Fisiognomía e IA: qué buscan exactamente los usuarios y por qué esta consulta es un indicador de un problema crítico en el ecosistema académico

La búsqueda «pdf physiognomy in the age of ai researchgate» refleja un intento de encontrar trabajos académicos que vinculan la antigua práctica de la fisiognomía con las tecnologías modernas de inteligencia artificial. La fisiognomía es un sistema de creencias desacreditado que afirma que los rasgos faciales de una persona pueden revelar su carácter, inteligencia, tendencias criminales o cualidades morales. Más información en la sección Detección de deepfakes.

Históricamente, esta práctica se utilizó para justificar la segregación racial, la eugenesia y la discriminación (S007). Hoy regresa no en forma de manifiestos abiertos, sino enmascarada bajo objetividad algorítmica.

⚠️ Qué representa la «fisiognomía digital» contemporánea en el contexto de la IA

En la era del aprendizaje automático, la fisiognomía ha cobrado nueva vida a través de algoritmos de reconocimiento facial que supuestamente pueden determinar características de personalidad, orientación sexual, opiniones políticas o propensión al crimen basándose en el análisis de fotografías (S001).

Estos sistemas se disfrazan de «análisis objetivo de datos», utilizando terminología de redes neuronales y significancia estadística, pero en esencia reproducen las mismas suposiciones desacreditadas sobre la conexión entre apariencia y cualidades internas. El reconocimiento biométrico se convierte en una herramienta mediante la cual viejos prejuicios obtienen un nuevo estatus legítimo.

- Fisiognomía digital

- Uso de algoritmos de visión por computadora para inferir características personales o conductuales basándose en el análisis facial. Es peligrosa porque el envoltorio tecnológico oculta la ausencia de relación causal entre apariencia y cualidades internas.

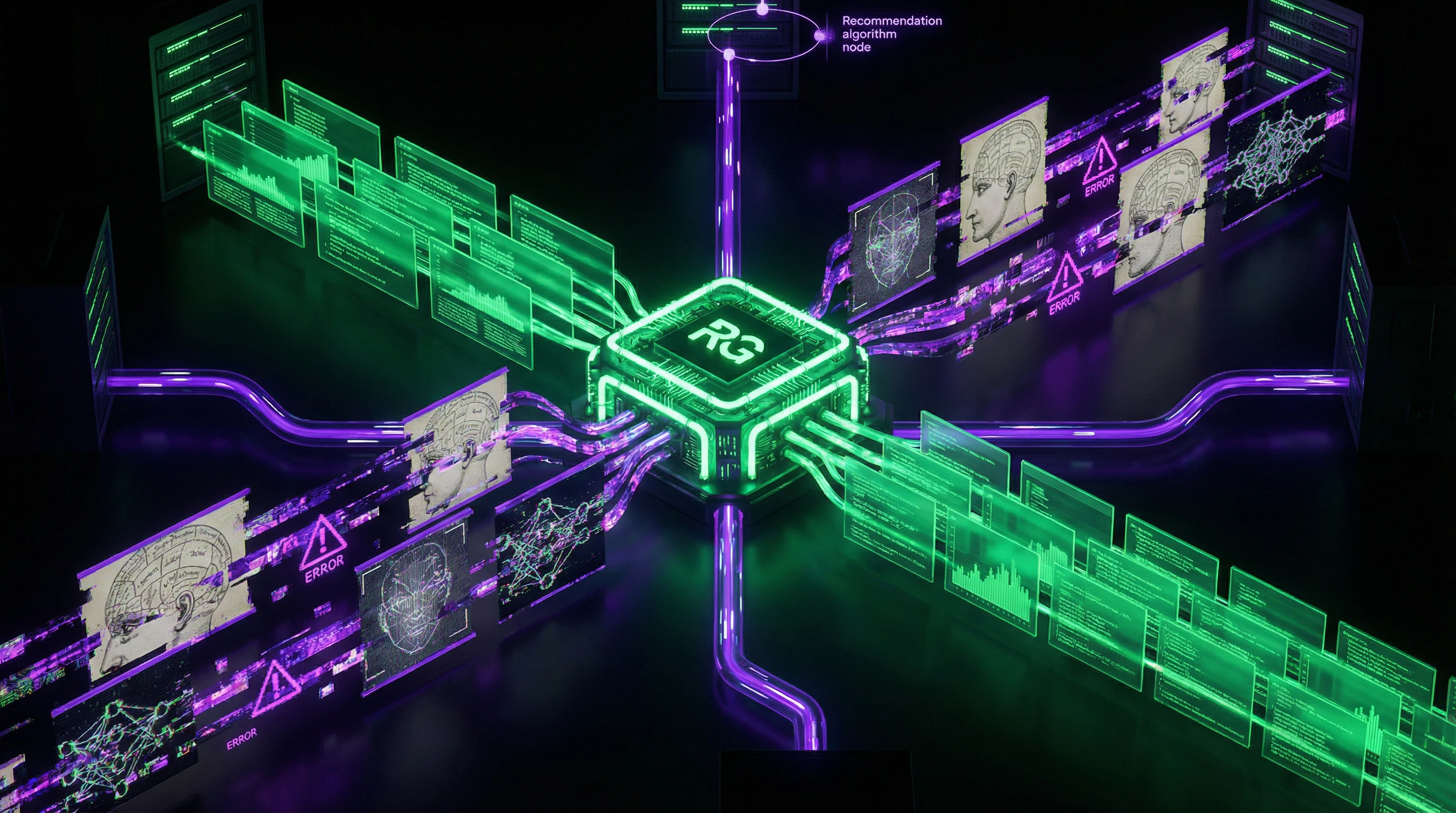

- ResearchGate como vector de difusión

- La plataforma crea una apariencia de legitimidad académica para trabajos que no han pasado por una revisión rigurosa por pares. Un preprint subido allí adquiere un aura de cientificidad simplemente por estar alojado entre millones de usuarios.

🔎 Por qué ResearchGate se convierte en canal de difusión de prácticas pseudocientíficas

ResearchGate se posiciona como plataforma para compartir trabajos científicos, pero la ausencia de revisión previa a la publicación la convierte en un vertedero de materiales no verificados (S003). Cualquier investigador puede subir un preprint que obtendrá apariencia de legitimidad académica simplemente por estar alojado en la plataforma.

Esto crea la ilusión de consenso científico en torno a ideas que no han pasado verificación crítica. El lector ve: muchas citas, alto índice h del autor, gráficos atractivos — y asume que el trabajo pasó un filtro de calidad. En realidad, no hay filtro.

🧩 Mecanismo de sustitución: cómo la pseudociencia se disfraza de investigación en IA

La táctica clave es usar jerga técnica y visualizaciones de datos para crear impresión de rigor científico. Un trabajo puede contener gráficos de precisión de clasificación, descripciones de arquitecturas de redes neuronales, referencias a datasets — pero basarse en suposiciones fundamentalmente erróneas sobre relaciones causales (S006).

| Señal de investigación legítima | Señal de enmascaramiento en IA-fisiognomía |

|---|---|

| Hipótesis claramente formulada sobre el mecanismo de conexión | Se asume que el algoritmo «encontrará por sí mismo» la conexión, sin fundamentación teórica |

| Se controlan variables confusoras (edad, iluminación, ángulo de cámara) | Se usa dataset «crudo» con múltiples variables no controladas |

| Resultados reproducibles en muestras independientes | Pruebas solo en un dataset o en submuestra del mismo dataset |

| Se discuten limitaciones y explicaciones alternativas | Los resultados se presentan como pruebas definitivas |

El problema se agrava porque los sistemas de IA generativa pueden crear textos de investigación con apariencia verosímil sin base empírica real. Un artículo puede estar escrito convincentemente, contener referencias a trabajos reales (a menudo distorsionando su sentido) y parecer resultado de investigación seria.

No es solo cuestión de calidad de publicaciones. La ética y seguridad de la IA dependen directamente de qué suposiciones se incorporan en los algoritmos. Si un sistema se entrena con trabajos que reproducen prejuicios históricos, los escalará.

Análisis Stillman: siete argumentos utilizados para justificar la "fisiognomía científica" en la era de la IA — y por qué parecen convincentes

Para comprender por qué los trabajos pseudocientíficos sobre fisiognomía encuentran audiencia en el ámbito académico, es necesario examinar las versiones más sólidas de los argumentos de sus defensores. Esto no implica estar de acuerdo con estas posiciones, pero permite identificar el mecanismo de persuasión y los puntos débiles en la lógica. Más información en la sección Mitos sobre la IA.

- «Las correlaciones existen objetivamente — simplemente las medimos». Si el algoritmo detecta correlaciones estadísticas entre rasgos faciales y características en el conjunto de datos, esto supuestamente es un hecho objetivo. El modelo «simplemente encuentra patrones» sin sesgos. Apelación al positivismo: si la correlación es reproducible, merece ser estudiada.

- «Los conjuntos de datos modernos y la capacidad computacional hacen que el análisis sea fundamentalmente diferente». En lugar de evaluaciones subjetivas de unos pocos observadores — millones de imágenes y redes neuronales profundas que revelan patrones sutiles. La escala de datos supuestamente supera las limitaciones del pasado.

- «La genética y el desarrollo embrionario vinculan el rostro y el cerebro». El rostro y el cerebro se forman a partir de los mismos tejidos embrionarios, están sujetos a los mismos factores genéticos. Por lo tanto, son posibles correlaciones entre morfología y características neurocognitivas. Suena científico y es más difícil de refutar sin conocimientos especializados.

- «La aplicación práctica justifica la investigación». Aplicaciones potenciales: mejora de la seguridad, diagnóstico temprano de trastornos, personalización de la educación. Argumento utilitarista: si la tecnología puede salvar vidas, las objeciones éticas son secundarias.

- «La crítica se basa en lo políticamente correcto, no en la ciencia». Los oponentes están motivados por la ideología, temen las «verdades incómodas» sobre las diferencias biológicas. Este marco convierte a los críticos en enemigos del progreso científico.

- «Las personas ya utilizan la fisiognomía intuitivamente — la IA simplemente lo formaliza». Las personas constantemente juzgan a otros por su apariencia. Si estos juicios contienen poder predictivo, la algoritmización puede hacer el proceso más justo, eliminando prejuicios individuales. Paradoja: la fisiognomía por IA se posiciona como lucha contra la discriminación.

- «Prohibir la investigación no detendrá el desarrollo — es mejor regular abiertamente». La tecnología se desarrollará en laboratorios cerrados. Las investigaciones públicas permiten a la sociedad comprender los riesgos y formar marcos regulatorios. La prohibición lleva el problema a la clandestinidad.

Cada uno de estos argumentos contiene semillas de lógica que los hacen convincentes para personas no familiarizadas con la historia de la fisiognomía o la metodología del aprendizaje automático. Precisamente por eso funcionan en el ámbito académico.

Los primeros cuatro argumentos apelan al optimismo tecnológico y la filosofía positivista de la ciencia: si podemos medirlo, entonces es real. Los últimos tres utilizan retórica social — acusación de ideología a los críticos, apelación al beneficio práctico y pragmatismo.

El problema es que estos argumentos ignoran la diferencia fundamental entre correlación en el conjunto de datos y relación causal en la realidad. El conjunto de datos no es la naturaleza, sino un artefacto social que refleja prejuicios históricos, métodos de recopilación de datos y selección de variables. El algoritmo no «descubre la verdad», sino que reproduce la estructura de los datos con los que fue entrenado.

La conexión entre la fisiognomía por IA y el retorno de la frenología demuestra que la escala de datos y el poder computacional no resuelven los problemas metodológicos — los agravan, otorgando falsa cientificidad a los resultados. El argumento genético suena convincente, pero ignora que la correlación a nivel poblacional no predice características individuales, y que factores sociales (nutrición, estrés, estilo de vida) influyen tanto en el rostro como en el comportamiento independientemente uno del otro.

El argumento utilitarista sobre el beneficio práctico contiene una premisa oculta: que la tecnología realmente funciona. Pero si la base no es confiable, la aplicación amplifica el daño. Acusar a los críticos de ser políticamente correctos es un recurso clásico que traslada la discusión de la metodología a la ideología, evitando objeciones científicas concretas.

El argumento sobre «formalizar la intuición» es paradójico: si las personas ya discriminan basándose en la apariencia, la algoritmización no elimina la discriminación, sino que la escala, otorgándole apariencia de objetividad. Esto amplifica el daño, no lo reduce.

El último argumento sobre regular abiertamente tiene sentido, pero solo si las investigaciones están metodológicamente fundamentadas. Si no lo están, la publicidad no salva — legitima la pseudociencia. La regulación debe comenzar con el criterio: ¿realmente funciona esto? — y no con la suposición de que funciona e intentar controlarlo.

Comprender estos argumentos es importante no para refutarlos (esa es la tarea de las siguientes secciones), sino para el diagnóstico: por qué personas inteligentes los aceptan. La respuesta radica en las trampas cognitivas que estos argumentos explotan — y en cómo la ética y seguridad de la IA requieren análisis crítico, no confianza ciega en la tecnología.

Base empírica: qué dicen realmente los datos sobre la relación entre apariencia y características personales — y por qué la mayoría de trabajos de "IA fisiognómica" son metodológicamente insostenibles

El análisis crítico de la base empírica muestra que la inmensa mayoría de trabajos que afirman la capacidad de la IA para determinar características personales por el rostro sufren problemas metodológicos fundamentales que invalidan sus conclusiones. Más detalles en la sección Errores y sesgos de la IA.

🧪 Problema 1: Confusión entre correlación y causalidad en presencia de múltiples factores de confusión

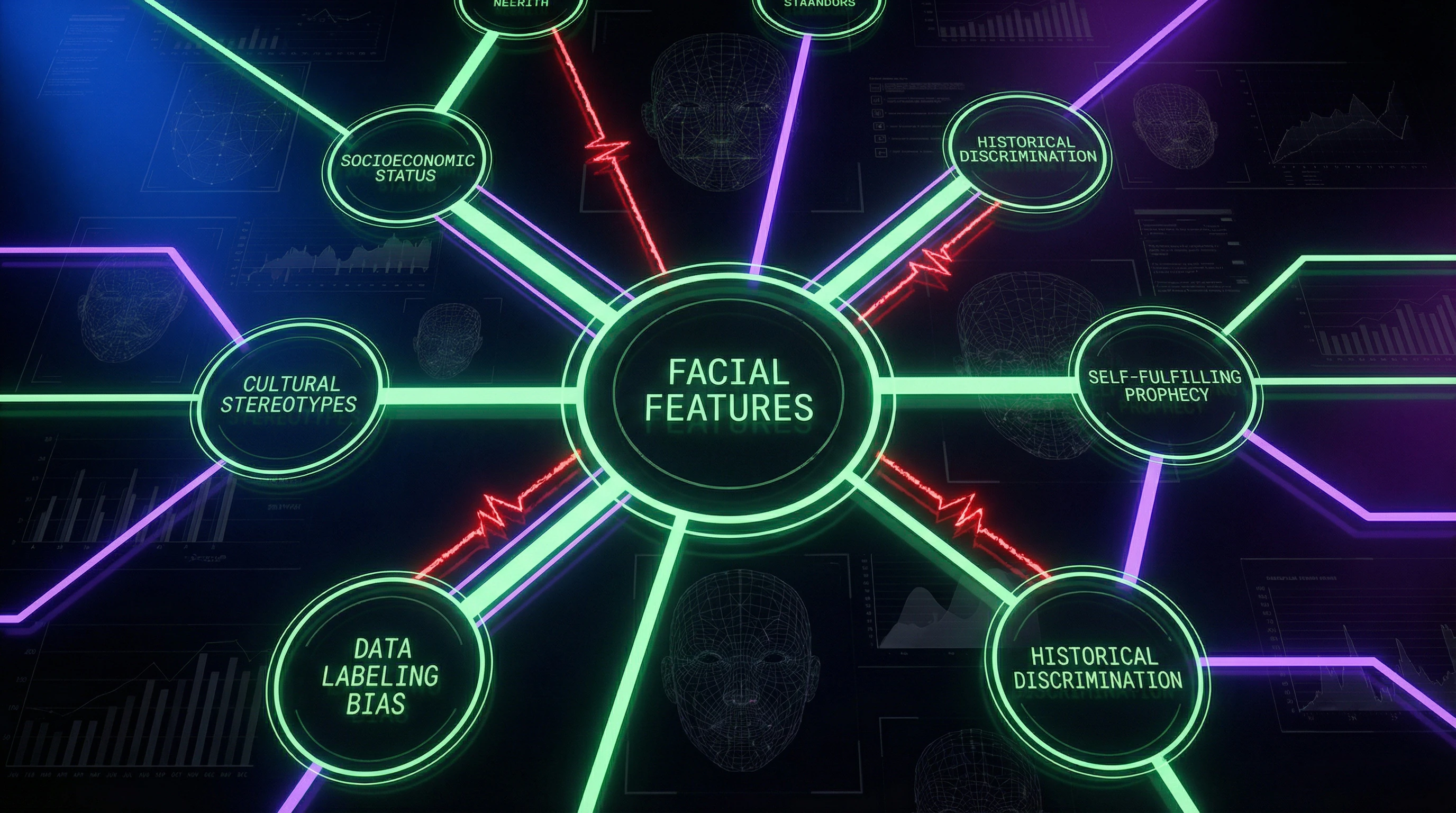

Incluso si el algoritmo detecta una relación estadística entre rasgos faciales y determinada característica en el dataset, esto no implica una relación causa-efecto. El rostro puede correlacionar con el estatus socioeconómico (a través del acceso a cosmética, nutrición, medicina), que a su vez correlaciona con educación, oportunidades, y posteriormente con las características medidas.

El modelo "predice" no cualidades internas, sino contexto social (S001).

📊 Problema 2: Los datasets reflejan prejuicios existentes, no la realidad objetiva

Los sistemas de aprendizaje automático se entrenan con datos creados por personas con prejuicios. Si en el dataset de entrenamiento las personas con determinados rasgos faciales están marcadas más frecuentemente como "criminales" debido a sesgos policiales o judiciales, el modelo aprenderá a reproducir ese sesgo, no a detectar una relación real.

Esto no es "medición objetiva", sino automatización de la discriminación (S004).

Más detalles sobre los mecanismos de este sesgo en el análisis del reconocimiento facial biométrico.

🧬 Problema 3: Los argumentos biológicos no están respaldados por investigaciones genéticas

Aunque el rostro y el cerebro se desarrollan efectivamente a partir de estructuras embrionarias relacionadas, las investigaciones genéticas no encuentran correlaciones significativas entre los genes que influyen en la morfología facial y los genes asociados con características cognitivas o de personalidad. Los factores comunes de desarrollo no implican una conexión funcional en el organismo maduro.

El argumento embriológico es una versión biologizada de una falacia lógica (S001).

⚠️ Problema 4: El efecto de profecía autocumplida distorsiona cualquier medición

Si las personas con determinados rasgos faciales son sistemáticamente tratadas de manera diferente debido a estereotipos existentes (por ejemplo, percibidas como menos competentes o más agresivas), esto afecta sus trayectorias vitales, oportunidades, estado psicológico. Cualquier correlación detectada puede ser resultado del impacto social, no de una conexión innata.

Separar estos efectos en datos observacionales es imposible.

🔎 Problema 5: Sesgo de publicación y p-hacking en investigaciones de IA

Los trabajos que no encuentran relación entre rasgos faciales y características personales se publican menos que aquellos con resultados "positivos". Esto crea una imagen distorsionada en la literatura. Además, con grandes datasets y múltiples características posibles, es fácil encontrar correlaciones estadísticamente significativas por azar.

Sin registro previo de hipótesis y corrección rigurosa para comparaciones múltiples, la mayoría de "descubrimientos" son falsos positivos (S002).

🧾 Problema 6: Falta de reproducibilidad de resultados en muestras independientes

La prueba crítica de cualquier afirmación científica es la reproducibilidad con datos independientes. La mayoría de trabajos sobre "IA fisiognómica" no superan esta prueba: los modelos entrenados con un dataset muestran una caída drástica de precisión en otras muestras, especialmente de contextos culturales diferentes.

Esto indica que los modelos aprenden artefactos específicos del dataset concreto, no patrones universales (S001).

📌 Qué dicen las revisiones sistemáticas y metaanálisis

Las revisiones sistemáticas de la literatura sobre la relación entre características faciales y rasgos de personalidad muestran que tras controlar los problemas metodológicos, los efectos desaparecen o se vuelven tan pequeños que carecen de significación práctica. Los tamaños de efecto suelen explicar menos del 5% de la variación, lo que hace que las predicciones individuales carezcan de sentido incluso si las diferencias grupales son estadísticamente significativas (S001).

El contexto de este problema es más amplio: véase cómo los algoritmos modernos repiten errores del siglo XIX y los principios del desarrollo responsable de IA.

Mecanismo del engaño: por qué personas inteligentes creen en la «fisiognomía científica» — trampas cognitivas y explotación de la confianza en las tecnologías

Comprender los mecanismos psicológicos que hacen convincentes las afirmaciones pseudocientíficas sobre fisiognomía es fundamental para desarrollar estrategias efectivas de resistencia. Más información en la sección Estadística y teoría de probabilidades.

🧩 Trampa 1: Heurística de representatividad e ilusión de validez

Las personas tienden a confiar en sus juicios intuitivos sobre otros basándose en la apariencia, porque estos juicios parecen rápidos y seguros. Cuando la tecnología supuestamente confirma estas intuiciones, surge la ilusión de validez: «Siempre sentí que esto era cierto, y ahora la ciencia lo ha demostrado».

En realidad, tanto la intuición como el algoritmo pueden reproducir los mismos estereotipos culturales sin poder predictivo real.

⚙️ Trampa 2: Determinismo tecnológico y fe en la «objetividad de las máquinas»

Existe la creencia generalizada de que los ordenadores y algoritmos están libres de prejuicios humanos porque «simplemente procesan números». Esto ignora el hecho de que los algoritmos son creados por personas, entrenados con datos recopilados y etiquetados por personas, y optimizados según objetivos definidos por personas (S008).

Cada etapa del desarrollo algorítmico —desde la selección de datos hasta la definición de métricas de éxito— está impregnada de valores y prejuicios humanos. La «objetividad de la máquina» es un mito que enmascara la responsabilidad de los desarrolladores.

🔁 Trampa 3: Sustitución de explicación por descripción mediante formalización matemática

Cuando la correlación se expresa mediante ecuaciones, gráficos e indicadores estadísticos, adquiere apariencia de explicación. «El modelo alcanzó una precisión del 73% en la predicción de X mediante rasgos faciales» suena como un descubrimiento científico (S002).

En realidad, esto es simplemente una descripción de patrones en un conjunto de datos específico sin comprensión de mecanismos causales. La forma matemática crea la ilusión de profundidad en la comprensión.

- Correlación en los datos ≠ relación causal

- Alta precisión en el conjunto de entrenamiento ≠ validez en datos nuevos

- Patrón estadístico ≠ mecanismo biológico

🧬 Trampa 4: Biologización de fenómenos sociales como defensa contra la disonancia cognitiva

Reconocer que las desigualdades sociales son resultado de factores históricos y estructurales requiere admitir la responsabilidad colectiva y la necesidad de cambios sistémicos. Las explicaciones biológicas (incluida la fisiognomía) eliminan esta responsabilidad: «Es simplemente la naturaleza, no podemos hacer nada» (S001).

Esto es psicológicamente más cómodo, especialmente para quienes se benefician del orden existente. El biologicismo se convierte en un instrumento de defensa contra la disonancia cognitiva, no en resultado de análisis científico.

Más información sobre cómo la fisiognomía con IA repite los errores del siglo XIX, y por qué la ética de la IA requiere un enfoque crítico hacia estos sistemas.

Conflictos en las fuentes y zonas de incertidumbre: donde incluso los críticos de la fisiognomía discrepan — y qué significa esto para la práctica

Incluso entre investigadores que critican los sistemas de IA fisiognómicos, existen desacuerdos sobre cuestiones clave. Esto no es una debilidad de la crítica — es señal de que el problema es más complejo de lo que parece a primera vista. Más detalles en la sección Sesgos cognitivos.

🔬 Desacuerdo 1: ¿Existen correlaciones válidas entre rostro y personalidad?

Una posición: cualquier correlación es un artefacto de problemas metodológicos y factores de confusión sociales. La segunda: son posibles conexiones muy débiles pero reales a través de la influencia hormonal en el desarrollo o efectos de autopresentación (personas con ciertos rasgos desarrollan estilos de interacción específicos en respuesta a las reacciones de otros).

Este debate define los límites de la investigación permisible (S001). Si existen correlaciones, incluso débiles, la pregunta deja de ser "¿investigar o no?" y se convierte en "¿cómo investigar sin causar daño?".

📊 Desacuerdo 2: ¿El problema está en la idea misma o en la implementación actual?

Primera posición: la fisiognomía es fundamentalmente errónea, las mejoras metodológicas no la salvarán. Segunda: los sistemas actuales fallan por deficiencias en datos y modelos, pero teóricamente son posibles enfoques más sofisticados.

Este desacuerdo impacta directamente la estrategia regulatoria: prohibición total o estándares metodológicos estrictos (S004). La elección entre ambos no es técnica, sino política.

🧾 Desacuerdo 3: El papel de las plataformas académicas en la difusión de investigaciones problemáticas

Un lado: plataformas como ResearchGate deberían implementar moderación estricta y eliminar contenido pseudocientífico. El otro teme que esto cree mecanismos de censura que podrían usarse contra investigaciones legítimas pero controvertidas.

El equilibrio entre apertura y calidad sigue siendo un problema sin resolver (S003). No existe un algoritmo universal que distinga "verdad incómoda" de "mentira conveniente".

⚙️ Incertidumbre: Cómo evaluar riesgos ante el rápido desarrollo tecnológico

Los sistemas fisiognómicos actuales son ineficaces. Pero no está claro si esto seguirá siendo cierto con la aparición de enfoques radicalmente nuevos — integración de datos genéticos, estudios longitudinales, neuroimagen.

El principio de precaución sugiere limitaciones incluso ante la incertidumbre. Pero esto entra en conflicto con el principio de libertad de investigación (S008).

- Qué significa esto para la práctica

- Un crítico de la fisiognomía no puede simplemente decir "esto es falso". Debe señalar qué mecanismos específicos son erróneos, bajo qué condiciones podrían ser válidos, y por qué las pruebas actuales son insuficientes. Esto requiere más trabajo, pero es la única forma de ser convincente.

- Por qué los desacuerdos no debilitan la posición de los críticos

- La existencia de debates dentro de la comunidad crítica demuestra que no es ideológica. Los ideólogos no debaten — declaran. Los investigadores debaten porque buscan la verdad, no la victoria.

Para periodistas, reguladores e investigadores esto significa: exijan transparencia, no consenso. ¿Qué supuestos específicos hace el autor? ¿Dónde podrían estar equivocados? ¿Qué datos podrían refutarlos?

Protocolo de verificación: siete preguntas que desenmascararán un trabajo pseudocientífico sobre «IA fisiognómica» en tres minutos — checklist para investigadores, periodistas y reguladores

Herramienta práctica para evaluar rápidamente la validez científica de trabajos que afirman que la IA puede determinar características personales por la apariencia. Más información en la sección Fundamentos de epistemología.

✅ Pregunta 1: ¿Ha pasado el trabajo por revisión por pares independiente en una revista con factor de impacto superior a 3.0?

Los preprints en ResearchGate o arXiv no pasan por verificación rigurosa. La publicación en revista revisada por pares no garantiza calidad, pero su ausencia es una señal de alarma.

Verifique la revista en las bases Scopus o Web of Science. Si el trabajo existe solo como preprint durante más de un año, es sospechoso (S003).

✅ Pregunta 2: ¿Están registradas la hipótesis y el plan de análisis antes de la recogida de datos?

El registro previo (preregistration) en plataformas como Open Science Framework protege contra p-hacking y HARKing (formulación de hipótesis después de obtener resultados).

Si los autores no pueden proporcionar enlace al preregistro, los resultados pueden ser producto de ajuste a los datos (S002).

✅ Pregunta 3: ¿Se ha validado el modelo en una muestra independiente de otro contexto cultural?

La validación solo en parte del mismo dataset (train-test split) es insuficiente. Se requiere verificación con datos completamente independientes, recogidos en otro país, en otro momento, por otros investigadores.

Si no existe tal verificación, los resultados pueden ser específicos del dataset concreto (S001).

⛔ Pregunta 4: ¿Se controlan los confusores obvios (edad, sexo, raza, nivel socioeconómico)?

Si el modelo «predice» una característica, pero los autores no demuestran que la predicción se mantiene tras controlar variables sociodemográficas, el resultado puede explicarse completamente por estos confusores.

Exija tablas con resultados de análisis multifactorial (S001).

⛔ Pregunta 5: ¿Se han divulgado los datos y el código para verificación independiente?

La reproducibilidad es la base de la ciencia. Si los autores no proporcionan acceso a los datos (o al menos a datos sintéticos con las mismas propiedades) y al código de análisis, los resultados son imposibles de verificar.

Las referencias a «confidencialidad» o «secreto comercial» en un trabajo académico son inaceptables (S002).

⛔ Pregunta 6: ¿Se discuten los riesgos éticos y la posibilidad de abusos?

Un trabajo legítimo en un área sensible debe incluir discusión detallada de riesgos potenciales: cómo los resultados pueden usarse para discriminación, perfilado, violación de privacidad.

La ausencia de tal discusión indica que los autores o no son conscientes de las consecuencias, o las ocultan intencionadamente. Familiarícese con los principios de desarrollo responsable de IA.

⛔ Pregunta 7: ¿Se utiliza lenguaje característico de la pseudociencia?

Señales de alarma en el texto: afirmaciones absolutas sin matices («la IA determina con precisión criminales por el rostro»), apelación a la autoridad sin pruebas, ausencia de discusión de limitaciones, acusaciones a críticos de «sesgo» o «corrección política».

- Lenguaje científico

- «El modelo mostró una correlación r = 0.32 (p < 0.05) controlando edad y sexo, pero el efecto puede explicarse por diferencias culturales en la expresión emocional».

- Lenguaje pseudocientífico

- «Nuestra IA reveló la conexión oculta entre rasgos faciales y personalidad, que los científicos ignoraban por corrección política».

Si el trabajo contiene 4+ señales de alarma de esta lista, no merece confianza. Si contiene 2–3, requiere lectura crítica y consulta con un metodólogo. Si no hay señales de alarma, el trabajo puede ser legítimo — pero esto no garantiza su validez.

Recuerde: la ausencia de evidencia de daño no es evidencia de ausencia de daño. La carga de la prueba recae en los autores que afirman que la IA puede determinar características personales por la apariencia. Familiarícese con el análisis de la IA fisiognómica y las amenazas a las libertades civiles.