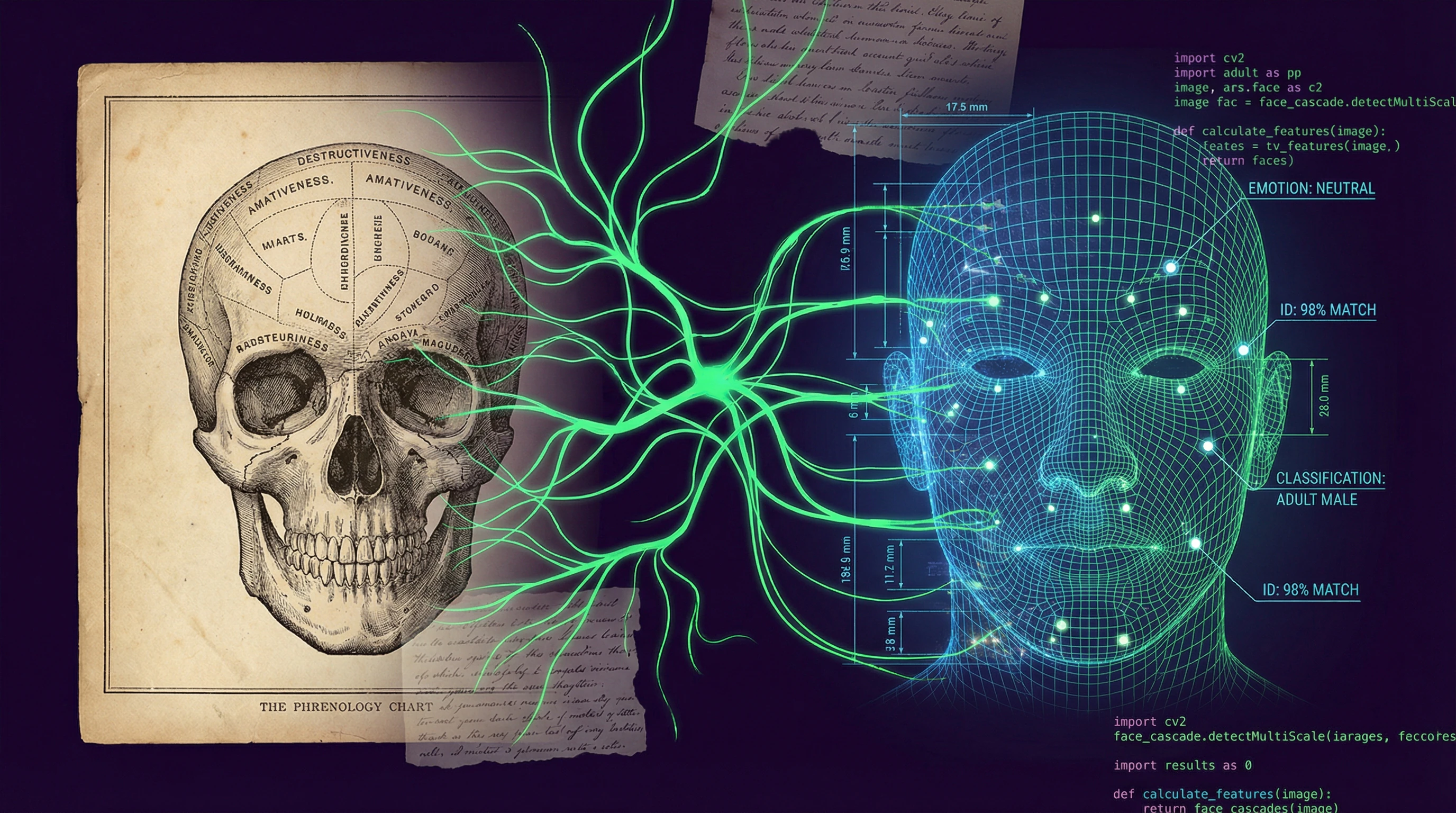

IA fisiognómica: cuando los algoritmos juzgan a las personas por cráneos y narices — definición del fenómeno que los gigantes tecnológicos prefieren ignorar

La inteligencia artificial fisiognómica es la práctica de utilizar visión por computador para inferir jerarquías de composición corporal, estatus de clase protegida, carácter percibido, capacidades y resultados sociales futuros basándose en características físicas o conductuales (S003, S004). El espectro abarca sistemas de reconocimiento de emociones faciales, algoritmos de predicción de inclinaciones criminales por la forma del cráneo y evaluación de la "fiabilidad" de una persona por la distancia entre los ojos.

Esto no es una hipótesis sobre el futuro. Tales sistemas ya están desplegados en fuerzas del orden, instituciones crediticias y sistemas de contratación (S008). Los gigantes tecnológicos guardan silencio al respecto, porque el fenómeno requiere reconocer: han resucitado la fisiognomía del siglo XIX y le han dado GPU.

Tres mecanismos de la IA fisiognómica

- Clasificación

- División de personas por rasgos físicos: color de piel, forma del rostro, estructura ósea, distancia entre los ojos. El algoritmo extrae estos rasgos de la imagen automáticamente.

- Jerarquización

- Asignación de características grupales basadas en la clasificación: unos grupos son declarados más fiables, inteligentes o respetuosos de la ley que otros. Esto no es descripción, sino clasificación jerárquica.

- Predicción

- Afirmación de que el algoritmo puede determinar el comportamiento futuro: si una persona se convertirá en criminal, trabajador exitoso o ciudadano leal (S003). Este es el paso de la clasificación al destino.

Por qué la visión por computador es el portador ideal para la fisiognomía del siglo XXI

La visión por computador es el vector central para la IA fisiognómica (S003, S004). Los sistemas se entrenan con enormes conjuntos de datos de rostros etiquetados, donde cada imagen está vinculada con etiquetas — sexo, edad, raza, emoción.

El algoritmo aprende a encontrar correlaciones entre píxeles y categorías sociales, sin comprender que estas categorías son constructos sociales, no hechos biológicos. Resultado: la máquina reproduce y amplifica los prejuicios humanos, otorgándoles apariencia de objetividad.

Frontera entre biometría y fisiognomía

| Identificación biométrica | Inferencia fisiognómica |

|---|---|

| Coteja el rostro con una base de datos para establecer identidad | Afirma que puede inferir cualidades internas desde la apariencia |

| Técnicamente posible y a veces justificada | Científicamente insostenible y éticamente inadmisible |

| Respuesta: «Esta es la persona X» | Respuesta: «Esta persona es criminal / no fiable / peligrosa» |

La frontera es difusa: muchos sistemas comienzan con identificación, pero luego añaden capas de inferencia sobre carácter, intenciones o comportamiento futuro (S003). Esto transforma una herramienta de control en una herramienta de condena.

Más detalles sobre los mecanismos de esta transformación en el artículo «IA-fisiognomía y el retorno de la frenología».

Cinco argumentos en defensa de la IA fisiognómica — y por qué parecen convincentes para quienes no conocen la historia de la ciencia

Antes de desmontar la IA fisiognómica con pruebas, es necesario entender por qué esta idea resulta atractiva. El steelmanning — presentar la versión más sólida del argumento oponente — muestra que los defensores de la IA fisiognómica se apoyan en cinco tesis aparentemente lógicas. Más detalles en la sección Medios sintéticos.

🔬 Primer argumento: las correlaciones existen, y los algoritmos las encuentran

Los defensores afirman: si un algoritmo detecta una relación estadística entre la forma del rostro y determinado comportamiento, significa que esa relación es real. La máquina no tiene prejuicios — simplemente analiza datos.

Si un modelo predice comportamiento criminal con una precisión del 70%, esto es mejor que adivinar al azar. El problema es que correlación no equivale a causalidad, y un 30% de acusaciones falsas no es un margen de error estadístico, sino vidas reales.

📊 Segundo argumento: las emociones se reflejan en el rostro — es un hecho probado de la psicología

Los partidarios citan las investigaciones de Paul Ekman sobre expresiones faciales universales. Si la ira, el miedo y la alegría tienen patrones mímicos reconocibles, ¿por qué no entrenar un algoritmo para reconocerlos?

Sin embargo, los críticos señalan: la teoría de Ekman simplifica la diversidad cultural de las expresiones emocionales e ignora el contexto. La expresión facial no es una ventana al alma, sino una señal social que depende de la cultura, la situación y quién observa.

🧬 Tercer argumento: la genética influye en la apariencia y el comportamiento — por qué la IA no puede captar esta conexión

Los factores genéticos efectivamente influyen tanto en los rasgos físicos como en algunas tendencias conductuales. Si ciertos marcadores genéticos se correlacionan con la forma del rostro y con la predisposición a la impulsividad, el algoritmo teóricamente podría detectar esta conexión.

Suena científico — pero ignora que el comportamiento está determinado por una interacción compleja de genes, entorno y cultura, no por la forma de la nariz. Es reduccionismo disfrazado de estadística.

⚙️ Cuarto argumento: la tecnología es neutral — el problema está en los datos, no en el método

Este es el argumento más peligroso: la visión por computador en sí misma no es racista, simplemente fue entrenada con datos sesgados. Corrijan el dataset — y el problema está resuelto.

- Las lógicas fisiognómicas están integradas en el mecanismo técnico de la visión por computador aplicada a personas (S003, S004)

- El problema no está en los datos — el problema está en la idea misma de que la apariencia puede predecir cualidades internas

- Incluso un dataset perfecto no salva del error conceptual

🛡️ Quinto argumento: rechazar la tecnología es rechazar la seguridad y la eficiencia

El último argumento apela al miedo: si prohibimos la IA fisiognómica, no podremos prevenir crímenes, identificar terroristas u optimizar la contratación.

Es un falso dilema. Existen métodos alternativos de evaluación de riesgos basados en el comportamiento, no en la apariencia. Pero el miedo es un motivador poderoso, y este argumento funciona con políticos y directivos corporativos.

Para un análisis profundo de los mecanismos por los cuales estos argumentos se vuelven convincentes, véase el análisis del retorno de la frenología en la era de la IA y los protocolos de debunking de afirmaciones pseudocientíficas.

Base científica contra la IA fisiognómica: por qué resucitar la fisiognomía y la frenología no es progreso, sino regresión medieval con GPU

La resurrección de las pseudociencias de la fisiognomía y la frenología mediante visión por computadora y aprendizaje automático es motivo de preocupación urgente (S003, S004). El análisis histórico demuestra que la fisiognomía y la frenología justificaron la esclavitud, el colonialismo, la esterilización forzada y el genocidio.

El renacimiento de estas teorías mediante IA crea el riesgo de repetir estos horrores en la era digital, pero con una escala y velocidad que el siglo XIX no podía imaginar.

📊 Contexto histórico: cómo la fisiognomía justificó el genocidio

En el siglo XIX, la fisiognomía y la frenología eran ciencia convencional. Cesare Lombroso afirmaba que los criminales podían identificarse por la forma del cráneo. Los frenólogos medían cabezas para demostrar la superioridad de los europeos sobre africanos y asiáticos. Más información en la sección Deepfakes.

Estas teorías se utilizaron para justificar la esclavitud en Estados Unidos, el colonialismo en África y Asia, y programas de eugenesia en Europa y América. Los nazis aplicaron mediciones fisiognómicas para clasificar razas y enviar personas a campos de concentración. A mediados del siglo XX, la comunidad científica rechazó estas teorías como pseudociencia, pero los algoritmos las están resucitando.

🧪 Investigación contemporánea: por qué los algoritmos de reconocimiento emocional no funcionan

Numerosos estudios demuestran la ineficacia de la IA fisiognómica. Los sistemas de reconocimiento emocional muestran precisión no superior al azar en condiciones reales, especialmente para personas de origen no europeo.

Los algoritmos de predicción de criminalidad facial reproducen prejuicios raciales: clasifican con mayor frecuencia a personas de piel oscura como potenciales criminales, independientemente del comportamiento real. Esto no es un error de calibración, es un problema fundamental del método (S003).

- Sistemas de reconocimiento emocional: precisión del 50–60% en grupos subrepresentados (mujeres, personas mayores, razas no blancas)

- Algoritmos de criminalidad: sobrestimación sistemática de riesgos para afroamericanos

- Sistemas biométricos: denegación de acceso para personas con particularidades neurológicas

🧾 Tres escándalos que expusieron el peligro de la IA fisiognómica

HireVue: el sistema de análisis facial para evaluar candidatos laborales fue acusado de discriminación. El algoritmo evaluaba no las competencias, sino la mímica y el tono de voz, lo que perjudicaba a personas con autismo, particularidades neurológicas y representantes de culturas no occidentales.

Reconocimiento uigur: el sistema chino de reconocimiento facial de uigures se utilizó para detenciones masivas y envío a campos de reeducación.

COMPAS: el algoritmo para predecir reincidencia en Estados Unidos sobrestimaba sistemáticamente los riesgos para afroamericanos, lo que resultaba en sentencias más severas (S003).

🔎 Metaanálisis: qué dicen las revisiones sistemáticas sobre la precisión

Las revisiones sistemáticas de la literatura demuestran que la IA fisiognómica no alcanza la precisión declarada en pruebas independientes. Los estudios financiados por desarrolladores muestran precisión del 80–90%, pero las verificaciones independientes reducen esta cifra al 50–60%, nivel de acierto aleatorio.

| Condición de prueba | Precisión declarada | Verificación independiente | Conclusión |

|---|---|---|---|

| Laboratorio controlado | 80–90% | 70–75% | Sobreestimación en condiciones ideales |

| Condiciones reales | — | 50–60% | Nivel de acierto aleatorio |

| Grupos subrepresentados | — | 30–45% | Instrumento de discriminación |

La precisión cae drásticamente para grupos subrepresentados: mujeres, personas mayores, razas no blancas. Esto significa que los sistemas funcionan como instrumentos de discriminación, no de evaluación objetiva (S003, S004).

Para más detalles sobre los mecanismos de estos errores, consulte el análisis del retorno de la frenología en algoritmos contemporáneos y los principios de desarrollo responsable de IA.

Mecanismos del error: por qué la IA fisiognómica confunde correlación con causalidad y crea profecías autocumplidas

La IA fisiognómica comete un error epistemológico fundamental: confunde correlación con causalidad. Si el algoritmo detecta que personas con determinada forma facial son arrestadas con mayor frecuencia, concluye que la forma facial causa comportamiento criminal. Más información en la sección Detección de deepfakes.

En realidad, la causa es el racismo sistémico: la policía detiene y arresta con mayor frecuencia a personas de determinada apariencia, creando un dataset sesgado (S003).

El algoritmo ve la conexión entre rostro y arresto, pero no ve la pobreza, la vigilancia policial y la desigualdad estructural como causas comunes. El sistema castiga a las personas por su posición social, disfrazándolo de evaluación objetiva de riesgo.

🧬 Variables de confusión: variables ocultas que los algoritmos no detectan

Una variable de confusión es una variable oculta que influye simultáneamente en la apariencia y en el comportamiento. La pobreza afecta a la nutrición (se refleja en el rostro) y a la probabilidad de arresto (debido a la vigilancia policial en barrios desfavorecidos).

Resultado: el algoritmo crea la ilusión de una relación causal entre rasgos faciales y criminalidad, aunque ambas variables dependen de un tercer factor: el estatus socioeconómico.

🔁 Bucles de retroalimentación: cómo la IA fisiognómica crea la realidad que predice

La profecía autocumplida es un mecanismo clave de daño. Si el algoritmo predice criminalidad por apariencia, la policía intensifica la vigilancia sobre esas personas.

- La vigilancia intensificada conduce a mayor número de arrestos

- Más arrestos confirman la predicción del algoritmo

- El sistema crea pruebas de su propia validez

- Estas pruebas son un artefacto de la discriminación, no realidad objetiva (S003, S004)

🧷 Reduccionismo: por qué el comportamiento complejo no puede reducirse a píxeles

El comportamiento humano está determinado por la interacción de genética, epigenética, neurobiología, psicología, entorno social, cultura, economía y azar. La IA fisiognómica reduce esta complejidad a patrones de píxeles.

Esto no es una simplificación: es un error categorial, comparable a intentar predecir el clima por el color del cielo. Cierta información está contenida en la apariencia, pero es insuficiente para predicciones fiables sobre carácter o comportamiento futuro (S003).

Más información sobre cómo la IA reproduce errores históricos de la ciencia en IA fisiognómica y el retorno de la frenología.

Conflictos en las fuentes: dónde los investigadores discrepan y por qué es importante para comprender el problema

La comunidad científica no es unánime en la evaluación de la IA fisionómica. Tres posiciones principales —abolicionismo, reformismo, tecnooptimismo— reflejan una división fundamental en la comprensión de si la tecnología puede corregirse o debe prohibirse. Más detalles en la sección Sesgos cognitivos.

Estas discrepancias no son académicas. Determinan qué leyes se aprobarán, qué sistemas se desplegarán, qué derechos se protegerán.

🧩 Abolicionistas contra reformistas: ¿se puede corregir la IA fisionómica o debe prohibirse?

Los abolicionistas, incluidos los autores del estudio de Fordham Law, afirman: las lógicas fisionómicas están integradas en el mecanismo técnico de la visión por computadora aplicada a personas (S003, S004). El problema no puede resolverse mejorando datos o algoritmos: se necesita una prohibición total.

Los reformistas objetan: la tecnología es neutral, el problema está en su aplicación. Proponen auditoría de algoritmos, transparencia y rendición de cuentas. Los abolicionistas responden: la auditoría no puede corregir un concepto fundamentalmente defectuoso.

El desacuerdo aquí no es sobre detalles de implementación. Es un debate sobre si existe siquiera una solución técnica para un problema que por su naturaleza no es técnico, sino conceptual.

🔬 Debate sobre la precisión: ¿es suficiente un 70% para tomar decisiones sobre vidas humanas?

Los tecnooptimistas señalan la mejora en la precisión de los algoritmos: los sistemas actuales alcanzan un 70–80% de precisión en condiciones de laboratorio. Los críticos responden: 70% de precisión significa 30% de errores, y cuando se trata de libertad, trabajo o vida, esto es inaceptable.

Además, la precisión disminuye para las minorías, creando discriminación sistemática. El debate no está resuelto, pero el consenso se desplaza hacia los críticos: incluso una alta precisión promedio no justifica el uso de la tecnología si discrimina a grupos vulnerables (S003).

- La precisión promedio del 70–80% oculta la dispersión entre grupos demográficos

- Un error del 30% es inadmisible para decisiones que afectan vidas

- El error sistemático para minorías no es un problema técnico, sino de justicia

📊 Desacuerdos sobre regulación: prohibición, moratoria o autorregulación de la industria

El estudio de Fordham Law recomienda a los legisladores prohibir la IA fisionómica en espacios públicos (S003, S004). La industria propone autorregulación mediante códigos éticos y estándares voluntarios.

Los gobiernos consideran opciones intermedias: moratoria sobre ciertas aplicaciones, auditoría obligatoria, requisitos de transparencia. Los desacuerdos reflejan un conflicto de intereses: la industria quiere preservar un mercado rentable, investigadores y activistas priorizan los derechos humanos.

- Prohibición

- Exclusión total de la IA fisionómica del espacio público. Posición: la tecnología es discriminatoria por naturaleza.

- Moratoria

- Suspensión temporal del despliegue hasta desarrollar estándares. Posición: se necesita tiempo para regular.

- Autorregulación

- Códigos éticos y estándares voluntarios de la industria. Posición: el mercado se corregirá solo.

Para ciudadanos y legisladores es importante entender: la ausencia de consenso no significa incertidumbre. Significa que la decisión se tomará políticamente, no científicamente. La elección entre prohibición, moratoria y autorregulación es una elección entre proteger los derechos humanos y los intereses de la industria.

Consulte el análisis de cómo los algoritmos modernos repiten errores del siglo XIX, y el protocolo de desarrollo responsable de IA.

Anatomía cognitiva del mito: qué mecanismos psicológicos hacen que las personas crean en la IA fisiognómica

La IA fisiognómica explota sesgos cognitivos profundamente arraigados. Comprender estos mecanismos explica por qué una pseudociencia desacreditada encuentra nuevos defensores en la era del big data y el aprendizaje automático. Más información en la sección Psicología de la creencia.

⚠️ Esencialismo: por qué el cerebro quiere creer que la apariencia refleja la esencia

El esencialismo psicológico es la tendencia a atribuir a las personas una esencia interna inmutable que determina sus propiedades. El cerebro busca automáticamente conexiones entre apariencia y carácter, simplificando la navegación social.

La IA fisiognómica explota esta tendencia, ofreciendo confirmación tecnológica de creencias intuitivas pero falsas. Las personas creen que el algoritmo revelará la esencia oculta de una persona porque esto coincide con el funcionamiento de su propio cerebro.

🧠 Efecto halo: cómo la primera impresión de la apariencia distorsiona todos los juicios posteriores

El efecto halo es un sesgo cognitivo en el que la impresión general sobre una persona influye en la evaluación de sus cualidades específicas. Las personas atractivas parecen más inteligentes, honestas y competentes.

La IA fisiognómica institucionaliza el efecto halo: el algoritmo se entrena con datos donde el atractivo se correlaciona con el éxito (las personas atractivas son contratadas y promovidas con más frecuencia), y reproduce esta discriminación como evaluación objetiva.

🕳️ Ilusión de objetividad: por qué los números y algoritmos parecen imparciales

Las personas tienden a confiar más en las evaluaciones cuantitativas que en los juicios cualitativos. El algoritmo produce un número —73% de probabilidad de comportamiento criminal— y ese número parece un hecho objetivo, no el resultado de un modelo sesgado entrenado con datos sesgados.

- El número se percibe como hecho, no como interpretación

- El algoritmo parece neutral, aunque refleja los prejuicios de los datos

- La ilusión de objetividad enmascara la discriminación bajo precisión científica (S003, S004)

🧷 Determinismo tecnológico: la creencia en la inevitabilidad y neutralidad del progreso

El determinismo tecnológico es la convicción de que el desarrollo tecnológico sigue su propia lógica, independiente de los valores sociales, y que el progreso es inevitable y beneficioso. Esta ideología lleva a las personas a aceptar la IA fisiognómica como parte inevitable del futuro, en lugar de evaluar críticamente sus consecuencias.

El determinismo suprime la agencia: si la tecnología es inevitable, ¿para qué resistirse? En realidad, el desarrollo tecnológico es resultado de decisiones humanas, y estas decisiones pueden cambiarse. Más sobre el legado que ignoramos en el análisis de la historia de la IA y sus raíces sociales.

Estos cuatro mecanismos funcionan sinérgicamente: el esencialismo crea la disposición a creer, el efecto halo proporciona refuerzo emocional, la ilusión de objetividad enmascara el prejuicio, y el determinismo bloquea la resistencia crítica. Juntos forman una trampa cognitiva de la que es difícil escapar sin un análisis consciente de los propios sesgos.

Protocolo de verificación: siete preguntas que desenmascarán la IA fisiognómica en treinta segundos

La investigación de Fordham Law propone conceptualizar la IA fisiognómica y ofrecer recomendaciones políticas para su regulación. Aquí están las siete preguntas que desenmascarán el sistema en medio minuto. Más detalles en la sección Karma y reencarnación.

- ¿El sistema fue entrenado con una muestra representativa o con una base de datos conveniente? Si usa fotos de internet, ya hay sesgo.

- ¿Los desarrolladores publicaron métricas de error por grupos demográficos? El silencio = ocultación del problema.

- ¿El sistema predice comportamiento o solo clasifica rasgos visuales? Si es lo primero, es fisiognomía; si es lo segundo, puede ser legítimo (pero rara vez).

- ¿Existe verificación independiente o solo pruebas internas de la empresa? La validación externa es obligatoria.

- ¿El sistema se usa para tomar decisiones sobre personas (contratación, crédito, aplicación de la ley) o solo para análisis? Lo primero es una línea roja.

- ¿Las personas sobre las que opera el sistema lo saben y pueden objetar? Si no, es una violación de la transparencia.

- ¿Existe un mecanismo de apelación o revisión de las decisiones tomadas por el sistema? La ausencia = ausencia de justicia.

Si la respuesta a cuatro o más preguntas es "no" o "desconocido", estás ante una IA fisiognómica disfrazada de objetividad. (S001), (S004)

Los periodistas pueden usar esta lista de verificación al examinar las afirmaciones de las empresas. Los legisladores, al desarrollar estándares. Los ciudadanos, al evaluar sistemas que afectan sus vidas.

La trampa de la IA fisiognómica es que parece más objetiva que el juicio humano. En realidad, solo oculta los prejuicios dentro de las matemáticas. El uso responsable de la IA comienza por hacer estas preguntas antes del despliegue del sistema, no después del escándalo.

El protocolo funciona porque ataca no la tecnología, sino la lógica de su aplicación. La IA fisiognómica no cae bajo la presión de la crítica, sino bajo la presión de la transparencia. El desmantelamiento comienza con preguntas, no con respuestas.