Qué es el reconocimiento facial biométrico en sentido jurídico y técnico — y por qué no es simplemente una «fotografía»

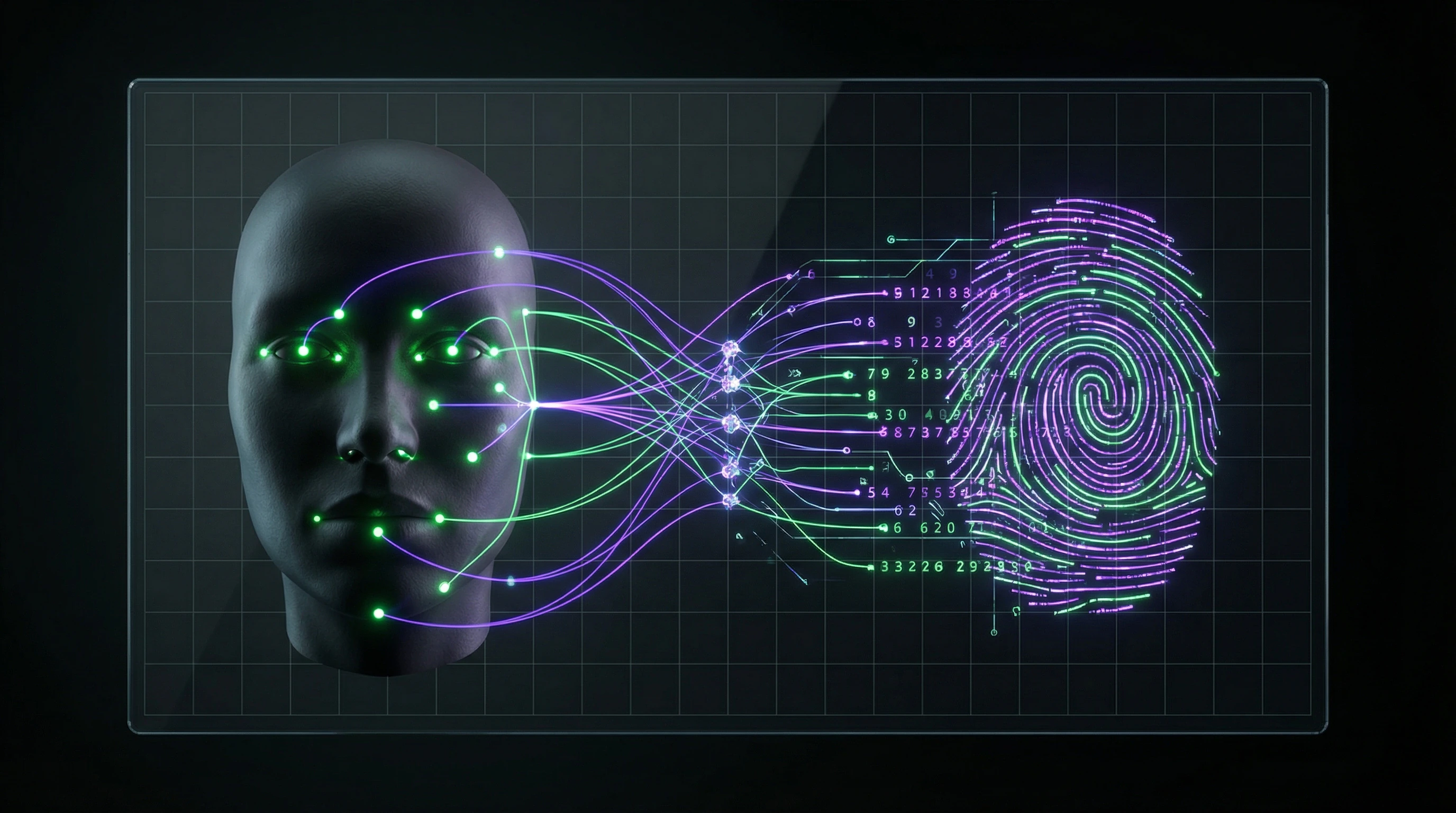

El reconocimiento facial biométrico (facial recognition) es una tecnología automatizada de identificación personal basada en características fisiológicas únicas del rostro. A diferencia de una fotografía, el sistema crea un modelo matemático: una «plantilla biométrica» o «faceprint» — un conjunto de valores numéricos que describen las distancias entre puntos clave del rostro (S001).

La plantilla contiene la distancia entre pupilas, el ancho de la nariz, la profundidad de las cuencas oculares, el contorno de la mandíbula. Esto permite cotejar rostros bajo diferentes condiciones de iluminación y ángulos, pero crea un problema: el rostro no se puede ocultar en el espacio público, a diferencia de las huellas dactilares o el iris. Más detalles en la sección Fundamentos del aprendizaje automático.

📌 Arquitectura técnica: cuatro etapas desde la imagen hasta la decisión

- Detección

- El sistema separa el rostro del fondo y otros objetos en la imagen.

- Normalización

- Corrección del ángulo de inclinación, escala e iluminación para unificar los datos.

- Extracción de características

- La red neuronal analiza la imagen y crea un vector de entre 128 y 512 números (S001).

- Cotejo

- El vector obtenido se compara con la base de datos, calculando el grado de similitud. Si supera el umbral establecido, se produce una coincidencia.

⚖️ Calificación jurídica: por qué la biometría requiere protección reforzada

En el derecho internacional, los datos biométricos constituyen una categoría especial de datos personales. El RGPD los clasifica como «categorías especiales», cuyo tratamiento está prohibido por regla general (S001).

Las excepciones solo son posibles con consentimiento explícito del interesado, protección de intereses vitales o cumplimiento de obligaciones en el ámbito del derecho laboral. La legislación española también exige consentimiento por escrito para el tratamiento de datos personales biométricos.

🧱 Diferencia crítica: imposibilidad de recuperación y sustitución

Si se filtra una contraseña, se cambia. Si roban una tarjeta, se bloquea. Pero una plantilla biométrica facial no se puede modificar: una persona no puede «cambiar de rostro».

| Identificador | ¿Se puede cambiar? | Visibilidad en espacio público |

|---|---|---|

| Contraseña | Sí, fácilmente | Oculta |

| Tarjeta bancaria | Sí, reemisión | Oculta |

| Huella dactilar | No | Requiere contacto físico |

| Rostro (biometría) | No | Visible siempre y en todas partes |

Los datos biométricos comprometidos una vez permanecen vulnerables durante toda la vida. Esto crea riesgos únicos que distinguen la biometría de todas las demás formas de identificación.

Siete argumentos de los defensores de la implementación masiva del facial recognition — y por qué suenan convincentes

Antes de analizar los riesgos, es necesario examinar honestamente los argumentos de los defensores. La tecnología no habría alcanzado una difusión tan amplia si no ofreciera ventajas reales. Comprender la lógica de estos argumentos permite evaluar dónde terminan los beneficios justificados y comienzan los riesgos injustificados. Más información en la sección Tecno-esoterismo.

🛡️ Argumento de seguridad: prevención de atentados y búsqueda de delincuentes

Los sistemas de reconocimiento facial permiten identificar en tiempo real a personas buscadas, terroristas en bases de datos, niños desaparecidos. La identificación biométrica ocurre instantáneamente y no requiere cooperación del sujeto — a diferencia de la verificación manual de documentos, que puede ser engañada con documentación falsificada.

Las cámaras de videovigilancia equipadas con sistemas de reconocimiento cubren grandes territorios — aeropuertos, estaciones, estadios — donde el control manual es físicamente imposible.

⚙️ Argumento de eficiencia: reducción de costes y aceleración de procesos

La automatización de la identificación reduce radicalmente el tiempo de los procedimientos de control. En los aeropuertos, los pasajeros pasan por el registro, el control de pasaportes y el embarque sin presentar documentos — basta con mirar a la cámara.

En el sector bancario, la identificación biométrica acelera la apertura de cuentas y la realización de operaciones, reduciendo los riesgos de fraude. En el entorno corporativo, los sistemas de control de acceso eliminan la necesidad de tarjetas físicas, que pueden perderse o transferirse a terceros.

🧠 Argumento de comodidad: identificación sin contacto sin acciones adicionales

El reconocimiento biométrico no requiere ninguna acción activa del usuario — no es necesario sacar documentos, colocar el dedo en un escáner, introducir contraseñas. Esto es especialmente importante para personas con discapacidad (S002).

La tecnología funciona a distancia, no requiere contacto físico con el dispositivo, lo cual es relevante en el contexto de riesgos epidemiológicos. Para las personas mayores, a quienes les resulta difícil recordar contraseñas, la identificación biométrica puede ser un método de autenticación más accesible.

- No requiere acciones activas del usuario

- Funciona a distancia sin contacto físico

- Accesible para personas con discapacidad

- Reduce la carga cognitiva (no es necesario recordar contraseñas)

📊 Argumento de precisión: los sistemas actuales superan las capacidades humanas

Los algoritmos de reconocimiento facial basados en redes neuronales profundas alcanzan una precisión superior al 99% en conjuntos de datos de prueba estándar, superando la capacidad humana de reconocer rostros en condiciones complejas (S001).

Los sistemas no están sujetos a fatiga, estados emocionales, sesgos cognitivos que afectan la percepción humana. Procesan miles de rostros por segundo y son capaces de reconocer rostros con mala iluminación, oclusión parcial, cambios de edad.

Los algoritmos resuelven tareas en las que el ser humano tiene peor desempeño: reconocimiento en condiciones no óptimas, procesamiento de flujos masivos de datos, ausencia de errores subjetivos de percepción.

🔁 Argumento de escalabilidad: la tecnología funciona a nivel de ciudades y países

Los sistemas de reconocimiento facial se despliegan a nivel de ciudades enteras, creando una red unificada de videovigilancia con capacidad de rastrear los desplazamientos de las personas. Esto permite resolver tareas inaccesibles para los métodos tradicionales: búsqueda de personas desaparecidas en toda la ciudad en minutos, análisis de flujos de visitantes en centros comerciales, optimización de rutas de transporte.

La tecnología escala linealmente: añadir nuevas cámaras no requiere un aumento proporcional del número de operadores.

💎 Argumento de inevitabilidad: la tecnología ya forma parte de la infraestructura

El reconocimiento facial ya está integrado en infraestructuras críticas: sistemas bancarios, servicios públicos, redes de transporte, seguridad corporativa. Renunciar a la tecnología requeriría desmantelar los sistemas existentes con enormes costes y reducción del nivel de seguridad.

La tecnología se desarrolla globalmente: si un país renuncia a su uso, esto no detendrá el desarrollo en otras jurisdicciones, pero creará desventajas competitivas en las áreas de seguridad y gestión pública.

🧭 Argumento de regulabilidad: la tecnología admite control legal

A diferencia de la vigilancia anónima, los sistemas de identificación biométrica crean un rastro digital que puede ser verificado y controlado. Cada hecho de identificación queda registrado en los logs del sistema con indicación de hora, lugar, operador.

Esto crea la posibilidad de auditoría y responsabilización en caso de abusos. La tecnología puede configurarse con diferentes niveles de precisión y umbrales de activación, lo que permite equilibrar entre seguridad y privacidad. Mecanismos legales, como la exigencia de orden judicial para acceder a bases de datos, pueden limitar el uso arbitrario de los sistemas (S003).

- Rastro digital

- Cada acción del sistema queda registrada con metadatos (hora, lugar, operador), lo que teóricamente permite realizar auditorías e identificar abusos.

- Configurabilidad de parámetros

- Los niveles de precisión y umbrales de activación pueden variar según el contexto de uso y el equilibrio requerido entre seguridad y privacidad.

- Control judicial

- La exigencia de orden judicial para acceder a bases de datos crea una barrera formal contra el uso arbitrario de los sistemas.

Los siete argumentos se basan en ventajas reales de la tecnología. Sin embargo, la fuerza persuasiva de estos argumentos a menudo se fundamenta en que consideran solo un lado de la ecuación — los beneficios — e ignoran o minimizan los riesgos que surgen con la implementación masiva. La ética y seguridad de la IA requieren un análisis integral, no una elección entre comodidad y control.

Base de evidencia: qué dicen las investigaciones sobre precisión, errores y sesgos sistemáticos de los algoritmos de reconocimiento

Las afirmaciones sobre alta precisión requieren verificación crítica: en qué condiciones se realizaron las pruebas, con qué muestras, qué métricas se utilizaron. Atención especial merecen los errores sistemáticos, cuando los algoritmos demuestran un rendimiento predeciblemente peor para determinados grupos poblacionales. Más detalles en la sección Medios sintéticos.

📊 Métricas de precisión: qué se oculta tras la cifra «99% accuracy»

Las afirmaciones de 99% de precisión requieren comprender el contexto. Existen dos modos: verificación (comparación 1:1 — ¿es la misma persona?) e identificación (búsqueda 1:N — ¿quién es esta persona entre N registros?). La verificación suele ser más precisa, ya que el sistema compara dos plantillas.

En la identificación dentro de una base grande, la probabilidad de falso positivo crece proporcionalmente al tamaño de la base (S011). Si un sistema tiene una tasa de falsos positivos del 0.1% (precisión del 99.9%), al verificar contra una base de 1 millón de registros generará 1000 coincidencias falsas.

La precisión en condiciones de laboratorio y la precisión en explotación real son dos métricas diferentes. La primera mide el potencial, la segunda mide el riesgo.

⚠️ Sesgos sistemáticos: prejuicio racial y de género

Múltiples investigaciones han identificado tasas de error significativamente más altas al identificar personas de piel oscura, mujeres y personas mayores (S012). La causa: los conjuntos de entrenamiento contienen predominantemente imágenes de hombres blancos de mediana edad.

La red neuronal reconoce peor los rostros que difieren de este «estándar». Tales sesgos crean riesgos de discriminación: las personas de grupos subrepresentados son más frecuentemente víctimas de acusaciones falsas o no pueden acceder a servicios debido a fallos de identificación.

| Grupo poblacional | Problema típico | Mecanismo del error |

|---|---|---|

| Personas de piel oscura | Alta tasa de falsos positivos | Representación insuficiente en el conjunto de entrenamiento |

| Mujeres | Errores al reconocer con maquillaje | Algoritmo entrenado con rostros sin maquillaje o con mínimo |

| Personas mayores | No coincidencia con fotografías jóvenes en la base | Cambios faciales por edad no considerados en el modelo |

🧪 Condiciones de prueba vs. explotación real

Las pruebas de laboratorio se realizan con conjuntos cuidadosamente preparados: fotografías de alta calidad, iluminación controlada, ángulos frontales, ausencia de oclusiones. En condiciones reales — en calles, metro, aeropuertos — la calidad de las imágenes es significativamente inferior.

Baja resolución de cámaras, mala iluminación, ángulos de captura arbitrarios, ocultación parcial del rostro con ropa o accesorios hacen que la precisión real sea sustancialmente inferior a la declarada (S011). La brecha entre laboratorio y campo no es un detalle técnico, sino una fuente de errores sistemáticos en la aplicación de la ley.

- Condiciones de laboratorio: iluminación controlada, ángulo frontal, alta resolución

- Condiciones de campo: iluminación natural, ángulos arbitrarios, baja resolución

- Resultado: la precisión cae entre 5–15% según el sistema

- Consecuencia legal: las acusaciones basadas en reconocimiento requieren verificación adicional

🔎 Problema del cambio de apariencia: maquillaje, envejecimiento, condiciones médicas

Los sistemas de reconocimiento son vulnerables a cambios de apariencia. El maquillaje, especialmente el contouring, puede alterar la geometría percibida del rostro hasta el punto de que el algoritmo no reconozca a la persona. El envejecimiento natural modifica los rasgos: la piel pierde firmeza, aparecen arrugas, cambia el óvalo facial.

- Maquillaje y contouring

- Altera la geometría del rostro en el espacio de características del algoritmo. El sistema puede no reconocer a una persona que luce diferente a la fotografía original en la base. El problema se agrava si el maquillaje está aplicado profesionalmente.

- Envejecimiento natural

- Arrugas, cambio del óvalo facial, pérdida de firmeza de la piel — todo esto desplaza la plantilla biométrica. Una persona cuya fotografía en la base fue tomada hace 10 años puede no coincidir con el reconocimiento actual.

- Condiciones médicas

- Edemas, traumatismos, cirugías plásticas alteran la geometría facial. Esto crea la necesidad de actualización regular de plantillas biométricas, lo que complica la explotación y genera riesgos adicionales de filtración de datos.

El problema se agrava porque las personas a menudo desconocen la necesidad de actualizar sus datos biométricos. El sistema puede denegar el acceso o generar una coincidencia falsa, y la persona quedará sin explicación de la causa.

La plantilla biométrica no es un identificador estático, como una huella dactilar. Es una imagen dinámica que cambia con la edad, la salud y las elecciones de la persona. Los sistemas que ignoran esta realidad crean la ilusión de precisión, no la precisión misma.

La conexión entre estas limitaciones técnicas y el retorno de la fisiognomía en la era de la IA se vuelve evidente: los algoritmos repiten los errores del siglo XIX, pero con apariencia de cientificidad. Para comprender las consecuencias éticas ver ética y seguridad de la IA.

Mecanismo de funcionamiento de las redes neuronales en el reconocimiento facial: por qué la "caja negra" crea problemas legales

Comprender el mecanismo técnico es fundamental para evaluar las consecuencias jurídicas. Los sistemas actuales se basan en redes neuronales convolucionales profundas (CNN), entrenadas con millones de imágenes de rostros. Más información en la sección Falacias lógicas.

El proceso de toma de decisiones dentro de la red neuronal permanece opaco incluso para los desarrolladores: el problema de la "caja negra", que crea dificultades fundamentales para la regulación jurídica.

🧠 Arquitectura de redes neuronales profundas: de los píxeles a la decisión

Los sistemas de reconocimiento utilizan arquitecturas como FaceNet, VGGFace, ArcFace: redes neuronales profundas con decenas o cientos de capas. Las primeras capas extraen características simples: bordes, esquinas, texturas.

Las capas intermedias combinan estas características en patrones más complejos: formas de ojos, nariz, boca. Las capas profundas crean representaciones abstractas que ya no tienen interpretación visual directa: vectores multidimensionales en el espacio de características (S001). La capa final transforma estos vectores en una representación compacta: una plantilla biométrica para comparación.

- Capa de entrada: procesamiento de píxeles de la imagen

- Capas 1–5: extracción de características locales (texturas, bordes)

- Capas 6–15: combinación en patrones regionales

- Capas 16–25: representaciones abstractas del rostro

- Capa de salida: plantilla biométrica y decisión sobre coincidencia

⚙️ Problema de explicabilidad: por qué el sistema tomó precisamente esta decisión

Problema crítico: imposibilidad de explicar por qué se tomó una decisión concreta. Si el sistema identificó a una persona como coincidente con un registro en la base de datos, es imposible señalar qué características específicas del rostro condujeron a esa conclusión.

El derecho a la explicación de decisiones tomadas por sistemas automatizados está consagrado en el RGPD (S002). Pero implementarlo técnicamente para redes neuronales profundas es extremadamente difícil, lo que crea una brecha entre el requisito legal y la realidad técnica.

¿Cómo puede una persona impugnar una decisión si es imposible comprender sus fundamentos? Este es un problema fundamental para la justicia del proceso judicial.

🔁 Entrenamiento con datos: de dónde provienen los millones de rostros para el entrenamiento

Para entrenar un sistema eficaz se requieren millones de imágenes de rostros etiquetadas. ¿De dónde provienen? A menudo, de fuentes públicamente disponibles: redes sociales, bancos de imágenes, grabaciones de vídeo.

Muchas personas desconocen que sus fotografías se utilizan para entrenar sistemas comerciales. Esto viola los principios de protección de datos personales (S002). Si la muestra de entrenamiento está desequilibrada (pocas imágenes de personas de determinados grupos étnicos), esto conduce a sesgos sistemáticos en el funcionamiento del sistema.

| Fuente de datos | Volumen | Problema |

|---|---|---|

| Redes sociales | Miles de millones de fotos | Ausencia de consentimiento de los sujetos |

| Bancos de imágenes | Cientos de millones | Uso de licencia poco claro |

| Grabaciones de vídeo (cámaras) | Millones de fotogramas | Vigilancia masiva sin notificación |

| Bases de datos estatales | Decenas de millones | Control centralizado |

🧷 Adversarial attacks: cómo engañar al sistema de reconocimiento

Las redes neuronales son vulnerables a adversarial attacks: perturbaciones especialmente construidas de los datos de entrada que obligan al sistema a tomar decisiones incorrectas. Para el reconocimiento facial, puede ser maquillaje especial, gafas con un patrón determinado, pegatinas en el rostro.

Estas perturbaciones son imperceptibles para el ser humano, pero cambian radicalmente la salida de la red neuronal (S003). La existencia de tales ataques demuestra que los sistemas de reconocimiento no son fiables en condiciones de oposición.

Si un atacante sabe cómo engañar al sistema, este pierde su función protectora. Esto es crítico para aplicaciones en el ámbito de la seguridad: el sistema se convierte en una herramienta que puede eludirse, no en un mecanismo fiable de control.

Paradoja: cuanto más "inteligente" se vuelve el sistema, más específicos se vuelven los métodos para eludirlo. Esto crea una carrera armamentística entre los desarrolladores de protección y quienes buscan vulnerabilidades.

Conflicto de intereses: donde chocan la seguridad colectiva y el derecho a la privacidad individual

El reconocimiento facial biométrico se encuentra en el epicentro de un conflicto fundamental entre la seguridad colectiva y la libertad individual. Por un lado, el Estado tiene la obligación legítima de proteger a los ciudadanos contra la delincuencia y el terrorismo. Por otro lado, la vigilancia masiva crea riesgos de abusos, represión del disenso y control total. Más información en la sección Psicología de la creencia.

Este conflicto no tiene una solución simple: requiere un equilibrio cuidadoso de intereses, donde cada decisión a favor de una parte debilita automáticamente a la otra.

🕳️ Presunción de culpabilidad: cuando todos se convierten en sospechosos

La vigilancia biométrica masiva invierte la presunción de inocencia. En el sistema jurídico tradicional, una persona se considera inocente hasta que se demuestre su culpabilidad, y la vigilancia comienza después de que surgen sospechas. Los sistemas de reconocimiento facial masivo funcionan al revés: cada persona en el espacio público es automáticamente escaneada y verificada contra bases de datos.

Esto significa que todos son considerados potenciales delincuentes sujetos a verificación. Este enfoque cambia fundamentalmente la relación entre el ciudadano y el Estado, creando una atmósfera de desconfianza total.

🧩 Efecto inhibidor: cómo la vigilancia suprime la libertad de expresión

La conciencia de que tu rostro está siendo constantemente escaneado y tus movimientos rastreados cambia el comportamiento de las personas. Este fenómeno se denomina "efecto inhibidor" (chilling effect): las personas evitan visitar ciertos lugares, participar en protestas, reunirse con determinadas personas, por temor a las consecuencias.

Incluso si el sistema se utiliza únicamente para buscar delincuentes, el mero hecho de su existencia crea presión psicológica. Esto es especialmente peligroso para la libertad de reunión y expresión: si los participantes en una protesta saben que sus rostros serán identificados y registrados, muchos se negarán a participar (S001).

| Escenario | Sin vigilancia masiva | Con vigilancia masiva |

|---|---|---|

| Participación en protesta | Decisión basada en convicciones | Decisión incluye cálculo de riesgos de identificación |

| Visita a lugar de encuentro | Elección de lugar libre | Elección limitada por temor al registro |

| Actividad pública | Anonimato en la multitud | Rastreabilidad total |

🛡️ Protección de grupos vulnerables: niños, refugiados, víctimas de violencia

Algunas categorías de personas son especialmente vulnerables a los riesgos de la vigilancia biométrica. Los niños no pueden dar consentimiento informado para el procesamiento de sus datos biométricos, pero sus rostros entran en los sistemas de reconocimiento a través de sistemas de seguridad escolares o vigilancia pública.

- Refugiados y solicitantes de asilo

- Pueden ser identificados y deportados si sus datos biométricos caen en manos de las autoridades del país del que huyeron (S006).

- Víctimas de violencia doméstica

- Pierden la posibilidad de anonimato si sus rostros pueden ser encontrados mediante sistemas de reconocimiento, lo que facilita a los acosadores su búsqueda (S008).

- Activistas y periodistas

- Se vuelven vulnerables a represalias específicas en países con libertad de prensa limitada.

⚠️ Riesgos de uso autoritario: del control a la represión

La historia demuestra que las tecnologías de vigilancia creadas para combatir la delincuencia pueden ser utilizadas para la represión política. Los sistemas de reconocimiento facial permiten identificar participantes en protestas, rastrear movimientos de opositores, crear perfiles de actividad política.

En regímenes autoritarios, estos sistemas se convierten en instrumentos de represión del disenso. Incluso en países democráticos existe el riesgo de "deslizamiento de funciones" (function creep): sistemas creados inicialmente para objetivos limitados de seguridad amplían gradualmente su ámbito de aplicación, abarcando cada vez más aspectos de la vida de los ciudadanos (S001).

La tecnología es neutral, pero su aplicación depende del contexto político. Una herramienta segura en democracia se convierte en arma en manos del autoritarismo.

Materiales relacionados: Ética y seguridad de la IA: cómo desarrollar y utilizar responsablemente y Fisiognomía por IA y el retorno de la frenología: por qué los algoritmos de reconocimiento facial repiten errores del siglo XIX.

Estándares internacionales de protección de datos biométricos: qué exigen el RGPD, el Convenio 108+ y las legislaciones nacionales

La regulación jurídica del reconocimiento facial biométrico se desarrolla en varios niveles: convenios internacionales, reglamentos regionales (como el RGPD en la UE), leyes nacionales. Estas normas establecen principios de tratamiento de datos biométricos, requisitos de consentimiento de los sujetos, limitaciones al uso de la tecnología. Más información en la sección Cosmología y astronomía.

Sin embargo, la aplicación de la ley sigue siendo un problema: la tecnología avanza más rápido que la legislación, y el control del cumplimiento de las normas es difícil.

📌 RGPD: la biometría como categoría especial de datos

El RGPD (Reglamento General de Protección de Datos europeo) clasifica los datos biométricos como categoría especial, al mismo nivel que la información genética y los datos de salud (S001). Esto significa prohibición de tratamiento sin consentimiento explícito del sujeto, excepto en casos limitados (seguridad, fuerzas del orden, intereses vitales).

Paradoja del RGPD: el reglamento protege los datos, pero no resuelve el problema de los errores sistemáticos de los algoritmos. Incluso cumpliendo completamente los procedimientos, la tecnología puede discriminar por razones de sexo, edad, origen étnico.

El artículo 9 del RGPD prohíbe el tratamiento de datos biométricos para identificación en espacios públicos sin un acto legislativo específico. Esto crea una barrera para la implementación masiva del facial recognition en aeropuertos, calles, centros comerciales.

📌 Convenio 108+: mínimo global

El Convenio 108+ (Consejo de Europa) establece un estándar internacional de protección de datos personales, incluida la biometría. Sus requisitos son más flexibles que el RGPD, pero abarcan un círculo más amplio de países (incluidos Rusia, Ucrania, Moldavia).

- Principio de legalidad: tratamiento solo con base legal o consentimiento

- Principio de proporcionalidad: el objetivo debe justificar los medios

- Principio de transparencia: el sujeto debe saber que sus datos se procesan

- Derecho de acceso y rectificación: el sujeto puede verificar y cuestionar los datos

El Convenio 108+ no prohíbe el facial recognition, pero exige que cada Estado establezca sus propias limitaciones en la legislación nacional.

📌 Legislaciones nacionales: fragmentación y lagunas

Diferentes países eligen diferentes enfoques. Francia y Alemania limitan el facial recognition en espacios públicos. Estados Unidos se basa en regulación sectorial (ley de biometría en Illinois, leyes de videovigilancia en estados individuales).

| Jurisdicción | Enfoque | Limitaciones |

|---|---|---|

| UE (RGPD) | Prohibitivo | Facial recognition en espacio público requiere ley específica |

| EE.UU. | Sectorial | Depende del estado y sector (policía, comercio, fintech) |

| China | Permisivo | Limitaciones mínimas, uso amplio en sistema de crédito social |

| Rusia | Mixto | Convenio 108+, pero legislación nacional en desarrollo |

La fragmentación crea un problema: las empresas que operan en varias jurisdicciones deben cumplir diferentes estándares. Esto ralentiza la innovación, pero protege a los ciudadanos de la unificación bajo el estándar más laxo.

La conexión con la ética y seguridad de la IA se desarrolla en un artículo separado. Allí también se discute cómo los algoritmos modernos repiten errores del siglo XIX.

📌 Problema de aplicación: la tecnología supera a la ley

Incluso las leyes estrictas (como el RGPD) enfrentan el problema del control. ¿Cómo verificar que una empresa no usa facial recognition en segundo plano? ¿Cómo demostrar discriminación si el algoritmo funciona como una "caja negra"?

- Problema 1: Asimetría de información

- Los reguladores no tienen acceso al código fuente ni a los datos de entrenamiento de los algoritmos. Las empresas pueden ocultar errores y sesgos.

- Problema 2: Transfronterización

- Los datos se procesan en la nube, los servidores están en diferentes países. ¿Qué ley se aplica? ¿Quién es responsable?

- Problema 3: Velocidad de innovación

- Nuevas aplicaciones de facial recognition (deepfakes, vídeos sintéticos) aparecen más rápido de lo que los legisladores pueden reaccionar. La detección de deepfakes es un problema aparte.

Conclusión: los estándares internacionales establecen principios, pero su implementación depende de la voluntad política y las capacidades técnicas de control. Sin transparencia de algoritmos y auditoría independiente, incluso las leyes más estrictas quedan en el papel.