⚖️ Ética de la inteligencia artificial

⚖️ Ética de la inteligencia artificialPrincipios éticos y seguridad de la inteligencia artificial en medicinaλ

Investigación sobre normas éticas, seguridad de la información y aplicación responsable de tecnologías de IA en la práctica clínica e investigación médica

Overview

La implementación de inteligencia artificial en medicina requiere el cumplimiento estricto de principios éticos y protocolos de seguridad. Los sistemas de IA para visualización intraoperatoria de glándulas paratiroides, algoritmos de análisis de factores de riesgo de cáncer de mama y sistemas de apoyo a la toma de decisiones en el tratamiento de la degeneración macular asociada a la edad demuestran el potencial de la tecnología, pero simultáneamente plantean cuestiones sobre confidencialidad de datos, transparencia algorítmica y responsabilidad clínica. Los marcos éticos deben garantizar el equilibrio entre innovación y protección de los derechos de los pacientes, asegurando que la IA permanezca como herramienta de apoyo y no como sustituto del juicio médico profesional.

🛡️ Protocolo Laplace: Todos los sistemas de IA pasan por una verificación multinivel de cumplimiento de estándares éticos, incluyendo evaluación de transparencia algorítmica, protección de datos personales, validación clínica y cumplimiento de los principios de consentimiento informado antes de su implementación en la práctica.

Reference Protocol

Base Científica

Marco basado en evidencia para análisis crítico

Protocol: Evaluation

Ponte a Prueba

Cuestionarios sobre este tema próximamente

Sector L1

Artículos

Materiales de investigación, ensayos y profundizaciones en los mecanismos del pensamiento crítico.

⚖️ Ética de la inteligencia artificial

⚖️ Ética de la inteligencia artificial ⚖️ Ética de la inteligencia artificial

⚖️ Ética de la inteligencia artificial ⚖️ Ética de la inteligencia artificial

⚖️ Ética de la inteligencia artificial ⚖️ Ética de la inteligencia artificial

⚖️ Ética de la inteligencia artificial ⚖️ Ética de la inteligencia artificial

⚖️ Ética de la inteligencia artificial ⚖️ Ética de la inteligencia artificial

⚖️ Ética de la inteligencia artificial⚡

Más Información

Principios éticos de la aplicación de IA en la práctica clínica: dónde termina el algoritmo y comienza el médico

La implementación de inteligencia artificial en medicina crea una paradoja ética fundamental: una tecnología diseñada para mejorar la calidad asistencial puede vulnerar principios básicos de la ética médica si no se consideran los límites de su aplicación. Las revisiones sistemáticas sobre sistemas asistidos por IA en cirugía demuestran que la tecnología se encuentra en fase de validación y no puede sustituir la experiencia clínica.

La cuestión clave no es «puede la IA», sino «debe la IA» tomar decisiones sin participación humana en situaciones clínicas críticas.

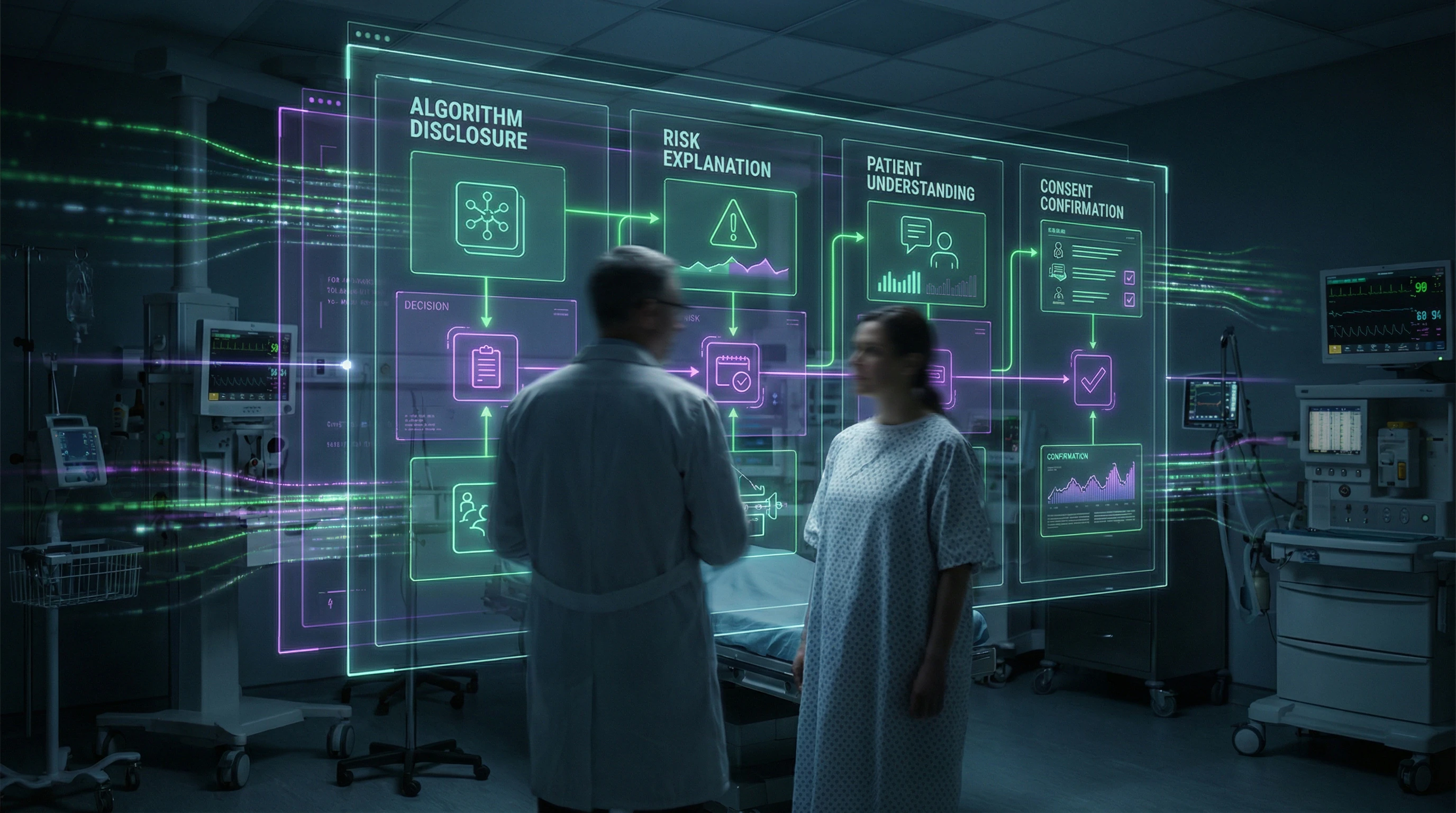

Autonomía del paciente y consentimiento informado en la era de los algoritmos

El modelo tradicional de consentimiento informado presupone que el paciente comprende la naturaleza de la intervención propuesta, pero los sistemas de IA crean una «caja negra» donde la lógica de toma de decisiones permanece opaca incluso para los médicos. Los estudios sobre visualización intraoperatoria asistida por IA para identificación de glándulas paratiroides muestran que los sistemas de visión artificial utilizan algoritmos complejos cuyo mecanismo de funcionamiento no siempre es explicable en términos clínicos.

El paciente tiene derecho a saber que una decisión diagnóstica o terapéutica se basa en un algoritmo y no solo en el juicio clínico del médico. Sin este conocimiento, la autonomía del paciente —su capacidad de tomar decisiones informadas sobre su propia salud— queda vulnerada.

- Protocolo de obtención del consentimiento

- Debe incluir explicación del papel del sistema de IA: si es una herramienta auxiliar o toma decisiones de forma autónoma, cuál es la precisión del algoritmo, qué métodos alternativos existen.

- Relevancia clínica

- Especialmente alta en el contexto de intervenciones quirúrgicas, donde un error en la identificación de estructuras anatómicas puede provocar complicaciones graves —por ejemplo, extirpación accidental de glándulas paratiroides con hipocalcemia subsecuente o lesión del nervio laríngeo recurrente.

El médico sigue siendo responsable de la decisión final, pero el paciente debe comprender sobre qué datos se basa esa decisión.

Transparencia y explicabilidad de los algoritmos: ¿requisito o utopía?

Los sistemas de IA actuales, especialmente los basados en aprendizaje profundo, constituyen redes neuronales multicapa con millones de parámetros, lo que hace sus decisiones prácticamente inexplicables en el sentido tradicional. La revisión sistemática sobre identificación de glándulas paratiroides asistida por IA señala la necesidad de validar el rendimiento diagnóstico de estos sistemas, pero no revela los mecanismos por los cuales el algoritmo reconoce el tejido.

El médico debe confiar en la herramienta sin comprender completamente cómo funciona —situación análoga al uso de equipamiento médico complejo, pero con una diferencia crítica: la IA influye en el juicio clínico, no solo en la medición de parámetros.

La solución práctica reside en el desarrollo de «IA explicable» (explainable AI, XAI) —sistemas capaces de proporcionar una justificación clínicamente relevante de sus recomendaciones. Para aplicaciones quirúrgicas, esto puede significar visualización de las áreas de la imagen que el algoritmo identificó como tejido paratiroideo, con indicación del nivel de confianza.

- Datos con los que se entrenó el sistema

- Métricas de rendimiento en estudios de validación

- Limitaciones conocidas y casos de resultados erróneos

- Condiciones bajo las cuales la recomendación del algoritmo puede no ser fiable

Sin esta información, el médico no puede evaluar críticamente la recomendación del algoritmo y asume responsabilidad por decisiones tomadas sobre la base de datos opacos.

Seguridad informática de datos médicos: por qué una filtración no es solo una multa, sino vidas

Los datos médicos constituyen la categoría más sensible de información personal. Su compromiso conduce no solo a la violación de la privacidad, sino también al daño físico directo a los pacientes.

Los sistemas de IA requieren conjuntos de datos masivos para entrenamiento y validación. Los metaanálisis en red sobre la eficacia de las terapias anti-VEGF para la degeneración macular asociada a la edad neovascular combinan datos de múltiples ensayos clínicos para comparar resultados visuales y perfiles de seguridad de diferentes fármacos. Cada punto de datos representa un paciente real con una historia médica única.

| Riesgo de filtración | Consecuencias |

|---|---|

| Discriminación en seguros | Denegación de cobertura, aumento de primas |

| Discriminación laboral | Rechazo de empleo basado en estado médico |

| Ataques dirigidos | Daño físico, chantaje, extorsión |

Protección de datos personales de pacientes: de la desidentificación a la privacidad diferencial

La desidentificación tradicional —eliminación de identificadores directos (nombre, dirección, fecha de nacimiento)— resulta insuficiente en la era del big data y el aprendizaje automático.

Las revisiones sistemáticas que analizan la relación entre el índice de masa corporal y el riesgo de cáncer de mama según subtipos moleculares utilizan datos que incluyen características demográficas, estado menopáusico, estado de receptores hormonales y estado HER2. La combinación de estas características puede ser única y permitir la reidentificación incluso tras eliminar el nombre. La relevancia clínica de comprender los efectos diferenciales del IMC sobre distintos subtipos de cáncer requiere datos detallados, lo que crea tensión entre el valor científico y la protección de la privacidad.

La privacidad diferencial es un método matemático que añade "ruido" controlado a los datos de manera que las conclusiones estadísticas permanecen válidas, pero los registros individuales no pueden recuperarse.

Para el entrenamiento de sistemas de IA en identificación de glándulas paratiroides, esto significa que el algoritmo puede aprender de imágenes quirúrgicas reales sin posibilidad de vincular una imagen específica con un paciente concreto.

El aprendizaje federado es otro enfoque en el que el modelo se entrena localmente con los datos de cada institución médica, y solo se transmiten al centro las actualizaciones de parámetros del modelo, no los datos en sí. Estas tecnologías no constituyen una protección absoluta, pero elevan significativamente el umbral de complejidad para posibles ataques.

Protocolos de cifrado y control de acceso: barreras técnicas contra el factor humano

La mayoría de las filtraciones de datos médicos no ocurren por vulnerabilidades técnicas, sino por el factor humano: ataques de phishing, contraseñas débiles, acceso no autorizado de personal interno.

Los metaanálisis en red que comparan la eficacia de diferentes agentes anti-VEGF (aflibercept, ranibizumab, bevacizumab, brolucizumab, faricimab) requieren acceso a datos detallados de ensayos clínicos que frecuentemente se almacenan en sistemas distribuidos. Cada punto de acceso representa una vulnerabilidad potencial.

- Principio de mínimos privilegios: cada usuario obtiene acceso solo a los datos necesarios y únicamente durante la ejecución de una tarea específica

- Cifrado end-to-end de datos en reposo y en tránsito

- Autenticación multifactor para todos los usuarios

- Auditoría de todos los accesos a datos con detección automática de patrones anómalos de acceso

- Pentests regulares (pruebas de penetración)

- Formación obligatoria del personal en fundamentos de seguridad informática

Para los sistemas de IA que trabajan con imágenes médicas, resulta crítico el cifrado a nivel de almacenamiento. Las imágenes intraoperatorias de glándulas paratiroides contienen no solo la estructura anatómica objetivo, sino también tejidos circundantes mediante los cuales potencialmente se puede identificar al paciente.

La tecnología de protección de datos evoluciona más lentamente que la tecnología de su utilización: esta brecha crea una ventana de vulnerabilidad que crece con cada nueva aplicación de IA en la clínica.

IA como herramienta de apoyo a las decisiones quirúrgicas: asistente, no piloto automático

Un error fundamental en los debates sobre IA en cirugía es la idea de que la tecnología puede o debe reemplazar al cirujano. Los sistemas de visualización intraoperatoria asistida por IA para identificación de glándulas paratiroides se posicionan como herramientas auxiliares en fase de validación.

La necesidad clínica de estos sistemas se debe a una complejidad objetiva: la extirpación o lesión accidental de las glándulas paratiroides provoca hipocalcemia, mientras que la identificación errónea aumenta el riesgo de daño al nervio laríngeo recurrente. La IA no toma la decisión de "extirpar o no extirpar" — proporciona información adicional para que el cirujano tome esa decisión.

Identificación intraoperatoria de glándulas paratiroides: donde la visión por computadora supera a la humana

Los sistemas de visión por computadora analizan imágenes intraoperatorias en tiempo real, utilizando algoritmos entrenados con miles de imágenes quirúrgicas anotadas. La ventaja de la IA es su capacidad para procesar múltiples características visuales simultáneamente: color, textura, vascularización, posición relativa a otras estructuras.

El ojo humano puede pasar por alto diferencias sutiles, especialmente cuando la glándula tiene una ubicación atípica o la anatomía está alterada por cirugías previas. La IA compara la imagen actual con una amplia base de casos de referencia, lo que amplía el espectro diagnóstico.

| Parámetro | Capacidad de la IA | Limitación |

|---|---|---|

| Tamaño de la glándula paratiroides | Detección de estructuras de 3–8 mm en tiempo real | Variantes anatómicas raras pueden estar ausentes del dataset de entrenamiento |

| Características visuales | Análisis simultáneo de color, textura, vascularización | Similitud con ganglios linfáticos, tejido adiposo, tejido tiroideo |

| Contexto clínico | Proporcionar recomendación basada en imagen | Falta de acceso a datos preoperatorios, valores de laboratorio, historia clínica |

El rendimiento diagnóstico del sistema no es un reemplazo del juicio clínico, sino su extensión. Solo el cirujano puede integrar la información de la IA con el contexto clínico completo: datos preoperatorios de imagen, valores de laboratorio de hormona paratiroidea, hallazgos intraoperatorios.

Límites de la automatización y rol del cirujano: por qué la última palabra siempre es humana

La automatización en cirugía tiene límites estrictos, determinados no solo por restricciones tecnológicas, sino también por marcos éticos y legales. La tecnología está en fase de validación, lo que significa: no está lista para aplicación autónoma sin supervisión de un especialista experimentado.

Una decisión quirúrgica no es solo la identificación de una estructura anatómica, sino la evaluación de riesgos y beneficios de una acción específica para un paciente específico en una situación clínica específica. La IA no tiene acceso al contexto completo: historia clínica, preferencias del paciente, comorbilidades, factores sociales que pueden influir en el resultado.

El modelo óptimo es "humano en el bucle" (human-in-the-loop): la IA proporciona una recomendación con indicación del nivel de confianza, el cirujano evalúa críticamente esa recomendación y toma la decisión final.

- El sistema resalta una estructura sospechosa en pantalla con indicación del nivel de confianza.

- El cirujano confirma visualmente el hallazgo, lo evalúa en el contexto de la anatomía circundante.

- El cirujano toma la decisión sobre las acciones posteriores basándose en el contexto clínico completo.

- La responsabilidad legal por el resultado de la operación recae en el cirujano, no en el algoritmo.

La IA es una herramienta que amplía las capacidades del cirujano, pero no reemplaza su experiencia, pericia y capacidad de juicio clínico en condiciones de incertidumbre.

Responsabilidad y rendición de cuentas en sistemas de IA: quién responde cuando el algoritmo falla

Distribución de responsabilidad entre desarrolladores y clínicos

El modelo jurídico de responsabilidad por sistemas de IA médica permanece fragmentado: el desarrollador asume responsabilidad por defectos del producto, el clínico por la decisión clínica tomada utilizando ese producto.

Para sistemas de visión por computador en cirugía de paratiroides esto significa: si el algoritmo no detecta una glándula por error técnico, la responsabilidad puede recaer en el fabricante; si el cirujano ignora una advertencia correcta o sigue ciegamente una señal falso-positiva sin verificación clínica, la responsabilidad recae sobre él.

Cuando el sistema emite una recomendación sin explicar su lógica, el clínico no puede evaluar su fiabilidad — esto crea un dilema ético: confiar en un algoritmo opaco o basarse únicamente en la propia experiencia.

Los organismos reguladores (FDA, EMA) exigen validación en conjuntos de datos independientes y monitorización post-comercialización, pero los estándares de "transparencia suficiente" para aplicación clínica aún están en formación.

Aspectos jurídicos de errores médicos al utilizar IA

La jurisprudencia sobre errores médicos asistidos por IA es prácticamente inexistente, lo que genera incertidumbre legal para todos los participantes.

| Escenario de error | Cuestión judicial | Responsable |

|---|---|---|

| El algoritmo no identificó la glándula paratiroides | ¿Defecto técnico del sistema? | Fabricante |

| El cirujano no recibió formación en uso de IA | ¿Preparación insuficiente? | Institución |

| El cirujano ignoró la advertencia del sistema | ¿Negligencia clínica? | Cirujano |

La doctrina del consentimiento informado requiere revisión: ¿debe el paciente ser notificado de que se utiliza un sistema de IA en la operación, cuáles son sus índices de precisión, y tiene derecho a rechazar su aplicación?

Las compañías aseguradoras comienzan a incluir procedimientos asistidos por IA en pólizas de responsabilidad profesional, pero las primas y condiciones de cobertura varían considerablemente, reflejando la incertidumbre de los riesgos.

FIG_02: Modelo de distribución de responsabilidad en cirugía asistida por IA

┌─────────────────────────────────────────────────────────────┐ │ NIVEL DE RESPONSABILIDAD │ SUJETO │ TIPO RIESGO │ ├─────────────────────────────────────────────────────────────┤ │ Defecto técnico del algoritmo │ Desarrollador│ Product │ │ Validación insuficiente │ Regulador │ Regulatory │ │ Interpretación incorrecta │ Clínico │ Clinical │ │ Ausencia de formación personal │ Institución│ Institutional│ │ Ignorar advertencias │ Cirujano │ Professional│ └─────────────────────────────────────────────────────────────┘

Revisiones sistemáticas y metaanálisis: ética de la síntesis de datos en la era de la abundancia informativa

Minimización del sesgo de publicación y presentación selectiva de resultados

El sesgo de publicación (publication bias) — distorsión sistemática por la cual los estudios con resultados positivos se publican con mayor frecuencia que aquellos con resultados negativos o nulos — sigue siendo la principal amenaza para la validez de los metaanálisis.

Para una revisión sistemática sobre terapia anti-VEGF en degeneración macular asociada a la edad neovascular, esto es crítico: si los estudios que no mostraron diferencias entre fármacos permanecen sin publicar, el metaanálisis en red sobreestimará la eficacia de unos agentes frente a otros.

Los métodos de detección (gráficos en embudo, test de Egger, análisis trim-and-fill) tienen sensibilidad limitada con pocos estudios — esto no es un error, sino una limitación fundamental de la estadística con muestras pequeñas.

Protocolo ético para autores de revisiones sistemáticas:

- Búsqueda de datos no publicados a través de registros de ensayos clínicos (ClinicalTrials.gov, EudraCT).

- Contacto con autores de estudios originales para obtener resultados no publicados.

- Discusión explícita del impacto potencial del sesgo de publicación sobre las conclusiones.

Transparencia metodológica en la selección de estudios y análisis de subgrupos

El preregistro del protocolo de revisión sistemática (PROSPERO para revisiones médicas) fija los criterios de inclusión, estrategia de búsqueda y plan de análisis antes de iniciar el trabajo.

Para una revisión sobre la relación entre IMC y riesgo de cáncer de mama, esto significa: los autores deben definir previamente si analizarán subgrupos por estado menopáusico y subtipos moleculares, o si estos análisis serán exploratorios.

Los análisis post-hoc de subgrupos sin especificación previa aumentan drásticamente el riesgo de hallazgos falsos positivos (p-hacking) y deben interpretarse como generadores de hipótesis, no como confirmatorios.

El reporte debe seguir los estándares PRISMA (Preferred Reporting Items for Systematic Reviews and Meta-Analyses):

- Diagrama de flujo completo de selección de estudios.

- Tablas de características de estudios incluidos y excluidos.

- Evaluación del riesgo de sesgo sistemático para cada estudio utilizando instrumentos validados (Cochrane RoB 2, ROBINS-I).

El futuro de la ética de la IA en medicina personalizada: del acceso equitativo a algoritmos justos

Equidad en el acceso a tecnologías de IA y brecha digital

La implementación de sistemas de IA en la práctica clínica profundiza las desigualdades existentes en salud: las tecnologías se concentran en grandes centros académicos de países desarrollados, dejando a instituciones periféricas y de bajos recursos sin acceso. Para la identificación asistida por IA de glándulas paratiroides, esto significa una brecha en la calidad asistencial: los cirujanos en clínicas bien equipadas obtienen una herramienta que reduce el riesgo de complicaciones, mientras sus colegas en hospitales regionales trabajan sin este soporte.

Barreras económicas: alto coste de licencias, necesidad de equipamiento especializado (cámaras de alta resolución, capacidad computacional) y formación del personal. La respuesta ética requiere desarrollo de soluciones open-source, subsidios para implementación en entornos de bajos recursos e inclusión de criterios de acceso equitativo en la evaluación regulatoria.

La equidad en medicina con IA no es caridad, sino condición de validez de la propia tecnología. Un sistema que funciona solo para centros ricos no resuelve el problema clínico, sino que reproduce la desigualdad social.

Prevención de discriminación algorítmica y garantía de representatividad de datos

El sesgo algorítmico surge cuando los datos de entrenamiento no son representativos de la población en la que se aplicará el sistema. Si un modelo de IA para identificación de glándulas paratiroides se entrena predominantemente con imágenes de pacientes de origen europeo, su precisión puede ser menor en pacientes de otros grupos étnicos debido a diferencias en anatomía, pigmentación tisular o patología concomitante.

Las revisiones sistemáticas deben evaluar la composición demográfica de los participantes en estudios incluidos y discutir explícitamente las limitaciones de generalización de resultados. Para metaanálisis de terapia anti-VEGF es crítico considerar que eficacia y seguridad difieren entre poblaciones debido a factores genéticos, patrones de comorbilidad y acceso a monitorización.

| Nivel de verificación | Qué evaluar | Señal de alerta |

|---|---|---|

| Datos de entrenamiento | Composición demográfica, origen geográfico de muestras | Más del 80% de un grupo étnico o región |

| Validación | Precisión por subgrupos (edad, sexo, etnia, comorbilidad) | Variación de precisión >5% entre subgrupos |

| Regulación | Indicación explícita de limitaciones de aplicabilidad en instrucciones | Ausencia de análisis de equidad en documentación |

Los requisitos regulatorios evolucionan hacia evaluación obligatoria de equidad: los desarrolladores deben demostrar que el sistema funciona con precisión comparable para todos los subgrupos relevantes, o indicar explícitamente limitaciones de aplicabilidad.

Un algoritmo que funciona bien en promedio pero mal para una minoría no es progreso, sino error sistematizado. La equidad no es un complemento a la validez, sino parte de ella.

FIG_03: Principios de implementación ética de IA en medicina

┌──────────────────────────────────────────────────────────────┐

│ PRINCIPIO │ IMPLEMENTACIÓN │ MÉTRICA │

├──────────────────────────────────────────────────────────────┤

│ Transparencia │ Explainable AI │ SHAP values │

│ Equidad │ Diverse datasets │ Equity metrics│

│ Rendición de cuentas │ Audit trails │ Decision logs │

│ Seguridad │ Validation studies │ AUC, NPV, PPV │

│ Confidencialidad │ Federated learning │ Privacy budget│

│ Control humano │ Human-in-the-loop │ Override rate │

└──────────────────────────────────────────────────────────────┘

↓

BENEFICIO CLÍNICO > RIESGO TECNOLÓGICO

Knowledge Access Protocol

FAQ

Preguntas Frecuentes

La ética de la IA en medicina es un sistema de principios que regulan el desarrollo y aplicación de la inteligencia artificial en la práctica clínica. Incluye la autonomía del paciente, la transparencia de los algoritmos, la equidad en el acceso y la protección de datos personales. Estos principios garantizan la implementación segura de las tecnologías manteniendo la responsabilidad médica.

Los sistemas de IA con visión por computadora analizan imágenes intraoperatorias en tiempo real, ayudando a los cirujanos a reconocer las glándulas paratiroides. Esto reduce el riesgo de daño o extirpación accidental de las glándulas, previniendo la hipocalcemia. La tecnología sigue siendo una herramienta de apoyo, la decisión final la toma el cirujano.

Sí, el consentimiento informado es obligatorio al utilizar sistemas de IA en diagnóstico y tratamiento. El paciente debe comprender que los algoritmos participan en la toma de decisiones, qué datos se procesan y cuáles son los riesgos. Esto cumple con el principio de autonomía y los requisitos de la ética médica.

No, este es un mito común: la IA no reemplaza a los médicos, sino que complementa su trabajo. Los algoritmos analizan datos y proponen opciones, pero el razonamiento clínico, la empatía y la responsabilidad siguen siendo del especialista. Las revisiones sistemáticas confirman que la IA es efectiva solo como herramienta de apoyo a las decisiones.

La protección se garantiza mediante protocolos de cifrado, control de acceso y anonimización de datos personales de los pacientes. Los sistemas deben cumplir con los requisitos de seguridad de la información y la legislación sobre protección de datos. Las auditorías regulares y la certificación confirman la fiabilidad de las tecnologías.

La responsabilidad se distribuye entre los desarrolladores del algoritmo, la institución médica y el médico tratante. El médico tiene la principal responsabilidad clínica, ya que toma la decisión final basándose en las recomendaciones de la IA. Los aspectos legales requieren una documentación clara del proceso de toma de decisiones.

La transparencia significa que médicos y pacientes pueden comprender cómo el sistema de IA llegó a una conclusión o recomendación específica. Los algoritmos explicables muestran los factores clave que influyen en la decisión, lo que aumenta la confianza. Esto es fundamental para la práctica clínica y la aceptabilidad ética de las tecnologías.

Evalúe la transparencia de la metodología de selección de estudios, la existencia de un protocolo y el análisis de sesgos de publicación. Un metaanálisis de calidad especifica los criterios de inclusión, las bases de datos de búsqueda y los métodos estadísticos. Las revisiones sistemáticas de PubMed suelen pasar por una rigurosa evaluación por pares.

Sí, la discriminación algorítmica es posible si los datos de entrenamiento contienen sesgos por género, edad, origen étnico o estatus social. Esto conduce a una calidad desigual en el diagnóstico y tratamiento para diferentes grupos. La prevención requiere conjuntos de datos diversos y auditorías regulares de equidad de los algoritmos.

No, esto es un error: la precisión de la IA depende de la calidad de los datos, el contexto y el tipo de tarea. En algunas áreas específicas (como el análisis de imágenes) los algoritmos muestran alta precisión, pero son inferiores en la evaluación compleja. El resultado óptimo se logra mediante el trabajo conjunto del médico y la IA.

La equidad requiere que las tecnologías sean accesibles para todas las instituciones sanitarias independientemente de la región y la financiación. Son necesarios programas gubernamentales de apoyo, estandarización y formación de especialistas. Esto previene la desigualdad digital en la calidad de la atención médica entre ciudades y regiones.

El sesgo de publicación ocurre cuando los estudios con resultados positivos se publican con mayor frecuencia que aquellos con resultados negativos o neutros. Esto distorsiona las conclusiones del metaanálisis y sobreestima la eficacia de las intervenciones. La minimización requiere la búsqueda de datos no publicados y pruebas estadísticas de sesgo.

No, las decisiones críticas de vida o muerte deben permanecer en manos de los médicos considerando principios éticos y juicio humano. La IA puede proporcionar información pronóstica, pero carece del estatus moral para tales decisiones. La automatización en situaciones críticas es éticamente inaceptable.

La IA transforma el rol del cirujano de ejecutor a supervisor de sistemas de alta tecnología, manteniendo el control final. Los algoritmos ayudan en la identificación de estructuras y la planificación, pero las habilidades manuales y el pensamiento clínico siguen siendo insustituibles. Esto requiere nuevas competencias en el trabajo con herramientas digitales.

Los algoritmos opacos («cajas negras») dificultan la detección de errores, reducen la confianza de médicos y pacientes, y crean riesgos legales. La imposibilidad de explicar una decisión obstaculiza el aprendizaje clínico y la verificación de recomendaciones. Esto puede conducir a tratamientos incorrectos y violaciones éticas.

La ética se centrará en la equidad de acceso a tecnologías personalizadas, la protección de datos genómicos y la prevención de discriminación por características genéticas. Se requerirán nuevos marcos regulatorios para equilibrar innovación y derechos de los pacientes. La cooperación internacional será clave para desarrollar estándares universales.