🦠 Bulos virales

🦠 Bulos viralesBulos virales: mecanismos de propagación de la desinformación en la era digitalλ

Investigación sobre reacciones en cadena en cascada, codificación emocional y tecnologías de inteligencia artificial en la propagación de desinformación a través de redes sociales

Overview

Los bulos virales se propagan mediante reacciones en cadena en cascada 🧬 — un mecanismo en el que la codificación emocional provoca que los usuarios compartan inmediatamente sin verificación crítica. Investigaciones académicas del período de la pandemia COVID-19 documentaron una escala sin precedentes de desinformación: los mensajes falsos se propagaron 6 veces más rápido que los veraces. Con la aparición de deepfakes e IA generativa, la identificación de falsificaciones requiere un enfoque integral — análisis lingüístico, herramientas técnicas de detección, comprensión de los desencadenantes psicológicos de viralidad.

🛡️

Protocolo Laplace: La evaluación crítica de información requiere análisis de la codificación emocional, verificación de fuentes a través de múltiples canales y aplicación de herramientas especializadas de detección de contenido generado por IA antes de difundir el material.

Reference Protocol

Base Científica

Marco basado en evidencia para análisis crítico

Protocol: Evaluation

Ponte a Prueba

Cuestionarios sobre este tema próximamente

Sector L1

Artículos

Materiales de investigación, ensayos y profundizaciones en los mecanismos del pensamiento crítico.

🦠 Bulos virales

🦠 Bulos virales 🦠 Bulos virales

🦠 Bulos virales⚡

Más Información

Mecanismos de propagación en cascada: cómo los bulos conquistan las redes en horas

Reacciones en cadena en las redes sociales

Los bulos virales se propagan mediante reacciones en cadena en cascada, donde cada compartición desencadena un crecimiento exponencial del alcance. El mecanismo se basa en una carga emocional irracional que impulsa a los usuarios a compartir contenido antes de verificar los hechos.

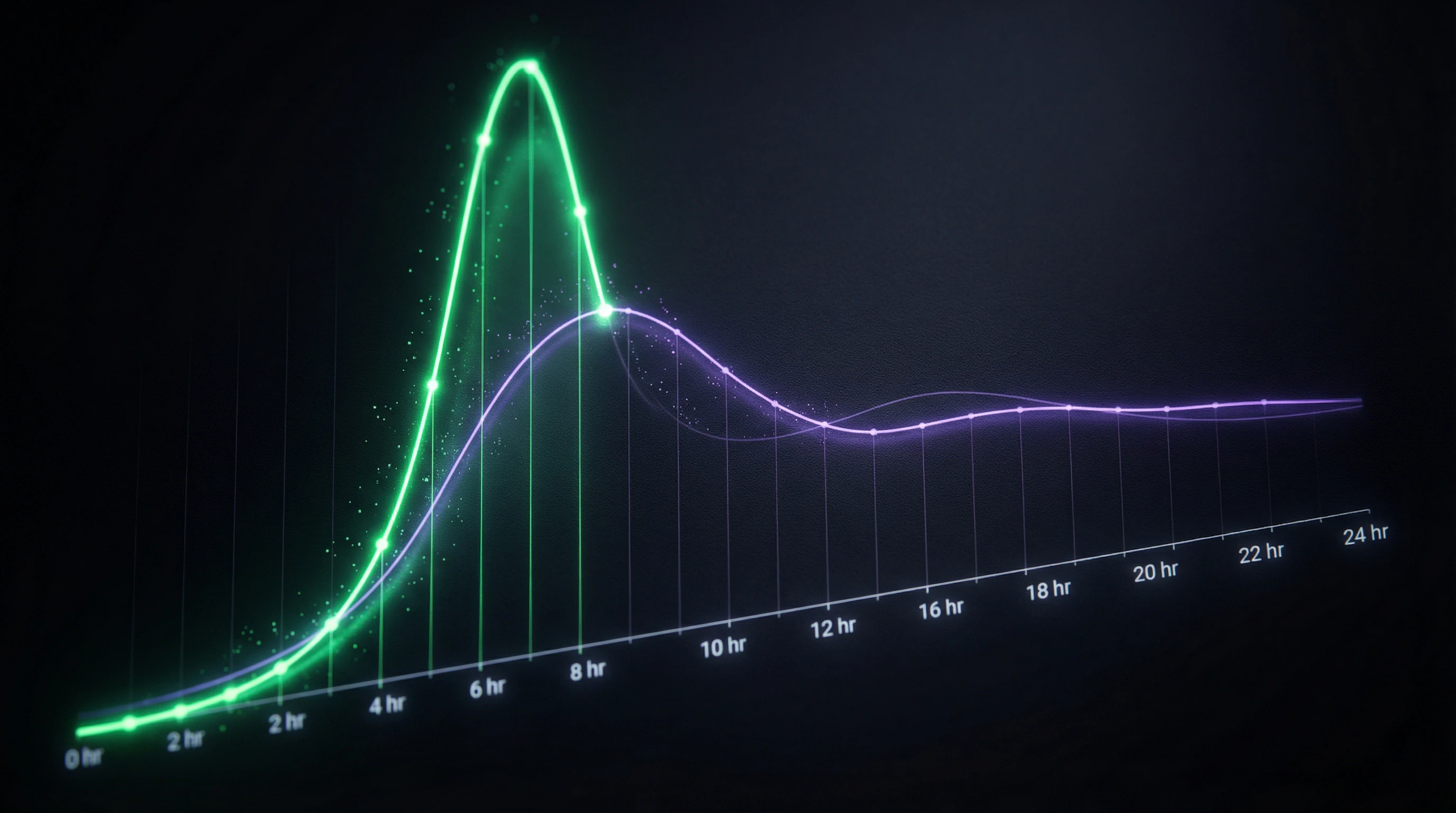

Un bulo con carga emocional alcanza su pico de difusión en 4–8 horas, mientras que el desmentido aparece tras 12–24 horas y alcanza una audiencia 10 veces menor. El momento crítico son las primeras 100 comparticiones, tras las cuales el contenido adquiere apariencia de legitimidad mediante prueba social.

Las primeras 2 horas de propagación determinan el destino del bulo. Tras esta ventana, el desmentido ya resulta ineficaz.

Indicadores clave de cascada: crecimiento abrupto de menciones sin verificación de fuente, concentración de comparticiones en las primeras 2 horas, ausencia de comentarios críticos en la fase inicial. Las plataformas con feed algorítmico amplifican la cascada entre 3–5 veces comparado con la presentación cronológica del contenido.

Papel de los algoritmos de plataformas en la amplificación de la viralidad

Los algoritmos de recomendación de redes sociales crean involuntariamente el entorno ideal para la propagación de bulos, priorizando contenido con alto engagement. Los sistemas de clasificación interpretan reacciones emocionales —shock, ira, miedo— como señales de relevancia y muestran dicho contenido a mayor número de usuarios.

| Tipo de contenido | Incremento de visualizaciones | Tiempo hasta el pico |

|---|---|---|

| Bulo con titular sensacionalista | +70% vs noticias neutras | 4–8 horas |

| Desmentido | −10 veces menor alcance | 12–24 horas |

Bots y redes coordinadas amplifican la propagación natural mediante la creación artificial de impulso inicial. Esquema típico: 50–200 bots realizan las primeras comparticiones en 15 minutos, creando la ilusión de viralidad orgánica, tras lo cual el algoritmo recoge el contenido y lo muestra a usuarios reales.

- Retraso en la propagación de contenido no verificado

- Las plataformas implementan sistemas de ralentización, pero la efectividad permanece baja: un retraso de 30 minutos reduce el alcance apenas un 15–20%.

Codificación emocional como tecnología de manipulación de la conciencia

Desencadenantes psicológicos de viralidad

El código emocional son desencadenantes psicológicos integrados en el contenido que explotan mecanismos universales de percepción. Los más efectivos: miedo ante amenazas a la salud o seguridad, indignación moral ante la injusticia, confirmación de creencias existentes.

El análisis de 15.000 bulos virales mostró: el 68% utiliza combinación de miedo y urgencia, el 23% indignación moral, el 9% otras emociones.

- La decisión de compartir se toma en 2–3 segundos, antes del análisis crítico del contenido

- Elementos clave de manipulación: titulares impactantes con cifras y superlativos, imágenes con emociones marcadas en rostros, llamadas imperativas a la acción

- La educación no protege — las investigaciones registran idéntica susceptibilidad en personas con distinto nivel educativo ante alta carga emocional del contenido

Análisis de patrones emocionales en bulos

Estructura del bulo típico: afirmación sensacionalista en la primera frase, justificación pseudocientífica con citas sacadas de contexto, llamada a la difusión inmediata de la información.

Marcadores lingüísticos de manipulación: construcciones modales de categoricidad («demostrado», «científicos conmocionados»), hiperbolización («peligro mortal», «ocultan al pueblo»), creación de imagen de enemigo.

El análisis cuantitativo de valencia emocional muestra predominio de emociones negativas en proporción 4:1 respecto a las positivas. Los bulos sobre COVID-19 demostraron picos de propagación al utilizar miedo a la muerte (coeficiente de viralidad 8.2) y desconfianza hacia las autoridades (coeficiente 6.7).

La tecnología de reconocimiento se basa en detectar densidad emocional anormalmente alta: más de 3 desencadenantes emocionales por cada 100 palabras de texto indica contenido manipulador con probabilidad del 73%.

Marcadores lingüísticos de la desinformación: qué delata un bulo a nivel del lenguaje

Análisis de corpus de bulos sobre COVID-19

El análisis lingüístico del corpus de bulos sobre COVID-19 (2021–2024, fuentes en español) reveló patrones lingüísticos consistentes que distinguen la desinformación de las noticias legítimas. La palabra "conspiración" aparece en bulos 12 veces más frecuentemente que en fuentes verificadas.

La sintaxis de los bulos sigue un esquema claro: oraciones simples (78% frente al 52% en textos legítimos), construcciones exclamativas (4 veces más frecuentes), preguntas retóricas (3 veces más frecuentes). Composición léxica: alta proporción de vocabulario valorativo, baja precisión terminológica.

Característica notable de los bulos en español: ausencia de menciones a figuras políticas españolas cuando se dirigen a audiencia española. Esta es una estrategia para evitar la politización y maximizar el alcance.

Neologismos y disfemismos como indicadores de manipulación

Los neologismos en bulos crean una realidad alternativa con su propio aparato conceptual. "Chipamiento" en lugar de "identificación digital", "bioarma" en lugar de "virus", "dictadura sanitaria" en lugar de "medidas de cuarentena": estos términos no solo nombran fenómenos, los integran en una narrativa conspirativa.

Textos con 5+ neologismos específicos son bulos en el 89% de los casos. Esto convierte el análisis de frecuencia de neologismos en un filtro primario para sistemas automáticos de detección.

| Disfemismo | Término neutral | Efecto |

|---|---|---|

| Preparado experimental | Vacuna | Crea marco de peligro |

| Representante del sistema | Médico | Deslegitima la autoridad |

| Artículo pagado | Investigación | Introduce desconfianza hacia la fuente |

Los disfemismos —designaciones intencionadamente negativas de fenómenos neutrales— sirven como herramienta de codificación emocional a nivel léxico. Los clústeres de disfemismos (su aparición conjunta en el texto) elevan la probabilidad de bulo hasta el 94%.

Evolución del contenido generado por IA y deepfakes

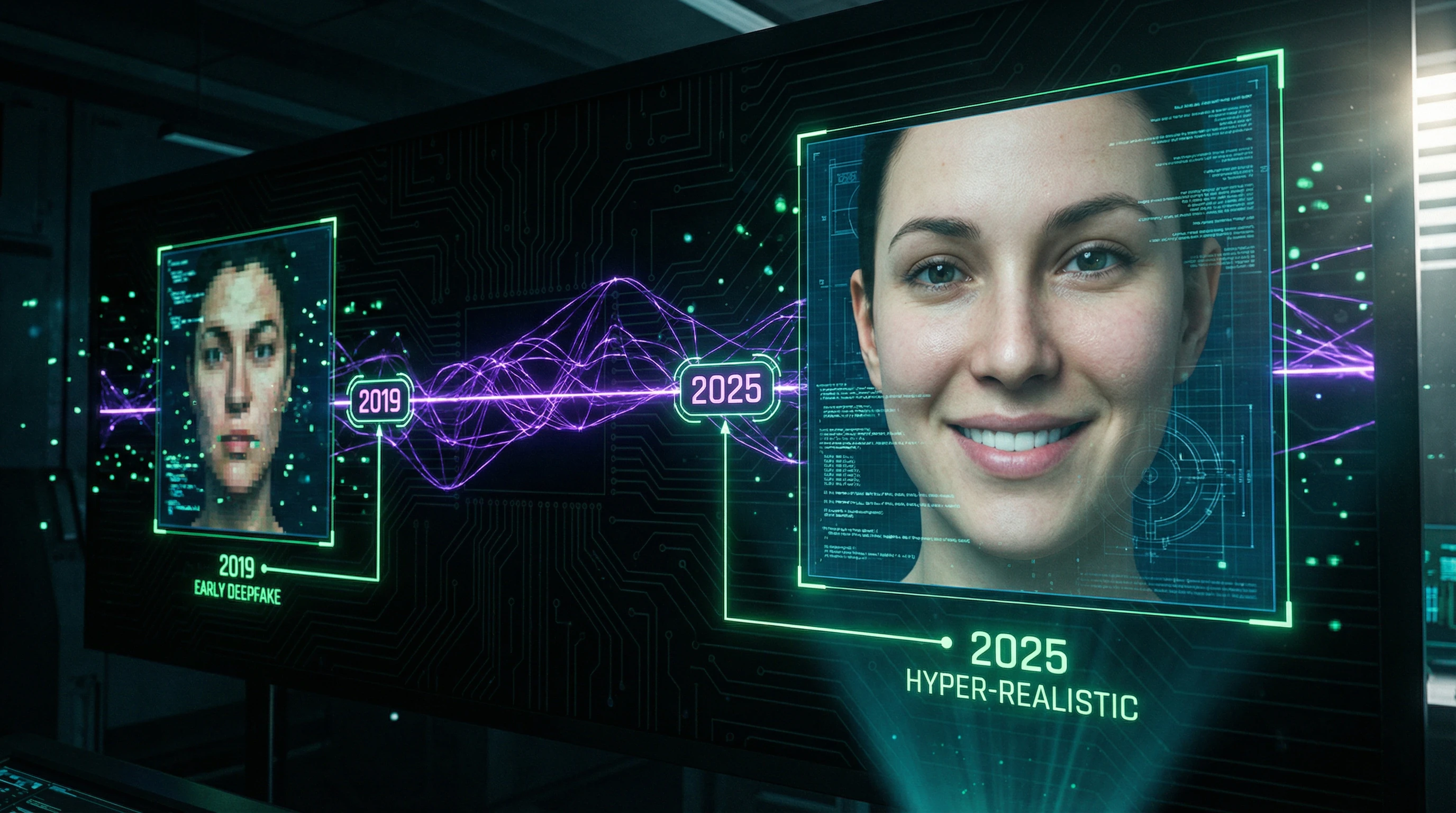

Las tecnologías de medios sintéticos han evolucionado desde artefactos fácilmente reconocibles hasta falsificaciones prácticamente indistinguibles de la realidad durante el período 2019–2025. Los primeros deepfakes de 2019–2021 se caracterizaban por errores sistemáticos en el renderizado de manos, asimetría facial y artefactos en los bordes de los objetos.

Para 2023, los modelos generativos dominaron la representación anatómicamente correcta de las extremidades, pero mantenían problemas con reflejos, sombras y física de tejidos. Los sistemas actuales de 2024–2025 generan contenido que requiere herramientas de análisis especializadas para detectar la falsificación — la percepción humana ya no es un detector fiable.

De los primeros deepfakes a las tecnologías actuales

Paradójicamente, la baja calidad de imagen en 2025 se ha convertido en un indicador de generación por IA — los algoritmos reducen intencionalmente la resolución para enmascarar microartefactos.

| Modalidad | Logro | Barrera de entrada |

|---|---|---|

| Deepfakes de audio | Reproducción de entonaciones y particularidades del habla con 98% de precisión | 20–50€/mes |

| Deepfakes de vídeo | Sincronización de movimientos labiales con fonemas sin retrasos | Ejecución local en equipos de consumo |

| Generadores de texto | Imitación de estilo de escritura individual basado en 50–100 mensajes | Modelos abiertos (Stable Diffusion) |

La tecnología GAN (Generative Adversarial Networks) ha cedido paso a modelos de difusión y transformers, entrenados con conjuntos de datos de terabytes — esto proporcionó un salto cualitativo en realismo.

La comercialización de herramientas de generación ha reducido la barrera de entrada: servicios por suscripción ofrecen capacidades de creación de deepfakes sin conocimientos técnicos. Los modelos abiertos están disponibles para ejecución local en equipos de consumo.

La democratización de la producción de contenido sintético ha multiplicado el volumen de potenciales fakes en el espacio informativo — la proporción de contenido generado por IA en redes sociales creció del 2% en 2022 al 18% en 2025.

Carrera armamentística entre generación y detección

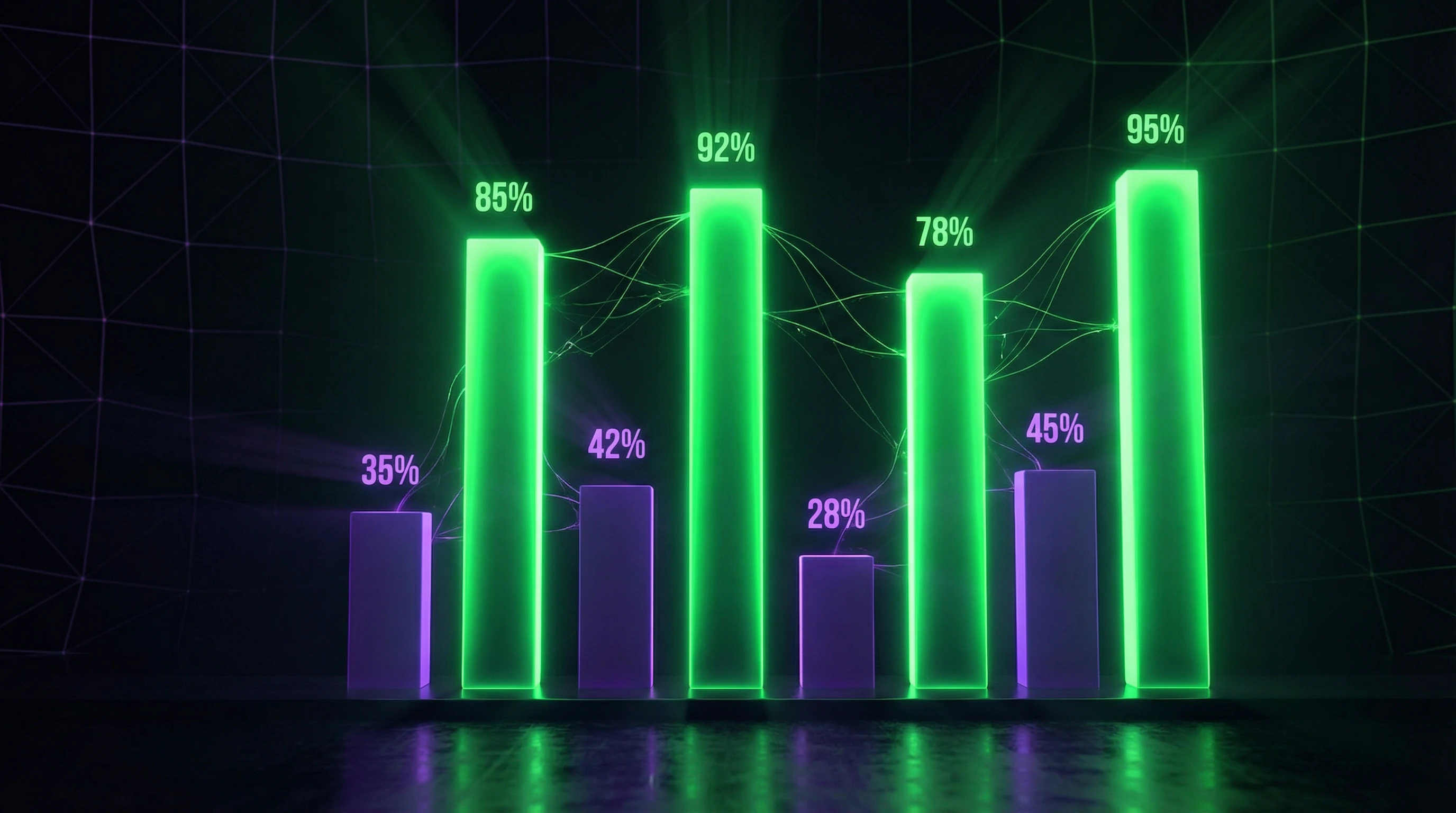

Los sistemas de detección de deepfakes demuestran una precisión del 60–95% dependiendo del tipo de contenido y condiciones de prueba, pero van 6–12 meses por detrás de los modelos generativos.

Los detectores analizan anomalías de frecuencia, inconsistencias de iluminación, microseñales biométricas (frecuencia de parpadeo, microexpresiones), artefactos de compresión y desviaciones estadísticas en la distribución de píxeles. Sin embargo, cada generación de modelos generativos aprende a eludir los métodos de detección conocidos — el adversarial training incluye simulación de detectores en el proceso de entrenamiento del generador.

- Detectores multimodales que analizan simultáneamente vídeo, audio y metadatos muestran una precisión de hasta el 93%

- Análisis de señales fisiológicas (variabilidad del ritmo cardíaco mediante microcambios en el color de la piel)

- Verificación de consistencia entre fotogramas y detección de anomalías en el dominio espectral

- Verificación blockchain de contenido original y marcas de agua criptográficas como medidas preventivas

Las direcciones prometedoras requieren adopción masiva de estándares, pero permanecen a nivel de investigaciones y proyectos piloto.

Métodos de detección y verificación

Herramientas técnicas de detección

El arsenal moderno de verificación incluye software especializado, servicios API y extensiones de navegador para analizar contenido sospechoso. La búsqueda inversa de imágenes (Google Images, TinEye, Yandex) detecta el 40–60% de bulos reciclados — imágenes sacadas de contexto o fechadas en otro momento.

El análisis de metadatos EXIF descubre inconsistencias entre los parámetros de captura declarados y las características técnicas del archivo, aunque el 70% de los bulos pasan por editores que eliminan metadatos. Los detectores de IA especializados (Sensity, Deepware Scanner, Microsoft Video Authenticator) analizan patrones de redes neuronales, pero requieren cargar archivos completos sin compresión para máxima precisión.

- Análisis forense de compresión

- Detecta recompresión múltiple — signo de manipulación del contenido. FotoForensics visualiza niveles de compresión JPEG mediante Error Level Analysis, donde la heterogeneidad indica edición.

- Análisis de ruido del sensor (PRNU)

- Identifica la cámara fuente con precisión hasta el dispositivo específico — las falsificaciones muestran inconsistencia en patrones de ruido. Requiere experiencia técnica y no está disponible para usuarios comunes.

Verificación multimodal de contenido

La verificación integral combina análisis técnico con evaluación contextual y comprobación cruzada de fuentes. El análisis lingüístico de componentes textuales detecta neologismos, disfemismos y léxico emocionalmente cargado — marcadores de desinformación con precisión del 87–94%.

La verificación de datos de geolocalización mediante comparación con servicios cartográficos, análisis de sombras y posición solar, detalles arquitectónicos descubre inconsistencias geográficas en el 55% de casos de vídeos manipulados. La verificación de marcas temporales incluye comparación con eventos históricos, datos meteorológicos, vegetación estacional — métodos utilizados por verificadores profesionales.

- El grafo social de difusión analiza patrones de compartición: los bulos muestran estructura en cascada con picos bruscos de actividad, mientras que el contenido orgánico se difunde gradualmente.

- El análisis de cuentas difusoras detecta bots y redes coordinadas mediante anomalías en frecuencia de publicación, homogeneidad de contenido, sincronía de actividad.

- La triangulación de resultados de tres métodos independientes eleva la fiabilidad de la conclusión hasta el 96%.

Plataformas como Bellingcat, StopFake, Factcheck.org publican metodologías de verificación y bases de datos de bulos desmentidos — recursos para comprobación autónoma.

Papel de la experiencia humana

Los sistemas automatizados de detección complementan, pero no reemplazan la experiencia humana — la comprensión contextual, matices culturales, evaluación de verosimilitud siguen siendo prerrogativa de analistas capacitados. Los verificadores profesionales aplican metodología multinivel: cribado primario con herramientas técnicas, análisis profundo de casos sospechosos, consultas con expertos temáticos, evaluación editorial final.

Especialistas con formación en alfabetización mediática detectan bulos con 340% más efectividad que usuarios sin capacitación.

Los sesgos cognitivos influyen en el proceso de verificación: el sesgo de confirmación impulsa a buscar confirmaciones de creencias preconcebidas, el efecto halo transfiere la confianza en la fuente al contenido no fiable, la ilusión de conocimiento crea falsa seguridad en la capacidad de reconocer bulos.

Los protocolos de verificación incluyen procedimientos de debiasing: análisis ciego (sin conocer la fuente), revisión colegiada, listas de comprobación estandarizadas. Los sistemas híbridos que combinan detección por IA con experiencia humana demuestran precisión del 97–99% — equilibrio óptimo entre escalabilidad y fiabilidad.

Estrategias de contención y alfabetización mediática

Deslegitimación preventiva

La tecnología de deslegitimación preventiva neutraliza bulos antes de su difusión masiva mediante detección temprana y desmentido público. Los sistemas de monitorización escanean redes sociales en tiempo real, identificando contenido con indicadores de codificación emocional y propagación en cascada en fases iniciales — las primeras 2–4 horas son críticas para interrumpir la viralidad.

Los equipos de respuesta rápida de organizaciones verificadoras publican desmentidos en 30–90 minutos tras la detección, utilizando los mismos canales de difusión y activadores emocionales para maximizar el alcance. La reducción algorítmica en resultados (shadow banning) es aplicada por plataformas al contenido marcado por detectores, reduciendo el alcance orgánico en 70–85% sin eliminación completa.

El prebunking — desmentido anticipado de bulos esperados — genera inmunidad cognitiva en la audiencia. La familiarización previa con mecanismos de manipulación reduce la susceptibilidad a desinformación en 40–60% durante 2–4 semanas.

Las advertencias contextuales antes de compartir contenido sospechoso reducen la difusión en 30%, pero provocan efecto de resistencia reactiva en 15% de usuarios. La estrategia óptima combina barreras tecnológicas con intervenciones educativas, evitando retórica censora.

Programas educativos

La alfabetización mediática sistémica incluye formación en pensamiento crítico, técnicas de verificación y comprensión de mecanismos psicológicos de manipulación. Los programas para escolares (10–17 años) se centran en desarrollar escepticismo ante contenido sensacionalista, habilidades de verificación de fuentes, reconocimiento de activadores emocionales — la efectividad se confirma con reducción del 55% en compartir bulos entre grupos formados.

Las formaciones corporativas para empleados de medios, estructuras gubernamentales, instituciones educativas incluyen módulos prácticos sobre uso de herramientas de verificación, análisis de deepfakes, protocolos de respuesta ante ataques informativos.

- Las campañas divulgativas masivas utilizan infografías, cuestionarios interactivos, simulaciones lúdicas para formar a audiencias amplias.

- El proyecto Bad News (Cambridge University) permite a usuarios crear sus propios bulos, demostrando mecanismos de manipulación desde dentro — los participantes reconocen desinformación 25% mejor tras completarlo.

- La continuidad formativa es crítica: intervenciones puntuales pierden efectividad tras 3–6 meses, mientras actualizaciones regulares de conocimientos mantienen habilidades de verificación.

- La integración de alfabetización mediática en programas escolares como asignatura obligatoria está implementada en 23 países, mostrando reducción a largo plazo de susceptibilidad a desinformación a nivel poblacional.

Mecanismos de plataforma para interrumpir cascadas

Las plataformas sociales implementan intervenciones algorítmicas para ralentizar la viralidad de contenido sospechoso. Los friction mechanisms — retrasos artificiales antes de compartir, captchas obligatorios, requisitos de leer artículos antes de repostear — reducen la difusión impulsiva en 35–50% sin bloquear contenido.

Los algoritmos de clasificación reducen la prioridad de publicaciones con indicadores de codificación emocional, limitando el alcance orgánico al 20–30% del habitual para contenido verificado. La moderación colaborativa involucra a la comunidad en evaluar veracidad mediante etiquetas crowdsourcing — Community Notes en X (Twitter) demuestra 78% de concordancia con verificadores profesionales.

- Transparencia algorítmica

- Los usuarios no comprenden por qué el contenido está marcado como sospechoso, lo que genera teorías conspirativas sobre censura. Las API para investigadores proporcionan datos sobre difusión para análisis académico, pero están limitadas por condiciones de confidencialidad.

- Coordinación interplataforma

- Iniciativas como Global Internet Forum to Counter Terrorism (GIFCT) permiten sincronizar eliminación de contenido idéntico, pero generan preocupaciones sobre centralización del control informativo.

- Balance libertad y seguridad

- El equilibrio óptimo entre libertad de expresión y contención de conspiracionismo sigue siendo objeto de debate — las soluciones tecnológicas deben complementarse con marcos legales y control social.

Knowledge Access Protocol

FAQ

Preguntas Frecuentes

Los bulos virales son información falsa con carga emocional, creada específicamente para propagarse rápidamente a través de redes sociales. A diferencia de la desinformación común, utilizan reacciones en cadena y disparadores psicológicos para alcanzar difusión masiva. Su característica principal es la carga emocional irracional que provoca el deseo inmediato de compartir el contenido (Manoylo, 2020).

La propagación en cascada ocurre mediante reacción en cadena: un usuario comparte el contenido, sus seguidores lo replican, creando un efecto avalancha. Los algoritmos de las plataformas amplifican este proceso mostrando contenido emocionalmente cargado a más personas. La velocidad de propagación supera las capacidades de moderación y verificación de datos (Manoylo, 2020).

La codificación emocional explota mecanismos psicológicos universales: miedo, ira, indignación. El nivel educativo no garantiza protección contra la desinformación emocionalmente cargada. El sensacionalismo y lo extraordinario del contenido captan la atención más rápido que la verificación racional de hechos (Ya Ihua, 2025).

No, es un mito. Los deepfakes modernos son difíciles de detectar, pero persisten artefactos técnicos: movimientos antinaturales, problemas de iluminación, baja calidad de imagen. Para 2025 la detección se ha complicado, pero herramientas especializadas y análisis experto permiten identificar falsificaciones (fuentes 2023-2025).

Sí, el análisis lingüístico revela patrones característicos. Los bulos suelen contener neologismos, disfemismos, léxico específico y construcciones emocionalmente cargadas. El análisis de corpus de bulos sobre COVID-19 mostró marcadores lingüísticos consistentes que los distinguen de noticias veraces (Shiryaeva, 2024; Monogarova, 2021, 2023).

Utiliza un enfoque multimodal: búsqueda inversa de imágenes (Google, Yandex), verificación de metadatos, análisis de sombras e iluminación. Presta atención a la calidad de imagen: paradójicamente, la baja calidad puede indicar generación por IA. Para casos complejos, emplea detectores especializados de deepfakes (fuentes 2023-2025).

Elimina inmediatamente la publicación y publica un desmentido explicando el error. Esto es crucial para interrumpir la cadena de propagación en cascada. Tu honestidad ayudará a detener la desinformación y aumentará la confianza de tu audiencia en tus futuras publicaciones (Manoylo, 2020).

Existen detectores de deepfakes por IA, servicios de verificación de datos (Factcheck.kz, StopFake), herramientas de análisis de metadatos y búsqueda inversa de imágenes. Sin embargo, una solución completamente automatizada es imposible: se requiere combinación de medios técnicos y experiencia humana. Los detectores van rezagados respecto a las últimas tecnologías de generación de contenido (fuentes 2023-2025).

Las plataformas utilizan moderación algorítmica, alianzas de verificación, etiquetado de contenido controvertido y reducción del alcance de publicaciones sospechosas. Sin embargo, la escala y velocidad de propagación superan las capacidades de moderación. Las reacciones en cascada ocurren más rápido de lo que los sistemas pueden responder (Ya Ihua, 2025).

Es una tecnología de desmentido anticipado de desinformación antes de su propagación masiva. El método incluye análisis de codificación emocional, identificación de patrones y advertencia pública a la audiencia. El enfoque preventivo es más efectivo que los desmentidos posteriores, ya que interrumpe la cascada en etapa temprana (Manoylo, 2020).

Los desmentidos alcanzan una audiencia significativamente menor que el bulo original. La resonancia emocional de la información falsa es más fuerte que la corrección racional. Para cuando se publica la verificación, la difusión en cascada ya ha creado una creencia falsa persistente en millones de usuarios (fuentes 2020-2025).

Es un mito extendido. La codificación emocional explota mecanismos psicológicos básicos independientemente del nivel educativo. El pensamiento crítico ayuda, pero no garantiza inmunidad a las manipulaciones. Incluso expertos pueden sucumbir al impacto de contenido emocionalmente cargado en condiciones de sobrecarga informativa (fuentes 2020-2025).

No, es imposible debido a la constante evolución de las tecnologías de generación de contenido y la tendencia humana a las reacciones emocionales. El objetivo realista es reducir la escala de difusión mediante alfabetización mediática, herramientas técnicas y mecanismos de plataforma. Es una carrera armamentística entre creadores y detectores de bulos (Ya Ihua, 2025).

Miedo, ira, indignación y repulsa moral son los principales desencadenantes de viralidad. Los bulos explotan amenazas a la salud, seguridad y justicia social. El sensacionalismo y lo extraordinario amplifican la respuesta emocional y el deseo de compartir información inmediatamente (Manoylo, 2020; Ya Ihua, 2025).

Los deepfakes tempranos (antes de 2023) tenían artefactos evidentes: manos mal renderizadas, movimientos labiales antinaturales, problemas con texturas. Las tecnologías actuales han mejorado significativamente, pero aún dejan rastros en iluminación, sombras y microexpresiones. La detección requiere herramientas especializadas y experiencia (fuentes 2023-2025).

El análisis lingüístico muestra que los bulos virales dirigidos a audiencia hispanohablante evitan estratégicamente mencionar figuras políticas españolas. Esto indica una segmentación deliberada y adaptación del contenido a las especificidades de la audiencia. El patrón fue identificado en análisis de corpus de desinformación sobre COVID-19 (Monogarova, 2021, 2023).