Was ist der Reward Prediction Error: Wenn das Gehirn die Differenz zwischen „erwartet" und „erhalten" berechnet

Der Reward Prediction Error (RPE) ist ein fundamentaler Berechnungsmechanismus, der gerade jetzt in Ihrem Gehirn arbeitet. Mathematisch: RPE = Tatsächliche Belohnung − Erwartete Belohnung (S003, S005).

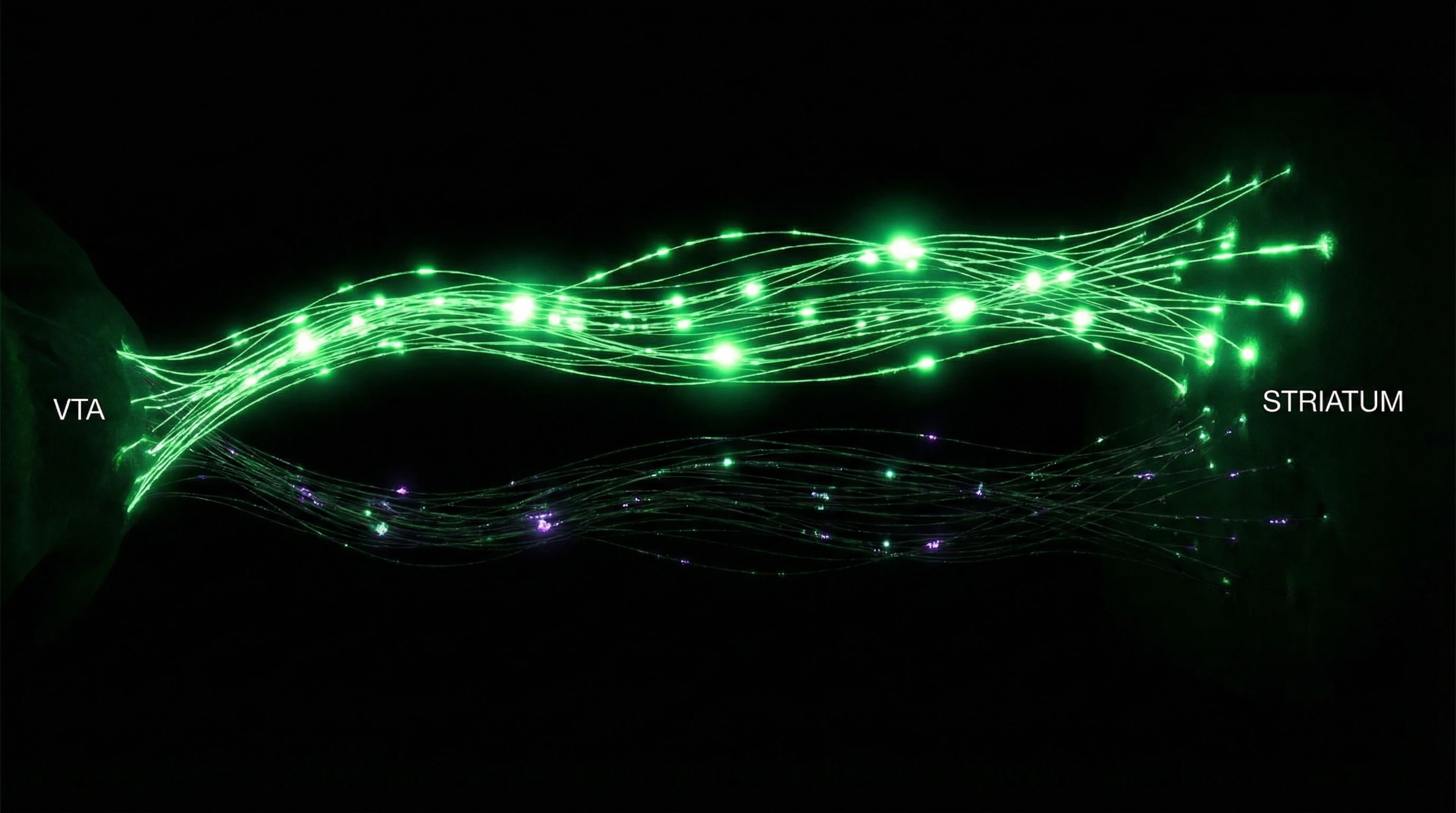

Positiver Fehler — Sie haben mehr erhalten als erwartet. Negativer Fehler — weniger. Dieses Signal wird von dopaminergen Neuronen des ventralen Tegmentums (VTA) kodiert und an das Striatum weitergeleitet, wo es als Grundlage für Verstärkungslernen dient (S007).

- Dopaminerge Neuronen der VTA

- Erhöhen die Feuerrate bei positivem Fehler, verringern sie bei negativem. Sie kodieren nicht die Belohnung selbst, sondern die Abweichung von der Erwartung (S003).

- Nucleus accumbens

- Erhält Projektionen aus der VTA und moduliert synaptische Plastizität. Dieselbe Belohnung löst unterschiedliche dopaminerge Antworten aus, abhängig von ihrer Vorhersagbarkeit.

Signed vs Unsigned RPE: Richtung versus Größe

Aktuelle Forschung unterscheidet zwei Typen von Vorhersagefehlern (S004).

| RPE-Typ | Was kodiert wird | Funktion |

|---|---|---|

| Signed RPE | Richtung des Fehlers (besser/schlechter als erwartet) | Bewertung von Ergebnissen, Verhaltensverstärkung |

| Unsigned RPE | Absolute Größe der Abweichung | Verarbeitung von Unsicherheit, Aktualisierung des Weltmodells |

EEG-Studien zeigen, dass diese beiden Signaltypen von teilweise unabhängigen neuronalen Systemen verarbeitet werden. Unsigned RPE ist mit metakognitivem Monitoring der Vorhersagegenauigkeit verbunden.

Temporal Difference Learning: Wie RPE Erwartungen über die Zeit aktualisiert

RPE ist in den Temporal-Difference-(TD-)Learning-Algorithmus eingebettet, bei dem Vorhersagen bei jedem Zeitschritt aktualisiert werden und nicht erst nach dem Endergebnis (S005).

Wenn Sie ein Signal sehen, das eine Belohnung vorhersagt (Türklingel vor der Essenslieferung), beginnen dopaminerge Neuronen auf dieses Signal zu reagieren, nicht auf die Belohnung selbst. Der Vorhersagefehler „wandert" zeitlich zurück zum frühesten Prädiktor. Mehr dazu im Abschnitt Thermodynamik.

- Die dopaminerge Antwort wechselt von der Belohnung zu kontextuellen Signalen, die ihr vorausgehen

- Konditionierte Stimuli erwerben motivationale Kraft

- Abhängigkeiten werden stabil — das Gehirn reagiert auf den Kontext, nicht auf die Substanz

Dieser Mechanismus erklärt, warum eine Trennung dieselben Trauermechanismen auslöst wie der Verlust einer Belohnung: Das Gehirn ist daran gewöhnt, die Anwesenheit des Partners vorherzusagen und erhält einen negativen Vorhersagefehler bei dessen Abwesenheit.

Fünf Argumente für die zentrale Rolle von RPE beim Lernen und bei Entscheidungsprozessen

🔬 Argument 1: Artübergreifende Konservierung des Mechanismus

RPE-Mechanismen wurden bei Organismen von Fruchtfliegen bis zu Primaten nachgewiesen, was auf ihre fundamentale evolutionäre Bedeutung hinweist (S005). Bei allen untersuchten Arten zeigt sich eine ähnliche Logik: Neuronale Systeme, die Neuromodulatoren verwenden (Dopamin bei Säugetieren, Octopamin bei Insekten), kodieren Abweichungen von erwarteten Ergebnissen und nutzen diese Signale zur Verhaltensmodifikation.

Die Konservierung über Hunderte Millionen Jahre Evolution hinweg belegt, dass RPE eine kritisch wichtige adaptive Aufgabe löst: effizientes Lernen in einer veränderlichen Umgebung bei begrenzten Rechenressourcen.

📊 Argument 2: Direkte Entsprechung zwischen dopaminerger Aktivität und Verhaltenslernen

Optogenetische Experimente demonstrieren einen kausalen Zusammenhang: Künstliche Stimulation dopaminerger Neuronen im Moment einer Handlung erhöht die Wahrscheinlichkeit der Wiederholung dieser Handlung, selbst in Abwesenheit einer realen Belohnung (S007). Das Gegenteil gilt ebenfalls – die Unterdrückung dopaminerger Aktivität beeinträchtigt das Lernen.

Die Größe der dopaminergen Antwort korreliert mit der Lerngeschwindigkeit: Je größer der Vorhersagefehler, desto schneller erfolgt die Aktualisierung der Verhaltensstrategie (S005). Dies ist ein direkter Beweis dafür, dass RPE nicht nur mit Lernen korreliert, sondern dessen kausaler Mechanismus ist.

🧠 Argument 3: Rechnerische Effizienz von TD-Learning

Aus Sicht des maschinellen Lernens zeigen RPE-basierte Algorithmen (insbesondere TD-Learning) ein optimales Verhältnis zwischen Lerngeschwindigkeit und Rechenkomplexität (S005). Im Gegensatz zu Methoden, die ein vollständiges Umgebungsmodell erfordern, arbeitet RPE-basiertes Lernen inkrementell und aktualisiert Schätzungen nach jeder Erfahrung.

- Inkrementelle Aktualisierung

- Ermöglicht Organismen das Lernen in Echtzeit, ohne die vollständige Interaktionshistorie speichern und verarbeiten zu müssen.

- Konvergenz zur optimalen Lösung

- Die Tatsache, dass biologische Systeme zu einer Lösung konvergierten, die mathematisch nahe am Optimum liegt, bestätigt den adaptiven Wert von RPE-Mechanismen.

🔎 Argument 4: Erklärungskraft für klinische Phänomene

Das RPE-Framework erklärt ein breites Spektrum psychiatrischer und neurologischer Störungen (S008). Bei Abhängigkeitserkrankungen zeigt sich eine Hypersensitivität gegenüber Signalen, die die Droge vorhersagen, und eine abgestumpfte Reaktion auf natürliche Belohnungen – ein Muster, das mit gestörten RPE-Signalen übereinstimmt.

Bei Depressionen ist Anhedonie und eine verminderte Fähigkeit, aus positiven Ergebnissen zu lernen, charakteristisch, was abgestumpften positiven RPE entspricht. Bei Schizophrenie kann aberrante dopaminerge Signalübertragung falsche Vorhersagefehler generieren, was zur Bildung wahnhafter Überzeugungen führt (S008).

Ein einheitlicher theoretischer Rahmen, der derart heterogene klinische Phänomene erklärt, besitzt hohe Erklärungskraft.

🧪 Argument 5: Konvergenz von Daten aus multiplen Methodologien

Die Rolle von RPE wird durch Daten aus Einzelzellableitungen bei Tieren, fMRT beim Menschen, EEG/ERP-Studien, pharmakologischen Manipulationen, genetischen Untersuchungen und computergestützter Modellierung bestätigt (S004), (S005), (S003). Wenn unabhängige Methoden mit unterschiedlichen Einschränkungen und Fehlerquellen zu derselben Schlussfolgerung konvergieren, erhöht dies die Zuversicht in deren Validität erheblich.

| Methodologie | Was gemessen wird | Ergebnis |

|---|---|---|

| Einzelzellableitungen | Aktivität einzelner dopaminerger Neuronen | Kodierung des Vorhersagefehlers in Echtzeit |

| fMRT | BOLD-Signal im ventralen Striatum | Korrelation mit berechneten RPE aus Verhaltensmodellen |

| EEG/ERP | Komponente Reward Positivity | Sensitivität für die Größe des Vorhersagefehlers |

Der Attraktivitätseffekt: Wie Kontext neuronale RPE-Berechnungen verändert

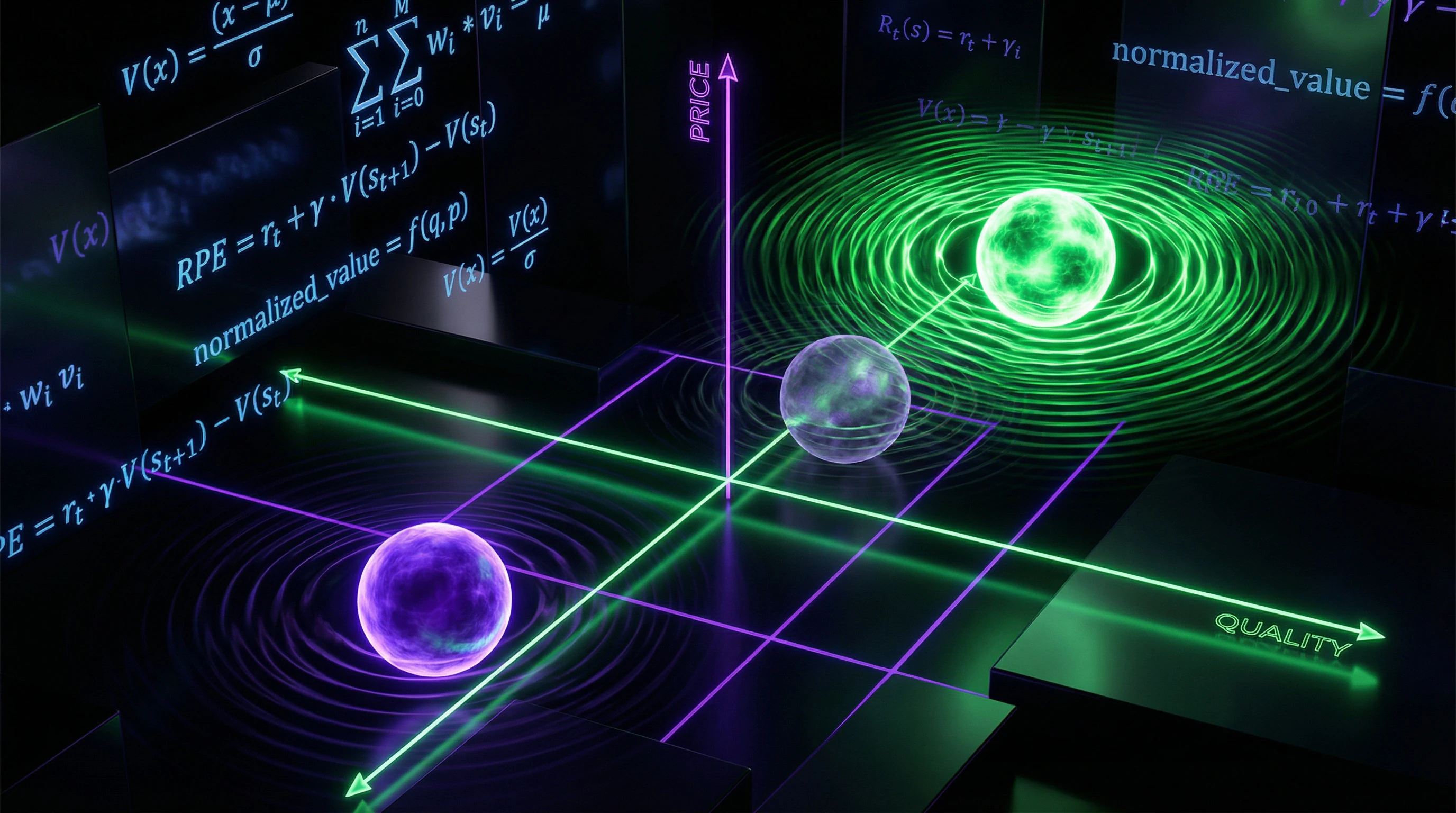

Die klassische RPE-Theorie geht davon aus, dass Vorhersagefehler auf Basis absoluter Belohnungswerte berechnet werden. Forschungen zum Attraktivitätseffekt (attraction effect) zeigen jedoch, dass der Wahlkontext diese Berechnungen radikal moduliert (S001, S002).

Der Attraktivitätseffekt tritt auf, wenn das Hinzufügen einer dritten, asymmetrisch dominierten Option (decoy) die Attraktivität einer der beiden ursprünglichen Optionen erhöht. Wenn Sie zwischen Option A (hohe Qualität, hoher Preis) und Option B (niedrige Qualität, niedriger Preis) wählen, erhöht das Hinzufügen von Option C (etwas schlechter als A in beiden Parametern) die Wahrscheinlichkeit, A zu wählen, obwohl sich der objektive Wert von A nicht verändert hat. Mehr dazu im Abschnitt Elektromagnetismus.

🧬 Neuronale Korrelate der kontextuellen RPE-Modulation

Eine fMRT-Studie zeigte, dass der Attraktivitätseffekt RPE-Signale im ventralen Striatum und im medialen präfrontalen Kortex moduliert (S001, S002). Wenn Teilnehmer in Gegenwart einer Decoy-Option wählten, waren die neuronalen RPE-Signale für die Zieloption verstärkt im Vergleich zum Kontext ohne Decoy, selbst bei identischen objektiven Ergebnissen.

Das Gehirn berechnet Vorhersagefehler nicht in absoluten Einheiten, sondern relativ zum Wahlkontext. Diese Modulation erfolgt auf der Ebene grundlegender RPE-Signale, nicht nur auf der Ebene höherstufiger Entscheidungsfindung.

📊 Zeitliche Dynamik: Intertemporale Entscheidungen unter Kontexteinfluss

Der Attraktivitätseffekt beeinflusst intertemporale Entscheidungen (intertemporal choice) — Entscheidungen zwischen kleineren sofortigen und größeren verzögerten Belohnungen (S001, S002). Die Anwesenheit einer Decoy-Option veränderte nicht nur die Wahl selbst, sondern auch die subjektive Diskontierung zukünftiger Belohnungen.

| Bedingung | Zeitliche Diskontierung | RPE-Signal für verzögerte Belohnung |

|---|---|---|

| Ohne Decoy | Hoch (geringe Geduld) | Schwach |

| Mit Decoy | Niedrig (hohe Geduld) | Verstärkt |

Teilnehmer zeigten eine geringere zeitliche Diskontierung (größere „Geduld") für die Zieloption in Gegenwart eines Decoys. Das Gehirn generierte stärkere positive Vorhersagefehler für verzögerte Belohnungen in einem Kontext, der sie relativ zu Alternativen attraktiver machte.

⚙️ Mechanismus: Wertnormalisierung im Wahlkontext

Der vermutete Mechanismus umfasst Wertnormalisierung (divisive normalization) — ein Prozess, bei dem der subjektive Wert einer Option relativ zum Durchschnitt oder zur Spanne verfügbarer Optionen berechnet wird (S001). Wenn ein Decoy zum Wahlset hinzugefügt wird, verändert er den Referenzpunkt, relativ zu dem andere Optionen bewertet werden.

- Die Zieloption wird attraktiver, nicht weil ihr absoluter Wert gestiegen ist

- Sie dominiert nun über eine größere Anzahl von Alternativen im Wahlraum

- Diese kontextuelle Neubewertung spiegelt sich in verstärkten RPE-Signalen wider

- Verstärkte Signale steuern Lernen und zukünftige Präferenzen (S002)

Das bedeutet, dass neuronale Belohnungsbewertungssysteme nicht als absolute Zähler arbeiten, sondern als adaptive Komparatoren, die Erwartungen kontinuierlich an den aktuellen Wahlkontext kalibrieren.

Evidenzbasis: Was wir über RPE mit hoher Sicherheit wissen

🔬 Dopamin kodiert Vorhersagefehler, nicht die Belohnung selbst

Dopaminerge Neuronen im VTA kodieren Vorhersagefehler, nicht die absolute Größe der Belohnung (S003, S007). Klassische Experimente von Schultz zeigten: Bei unerwartetem Saft zeigen Neuronen einen Aktivitätsanstieg, aber nach dem Lernen, wenn der Saft vorhersagbar wird, verschwindet dieser Anstieg.

Statt auf die Belohnung selbst zu reagieren, beginnen die Neuronen auf den konditionierten Stimulus zu reagieren, der den Saft vorhersagt. Wenn die erwartete Belohnung ausbleibt, wird eine Unterdrückung der Aktivität unter das Basisniveau beobachtet — ein negativer Vorhersagefehler (S003). Dieses Muster entspricht exakt der mathematischen Definition von RPE und wurde in Dutzenden Laboren reproduziert.

Dopamin reagiert auf die Differenz zwischen Erwartung und Realität, nicht auf die Realität selbst. Eine vollständig vorhersagbare Belohnung löst keine dopaminerge Antwort aus.

📊 Ventrales Striatum als Rechenzentrum für RPE

Das BOLD-Signal im ventralen Striatum, insbesondere im Nucleus accumbens, korreliert mit berechneten Vorhersagefehlern aus Verhaltensmodellen (S008). Meta-Analysen zeigen Aktivierung dieser Region bei positiven RPE in einem breiten Spektrum von Aufgaben — von konditionierten Reflexen bis zu komplexen ökonomischen Entscheidungen.

Entscheidend: Die Aktivierung ist spezifisch für RPE, nicht für die Belohnung als solche. Sie ist stärker bei unerwarteten Belohnungen als bei erwarteten, selbst wenn die absolute Größe der Belohnung identisch ist (S008). Individuelle Unterschiede in der Stärke dieser Signale korrelieren mit Impulsivität und Risikobereitschaft.

- Das ventrale Striatum wird bei positiven Vorhersagefehlern aktiviert

- Die Aktivierung hängt von der Unerwartetheit ab, nicht von der Größe der Belohnung

- Individuelle Unterschiede in der Aktivierung sagen Verhaltensmerkmale voraus

🧾 Reward Positivity (RewP) als elektrophysiologischer Marker für RPE

Die Reward-Positivity-Komponente im EEG zeigt Sensitivität für Belohnungsvorhersagefehler (S003). RewP ist eine positive Potenzialabweichung, die 250–350 ms nach Feedback auftritt, mit Maximum an zentralen Elektroden.

Die RewP-Amplitude ist größer für positive als für negative Ergebnisse, und entscheidend — sie ist sensitiv für Erwartungen: Der Unterschied zwischen Gewinn und Verlust ist größer, wenn das Ergebnis unerwartet ist (S003). Es gibt jedoch eine Debatte: Reflektiert RewP tatsächlich Reward Prediction Error oder einen allgemeineren Salience Prediction Error — Abweichung von der Erwartung unabhängig von der Valenz.

🔎 RPE beim aversiven Lernen: Erweiterung über Belohnung hinaus

Analoge Mechanismen funktionieren für aversive Stimuli (S001). Nach unkonditionierten aversiven Stimuli (unangenehme Geräusche, elektrische Schocks) werden neuronale Signale beobachtet, die Vorhersagefehlern für Bestrafung entsprechen.

Wenn ein aversiver Stimulus schlimmer als erwartet ist, wird ein negativer Vorhersagefehler generiert. Diese Signale werden zum Lernen von Vermeidung und zur Bildung von Schutzreaktionen genutzt. Die neuronalen Substrate überlappen teilweise mit Belohnungsverarbeitungssystemen, umfassen aber spezifische Strukturen: Amygdala und periaquäduktales Grau. Mehr dazu im Abschnitt Relativitätstheorie.

| Stimulustyp | Positiver RPE | Negativer RPE | Neuronale Strukturen |

|---|---|---|---|

| Belohnung | Besser als erwartet | Schlechter als erwartet | VTA, Nucleus accumbens |

| Bestrafung | Weniger schwer als erwartet | Schwerer als erwartet | Amygdala, periaquäduktales Grau |

⚙️ Value-free Teaching Signals: Neues Paradigma zum Verständnis von Dopamin

Eine Studie in Nature stellt die traditionelle Vorstellung von Dopamin als Wertsignal infrage (S007). Dopaminerge Handlungsvorhersagefehler (Action Prediction Errors) können als wertfreie Lernsignale dienen.

Dopaminerge Neuronen reagierten auf die Diskrepanz zwischen erwarteter und tatsächlicher Handlung, unabhängig davon, ob diese Handlung zu Belohnung oder Bestrafung führte (S007). Dies legt nahe, dass das dopaminerge System abstraktere Vorhersagefehler kodiert — nicht nur „wie gut ist das Ergebnis", sondern auch „wie genau ist mein Weltmodell".

Dopamin kann einen Fehler in der Handlungsvorhersage signalisieren, unabhängig davon, ob diese Handlung gut oder schlecht ist. Dies erweitert das Verständnis von Dopamin über das Belohnungssystem hinaus.

Mechanismen und Kausalität: Was tatsächlich Verhaltensänderungen verursacht

🧬 Synaptische Plastizität als Vermittler zwischen RPE und Lernen

RPE-Signale verändern Verhalten nicht direkt — sie modulieren die synaptische Plastizität in Zielstrukturen (S005). Dopamin wirkt als Neuromodulator und verändert die Effizienz der synaptischen Übertragung im Striatum.

Positive RPE verstärken Synapsen durch Langzeitpotenzierung (LTP), negative schwächen sie durch Langzeitdepression (LTD). Dieser Prozess — dopaminmodulierte spike-timing-abhängige Plastizität — stellt die kausale Verbindung zwischen RPE-Signalen und Veränderungen in der Verhaltensstrategie her (S005).

Plastizität hängt vom zeitlichen Zusammentreffen dreier Faktoren ab: präsynaptische Aktivität, postsynaptische Aktivität und dopaminerges Signal. Ohne dieses Triplett verändert sich die Synapse nicht.

🔁 Korrelation vs. Kausalität: Optogenetische Beweise

Die Korrelation zwischen dopaminerger Aktivität und Lernen beweist keine Kausalität. Die Optogenetik ermöglichte es, dies direkt zu überprüfen (S007).

Künstliche Aktivierung dopaminerger Neuronen im VTA zum Zeitpunkt einer Handlung verstärkte diese Handlung in der Zukunft, selbst ohne tatsächliche Belohnung. Die Unterdrückung von Dopamin beim Erhalt einer Belohnung blockierte das Lernen. Dopaminerge RPE-Signale korrelieren nicht nur mit Lernen — sie sind notwendig und hinreichend für dessen Entstehung (S007).

- Dopaminaktivierung → Verstärkung der Handlung (auch ohne Belohnung)

- Dopaminunterdrückung → Blockierung des Lernens (trotz Belohnung)

- Schlussfolgerung: Kausale Rolle von Dopamin experimentell nachgewiesen

🧩 Störfaktoren: Aufmerksamkeit, Motivation und kognitive Kontrolle

Die Interpretation von RPE-Signalen wird durch multiple Störfaktoren erschwert. Aufmerksamkeit moduliert die Verarbeitung von Belohnungen: Auffälligere Stimuli erzeugen stärkere Reaktionen unabhängig vom RPE. Mehr dazu im Abschnitt Statistik und Wahrscheinlichkeitstheorie.

Der Motivationszustand beeinflusst den subjektiven Wert: Ein hungriges Tier bewertet Nahrung höher, was die Grunderwartungen und RPE verändert. Kognitive Kontrolle und Arbeitsgedächtnis ermöglichen die Aufrechterhaltung komplexer Erwartungen, die möglicherweise nicht einfachen TD-Learning-Modellen entsprechen (S005).

| Störfaktor | Wirkmechanismus | Wie kontrollieren |

|---|---|---|

| Aufmerksamkeit | Verstärkt neuronale Reaktion auf auffällige Stimuli | Stimuluskomplexität angleichen; Aufmerksamkeit separat messen |

| Motivation | Verändert subjektiven Wert der Belohnung | Zustand standardisieren (Hunger, Durst); Belohnungen variieren |

| Kognitive Kontrolle | Ermöglicht Aufbau komplexer Erwartungen | Einfache Aufgaben verwenden; Arbeitsgedächtnis messen |

Individuelle Unterschiede in diesen Prozessen erzeugen Variabilität in RPE-Signalen, die nicht mit dem grundlegenden Lernmechanismus zusammenhängt (S008).

🔬 Doppelte Dissoziation: Model-free vs. model-based Learning

RPE-basiertes Lernen (model-free) ist nicht das einzige Lernsystem. Parallel existiert ein model-based System, das ein explizites Modell der Umweltstruktur zur Planung nutzt (S005).

Nach Veränderung der Belohnungsstruktur passt sich das model-based System sofort an, während model-free wiederholte Erfahrung benötigt. Neuroimaging zeigt partielle Dissoziation: Das ventrale Striatum ist mit model-free RPE verbunden, der dorsolaterale präfrontale Kortex und der intraparietale Sulcus mit model-based Berechnungen (S005).

- Model-free System

- Lernt durch RPE; langsame Anpassung an neue Bedingungen; ventrales Striatum.

- Model-based System

- Nutzt explizites Umweltmodell; schnelle Anpassung; präfrontaler Kortex.

- Reales Verhalten

- Kombination beider Strategien; erschwert Interpretation neuronaler Signale.

Verhalten in realen Aufgaben stellt oft eine gewichtete Kombination beider Systeme dar, was komplexere Modelle zur Erklärung beobachteter Aktivitätsmuster erfordert.

Datenkonflikte: Wo Quellen divergieren und warum das wichtig ist

🧩 Reward vs Salience Prediction Error: eine ungelöste Debatte

Es gibt eine fundamentale Debatte darüber, was genau dopaminerge Neuronen kodieren. Die traditionelle Interpretation: Dopamin kodiert reward prediction error — die Abweichung vom erwarteten Wert eines Ergebnisses (S001). Die alternative Hypothese: Dopamin kodiert salience prediction error — die Abweichung von der erwarteten Auffälligkeit eines Ereignisses, unabhängig von seiner Valenz.

Die Forschung zu reward positivity zeigt, dass diese Komponente eher salience als spezifisch reward widerspiegeln könnte. Das Problem ist, dass in den meisten Experimenten diese beiden Signale korrelieren: bedeutsame Ereignisse bringen oft Belohnung, und Bestrafung ist bedeutsam und negativ. Mehr dazu im Abschnitt Logische Fehlschlüsse.

Wenn Variablen unter Laborbedingungen perfekt korrelieren, ist es unmöglich, ihren Beitrag zur neuronalen Antwort zu trennen. Das ist kein Fehler der Experimentatoren — es ist ein fundamentales Designproblem.

Kontextuelle Modulation: Verstärkung oder Neudefinition?

Der Attraktivitätseffekt zeigt, dass Kontext das RPE-Signal moduliert (S002). Aber der Mechanismus bleibt umstritten: Verstärkt der Kontext den bestehenden RPE-Code oder definiert er seine Logik vollständig neu?

Einige Studien legen nahe, dass Attraktivität den Wert einer Option in Echtzeit neu schreibt (S004). Andere Daten deuten auf parallele Verarbeitungskanäle hin: RPE bleibt unverändert, aber sein Einfluss auf das Verhalten wird durch ein separates Bedeutsamkeitssystem moduliert.

| Interpretation | Vorhersage | Status |

|---|---|---|

| Kontext verstärkt RPE | Signalamplitude steigt mit Attraktivität | In fMRI bestätigt |

| Kontext definiert Wert neu | RPE wird von neuer Basislinie berechnet | Umstritten; erfordert direktes Testen |

| Parallele Kanäle | RPE und salience sind unabhängig, interagieren aber verhaltensmäßig | Theoretisch attraktiv, aber schwer zu testen |

Altersunterschiede: Norm oder Artefakt?

Die Daten zu RPE in verschiedenen Altersgruppen sind widersprüchlich. Bei Jugendlichen wurde eine verstärkte Reaktion auf reward prediction errors gefunden (S006), aber die Interpretation variiert: Ist das erhöhte Sensibilität für Fehler oder einfach eine andere Kalibrierung des Systems?

Bei älteren Menschen schwächt sich das RPE-Signal ab, aber Dopamin kann diese Funktion wiederherstellen (S005). Die Frage: Degradiert der RPE-Mechanismus selbst oder ändert sich seine neurochemische Grundlage?

Altersunterschiede könnten nicht verschiedene Versionen desselben Mechanismus widerspiegeln, sondern grundlegend unterschiedliche Lernstrategien in verschiedenen Lebensphasen.

Einheit oder Vielfalt?

Die Schlüsselfrage: Kodieren alle dopaminergen Neuronen dasselbe RPE-Signal oder existieren Subpopulationen mit unterschiedlichen Funktionen? (S007) legt eine gemeinsame Funktion nahe, aber (S008) zeigt, dass axiomatische Modellierung Abweichungen von der klassischen RPE-Hypothese aufdeckt.

Wenn Neuronen spezialisiert sind, dann ist „reward prediction error" kein einheitlicher Mechanismus, sondern eine Familie verwandter Prozesse. Das verändert die gesamte Logik der Dateninterpretation.

- Warum das für kognitive Immunologie wichtig ist

- Wenn RPE kein universeller Code ist, dann funktioniert Kontextmanipulation nicht über einen einzigen „Hebel", sondern über mehrere parallele Kanäle. Das erschwert die Abwehr gegen kognitive Fallen, eröffnet aber auch neue Interventionspunkte.