🧠 Neurowissenschaften

🧠 NeurowissenschaftenDer Goldstandard der Synthese wissenschaftlicher Evidenz in der Medizinλ

Systematische Reviews und Meta-Analysen stellen die höchste Evidenzstufe dar, indem sie Ergebnisse zahlreicher Studien durch transparente, reproduzierbare Protokolle zusammenführen, um verlässliche klinische Empfehlungen zu liefern.

Overview

Systematische Reviews und Meta-Analysen sind fundamentale Instrumente der evidenzbasierten Medizin, die es ermöglichen, alle relevanten Studien zu einer spezifischen Fragestellung systematisch zu identifizieren, auszuwählen, kritisch zu bewerten und zu synthetisieren. Im Gegensatz zu narrativen Übersichtsarbeiten folgen sie vordefinierten Protokollen, minimieren systematische Fehler und gewährleisten die Reproduzierbarkeit der Ergebnisse. Meta-Analyse als statistische Methode kombiniert quantitative Daten aus unabhängigen Studien, erhöht die statistische Power und löst Widersprüche zwischen einzelnen Arbeiten auf. Moderne Standards wie PRISMA 2020 gewährleisten Transparenz und Vollständigkeit der Berichterstattung in allen Phasen der Review-Durchführung.

🛡️ Laplace-Protokoll: Die Qualität einer Meta-Analyse wird durch die Qualität der eingeschlossenen Studien bestimmt — die Kombination schwacher Arbeiten erzeugt keine starken Evidenzen. Kritische Bewertung der Methodologie, Analyse von Heterogenität und Publikationsbias sind obligatorisch für die korrekte Interpretation der Ergebnisse.

Reference Protocol

Wissenschaftliche Grundlage

Evidenzbasierter Rahmen für kritische Analyse

Navigation Matrix

Unterabschnitte

[abiogenesis]

Abiogenese

Wissenschaftliche Theorie über die natürliche Entstehung des Lebens aus einfachen chemischen Verbindungen vor über 3,5 Milliarden Jahren durch schrittweise chemische Evolution

Erkunden

[cell-biology]

Zellbiologie

Die Zelle – die kleinste lebende Einheit, die alle Moleküle des Lebens enthält. Von einzelligen Organismen bis zu den Billionen Zellen des menschlichen Körpers – wir erforschen Struktur, Funktionen und Verhalten der Grundlage allen Lebens.

Erkunden

[evolution-genetics]

Evolution und Genetik

Die biologische Evolution ist ein Prozess der Entwicklung und Veränderung der belebten Natur über Millionen von Jahren hinweg, durch den die gesamte Vielfalt des Lebens auf unserem Planeten entstanden ist.

Erkunden

[neuroscience]

Neurowissenschaften

Interdisziplinäre Wissenschaft, die Struktur, Funktion und Entwicklung des Nervensystems erforscht – von molekularen Mechanismen bis hin zu menschlichem Verhalten und Kognition.

Erkunden

Protocol: Evaluation

Teste Dich

Quiz zu diesem Thema kommt bald

Sector L1

Artikel

Forschungsmaterialien, Essays und tiefe Einblicke in die Mechanismen des kritischen Denkens.

🧠 Neurowissenschaften

🧠 Neurowissenschaften 🧬 Evolution und Genetik

🧬 Evolution und Genetik 🧠 Neurowissenschaften

🧠 Neurowissenschaften 🧬 Evolution und Genetik

🧬 Evolution und Genetik 🧬 Evolution und Genetik

🧬 Evolution und Genetik 🧬 Evolution und Genetik

🧬 Evolution und Genetik 🧠 Neurowissenschaften

🧠 Neurowissenschaften 🧬 Evolution und Genetik

🧬 Evolution und Genetik 🧠 Neurowissenschaften

🧠 Neurowissenschaften 🧠 Neurowissenschaften

🧠 Neurowissenschaften 🧠 Neurowissenschaften

🧠 Neurowissenschaften 🧬 Evolution und Genetik

🧬 Evolution und Genetik⚡

Vertiefung

Methodik systematischer Reviews: vom Literatur-Chaos zum reproduzierbaren Protokoll

Systematische Reviews stellen die höchste Stufe in der Hierarchie wissenschaftlicher Evidenz dar. Sie unterscheiden sich von narrativen Übersichtsarbeiten durch ihre strenge Methodik: prospektive Protokollregistrierung, erschöpfende Suche in multiplen Datenbanken, transparente Dokumentation jeder Entscheidung.

Der entscheidende Unterschied: Minimierung systematischer Fehler durch explizite Ein- und Ausschlusskriterien, die vor Beginn der Recherche festgelegt werden. Dies verhindert die subjektive Quellenauswahl, die bei traditionellen Literaturübersichten unvermeidlich ist.

Protokolle und Registrierung: PRISMA-P als Absicherung gegen Post-hoc-Manipulationen

Die prospektive Protokollregistrierung in Registern wie PROSPERO ist ein kritischer Mechanismus zur Verhinderung selektiver Berichterstattung. PRISMA-P 2015 bietet eine 17-Punkte-Checkliste für die Protokollentwicklung vor Beginn des Reviews: Forschungsfrage, Auswahlkriterien, Suchstrategie, Synthesemethoden.

Die Registrierung schafft eine öffentliche Dokumentation der Forschungsabsichten und macht nachträgliche Änderungen primärer Endpunkte oder Einschlusskriterien nach Kenntnisnahme der Ergebnisse unmöglich.

PRISMA 2020 erweiterte die Checkliste auf 27 Punkte: separate Anforderungen für Abstracts, Flussdiagramme, Protokolländerungen, Bewertung der Evidenzqualität und Transparenz der Finanzierung. Die Einhaltung von PRISMA garantiert keine Qualität, gewährleistet aber minimale Transparenz für die kritische Bewertung methodischer Strenge.

Suchstrategien: von inception bis zum letzten Byte

Eine umfassende Suchstrategie erfordert systematische Abdeckung multipler Datenbanken. Ein typisches Protokoll umfasst CENTRAL, MEDLINE und Embase mit Suche vom Zeitpunkt der Datenbankgründung bis zu einem definierten Datum.

- Transparenz der Suchbegriffe

- Vollständige Suchstrings für jede Datenbank, boolesche Operatoren, Filter – alles muss zur Reproduzierbarkeit publiziert werden.

- Erweiterte Suche

- Manuelle Durchsicht von Literaturverzeichnissen zentraler Artikel, Kontakte mit Experten, Suche nach unveröffentlichten Daten zur Minimierung des Publication Bias.

Die systematische Suche geht über elektronische Datenbanken hinaus. Es handelt sich um einen kombinierten Ansatz, bei dem jede Quelle im Protokoll dokumentiert und begründet wird.

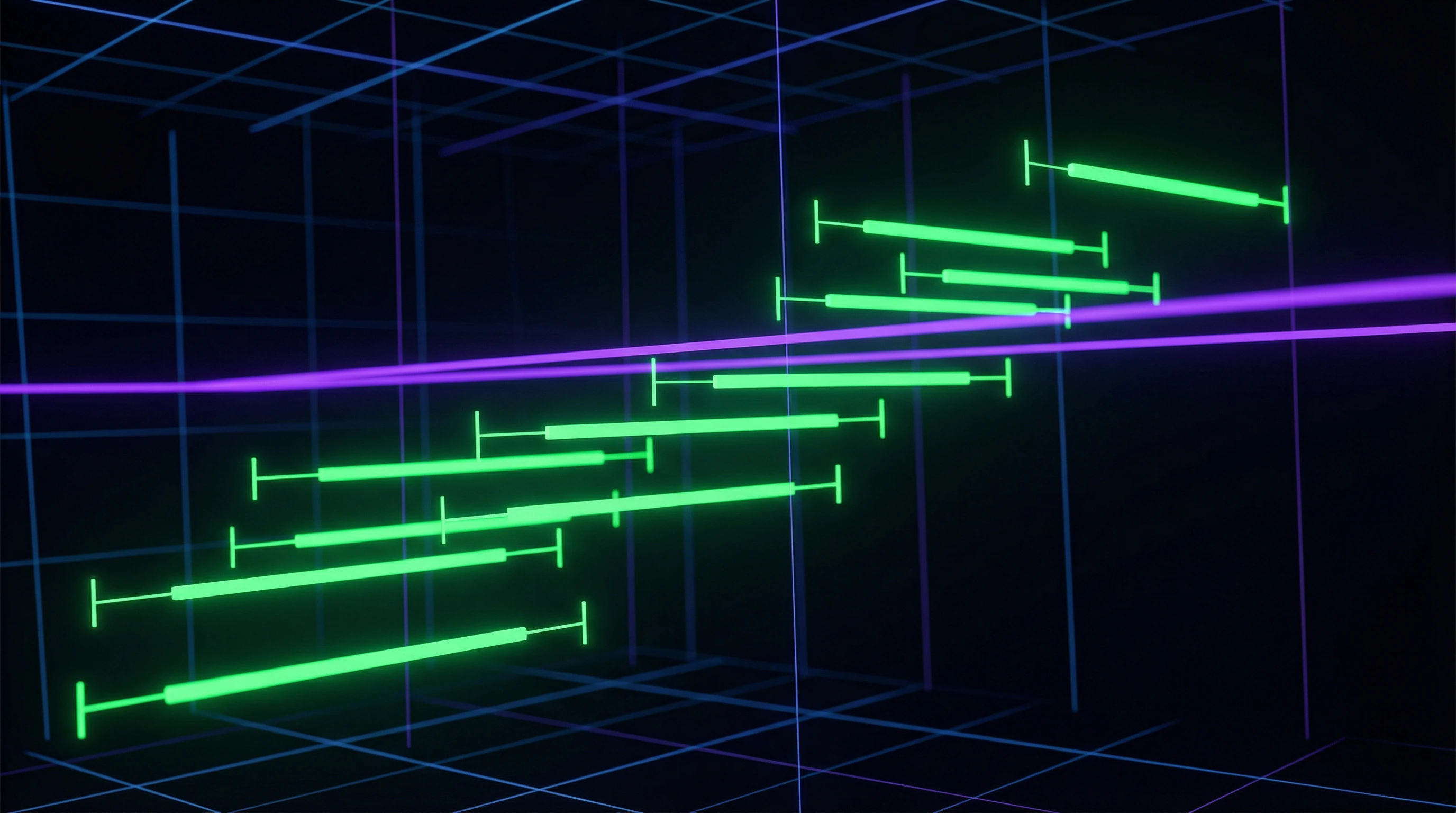

Meta-Analyse und statistische Synthese: wenn Zahlen lauter sprechen als Worte

Meta-Analyse ist eine statistische Technik zur Zusammenführung quantitativer Daten aus mehreren unabhängigen Studien, um eine einheitliche Effektschätzung mit erhöhter statistischer Power zu erhalten. Im Gegensatz zur systematischen Übersichtsarbeit, die qualitativ sein kann, ist die Meta-Analyse stets quantitativ und erfordert numerische Daten, die für statistisches Pooling geeignet sind.

Entscheidender Vorteil: Auflösung von Unsicherheiten, wenn einzelne Studien einander widersprechen, und Identifikation von Effekten, die in kleinen Stichproben unbemerkt bleiben.

Fixed-Effect- und Random-Effects-Modelle: die Philosophie der Variabilität

Das Fixed-Effect-Modell geht davon aus, dass alle eingeschlossenen Studien einen einzigen wahren Effekt schätzen und Unterschiede zwischen ihnen ausschließlich durch zufällige Stichprobenfehler bedingt sind. Das Random-Effects-Modell lässt zu, dass der wahre Effekt zwischen Studien aufgrund von Unterschieden in Populationen, Interventionen oder Design variiert.

| Modell | Annahme | Konfidenzintervall |

|---|---|---|

| Fixed-Effect | Ein wahrer Effekt; Variation = zufälliger Fehler | Enger bei Heterogenität |

| Random-Effects | Wahrer Effekt variiert zwischen Studien | Breiter; reflektiert zusätzliche Unsicherheit |

Eine Meta-Analyse zum Zusammenhang zwischen BMI und Brustkrebsrisiko zeigte gegensätzliche Effekte bei Stratifizierung nach Menopausenstatus: Risikoerhöhung bei postmenopausalen Frauen und Risikoreduktion bei prämenopausalen. Eine Studie zum neurowissenschaftlichen Schmerzlernen zeigte, dass die Interventionsdauer die Effektgröße signifikant beeinflusst und einen Teil der Heterogenität zwischen Studien erklärt.

Heterogenität und Publikationsbias: Detektivarbeit mit Daten

Die I²-Statistik quantifiziert den Anteil der Variabilität zwischen Studien, der auf wahre Heterogenität zurückzuführen ist: Werte von 25%, 50% und 75% werden als niedrige, moderate und hohe Heterogenität interpretiert. Hohe Heterogenität disqualifiziert eine Meta-Analyse nicht, erfordert aber Untersuchung durch Subgruppen- und Moderatoranalyse.

- Quellen der Variabilität zwischen Studien identifizieren

- Sensitivitätsanalyse durchführen unter Ausschluss von Arbeiten mit hohem Bias-Risiko

- Robustheit der Schlussfolgerungen gegenüber methodischer Qualität prüfen

Publikationsbias entsteht, wenn Studien mit positiven Ergebnissen häufiger publiziert werden als solche mit negativen, wodurch die gepoolte Effektschätzung in Richtung Überschätzung verzerrt wird. Funnel Plots visualisieren die Asymmetrie der Verteilung von Effektgrößen, während statistische Tests nach Egger und Begg das Vorhandensein von Bias formal prüfen.

Die Einbeziehung unpublizierter Daten durch Kontakte mit Forschenden und Suche in klinischen Studienregistern mildert Publikationsbias teilweise, vollständig eliminieren lässt er sich jedoch nicht.

Netzwerk-Metaanalyse: multidimensionales Schachspiel der Interventionen

Die Netzwerk-Metaanalyse erweitert die traditionelle paarweise Metaanalyse und ermöglicht den simultanen Vergleich multipler Interventionen auch bei Fehlen direkter Head-to-Head-Vergleiche zwischen allen Paaren. Die Methodologie nutzt sowohl direkte Evidenz aus Studien, die zwei Interventionen direkt vergleichen, als auch indirekte Evidenz über einen gemeinsamen Komparator und schafft so ein kohärentes Netzwerk von Vergleichen.

Der kritische Vorteil liegt in der Möglichkeit, alle verfügbaren Interventionen nach Wirksamkeit und Sicherheit zu ranken und damit klinische Entscheidungen bei multiplen therapeutischen Optionen zu informieren.

Indirekte Vergleiche und Transitivität: Logik transitiver Schlussfolgerungen

Der indirekte Vergleich der Interventionen A und C über einen gemeinsamen Komparator B basiert auf der Annahme der Transitivität: Wenn A besser ist als B und B besser als C, dann sollte A besser sein als C. Die Validität indirekter Vergleiche hängt kritisch von der Ähnlichkeit der Studien hinsichtlich Effektmodifikatoren ab – Charakteristika, die die relative Wirksamkeit der Interventionen beeinflussen können.

Eine Verletzung der Transitivität tritt auf, wenn sich Studien, die A mit B vergleichen, systematisch von Studien unterscheiden, die B mit C vergleichen, etwa hinsichtlich Population, Dosierung oder Begleitinterventionen.

- Inkonsistenzstatistik

- Prüft die Transitivitätsannahme durch Bewertung der Konsistenz zwischen direkter und indirekter Evidenz. Signifikante Diskrepanzen signalisieren potenzielle Verletzungen.

- Sensitivitätsanalyse

- Schließt Netzwerkknoten mit hohem Risiko für Transitivitätsverletzungen aus und prüft die Robustheit des Interventionsrankings.

Das RAIN-Protokoll (systematic Review and Artificial Intelligence Network meta-analysis) für COVID-19 demonstriert die Anwendung der Netzwerk-Metaanalyse auf eine sich rasch entwickelnde Evidenzbasis mit multiplen therapeutischen Kandidaten.

Ranking von Interventionen: von Wahrscheinlichkeiten zu klinischen Entscheidungen

Die Netzwerk-Metaanalyse generiert ein probabilistisches Ranking der Interventionen über SUCRA (Surface Under the Cumulative Ranking curve) – eine Metrik, bei der ein Wert von 100% auf die höchste Wahrscheinlichkeit hinweist, die beste Intervention zu sein, und 0% die schlechteste. Das Ranking berücksichtigt nicht nur Punktschätzer des Effekts, sondern auch die Unsicherheit: Eine Intervention mit moderatem Effekt und engem Konfidenzintervall kann höher ranken als eine mit größerem Effekt, aber breitem Intervall.

Eine Intervention, die im Netzwerkdurchschnitt optimal ist, kann für eine spezifische Patientensubgruppe suboptimal sein. Stratifikation nach klinischen Charakteristika ist kritisch für die Übersetzung des Rankings in Handlung.

Die Metaanalyse von Anti-VEGF-Therapien bei Makuladegeneration illustriert den klinischen Wert: Das simultane Ranking nach Wirksamkeit und Sicherheit informiert die Wahl zwischen Aflibercept, Ranibizumab und Bevacizumab.

Die Integration künstlicher Intelligenz in die Netzwerk-Metaanalyse, wie im RAIN-Protokoll vorgeschlagen, automatisiert Datenextraktion und Bewertung des Bias-Risikos und beschleunigt die Evidenzsynthese unter Pandemiebedingungen. Die Inositol-Studie bei PCOS demonstriert die Bedeutung der Stratifikation: Myo-Inositol zeigte Überlegenheit gegenüber D-Chiro-Inositol für reproduktive Outcomes, die Kombination erwies sich jedoch als optimal für metabolische Parameter.

PRISMA 2020-Berichtsstandards: Von der Checkliste zur Transparenz der Synthese

PRISMA 2020 ist eine aktualisierte Reihe von Empfehlungen, die die Version von 2009 ersetzt hat. Die 27-Punkte-Checkliste deckt alle Phasen ab: von der Formulierung der Fragestellung nach der PICO-Struktur bis zur Interpretation der Ergebnisse unter Berücksichtigung von Limitationen.

Der wesentliche Unterschied: erweiterte Anforderungen an die Beschreibung der Suchmethoden, die Bewertung der Evidenzqualität und die Berichterstattung über die Datensynthese. Dies erhöht die Reproduzierbarkeit und ermöglicht es dem Leser, jeden Schritt der Autorenlogik nachzuvollziehen.

27-Punkte-Checkliste und Datenflussdiagramme

Die Checkliste ist nach Abschnitten strukturiert: Titel, Abstract, Einleitung, Methoden, Ergebnisse, Diskussion, Finanzierung. Jeder Abschnitt enthält spezifische Berichtsanforderungen.

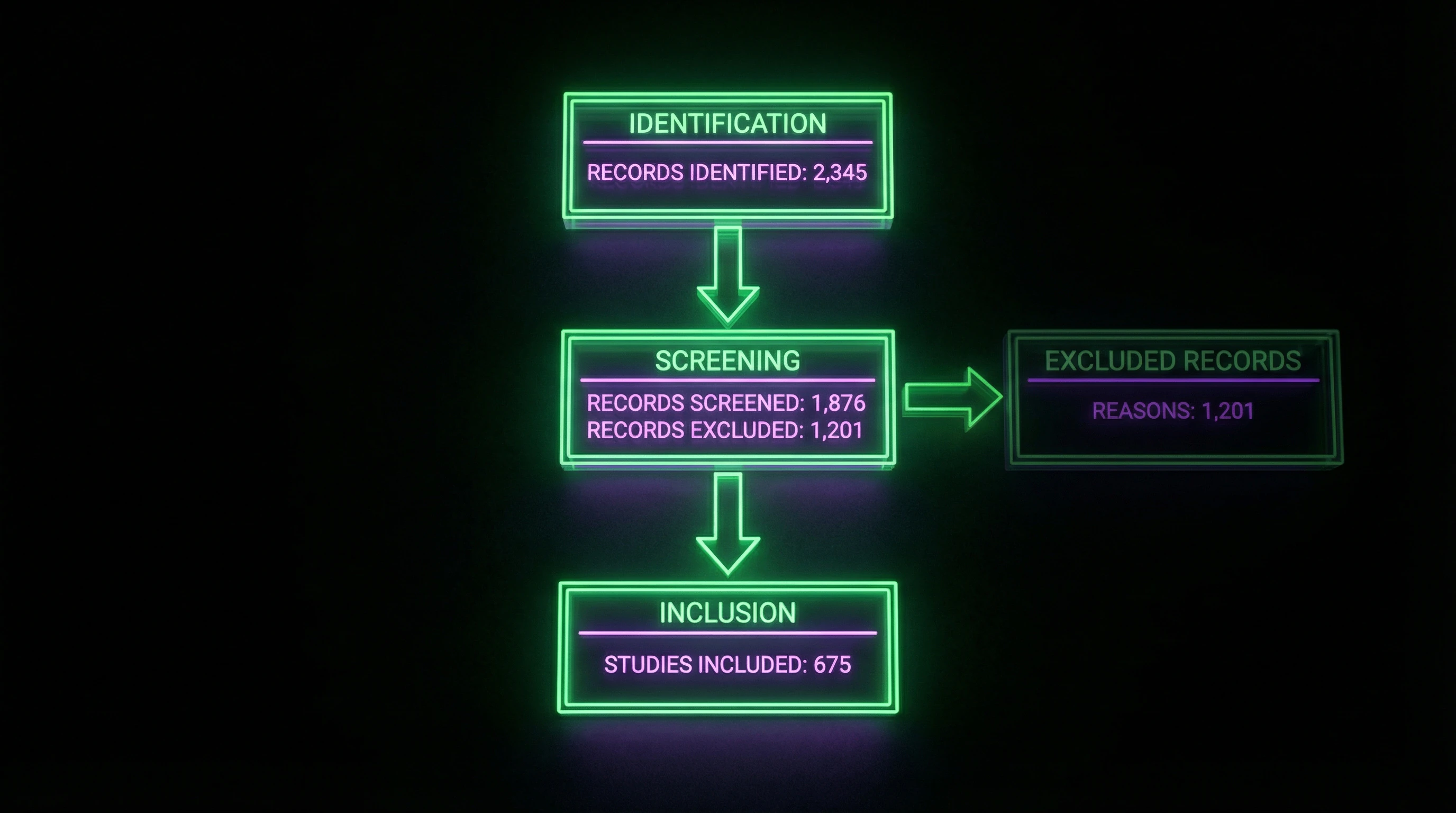

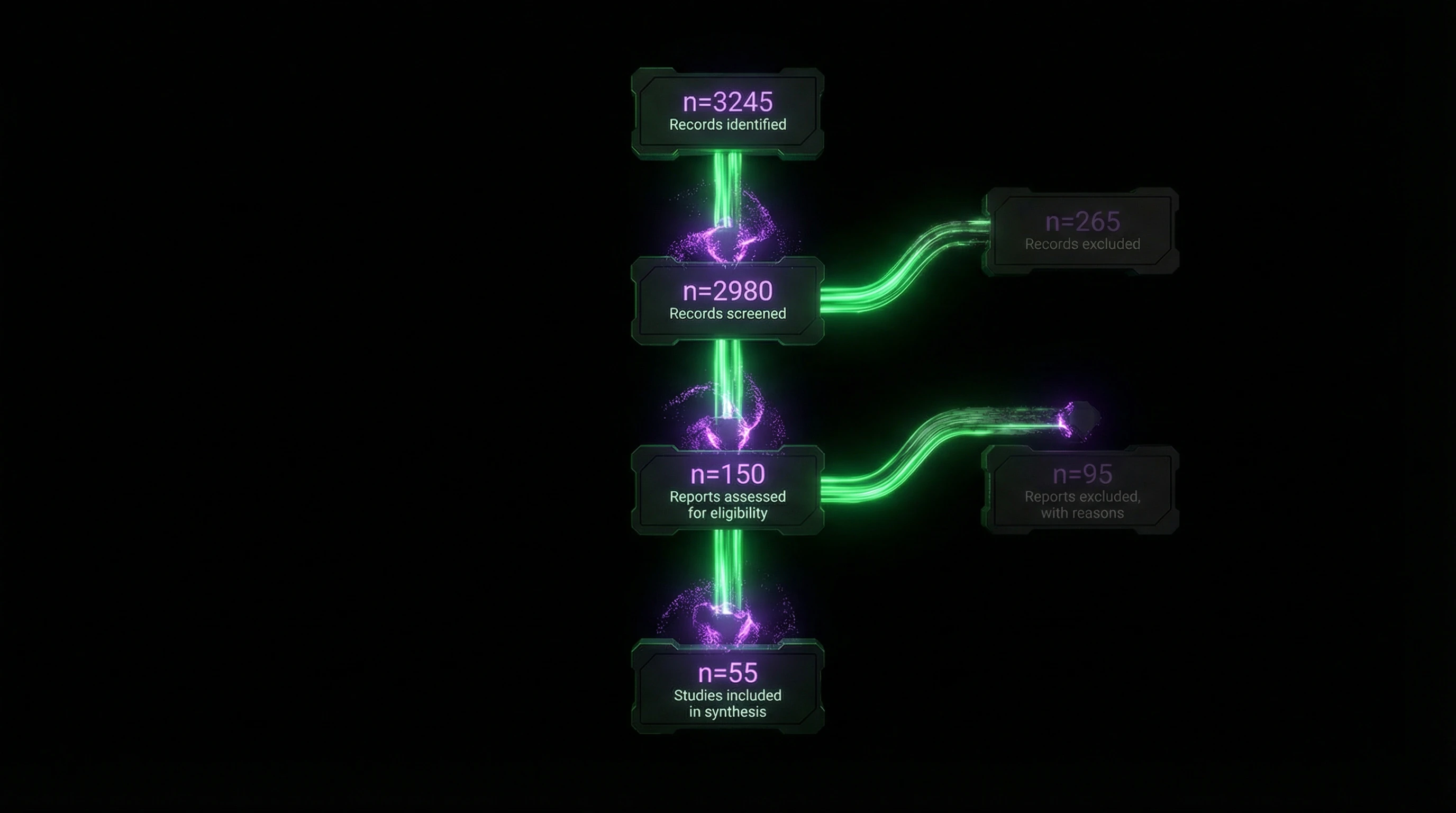

Das Flussdiagramm visualisiert den Auswahlprozess: Anzahl der über Datenbanken identifizierten Einträge → beim Screening ausgeschlossen → auf Eignung bewertet → endgültig in die Synthese eingeschlossen. Beispiel: Ein Review zur Neurowissenschaft des Schmerzes begann mit 6850 Einträgen, aber nur 37 Studien erfüllten die Einschlusskriterien.

Das Flussdiagramm ist keine Dekoration. Es ist ein Prüfprotokoll: Der Leser sieht, wo und warum Studien ausgeschlossen wurden, und kann beurteilen, ob relevante Arbeiten verloren gegangen sind.

Eine separate Checkliste für Abstracts gewährleistet eine knappe, aber vollständige Darstellung der Schlüsselelemente des Reviews in strukturiertem Format – entscheidend für schnelles Screening durch den Leser.

Unterschiede zu PRISMA 2009 und erweiterte Anforderungen

PRISMA 2020 verlangt vollständige Suchabfragen für alle Datenbanken und das Datum der letzten Suche – dies war 2009 nicht vorgesehen. Dies ermöglicht es anderen Forschern, die Suche zu reproduzieren oder das Review zu aktualisieren.

- Bewertung des Risikos systematischer Fehler

- Jetzt ist es obligatorisch, die verwendeten Instrumente und Methoden für die kritische Bewertung anzugeben und die Ergebnisse für jede eingeschlossene Studie darzustellen. 2009 wurde dies oft vage beschrieben.

- Evidenzqualität (GRADE)

- Die neue Version verlangt eine explizite Angabe des Bewertungssystems (z. B. GRADE) und die Diskussion von Limitationen auf der Ebene einzelner Studien und des Reviews insgesamt.

- PRISMA-P 2015

- Ergänzt die Hauptcheckliste um eine 17-Punkte-Anleitung für Protokolle. Betont die Bedeutung der vorherigen Registrierung der Methodik in Datenbanken wie PROSPERO – dies verhindert p-hacking und selektive Berichterstattung.

Die Registrierung des Protokolls vor Beginn des Reviews ist keine Bürokratie. Es ist eine Garantie dafür, dass die Autoren die Methoden nicht nachträglich an die Ergebnisse angepasst haben.

Bewertung des Risikos systematischer Fehler: Von Instrumenten zur Interpretation

Die Zusammenführung minderwertiger Daten erzeugt keine hochwertigen Evidenzen. Das Risiko systematischer Fehler wird über mehrere Domänen bewertet: Randomisierung, Verdeckung der Zuteilung, Verblindung von Teilnehmern und Endpunktbewertern, Vollständigkeit der Daten und selektive Berichterstattung.

In einer Übersichtsarbeit zur Schmerzneuroedukation wiesen 78% der Studien ein hohes Risiko systematischer Fehler auf, da bei edukativen Interventionen eine Verblindung nicht möglich war. Die systematische Dokumentation der Bewertung für jede Studie ermöglicht es den Lesern, die Zuverlässigkeit der Schlussfolgerungen zu beurteilen.

Instrumente zur kritischen Bewertung und Risikodomänen

Das Cochrane Risk of Bias Tool (RoB 2) strukturiert die Bewertung randomisierter kontrollierter Studien über fünf Domänen: Randomisierungsprozess, Abweichungen von geplanten Interventionen, fehlende Endpunktdaten, Endpunktmessung und selektive Berichterstattung.

| Instrument | Studientyp | Schlüsseldomänen |

|---|---|---|

| RoB 2 | Randomisierte kontrollierte | Randomisierung, Verblindung, Datenvollständigkeit, selektive Berichterstattung |

| ROBINS-I | Nicht-randomisierte | Confounding-Verzerrung, Teilnehmerauswahl, Interventionsklassifikation |

Jede Domäne wird auf Basis von Signalfragen als niedriges, moderates oder hohes Risiko bewertet, wobei die Gesamtbewertung die schlechteste Domäne widerspiegelt. Für nicht-randomisierte Studien berücksichtigt ROBINS-I zusätzliche Quellen systematischer Fehler.

Interpretation der Ergebnisse unter Berücksichtigung der methodologischen Qualität

Hohe Heterogenität zwischen Studien wird häufig durch Unterschiede in der methodologischen Qualität erklärt. Sensitivitätsanalysen unter Ausschluss von Studien mit hohem Risiko zeigen, ob Effekte überschätzt wurden.

In einer Meta-Analyse zur Schmerzneuroedukation blieb der Effekt auf die Schmerzintensität nur bei Einschluss von Studien mit niedrigem Risiko systematischer Fehler bestehen – ein Hinweis auf Überschätzung des Effekts in minderwertigen Studien.

Das GRADE-System (Grading of Recommendations Assessment, Development and Evaluation) integriert die Bewertung des Risikos systematischer Fehler mit Inkonsistenz, Indirektheit, Ungenauigkeit und Publikationsbias zur Bestimmung der Gesamtvertrauenswürdigkeit der Evidenz.

- Bewertung des Risikos systematischer Fehler nach Domänen (Randomisierung, Verblindung, Datenvollständigkeit)

- Durchführung von Sensitivitätsanalysen unter Ausschluss von Studien mit hohem Risiko

- Anwendung von GRADE zur Integration der Qualität mit anderen Unsicherheitsfaktoren

- Dokumentation der Limitationen für Kliniker und Leitlinienentwickler

Praktische Anwendung und Einschränkungen: Von der Statistik zur Klinik

Statistische Signifikanz in Meta-Analysen entspricht nicht immer klinischer Relevanz. Die Zusammenführung großer Stichproben kann minimale Effekte aufdecken, die keinen praktischen Wert haben.

In einer Übersichtsarbeit zur Schmerzedukation über Neurowissenschaft war die standardisierte Mittelwertdifferenz von −0,26 für Schmerzintensität statistisch signifikant, erreichte jedoch nicht die Schwelle der minimal klinisch wichtigen Differenz von 1,5 Punkten auf einer 10-Punkte-Skala.

Die Interventionsdauer beeinflusste die Effektgröße signifikant: Programme über 30 Minuten zeigten eine klinisch relevante Schmerzreduktion, während kurze Interventionen dies nicht taten.

Dies unterstreicht die Notwendigkeit, Ergebnisse im Kontext minimal klinisch wichtiger Differenzen zu interpretieren, die für jeden Endpunkt und jede Population spezifisch sind.

Klinische Relevanz versus statistische Signifikanz

Konfidenzintervalle gepoolter Effektschätzer informieren über Präzision und klinische Interpretation. Breite Intervalle, die die Schwelle klinischer Relevanz überschneiden, weisen auf Unsicherheit bezüglich des praktischen Werts der Intervention hin.

In einer Netzwerk-Meta-Analyse zu Inositol bei polyzystischem Ovarialsyndrom zeigte Myo-Inositol ein Odds Ratio von 2,38 (95% KI 1,43–3,95) für die Wiederherstellung der Ovulation im Vergleich zu Placebo — eine sowohl statistisch als auch klinisch signifikante Verbesserung.

| Endpunkt | Intervention | Effekt | Interpretation |

|---|---|---|---|

| Wiederherstellung der Ovulation | Myo-Inositol vs. Placebo | OR 2,38 (95% KI 1,43–3,95) | Statistisch und klinisch signifikant |

| Metabolische Endpunkte | Myo- + D-Chiro-Inositol (40:1) | Überlegenheit bestätigt | Erfordert Stratifizierung nach Endpunkttypen |

Heterogenität der Effekte zwischen Subgruppen (I² > 50%) erfordert Vorsicht bei der Verallgemeinerung der Ergebnisse und kann auf die Notwendigkeit eines individualisierten Behandlungsansatzes hinweisen.

Die Rolle künstlicher Intelligenz bei der Automatisierung der Evidenzsynthese

Die Integration künstlicher Intelligenz in systematische Reviews automatisiert arbeitsintensive Schritte: Screening von Titeln und Abstracts, Datenextraktion und Bewertung des Bias-Risikos. Maschinelles Lernen kann die Screening-Zeit um 30–70% reduzieren bei gleichzeitiger Sensitivität über 95%.

Automatisierung erfordert Validierung: Algorithmen lernen aus vorhandenen Daten und können systematische Fehler der Trainingsdatensätze reproduzieren oder Studien mit unkonventioneller Terminologie übersehen.

In einer diagnostischen Meta-Analyse zur KI-gestützten Identifikation von Nebenschilddrüsen betrug die gepoolte Sensitivität 93,8%, aber die Heterogenität zwischen Studien (I² = 89%) wies auf Variabilität der Algorithmen und die Notwendigkeit von Standardisierung hin.

- Living Systematic Reviews, die kontinuierlich durch KI-Monitoring neuer Publikationen aktualisiert werden, stellen die Zukunft der Evidenzsynthese in sich schnell entwickelnden Bereichen dar.

- Transparente Berichterstattung über die Rolle der Automatisierung in jedem Prozessschritt ist erforderlich.

- Kritisch für schnelle Evidenzsynthese in Pandemie- und anderen Krisensituationen.

Knowledge Access Protocol

FAQ

Häufig gestellte Fragen

Ein systematischer Review ist eine Studie, die strenge, vordefinierte Methoden zur Suche, Auswahl und Analyse aller relevanten Studien zu einer bestimmten Fragestellung verwendet. Im Gegensatz zu narrativen Übersichten folgt er klaren Protokollen (z. B. PRISMA), minimiert Subjektivität und gewährleistet die Reproduzierbarkeit der Ergebnisse. Dies macht systematische Reviews zur höchsten Evidenzstufe in der Medizin.

Eine Meta-Analyse ist eine statistische Methode zur Zusammenführung quantitativer Daten aus mehreren unabhängigen Studien, um eine einheitliche Effektschätzung zu erhalten. Sie erhöht die statistische Power und hilft, Widersprüche zwischen einzelnen Studien aufzulösen. Sie wird in der klinischen Medizin, Epidemiologie und den Neurowissenschaften eingesetzt, um präzisere Schlussfolgerungen zu ziehen.

PRISMA 2020 ist der aktualisierte Berichtsstandard für systematische Reviews, der eine 27-Punkte-Checkliste, eine Checkliste für Abstracts und Flussdiagramme umfasst. Er ersetzte die Version von 2009 und gewährleistet Transparenz, Vollständigkeit und Reproduzierbarkeit von Publikationen. Die Einhaltung von PRISMA erhöht die Qualität und das Vertrauen in die Ergebnisse von Reviews.

Nein, systematische Reviews können trotz strenger Methodik systematische Fehler enthalten. Publikationsbias, niedrige Qualität der eingeschlossenen Studien und unvollständige Literatursuche können die Schlussfolgerungen verzerren. Daher sind eine kritische Bewertung des Fehlerrisikos und Sensitivitätsanalysen für eine korrekte Interpretation unerlässlich.

Hohe Heterogenität zwischen Studien erfordert vorsichtige Interpretation. Moderator- und Subgruppenanalysen helfen, Quellen der Unterschiede zu identifizieren (z. B. Dosierung, Dauer, Populationsmerkmale). Wenn die Heterogenität nicht erklärbar ist, kann die Zusammenführung der Daten inkorrekt sein, und man sollte sich auf eine qualitative Synthese beschränken.

Die prospektive Registrierung des Protokolls (z. B. in PROSPERO) verhindert selektive Publikation von Ergebnissen und nachträgliche Änderungen der Methodik. Dies erhöht die Transparenz und reduziert das Risiko von Datenmanipulation. PRISMA-P 2015 betont die Notwendigkeit der Protokollentwicklung vor Beginn des Reviews zur Gewährleistung wissenschaftlicher Strenge.

Es muss systematisch in mehreren Datenbanken (MEDLINE, Embase, CENTRAL) von deren Beginn bis zu einem bestimmten Datum gesucht werden. Suchanfragen müssen transparent dokumentiert werden, einschließlich Schlüsselwörtern und Filtern. Zusätzlich werden Literaturverzeichnisse gefundener Artikel und graue Literatur überprüft, um eine vollständige Abdeckung zu gewährleisten.

Eine Netzwerk-Meta-Analyse ermöglicht den gleichzeitigen Vergleich mehrerer Interventionen, auch wenn keine direkten Vergleiche zwischen ihnen vorliegen. Sie nutzt indirekte Vergleiche über einen gemeinsamen Komparator und ermöglicht die Rangordnung von Behandlungsmethoden. Sie wird zur Optimierung der Therapiewahl bei mehreren verfügbaren Optionen eingesetzt.

Es werden standardisierte Instrumente zur kritischen Bewertung verwendet, um methodische Einschränkungen zu identifizieren (Randomisierung, Verblindung, Datenvollständigkeit). Die Bewertung des Fehlerrisikos informiert die Interpretation der Ergebnisse und hilft, die Zuverlässigkeit der Schlussfolgerungen zu bestimmen. Studien mit hohem Risiko können in Sensitivitätsanalysen ausgeschlossen werden.

Das Fixed-Effect-Modell nimmt einen einzigen wahren Effekt in allen Studien an, während das Random-Effects-Modell Variabilität der Effekte zwischen Studien zulässt. Bei Vorliegen von Heterogenität ist das Random-Effects-Modell konservativer und liefert breitere Konfidenzintervalle. Die Modellwahl hängt von statistischen Tests auf Heterogenität ab.

Nein, eine Meta-Analyse ist nicht immer einer großen RCT gleichwertig. Sie kombiniert Daten mit unterschiedlichen Protokollen, Populationen und Qualität, was systematische Verzerrungen einführen kann. Eine gut geplante große Studie ist oft vorzuziehen, insbesondere bei hoher Heterogenität oder niedriger Qualität der verfügbaren Daten.

Nein, statistische Signifikanz garantiert keine klinische Relevanz. Eine große Stichprobengröße in einer Meta-Analyse kann minimale Effekte aufdecken, die keine praktische Bedeutung haben. Es ist notwendig, die Effektgröße, Konfidenzintervalle und den klinischen Kontext zu bewerten, um den tatsächlichen Nutzen zu bestimmen.

KI automatisiert arbeitsintensive Schritte: Screening von Titeln, Datenextraktion, Bewertung des Verzerrungsrisikos. Dies beschleunigt den Prozess und reduziert menschliche Fehler, erfordert jedoch Validierung. Beispiele umfassen KI-gestützte Identifikation von Nebenschilddrüsen und automatische Analyse diagnostischer Genauigkeit.

Eine Moderatoranalyse untersucht, wie die Effektgröße von Studienmerkmalen abhängt (Dosierung, Dauer, Population). Beispielsweise kann der Effekt von Schmerzneurowissenschaftsschulung je nach Interventionsdauer variieren. Dies hilft, klinische Empfehlungen zu optimieren und Quellen der Heterogenität zu verstehen.

Technisch möglich, erfordert aber Vorsicht aufgrund von Unterschieden im Verzerrungsrisiko zwischen Designs (RCT vs. Beobachtungsstudien). Üblicherweise ist es vorzuziehen, Studien desselben Typs zu kombinieren und unterschiedliche Designs separat oder in Subgruppen zu analysieren. Eine Vermischung kann die Heterogenität erhöhen und die Interpretation erschweren.

Publikationsbias (bevorzugte Publikation positiver Ergebnisse) kann Effektschätzungen überhöhen. Verwendet werden Funnel-Plots, Egger-Tests und Korrekturmethoden (Trim-and-Fill). Bei erheblichem Bias sollten Schlussfolgerungen vorsichtig formuliert werden, mit Hinweis auf mögliche Überschätzung des Effekts.