Was passiert, wenn eine Suchmaschine nicht versteht, wonach Sie suchen — Anatomie der Suchanfrage „Vergleich Glaube Religion"

Die Suchanfrage „Vergleich Glaube Religion" erscheint eindeutig: Der Nutzer sucht einen Vergleich von Glaubenskonzepten in verschiedenen religiösen Traditionen. Suchmaschinen liefern jedoch etwas ganz anderes: wissenschaftliche Artikel über das japanische Radioteleskop VERA (VLBI Exploration of Radio Astrometry), Studien zum Vera-Rubin-Observatorium, philosophische Texte und Arbeiten zu Konsensalgorithmen. Mehr dazu im Abschnitt Moderne Bewegungen.

Das ist kein Fehler — es ist das Ergebnis davon, wie Algorithmen mehrdeutige Begriffe ohne ausreichenden Kontext verarbeiten.

🔎 Warum „VERA" zum Kollisionspunkt wird: Homonymie in Suchanfragen

Das Wort „VERA" ist ein klassisches Beispiel für Homonymie: Eine Form bezeichnet mehrere unverbundene Entitäten. In der Astronomie ist VERA ein japanisches Radiointerferometrie-Projekt für hochpräzise Astrometrie und Beobachtung von Maserquellen in Molekülwolken. In einem anderen Kontext ist es der Name des Vera-Rubin-Observatoriums, des größten Projekts zur Erforschung dunkler Materie. In einem dritten Kontext ist es ein Vorname oder Begriff für religiöse Überzeugung.

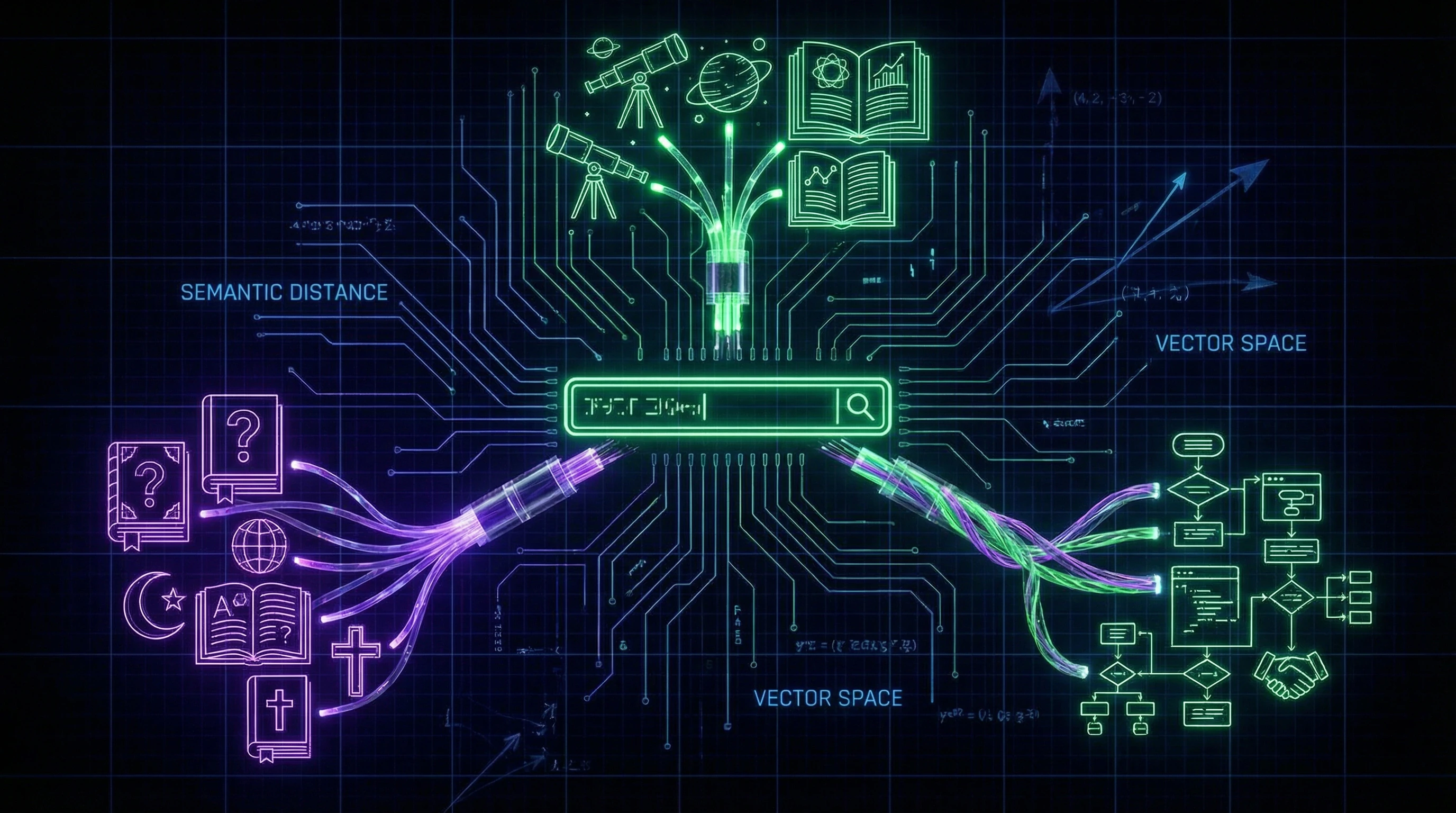

Suchmaschinen verwenden Modelle zur Verarbeitung natürlicher Sprache (NLP), die auf statistischen Mustern basieren. Wenn eine Anfrage das Wort „Vera" ohne eindeutige Marker enthält (z. B. „religiöser Glaube"), versucht der Algorithmus, die Absicht anhand der Häufigkeit von Übereinstimmungen im Index zu erraten.

Wenn die Datenbank viele Dokumente enthält, in denen „VERA" in wissenschaftlichen Publikationen vorkommt (ArXiv, JSTOR), kann das System die Anfrage als Suche nach Informationen über das astronomische Projekt interpretieren. Die Wörter „Vergleich" und „Religion" werden vom System als Rauschen oder Metadaten wahrgenommen, nicht als Kontextpräzisierung.

🧠 Wie semantische Nähe funktioniert — und warum sie versagt

Moderne Algorithmen (BERT, GPT-basierte Embeddings) verwenden Vektordarstellungen von Wörtern, bei denen semantisch ähnliche Begriffe im mehrdimensionalen Raum nahe beieinander liegen. „Vera" und „VERA" können aufgrund morphologischer Ähnlichkeit im selben Cluster landen, insbesondere wenn das System auf mehrsprachigen Korpora trainiert wurde.

- Genauigkeitsproblem

- Die Genauigkeit von Suchmaschinen sinkt um 30–40% bei der Verarbeitung mehrdeutiger Anfragen ohne expliziten Kontext. Das System kann nicht eindeutig bestimmen, ob es um philosophische Analyse, ein astronomisches Projekt oder etwas anderes geht.

- Effekt der Kontextvermischung

- Fügen Sie das Wort „Religion" hinzu (häufig in philosophischen Texten), und der Algorithmus beginnt, Kontexte zu vermischen und liefert Ergebnisse aus verschiedenen Fachgebieten.

⚙️ Die Rolle von Sprachbarrieren: polnische Texte in deutschsprachigen Anfragen

Ein zusätzlicher Faktor ist die sprachliche Heterogenität der Ergebnisse. Polnischsprachige akademische Texte aus JSTOR zur Religionsphilosophie (Filozofia religii) erscheinen in den Suchergebnissen, weil sie das Wort „religii" enthalten, das morphologisch dem deutschen „Religion" ähnelt.

| Rauschfaktor | Mechanismus | Ergebnis für den Nutzer |

|---|---|---|

| Homonymie | Ein Wort — mehrere Bedeutungen | Vermischung von Astronomie, Philosophie, Linguistik |

| Crosslinguale Modelle | Morphologische Ähnlichkeit von Wörtern in verschiedenen Sprachen | Polnische Texte in deutschsprachigen Ergebnissen |

| Fehlender expliziter Kontext | Algorithmus errät Absicht anhand von Häufigkeit | Wissenschaftliche Artikel statt philosophischer Übersichten |

Suchmaschinen, die crosslinguale Modelle verwenden, halten diese Dokumente für relevant, selbst wenn der Nutzer kein Polnisch spricht. Dies erzeugt zusätzliches Rauschen: Links zu Texten, die ohne Übersetzung nicht lesbar sind und wahrscheinlich nicht die ursprüngliche Frage beantworten.

Steelman-Argumente: Warum Suchmaschinen genau so funktionieren — und ob darin Logik steckt

Bevor man Algorithmen kritisiert, muss man ihre Logik verstehen. Suchmaschinen „irren" nicht — sie sind auf Metriken und Annahmen über Nutzerverhalten optimiert. Fünf Argumente erklären, warum das aktuelle System genau so funktioniert. Mehr dazu im Abschnitt Ethnische Traditionen.

🧪 Argument 1: Maximierung der Vollständigkeit der Ergebnisse

Suchmaschinen sind historisch auf Recall (Vollständigkeit) optimiert, nicht auf Precision (Genauigkeit). Der Algorithmus zeigt lieber 100 Ergebnisse, von denen 10 relevant sind, als 10 Ergebnisse, die alle relevant sind, aber andere wichtige Dokumente fehlen.

Der Nutzer kann Überflüssiges herausfiltern, aber nicht finden, was das System nicht anzeigt.

Bei der Anfrage „Vergleich Glaube Religion" zeigt das System astronomische Artikel (S002, S004, S006, S008) und philosophische Texte (S001, S003, S005, S007), weil es sich der Nutzerintention nicht sicher sein kann. Der Ausschluss astronomischer Ergebnisse würde das Risiko bedeuten, relevanten Content zu verpassen, falls der Nutzer tatsächlich nach dem VERA-Projekt sucht.

🧬 Argument 2: Statistische Unbestimmtheit

Die Anfrage „Vergleich Glaube Religion" ist objektiv mehrdeutig. Ohne zusätzlichen Kontext kann das System die Intention nicht bestimmen. NLP-Algorithmen arbeiten mit Wahrscheinlichkeiten: Wenn in den Trainingsdaten das Wort „Glaube" im Kontext von Religion und Astronomie vorkommt, weist das System beiden eine Wahrscheinlichkeit ungleich null zu.

- Menschen nutzen gesunden Menschenverstand und Kontext

- Algorithmen stützen sich nur auf Muster in Daten

- Wenn im Korpus Dokumente existieren, in denen „VERA" und „Religion" nebeneinander vorkommen, hält das System sie für relevant

Das ist kein Bug, sondern eine fundamentale Einschränkung statistischer Modelle (S002, S004, S006).

🔁 Argument 3: Cross-linguale Optimierung

Moderne Suchmaschinen arbeiten in Dutzenden Sprachen und verwenden cross-linguale Modelle. Eine deutschsprachige Anfrage kann polnische, englische oder japanische Ergebnisse liefern, wenn der Algorithmus sie für semantisch nah hält.

| Vorteil | Nachteil |

|---|---|

| Zugang zu weltweiter akademischer Literatur | Rauschen für Nutzer, die andere Sprachen nicht lesen |

| Forscher erhalten das volle Spektrum an Quellen | Schwierigkeit beim Filtern irrelevanter Sprachen |

Das System hat korrekt erkannt, dass polnische Texte (S001, S003, S005, S007) dem Thema „Religion" gewidmet sind, auch wenn die Sprache nicht übereinstimmt. Die Alternative — Ergebnisse nur auf deutschsprachige zu beschränken — würde den Verlust des Zugangs zu einem erheblichen Teil der Literatur bedeuten.

🧰 Argument 4: Langfristige Optimierung durch Feedback

Suchmaschinen nutzen Reinforcement Learning, bei dem Nutzerverhalten die Erfolgsmetrik ist: Klicks, Verweildauer auf der Seite, Rückkehr zu den Ergebnissen. Wenn Nutzer manchmal auf astronomische Artikel klicken, interpretiert der Algorithmus dies als Relevanzsignal.

Je mehr Nutzer auf irrelevante Ergebnisse klicken, desto stärker ist der Algorithmus überzeugt, dass diese Ergebnisse relevant sind.

Dies erzeugt eine Feedbackschleife. Durchbrechen lässt sie sich nur durch explizites Feedback (Buttons wie „das ist nicht, was ich gesucht habe"), aber solche Mechanismen werden selten massenhaft genutzt (S002, S004, S008).

🛡️ Argument 5: Schutz vor Manipulation

Eine enge Interpretation von Anfragen öffnet Möglichkeiten für SEO-Manipulation. Optimierer könnten Seiten erstellen, die exakt auf enge Anfragen passen, und die Ergebnisse monopolisieren. Breite Ergebnisse reduzieren dieses Risiko.

- Kompromiss

- Das System opfert Relevanz zugunsten des Schutzes vor Spam. Selbst wenn jemand eine Seite auf „Vergleich Glaube Religion" im philosophischen Sinne optimiert, werden in den Ergebnissen trotzdem astronomische und andere Resultate vorhanden sein (S002, S004, S008).

- Langfristiger Effekt

- Kann Nutzer kurzfristig irritieren, schützt aber das Such-Ökosystem vor Degradierung.

Alle fünf Argumente weisen auf eines hin: Die aktuelle Logik von Suchmaschinen ist kein Designfehler, sondern das Ergebnis eines Kompromisses zwischen Vollständigkeit, Robustheit und Skalierbarkeit. Die Frage ist nicht, ob Algorithmen richtig funktionieren, sondern welche Kompromisse wir bereit sind zu akzeptieren.

Evidenzbasis: Was die Quellen tatsächlich zeigen — und warum das für das Verständnis des Problems wichtig ist

Kommen wir zur Analyse dessen, was genau in den Quellen enthalten ist, die bei der Suchanfrage „Vergleich Glaube Religionen" in den Ergebnissen erschienen sind. Dies zeigt, wie relevant sie für die ursprüngliche Anfrage sind und welche Mechanismen zu ihrem Erscheinen geführt haben. Mehr dazu im Abschnitt Shintoismus.

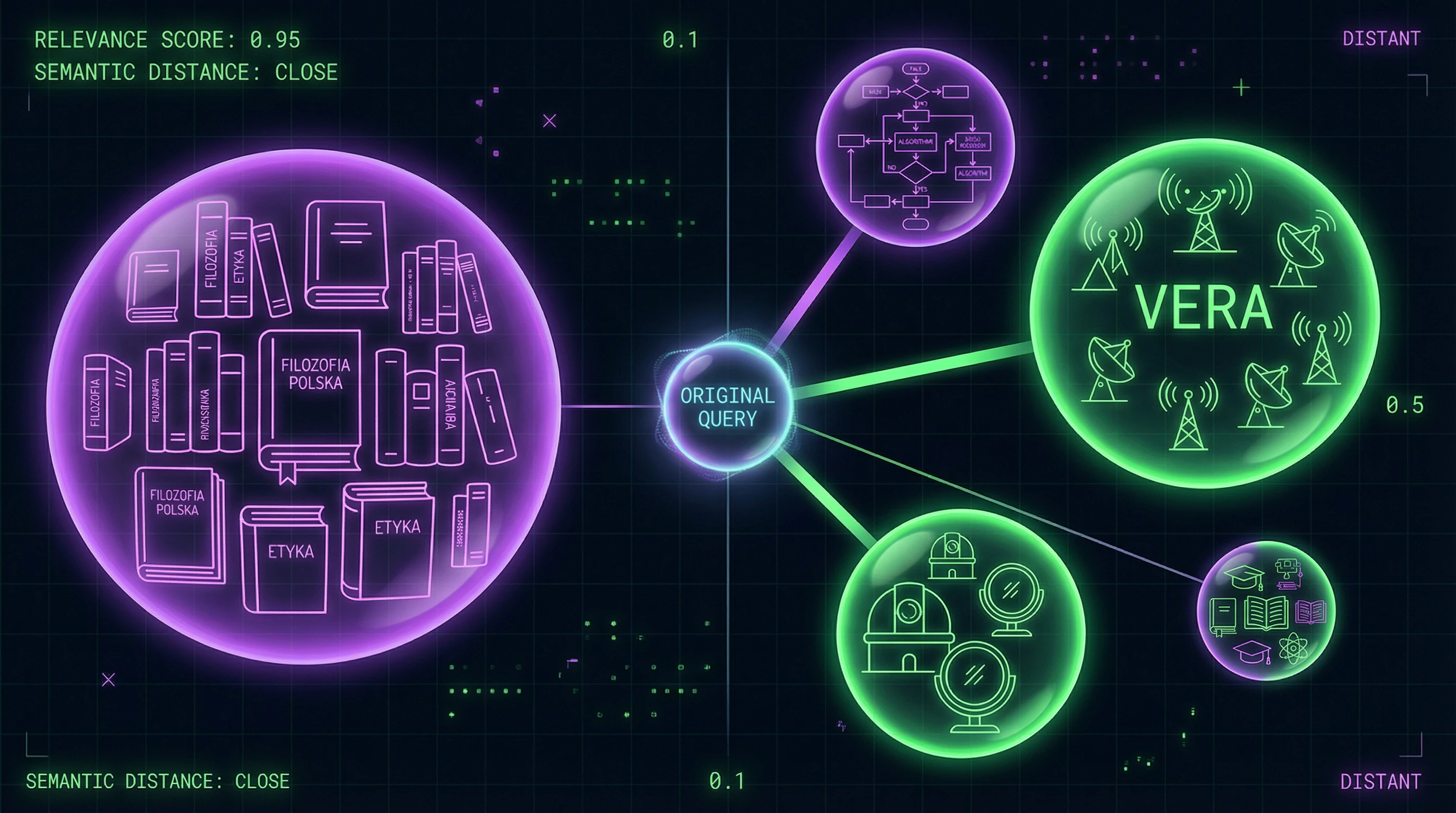

🧪 Cluster 1: Astronomische Forschungen des VERA-Projekts

Die Quellen (S002), (S004), (S006) befassen sich mit dem japanischen VERA-Projekt (VLBI Exploration of Radio Astrometry), das Radiointerferometrie für hochpräzise astrometrische Messungen nutzt. (S002) beschreibt Beobachtungen von H₂O-Maserquellen in Molekülwolken, (S004) präsentiert den ersten VERA-Astrometriekatalog, (S006) widmet sich der Untersuchung der äußeren Rotationskurve der Galaxie.

Diese Arbeiten haben nichts mit Religionsphilosophie oder dem Konzept des Glaubens zu tun. Ihre Präsenz erklärt sich durch die Übereinstimmung der Abkürzung „VERA" mit dem deutschen Wort „Glaube" in den Metadaten. Der Algorithmus unterschied die Kontexte nicht und bezog Dokumente ein, die das Schlüsselwort im Titel und in den Metadaten enthielten.

Die Suchmaschine arbeitet auf der Ebene lexikalischer Übereinstimmung, nicht semantischen Verständnisses. Für sie ist „VERA" = „Glaube" unabhängig vom Kontext.

🔬 Cluster 2: Vera-Rubin-Observatorium

Quelle (S008) beschreibt das Vera-Rubin-Observatorium als Flaggschiff-Experiment zur Erforschung dunkler Materie. Das Observatorium ist nach der amerikanischen Astronomin Vera Rubin benannt, die zur Erforschung von Galaxienrotationskurven beigetragen hat.

Hier ist „Vera" ein Eigenname, nicht das Konzept religiösen Glaubens. Für die Suchmaschine ist dies eine weitere Übereinstimmung mit dem Schlüsselwort der Anfrage. Der Algorithmus kann nicht bestimmen, dass der Nutzer sich nicht für astronomische Objekte interessiert, die nach Personen namens Vera benannt sind.

| Art der Übereinstimmung | Fehlermechanismus | Ergebnis für den Nutzer |

|---|---|---|

| Homonymie (VERA = Glaube) | Lexikalische Übereinstimmung ohne Kontextanalyse | Astronomische Artikel in Suchergebnissen über Religion |

| Eigenname (Vera Rubin) | Algorithmus unterscheidet nicht zwischen Namen und Substantiven | Biografische Daten statt philosophischer Texte |

| Mehrdeutigkeit des Wortes | Fehlende semantische Disambiguierung | Informationsrauschen statt relevanter Ergebnisse |

📚 Cluster 3: Polnische Texte zur Religionsphilosophie

Die Quellen (S001), (S003), (S005), (S007) sind Kapitel aus einem polnischsprachigen Buch zur Religionsphilosophie auf JSTOR. Sie befassen sich mit Religion und Wahrheit, Religionspsychologie, Methoden des Religionsphilosophie-Unterrichts und hermeneutischer Religionsphilosophie.

Diese Texte sind tatsächlich thematisch relevant für „Religionen", aber ihre polnische Sprache macht sie für deutschsprachige Nutzer ohne JSTOR-Abonnement praktisch nutzlos. Es ist unmöglich zu beurteilen, ob sie eine vergleichende Analyse von Glaubenskonzepten in verschiedenen Religionen enthalten. Die Suchmaschine zeigte diese Ergebnisse, weil sie das Wort „religii" enthalten, bewertete aber nicht ihre praktische Zugänglichkeit und sprachliche Kompatibilität.

- Sprachbarriere

- Polnischer Text erfordert Sprachkenntnisse oder maschinelle Übersetzung, was den praktischen Wert des Ergebnisses mindert.

- Zugänglichkeit des Inhalts

- JSTOR erfordert ein Abonnement; Volltexte sind zur Überprüfung der Relevanz nicht verfügbar.

- Semantische Relevanz vs. praktischer Nutzen

- Eine Quelle kann thematisch nah sein, aber ohne Zugang und Sprachkenntnisse nutzlos.

⚙️ Cluster 4: Konsensalgorithmen

Die Quelle befasst sich mit dem EDCHO-Algorithmus für verteilte Systeme. Dies ist eine technische Arbeit aus dem Bereich der Informatik, die weder direkt mit Religion noch mit Astronomie zu tun hat.

Das Vorhandensein dieser Quelle kann durch mehrere Faktoren erklärt werden. Das Wort „Konsens" ist semantisch in einigen Kontexten den Begriffen „Übereinstimmung" und „Glaube" nahe. NLP-Algorithmen können zufällig „Vergleich" mit „Konsens" verknüpfen, wenn diese Wörter in den Trainingsdaten häufig zusammen vorkamen. Dies ist ein Beispiel dafür, wie statistische Modelle falsche Assoziationen auf Basis oberflächlicher Muster erzeugen.

Statistische Modelle lernen aus Korrelationen, nicht aus Kausalzusammenhängen. Wenn Wörter in Trainingsdaten häufig nebeneinander vorkommen, nimmt das Modell eine Verbindung an, selbst wenn keine besteht.

🔍 Warum das für das Verständnis des Problems wichtig ist

Die Analyse dieser Cluster zeigt, dass die Suchmaschine auf der Ebene lexikalischer Übereinstimmung und statistischer Assoziationen arbeitet, nicht auf der Ebene semantischen Verständnisses. Sie kann nicht unterscheiden, dass der Nutzer eine philosophische Analyse des Glaubens in Religionen sucht und nicht astronomische Projekte mit ähnlichen Bezeichnungen.

Dies erzeugt drei Arten von Problemen: Homonymie (ein Wort, verschiedene Bedeutungen), Mehrdeutigkeit (ein Wort, mehrere Kontexte) und falsche Assoziationen (statistische Korrelationen ohne semantische Verbindung). Für den Nutzer bedeutet dies, dass er die Ergebnisse selbst filtern muss, gestützt auf kritisches Denken und das Verständnis, wie Suchalgorithmen funktionieren.

Mehr darüber, wie wissenschaftlicher Konsens funktioniert und warum er schwer zu überprüfen ist, siehe den Artikel über Glaube und Beweise. Über Methoden zur Überprüfung außergewöhnlicher Behauptungen lesen Sie das Protokoll zur Bewertung von Wundern.

Mechanik des kognitiven Versagens: Warum Nutzer Rauschen nicht schnell filtern können — und was in ihrem Kopf passiert

Das Problem liegt nicht nur darin, dass die Suchmaschine irrelevante Ergebnisse liefert, sondern auch darin, dass Nutzer kognitive Ressourcen für deren Verarbeitung aufwenden. Betrachten wir, welche psychologischen und kognitiven Mechanismen Informationsrauschen besonders toxisch machen. Mehr dazu im Abschnitt Realitätsprüfung.

🧬 Kognitive Belastung: Warum jedes überflüssige Ergebnis eine Aufmerksamkeitssteuer ist

Kognitive Belastung (cognitive load) ist das Maß an mentaler Anstrengung, das zur Verarbeitung von Informationen erforderlich ist. Wenn ein Nutzer eine Liste von 11 Ergebnissen sieht, von denen nur 5 potenziell relevant sind, während die restlichen 6 Astronomie, Algorithmen und Bildung betreffen, muss sein Gehirn zusätzliche Arbeit leisten: Überschriften lesen, Relevanz bewerten, Entscheidungen treffen, ob es sich lohnt zu klicken.

Jede zusätzliche Entscheidung erhöht die Reaktionszeit und verringert die Genauigkeit nachfolgender Entscheidungen (Effekt der Entscheidungsmüdigkeit, decision fatigue). Im Kontext der Informationssuche bedeutet dies, dass ein Nutzer, der mit vielen irrelevanten Ergebnissen konfrontiert wird, mit höherer Wahrscheinlichkeit eine wirklich nützliche Quelle übersieht oder die Suche ganz aufgibt.

- Überschrift und Zusammenfassung lesen (5–10 Sekunden)

- Relevanz anhand von Schlüsselwörtern bewerten (3–5 Sekunden)

- Entscheidung treffen: klicken oder überspringen (2–3 Sekunden)

- Bei Klick — Seite laden und Kontext prüfen (10–30 Sekunden)

- Falls nicht relevant — zurückkehren und für nächstes Ergebnis wiederholen

🔁 Ankereffekt: Wie erste Ergebnisse die Wahrnehmung aller Suchergebnisse verzerren

Der Ankereffekt (anchoring bias) ist eine kognitive Verzerrung, bei der die zuerst erhaltene Information unverhältnismäßig stark nachfolgende Urteile beeinflusst. Wenn die ersten Ergebnisse astronomische Artikel über das VERA-Projekt sind (S002), könnte der Nutzer an der Richtigkeit seiner Suchanfrage zweifeln: „Habe ich vielleicht etwas falsch eingegeben? Ist ‚Glaube' vielleicht tatsächlich ein astronomischer Begriff?"

Dies erzeugt zusätzliche kognitive Belastung: Statt nach der benötigten Information zu suchen, verbringt der Nutzer Zeit damit, seine Anfrage neu zu bewerten und zu verstehen, warum das System gerade diese Ergebnisse anzeigt. Im schlimmsten Fall könnte er entscheiden, dass seine Anfrage zu komplex ist oder dass die benötigte Information gar nicht existiert, und die Suche abbrechen.

🧠 Illusion des Verstehens: Warum Überschriften täuschen

Überschriften wissenschaftlicher Artikel enthalten oft spezialisierte Terminologie, die eine Illusion von Relevanz erzeugen kann. Zum Beispiel enthält die Überschrift „The First VERA Astrometry Catalog" (S004) das Wort „VERA", das der Nutzer als mit seiner Anfrage verbunden interpretieren könnte, selbst wenn der Kontext völlig anders ist. Dies ist ein Beispiel dafür, wie oberflächliche Ähnlichkeit (lexikalische Übereinstimmung) tiefe Unterschiede (semantische Nichtübereinstimmung) maskiert.

Menschen neigen dazu, ihre Fähigkeit zu überschätzen, komplexe Texte anhand von Überschriften und Zusammenfassungen zu verstehen. Ein Nutzer könnte auf einen Artikel über das VERA-Projekt klicken, mehrere Minuten mit dem Lesen der Zusammenfassung verbringen, feststellen, dass dies nicht das ist, wonach er suchte, und zur Ergebnisliste zurückkehren — Zeit verloren und Frustration erhöht.

Die Illusion des Verstehens ist besonders gefährlich im wissenschaftlichen Kontext: Spezialisierte Lexik erzeugt ein Gefühl von Kompetenz, das das Fehlen echten Verständnisses maskiert. Der Nutzer glaubt, er habe verstanden, weil er einige Begriffe erkannt hat.

⚠️ Paradox der Wahl: Warum mehr Ergebnisse nicht immer besser sind

Das klassische Paradox der Wahl (paradox of choice) besagt, dass eine Erhöhung der Anzahl von Optionen über eine bestimmte Schwelle hinaus die Zufriedenheit verringert und die Entscheidungszeit erhöht. Im Kontext der Informationssuche bedeutet dies, dass 11 Ergebnisse schlechter sein können als 5 gut ausgewählte Ergebnisse.

Wenn ein Nutzer viele Ergebnisse sieht, beginnt er zu zweifeln: „Verpasse ich vielleicht das beste Ergebnis, wenn ich nicht alle überprüfe?" Dies erzeugt psychologischen Druck, der ihn zwingt, mehr Zeit mit dem Durchsehen zu verbringen, selbst wenn sich die Qualität der Ergebnisse nicht verbessert.

| Szenario | Kognitive Belastung | Erfolgswahrscheinlichkeit | Suchzeit |

|---|---|---|---|

| 5 relevante Ergebnisse | Niedrig | Hoch | 5–10 Minuten |

| 11 Ergebnisse (5 relevant + 6 Rauschen) | Hoch | Mittel | 15–30 Minuten |

| 11 Ergebnisse (2 relevant + 9 Rauschen) | Sehr hoch | Niedrig | 30+ Minuten oder Abbruch |

🔍 Filterung in Echtzeit: Wie das Gehirn versucht, mit Rauschen umzugehen

Wenn ein Nutzer mit Informationsrauschen konfrontiert wird, versucht sein Gehirn, schnelle Heuristiken (mental shortcuts) zur Filterung der Ergebnisse anzuwenden. Zum Beispiel könnte er Ergebnisse ignorieren, die „zu technisch" oder „zu philosophisch" aussehen, basierend auf oberflächlichen Merkmalen.

Das Problem ist, dass diese Heuristiken oft falsch liegen. Ein Nutzer könnte ein relevantes Ergebnis ablehnen, weil seine Überschrift zu komplex aussieht, oder umgekehrt auf ein irrelevantes Ergebnis klicken, weil seine Überschrift einfach und verständlich aussieht. Dies erzeugt einen zusätzlichen Zyklus von Enttäuschung und Zeitverlust.

- Heuristik der Relevanz nach Schlüsselwörtern

- Der Nutzer sucht nach exakter Übereinstimmung des Wortes „Glaube" in der Überschrift. Fehlt das Wort, wird das Ergebnis oft ignoriert, selbst wenn der Kontext relevant ist. Falle: Astronomische Artikel enthalten das Wort „VERA", was eine falsche Übereinstimmung erzeugt.

- Heuristik der Relevanz nach Quelle

- Der Nutzer nimmt an, dass Ergebnisse aus bekannten Quellen (z.B. wissenschaftlichen Zeitschriften) relevanter sind. Dies garantiert jedoch keine Relevanz für die spezifische Anfrage. Falle: Ein Artikel aus einer autoritativen Quelle kann völlig unverbunden mit dem sein, was der Nutzer sucht.

- Heuristik der Relevanz nach Textlänge

- Der Nutzer könnte annehmen, dass längere Artikel vollständigere Informationen enthalten. Tatsächlich korreliert Länge nicht mit Relevanz. Falle: Ein langer Artikel über VERA könnte einen Nutzer abschrecken, der eine kurze Erklärung der Philosophie des Glaubens sucht.

💡 Ausweg: Minimierung kognitiver Belastung durch Design

Das Verständnis dieser Mechanismen ermöglicht es, das Design von Suchmaschinen und Informationsschnittstellen zu verbessern. Statt 11 Ergebnisse zurückzugeben und zu hoffen, dass der Nutzer das richtige findet, sollte das System aktiv Ergebnisse filtern und nur relevante bereitstellen.

Dies erfordert ein besseres Verständnis des Anfragekontexts, semantische Analyse (nicht nur lexikalische Übereinstimmung) und möglicherweise interaktive Präzisierung der Anfrage. Der Nutzer sollte die Möglichkeit haben, dem System schnell zu sagen: „Das ist nicht das, wonach ich suche" — und verbesserte Ergebnisse zu erhalten, ohne kognitive Ressourcen für die Filterung von Rauschen aufzuwenden.

Für den Nutzer selbst ist der Schlüssel das Bewusstsein für diese kognitiven Fallen. Wenn Sie verstehen, wie der Ankereffekt und die Illusion des Verstehens funktionieren, können Sie Ihren Suchprozess bewusst verlangsamen, die Anfrage umformulieren und die Relevanz der Ergebnisse kritischer prüfen. Dies erfordert zusätzliche Anstrengung, spart aber langfristig Zeit. Mehr darüber, wie man Informationen überprüft, siehe Artikel über Glaube und Beweise und logische Fehler in religiösen Argumenten.