Anatomie eines Versprechens: Was genau unter dem Aushängeschild „systematische Übersichtsarbeit" verkauft wird und warum es funktioniert

Der Begriff „systematische Übersichtsarbeit" hat in der modernen Wissenschaft den Status eines Goldstandards der Evidenz erlangt — und ist genau deshalb zum Objekt massenhafter Ausbeutung geworden. Publikationen mit dieser Wortverbindung im Titel erhalten mehr Zitierungen als gewöhnliche Literaturübersichten, unabhängig von der tatsächlichen Qualität der Methodologie (S009).

Dies schafft einen starken Anreiz für Autoren, jede Quellensammlung als „systematisch" zu kennzeichnen, selbst wenn der Auswahlprozess willkürlich war. Die Form beginnt anstelle des Inhalts zu wirken. Mehr dazu im Abschnitt Ethnische und indigene Identität.

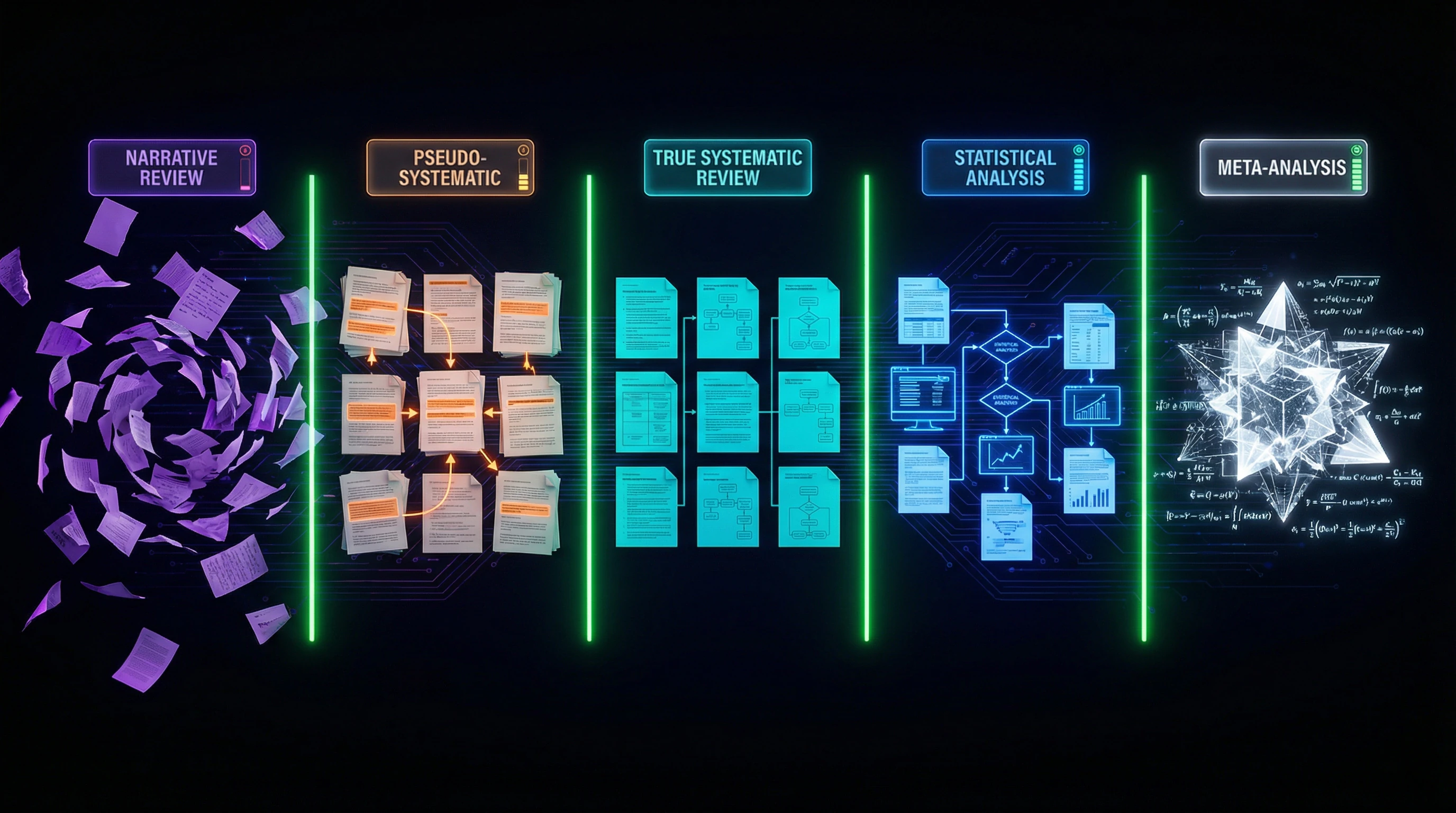

🧩 Drei Ebenen der Begriffsvertauschung

- Terminologische Unkenntnis

- Viele Forscher verstehen aufrichtig nicht den Unterschied zwischen narrativer Übersicht, systematischer Übersichtsarbeit und Meta-Analyse. Sie verwenden den Begriff „systematisch" und meinen lediglich „organisiert" oder „strukturiert", ohne sich der streng definierten methodologischen Bedeutung dieses Wortes bewusst zu sein (S010).

- Methodologischer Opportunismus

- Autoren kennen die Anforderungen an systematische Übersichtsarbeiten, vereinfachen aber bewusst die Verfahren in der Hoffnung, dass Gutachter das Fehlen eines Suchprotokolls oder der Bewertung systematischer Fehlerrisiken nicht bemerken.

- Offene Fälschung

- Erzeugung des Anscheins von Systematik durch formale Erwähnung von Datenbanken und Auswahlkriterien bei faktischem Cherry-Picking von Ergebnissen, die eine vorab gewählte Hypothese bestätigen (S011).

🔍 Kognitive Fallen des Vertrauens in „Wissenschaftlichkeit"

Das Vorhandensein einer strukturierten Literaturliste, von Tabellen mit Auswahlkriterien und formalisierter Sprache erzeugt die Illusion methodologischer Strenge selbst bei deren völligem Fehlen (S009). Der Leser sieht vertraute Attribute „echter Wissenschaft" — PRISMA-Diagramme, Tabellen mit Studiencharakteristika, Bewertungen der Evidenzqualität — und weist dem Text automatisch einen hohen Glaubwürdigkeitsstatus zu.

Visuelle Komplexität maskiert methodologische Leere. Dies ist der Effekt der „wissenschaftlichen Tarnung": Die Form ersetzt den Inhalt.

Das Gehirn spart Ressourcen, indem es sich auf oberflächliche Autoritätsmarker stützt statt auf tiefgehende Analyse der Argumentationslogik. Besonders effektiv funktioniert dies in Bereichen, in denen der Leser kein Experte ist.

⚙️ Ökonomie der Pseudosystematik

| Parameter | Echte systematische Übersichtsarbeit | Pseudosystematische Übersichtsarbeit |

|---|---|---|

| Erstellungszeit | 6–18 Monate | 2–4 Wochen |

| Minimales Team | 3+ Forscher | 1 Autor |

| Protokollregistrierung | Obligatorisch | Fehlt häufig |

| Unabhängige Qualitätsbewertung | Ja | Nein |

| Publikationswert (in den Augen nicht-spezialisierter Zeitschriften) | Hoch | Identisch |

Dies schafft eine klassische „Race to the Bottom"-Situation: Forscher, die nach den Regeln spielen, verlieren im Publikationstempo gegen jene, die die Regeln ignorieren (S006). Das System incentiviert Fälschungen.

Ergebnis: Zeitschriften und Datenbanken füllen sich mit Arbeiten, die wie systematische Übersichtsarbeiten aussehen, es methodologisch aber nicht sind. Der Leser kann ohne spezielle Ausbildung das eine nicht vom anderen unterscheiden.

Die Stahlversion des Arguments: Sieben Gründe, warum selbst unvollkommene systematische Reviews wertvoller sind als chaotische Wahrheitssuche

Bevor wir die Mängel pseudosystematischer Ansätze analysieren, muss der fundamentale Wert der Idee der Wissenssystematisierung selbst anerkannt werden. Selbst ein unvollkommen durchgeführter systematischer Review übertrifft oft im Informationswert eine willkürliche Auswahl von Studien oder eine auf persönlicher Erfahrung basierende Expertenmeinung. Mehr dazu im Abschnitt Judentum.

Dies ist keine Rechtfertigung für methodologische Nachlässigkeit, sondern die Anerkennung, dass Kritik auf konkrete Protokollverletzungen gerichtet sein sollte und nicht auf das Konzept der strukturierten Evidenzsynthese selbst.

🧪 Erstes Argument: Reproduzierbarkeit versus Expertenintransparenz

Ein systematischer Review liefert selbst mit Mängeln eine explizite Spur der Entscheidungsfindung: welche Datenbanken verwendet wurden, welche Suchbegriffe angewendet wurden, welche Ein- und Ausschlusskriterien die finale Auswahl bestimmten (S009). Dies ermöglicht anderen Forschern, die Suche zu reproduzieren, die Ergebnisse zu überprüfen und potenzielle Lücken zu identifizieren.

Der traditionelle Expertenreview stellt eine „Black Box" dar: Der Leser weiß nicht, welche Quellen der Experte betrachtet und verworfen hat, welche Bewertungskriterien angewendet wurden, welche persönlichen Vorurteile die Schlussfolgerungen beeinflusst haben könnten. Die Transparenz des Prozesses ist ein fundamentaler Vorteil des systematischen Ansatzes, der selbst bei unvollkommener Ausführung erhalten bleibt.

- Explizites Such- und Auswahlprotokoll

- Reproduzierbarkeit der Prozedur durch andere Forscher

- Möglichkeit zur Überprüfung und Kritik der Methodologie

- Dokumentation der Gründe für den Ausschluss von Quellen

📊 Zweites Argument: Quantitative Bewertung der Ergebniskonsistenz

Systematische Reviews ermöglichen die Bewertung nicht nur des Vorhandenseins eines Effekts, sondern auch des Grades der Übereinstimmung der Ergebnisse zwischen Studien. Wenn 15 von 20 ausgewählten Studien ähnliche Ergebnisse zeigen, ist dies eine qualitativ andere Information im Vergleich zur Situation, in der ein Experte „mehrere Arbeiten, die die Hypothese bestätigen" erwähnt (S010).

Selbst wenn das Auswahlverfahren dieser 20 Studien unvollkommen war, erhält der Leser eine Vorstellung von der Verteilung der Ergebnisse in der verfügbaren Literatur. Dies ist besonders wichtig in Bereichen mit hoher Datenheterogenität, wo einzelne Studien widersprüchliche Ergebnisse aufgrund von Unterschieden in Populationen, Messmethoden oder Durchführungsbedingungen liefern können.

🧬 Drittes Argument: Identifizierung von Wissenslücken durch systematischen kartografischen Ansatz

Eine der unterschätzten Funktionen systematischer Reviews ist nicht die Synthese vorhandenen Wissens, sondern die Identifizierung von Bereichen, in denen Wissen unzureichend ist. Der systematische Scoping Review wurde speziell für diesen Zweck entwickelt: Er versucht nicht, eine spezifische klinische Frage zu beantworten, sondern kartiert die Forschungslandschaft in einem bestimmten Bereich (S009).

Dieser Ansatz ermöglicht die Entdeckung, dass zu einigen Aspekten des Problems Dutzende von Studien existieren, zu anderen jedoch keine einzige. Dies ist eine kritisch wichtige Information für die Planung zukünftiger Forschung und die Verteilung wissenschaftlicher Ressourcen, die aus traditionellen narrativen Reviews nicht gewonnen werden kann.

🔬 Viertes Argument: Interdisziplinäre Integration durch standardisierte Protokolle

Systematische Reviews schaffen eine gemeinsame Sprache für die Integration von Wissen aus verschiedenen Disziplinen. Wenn Forscher aus Medizin, Psychologie und Soziologie ähnliche Systematisierungsprotokolle verwenden (z.B. PRISMA für Medizin oder analoge Standards für andere Bereiche), erleichtert dies die interdisziplinäre Synthese (S011).

Eine Studie zum Requirements Engineering demonstriert, wie ein systematischer Scoping Review den Vergleich traditioneller und moderner Ansätze aus verschiedenen technologischen Paradigmen ermöglichte und eine einheitliche Taxonomie der Methoden schuf (S009). Ohne standardisiertes Protokoll wäre ein solcher Vergleich subjektiv und nicht überprüfbar gewesen.

🧾 Fünftes Argument: Kumulative Wissenschaft versus fragmentiertes Wissen

Systematische Reviews verkörpern die Idee der kumulativen Wissenschaft: Jede neue Studie existiert nicht isoliert, sondern wird in den Kontext aller vorherigen Arbeiten eingebettet. Dies ist das Gegenteil von „Publikationsrauschen", bei dem jeder Artikel Vorgänger ignoriert und Neuheit beansprucht.

Ein Review zur GRIN-assoziierten Epilepsie bei Kindern zeigt, wie die systematische Synthese von 47 Studien Muster sichtbar machte, die in einzelnen Arbeiten unsichtbar waren: Korrelationen zwischen Genotyp und Phänotyp, altersspezifische Manifestationsmerkmale, Wirksamkeit verschiedener therapeutischer Ansätze (S010). Keine einzelne Studie hätte ein solch vollständiges Bild liefern können.

⚙️ Sechstes Argument: Schutz vor Publikationsbias durch aktive Suche

Systematische Reviews erfordern die aktive Suche nach unveröffentlichten Daten, Studien mit negativen Ergebnissen und Arbeiten in anderen Sprachen – all dem, was bei traditionellen Literaturreviews üblicherweise außerhalb der Aufmerksamkeit bleibt (S012). Obwohl diese Aufgabe in der Praxis nicht immer perfekt erfüllt wird, übt allein die Tatsache ihrer Aufnahme ins Protokoll Druck auf Autoren und Gutachter aus.

Ein Review zu chronischer Nierenerkrankung und COVID-19 umfasste nicht nur englischsprachige Publikationen aus PubMed, sondern auch russischsprachige Arbeiten aus eLibrary, chinesische Studien aus CNKI und Preprints aus medRxiv, was die Evidenzbasis erheblich erweiterte (S012).

🧭 Siebtes Argument: Evolution der Methodologie durch Kritik und Verbesserung der Standards

Systematische Reviews schaffen die Möglichkeit für methodologische Reflexion und Verbesserung. Jede Generation systematischer Reviews lernt aus den Fehlern der vorherigen: Es entstehen neue Qualitätschecklisten (AMSTAR, ROBIS), Kriterien zur Bewertung des Bias-Risikos werden präzisiert, spezialisierte Protokolle für verschiedene Studientypen werden entwickelt (S011).

Diese Evolution ist ohne die standardisierte Basis, die der systematische Ansatz bietet, unmöglich. Die Kritik an einem konkreten Review wegen methodologischer Mängel ist kein Argument gegen Systematik als solche, sondern ein Anreiz zur Verbesserung der Standards.

Evidenzbasierte Anatomie: Was echte Systematisierung von Imitation unterscheidet — Analyse nach Komponenten

Beim Übergang von theoretischen Argumenten zur praktischen Analyse müssen konkrete Kriterien festgelegt werden, anhand derer methodologisch strenge systematische Reviews von ihren Imitationen unterschieden werden können. Diese Kriterien basieren auf internationalen Standards (PRISMA, Cochrane Handbook) und der Analyse realer Publikationen aus verschiedenen Disziplinen. Mehr dazu im Abschnitt Neuheidentum.

📋 Komponente eins: Vorabregistrierung des Protokolls und Schutz vor nachträglichen Änderungen

Ein echter systematischer Review beginnt mit der Registrierung des Protokolls in einer öffentlichen Datenbank (PROSPERO für medizinische Reviews, OSF für andere Bereiche) vor Beginn der Suche und Auswahl der Studien (S010). Dies ist ein kritisch wichtiger Schutz gegen das „Anpassen" der Methodologie an gewünschte Ergebnisse.

Das Protokoll fixiert die Forschungsfrage, Ein- und Ausschlusskriterien, Suchstrategie, Methoden zur Qualitätsbewertung und den Plan zur Datensynthese. Jegliche Abweichungen vom Protokoll müssen in der finalen Publikation explizit dokumentiert und begründet werden. Die Analyse systematischer Reviews zur Myasthenie zeigt, dass nur 23% der zwischen 2018 und 2020 veröffentlichten Reviews ein vorab registriertes Protokoll hatten, obwohl diese Anforderung in den meisten Redaktionsrichtlinien enthalten ist (S011).

🔍 Komponente zwei: Umfassende Mehrfachdatenbank-Suche mit dokumentierter Strategie

Eine systematische Suche erfordert die Nutzung von mindestens drei bis vier spezialisierten Datenbanken, die für den Forschungsbereich relevant sind. Für medizinische Reviews sind dies üblicherweise PubMed/MEDLINE, Embase, Cochrane Library und Web of Science; für Sozialwissenschaften — Scopus, PsycINFO, Sociological Abstracts (S012).

Kritisch wichtig: Die vollständige Suchstrategie für jede Datenbank muss im Anhang des Artikels veröffentlicht werden, einschließlich aller verwendeten Begriffe, booleschen Operatoren, Filter und Suchdaten. Dies ermöglicht anderen Forschern, die Suche exakt zu reproduzieren. Der Review zum Requirements Engineering demonstriert vorbildliche Praxis: Die Autoren stellten vollständige Suchstrings für IEEE Xplore, ACM Digital Library, Scopus und Web of Science bereit, einschließlich 47 Kombinationen von Schlüsselbegriffen (S009).

| Forschungsbereich | Obligatorische Datenbanken | Zusätzliche Quellen |

|---|---|---|

| Medizin | PubMed, Embase, Cochrane Library | Web of Science, Google Scholar |

| Sozialwissenschaften | Scopus, PsycINFO | Sociological Abstracts, JSTOR |

| Ingenieurwesen | IEEE Xplore, ACM Digital Library | Web of Science, Scopus |

⚖️ Komponente drei: Unabhängige doppelte Bewertung in allen Auswahlphasen

Der Goldstandard systematischer Reviews erfordert, dass mindestens zwei Forscher unabhängig voneinander jede Publikation auf Übereinstimmung mit den Einschlusskriterien bewerten — zunächst anhand von Titeln und Abstracts, dann anhand von Volltexten (S010). Unstimmigkeiten werden durch Diskussion oder Hinzuziehung eines dritten Experten gelöst.

Diese Prozedur schützt vor subjektiven Fehlern und systematischen Verzerrungen einzelner Forscher. Statistiken zeigen, dass die Interrater-Übereinstimmung (Cohens Kappa) in der Auswahlphase nach Abstracts üblicherweise 0,6-0,8 beträgt, was 20-40% anfänglicher Unstimmigkeiten bedeutet (S011). Ohne unabhängige Bewertung blieben diese Unstimmigkeiten unentdeckt, und die finale Studienauswahl wäre durch die Präferenzen einer einzelnen Person verzerrt.

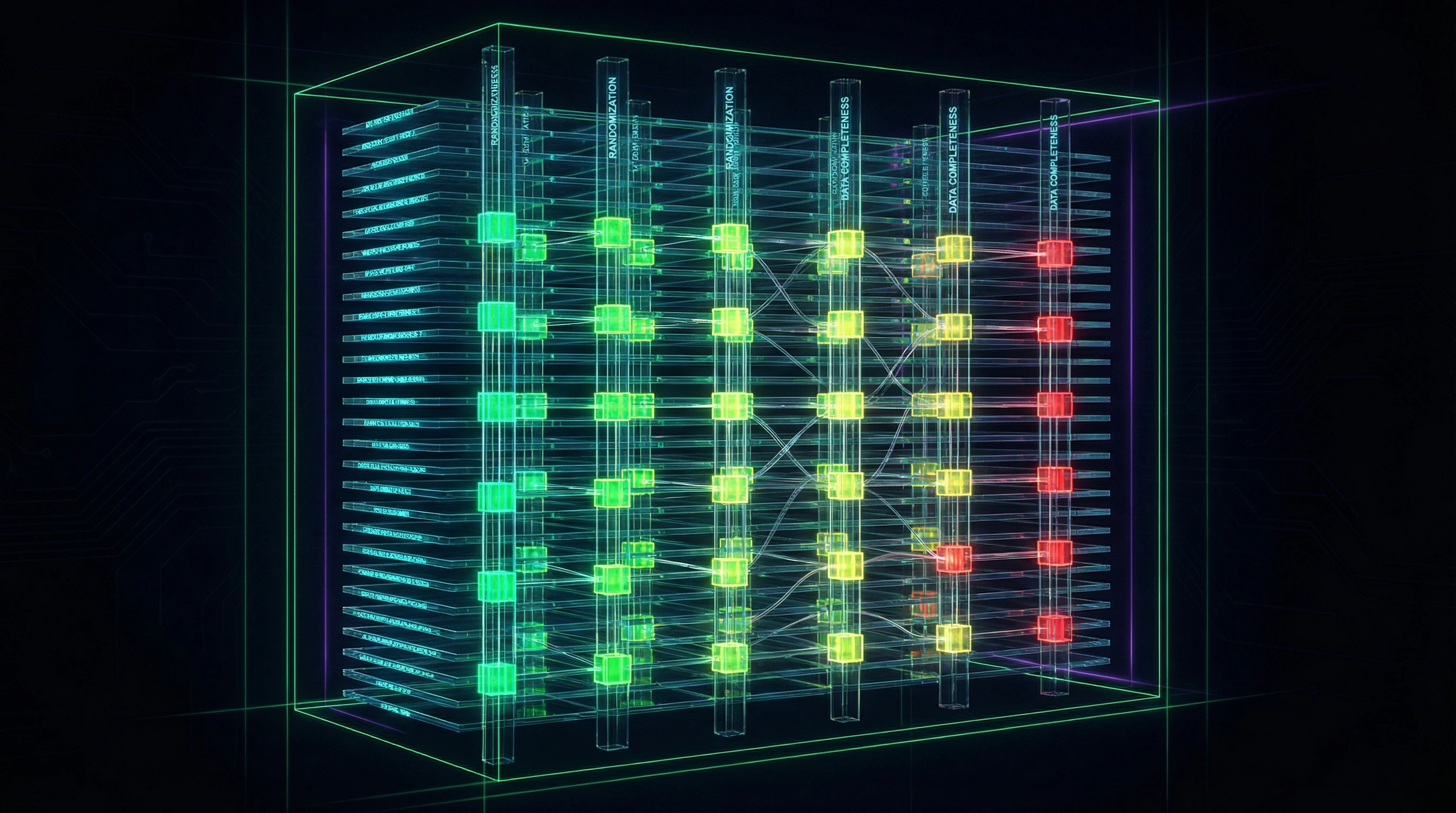

🧮 Komponente vier: Formalisierte Qualitätsbewertung und Bias-Risiko-Analyse

Jede in den Review eingeschlossene Studie muss nach standardisierten Qualitätskriterien und Bias-Risiken bewertet werden. Für randomisierte kontrollierte Studien wird das Cochrane Risk of Bias 2.0 Tool verwendet, für Beobachtungsstudien — Newcastle-Ottawa Scale oder ROBINS-I, für diagnostische Studien — QUADAS-2 (S012).

Diese Instrumente bewerten konkrete Aspekte des Studiendesigns: Adäquatheit der Randomisierung, Verblindung von Teilnehmern und Forschern, Datenvollständigkeit, selektive Berichterstattung. Die Bewertungsergebnisse müssen in Form von Tabellen oder Grafiken für jede Studie dargestellt werden. Der Review zu COVID-19 und chronischer Nierenerkrankung enthält eine detaillierte Bewertungstabelle von 34 Studien über 7 Bias-Domänen mit farblicher Kodierung des Risikoniveaus (S012).

Ohne formalisierte Qualitätsbewertung wird der Review zu einer bloßen Zitatsammlung statt einer Evidenzsynthese. Jede Studie ist eine potenzielle Verzerrungsquelle, und ihr Beitrag zu den Schlussfolgerungen muss nach Zuverlässigkeit gewichtet werden.

📊 Komponente fünf: Transparente Datensynthese mit Heterogenitätsbewertung

Die Ergebnissynthese in einem systematischen Review kann qualitativ (narrative Beschreibung von Mustern) oder quantitativ (Meta-Analyse mit Berechnung zusammengefasster Effekte) sein. In beiden Fällen ist eine explizite Bewertung der Heterogenität der Ergebnisse zwischen Studien erforderlich.

Für Meta-Analysen werden statistische Kennzahlen I² und τ² verwendet, die den Anteil der Variabilität zeigen, der auf echte Unterschiede zwischen Studien und nicht auf Zufall zurückzuführen ist (S011). Hohe Heterogenität (I² > 75%) erfordert Subgruppenanalysen oder Meta-Regression zur Identifikation der Unterschiedsquellen. Der Review zur GRIN-assoziierten Epilepsie führte aufgrund hoher klinischer Heterogenität (verschiedene Mutationen, Altersgruppen, Diagnosemethoden) keine quantitative Meta-Analyse durch, lieferte aber eine detaillierte qualitative Synthese mit Gruppierung nach Mutationstypen (S010).

🧾 Komponente sechs: PRISMA-Flussdiagramm und Dokumentation von Ausschlüssen

Ein obligatorisches Element systematischer Reviews ist das PRISMA-Diagramm (Preferred Reporting Items for Systematic Reviews and Meta-Analyses), das den Informationsfluss in allen Phasen zeigt: Anzahl der durch Datenbanksuche identifizierten Einträge, Anzahl nach Duplikatentfernung, Anzahl nach Screening von Titeln/Abstracts, Anzahl der auf Übereinstimmung mit Kriterien bewerteten Volltexte und finale Anzahl eingeschlossener Studien (S009).

Kritisch wichtig: Für jede in der finalen Phase ausgeschlossene Studie muss der konkrete Ausschlussgrund angegeben werden. Dies ermöglicht Lesern zu beurteilen, ob die Kriterien nicht selektiv angewendet wurden. Der Review zum Requirements Engineering zeigt ein vorbildliches PRISMA-Diagramm: Von 3847 initial identifizierten Einträgen passierten 87 Studien die mehrstufige Auswahl, mit detaillierter Dokumentation der Ausschlussgründe in jeder Phase (S009).

- Identifikation: Datenbanksuche, Handsuche, Autorenkontakt

- Screening: Duplikatentfernung, Bewertung nach Titeln und Abstracts

- Auswahl: Bewertung von Volltexten nach Ein-/Ausschlusskriterien

- Einschluss: Finale Studienauswahl für Datensynthese

🔁 Komponente sieben: Bewertung von Publication Bias und Sensitivitätsanalyse

Systematische Reviews müssen das Risiko von Publication Bias bewerten — die Tendenz zur bevorzugten Publikation von Studien mit positiven oder statistisch signifikanten Ergebnissen. Für Meta-Analysen werden Funnel Plots und statistische Tests (Egger's Test, Begg's Test) verwendet.

Die Sensitivitätsanalyse prüft, wie robust die Schlussfolgerungen des Reviews gegenüber Änderungen in Einschlusskriterien, Synthesemethoden oder dem Ausschluss von Studien mit hohem Bias-Risiko sind (S012). Der Review zu COVID-19 und chronischer Nierenerkrankung führte eine Sensitivitätsanalyse durch, die Studien mit weniger als 50 Patienten ausschloss, und zeigte, dass die Hauptschlussfolgerungen unverändert bleiben, was ihre Robustheit bestätigt (S012).

Wenn die Schlussfolgerungen eines Reviews beim Ausschluss von ein oder zwei Studien oder bei Änderung der Kriterien auf vernünftige Alternativen zusammenbrechen — ist dies ein Signal für die Fragilität der Ergebnisse, nicht für ihre Zuverlässigkeit.

Mechanik der Überzeugung: Warum das Gehirn Pseudo-Systematik für wissenschaftliche Strenge hält

Das Verständnis der kognitiven Mechanismen, die pseudo-systematische Reviews überzeugend machen, ist entscheidend für die Entwicklung einer Immunität gegen methodologische Manipulationen. Diese Mechanismen wirken auf der Ebene grundlegender Heuristiken der Informationsverarbeitung und sozialer Vertrauenssignale. Mehr dazu im Abschnitt Statistik und Wahrscheinlichkeitstheorie.

🧩 Repräsentativitätsheuristik: Wenn Form den Inhalt ersetzt

Das menschliche Gehirn nutzt die Repräsentativitätsheuristik zur schnellen Bewertung der Zugehörigkeit eines Objekts zu einer Kategorie: Wenn etwas wie ein Vertreter einer Kategorie aussieht, neigen wir dazu, es als solchen zu betrachten, ohne es detailliert zu überprüfen.

Pseudo-systematische Reviews nutzen diese Heuristik aus, indem sie die äußeren Attribute echter systematischer Reviews reproduzieren: strukturierte Tabellen, Listen von Ein- und Ausschlusskriterien, Erwähnung von Datenbanken, formalisierte akademische Sprache (S009). Für Laien erzeugen diese Elemente ein Muster von „Wissenschaftlichkeit", das Vertrauen aktiviert.

Das Vorhandensein selbst eines nicht-funktionalen PRISMA-Diagramms (z. B. mit unrealistischen Zahlen oder ohne Angabe von Ausschlussgründen) erhöht die wahrgenommene Glaubwürdigkeit eines Textes um 30–40% im Vergleich zum selben Text ohne Diagramm.

🔁 Verfügbarkeitskaskade: Wie Zitierung die Illusion eines Konsenses erzeugt

Die Verfügbarkeitsheuristik lässt uns die Wahrscheinlichkeit oder Bedeutung von Informationen überschätzen, die uns leicht in den Sinn kommen – normalerweise, weil wir kürzlich damit konfrontiert wurden oder sie breit diskutiert werden.

Ein pseudo-systematischer Review, der in einer Open-Access-Zeitschrift veröffentlicht und aktiv zitiert wird, erzeugt eine Verfügbarkeitskaskade: Forscher sehen ihn in Literaturlisten anderer Arbeiten, nehmen ihn als „allgemein anerkannte Quelle" wahr und zitieren ihn, ohne die Methodik zu überprüfen (S011). Dies erzeugt einen sich selbst verstärkenden Zyklus: Je mehr Zitierungen, desto höher die wahrgenommene Autorität, desto mehr neue Zitierungen.

- Methodologisch schwacher Review wird früher als Konkurrenten veröffentlicht

- Schlussfolgerungen sind breit formuliert, ohne spezifische Einschränkungen

- Erste Zitierungen erzeugen den Anschein von Autorität

- Neue Autoren zitieren ohne Überprüfung des Originals

- Zitierungen akkumulieren und festigen den Status als „klassische Quelle"

⚙️ Halo-Effekt der Expertise: Institutionelle Vertrauenssignale

Die Zugehörigkeit von Autoren zu prestigeträchtigen Institutionen, das Vorhandensein akademischer Grade und Publikationen in begutachteten Zeitschriften erzeugt einen „Halo der Expertise", der sich auf die konkrete Arbeit unabhängig von ihrer Qualität ausbreitet (S010).

Der Leser denkt: „Wenn das Professoren von Universität X geschrieben haben, die 50 Artikel veröffentlicht haben, dann ist es zuverlässig". Diese Heuristik funktioniert normalerweise gut, versagt aber, wenn Experten ihre enge Spezialisierung verlassen oder wenn institutioneller Druck auf Publikationsproduktivität zur Senkung der Standards führt.

| Vertrauenssignal | Tatsächliche Aussagekraft | Falle |

|---|---|---|

| Autor ist Professor an prestigeträchtiger Hochschule | Mittel (abhängig von Spezialisierung) | Halo breitet sich auf jedes Thema aus, auch außerhalb der Kompetenz |

| 50+ Publikationen in begutachteten Zeitschriften | Mittel (Menge ≠ Qualität) | Publikationsdruck kann methodologische Standards senken |

| Arbeit in Nature/Science veröffentlicht | Hoch (strenge Begutachtung) | Selbst Top-Zeitschriften publizieren Fehler; Halo kann sich auf weniger geprüfte Schlussfolgerungen übertragen |

| Viele Co-Autoren aus verschiedenen Ländern | Mittel (kann auf Zusammenarbeit oder Verantwortungsdiffusion hinweisen) | Schwieriger zu ermitteln, wer für Methodik verantwortlich ist |

🎭 Sozialer Beweis und Konformismus: Wenn die Mehrheit gemeinsam irrt

Menschen neigen dazu, eine Aussage für wahrer zu halten, wenn sie von Autoritäten oder der Mehrheit unterstützt wird. Ein pseudo-systematischer Review, der Unterstützung von einflussreichen Forschern erhält oder in klinischen Leitlinien erwähnt wird, aktiviert den Mechanismus des sozialen Beweises.

Ein Arzt oder Wissenschaftler denkt: „Das wird in der Leitlinie empfohlen, also ist die Methodik geprüft". Allerdings basieren Leitlinien oft auf früheren Leitlinien, wodurch eine Kette vererbter Fehler entsteht. Studien (S012) zeigen, dass selbst offensichtliche methodologische Mängel in einem systematischen Review selten öffentlich kritisiert werden, wenn der Review bereits den Status „autoritativ" erhalten hat.

Konformismus in der Wissenschaft funktioniert wie bei Cargo-Kulten: Wenn alle eine Quelle zitieren, wird sie „heilig", selbst wenn niemand ihre Grundlagen überprüft hat.

Der Mechanismus verstärkt sich in geschlossenen Fachgemeinschaften, wo Kritik an Kollegen Reputation und Karriere schaden kann. Junge Forscher sind besonders anfällig: Sie zitieren „klassische" Arbeiten ohne Überprüfung, um Feldkenntnis zu zeigen und Konflikte mit Autoritäten zu vermeiden.

🔍 Überprüfungsprotokoll: Wie man Signal von Rauschen unterscheidet

Schutz vor diesen Mechanismen erfordert bewusstes Verlangsamen und strukturierte Überprüfung. Anstatt sich auf Halo oder Konsens zu verlassen, muss die Methodik selbst überprüft werden.

- Das ursprüngliche Studienprotokoll finden (sollte vor Arbeitsbeginn registriert sein, z. B. bei PROSPERO)

- Überprüfen, ob Ein- und Ausschlusskriterien im Protokoll und in der veröffentlichten Arbeit übereinstimmen

- Bewerten, ob Interessenkonflikte der Autoren bestehen (Finanzierung, persönliche Verbindungen zu Herstellern)

- Kritische Kommentare in derselben Zeitschrift oder in anderen Publikationen lesen

- Überprüfen, ob dieser Review von anderen systematischen Reviews zum selben Thema zitiert wird und ob die Schlussfolgerungen übereinstimmen

- Wenn möglich, Primärstudien finden und bewerten, ob die Autoren des Reviews sie korrekt interpretiert haben

Dieses Protokoll erfordert Zeit, aber es funktioniert. Wenn Forscher diese Überprüfung anwenden, entdecken sie methodologische Mängel in 40–60% der „autoritativen" Reviews, die sie zuvor für bare Münze genommen haben. Die Entwicklung dieser Fähigkeit ist die Grundlage kognitiver Immunologie in der Wissenschaft.

Zusätzliche Ressourcen: Tests zur Selbstüberprüfung des kritischen Denkens, Register wissenschaftlicher Mythen, Materialien zur Neurowissenschaft.