Was ist ein „wissenschaftliches Wunder" und warum glaubt unser Gehirn so leicht daran: Definition der Grenzen des Außergewöhnlichen

Der Begriff „wissenschaftliches Wunder" ist ein Oxymoron, das ein Missverständnis der Natur der Wissenschaft verschleiert. Wissenschaft beschäftigt sich nicht mit Wundern; sie beschäftigt sich mit reproduzierbaren, überprüfbaren Phänomenen, die im Rahmen bestehender oder neuer theoretischer Modelle erklärbar sind. Mehr dazu im Abschnitt Indigene Glaubensvorstellungen.

Eine außergewöhnliche Behauptung ist eine Aussage, die dem etablierten Wissenskorpus widerspricht und eine Überprüfung fundamentaler Prinzipien erfordert. Beispielsweise widerspricht die Behauptung einer instantanen Informationsübertragung durch Quantenverschränkung der speziellen Relativitätstheorie und erfordert außergewöhnliche Beweise (S001).

Das menschliche Gehirn hat sich nicht zur Bewertung statistischer Signifikanz entwickelt, sondern zur schnellen Entscheidungsfindung unter Unsicherheit. Wir sehen Muster, wo keine sind, schreiben zufälligen Korrelationen Kausalzusammenhänge zu und vertrauen Autoritäten mehr als Daten.

Selbst professionelle Wissenschaftler unterliegen kognitiven Verzerrungen bei der Interpretation von Ergebnissen, insbesondere beim Umgang mit p-Werten und statistischer Signifikanz (S001), (S003).

🔎 Drei Typen außergewöhnlicher Behauptungen

Der erste Typ erweitert bestehende Theorien, ohne sie zu widerlegen. Die Entdeckung der asymptotischen Freiheit in der Quantenchromodynamik war außergewöhnlich, widersprach aber nicht den fundamentalen Prinzipien der Quantenfeldtheorie.

Der zweite Typ erfordert eine radikale Revision fundamentaler Gesetze: Verletzung der Gesetze der Thermodynamik, überlichtschnelle Informationsübertragung, makroskopische Quanteneffekte in der Biologie. Solche Behauptungen erfordern nicht nur statistisch signifikante Ergebnisse, sondern auch einen theoretischen Mechanismus, der erklärt, warum alle vorherigen Experimente sie nicht entdeckt haben.

Der dritte Typ sind Versuche, moderne Wissenschaft mit antiken philosophischen oder religiösen Texten zu verbinden. Obwohl die historische Analyse philosophischer Ideen wertvoll ist, basiert die Darstellung antiker Texte als Vorwegnahme der Quantenmechanik meist auf retrospektiver Interpretation und ignoriert den Entstehungskontext dieser Ideen.

- Apophänie

- Die Neigung, bedeutungsvolle Muster in zufälligen Daten zu sehen – eine kognitive Verzerrung, die bei der Analyse außergewöhnlicher Behauptungen besonders gefährlich ist.

- Außergewöhnlicher Beweis

- Nicht nur ein statistisch signifikantes Ergebnis, sondern reproduzierbare Daten, ein theoretischer Mechanismus und Integration in den bestehenden Wissenskorpus.

🧱 Grenze zwischen Skepsis und Dogmatismus

Die Wissenschaftsgeschichte ist voll von Beispielen, in denen revolutionäre Ideen auf Widerstand stießen: Heliozentrismus, Quantenmechanik. Aber diese Ideen setzten sich nicht durch die Charisma ihrer Autoren durch, sondern durch reproduzierbare experimentelle Beweise und theoretische Modelle, die mehr Phänomene erklärten als frühere Theorien.

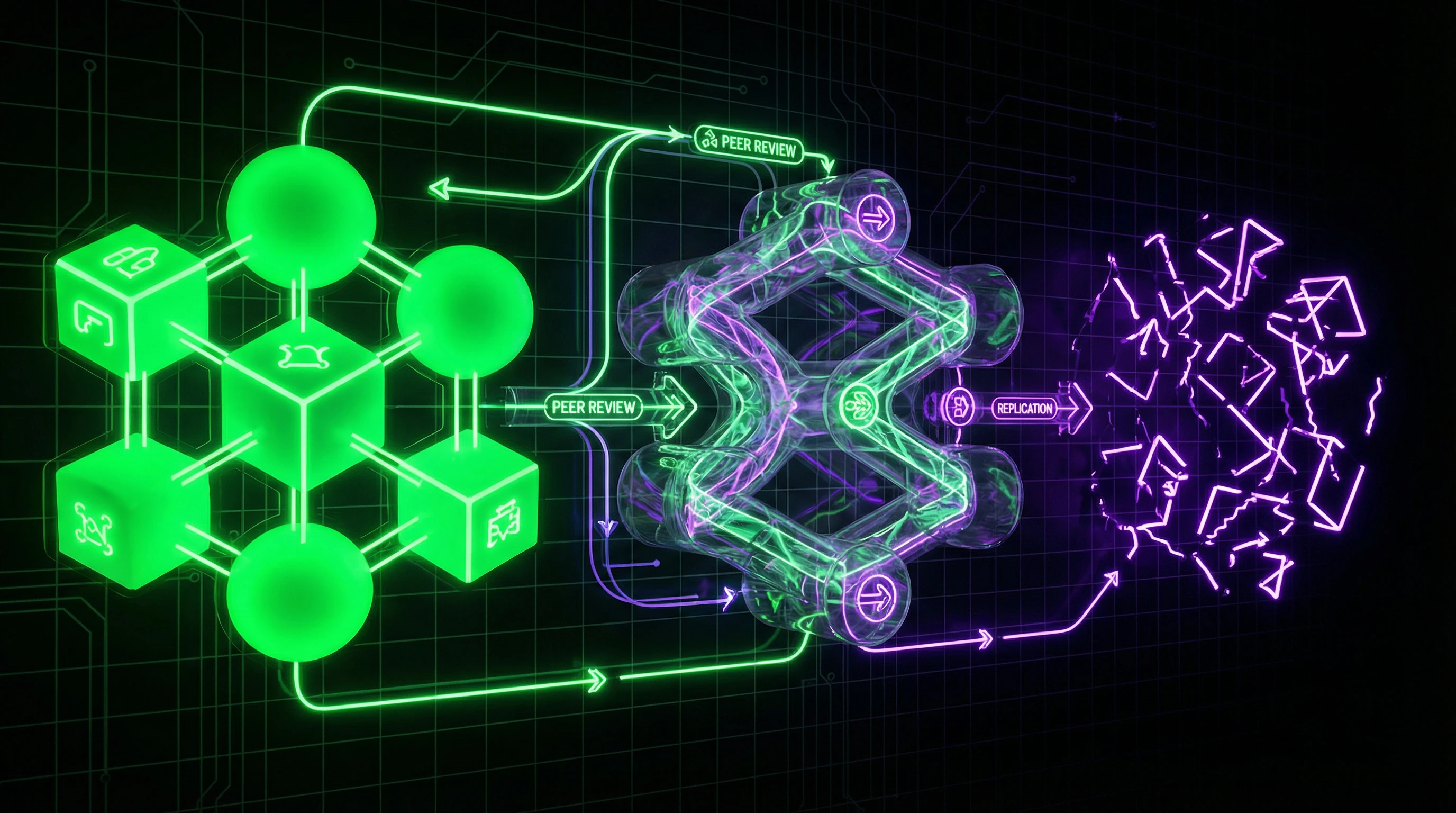

Grundprinzip: Eine außergewöhnliche Behauptung muss mehrfache unabhängige Überprüfungen durchlaufen – Reproduktion in verschiedenen Laboren, theoretische Analyse, Integration in den bestehenden Wissenskorpus.

Das Peer-Review-System bleibt trotz seiner Mängel der beste Mechanismus zur Filterung wissenschaftlicher Behauptungen (S006). Transparenz des Prozesses führt keine systematische Voreingenommenheit ein, schafft aber neue Herausforderungen.

| Merkmal gesunder Skepsis | Merkmal von Dogmatismus |

|---|---|

| Fordert reproduzierbare Daten | Lehnt Daten ohne Analyse ab |

| Sucht theoretischen Mechanismus | Verweigert Mechanismus a priori |

| Prüft durch unabhängige Quellen | Verlässt sich auf Autorität |

Die Verbindung zwischen Glauben und Beweisen zeigt, wie wissenschaftlicher Konsens funktioniert, wenn er angegriffen wird. Das Verständnis logischer Fehler hilft, kritisches Denken vor Manipulation zu schützen.

Stahlmann-Prinzip: Die sieben stärksten Argumente für außergewöhnliche Behauptungen und warum sie ernsthafte Betrachtung verdienen

Bevor man außergewöhnliche Behauptungen widerlegt, muss man ihre stärkste Version konstruieren — dies nennt man das „Stahlmann-Prinzip" (steelman), das Gegenteil der „Strohmann-Argumentation". Nur wenn wir die überzeugendste Form eines Arguments widerlegen, können wir unserer Schlussfolgerung sicher sein. Betrachten wir sieben Argumentkategorien, die am häufigsten zur Stützung außergewöhnlicher Behauptungen verwendet werden. Mehr dazu im Abschnitt Islam.

🧪 Argument reproduzierbarer Anomalien: Wenn sich das Experiment wiederholt, aber nicht erklärt wird

Das stärkste Argument für eine außergewöhnliche Behauptung ist eine reproduzierbare experimentelle Anomalie. Wenn mehrere unabhängige Labore dasselbe unerwartete Ergebnis erzielen, erfordert dies eine Erklärung. Ein klassisches Beispiel sind die Experimente mit Neutrinos, die sich angeblich schneller als Licht bewegten (später stellte sich heraus, dass es ein Messfehler war). Wichtig: Reproduzierbarkeit garantiert nicht die Richtigkeit der Interpretation, schließt aber zufällige Fluktuation als Erklärung aus.

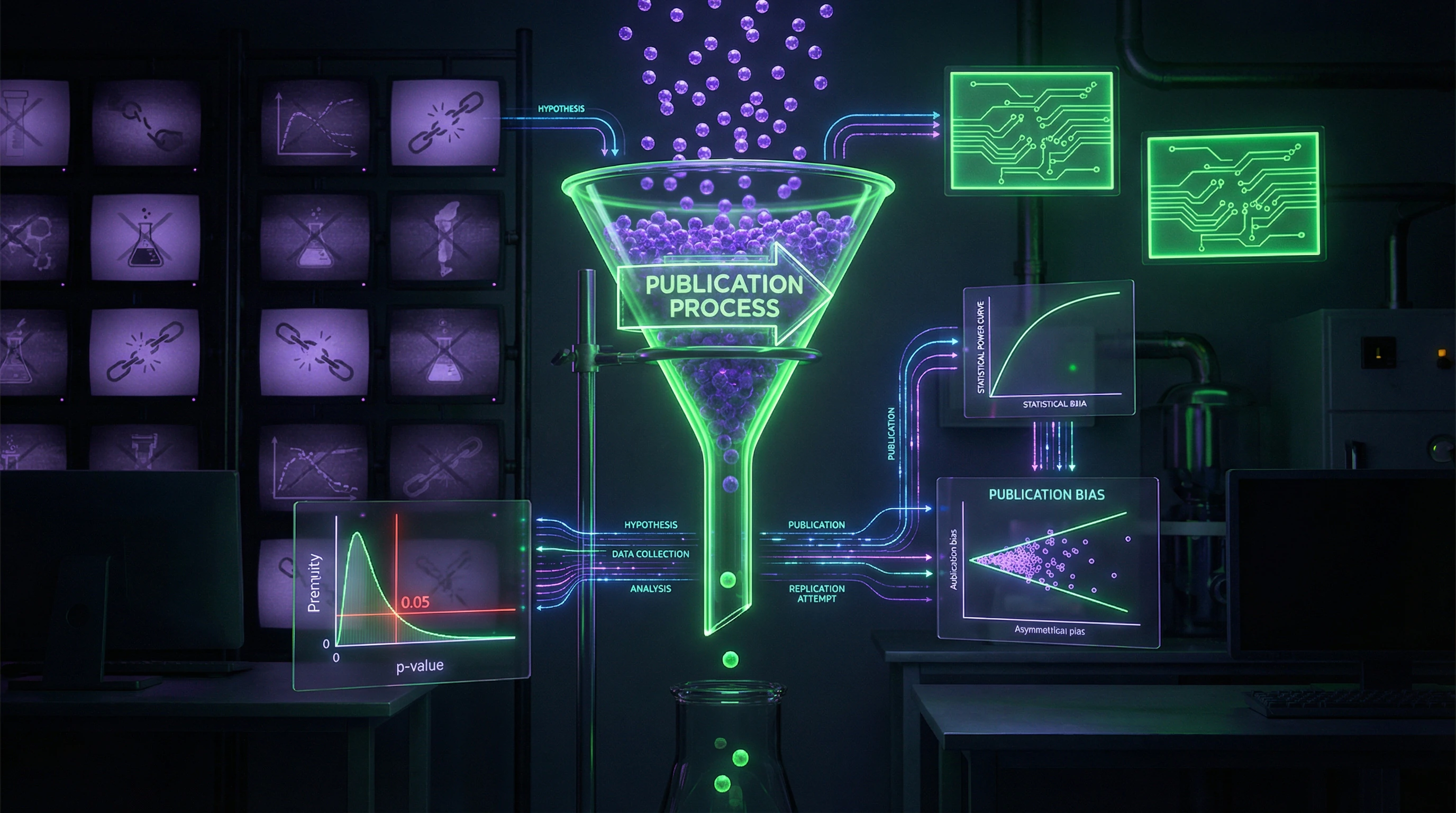

📊 Das Problem ist, dass echte Reproduzierbarkeit selten vorkommt. Studien zeigen, dass in den biologischen und Naturwissenschaften ein erheblicher Teil der Ergebnisse bei wiederholten Experimenten nicht reproduziert werden kann (S001, S003). Dies hängt nicht nur mit Betrug zusammen, sondern auch mit subtileren Problemen: p-hacking (Datenmanipulation zur Erreichung statistischer Signifikanz), publication bias (Veröffentlichung nur positiver Ergebnisse) und unzureichende statistische Power der Experimente.

🧬 Argument theoretischer Eleganz: Wenn ein neues Modell mehr mit weniger erklärt

Das zweite starke Argument ist theoretische Eleganz und Erklärungskraft. Wenn eine neue Theorie alles erklärt, was die alte erklärte, plus zusätzliche Phänomene, und dies mit weniger Annahmen tut, verdient sie ernsthafte Betrachtung. Occams Rasiermesser funktioniert genau so: Vervielfache Entitäten nicht ohne Notwendigkeit.

Ein Beispiel aus der Informationsbiologie: Die Untersuchung der optimalen Anzahl von Basen im genetischen Code (S005) zeigt, wie ein informationstheoretischer Ansatz erklären kann, warum DNA genau vier Basen verwendet und nicht mehr oder weniger. Dies ist keine außergewöhnliche Behauptung im strengen Sinne, demonstriert aber, wie theoretische Eleganz auf tiefe Organisationsprinzipien biologischer Systeme hinweisen kann.

🔁 Argument konvergierender Beweislinien: Wenn verschiedene Methoden zur selben Schlussfolgerung führen

⚠️ Das dritte Argument ist die Konvergenz unabhängiger Beweislinien. Wenn dieselbe Schlussfolgerung aus verschiedenen Experimenttypen, theoretischen Modellen und Beobachtungen in unterschiedlichen Kontexten folgt, stärkt dies ihre Glaubwürdigkeit erheblich. Zum Beispiel wird die Existenz dunkler Materie durch Gravitationslinseneffekte, Rotationskurven von Galaxien, Anisotropie der kosmischen Hintergrundstrahlung und Computersimulationen der Strukturbildung im Universum bestätigt.

Konvergenz kann jedoch illusorisch sein, wenn alle Methoden dieselbe systematische Verzerrung teilen. Die systematische Übersicht zur Verwendung von Kontext in der Objekterkennung (S008) zeigt, wie verschiedene Machine-Learning-Algorithmen ähnliche Ergebnisse liefern können, nicht weil sie die Realität korrekt modellieren, sondern weil sie dieselben Artefakte in den Trainingsdaten ausnutzen.

🧠 Argument mechanistischer Plausibilität: Wenn es einen theoretischen Weg von Ursache zu Wirkung gibt

Das vierte Argument ist das Vorhandensein eines plausiblen Mechanismus. Selbst wenn experimentelle Daten mehrdeutig sind, stärkt das Vorhandensein eines detaillierten theoretischen Mechanismus, der erklärt, wie eine Ursache zur Wirkung führt, die Behauptung. Dies ist besonders wichtig in Biologie und Medizin, wo randomisierte kontrollierte Studien nicht immer möglich sind.

Das Problem: Plausibilität ist subjektiv und hängt von bestehenden theoretischen Rahmen ab. Was in einem Paradigma plausibel erscheint, kann in einem anderen absurd sein. Die Übersicht zum Partitionsansatz der Quantenmechanik-Interpretation (S007) illustriert, wie alternative Interpretationen intern konsistent sein können, aber radikal von Mainstream-Ansichten abweichen.

📊 Argument statistischer Power: Wenn die Stichprobengröße Zufall ausschließt

🔬 Das fünfte Argument ist ausreichende statistische Power. Wenn ein Experiment eine große Stichprobengröße und korrekt berechnete statistische Power hat, sinkt die Wahrscheinlichkeit falsch-positiver Ergebnisse. Dies ist besonders wichtig im Kontext der Reproduzierbarkeitskrise in der Wissenschaft, wo viele Studien unzureichende Power zur Entdeckung realer Effekte haben (S001, S003).

Hohe statistische Power schützt jedoch nicht vor systematischen Fehlern. Eine große Stichprobe kann mit hoher Präzision die falsche Größe messen, wenn das Experimentdesign eine systematische Verzerrung enthält. Zudem lassen sich im Zeitalter von Big Data leicht statistisch signifikante, aber praktisch bedeutungslose Korrelationen finden.

🧷 Argument des Expertenkonsenses: Wenn Fachleute im Bereich übereinstimmen

Das sechste Argument ist der Konsens der Expertengemeinschaft. Wenn die Mehrheit der Spezialisten im relevanten Bereich eine Behauptung unterstützt, ist dies ein gewichtiges Argument zu ihren Gunsten. Die Delphi-Methode, die zur Konsensbildung in medizinischen Studien verwendet wird (S009), zeigt, wie ein strukturierter Prozess Experten helfen kann, bei komplexen Fragen zu einer Übereinstimmung zu gelangen.

⚠️ Aber Konsens ist keine Garantie für Wahrheit. Die Wissenschaftsgeschichte kennt viele Beispiele, wo der Konsens falsch lag: von der Phlogiston-Theorie bis zur Eugenik. Zudem kann sich in manchen Bereichen Konsens unter dem Einfluss sozialer, politischer oder ökonomischer Faktoren bilden, die nicht mit wissenschaftlichen Beweisen zusammenhängen.

🔎 Argument der Vorhersagekraft: Wenn die Theorie neue, unerwartete Phänomene vorhersagt

Das siebte und stärkste Argument ist Vorhersagekraft. Wenn eine Theorie neue Phänomene vorhersagt, die dann experimentell entdeckt werden, ist dies ein mächtiger Beleg zu ihren Gunsten. Klassische Beispiele: Einsteins Vorhersage der Lichtablenkung im Gravitationsfeld, Diracs Vorhersage von Antiteilchen, die Vorhersage des Higgs-Bosons.

Wichtige Unterscheidung: Postdiktive Erklärungen (wenn eine Theorie bereits bekannte Fakten erklärt) sind viel schwächer als prädiktive. Es ist leicht, ein Modell an bestehende Daten anzupassen, aber viel schwieriger, etwas vorherzusagen, was noch niemand gesehen hat. Genau deshalb wird die Präregistrierung von Hypothesen und Analyseplänen zum Standard in der modernen Wissenschaft.

Anatomie des Beweises: Wie man die Qualität wissenschaftlicher Daten im Zeitalter des Informationsrauschens und der Preprints bewertet

Nachdem wir nun den Strohmann aus Stahl gebaut haben, ist es Zeit, ihn zu zerlegen. Die Bewertung der Qualität wissenschaftlicher Beweise erfordert einen systematischen Ansatz, der nicht nur statistische Signifikanz berücksichtigt, sondern auch Studiendesign, potenzielle Verzerrungen, Reproduzierbarkeit und theoretische Integration. Mehr dazu im Abschnitt Neue religiöse Bewegungen.

📊 Hierarchie der Beweise: Von Meta-Analysen bis zu Anekdoten, und warum sie nicht absolut ist

Die traditionelle Hierarchie stellt systematische Übersichtsarbeiten und Meta-Analysen randomisierter kontrollierter Studien (RCTs) an die Spitze, gefolgt von einzelnen RCTs, Kohortenstudien, Fall-Kontroll-Studien und ganz unten – Fallbeschreibungen und Expertenmeinungen. Diese Hierarchie ist nützlich, aber nicht absolut.

Die Qualität einer systematischen Übersichtsarbeit hängt von der Qualität der eingeschlossenen Studien ab (S008). Eine Meta-Analyse schlecht geplanter Experimente liefert keine verlässlichen Schlussfolgerungen, und eine gut geplante Beobachtungsstudie kann informativer sein als eine schlechte RCT.

- Systematische Übersichtsarbeit – Prüfung aller verfügbaren Studien zu einem Thema mit klaren Einschlusskriterien

- Meta-Analyse – statistische Zusammenführung der Ergebnisse mehrerer Studien

- Randomisierte kontrollierte Studie – zufällige Zuteilung der Teilnehmer in Gruppen

- Kohortenstudie – Beobachtung einer Gruppe von Menschen mit gemeinsamen Merkmalen

- Fall-Kontroll-Studie – Vergleich von Menschen mit und ohne das interessierende Ergebnis

- Fallbeschreibung – detaillierte Beschreibung eines oder mehrerer Patienten

🧾 P-Werte und statistische Signifikanz: Warum p < 0,05 nicht „bewiesen" bedeutet

Einer der häufigsten Fehler ist die Gleichsetzung statistischer Signifikanz mit praktischer Bedeutung oder Wahrheit der Hypothese. Der P-Wert zeigt die Wahrscheinlichkeit, die beobachteten Daten (oder extremere) zu erhalten, unter der Bedingung, dass die Nullhypothese wahr ist.

Der P-Wert ist nicht die Wahrscheinlichkeit, dass die Nullhypothese wahr ist, und nicht die Wahrscheinlichkeit, dass das Ergebnis zufällig ist. Es ist eine bedingte Wahrscheinlichkeit unter der Annahme, dass die Nullhypothese wahr ist.

Der Schwellenwert p < 0,05 ist eine willkürliche Konvention, keine magische Grenze zwischen Wahrheit und Lüge (S001, S003). Bei multiplem Testen (wenn viele Hypothesen gleichzeitig geprüft werden) steigt die Wahrscheinlichkeit falsch-positiver Ergebnisse stark an. Korrekturen wie Bonferroni helfen, lösen das Problem aber nicht vollständig.

🔁 Reproduzierbarkeit als Goldstandard: Die Replikationskrise und was sie für die Bewertung von Behauptungen bedeutet

Reproduzierbarkeit – die Fähigkeit, dasselbe Ergebnis bei Wiederholung des Experiments zu erhalten – gilt als Goldstandard der wissenschaftlichen Methode. Die Replikationskrise der letzten Jahre hat gezeigt, dass ein erheblicher Teil der veröffentlichten Ergebnisse nicht reproduzierbar ist, insbesondere in Psychologie, Medizin und Biologie (S001, S003).

| Ursache der Nicht-Reproduzierbarkeit | Mechanismus | Wie erkennen |

|---|---|---|

| Unzureichende statistische Power | Stichprobengröße zu klein zur Effektdetektion | Power-Berechnung in der Methodik prüfen |

| Flexibilität in der Datenanalyse | Forscher wählt Analyse, die signifikantes Ergebnis liefert | Präregistrierung mit veröffentlichter Analyse vergleichen |

| Publikationsbias | Nur signifikante Ergebnisse werden publiziert | Suche nach Preprints und negativen Ergebnissen |

| HARKing | Hypothese wird nach Erhalt der Ergebnisse formuliert | Logik von Hypothese und Design prüfen |

Nicht-Reproduzierbarkeit bedeutet nicht immer Betrug. Oft ist es das Ergebnis ehrlicher Fehler und struktureller Probleme im wissenschaftlichen Publikationssystem.

🧷 Peer Review als Filter: Was es kann und was nicht, und warum offenes Peer Review die Spielregeln ändert

Das Peer-Review-System ist der wichtigste Qualitätskontrollmechanismus in der Wissenschaft. Vor der Veröffentlichung wird ein Artikel von mehreren Experten geprüft, die Methodik, Datenanalyse und Schlussfolgerungen bewerten. Dieses System ist jedoch weit von der Perfektion entfernt.

Offenes Peer Review (wenn die Namen der Gutachter bekannt sind) führt nicht zwangsläufig zu systematischer Voreingenommenheit, kann aber die Interaktionsdynamik verändern (S006). Es kann die Aggressivität der Kritik verringern und den Prozess konstruktiver gestalten. Wichtig: Peer Review garantiert nicht die Richtigkeit der Ergebnisse, es prüft lediglich, ob die Methodik den Standards des Fachgebiets entspricht.

🔬 Preprints und Post-Publication Peer Review: Das neue Ökosystem wissenschaftlicher Kommunikation und seine Risiken

Das traditionelle Modell wissenschaftlicher Publikation – Einreichung bei einer Zeitschrift, Peer Review, Veröffentlichung – dauert Monate oder Jahre. Preprints (Versionen von Artikeln im offenen Zugang vor formaler Begutachtung) haben die wissenschaftliche Kommunikation revolutioniert und die Verbreitung von Ergebnissen beschleunigt.

Preprints schaffen jedoch neue Risiken. Ungeprüfte Ergebnisse können von Medien aufgegriffen und als etablierte Fakten dargestellt werden. Während der COVID-19-Pandemie führte dies zur Verbreitung zahlreicher fehlerhafter Behauptungen, die auf Preprints niedriger Qualität basierten (S006). Post-Publication Peer Review (wenn ein Artikel nach der Veröffentlichung diskutiert und kritisiert wird) löst dieses Problem teilweise, erfordert aber aktive Beteiligung der wissenschaftlichen Gemeinschaft.

🧭 Interessenkonflikte und Finanzierung: Wie Geld wissenschaftliche Schlussfolgerungen verzerrt, selbst wenn Forscher ehrlich sind

Interessenkonflikte sind Situationen, in denen ein Forscher finanzielle oder persönliche Anreize hat, die Design, Durchführung oder Interpretation einer Studie beeinflussen können. Ein klassisches Beispiel sind von Pharmaunternehmen finanzierte Studien, die mit größerer Wahrscheinlichkeit positive Ergebnisse für die Medikamente dieser Unternehmen zeigen.

Ein Interessenkonflikt bedeutet nicht automatisch, dass die Ergebnisse falsch sind. Er erfordert aber erhöhte Wachsamkeit bei der Bewertung der Beweise.

Transparenz der Finanzierung, Präregistrierung von Studienprotokollen und offener Zugang zu Daten sind Mechanismen, die helfen, den Einfluss von Interessenkonflikten zu verringern. Ein strukturierter Ansatz zur Erzielung von Expertenkonsens kann helfen, Voreingenommenheit im Bewertungsprozess zu minimieren.

Bei der Bewertung außergewöhnlicher Behauptungen achten Sie auf Finanzierung, Affiliation der Autoren und Verfügbarkeit offener Daten. Dies beweist keinen Fehler, weist aber auf die Notwendigkeit zusätzlicher Überprüfung hin.

Mechanismen der Illusion: Warum Korrelation nicht gleich Kausalität ist und wie Störfaktoren falsche Muster erzeugen

Selbst überzeugende Daten können die Illusion eines Kausalzusammenhangs verbergen. Dies ist kritisch bei der Bewertung außergewöhnlicher Behauptungen, die sich oft auf Beobachtungen statt auf kontrollierte Experimente stützen. Mehr dazu im Abschnitt Logische Fehlschlüsse.

🔁 Korrelation vs. Kausalität: Klassische Fallen und moderne Methoden der Kausalinferenz

„Korrelation bedeutet nicht Kausalität" – ein bekanntes Prinzip, dessen Funktionsweise jedoch einer Analyse bedarf. Zwei Variablen korrelieren aus drei Gründen: A verursacht B, B verursacht A, oder eine dritte Variable C verursacht beide.

Moderne Methoden der Kausalinferenz – Instrumentalvariablen, Regression-Discontinuity-Design, synthetische Kontrolle – ermöglichen Kausalschlüsse aus Beobachtungsdaten. Sie erfordern jedoch starke Annahmen, die oft nicht überprüfbar sind. Die randomisierte kontrollierte Studie bleibt der Goldstandard: Zufällige Zuteilung der Teilnehmer schließt systematische Unterschiede aus.

🧩 Störfaktoren und versteckte Variablen: Wie ein dritter Faktor die Illusion erzeugt

Ein Störfaktor (Confounder) ist eine Variable, die sowohl mit der vermuteten Ursache als auch mit der Wirkung verbunden ist und so einen falschen Anschein eines Zusammenhangs zwischen ihnen erzeugt. Klassisches Beispiel: die Korrelation zwischen Eiskonsum und Ertrinkungsfällen. Beide werden durch Hitze verursacht – einen dritten Faktor.

Ein Störfaktor wirkt wie ein unsichtbarer Regisseur: Er treibt beide Variablen in dieselbe Richtung, und der Beobachter sieht nur ihre synchrone Bewegung und hält sie für Kausalität.

In der Medizin sind Störfaktoren besonders gefährlich. Patienten, die Vitamine einnehmen, sind oft nicht wegen der Vitamine gesünder, sondern weil sie sich bereits um ihre Gesundheit kümmern – Sport treiben, sich besser ernähren, regelmäßig Vorsorgeuntersuchungen wahrnehmen. Gesundheit verursacht die Vitamineinnahme, nicht umgekehrt.

Zur Kontrolle von Störfaktoren verwendet man Stratifizierung (Aufteilung in Untergruppen), Regressionsanalyse oder Matching. Alle diese Methoden erfordern jedoch, dass Sie den Störfaktor im Voraus kennen. Versteckte Variablen – solche, von denen Sie nichts ahnen – bleiben eine unsichtbare Bedrohung.

📊 Umgekehrte Kausalität und zyklische Zusammenhänge: Wenn die Wirkung zur Ursache wird

Umgekehrte Kausalität liegt vor, wenn die vermutete Wirkung tatsächlich die Ursache verursacht. Depression korreliert mit niedrigem Einkommen, aber niedriges Einkommen kann Depression verursachen, und Depression kann zu Arbeitsplatzverlust und Einkommensrückgang führen.

| Szenario | Sichtbare Korrelation | Wahrer Mechanismus | Wie prüfen |

|---|---|---|---|

| Vitamine und Gesundheit | Menschen, die Vitamine nehmen, sind gesünder | Gesunde Menschen nehmen Vitamine | Randomisiertes Experiment |

| Gebet und Genesung | Betende genesen häufiger | Weniger schwer erkrankte Patienten beten; Ärzte behandeln Gläubige besser | Kontrolle des Schweregrads, doppelblind |

| Soziale Medien und Einsamkeit | Aktive Nutzer sind einsamer | Einsame Menschen suchen Trost in Netzwerken | Längsschnittstudie mit Zeitverzögerung |

Zyklische Zusammenhänge verkomplizieren das Bild noch weiter. Armut verursacht Stress, Stress verringert kognitive Fähigkeiten, was den Ausweg aus der Armut erschwert. Das System verstärkt sich selbst, und es ist unmöglich, eine einzige Ursache zu benennen.

🎯 Selektionsverzerrung: Wenn die Datenauswahl selbst die Illusion erzeugt

Selektionsverzerrung (Selection Bias) entsteht, wenn die Art der Datenauswahl die Ergebnisse systematisch verzerrt. Wenn Sie die Wirksamkeit einer Behandlung nur bei Patienten untersuchen, die sie abgeschlossen haben, schließen Sie jene aus, die die Behandlung wegen Nebenwirkungen oder Unwirksamkeit abgebrochen haben.

Überlebende Patienten erscheinen gesünder, als sie tatsächlich sind. Dies nennt man Survivorship Bias. Bei außergewöhnlichen Behauptungen funktioniert Selektionsverzerrung besonders effektiv: Menschen, denen eine Wunderbehandlung geholfen hat, erzählen davon; jene, denen sie nicht geholfen hat, schweigen.

- Publikationsverzerrung

- Studien mit positiven Ergebnissen werden häufiger veröffentlicht als solche mit negativen. Dies erzeugt die Illusion, dass ein Effekt existiert, obwohl die Hälfte der Studien ihn nicht gefunden hat.

- Erinnerungsverzerrung

- Menschen erinnern sich besser an Ereignisse, die ihre Überzeugungen bestätigen. Wenn Sie an eine Wunderbehandlung glauben, erinnern Sie sich an Fälle, in denen sie funktioniert hat, und vergessen Fälle, in denen sie nicht half.

- Verzerrung durch multiples Testen

- Wenn Sie 100 Hypothesen prüfen, werden etwa 5 davon rein zufällig „signifikant" sein (bei einem Signifikanzniveau von 0,05). Wenn Sie nur diese 5 veröffentlichen, sieht der Leser 100% Erfolg.

Zur Kontrolle von Selektionsverzerrung müssen Ein- und Ausschlusskriterien vor Studienbeginn klar definiert, Intention-to-Treat-Analysen verwendet und Studien in offenen Registern registriert werden.

🔍 Wie man Kausalität von Illusion unterscheidet: Praktische Checkliste

- Gibt es eine alternative Erklärung durch einen Störfaktor? Nennen Sie drei mögliche dritte Faktoren.

- Könnte umgekehrte Kausalität vorliegen? Ist es logisch möglich, dass die Wirkung die Ursache verursacht?

- Wie wurden die Daten ausgewählt? Wer wurde eingeschlossen, wer ausgeschlossen, warum?

- Gibt es einen Mechanismus? Wenn A B verursacht, muss es eine biologische oder physikalische Ereigniskette geben.

- Ist es reproduzierbar? Wurde es in verschiedenen Populationen, Ländern, Zeiträumen gefunden?

- Gibt es eine Dosis-Wirkungs-Beziehung? Wenn mehr A, dann mehr B? Oder ist der Effekt bei jeder Menge von A gleich?

- Sagt es die Zukunft voraus? Wenn die Kausalität real ist, muss sie in neuen Daten funktionieren.

Außergewöhnliche Behauptungen bestehen oft nicht einmal die ersten drei Punkte dieser Liste. Das bedeutet nicht, dass sie falsch sind, aber es bedeutet, dass die Beweise für einen Kausalschluss unzureichend sind.