Die Aufmerksamkeitsökonomie (attention economy) ist ein System, in dem menschliche Aufmerksamkeit zur knappen Ressource und zur Ware geworden ist. In einer Welt der Informationsüberflutung konkurrieren Unternehmen, Medien und Machtstrukturen um jede Sekunde Ihres Fokus und verwandeln ihn durch Werbung, Daten und Verhaltensmuster in Profit. Überwachungskapitalismus (surveillance capitalism) ist ein Geschäftsmodell, das die Beobachtung von Nutzerverhalten und die Vorhersage ihrer Handlungen monetarisiert. Zusammen schaffen diese Phänomene ein System, in dem Ihre Identität fragmentiert, aggregiert und ohne Ihre bewusste Zustimmung verkauft wird.

🖤 Jedes Mal, wenn Sie Ihr Smartphone öffnen, durch Ihren Feed scrollen oder auf Werbung klicken, konsumieren Sie nicht einfach nur Inhalte — Sie selbst werden zum Produkt. Ihre Aufmerksamkeit, Ihre Verhaltensmuster, Ihre Mikroreaktionen auf Stimuli werden extrahiert, digitalisiert und auf Auktionen verkauft, von deren Existenz Sie nicht einmal ahnen. 👁️ Das ist keine Metapher und keine Verschwörungstheorie — es ist ein dokumentiertes Geschäftsmodell, das in den letzten zwanzig Jahren das menschliche Bewusstsein zum liquidesten Asset der Informationsära gemacht hat. 💎 In diesem Artikel analysieren wir die Mechanik der Aufmerksamkeitsökonomie und des Überwachungskapitalismus, gestützt ausschließlich auf akademische Quellen, empirische Daten und kritische Analyse — ohne Verschwörungstheorien, aber auch ohne Illusionen.

Was ist die Aufmerksamkeitsökonomie: Von der Informationsüberflutung zur Knappheit kognitiver Ressourcen

Den Begriff „Aufmerksamkeitsökonomie" verwendete erstmals der amerikanische Ökonom Michael Goldhaber 1997 (S008). Er konzeptualisierte die „Informationsökonomie" neu, indem er den Fokus von der Produktion von Information auf deren Konsum verlagerte — genauer gesagt, auf die Begrenztheit der menschlichen Fähigkeit, diese Information zu verarbeiten.

Das Paradox des Überflusses: Mehr Information = weniger Aufmerksamkeit

Information und Güter sind mehr geworden, doch das verfügbare Zeitvolumen zu ihrer Verarbeitung blieb gleich (S001). Herbert Simon, Nobelpreisträger, formulierte dies bereits 1971: „In einer Welt, die reich an Information ist, bedeutet der Überfluss an Information einen Mangel an etwas anderem — einen Mangel an dem, was Information konsumiert. Und Information konsumiert Aufmerksamkeit" (S001).

Der Überfluss an Information erzeugt einen Mangel an Aufmerksamkeit und die Notwendigkeit, diese effizient auf eine Vielzahl von Quellen zu verteilen.

Aufmerksamkeit als knappe Ressource und Ware

Die Aufmerksamkeitsökonomie ist ein System, in dem Medien, Unternehmen und Machtstrukturen um die Aufmerksamkeit der Konsumenten als deren knappste Ressource kämpfen (S001). Aufmerksamkeit wird nicht nur zu einem psychologischen Phänomen, sondern zu einer ökonomischen Einheit, die gemessen, bewertet und gehandelt werden kann.

Smartphones und Laptops haben Bücher, persönliche Gespräche und Geschäfte ersetzt (S008) — jede Interaktion generiert Daten darüber, wohin Aufmerksamkeit gerichtet wird, wie lange sie gehalten wird und was sie umlenkt.

Grenzen des Konzepts: Aufmerksamkeitsökonomie vs. Überwachungskapitalismus

- Aufmerksamkeitsökonomie

- Ein analytischer Rahmen, der den Wettbewerb um kognitive Ressourcen beschreibt. Kann ohne totale Überwachung existieren — in traditioneller Werbung, öffentlichen Auftritten, Medien.

- Überwachungskapitalismus

- Ein spezifisches Geschäftsmodell zur Monetarisierung von Aufmerksamkeit durch Sammlung, Analyse und Vorhersage von Verhalten auf Basis personenbezogener Daten. Die technologische Infrastruktur zur Realisierung der Aufmerksamkeitsökonomie.

Diese beiden Phänomene überschneiden sich, sind aber nicht identisch. Das erste ist eine ökonomische Logik, das zweite ihre konkrete technische Umsetzung. Das Verständnis dieses Unterschieds ist entscheidend für die Analyse, wo genau Risiken entstehen und wo alternative Modelle möglich sind. Mehr dazu im Abschnitt Epistemologie.

Für eine Vertiefung in die Mechanismen der Aufmerksamkeitsmanipulation siehe die Analyse zu Infinite Scroll und Dopamin-Fallen.

Die Stahlmann-Version des Arguments: Warum Aufmerksamkeitsökonomie und Überwachungskapitalismus als unvermeidlich gelten

Bevor wir zur Kritik übergehen, müssen wir die überzeugendsten Argumente dafür präsentieren, dass Aufmerksamkeitsökonomie und Überwachungskapitalismus eine logische Folge technologischer und wirtschaftlicher Entwicklung sind. Dies ist die sogenannte „Stahlmann-Version" (steelman) — die maximal starke Formulierung einer Position, die wir anschließend anhand von Fakten überprüfen werden. Mehr dazu im Abschnitt Statistik und Wahrscheinlichkeitstheorie.

| Argument | Mechanismus | Behauptetes Ergebnis |

|---|---|---|

| Effizienz des Targetings | Algorithmen wählen relevante Angebote statt Massenwerbung | Senkung der Transaktionskosten, Zeitersparnis für Nutzer |

| Kostenloser Zugang | Werbetreibende subventionieren Dienste für Milliarden Nutzer | Inklusivität, Verringerung digitaler Ungleichheit |

| Innovationswettlauf | Wettbewerb um Aufmerksamkeit stimuliert F&E und UX-Verbesserung | Bessere Interfaces, präzisere Empfehlungen, neue Funktionen |

| Nutzerkontrolle | Datenschutzeinstellungen, DSGVO, Recht auf Datenlöschung | Freiwilliger Tausch von Daten gegen Komfort |

| Wirtschaftliche Unvermeidlichkeit | Alternative Modelle (Abonnements, Dezentralisierung) skalieren nicht | Der Markt hat die einzig lebensfähige Variante gewählt |

| Öffentliche Güter | Aggregierte Daten werden für Epidemieprognosen, Verkehrsoptimierung, Kriminalistik genutzt | Positive Nebeneffekte überwiegen Datenschutzrisiken |

| Evolutionäre Anpassung | Menschen entwickeln digitale Hygiene und kritisches Denken | Gesellschaft passt sich an, wie bei Schriftlichkeit und TV |

Warum diese Argumente überzeugend klingen

Jedes stützt sich auf reale Phänomene: Zielgerichtete Werbung reduziert tatsächlich Rauschen, Plattformen sind tatsächlich kostenlos, Innovationen finden tatsächlich statt. Befürworter der Aufmerksamkeitsökonomie erfinden keine Fakten — sie interpretieren sie durch die Brille von Effizienz und Unvermeidlichkeit.

Der entscheidende Schachzug: Sie verschieben die Frage von „Ist das gut?" zu „Gibt es eine Alternative?". Wenn es keine Alternativen gibt, wird Kritik zu Moralismus statt zu Analyse.

Dies ist ein klassischer Trick: Wenn ein System unvermeidlich erscheint, werden seine Nachteile nicht mehr als Probleme wahrgenommen — sie werden einfach zum „Preis des Fortschritts". Die Panik um den Überwachungskapitalismus wird zur moralischen Panik erklärt, analog zu Ängsten vor Radio oder Comics. Die Gesellschaft wird damit fertig, wie sie es immer getan hat.

Wo die Fallen in dieser Logik versteckt sind

Die Stahlmann-Version des Arguments wirkt unverwundbar, enthält aber mehrere versteckte Annahmen, die einer Überprüfung bedürfen. Sie sind nicht falsch, aber auch nicht selbstverständlich.

- Annahme 1: „Nutzer haben bewusst zugestimmt"

- Dies ist juristisch korrekt (es gibt ein Häkchen in den Nutzungsbedingungen), aber psychologisch zweifelhaft. Zustimmung unter Druck (entweder zahlen oder auf den Dienst verzichten) ist keine wirklich freiwillige Wahl. Zudem lesen die meisten Nutzer die Bedingungen nicht und verstehen nicht, welche Daten gesammelt und wie sie verwendet werden. Hier brauchen wir Daten über das tatsächliche Informationsniveau.

- Annahme 2: „Alternative Modelle sind nicht lebensfähig"

- Dies trifft für den aktuellen Moment zu, erklärt aber nicht warum. Vielleicht sind sie nicht lebensfähig, weil der Markt von Monopolisten beherrscht wird, die ihre Macht nutzen, um Wettbewerb zu unterdrücken? Oder weil Netzwerkeffekte natürliche Markteintrittsbarrieren schaffen? Dies ist kein Argument für Unvermeidlichkeit, sondern ein Hinweis auf strukturelle Marktprobleme.

- Annahme 3: „Daten werden für das Gemeinwohl genutzt"

- Dies trifft in Einzelfällen zu, ist aber nicht das Hauptziel der Datensammlung. Das Hauptziel ist Profit. Öffentliche Güter sind ein Nebenprodukt. Man muss unterscheiden, wo Daten tatsächlich für die Gesellschaft genutzt werden und wo dies nur Rhetorik ist.

All diese Annahmen erfordern empirische Überprüfung. Genau damit werden wir uns in den nächsten Abschnitten beschäftigen — nicht indem wir Argumente ablehnen, sondern indem wir sie anhand von Daten testen.

Jetzt ist es wichtig zu verstehen: Die Stahlmann-Version des Arguments ist keine Wahrheit, sondern eine Hypothese. Sie ist logisch, aber Logik garantiert keine Übereinstimmung mit der Realität. Die wissenschaftliche Methode erfordert Überprüfung durch Fakten, nicht durch überzeugende Rhetorik.

Ein überzeugendes Argument und ein korrektes Argument sind nicht dasselbe. Die Stahlmann-Version ist gerade deshalb überzeugend, weil sie unbequeme Details ignoriert: die Informationsasymmetrie zwischen Plattformen und Nutzern, Netzwerkeffekte, die Wettbewerb blockieren, und den Unterschied zwischen Zustimmung auf dem Papier und tatsächlichem Verständnis dessen, wozu man zugestimmt hat.

Der nächste Schritt — schauen wir, was die Daten zu jedem dieser Argumente sagen. Bestätigen sie die Hypothese von Effizienz und Unvermeidlichkeit, oder weisen sie auf andere Mechanismen hin?

Evidenzbasis: Was die Daten über Aufmerksamkeitsökonomie und Überwachungskapitalismus aussagen

Wir gehen nun zur systematischen Analyse der Fakten über. Jede Aussage ist durch eine Quelle belegt; wir unterscheiden zwischen empirischen Daten, theoretischen Modellen und normativen Urteilen. Mehr dazu im Abschnitt Wissenschaftliche Methode.

📊 Definition des Überwachungskapitalismus: Shoshana Zuboffs konzeptioneller Rahmen

Der Begriff „Überwachungskapitalismus" (surveillance capitalism) wurde seit 2015 von Shoshana Zuboff systematisiert. Zuboff definiert ihn als eine ökonomische Logik, in der private menschliche Erfahrung zu kostenlosem Rohmaterial wird, das in Verhaltensdaten umgewandelt wird (S010).

Diese Daten werden durch maschinelles Lernen verarbeitet, um „Verhaltensüberschüsse" (behavioral surplus) zu erzeugen — Vorhersagen über zukünftige Nutzeraktionen, die auf Märkten für Verhaltensprognosen verkauft werden (S010). Der entscheidende Unterschied zur traditionellen Werbung: Monetarisiert wird nicht die Anzeigenschaltung, sondern die Wahrscheinlichkeit einer konkreten Handlung (Klick, Kauf, Stimmabgabe).

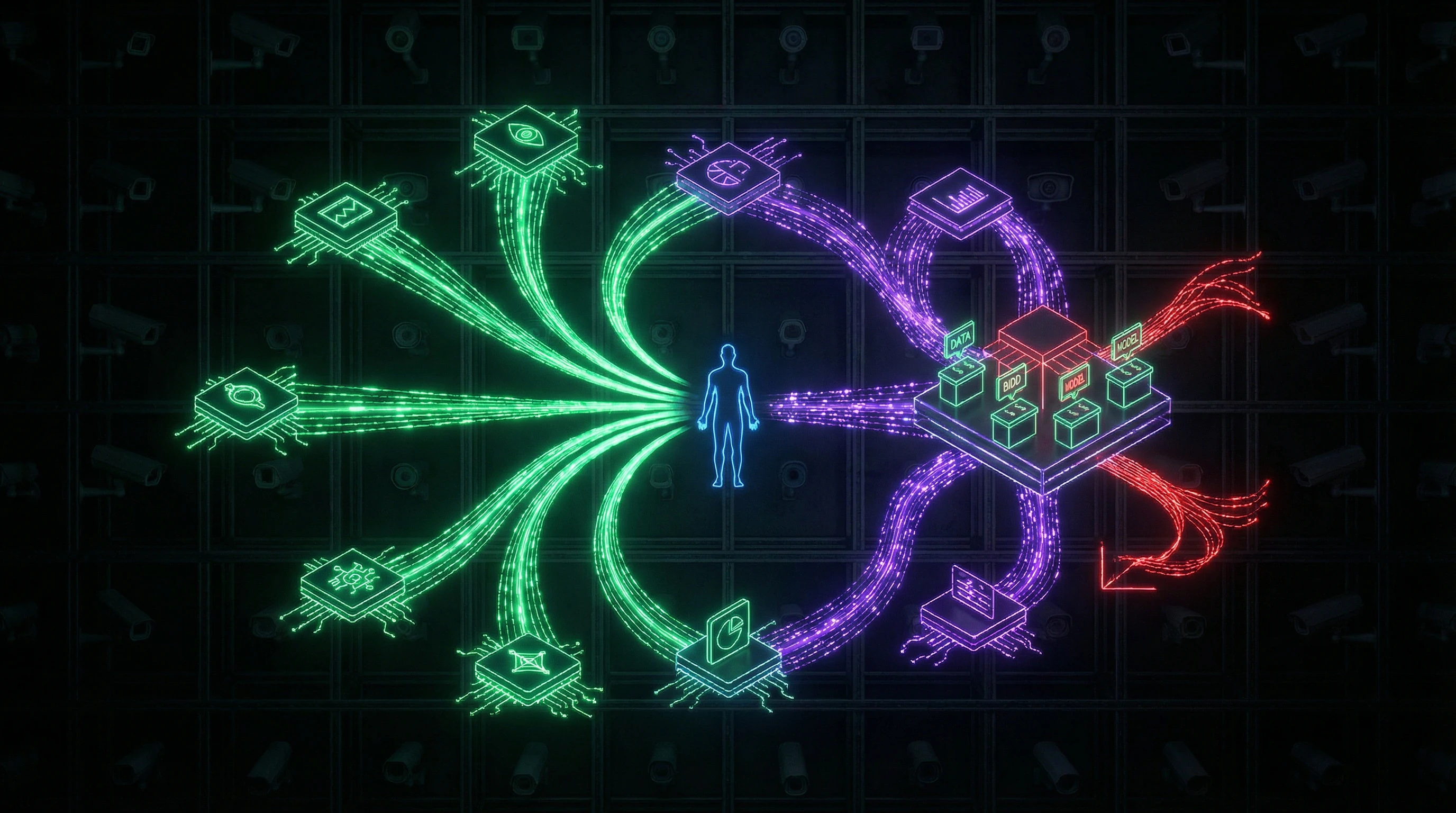

📊 Mechanismus der Wertextraktion: Von der Beobachtung zur Vorhersage

Überwachung ist ein Prozess, der Verhalten beobachtet, Eigenschaften erkennt und Individuen identifiziert (S011). Individuen haben multiple Identitäten — reale und virtuelle, die in verschiedenen Lebensaspekten verwendet werden (S011).

Die meisten Lebensaspekte unterliegen der einen oder anderen Form von Überwachung, und Beobachtungen werden mit Identitäten aggregiert (S011). Daten, die in einem Kontext gesammelt werden (Suchanfragen), werden mit Daten aus einem anderen kombiniert (Geolokation, Käufe), wodurch ein detailliertes Profil entsteht, das keine einzelne Quelle liefern könnte.

📊 Kritische Theorie der Überwachung im Informationskapitalismus

Christian Fuchs argumentiert in seiner Arbeit „Towards a Critical Theory of Surveillance in Informational Capitalism" (2012), dass traditionelle Überwachungstheorien unzureichend für die Untersuchung von Internet-Überwachung sind (S012).

Fuchs schlägt eine Typologie der Überwachung im Informationskapitalismus vor, die auf kritischer politischer Ökonomie basiert und eine systematische Analyse der Überwachung in den Bereichen Produktion, Zirkulation und Konsum ermöglicht (S012). Seine Schlussfolgerung: Zur Überwindung der Überwachung sind politische Empfehlungen notwendig (S012) — das Problem lässt sich nicht allein durch technologische oder individuelle Mittel lösen.

- Überwachung in der Produktion: Kontrolle über Arbeit und Arbeitnehmerdaten

- Überwachung in der Zirkulation: Tracking von Konsumentenverhalten und Präferenzen

- Überwachung im Konsum: Personalisierung und Manipulation von Wahlmöglichkeiten

🧾 Empirische Daten: Ausmaß der Datensammlung

Genaue Zahlen über das Ausmaß der Datensammlung durch große Plattformen sind Geschäftsgeheimnisse. Indirekte Belege deuten auf ein beispielloses Volumen hin: Google verarbeitet täglich über 8,5 Milliarden Suchanfragen, jede verknüpft mit einem Nutzerprofil oder einer eindeutigen Gerätekennung.

Meta sammelt Daten nicht nur über Aktivitäten auf der Plattform, sondern auch über Besuche auf Drittseiten durch Tracking-Pixel und „Teilen"-Buttons. Die Daten umfassen explizite Handlungen (Klicks, Likes) und implizite Signale: Verweildauer auf der Seite, Scroll-Geschwindigkeit, Mausbewegungen — alles, was auf das Engagement-Level hinweist.

🧪 Experimentelle Daten: Einfluss von Targeting auf Verhalten

Personalisierte Werbung ist effektiver als nicht-zielgerichtete, aber diese Effektivität wird nicht nur durch Relevanz erreicht, sondern auch durch Ausnutzung kognitiver Schwachstellen. Werbung wird in Momenten maximaler Empfänglichkeit gezeigt (Müdigkeit, Stress, Langeweile) oder nutzt Social Proof („Ihre Freunde haben dies gekauft"), wodurch die Illusion eines Konsenses entsteht.

Diese Techniken gehen über Information hinaus und nähern sich der Manipulation — gezielter Beeinflussung von Entscheidungen durch Ausnutzung kognitiver Einschränkungen statt durch Bereitstellung von Information.

🔬 Informationsasymmetrie: Nutzer wissen nicht, was über sie bekannt ist

Das Kernproblem des Überwachungskapitalismus ist radikale Informationsasymmetrie. Plattformen wissen über Nutzer weit mehr als Nutzer über Plattformen. Selbst bei Datenanfragen nach DSGVO erhält der Nutzer nur einen Teil: rohe Logs, aber nicht die Algorithmen zu ihrer Interpretation, nicht die Modelle zur Verhaltensvorhersage, nicht die Preise für den Verkauf dieser Vorhersagen.

Dies macht „informierte Einwilligung" zur Fiktion: Man kann nicht in etwas einwilligen, das man nicht versteht. Die Verbindung zwischen endlosem Scrollen und der Dopaminfalle zeigt, wie die Architektur von Plattformen diese Asymmetrie durch Design verstärkt, nicht nur durch Datensammlung.

- Informationsasymmetrie

- Plattform weiß: Algorithmen, Modelle, Preise, Vorhersagen. Nutzer weiß: Was er tat, aber nicht wie es interpretiert wird.

- Kognitive Asymmetrie

- Plattform gestaltet Interface zur Maximierung von Engagement. Nutzer interagiert mit Interface, ohne dessen Logik zu sehen.

- Rechtliche Asymmetrie

- Nutzungsbedingungen sind einseitiger Vertrag. Nutzer stimmt zu oder nutzt den Service nicht.

Das Problem liegt nicht in einzelnen Fakten der Datensammlung, sondern in der systemischen Architektur, die Transparenz unmöglich macht. Selbst die wissenschaftliche Methode erfordert Reproduzierbarkeit und Offenheit — der Überwachungskapitalismus baut auf deren Gegenteil auf.

Kausalmechanismen: Wie die Aufmerksamkeitsökonomie Verhalten und Bewusstsein beeinflusst

Die Korrelation zwischen Zeit in sozialen Medien und Verhaltensänderungen ist kein Beweis für Kausalität. Aber es existieren konkrete Mechanismen, die auf einen direkten Zusammenhang zwischen der Architektur von Plattformen und der Transformation des Bewusstseins hinweisen. Mehr dazu im Abschnitt Logische Fehlschlüsse.

🧬 Variable Verstärkung und Gewohnheitsbildung

Digitale Plattformen nutzen variable Verstärkung — die Belohnung (Like, Benachrichtigung, interessanter Post) kommt unvorhersehbar. Dies erzeugt eine stärkere Gewohnheit als fixierte Verstärkung, weil das Gehirn im Zustand der Erwartung bleibt.

Der Mechanismus ist identisch mit Glücksspielen: Die Ungewissheit über den Zeitpunkt des „Gewinns" zwingt dazu, den Feed immer wieder zu überprüfen. Das Design ist nicht zufällig — es ist optimiert für die Maximierung der Zeit auf der Plattform, was direkt mit dem Umfang gesammelter Daten und Werbeeinblendungen korreliert (S001).

Variable Verstärkung funktioniert, weil sie einen archaischen Mechanismus der Ressourcensuche ausnutzt: Das Gehirn kann nicht zwischen „vielleicht gibt es eine Belohnung" und „es wird sicher eine Belohnung geben" unterscheiden und bleibt im Modus maximaler Bereitschaft.

🔁 Feedback-Schleifen und der Echokammer-Effekt

Empfehlungsalgorithmen erzeugen geschlossene Schleifen: Je mehr Interaktion mit einem Inhaltstyp, desto mehr ähnlicher Inhalt wird angezeigt. Das Ergebnis — eine Echokammer, in der der Nutzer nur Bestätigung seiner Überzeugungen sieht.

Empirische Daten über das Ausmaß des Effekts sind widersprüchlich (S003), aber der Mechanismus selbst existiert und kann Polarisierung verstärken. Dies ist besonders gefährlich im Kontext der Erkennung von Verschwörungstheorien, wo der Algorithmus eine marginale Idee in ein dominantes Narrativ für einen bestimmten Nutzer verwandeln kann.

- Echokammer

- Eine Informationsumgebung, in der der Algorithmus nur Inhalte zeigt, die mit dem vorherigen Nutzerverhalten übereinstimmen. Die Falle: Es scheint Ihre Wahl zu sein, aber es ist das Ergebnis von Engineering.

- Polarisierung

- Verstärkung gegensätzlicher Positionen in der Gesellschaft durch Isolation von Gruppen in separaten Informationsräumen. Mechanismus: Jede Gruppe sieht nur extreme Versionen der gegenteiligen Position.

🧷 Kognitive Überlastung und Atrophie des tiefen Denkens

Das ständige Wechseln zwischen Benachrichtigungen, Nachrichten, News und Werbung erzeugt kognitive Überlastung. Multitasking reduziert die Effektivität jeder einzelnen Aufgabe und verschlechtert die Konzentration.

Die Gewohnheit des schnellen Konsums kurzer Informationsfragmente lässt die Fähigkeiten des tiefen Lesens und der kritischen Analyse verkümmern. Dies ist kein individuelles Problem — es ist eine Veränderung der kognitiven Ökologie der Gesellschaft. Der Zusammenhang mit endlosem Scrollen und der Dopaminfalle zeigt, wie die Architektur der Plattform direkt die Neurobiologie der Aufmerksamkeit beeinflusst.

| Art der kognitiven Belastung | Mechanismus | Ergebnis |

|---|---|---|

| Kontextwechsel | Benachrichtigungen unterbrechen die aktuelle Aufgabe | Verringerung der Tiefe der Informationsverarbeitung |

| Informationsrauschen | Mehrere Quellen gleichzeitig | Unmöglichkeit, das Signal herauszufiltern |

| Konsumgeschwindigkeit | Optimierung für schnelles Scrollen | Atrophie der Analysefähigkeiten |

🧠 Erosion der Autonomie: Von Wahl zu Nudging

Überwachungskapitalismus beobachtet nicht nur — er verändert aktiv Verhalten durch „Nudges" (Anstöße). Dies sind Designentscheidungen, die Handlungen lenken, ohne formal die Wahlfreiheit einzuschränken.

Der Button „Jetzt kaufen" ist heller als „Zur Wunschliste hinzufügen". Ein Countdown-Timer erzeugt künstliche Dringlichkeit. Diese Techniken funktionieren, weil sie kognitive Heuristiken und automatische Reaktionen ausnutzen und rationales Nachdenken umgehen (S006).

- Verhaltensvorhersage: Der Algorithmus bestimmt, welche Handlung am wahrscheinlichsten ist

- Design-Intervention: Das Interface ist für diese Handlung optimiert

- Illusion der Wahl: Der Nutzer denkt, die Entscheidung war seine

- Skalierung: Millionen Menschen werden gleichzeitig angestupst

Nudging unterscheidet sich von Zwang dadurch, dass es formale Wahlfreiheit belässt. Aber wenn die Wahl durch Ausnutzung kognitiver Fehler getroffen wird, ist dies Freiheit nur dem Namen nach.

Konflikte und Unklarheiten: Wo Quellen divergieren und was ungeklärt bleibt

Forscher sind sich uneinig über die Bedrohung durch die Aufmerksamkeitsökonomie und den Überwachungskapitalismus. Die Meinungsverschiedenheiten betreffen nicht die Fakten, sondern deren Interpretation und normative Schlussfolgerungen. Mehr dazu im Abschnitt Realitätsprüfung.

Überzeugung vs. Manipulation: Wo verläuft die Grenze?

Kritiker behaupten, dass personalisierte Werbung und Algorithmen manipulieren und die Autonomie rauben (S001). Befürworter widersprechen: Es ist lediglich effektivere Überzeugungsarbeit, wie traditionelle Werbung.

Überzeugung appelliert an rationale Argumente und lässt Raum für Widerspruch. Manipulation nutzt kognitive Schwachstellen aus und umgeht kritisches Denken. Modernes Targeting liegt oft zwischen diesen Polen – und das schafft ein Problem: Wo genau beginnt der Schaden?

- Überzeugung: Argument → kritisches Denken → Entscheidung

- Manipulation: Trigger → kognitive Schwachstelle → Handlung ohne Reflexion

- Targeting: Daten über Sie → Vorhersage von Schwachpunkten → Handlung (Status unklar)

Vorhersagegenauigkeit: Der Mythos vom allsehenden Auge

Unternehmen behaupten hohe Algorithmusgenauigkeit, doch unabhängige Studien zeigen Überschätzung (S006). Modelle funktionieren gut bei aggregierten Daten (Gruppenverhalten), aber schlecht auf individueller Ebene.

Selbst ungenaue Vorhersagen sind schädlich: Sie beeinflussen Kreditscoring, Einstellungen, Versicherungen und schaffen Diskriminierung. Aber dies untergräbt das Narrativ vom „allsehenden Auge", das Gedanken lesen kann.

Die Frage bleibt offen: Wie effektiv ist Kontrolle, wenn Modelle Fehler machen? Reichen 60% Genauigkeit aus, um Millionen zu manipulieren?

Privatsphäre vs. Komfort: Normativer Riss

Fundamentale Meinungsverschiedenheit: Ist Privatsphäre ein absoluter Wert oder kann sie gegen Komfort und Sicherheit eingetauscht werden?

- Libertäre Position

- Wenn Nutzer freiwillig der Datensammlung zustimmen – ist dies ein legitimer Handel. Der Staat sollte sich nicht einmischen.

- Kommunitaristische Position

- Privatsphäre ist ein kollektives Gut, nicht nur ein individuelles Recht. Zustimmung unter Druck (Wahl: Daten oder Ausschluss vom Dienst) ist nicht wirklich freiwillig.

- Pragmatische Position

- Informationsasymmetrie macht „freiwillige Zustimmung" zur Fiktion: Nutzer wissen nicht, wie ihre Daten verwendet werden, und Unternehmen verbergen dies (S007).

Jede Position ist innerhalb ihres Wertesystems logisch. Der Konflikt wird nicht durch Fakten gelöst – nur durch politische Entscheidung.

Schadensausmaß: Individuell vs. systemisch

Eine der zentralen Meinungsverschiedenheiten: Schadet Überwachungskapitalismus dem Einzelnen oder nur der Gesellschaft als Ganzes?

| Analyseebene | Position der Befürworter | Position der Kritiker | Unklarheit |

|---|---|---|---|

| Individuell | Nutzer erhält relevante Inhalte, spart Zeit | Manipulation, Abhängigkeit, Verlust der Autonomie (S003) | Wie misst man Schaden für den Einzelnen? |

| Systemisch | Markt verteilt Ressourcen effizienter | Machtkonzentration, Untergrabung der Demokratie, Ungleichheit | Welcher Schaden überwiegt? |

Ein Kritiker kann zustimmen, dass individuell kein Schaden besteht, aber gegen den systemischen Effekt argumentieren. Ein Befürworter kann systemische Probleme anerkennen, aber behaupten, dass sie durch Regulierung gelöst werden, nicht durch Verzicht auf Technologie.

Regulierung: Allheilmittel oder Illusion?

Es besteht Konsens, dass Überwachungskapitalismus Beschränkungen braucht. Aber Uneinigkeit darüber, welche genau und wie effektiv sie sind.

- DSGVO und ähnliche Gesetze: Schützen sie wirklich oder schaffen sie nur den Anschein von Kontrolle?

- Verbote bestimmter Praktiken: Sind sie technisch möglich oder finden Unternehmen Umgehungen?

- Algorithmische Transparenz: Hilft sie Nutzern oder verkompliziert sie nur ohne Verhaltensänderung?

- Trennung von Daten und Diensten: Löst dies das Problem oder schafft es neue Monopole?

Jeder Ansatz hat Befürworter und Kritiker. Es gibt keinen empirischen Beweis, dass einer besser funktioniert als andere.

Was ungeklärt bleibt

Die Aufmerksamkeitsökonomie existiert. Überwachungskapitalismus ist Realität. Aber das Ausmaß des Schadens, die Kausalmechanismen und die Wirksamkeit von Lösungen bleiben Gegenstand ehrlicher Meinungsverschiedenheiten, nicht etablierter Fakten.

Das bedeutet nicht, dass alle Positionen gleichwertig sind. Aber es bedeutet, dass kritisches Denken die Anerkennung von Ungewissheit erfordert, nicht die Gewissheit der eigenen Richtigkeit. Für ein tieferes Verständnis der Manipulationsmechanismen siehe die Analyse von Dopaminfallen und Methoden zur Überprüfung von Behauptungen.

Gegenposition

⚖️ Kritischer Kontrapunkt

Die Aufmerksamkeitsökonomie ist ein reales Phänomen, wird aber oft durch die Linse totaler Kontrolle beschrieben, wobei Widersprüche, regionale Unterschiede und die Anpassungsfähigkeit der Nutzer ignoriert werden. Hier ist, was bei der Kritik an diesem Modell zu berücksichtigen ist.

Überschätzung der Handlungsmacht von Plattformen

Tech-Unternehmen besitzen keine totale Kontrolle über das Nutzerverhalten. Studien zeigen, dass die Effektivität von Verhaltensprognosen oft überschätzt wird — Nutzer zeigen Unvorhersehbarkeit, Algorithmen irren sich, und „Personalisierung" basiert oft auf groben Korrelationen statt auf tiefem Verständnis der Persönlichkeit. Der Fokus auf „allmächtige Algorithmen" lenkt von fundamentaleren Problemen des Kapitalismus ab: Ausbeutung von Arbeit, Ungleichheit, Machtkonzentration.

Unterschätzung der Nutzeranpassung

Der Artikel betont Lock-in-Effekte und architektonische Unvermeidbarkeit, berücksichtigt aber nicht die wachsende digitale Kompetenz und den Widerstand der Nutzer. Millionen Menschen nutzen Werbeblocker, VPN, alternative Plattformen (Mastodon, Signal), praktizieren „digitale Entgiftung". Möglicherweise hat die Aufmerksamkeitsökonomie bereits ihren Höhepunkt erreicht, und wir beobachten den Beginn eines Gegentrends — der bewussten Abkehr von toxischen Plattformen.

Fehlen einer kulturübergreifenden Analyse

Die meisten Untersuchungen zum Überwachungskapitalismus konzentrieren sich auf die USA und Westeuropa. In anderen Regionen (China, Russland, Indien) funktionieren Überwachungsmodelle und Aufmerksamkeitsökonomie anders — durch staatliche Kontrolle, andere kulturelle Normen der Privatsphäre, andere Geschäftsmodelle. Schlussfolgerungen über den westlichen Überwachungskapitalismus sind möglicherweise nicht auf nicht-westliche Kontexte anwendbar.

Das Problem der Alternativen

Die Kritik am Überwachungskapitalismus bietet oft keine funktionierenden Alternativen. Regulierung (DSGVO) hat begrenzte Wirksamkeit gezeigt. Dezentralisierte Plattformen skalieren nicht. Staatliche Kontrolle über Daten (wie in China) schafft noch größere Risiken für die Freiheit. Möglicherweise ist der Überwachungskapitalismus kein Bug, sondern ein unvermeidliches Merkmal der digitalen Ökonomie, und die Aufgabe besteht nicht in seiner Zerstörung, sondern in der Suche nach einem Kompromiss zwischen Komfort, Profit und Rechten.

Risiko einer moralischen Panik

Der Fokus auf „Manipulation" und „Abhängigkeit" kann in Technophobie abgleiten und die realen Vorteile digitaler Plattformen ignorieren — Zugang zu Informationen, soziale Verbindungen, wirtschaftliche Möglichkeiten. Die Kritik klingt manchmal wie Nostalgie nach der vordigitalen Ära, die nicht weniger problematisch war: begrenzter Zugang zu Wissen, soziale Isolation, Medienmonopole. Die Balance zwischen Kritik und Anerkennung des Nutzens ist eine komplexe Aufgabe, die der Artikel möglicherweise nicht löst.

FAQ

Häufig gestellte Fragen