Was ist „algorithmische Radikalisierung" und warum dieser Begriff zur Waffe in Informationskriegen wurde

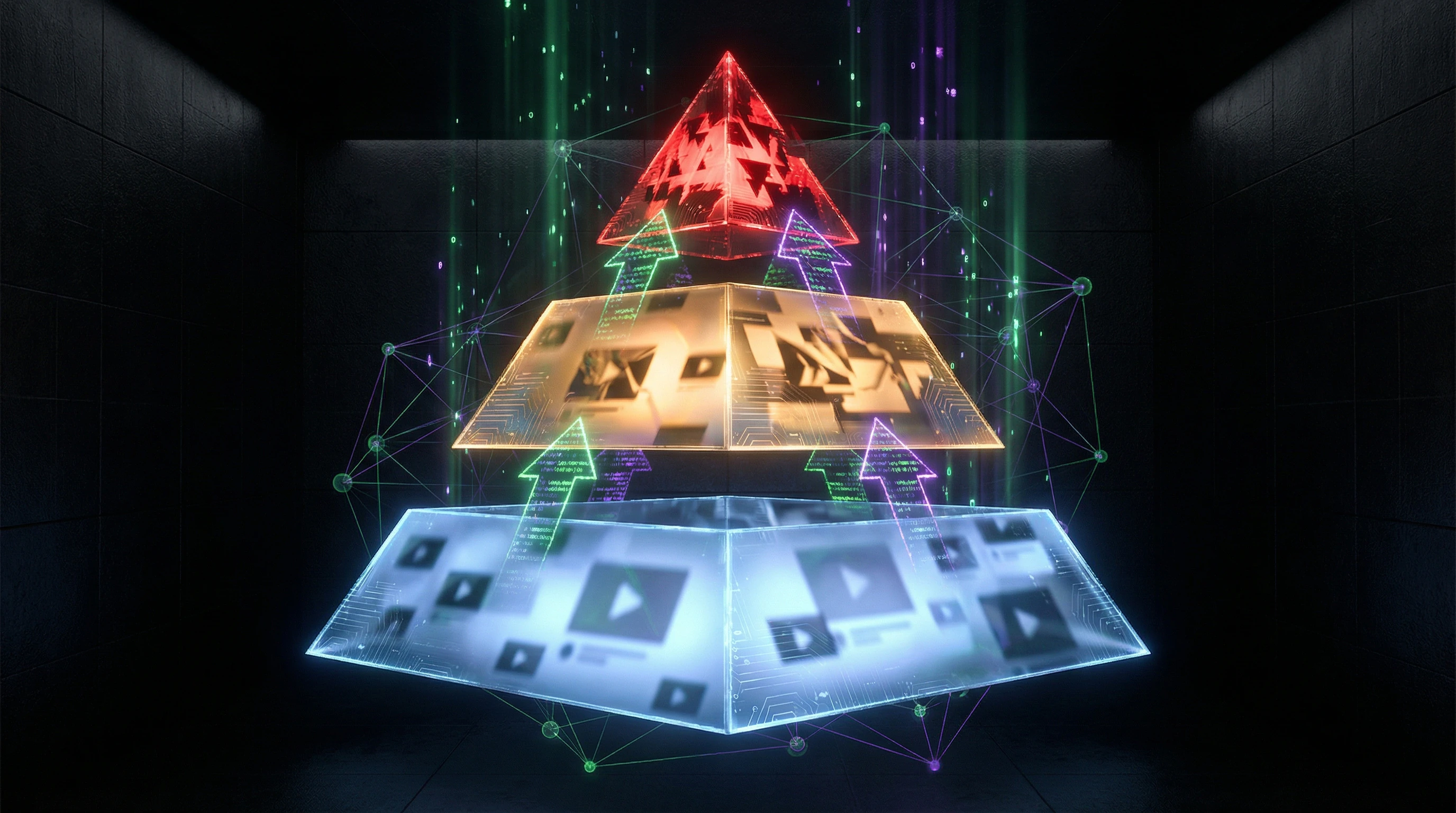

Der Begriff „algorithmische Radikalisierung" beschreibt einen hypothetischen Prozess, bei dem Empfehlungssysteme von Videoplattformen Nutzer systematisch von moderaten Inhalten zu extremistischen lenken – durch eine Kette zunehmend radikalisierender Empfehlungen. Das Konzept der „Radikalisierungs-Pipeline" (radicalization pipeline) geht von einem vorhersehbaren Pfad aus: Ein Nutzer beginnt mit Mainstream-Politik-Content, der Algorithmus empfiehlt provokanteres Material, dann offen extremistische Inhalte, bis die Person in einer Informationsblase radikaler Ideen landet (S010).

Dieses Narrativ wurde zentral in Debatten über Aufmerksamkeitsökonomie und Plattformverantwortung. Doch hinter der Popularität des Konzepts verbirgt sich eine methodologische Krise: Die meisten Studien unterscheiden nicht zwischen Korrelation und Kausalität, stützen sich auf anekdotische Belege statt quantitative Daten und ignorieren alternative Erklärungen.

Drei Komponenten des Pipeline-Narrativs

- Content-Hierarchie

- Es existiert eine klare Leiter vom Moderaten zum Extremistischen: Intellectual Dark Web (I.D.W.) – Intellektuelle, die progressive Agenda kritisieren; Alt-lite – rechte Populisten mit provokanter Rhetorik; Alt-right – offene Befürworter weißer Vorherrschaft und Antisemitismus (S010).

- Aktive Förderung von Übergängen

- Der YouTube-Algorithmus empfiehlt radikaleren Content an Nutzer, die moderate Inhalte ansehen, und schafft so einen gerichteten Fluss von einer Kategorie zur nächsten.

- Systematik des Prozesses

- Dieser Mechanismus funktioniert nicht zufällig, sondern ist der Haupttreiber von Online-Radikalisierung auf der Plattform.

Radikalisierung als wissenschaftliches Konzept: jenseits von technologischem Determinismus

Radikalisierung wird definiert als „Prozess, in dem ein Individuum oder eine Gruppe extremistische ideologische Überzeugungen und/oder die Bereitschaft annimmt, Gewalt zur Erreichung politischer Ziele einzusetzen" (S002). Entscheidende Unterscheidung: Radikalisierung der Ansichten ist nicht gleich Radikalisierung des Handelns.

Forschung zeigt, dass Radikalisierung ein multifaktorieller Prozess ist, der persönliche Prädispositionen, soziales Umfeld, politischen Kontext und auslösende Ereignisse umfasst (S005). Der Versuch, dieses komplexe Phänomen auf die mechanische Wirkung eines Empfehlungsalgorithmus zu reduzieren, vereinfacht das Problem auf technologischen Determinismus.

Radikalisierung der Ansichten ist nicht gleich Radikalisierung des Handelns. Das Ansehen provokanter Inhalte ist nicht dasselbe wie die Annahme extremistischer Ideologie oder Gewaltbereitschaft.

Methodologische Falle: Anekdoten statt Daten

Die meisten Publikationen über die „Radikalisierungs-Pipeline" auf YouTube stützen sich auf qualitative Methoden: Analyse einzelner Fälle, Interviews mit ehemaligen Extremisten, journalistische Recherchen. Typisches Beispiel – die Geschichte einer Person, die behauptet, „YouTube habe sie durch Empfehlungen in die Alt-right gezogen". Mehr dazu im Abschnitt Grundlagen der Erkenntnistheorie.

Diese Narrative besitzen starke emotionale Wirkung, können aber keinen Beweis für einen systematischen Effekt liefern. Das Repräsentativitätsproblem bleibt ungelöst: Wie viele Nutzer erhielten dieselben Empfehlungen, radikalisierten sich aber nicht? Wie hoch ist die Basisrate der Radikalisierung unter Nutzern, die solche Empfehlungen nicht erhielten?

| Frage | Erforderliche Antwort | Status in der Literatur |

|---|---|---|

| Wie hoch ist der Anteil der Nutzer, die Empfehlungen erhielten, sich aber nicht radikalisierten? | Quantitative Daten mit Kontrollgruppe | Fehlt |

| Unterscheidet sich die Radikalisierungstrajektorie bei Nutzern mit Empfehlungen von jenen ohne? | Vergleichsanalyse mit Variablenkontrolle | Selten |

| Welche Rolle spielen vorherige Überzeugungen des Nutzers bei der Content-Auswahl? | Analyse von Selektionsverzerrung | Wird ignoriert |

Ohne Kontrollgruppe und quantitative Daten ist es unmöglich, Korrelation von Kausalität zu trennen. Das ist kein methodologischer Pedantismus – es ist das Fundament, auf dem die gesamte Beweislogik aufbaut (S010).

Die Stahlmann-Version des Arguments: Sieben überzeugende Belege für die algorithmische Pipeline

Bevor wir die Gegenargumente zur „Radikalisierungspipeline"-Hypothese untersuchen, müssen wir zunächst die stärksten Argumente dafür ehrlich darstellen. Intellektuelle Redlichkeit erfordert die Konstruktion einer „Stahlmann-Version" (steelman) der gegnerischen Position – keine Karikatur, sondern die überzeugendste mögliche Formulierung. Mehr dazu im Abschnitt Epistemologie.

🔥 Erstes Argument: Die ökonomische Logik der Engagement-Maximierung führt unweigerlich zur Radikalisierung

Das Geschäftsmodell von YouTube basiert auf der Maximierung der Wiedergabezeit, was sich direkt auf die Werbeeinnahmen auswirkt. Der Algorithmus ist darauf optimiert vorherzusagen, welches Video den Nutzer am längsten auf der Plattform hält.

Emotional aufgeladener, provokanter Inhalt erzeugt höheres Engagement als nuancierter und ausgewogener. Radikaler Inhalt ist ein „Superstimulus" für ein auf Engagement ausgerichtetes System. Dies ist keine böse Absicht der Entwickler, sondern eine unvermeidliche Folge der Optimierungsfunktion.

Der strukturelle Anreiz des Algorithmus, zunehmend provokantes Material zu empfehlen, ist in die Architektur einer auf Aufmerksamkeitsökonomie ausgerichteten Plattform eingebaut.

📈 Zweites Argument: Das dokumentierte Wachstum extremistischer Kanäle korreliert mit Änderungen des Empfehlungsalgorithmus

Forscher dokumentieren ein explosives Wachstum des Publikums rechtspopulistischer und extremistischer Kanäle auf YouTube im Zeitraum 2015–2018 (S002, S003). Dieses Wachstum fällt mit Änderungen des Empfehlungsalgorithmus zusammen, die YouTube zur Erhöhung der Wiedergabezeit implementierte.

Alt-lite- und Alt-right-Kanäle berichteten von einem starken Anstieg der Abonnenten und Aufrufe speziell durch Empfehlungen, nicht durch Suche oder externe Links. Die zeitliche Korrelation zwischen Algorithmusänderungen und dem Wachstum extremistischer Inhalte deutet auf einen kausalen Zusammenhang hin.

🎯 Drittes Argument: Zeugnisse ehemaliger Extremisten über die Rolle von YouTube bei ihrer Radikalisierung

Zahlreiche Menschen, die eine Deradikalisierung durchlaufen haben, beschreiben YouTube als Schlüsselfaktor bei ihrer ideologischen Verschiebung (S004). Sie berichten detailliert, wie sie mit Videos über Feminismus oder Immigration begannen, Empfehlungen radikalerer Kritiker dieser Phänomene erhielten und dann offen rassistische Inhalte.

Diese Zeugnisse stimmen untereinander überein und beschreiben ein wiederkehrendes Muster. Sie als „anekdotisch" abzutun bedeutet, die gelebte Erfahrung von Menschen zu ignorieren, die direkt mit dem Phänomen konfrontiert waren.

- Beginn: Videos über soziale Phänomene (neutraler Inhalt)

- Empfehlungen: Kritik mit schärferem Blickwinkel

- Vertiefung: offen ideologisierter Inhalt

- Ergebnis: Übergang in extremistische Communities

🧬 Viertes Argument: Psychologische Mechanismen der Personalisierung verstärken den Echokammer-Effekt

Der Personalisierungsalgorithmus erstellt für jeden Nutzer einen einzigartigen Empfehlungsfeed basierend auf der Wiedergabehistorie. Wenn ein Nutzer beginnt, Inhalte einer bestimmten ideologischen Ausrichtung anzusehen, interpretiert der Algorithmus dies als Präferenz und empfiehlt mehr ähnliche Inhalte.

Dies erzeugt einen Echokammer-Effekt: Der Nutzer begegnet immer seltener alternativen Standpunkten und taucht immer tiefer in eine ideologische Blase ein. Personalisierung verwandelt gelegentliches Interesse in eine sich selbst verstärkende Rückkopplungsschleife.

🌐 Fünftes Argument: Plattformübergreifende Daten zeigen, dass YouTube die Hauptverkehrsquelle für extremistische Websites ist

Die Analyse des Referral-Traffics auf extremistische Websites und Foren zeigt, dass YouTube eine der größten Quellen neuer Besucher ist (S005). Nutzer wechseln von YouTube zu Plattformen wie 4chan, 8chan, Gab, wo die Radikalisierung in intensiverer Form fortgesetzt wird.

YouTube fungiert als „Trichter" – es zieht ein breites Publikum mit moderaten Inhalten an und leitet dann die empfänglichsten Nutzer in das Ökosystem extremistischer Plattformen. Ohne YouTube hätten viele dieser Nutzer nie die Existenz radikaler Communities entdeckt.

🛠️ Sechstes Argument: Interne YouTube-Dokumente bestätigen, dass das Unternehmen von dem Problem wusste

Journalistische Recherchen und Leaks interner Dokumente zeigen, dass YouTube-Mitarbeiter die Geschäftsführung wiederholt davor warnten, dass der Empfehlungsalgorithmus extremistische Inhalte fördert (S008). Ingenieure schlugen Änderungen vor, die diesen Effekt verringern würden, aber die Geschäftsführung lehnte sie ab aus Sorge, dass dies Engagement und Einnahmen verringern würde.

Dies belegt, dass das Problem real ist und innerhalb des Unternehmens anerkannt wurde, aber wirtschaftliche Interessen ethische Überlegungen überwogen.

⚖️ Siebtes Argument: Massenschützen und Terroristen zitierten YouTube als Radikalisierungsquelle

In Manifesten und Erklärungen mehrerer Massenmörder der letzten Jahre wird YouTube als Plattform erwähnt, auf der sie mit der Ideologie der weißen Vorherrschaft oder Antisemitismus in Kontakt kamen (S006). Der Schütze von Christchurch, der Terrorist von Pittsburgh und andere Täter beschrieben ihren Radikalisierungsweg, der mit dem Ansehen von Videos auf YouTube begann.

Wenn extremistische Gewalt direkt mit einer Plattform in Verbindung gebracht wird, erfordert dies eine ernsthafte Auseinandersetzung mit der Hypothese algorithmischer Radikalisierung, unabhängig von statistischen Daten. Die Verbindung zwischen Technologie und realem Schaden wird unbestreitbar.

Quantitative Prüfung: Was die größte Studie zu 2 Millionen YouTube-Empfehlungen zeigte

Im Jahr 2019 führten Forscher der Eidgenössischen Technischen Hochschule Lausanne die erste groß angelegte quantitative Untersuchung der „Radikalisierungs-Pipeline"-Hypothese auf YouTube durch. Die auf der ACM FAT*-Konferenz (Fairness, Accountability, and Transparency) veröffentlichte Arbeit analysierte über 2 Millionen Video- und Kanalempfehlungen, die zwischen Mai und Juli 2019 gesammelt wurden (S003).

Diese Studie markierte einen Wendepunkt in der Debatte, da sie erstmals groß angelegte empirische Daten anstelle anekdotischer Belege lieferte. Mehr dazu im Abschnitt Logische Fehlschlüsse.

Methodik: Wie Forscher das Ökosystem politischer Inhalte kartierten

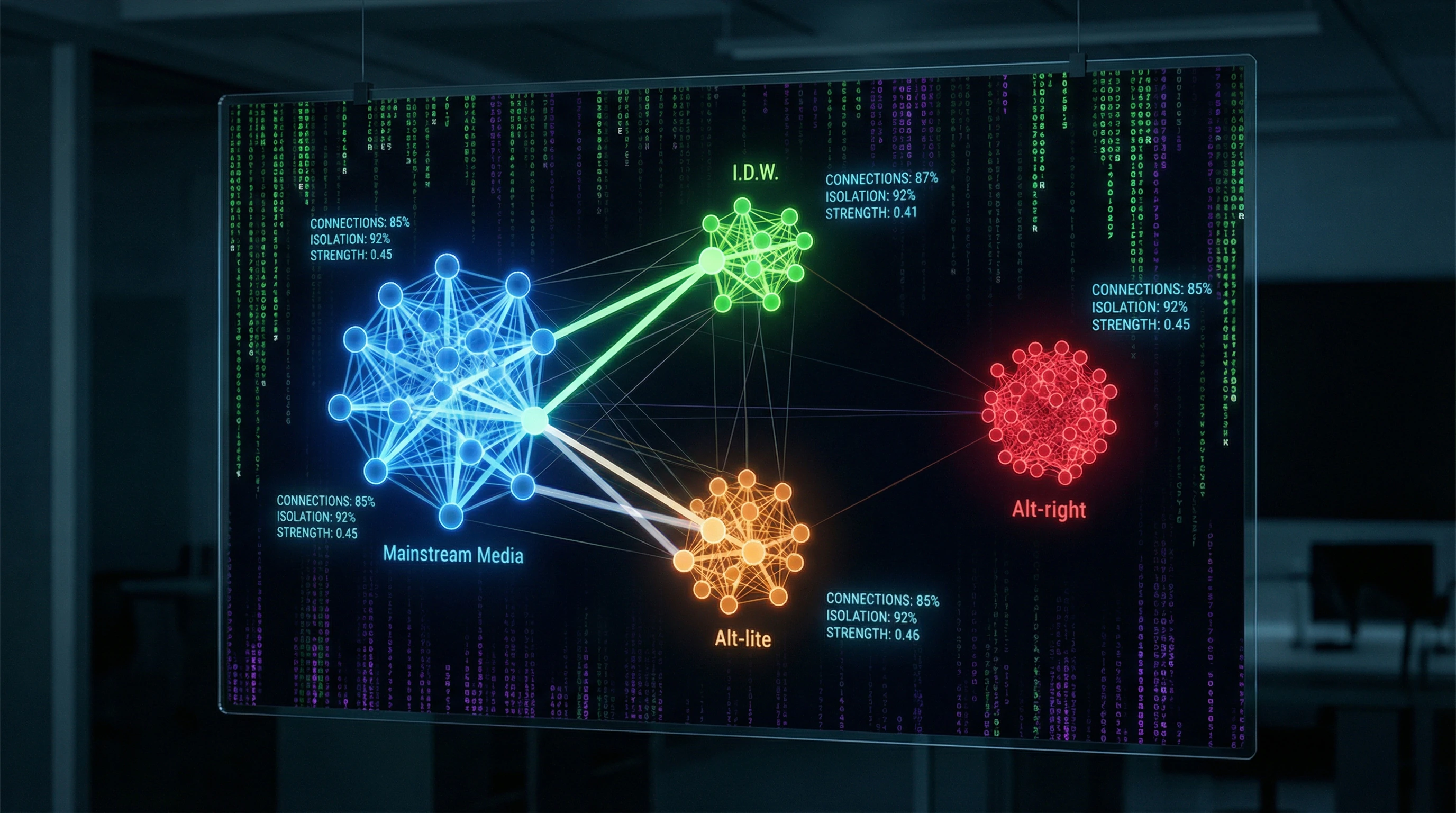

Die Forscher erstellten einen Datensatz aus 792 Kanälen, aufgeteilt in vier Kategorien: Media (Mainstream-Nachrichtenkanäle); Intellectual Dark Web – Intellektuelle, die progressive Ideologie kritisieren; Alt-lite (rechte Populisten mit provokanter Rhetorik); Alt-right (offene Befürworter weißer Vorherrschaft) (S003).

Für jeden Kanal wurden zwei Arten von Empfehlungen gesammelt: Video-Empfehlungen (welche Videos YouTube nach dem Ansehen vorschlägt) und Kanalempfehlungen (welche Kanäle YouTube auf der Kanalseite vorschlägt). Analysiert wurde die Wahrscheinlichkeit von Übergängen zwischen Kategorien durch Empfehlungen.

Zentrales Ergebnis: Fehlen substanzieller Beweise für eine systematische Pipeline

Die Hauptschlussfolgerung der Studie: Zum Zeitpunkt 2019 existierten keine substanziellen quantitativen Beweise für die vermutete Pipeline (S003). Die Analyse zeigte, dass YouTubes Video-Empfehlungen äußerst selten Nutzer von moderaten zu extremistischen Inhalten leiten.

Alt-right-Inhalte erscheinen praktisch nicht in Video-Empfehlungen, selbst für Nutzer, die Alt-lite oder Intellectual Dark Web ansehen. Das bedeutet, der Algorithmus schafft keinen automatischen Pfad von moderaten zu extremistischen Inhalten.

Die Forscher stellten fest, dass Alt-lite-Inhalte von Intellectual Dark Web-Kanälen durch Empfehlungen erreichbar sind, aber Alt-right-Videos nur über Kanalempfehlungen erreichbar sind, nicht über Empfehlungen spezifischer Videos (S003).

Nuance: Unterschied zwischen Video-Empfehlungen und Kanalempfehlungen

Die Studie identifizierte einen kritischen Unterschied zwischen zwei Arten von Empfehlungen:

| Empfehlungstyp | Sichtbarkeit für Nutzer | Verbindung zwischen Kategorien | Erforderliche Aktion |

|---|---|---|---|

| Video-Empfehlungen | Seitenleiste, Videoende (hoch) | Schwach | Passives Ansehen |

| Kanalempfehlungen | Kanalseite (niedrig) | Stark zwischen I.D.W., Alt-lite, Alt-right | Aktiver Wechsel zur Kanalseite |

Kanalempfehlungen erfordern eine gezielte Nutzeraktion – den Wechsel zur Kanalseite und das Durchsehen des Empfehlungsbereichs. Dies ist kein passives „Fließband", sondern das Ergebnis aktiver Suche nach ähnlichen Inhalten.

Zeitliche Dynamik: Algorithmusänderungen nach öffentlichem Druck

Die Studie wurde 2019 durchgeführt, nachdem YouTube Änderungen am Empfehlungsalgorithmus als Reaktion auf Kritik vorgenommen hatte. Im Januar 2019 kündigte YouTube Maßnahmen zur Reduzierung von Empfehlungen „grenzwertiger Inhalte" an – Material, das die Plattformregeln nicht verletzt, aber an der Grenze liegt.

Das bedeutet, die Studie erfasst den Zustand des Algorithmus nach Korrekturen, nicht im Zeitraum 2015–2018, als die „Pipeline" vermutlich am aktivsten war. Kritiker der Studie weisen darauf als Einschränkung hin: Möglicherweise existierte die Pipeline früher, wurde aber zum Zeitpunkt der Untersuchung bereits beseitigt.

Der Zusammenhang zwischen Aufmerksamkeitsökonomie und Plattformdesign zeigt, dass Algorithmusänderungen oft öffentlichem Druck folgen, statt ihm vorauszugehen. Dies schafft ein methodologisches Problem: Studien, die nach Korrekturen durchgeführt wurden, können Hypothesen über das Algorithmusverhalten in der Vergangenheit weder vollständig bestätigen noch widerlegen.

Mechanismus oder Mythos: Warum die Korrelation zwischen Konsum und Radikalisierung keine Kausalität beweist

Selbst wenn Studien zeigen würden, dass Nutzer, die extremistische Inhalte auf YouTube ansehen, sich tatsächlich radikalisieren, würde dies nicht beweisen, dass der Empfehlungsalgorithmus die Ursache der Radikalisierung ist. Mehr dazu im Abschnitt Kognitive Verzerrungen.

Das fundamentale Problem: Korrelation ist nicht gleich Kausalität. Die Beobachtung eines Zusammenhangs zwischen zwei Phänomenen sagt nichts über die Richtung des Einflusses oder über das Vorhandensein dritter Faktoren aus.

🔁 Das Problem der umgekehrten Kausalität: Radikalisierung geht dem Konsum voraus, folgt ihm nicht

Menschen, die bereits radikale Ansichten haben oder dafür prädisponiert sind, suchen aktiv nach entsprechenden Inhalten auf YouTube. Der Algorithmus treibt sie nicht zum Extremismus – er befriedigt lediglich effizient eine bestehende Nachfrage.

Radikalisierungsforschung zeigt, dass der Prozess üblicherweise mit persönlichen Erfahrungen, sozialem Umfeld oder politischen Ereignissen beginnt, nicht mit Medienkonsum (S002, S005). Online-Inhalte können bereits existierende Ansichten verstärken und legitimieren, schaffen sie aber selten von Grund auf.

- Nutzer erlebt persönliche Krise (ökonomisch, sozial, identitätsbezogen)

- Prädisposition für bestimmte Erklärungen und Gemeinschaften entsteht

- Aktive Suche nach Inhalten, die dieser Prädisposition entsprechen

- Algorithmus empfiehlt relevantes Material (weil der Nutzer danach sucht)

- Beobachter sieht Korrelation und schreibt sie fälschlicherweise dem Algorithmus zu

🧬 Störvariablen: Drittvariablen, die sowohl Konsum als auch Radikalisierung erklären

Zahlreiche Faktoren beeinflussen gleichzeitig die Inhaltswahl und die Radikalisierung: Autoritarismus, Bedürfnis nach kognitivem Abschluss, soziale Isolation, ökonomische Instabilität, politische Polarisierung in der Gesellschaft.

| Störvariable | Einfluss auf Inhaltskonsum | Einfluss auf Radikalisierung |

|---|---|---|

| Wirtschaftskrise | Suche nach Erklärungen in Verschwörungstheorien | Statusbedrohung, Suche nach Feindbildern |

| Soziale Isolation | Online-Gemeinschaften als Ersatz | Anfälligkeit für Gruppeneinfluss |

| Autoritäre Persönlichkeitsmerkmale | Präferenz für klare Hierarchien und Feindbilder | Empfänglichkeit für autoritäre Narrative |

Ohne Kontrolle dieser Störvariablen ist es unmöglich, den Effekt des Algorithmus zu isolieren. Eine Person, die eine Wirtschaftskrise durchlebt, kann gleichzeitig Erklärungen in Verschwörungstheorien suchen und entsprechende Inhalte ansehen. Der Algorithmus hat ihre Vulnerabilität nicht geschaffen – er hat lediglich Inhalte bereitgestellt, die mit bereits existierenden Ängsten resonieren.

🎲 Das Selektionsproblem: Wer wird Gegenstand von Radikalisierungsstudien

Die meisten qualitativen Studien über die Rolle von YouTube bei der Radikalisierung basieren auf Interviews mit Menschen, die bereits Radikalisierung und Deradikalisierung durchlaufen haben. Dies erzeugt einen systematischen Survivorship Bias.

- Survivorship Bias im Kontext der Radikalisierung

- Wir hören die Geschichten derer, die sich radikalisiert haben, aber nicht die Geschichten von Millionen Nutzern, die ähnliche Inhalte angesehen haben und sich nicht radikalisiert haben. Möglicherweise hat YouTube extremistische Inhalte Millionen Menschen empfohlen, aber radikalisiert haben sich nur jene, die bereits eine Prädisposition hatten.

- Basisrate

- Ohne zu wissen, wie viele Menschen Empfehlungen erhielten, sich aber nicht radikalisierten, ist es unmöglich, den tatsächlichen Effekt des Algorithmus zu bewerten. Wenn sich 0,01% der Empfänger radikalisiert haben, ist das etwas völlig anderes, als wenn sich 50% radikalisiert hätten.

⚙️ Algorithmische Macht und moralische Verantwortung: Der philosophische Aspekt der Kausalität

Philosophische Untersuchungen algorithmischer Macht werfen die Frage auf, ob man Algorithmen überhaupt eine kausale Rolle in sozialen Prozessen zuschreiben kann (S007). Ein Algorithmus ist ein Werkzeug, das die Ziele seiner Schöpfer umsetzt und die Präferenzen der Nutzer widerspiegelt.

Die Zuschreibung einer autonomen Fähigkeit zur „Radikalisierung" von Menschen an den Algorithmus anthropomorphisiert Technologie und verlagert Verantwortung. Die tatsächlichen Akteure: Entwickler, die die Optimierungsfunktion gewählt haben; Führungskräfte, die Profit über Sicherheit priorisiert haben; Nutzer, die die Entscheidung treffen, bestimmte Inhalte anzusehen. Der Diskurs über „algorithmische Radikalisierung" kann als bequeme Möglichkeit dienen, komplexeren Fragen über die sozialen Ursachen von Extremismus und über die Aufmerksamkeitsökonomie auszuweichen, die Polarisierung unabhängig vom Algorithmus fördert.

Konflikte in der Evidenzbasis: Wo Studien divergieren und was das bedeutet

Die wissenschaftliche Literatur zur Rolle von YouTube bei der Radikalisierung zeigt erhebliche Diskrepanzen in den Schlussfolgerungen. Diese Diskrepanzen sind nicht zufällig — sie spiegeln fundamentale Unterschiede in Methodik, Zeitrahmen und geografischem Umfang wider. Mehr dazu im Abschnitt Quellen und Evidenz.

🧪 Qualitativ versus quantitativ: Warum die Methodik die Ergebnisse bestimmt

Qualitative Studien, die auf Interviews und Einzelfallanalysen basieren, stützen die Hypothese der „Radikalisierungspipeline" (S002). Quantitative Studien, die große Datensätze zu Empfehlungen analysieren, finden keine substanziellen Belege für einen systematischen Effekt (S001, S003).

Diese Diskrepanz offenbart eine Falle in der Dateninterpretation: Qualitative Methoden weisen die Existenz des Phänomens nach (ja, manche Menschen radikalisieren sich über YouTube), bewerten aber nicht dessen Verbreitung. Quantitative Methoden bewerten die Häufigkeit, können aber Nuancen individueller Verläufe übersehen.

Die zentrale Frage: Ist algorithmische Radikalisierung ein systematischer Effekt, der einen signifikanten Anteil der Nutzer betrifft, oder eine seltene Ausnahme, die aufgrund der Dramatik einzelner Fälle unverhältnismäßige Aufmerksamkeit erhält?

Der Zusammenhang zur Aufmerksamkeitsökonomie ist hier direkt: Seltene, aber extreme Ereignisse erhalten mehr Medienberichterstattung, was die Illusion ihrer Häufigkeit erzeugt.

📅 Der Zeitfaktor: Algorithmusänderungen und Evolution des Problems

Studien aus verschiedenen Zeiträumen kommen zu unterschiedlichen Ergebnissen, weil sich der Untersuchungsgegenstand selbst verändert hat. Arbeiten aus den Jahren 2015–2018 dokumentieren einen stärkeren „Pipeline"-Effekt als Studien von 2019–2020, nach der Implementierung von YouTube-Maßnahmen zur Reduzierung von Empfehlungen grenzwertiger Inhalte (S007).

Dies schafft ein methodologisches Problem: Wir können nicht einfach die Ergebnisse von Studien aus verschiedenen Zeiträumen mitteln, da sie unterschiedliche Versionen des Algorithmus beschreiben. Es ist entscheidend, zwischen Aussagen darüber zu unterscheiden, wie der Algorithmus in der Vergangenheit funktionierte, und Aussagen darüber, wie er heute funktioniert.

| Zeitraum | Charakter der Ergebnisse | Grund für Unterschiede |

|---|---|---|

| 2015–2018 | Starker „Pipeline"-Effekt | Algorithmus auf Engagement optimiert, ohne Extremismusfilter |

| 2019–2020 | Schwacher oder fehlender Effekt | Maßnahmen zur Reduzierung von Empfehlungen grenzwertiger Inhalte implementiert |

| 2021–2024 | Erfordert neue Studien | Weitere Änderungen im Empfehlungssystem |

🌍 Geografische und sprachliche Limitationen: Das Generalisierungsproblem

Die überwiegende Mehrheit der Studien fokussiert sich auf englischsprachige Inhalte und Nutzer aus den USA und Westeuropa. Empfehlungsmuster können in anderen sprachlichen und kulturellen Kontexten erheblich variieren.

Studien zur Radikalisierung in Zentralasien zeigen, dass Online-Propaganda eine Rolle spielt, ihre Wirksamkeit aber stark vom lokalen politischen und sozialen Kontext abhängt (S005). Die Verallgemeinerung von Schlussfolgerungen aus englischsprachigem Material auf das globale YouTube-Publikum ist methodologisch inkorrekt.

- Englischsprachiger Kontext

- Hohe Inhaltskonkurrenz, entwickeltes Moderationssystem, Vielfalt alternativer Plattformen. Der Algorithmus könnte weniger radikalisierend sein, einfach weil der Wettbewerb um Aufmerksamkeit höher ist.

- Nicht-englischsprachige Kontexte

- Weniger Moderation, weniger alternative Plattformen, homogenere Zielgruppen. Möglicherweise funktioniert die „Radikalisierungspipeline" anders oder effektiver.

- Schlussfolgerung

- Globale Aussagen über YouTube erfordern Studien, die mindestens 5–10 Sprachen und kulturelle Kontexte abdecken. Die aktuelle Evidenzbasis leistet dies nicht.

Der Zusammenhang zur Epistemologie ist offensichtlich: Wir können keine universellen Schlussfolgerungen aus lokalen Daten ziehen, ohne explizit die Grenzen der Anwendbarkeit anzugeben.

Kognitive Anatomie des Mythos: Welche mentalen Fallen die „Pipeline"-Erzählung so überzeugend machen

Warum hat sich die „Radikalisierungs-Pipeline"-Hypothese so weit verbreitet, trotz fehlender überzeugender quantitativer Beweise? Die Antwort liegt in kognitiven Verzerrungen, die diese Erzählung psychologisch unwiderstehlich machen. Mehr dazu im Abschnitt Astrologie.

Die erste Verzerrung ist die Illusion der Kausalität. Wenn jemand sieht, dass eine Person politische Videos angeschaut und danach radikale Ansichten geäußert hat, verknüpft das Gehirn die Ereignisse automatisch kausal. Dabei werden Drittvariablen ignoriert: vorherige Überzeugungen, soziales Umfeld, Lebensumstände.

Der YouTube-Algorithmus wird zum Sündenbock für Phänomene, die lange vor seinem Erscheinen existierten. Das ist kognitiv ökonomisch: Statt komplexe soziale Realitäten zu analysieren, zeigen wir auf einen einzigen Knopf.

Die zweite ist der Bestätigungsfehler. Forscher und Journalisten suchen nach Beispielen für Radikalisierung durch YouTube und finden sie. Aber sie zählen nicht die Millionen Menschen, die dieselben Videos ansehen und moderat bleiben. (S003) zeigte genau das: Empfehlungen schaffen keinen radikalen Pfad, sie verstärken ihn für bereits Prädisponierte.

- Eine Person mit radikalen Ansichten sucht nach Inhalten, die ihren Überzeugungen entsprechen

- Der Algorithmus empfiehlt ähnliche Inhalte (das ist seine Aufgabe)

- Der Beobachter sieht eine Kette von Videos und schlussfolgert: Der Algorithmus hat die Person radikalisiert

- In Wirklichkeit: Der Algorithmus spiegelte eine bereits existierende Trajektorie wider

Die dritte ist die narrative Attraktivität. Die „Pipeline"-Geschichte hat eine klare Struktur: Bösewicht (Algorithmus), Opfer (Nutzer), Rettung (Regulierung). Das ist ein Archetyp, der in Medien, Politik und Wissenschaft funktioniert. Verschwörungstheorien siegen oft über nüchterne statistische Befunde, gerade weil sie die bessere Geschichte erzählen.

Die vierte ist moralische Panik. Jedes neue Kommunikationsmedium löst Ängste aus: Der Buchdruck soll die Jugend verdorben haben, das Fernsehen Menschen passiv gemacht, das Internet die Gesellschaft zerstört haben. YouTube geriet in diesen Zyklus. (S002) dokumentiert, wie sich das Medien-Narrativ über die „rabbit hole" bildete, bevor Daten vorlagen.

- Halo-Effekt

- Wenn eine Quelle (Forscher, Journalist, Organisation) in einem Bereich Autorität besitzt, erscheinen ihre Aussagen in einem anderen überzeugender. Informatiker sprechen über Algorithmen – klingt nach Fakt, obwohl es Spekulation sein kann.

- Verfügbarkeitsheuristik

- Dramatische Radikalisierungsgeschichten sind leichter zu erinnern als Statistiken über 99% der Nutzer, die sich nicht radikalisierten. Das Gehirn nutzt Verfügbarkeit als Proxy für Häufigkeit.

Die fünfte ist institutionelles Interesse. Forscher erhalten leichter Finanzierung für Projekte über „Algorithmen-Gefahren" als über „Algorithmen funktionieren wie erwartet". Journalisten schreiben leichter Artikel über Bedrohungen als über deren Abwesenheit. Politiker regulieren leichter einen sichtbaren Feind als soziale Probleme zu lösen.

Das ist keine Verschwörung – das sind strukturelle Anreize. Die Aufmerksamkeitsökonomie belohnt Sensationalismus. Das Wissenschaftssystem belohnt Neuheit. Politik belohnt einfache Lösungen.

Das Ergebnis: Das „Pipeline"-Narrativ wird selbsterhaltend. Jede neue Studie wird, selbst wenn sie die Hypothese widerlegt, als Bestätigung interpretiert. (S007) nutzte kontrafaktische Bots und zeigte, dass YouTube-Empfehlungen keine Radikalisierung verursachen. Doch die Schlussfolgerung wird oft umformuliert zu „YouTube kann radikalisieren, wenn die Bedingungen günstig sind" – was nicht mehr falsifizierbar ist.

Kognitive Immunologie erfordert hier eines: zwischen „Algorithmus kann existierende Trends verstärken" und „Algorithmus erzeugt Radikalisierung" zu unterscheiden. Ersteres ist wahrscheinlich. Letzteres ist nicht bewiesen. Und dieser Unterschied ist bedeutsam für Politik, Forschung und Ihr eigenes Denken.