Was ist der Black-Box-Fehlschluss und warum reduziert er sich nicht auf simples Nichtwissen über Funktionsmechanismen

Der Black-Box-Fehlschluss (black box fallacy) ist eine kognitive Verzerrung, bei der eine Person eine extreme Bewertung eines Systems (vollständiges Vertrauen oder vollständige Ablehnung) ausschließlich auf Basis der Intransparenz seiner inneren Funktionsweise bildet und dabei empirische Daten über dessen Wirksamkeit, Zuverlässigkeit und Anwendungskontext ignoriert. Mehr dazu im Bereich Kritisches Denken.

Das ist nicht einfach Nichtwissen — es ist die Ersetzung der Ergebnisanalyse durch die Analyse der Informationsverfügbarkeit über den Prozess.

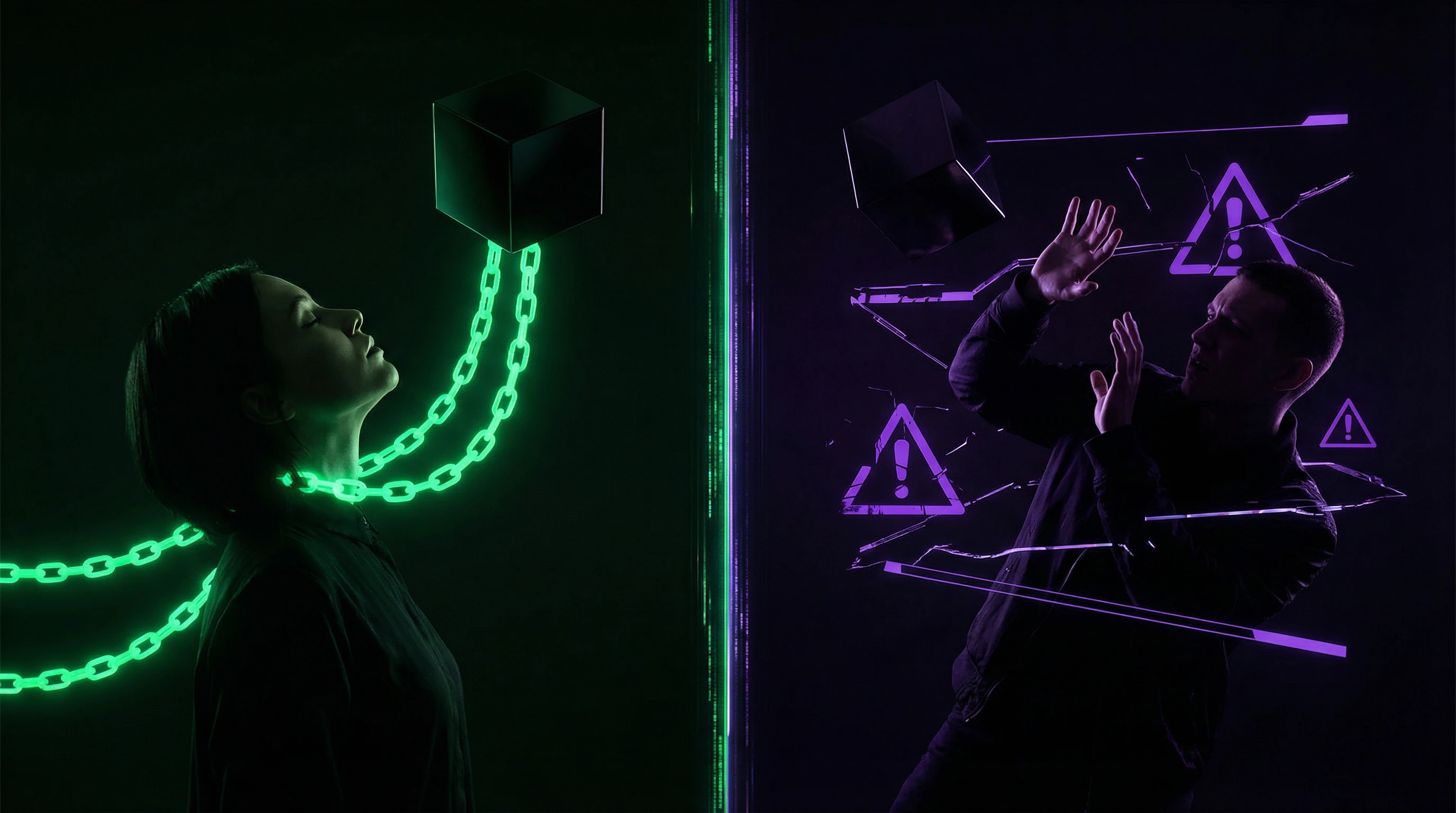

🧩 Zwei Pole eines Fehlschlusses: blindes Vertrauen und paranoide Ablehnung

Der Fehlschluss manifestiert sich in zwei gegensätzlichen Formen. Die erste — blindes Vertrauen in die Autorität der Intransparenz: „Das ist ein komplexes System, ich verstehe nicht, wie es funktioniert, also muss es richtig sein". Die zweite — paranoide Ablehnung: „Ich sehe nicht, was drin ist, also ist es Betrug/Gefahr/Manipulation".

Beide Formen vereint die Substitution: Statt die Validität der Ausgabedaten, die Reproduzierbarkeit der Ergebnisse und die Eignung des Systems für die Aufgabe zu bewerten, bewertet die Person nur den Grad ihres Verständnisses des Mechanismus.

⚠️ Warum das nicht dasselbe ist wie die Verfügbarkeitsheuristik oder der Halo-Effekt

Der Black-Box-Fehlschluss unterscheidet sich von verwandten kognitiven Verzerrungen. Die Verfügbarkeitsheuristik arbeitet mit der Leichtigkeit des Abrufs von Beispielen aus dem Gedächtnis. Der Halo-Effekt überträgt die Bewertung einer Eigenschaft auf andere.

- Black-Box-Fehlschluss

- wird genau durch die Intransparenz des Prozesses aktiviert und führt zum Ignorieren empirischer Daten über Ergebnisse. Eine Person kann wissen, dass ein System in 30% der Fälle irrt, ihm aber weiterhin vertrauen, weil „der Algorithmus komplex ist". Oder umgekehrt: Ein System zeigt 95% Genauigkeit, wird aber abgelehnt, weil „unklar ist, wie es das macht".

🔎 Anwendungsgrenzen des Begriffs: wo der Fehlschluss vorliegt und wo nicht

Nicht jede Nutzung eines intransparenten Systems ist ein Fehlschluss. Wenn Sie Aspirin einnehmen, ohne den Mechanismus der Cyclooxygenase-Hemmung zu kennen, sich aber auf Meta-Analysen zur Wirksamkeit und das Sicherheitsprofil stützen — das ist rationale Delegation an Expertise.

| Szenario | Entscheidungsgrundlage | Ist es ein Fehlschluss? |

|---|---|---|

| Arzt verschreibt Medikament nur weil „es eine neue Entwicklung ist, der Mechanismus ist komplex" | Intransparenz des Prozesses | Ja — ignoriert fehlende RCTs |

| Patient lehnt Impfstoff mit nachgewiesener Wirksamkeit ab | „Verstehe nicht, was da drin ist" | Ja — verdrängt Evidenzanalyse |

| Patient nimmt Medikament auf Basis von Meta-Analysen, ohne Mechanismus zu kennen | Empirische Daten über Ergebnisse | Nein — rationale Delegation |

Der Fehlschluss entsteht, wenn Intransparenz zum einzigen oder hauptsächlichen Bewertungskriterium wird und die Evidenzanalyse verdrängt.

Fünf stärkste Argumente dafür, dass Intransparenz von Systemen tatsächlich ein Vertrauensproblem schafft

Bedenken bezüglich intransparenter Systeme sind nicht unbegründet. Es bestehen reale Risiken, wenn Entscheidungen an Systeme delegiert werden, deren innere Funktionsweise nicht überprüfbar ist. Mehr dazu im Abschnitt Statistik und Wahrscheinlichkeitstheorie.

🧪 Argument 1: Unmöglichkeit von Audits und Reproduzierbarkeit der Ergebnisse in kritischen Bereichen

Wenn ein System Entscheidungen trifft, die Leben und Gesundheit beeinflussen (medizinische Diagnostik, gerichtliche Risikobewertungsalgorithmen, Steuerungssysteme kritischer Infrastruktur), schafft die Unmöglichkeit, seine Logik zu auditieren, ein echtes Verantwortungsproblem.

Wenn ein Algorithmus empfiehlt, eine Bewährung abzulehnen oder eine Chemotherapie zu verordnen, aber niemand erklären kann, auf Basis welcher Merkmale die Entscheidung getroffen wurde, ist es unmöglich, systematische Fehler oder Voreingenommenheit zu erkennen, bevor sie Schaden anrichten.

🔬 Argument 2: Die Medizingeschichte ist voll von „funktionierenden" Methoden, die sich als schädlich erwiesen

Aderlass „funktionierte" jahrhundertelang — Patienten genasen manchmal, Ärzte beobachteten Korrelationen. Die Lobotomie erhielt den Nobelpreis. Thalidomid bestand klinische Studien.

Intransparenz des Mechanismus in Kombination mit beobachtbarem Effekt garantiert keine Sicherheit. Die Forderung nach Verständnis des Mechanismus ist eine Lektion der Geschichte: Korrelation ohne Verständnis der Kausalität kann Schäden maskieren, die sich später oder unter anderen Bedingungen manifestieren.

📊 Argument 3: Algorithmische Systeme können verborgene Voreingenommenheit reproduzieren und verstärken

Intransparente Machine-Learning-Modelle, die auf historischen Daten trainiert wurden, kodieren rassistische, geschlechtsspezifische und sozioökonomische Voreingenommenheit, ohne diese explizit zu machen.

- Ein Kreditrisikobewertungssystem kann nach Postleitzahl diskriminieren

- Ein Recruiting-System — nach Namen

- Ein medizinisches Diagnosesystem — nach Zugang zu früheren Untersuchungen

Ohne Transparenz lassen sich diese Voreingenommenheiten nicht erkennen und korrigieren, bevor das System skaliert wird.

⚠️ Argument 4: Informationsasymmetrie schafft Raum für Manipulation

Wenn der Systementwickler dessen Einschränkungen kennt, der Nutzer aber nicht, entsteht das klassische Problem asymmetrischer Information. Ein Hersteller diagnostischer KI kann wissen, dass das System nur bei bestimmten demografischen Gruppen oder Bildtypen funktioniert, es aber als universelle Lösung verkaufen.

Ohne Transparenz der Methodik, Trainingsdaten und Validierung kann der Nutzer die tatsächliche Anwendbarkeit des Systems auf seinen Kontext nicht bewerten. Dies ist besonders gefährlich in der Techno-Esoterik, wo Intransparenz oft als Marker vermeintlicher „Fortschrittlichkeit" dient.

🧠 Argument 5: Delegation von Entscheidungen an intransparente Systeme lässt Expertise verkümmern

Wenn Ärzte beginnen, sich auf Empfehlungen eines Entscheidungsunterstützungssystems zu verlassen, ohne dessen Logik zu verstehen, verlieren sie allmählich die Fähigkeit, eigenständig Entscheidungen zu treffen. Dies schafft Fragilität: Bei Systemausfall, Nichtverfügbarkeit oder Anwendung in ungewöhnlichen Situationen ist der Experte hilflos.

- Intransparenz beschleunigt die Atrophie, weil sie keine Möglichkeit zum Lernen durch Verständnis der Systemlogik lässt

- Der Experte verliert die Fähigkeit, Empfehlungen kritisch zu bewerten

- Die Organisation wird abhängig von einer Black Box, statt Kompetenz zu entwickeln

Was systematische Reviews und Meta-Analysen über die tatsächliche Wirksamkeit intransparenter Systeme in Medizin und Bildung sagen

Beim Übergang von Argumenten zu Beweisen müssen zwei Fragen getrennt werden: Funktionieren intransparente Systeme (empirische Wirksamkeit) und lassen sie sich transparent machen, ohne an Wirksamkeit zu verlieren (technische Machbarkeit). Meta-Analysen der letzten Jahre geben auf beide Fragen überraschende Antworten.

📊 KI-Chatbots zeigen in kontrollierten Studien höhere Empathie als Ärzte

Ein systematischer Review, der KI-Chatbots und medizinische Fachkräfte im Kontext der Empathie in der Patientenversorgung vergleicht, offenbarte ein Paradoxon: Unter kontrollierten Bedingungen zeigten KI-Systeme höhere Werte wahrgenommener Empathie als menschliche Ärzte (S004). Das bedeutet nicht, dass KI „fühlt" – strukturierte, konsistente, ungehastete Antworten des Algorithmus wurden von Patienten als aufmerksamer wahrgenommen als eilige Konsultationen überlasteter Fachkräfte.

Die Intransparenz des Mechanismus hinderte das System nicht daran, den Menschen bei einem messbaren Qualitätskriterium der Interaktion zu übertreffen.

🧪 Klinische Entscheidungsunterstützungssysteme (CDSS) verbessern die diagnostische Genauigkeit bei korrekter Integration

Die Analyse der Wirksamkeit von CDSS zeigt signifikante Verbesserungen der diagnostischen Genauigkeit und Reduktion ärztlicher Fehler, jedoch nur bei korrekter Integration in den klinischen Prozess und Schulung des Personals (S010). Der Schlüsselfaktor ist nicht die Transparenz des Algorithmus, sondern die Transparenz des Nutzungsprozesses: Der Arzt muss verstehen, welche Daten das System berücksichtigt, welche Einschränkungen es hat, wie Empfehlungen in das klinische Denken zu integrieren sind.

Die Intransparenz des internen Algorithmus war kein kritischer Faktor für die Wirksamkeit.

🔎 Diagnostische Genauigkeit von KI im Screening übertrifft Menschen bei hochspezialisierten Aufgaben

Eine Meta-Analyse der diagnostischen Genauigkeit von KI für das Screening spezifischer Erkrankungen zeigt, dass KI-Systeme bei hochspezialisierten Aufgaben (Erkennung diabetischer Retinopathie, Früherkennung von Lungenkrebs im CT) Sensitivität und Spezifität erreichen, die mit erfahrenen Fachkräften vergleichbar sind oder diese übertreffen (S011). Entscheidend: Diese Ergebnisse wurden unter Bedingungen erzielt, in denen Ärzte die interne Logik des Algorithmus nicht verstanden, aber dessen Ausgabedaten bewerten und in den diagnostischen Prozess integrieren konnten.

- Das System arbeitet an einer eng definierten Aufgabe

- Die Ausgabedaten sind an unabhängigen Kohorten validiert

- Der Arzt kann das Ergebnis im Kontext des klinischen Bildes bewerten

- Der Mechanismus bleibt intransparent, aber das mindert nicht den Nutzen

🧬 Cognitive Task Analysis (CTA) in der Chirurgie: Öffnung der Black Box des Expertendenkens verbessert die Ausbildung

Ein systematischer Review über den Einfluss von Cognitive Task Analysis auf die chirurgische Ausbildung zeigt die Kehrseite des Problems: Wenn die „Black Box" des chirurgischen Expertendenkens durch strukturierte Analyse kognitiver Entscheidungsprozesse geöffnet wird, steigt die Lernwirksamkeit signifikant (S005). Eine Meta-Analyse von 12 Studien ergab eine große Effektstärke zugunsten von CTA-basiertem Lernen im Vergleich zu traditionellen Methoden.

Dies zeigt, dass die Transparenz des Denkprozesses eines Experten für die Weitergabe von Expertise entscheidend ist, selbst wenn der Experte nicht alle seine Entscheidungen ohne strukturierte Analyse verbalisieren kann. Mehr dazu im Abschnitt Debunking und Prebunking.

⚙️ Prognostische Rolle der MRT: Wenn Intransparenz des biologischen Prozesses dem klinischen Nutzen nicht schadet

Studien zur prognostischen Rolle der Magnetresonanztomographie zeigen, dass MRT-Biomarker Krankheitsverläufe mit hoher Genauigkeit vorhersagen können, selbst wenn der genaue biologische Mechanismus der Verbindung zwischen visualisiertem Merkmal und Verlauf unklar bleibt (S012). Ärzte nutzen diese prognostischen Modelle, ohne die Pathophysiologie vollständig zu verstehen, stützen sich aber auf validierte Korrelationen.

Dies ist rationaler Umgang mit Intransparenz: Der Mechanismus ist unklar, aber Reproduzierbarkeit, Validierung an unabhängigen Kohorten und klinischer Nutzen sind bewiesen.

Mechanismus des Fehlers: Wie Intransparenz evolutionäre Heuristiken ausnutzt und die Illusion des Verstehens erzeugt

Der Black-Box-Fehler entsteht nicht im Vakuum — er nutzt mehrere fundamentale Eigenschaften menschlicher Kognition aus, die durch Evolution zur Lösung von Aufgaben unter begrenzter Information und Zeit geformt wurden. Mehr dazu im Abschnitt Realitätsprüfung.

🧩 Die Heuristik „Komplexität = Kompetenz" und ihre evolutionären Wurzeln

Im sozialen Umfeld unserer Vorfahren korrelierte die Komplexität einer Erklärung oft mit Expertise: Ein Schamane, der eine komplexe Erklärung für eine Krankheit geben konnte, besaß wahrscheinlich mehr Erfahrung als einer mit einfachen Erklärungen. Diese Heuristik funktionierte, weil Komplexität ein kostspieliges Signal war — schwer zu fälschen ohne echtes Wissen.

Doch in der modernen Welt lässt sich Komplexität leicht imitieren: Pseudowissenschaftlicher Jargon, komplizierte Diagramme, mehrstufige Algorithmen können den Anschein von Expertise ohne deren Substanz erzeugen. Die Intransparenz eines Systems aktiviert diese Heuristik: „Ich verstehe es nicht, also ist es komplex, also sind die Entwickler kompetent".

Komplexität ist kein Signal für Kompetenz mehr — sie wurde zum Manipulationsinstrument. Intransparenz ermöglicht es, Imitation als Realität auszugeben.

🔁 Illusion der Erklärungstiefe und Überschätzung des eigenen Verständnisses

Menschen überschätzen systematisch die Tiefe ihres Verständnisses kausaler Mechanismen. Wenn jemand ein System benennen kann („das ist ein neuronales Netz", „das ist ein Quantencomputer", „das ist Blockchain"), glaubt er oft fälschlicherweise, zu verstehen, wie es funktioniert.

Die Intransparenz eines Systems verstärkt paradoxerweise diese Illusion: Das Fehlen von Details erlaubt es, Lücken mit vereinfachten mentalen Modellen zu füllen, die ausreichend erscheinen. Man erkennt die Grenzen des eigenen Nichtwissens nicht, weil das System keine Informationen liefert, die diese Grenzen offenlegen könnten.

- System benannt — Verständnis gefühlt

- Intransparenz verbirgt Lücken in diesem Verständnis

- Fehlende widersprüchliche Daten festigen die Illusion

- Kritisches Denken schaltet ab

⚠️ Asymmetrie des Vertrauens: Warum es leichter ist, an Magie zu glauben, als Statistiken zu prüfen

Die Überprüfung empirischer Daten zur Wirksamkeit eines Systems erfordert kognitive Anstrengung: Man muss Studien finden, ihre Methodik bewerten, Statistiken verstehen, den Kontext berücksichtigen. Blindes Vertrauen oder Ablehnung aufgrund von Intransparenz erfordert null Aufwand.

Evolutionär sind wir darauf ausgelegt, kognitive Kosten zu minimieren. Intransparenz schafft eine Asymmetrie: Der Weg des geringsten Widerstands ist eine extreme Bewertung (vollständiges Vertrauen oder vollständige Ablehnung), nicht eine aufwendige Analyse von Beweisen.

| Szenario | Kognitive Kosten | Ergebnis |

|---|---|---|

| Studien zur Wirksamkeit prüfen | Hoch | Fundiertes Urteil |

| Intransparenz als Qualitätssignal glauben | Null | Illusion des Verstehens |

| System als „Black Box" ablehnen | Null | Unbegründete Skepsis |

🧬 Kontext-Confounder: Wenn Intransparenz mit Neuheit und Aufgabenkomplexität korreliert

Intransparente Systeme werden oft in neuen, komplexen Bereichen eingesetzt, wo es noch keine etablierten Bewertungsstandards gibt. Dies erzeugt einen Confounder: Schlechte Ergebnisse können nicht Folge der Intransparenz sein, sondern der Unreife der Technologie oder falscher Anwendung.

Gute Ergebnisse können nicht Folge der Systemqualität sein, sondern sorgfältiger Auswahl von Aufgaben, bei denen es funktioniert. Ohne Kontrolle dieses Confounders ist es unmöglich, den Effekt der Intransparenz vom Effekt der Neuheit zu trennen. Dies ist besonders kritisch in Bereichen, wo technologischer Mystizismus bereits fruchtbaren Boden für die Überschätzung von Möglichkeiten geschaffen hat.

Wo die Beweise stark sind und wo Lücken bleiben: eine ehrliche Analyse der Grenzen aktueller Daten

Kritische Analyse erfordert die Anerkennung nicht nur dessen, was wir wissen, sondern auch dessen, was wir nicht wissen. Systematische Reviews und Meta-Analysen haben eigene Limitationen, die bei der Interpretation der Ergebnisse berücksichtigt werden müssen. Mehr dazu im Abschnitt Logik und Wahrscheinlichkeit.

📊 Publication Bias: nur Erfolge sind sichtbar

Studien, die hohe Effektivität von KI-Systemen zeigen, werden häufiger publiziert als Studien mit Null- oder negativen Ergebnissen. Dies erzeugt einen systematischen Bias in Meta-Analysen: Effektivitätsschätzungen können je nach Bereich um 20–40% überhöht sein.

Das Problem wird dadurch verschärft, dass viele KI-Systeme von kommerziellen Unternehmen entwickelt werden, die den Datenzugang kontrollieren und Ergebnisse selektiv publizieren können. Ohne Zugang zu Protokollen unveröffentlichter Studien ist es unmöglich, das wahre Ausmaß dieses Bias einzuschätzen.

Wenn nur Erfolge sichtbar sind, wird die Karte der Effektivität zur Karte des Marketings, nicht der Realität.

🔬 Heterogenität: verschiedene Studien sprechen verschiedene Sprachen

Verschiedene Studien verwenden unterschiedliche Effektivitätsmetriken, unterschiedliche Populationen, unterschiedliche Anwendungsbedingungen (S001, S003, S007). Dies erschwert den direkten Vergleich und die Verallgemeinerung der Ergebnisse.

Für KI-Systeme ist das Problem besonders akut: Es gibt keinen Konsens darüber, wie „Erklärbarkeit" oder „Transparenz" zu bewerten sind, keine standardisierten Benchmarks zum Vergleich von Systemen unter realen klinischen Bedingungen. Ein Forscher mag ein System als „erklärbar" betrachten, wenn es Koeffizienten ausgibt; ein anderer verlangt vollständige Nachvollziehbarkeit der Entscheidungslogik.

- Metrik A: Genauigkeit auf Testdatensatz

- Metrik B: Sensitivität und Spezifität

- Metrik C: Entscheidungszeit

- Metrik D: Übereinstimmung mit Expertenmeinung

- Metrik E: Nutzerzufriedenheit

Jede Metrik beantwortet eine andere Frage. Ohne Standardisierung lässt sich nicht sagen, welches System besser ist.

⚠️ Die Kluft zwischen Labor und Klinik

Die meisten Studien werden unter kontrollierten Bedingungen durchgeführt: sorgfältig ausgewählte Datensätze, standardisierte Protokolle, keine Zeitnot. Die reale klinische Praxis unterscheidet sich radikal: unvollständige Daten, nicht-standardisierte Fälle, Notwendigkeit schneller Entscheidungen, Integration in bestehende Arbeitsabläufe.

Die in Studien demonstrierte Effektivität lässt sich möglicherweise unter realen Bedingungen nicht reproduzieren. Systematische Daten über Langzeitergebnisse der Implementierung von KI-Systemen in die Routinepraxis sind noch unzureichend. Das bedeutet nicht, dass die Systeme ineffektiv sind — es bedeutet, dass wir nicht wissen, wie gut sie dort funktionieren, wo sie tatsächlich eingesetzt werden.

| Parameter | Kontrollierte Studie | Reale Praxis |

|---|---|---|

| Datenqualität | Hoch, standardisiert | Unvollständig, variabel |

| Zeitdruck | Nicht vorhanden | Hoch |

| Integration in Arbeitsablauf | Ideal | Oft konfliktreich |

| Fallauswahl | Repräsentativ | Verzerrt (schwere Fälle) |

🧪 Atrophie der Expertise: Theorie ohne Daten

Das Argument über die Atrophie von Expertise bei Delegation von Entscheidungen an intransparente Systeme ist theoretisch fundiert, aber empirisch schwach belegt. Es gibt keine Langzeitstudien, die Veränderungen kognitiver Fähigkeiten von Ärzten verfolgen, die Entscheidungsunterstützungssysteme nutzen, im Vergleich zu einer Kontrollgruppe.

Es gibt keine Daten darüber, wie sich die Fähigkeit zur Entscheidungsfindung in nicht-standardisierten Situationen nach jahrelanger Nutzung von KI-Assistenten verändert. Dies ist eine kritische Lücke: Wenn die Atrophie real ist, könnten ihre Effekte erst nach Jahren sichtbar werden, wenn ein Zurück unmöglich ist. Wir können nur spekulieren, gestützt auf kognitive Verzerrungen und Evolutionspsychologie.

Wir kennen den Mechanismus, aber nicht das Ausmaß. Das ist gefährlicher, als nichts zu wissen.

Stärken der Evidenzbasis: Die Effektivität von KI-Systemen bei eng definierten Aufgaben (Bilddiagnostik, Screening) ist durch zahlreiche Studien belegt. Schwächen: Langzeiteffekte, Einfluss auf kognitive Fähigkeiten, reale klinische Effektivität, Fehlermechanismen bei Entscheidungsdelegation — all dies bleibt im Schatten.

Kognitive Anatomie des Fehlers: Welche Verzerrungen ausgenutzt werden und wie sie interagieren

Der Black-Box-Fehler ist keine isolierte Verzerrung, sondern ein Knotenpunkt in einem Netzwerk miteinander verbundener kognitiver Schwachstellen. Das Verständnis dieses Netzwerks ist notwendig für die Entwicklung wirksamer Gegenmaßnahmen. Mehr dazu im Abschnitt Fehler und Voreingenommenheit von KI.

🧩 Technologie-Halo-Effekt: Übertragung von Prestige auf ein konkretes System

Wenn KI-Systeme allgemein mit Fortschritt und Innovation assoziiert werden, überträgt sich diese positive Bewertung auf ein konkretes System, ohne dessen individuelle Eigenschaften zu analysieren. „Das ist KI" wird zu einer ausreichenden Grundlage für Vertrauen.

Intransparenz verstärkt den Effekt: Das Fehlen von Details verhindert die Erkenntnis, dass ein konkretes System schlecht konzipiert, unzureichend validiert oder zweckentfremdet sein könnte. Dies ist besonders gefährlich im Kontext von Techno-Esoterik, wo technologische Sprache selbst zur Autoritätsquelle wird.

⚠️ Fehlerhafte Zuschreibung von Handlungsfähigkeit: Zuschreibung von Absichten und Verständnis an das System

Menschen neigen dazu, Systemen, die komplexes Verhalten zeigen, Handlungsfähigkeit (Absichten, Ziele, Verständnis) zuzuschreiben. Wenn ein KI-Chatbot eine empathische Antwort gibt, vergisst man leicht, dass dies das Ergebnis statistischer Optimierung ist und nicht des Verstehens von Emotionen.

Intransparenz verstärkt diese Illusion: Wenn wir den Mechanismus nicht sehen, ist es leichter, sich vorzustellen, dass es innen „Verständnis" gibt. Dies führt zu einer Überschätzung der Zuverlässigkeit des Systems – wir vertrauen ihm so, wie wir einem verstehenden Experten vertrauen würden, obwohl das System nicht die Flexibilität und das kontextuelle Verständnis eines Menschen besitzt.

🔁 Bestätigungsschleife: Wie die Nutzung des Systems das Vertrauen in es verstärkt

Jede erfolgreiche Anwendung des Systems (selbst eine zufällige Übereinstimmung) wird als Bestätigung seiner Kompetenz interpretiert. Misserfolge werden umattribuiert: Benutzerfehler, falscher Kontext, unzureichend präzise Anfrage – alles außer dem System selbst.

- Benutzer wendet das System an und erhält ein Ergebnis

- Ergebnis wird als Erfolg interpretiert (selbst wenn es Zufall ist)

- Vertrauen in das System wächst

- Benutzer wendet das System in komplexeren Situationen an

- Misserfolge werden durch externe Faktoren erklärt, nicht durch Systembeschränkungen

- Zyklus wiederholt sich, Vertrauen verfestigt sich

Intransparenz blockiert den Ausweg aus diesem Zyklus: Es gibt keine Möglichkeit zu überprüfen, ob das System tatsächlich besser funktioniert als Zufall, oder ob dies die Verfügbarkeitsheuristik ist – wir erinnern uns an Erfolge und vergessen Misserfolge.

🎯 Interaktion von Verzerrungen: Synergie der Schwachstellen

Diese drei Mechanismen wirken nicht unabhängig. Der Halo-Effekt schafft anfängliches Vertrauen, die fehlerhafte Zuschreibung von Handlungsfähigkeit macht das System psychologisch „lebendig" und verantwortlich, und die Bestätigungsschleife festigt beide Effekte.

Fügen Sie die Vernachlässigung der Basisrate hinzu – der Benutzer weiß nicht, wie häufig das System insgesamt Fehler macht – und Sie erhalten den perfekten Sturm: Das System wird als kompetent, verstehend und zuverlässig wahrgenommen, obwohl es in Wirklichkeit nur eine Black Box ist, die manchmal nützliche Ergebnisse liefert.

Intransparenz ist nicht einfach das Fehlen von Information. Sie ist ein aktiver Katalysator, der normale kognitive Prozesse in systematische Urteilsfehler verwandelt.