Die Dead Internet Theory: vom anonymen Post zur Massenpanik — was genau behauptet wird und warum es wichtig ist

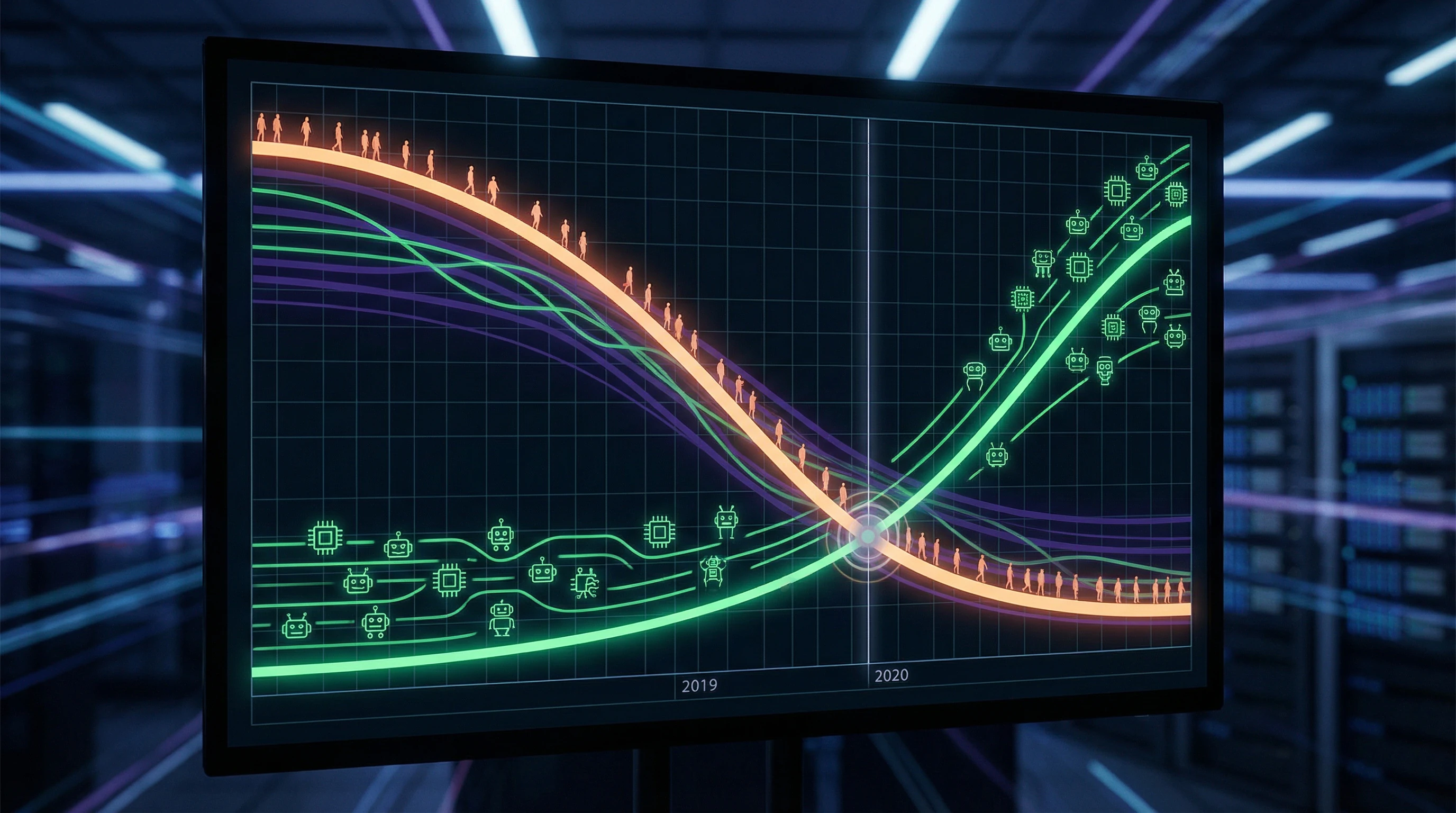

Die Dead Internet Theory ist eine verschwörungstheoretische Hypothese, die behauptet, dass ein erheblicher Teil der Online-Aktivität, der Inhalte und Interaktionen nicht von lebenden Menschen, sondern von Bots, Algorithmen und künstlicher Intelligenz generiert wird. Laut dieser Theorie „starb" das Internet etwa 2016–2017, als automatisierte Systeme eine kritische Masse erreichten und begannen, die menschliche Präsenz zu dominieren. Mehr dazu im Abschnitt Mentale Fehler.

Befürworter der Theorie behaupten, dass Konzerne und Regierungen absichtlich die Illusion eines lebendigen Internets aufrechterhalten, um die öffentliche Meinung zu manipulieren, Werbung zu verkaufen und den Informationsraum zu kontrollieren.

Das Internet hat sich nicht einfach verändert — es hat angeblich aufgehört, ein Raum menschlicher Kommunikation zu sein, und wurde zu einem Schattentheater, in dem Menschen mit Simulationen interagieren.

⚠️ Kernbehauptungen der Theorie: was genau als „tot" gilt

Die Theorie stützt sich auf vier miteinander verbundene Behauptungen. Die meisten Kommentare in sozialen Medien werden angeblich von Bots geschrieben, nicht von echten Nutzern. Ein erheblicher Anteil der Inhalte — Artikel, Videos, Posts — wird von Algorithmen generiert, um den Anschein von Aktivität zu erwecken.

- Trends und virale Phänomene

- Werden angeblich künstlich von automatisierten Systemen erzeugt und aufrechterhalten, statt organisch aus menschlichen Interessen zu entstehen.

- Aktivitätsverhältnis

- Echte Menschen bilden eine Minderheit der Online-Aktivität, ihre Interaktionen gehen in einem Meer synthetischen Rauschens unter.

🧩 Historischer Kontext: wie ein anonymer Post zum kulturellen Phänomen wurde

Die erste systematische Darstellung der Theorie erschien 2021 im Forum Agora Road's Macintosh Cafe, obwohl einzelne Elemente seit 2016 auf Imageboards kursierten. Der Post beschrieb das Internet als „toten Raum", in dem Algorithmen menschliche Aktivität so überzeugend imitieren, dass die meisten Nutzer die Täuschung nicht bemerken.

Die Theorie verbreitete sich schnell auf Reddit, Twitter und YouTube, wo sie bei Menschen Anklang fand, die „digitale Erschöpfung" und ein Gefühl der Unwirklichkeit bei Online-Interaktionen erlebten. Bis 2023, nach dem Start von ChatGPT und dem explosiven Wachstum generativer KI, erlebte die Theorie eine Renaissance — nun nicht mehr als Verschwörungstheorie, sondern als Beschreibung beobachtbarer Realität.

| Zeitraum | Status der Theorie | Verbreitungsauslöser |

|---|---|---|

| 2016–2020 | Marginale Hypothese auf Imageboards | Zunahme von Bots in sozialen Medien |

| 2021 | Systematisierte Verschwörungstheorie | Post auf Macintosh Cafe |

| 2023–2024 | Quasi-wissenschaftliche Beobachtung | Explosives Wachstum generativer KI |

🔎 Grenzen der Analyse: was wir prüfen und was nicht

In diesem Artikel konzentrieren wir uns auf überprüfbare Behauptungen der Theorie: den Anteil automatisierter Inhalte, Bot-Statistiken, Daten zu synthetischen Medien. Wir betrachten nicht die verschwörungstheoretischen Elemente über eine „globale Verschwörung" oder das „absichtliche Töten des Internets" — diese Behauptungen lassen sich empirisch nicht überprüfen.

Unsere Aufgabe ist es, beobachtbare Trends von kognitiven Verzerrungen zu trennen und zu zeigen, wo die Statistik endet und die paranoide Interpretation beginnt. Das bedeutet nicht, dass die Theorie völlig falsch ist — vielmehr vermischt sie reale Phänomene mit falschen Schlussfolgerungen über deren Ursachen und Ausmaß.

Die Steel-Man-Version der Theorie: Sieben überzeugende Argumente für das „tote Internet" — und warum man sie nicht ignorieren sollte

Bevor wir die Theorie analysieren, müssen wir sie in ihrer stärksten Form darstellen — das sogenannte „Steel-Man-Argument". Dies ist ein intellektuell redlicher Ansatz: Wir nehmen die besten Argumente der Befürworter der Theorie, befreien sie von Emotionen und Verschwörungstheorien und prüfen, inwieweit sie den Daten entsprechen. Mehr dazu im Abschnitt Kritisches Denken.

Im Folgenden — sieben der überzeugendsten Beobachtungen, die die Theorie des toten Internets nähren.

⚠️ Erstes Argument: Exponentielles Wachstum von Bots in sozialen Netzwerken

Die Statistiken zu Bots in sozialen Netzwerken sind tatsächlich beunruhigend. Nach verschiedenen Schätzungen waren zwischen 15% und 60% der Konten auf Twitter (vor dem Rebranding zu X) automatisiert oder halbautomatisiert.

Facebook löscht regelmäßig Milliarden gefälschter Konten pro Quartal — 2022 sperrte das Unternehmen über 1,6 Milliarden Konten in drei Monaten. Instagram kämpft gegen Bots, die Kommentare, Likes und Abonnements generieren.

Wenn Plattformen Milliarden von Bots löschen, wie viele bleiben dann noch unentdeckt? Diese Zahlen sind kein Geheimnis — sie werden in den Berichten der Plattformen selbst veröffentlicht.

🧩 Zweites Argument: Synthetischer Content ist nicht mehr von menschlichem zu unterscheiden

Mit dem Aufkommen von GPT-3, GPT-4 und anderen großen Sprachmodellen ist die Grenze zwischen menschlichem und maschinellem Text verschwommen. Studien zeigen, dass Menschen nicht zuverlässig zwischen KI-generierten und menschlichen Texten unterscheiden können — die Erkennungsgenauigkeit liegt bei etwa 50%, was einem Zufallstreffer entspricht.

Generative Modelle erstellen Artikel, Social-Media-Posts und Kommentare, die die Moderation passieren und als authentisch wahrgenommen werden. Wenn wir synthetischen Content nicht unterscheiden können, wie können wir sicher sein, dass wir mit Menschen kommunizieren?

🔁 Drittes Argument: Zunahme von „leerem" Content und Content-Farmen

Das Internet ist überflutet mit minderwertigen Inhalten, die für SEO und Werbemonetarisierung erstellt wurden. Content-Farmen generieren Tausende von Artikeln pro Tag unter Verwendung von Vorlagen und Automatisierung.

YouTube ist voll von automatisch generierten Videos — Compilations, Re-Uploads, robotergesteuerten Voice-Overs. TikTok und Instagram Reels zeigen endlose Variationen desselben Contents, der nach algorithmischen Vorlagen erstellt wurde.

- Content wird um des Contents willen erstellt, nicht um der Bedeutung willen

- Menschliche Kreativität wird zur seltenen Ausnahme

- Algorithmen optimieren auf Viralität, nicht auf Qualität

📊 Viertes Argument: Manipulation von Trends und künstliche Viralität

Es sind Fälle dokumentiert, in denen Trends in sozialen Netzwerken künstlich durch Botnetze und koordinierte Kampagnen erzeugt wurden. Politische Akteure nutzen automatisierte Systeme, um Hashtags zu pushen, Gegner zu diskreditieren und die Illusion massenhafter Unterstützung zu erzeugen.

Marketingagenturen verkaufen „Viralität" als Dienstleistung und nutzen Bot-Netzwerke, um Views, Likes und Shares zu manipulieren. Wenn Trends käuflich sind, wie können wir dem vertrauen, was wir im Feed sehen?

🧠 Fünftes Argument: Das Phänomen der „digitalen Derealisierung" bei Nutzern

Viele Nutzer berichten von einem subjektiven Gefühl der „Unwirklichkeit" bei Online-Interaktionen. Kommentare wirken schablonenhaft, Dialoge repetitiv, Reaktionen vorhersehbar.

Psychologen registrieren eine Zunahme von „digitaler Erschöpfung" und dem Gefühl, dass „alle um einen herum Bots sind". Diese subjektive Erfahrung ist kein Beweis, aber sie ist massenhaft und beständig.

Das kollektive Unbewusste könnte die veränderte Natur des Internets früher erkennen, als es die Daten erfassen. Aber subjektives Empfinden und objektive Realität sind verschiedene Dinge.

🕳️ Sechstes Argument: Sinkende Suchqualität und Zunahme von SEO-Spam

Google und andere Suchmaschinen liefern zunehmend minderwertige, automatisch generierte Ergebnisse. SEO-optimierte, von KI erstellte Artikel verdrängen originalen Content.

Nutzer beklagen, dass die Suche „nutzlos" geworden ist — die ersten Seiten sind gefüllt mit Werbung, Spam und Content-Farmen. Das Internet wird für Algorithmen optimiert, nicht für Menschen, was es für menschliche Bedürfnisse weniger geeignet macht.

⚙️ Siebtes Argument: Ökonomische Anreize zur Content-Automatisierung

Die Erstellung von Content durch Menschen ist teuer und langsam. Automatisierung ist günstig und skalierbar. Werbeplattformen zahlen für Views und Klicks, unabhängig davon, wer sie generiert.

- Ökonomische Logik

- Sie treibt zur Ersetzung von Menschen durch Algorithmen. In einem kapitalistischen System, in dem Content eine Ware ist, ist seine Industrialisierung unvermeidlich.

- „Totes Internet"

- Keine Verschwörung, sondern das natürliche Ergebnis von Marktkräften, wenn Skalierbarkeit über Qualität siegt.

Evidenzbasis: Was die Daten über den tatsächlichen Anteil synthetischer Inhalte sagen — Zahlen, Studien, Fakten ohne Emotionen

Von Argumenten gehen wir zu überprüfbaren Daten über. Mehr dazu im Abschnitt Quellen und Beweise.

🧪 Bot-Statistiken: Was Traffic-Studien zeigen

Imperva, ein Cybersicherheitsunternehmen, veröffentlicht jährlich Berichte über die Zusammensetzung des Internet-Traffics. Im Jahr 2022 wurden etwa 47,4% des gesamten Web-Traffics von Bots generiert — sowohl „guten" (Suchmaschinen-Crawler, Monitoring-Systeme) als auch „schlechten" (Scraper, Spam-Bots, DDoS-Angriffe). Der Anteil „schlechter" Bots betrug 30,2% des Gesamttraffics.

Traffic ist nicht gleich Inhalt. Bots generieren zahlreiche Anfragen, aber das bedeutet nicht, dass sie Inhalte erstellen, die Menschen sehen.

📊 Synthetische Inhalte in sozialen Netzwerken: Plattform-Daten

Twitter schätzte den Bot-Anteil auf 5% der aktiven Accounts, aber unabhängige Forscher nannten 9–15%. Elon Musk behauptete beim Streit um den Plattformkauf, der tatsächliche Anteil könne 20% und höher erreichen. Facebook entfernte 1,9 Milliarden gefälschte Accounts im Q2 2022 — etwa 5% der gesamten Nutzerbasis.

Instagram bekämpft automatisierte Systeme, die Kommentare und Likes generieren, veröffentlicht aber keine genauen Zahlen. Das Bot-Problem ist real, aber das Ausmaß hängt von der Zählmethodik ab.

🧾 Generative KI und Textinhalte: Studien zur Verbreitung

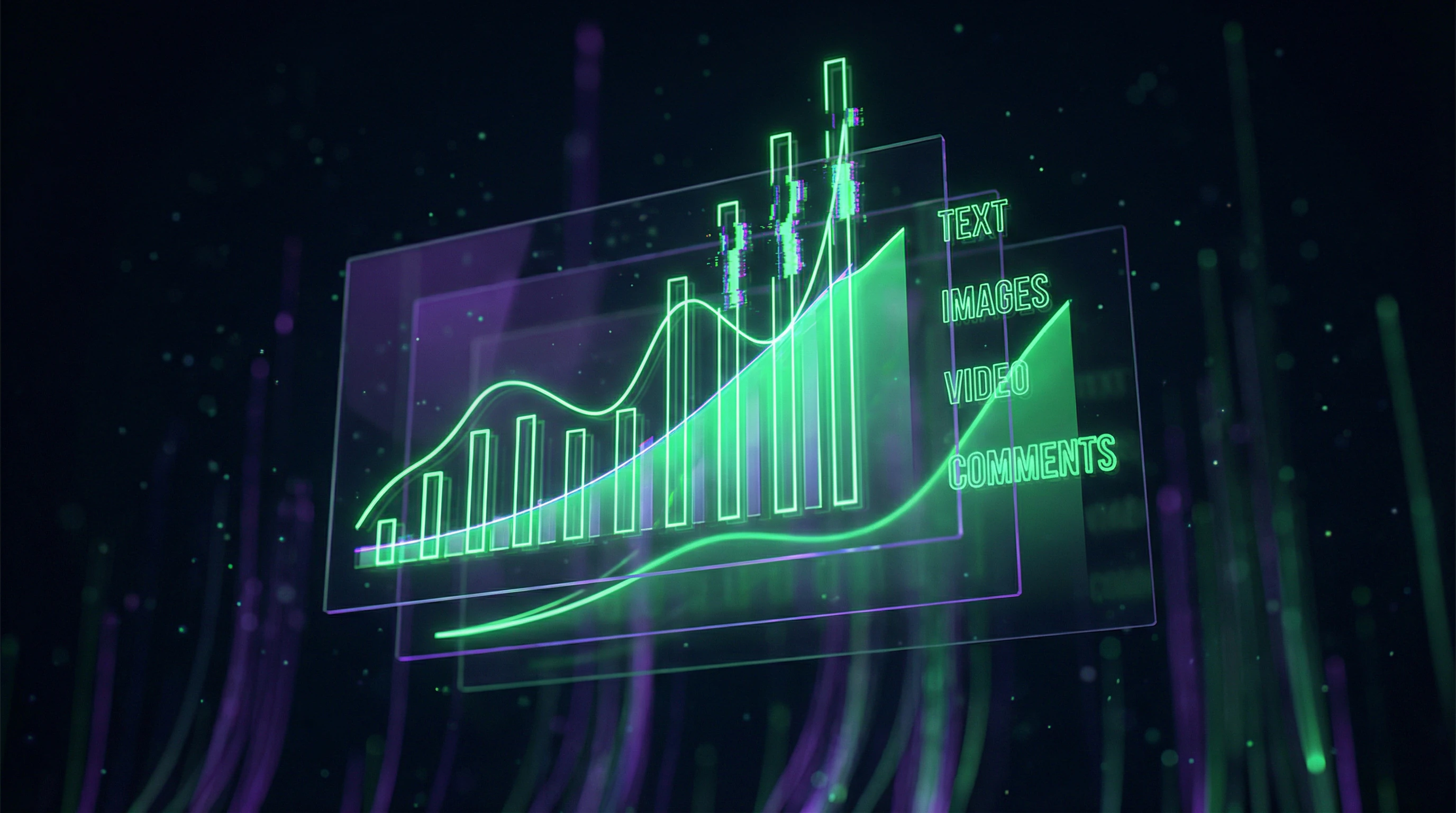

Nach dem Start von ChatGPT im November 2022 begann der Anteil KI-generierter Texte exponentiell zu wachsen. Eine Studie von Originality.AI (2023) zeigte: etwa 10–15% neuer Artikel im englischsprachigen Segment enthalten Anzeichen von KI-Generierung.

| Content-Nische | Anteil KI-Content | Detektionszuverlässigkeit |

|---|---|---|

| Allgemeines Internet | 10–15% | 70–80% |

| SEO-Content, Rezensionen, News-Aggregatoren | 40–60% | 60–70% |

Die Methodik zur Detektion von KI-Texten ist unvollkommen — falsch-positive und falsch-negative Ergebnisse machen 20–30% aus. Genaue Zahlen sind unbekannt, aber der Trend ist offensichtlich: Synthetischer Text wird zur Norm.

🔬 Synthetische Bilder und Videos: Daten zu Deepfakes und generativen Modellen

Generative Modelle (Midjourney, DALL-E, Stable Diffusion für Bilder; Runway, Synthesia für Videos) haben die Erstellung synthetischer Medien massentauglich gemacht. Eine Studie von Sensity AI zeigte: Die Anzahl von Deepfake-Videos verdoppelt sich alle sechs Monate.

- Im Jahr 2023 wurden über 95.000 Deepfake-Videos registriert (die meisten pornografischen Inhalts).

- Das sind nur die entdeckten Fälle.

- Synthetische Bilder für Illustrationen, Werbung, soziale Medien lassen sich nicht genau zählen — sie sind von Fotos nicht zu unterscheiden und werden nicht gekennzeichnet.

🧬 Methodologische Einschränkungen: Warum genaue Zahlen unmöglich sind

Alle angeführten Daten haben erhebliche Einschränkungen. Die Detektion von Bots und KI-Content ist unvollkommen — Algorithmen verbessern sich ständig und umgehen Erkennungssysteme.

- Problem 1: Anreize der Plattformen

- Plattformen haben kein Interesse daran, genaue Zahlen zu veröffentlichen — ein hoher Bot-Anteil senkt das Vertrauen von Werbetreibenden und Investoren.

- Problem 2: Unscharfe Definition

- Was gilt als synthetischer Inhalt? Von KI bearbeiteter Text? Bild mit Filtern? Video mit automatischen Untertiteln? Diese Fragen haben keine eindeutigen Antworten, was jede Schätzung annähernd macht.

- Problem 3: Verborgene Volumina

- Der Großteil synthetischer Inhalte bleibt unentdeckt — besonders in geschlossenen Systemen, Unternehmensnetzwerken und privaten Kanälen.

Fazit: Die Daten bestätigen das Wachstum synthetischer Inhalte, aber das genaue Ausmaß bleibt unbekannt. Das bedeutet nicht, dass die Theorie des toten Internets richtig ist — es bedeutet, dass sich das Internet tatsächlich verändert, und das Ignorieren von Basisraten bei der Interpretation dieser Daten führt zu fehlerhaften Schlussfolgerungen.

Mechanismus des Phänomens: Kausalität versus Korrelation — warum sich das Internet verändert und wer dafür verantwortlich ist

Das Wachstum automatisierter Inhalte ist Fakt. Aber ist es das Ergebnis einer Verschwörung oder die natürliche Folge von Technologie und Ökonomie? Wir analysieren die Kausalzusammenhänge. Mehr dazu im Abschnitt Psychologie des Glaubens.

⚙️ Aufmerksamkeitsökonomie: warum Automatisierung unvermeidlich ist

Das Internet monetarisiert Aufmerksamkeit. Werbeplattformen zahlen für Aufrufe, Klicks, Verweildauer — je mehr Inhalte, desto mehr Möglichkeiten für Werbeanzeigen.

Ein Mensch erstellt einen Artikel pro Tag. KI erstellt tausend pro Stunde. Die Wahl der Plattform ist nicht deshalb offensichtlich, weil sie böswillig ist, sondern weil es Markteffizienz ist. Plattformen optimieren nach ihren Geschäftsmodellen, ohne das Internet absichtlich zu „töten".

🔁 Technologischer Determinismus: KI-Entwicklung als unvermeidlicher Prozess

Generative KI ist das Ergebnis jahrzehntelanger Forschung, keine plötzliche Verschwörung. GPT-3 (2020), GPT-4 (2023), Stable Diffusion und Midjourney (2022) entwickelten sich offen: wissenschaftliche Publikationen, Open Source, vorhersehbare Qualitätsverbesserung und Kostensenkung.

Die Dead-Internet-Theorie interpretiert technologischen Fortschritt als böswilligen Plan und ignoriert, dass es die natürliche Entwicklungstrajektorie von KI ist.

🧩 Störfaktoren: andere Faktoren, die die beobachteten Veränderungen erklären

Das Gefühl der „Totheit" lässt sich möglicherweise nicht durch mehr Bots erklären, sondern durch etwas ganz anderes. Algorithmische Kuration erzeugt Filterblasen — Nutzer sehen sich wiederholende Muster. Kommerzialisierung führte zu Standardisierung: alle folgen denselben SEO-Regeln und erzeugen die Illusion von Einheitlichkeit.

Das Wachstum der Nutzerzahlen verwässerte die Qualität — mehr Menschen erstellen Inhalte, aber das durchschnittliche Niveau sinkt. Diese Faktoren haben nichts mit Bots zu tun, erzeugen aber ähnliche subjektive Empfindungen.

| Beobachtung | Erklärung durch Bots | Alternative Ursachen |

|---|---|---|

| Inhalte wirken repetitiv | Bots generieren einheitliche Texte | Algorithmen zeigen Ähnliches; SEO-Standardisierung |

| Weniger originelle Stimmen | Bots übertönen Menschen | Kommerzialisierung verdrängte Amateure; Plattformkonzentration |

| Qualität durchschnittlicher Inhalte sank | Bots füllen das Internet mit Müll | Mehr Nutzer = mehr durchschnittliche Inhalte; Demokratisierung der Erstellung |

| Nischeninhalte schwerer zu finden | Bots verdrängten Nischenautoren | Algorithmen priorisieren Populäres; Skalenökonomie |

🎯 Wo Korrelation endet und Kausalität beginnt

Korrelation: Das Internet verändert sich, KI entwickelt sich — beide Prozesse laufen parallel. Kausalität: Verursacht KI die Veränderungen im Internet? Oder erzeugt das Internet die Nachfrage nach KI? Oder sind beide Phänomene Folge eines dritten Faktors (Kapitalismus, Plattformskalierung)?

Die Dead-Internet-Theorie nimmt Korrelation und erklärt sie zur Ursache, fügt Absicht hinzu (Verschwörung). Das ist ein klassischer Fehler kognitiver Verzerrung: wir sehen ein Muster → vermuten einen Akteur → schreiben ihm ein Ziel zu.

- Kausalkette (real)

- Ökonomische Anreize → Investitionen in KI → technologischer Fortschritt → Implementierung in Plattformen → Veränderung der Inhalte

- Kausalkette (Dead-Internet-Theorie)

- Verschwörung → absichtliche Bot-Implementierung → Tötung des Internets → Informationskontrolle

- Warum die zweite Version attraktiver ist

- Sie ist einfacher (ein Akteur statt eines Faktorsystems), erklärt das Gefühl von Kontrollverlust, bietet einen Feind statt Ungewissheit

Die Realität ist komplexer: Das Internet verändert sich, weil seine Ökonomie Skalierung erfordert, und KI ist ein Werkzeug der Skalierung. Das ist keine Verschwörung, das ist Marktlogik. Aber das bedeutet nicht, dass die Veränderungen harmlos sind oder dass man sie nicht kritisieren kann — nur muss sich die Kritik auf ökonomische Anreize richten, nicht auf imaginäre Feinde.

Konflikte und Unklarheiten: Wo Quellen voneinander abweichen und warum es keine eindeutige Antwort gibt

Studien zum Anteil von Bots und synthetischen Inhalten liefern widersprüchliche Ergebnisse. Unterschiedliche Methodologien, unterschiedliche Definitionen, unterschiedliche Zeiträume — all dies führt zu Schätzungen zwischen 5% und 60%. Mehr dazu im Abschnitt Logische Fehlschlüsse.

🔎 Definition von „Bot": Technischer Agent oder sozialer Akteur?

Das Hauptproblem ist das Fehlen einer einheitlichen Definition von „Bot". Technisch gesehen ist es jedes automatisierte Programm, das mit Webdiensten interagiert: Google-Suchcrawler, Monitoring-Systeme, automatische Benachrichtigungen.

Im Kontext der Dead-Internet-Theorie bedeutet „Bot" ein System, das menschliches Verhalten imitiert, um zu manipulieren oder zu täuschen. Diese Definitionen überschneiden sich nicht.

Studien mit breiter Definition liefern hohe Zahlen; enge Definitionen führen zu niedrigen Werten. Dies ist eine methodologische Unklarheit, die ohne Konsens nicht beseitigt werden kann.

📊 Das Messproblem: Wie zählt man, was sich verbirgt?

Bots und KI-Systeme werden ständig weiterentwickelt, um der Erkennung zu entgehen. Dies schafft ein fundamentales Problem: Wir können nur erkannte Fälle zählen, wissen aber nicht, wie viele unentdeckt bleiben.

Verschiedene Studien verwenden unterschiedliche Erkennungsmethoden: Verhaltensanalyse, linguistische Muster, technische Signaturen. Keine Methode ist zu 100% zuverlässig.

- Verhaltensanalyse — Verfolgung von Aktivitätsmustern, aber Bots lernen, menschliche Rhythmen zu imitieren

- Linguistische Muster — Textanalyse, aber generative KI wird von menschlicher Sprache ununterscheidbar

- Technische Signaturen — Prüfung von Metadaten und IP, aber leicht durch Proxys und VPN zu verschleiern

🧾 Zeitliche Dynamik: Das Problem einer sich schnell verändernden Realität

Die Situation ändert sich so schnell, dass Studien zum Zeitpunkt der Veröffentlichung bereits veraltet sind. Daten aus 2022 spiegeln nicht die Realität von 2024 wider, als generative KI zum Masseninstrument wurde.

Jede Schätzung des Anteils synthetischer Inhalte ist eine Momentaufnahme, die nach wenigen Monaten ihre Aktualität verliert. Wir analysieren immer die Vergangenheit, nicht die Gegenwart.

- Forschungsverzögerung

- Von der Datenerhebung bis zur Veröffentlichung vergehen 6–18 Monate. In dieser Zeit macht die KI-Technologie mehrere Generationssprünge.

- Anpassungsverzögerung

- Sobald eine Studie über eine Erkennungsmethode erscheint, arbeiten Bot-Entwickler bereits an deren Umgehung.

- Wahrnehmungsverzögerung

- Die Öffentlichkeit erfährt von einem Problem, wenn es bereits in eine neue Entwicklungsphase übergegangen ist.

Diese drei Verzögerungen erzeugen einen „Schwanzjagd-Effekt": Wir beschreiben die gestrige Realität, während die heutige bereits eine andere ist. Eine eindeutige Antwort auf die Frage „Wie hoch ist der Anteil synthetischer Inhalte?" existiert nicht, weil die Forscher inkompetent wären, sondern weil die Frage selbst eine statische Realität voraussetzt, die es nicht gibt.

Kognitive Anatomie des Mythos: Welche psychologischen Mechanismen verwandeln Beobachtung in Verschwörungsdenken

Die Dead-Internet-Theorie ist ein klassisches Beispiel dafür, wie reale Beobachtungen in verschwörungstheoretisches Denken transformiert werden. Wir analysieren die kognitiven Verzerrungen, die diese Theorie nähren. Mehr dazu im Abschnitt Karma und Reinkarnation.

⚠️ Mustererkennung und Apophänie: Zusammenhänge sehen, wo keine sind

Das menschliche Gehirn ist evolutionär auf die Suche nach Mustern programmiert — das half beim Überleben durch das Erkennen von Bedrohungen. Doch diese Fähigkeit versagt manchmal und erzeugt die Illusion von Mustern in zufälligen Daten.

Apophänie ist die Wahrnehmung bedeutsamer Zusammenhänge zwischen unverbundenen Phänomenen. Anhänger der Dead-Internet-Theorie sehen überall „Beweise": sich wiederholende Kommentare, ähnliche Posts, schablonenartige Antworten. Doch diese Phänomene lassen sich einfach erklären: Menschen kopieren voneinander, verwenden dieselben Memes, folgen Trends.

Apophänie verwandelt Banalität in „Beweise einer Verschwörung" — und je mehr Daten vorhanden sind, desto mehr „Zufälle" findet das Gehirn.

🕳️ Bestätigungsfehler: Nur suchen, was die Hypothese bestätigt

Wenn jemand die Dead-Internet-Theorie akzeptiert, beginnt er nach Bestätigungen zu suchen und ignoriert Widerlegungen. Einen schablonenhaften Kommentar gefunden? „Das ist ein Bot!" Einen originellen Post gesehen? „Eine seltene Ausnahme".

Dieser kognitive Filter macht die Theorie unwiderlegbar — alle Daten werden zu ihren Gunsten interpretiert. Confirmation Bias ist ein systematischer Fehler, der Überzeugungen unabhängig von Fakten verstärkt.

🧠 Agentenerkennung und Intentionalität: Unpersönlichen Prozessen Absichten zuschreiben

Menschen neigen dazu, Absichten und Akteure dort zu sehen, wo unpersönliche Prozesse wirken. Die zunehmende Automatisierung des Internets ist das Ergebnis ökonomischer Anreize und technologischer Entwicklung, nicht der böswillige Plan von jemandem.

Doch das Gehirn verlangt nach einem Feind, einem Koordinator, einem Verschwörer. Unpersönliche Marktkräfte und Algorithmen werden als Absprache erlebt. Das ist keine Paranoia — das ist die normale Funktionsweise des Agentenerkennungssystems, das zu häufig anschlägt.

- Beobachtung: Content ist homogener und automatisierter geworden

- Interpretation: Das ist keine Marktlogik, sondern jemandes Plan

- Suche nach einem Akteur: Wer könnte das sein? KI-Unternehmen? Der Staat? Konzerne?

- Verstärkung: Jede neue Tatsache wird zum „Beweis" des Plans

📊 Verfügbarkeitsheuristik: Wir erinnern das Auffällige, vergessen das Typische

Auffällige Beispiele von Bots, kopierten Posts und seltsamen Kommentaren sind leicht zu erinnern und scheinen häufig. Millionen gewöhnlicher Posts bleiben unbemerkt — sie lösen keine Emotionen aus.

Die Verfügbarkeitsheuristik lässt uns die Häufigkeit dessen überschätzen, was leicht zu erinnern ist. Einige auffällige Bot-Beispiele erzeugen den Eindruck, dass Bots überall sind.

🎯 Vernachlässigung der Basisrate: Den Kontext vergessen

Selbst wenn 5% des Internets synthetischer Content sind, bedeutet das nicht, dass das Internet „tot" ist. Doch wenn sich jemand auf diese 5% konzentriert, vergisst er die 95% lebendigen Contents.

Die Vernachlässigung der Basisrate ist die systematische Missachtung von Kontext und Größenordnung. Die Dead-Internet-Theorie funktioniert genau so: Sie nimmt ein reales Phänomen (Zunahme von KI-Content) und ignoriert dessen wahres Ausmaß.

⚫⚪ Schwarz-Weiß-Denken: Keine Grautöne

Die Dead-Internet-Theorie setzt eine Dichotomie voraus: Entweder ist das Internet lebendig oder tot. Entweder ist Content menschlich oder von Bots. Doch die Realität ist komplexer: Content kann teilweise automatisiert, teilweise menschlich, hybrid sein.

Falsche Dichotomien vereinfachen die Welt und machen sie verständlicher, aber weniger präzise. Komplexe Phänomene erfordern komplexe Modelle — nicht die Wahl zwischen zwei Extremen.

Der Mythos vom toten Internet ist keine Lüge. Es ist eine reale Beobachtung, gefiltert durch kognitive Verzerrungen, die eine partielle Wahrheit in eine absolute Verschwörung verwandeln.