Was sind kognitive Verzerrungen und Heuristiken — und warum werden sie mit Denkfehlern verwechselt

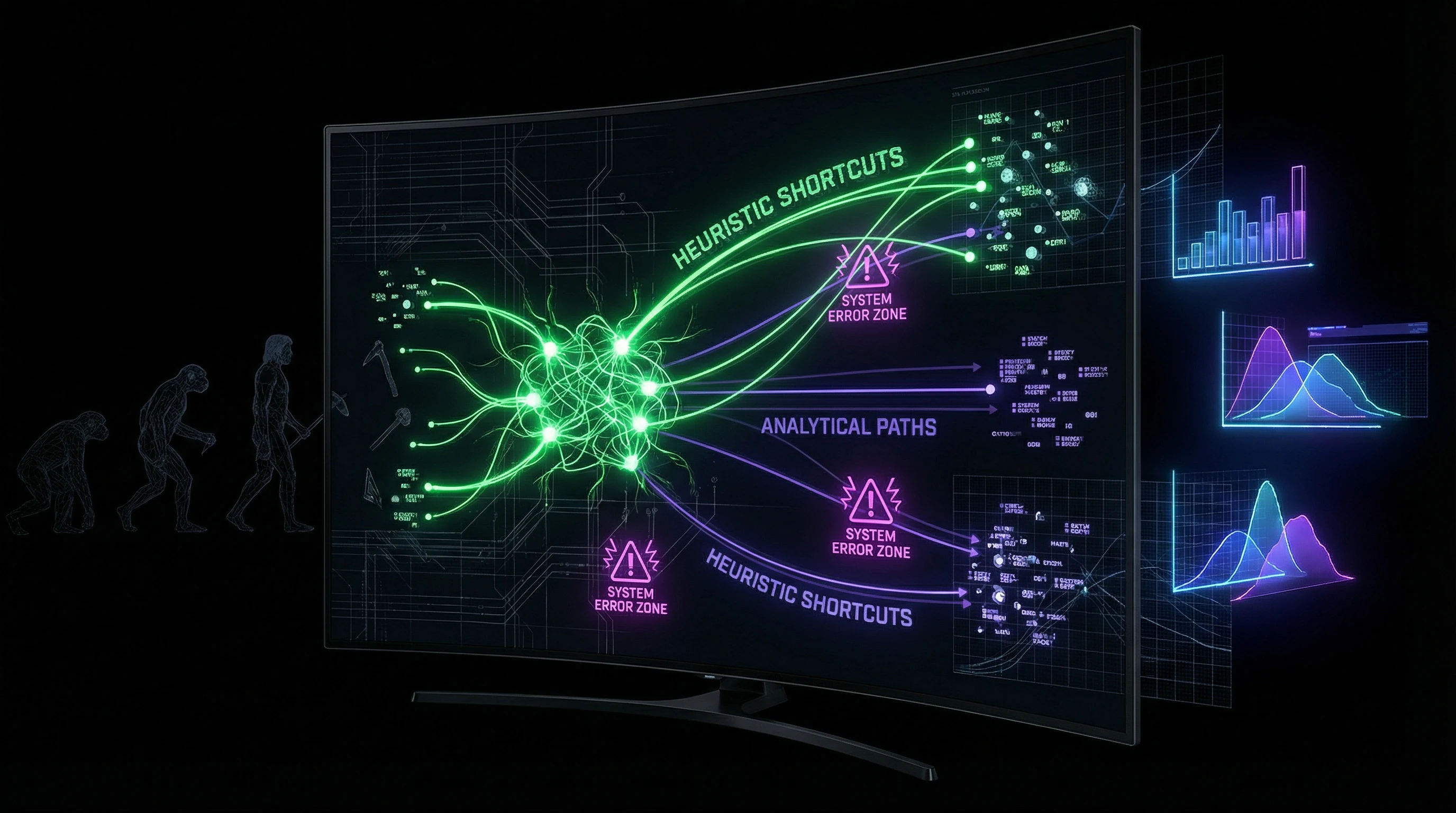

Heuristiken sind mentale Abkürzungen, vereinfachte Entscheidungsregeln, die eine schnelle Informationsverarbeitung unter Bedingungen begrenzter Zeit und Ressourcen ermöglichen (S001). Kognitive Verzerrungen sind systematische Abweichungen vom rationalen Urteil, die als Nebeneffekt der Anwendung von Heuristiken oder als Ergebnis der Besonderheiten der Architektur menschlichen Denkens entstehen (S003).

Sie werden oft verwechselt, weil Heuristiken tatsächlich Verzerrungen erzeugen. Das bedeutet jedoch nicht, dass Heuristiken ein Fehler sind. Es bedeutet, dass sie in manchen Kontexten funktionieren und in anderen versagen. Mehr dazu im Abschnitt Debunking und Prebunking.

Heuristiken als adaptive Werkzeuge

Heuristiken entwickelten sich als evolutionäre Anpassungen zur Lösung wiederkehrender Aufgaben unter Unsicherheit. Als unsere Vorfahren auf ein Rascheln im Gebüsch stießen, ließ die Heuristik „lieber auf Nummer sicher gehen" sie Gefahr annehmen, selbst wenn die Wahrscheinlichkeit einer Begegnung mit einem Raubtier gering war.

Der Preis eines Fehlalarms (verschwendete Energie für die Flucht) war unvergleichlich niedriger als der Preis einer übersehenen Bedrohung (Tod). Diese Asymmetrie der Risiken formte die grundlegende Architektur menschlichen Denkens, die auf schnelle, „gut genug" Entscheidungen ausgerichtet ist, nicht auf langsame, energieintensive Analyse aller Daten (S001).

Kognitive Verzerrungen als systemische Abweichungen

Kognitive Verzerrungen manifestieren sich als vorhersagbare Muster von Abweichungen von logischen oder statistischen Normen. Der Bestätigungsfehler (confirmation bias) veranlasst Menschen dazu, Informationen so zu suchen, zu interpretieren und zu erinnern, dass sie ihre bestehenden Überzeugungen bestätigen (S003).

- Verfügbarkeitsheuristik

- Menschen überschätzen die Wahrscheinlichkeit von Ereignissen, die leicht zu erinnern sind. Nach Nachrichten über einen Flugzeugabsturz überschätzen Menschen das Risiko von Flugreisen, obwohl die Luftfahrt statistisch die sicherste Transportart bleibt (S001). Diese Verzerrung funktioniert unabhängig von realen Daten.

Wenn Heuristiken zu Fallen werden

Heuristiken erzeugen kognitive Verzerrungen, wenn sie in Kontexten angewendet werden, für die sie nicht optimiert sind. Die Repräsentativitätsheuristik funktioniert gut, wenn Objekte schnell nach äußeren Merkmalen kategorisiert werden müssen, führt aber zu Fehlern, wenn Basiswahrscheinlichkeiten ignoriert werden.

| Kontext | Heuristik funktioniert | Heuristik versagt |

|---|---|---|

| Schnelle Kategorisierung (wer Feind, wer Freund) | Ja — adaptiv | Nein |

| Statistische Aufgaben (Wahrscheinlichkeiten, Basisraten) | Nein | Ja — ignoriert Daten |

| Verzögerte Konsequenzen (Investitionen, Gesundheit) | Nein | Ja — überbewertet nahe Ereignisse |

Klassisches Beispiel: Die Beschreibung einer Person als „schüchtern, methodisch, ordnungsliebend" lässt die meisten Menschen annehmen, dass sie Bibliothekar ist, nicht Landwirt, obwohl es in der Bevölkerung deutlich mehr Landwirte gibt (S003). Der Kontext der modernen Welt — mit ihren statistischen Aufgaben, abstrakten Risiken und verzögerten Konsequenzen — unterscheidet sich radikal von der Umgebung evolutionärer Anpassung.

Die stärksten Argumente für Heuristiken: Warum „schnell und grob" oft besser ist als „langsam und präzise"

Die traditionelle Sichtweise auf kognitive Verzerrungen als Denkfehler, die beseitigt werden müssen, dominierte die kognitive Psychologie seit den 1970er Jahren. Die gesammelten Daten zeigen jedoch, dass dieses Modell vereinfacht und in einigen Fällen fehlerhaft ist. Mehr dazu im Abschnitt Logik und Wahrscheinlichkeit.

Heuristiken funktionieren nicht nur „gut genug" — unter bestimmten Bedingungen übertreffen sie komplexe analytische Methoden in Genauigkeit, Geschwindigkeit und Robustheit gegenüber Datenrauschen.

⚙️ Effizienz unter begrenzten Ressourcen und Zeitdruck

Das menschliche Gehirn verbraucht etwa 20% der Körperenergie bei einer Masse von nur 2% des Körpergewichts. Eine vollständige rationale Analyse jeder Entscheidung würde astronomische Energie- und Zeitaufwendungen erfordern.

Heuristiken lösen dieses Problem durch radikale Vereinfachung: Statt alle verfügbaren Informationen zu verarbeiten, konzentrieren sie sich auf Schlüsselsignale (S001). Die „Take-the-best"-Heuristik zeigt in Experimenten eine Vorhersagegenauigkeit, die mit multifaktoriellen Regressionsmodellen vergleichbar ist, bei Nutzung nur eines Bruchteils der Informationen (S003).

- Unter realen Bedingungen ist die Entscheidungszeit auf Sekunden oder Minuten begrenzt

- Heuristiken bieten den einzig möglichen Weg zum Handeln

- Eine vollständige Analyse ist oft physiologisch unmöglich

📊 Robustheit gegen Überanpassung und Datenrauschen

Paradoxerweise macht die Einfachheit von Heuristiken sie robuster gegen Überanpassung (Overfitting) im Vergleich zu komplexen Modellen. Wenn Daten Rauschen enthalten oder die Stichprobe nicht repräsentativ ist, beginnen komplexe Algorithmen, das Modell an zufällige Fluktuationen anzupassen und verlieren die Fähigkeit zur Generalisierung.

Heuristiken, die den Großteil der Informationen ignorieren, ignorieren automatisch auch den Großteil des Rauschens. Studien zeigen, dass bei Vorhersageaufgaben mit hoher Unsicherheit (z.B. Vorhersage des Erfolgs von Start-ups oder Sportergebnissen) einfache Heuristiken oft komplexe statistische Modelle übertreffen (S003).

🧠 Kognitive Entlastung und Vermeidung von Entscheidungslähmung

Informations- und Optionsüberfluss führt zum Phänomen der „Entscheidungslähmung" (Choice Paralysis), bei dem Menschen entweder Entscheidungen endlos aufschieben oder starken Stress und Unzufriedenheit mit dem Ergebnis erleben.

Heuristiken wirken als Filter, die den Entscheidungsraum auf eine handhabbare Größe reduzieren. Die Satisficing-Heuristik — die Wahl der ersten Option, die Mindestkriterien erfüllt, statt der Suche nach dem Optimum — reduziert die kognitive Belastung und erhöht das subjektive Wohlbefinden ohne signifikanten Qualitätsverlust bei Entscheidungen (S001).

Unter den Bedingungen der Informationsüberflutung der modernen Welt wird diese Funktion von Heuristiken kritisch wichtig für die psychische Gesundheit.

🔁 Soziale Koordination und kommunikative Effizienz

Heuristiken dienen als gemeinsame kognitive Protokolle, die es Menschen ermöglichen, Handlungen ohne langwierige Verhandlungen und Erklärungen zu koordinieren. Wenn eine Gruppe dieselben Heuristiken verwendet (z.B. „folge der Mehrheit" oder „vertraue dem Experten"), werden kollektive Entscheidungen schneller getroffen und die soziale Kohäsion gestärkt.

Diese Funktion ist besonders wichtig in Krisensituationen, die sofortige Koordination ohne Möglichkeit detaillierter Diskussion erfordern (S003). Der Versuch, Heuristiken vollständig durch rationale Analyse zu ersetzen, würde diese Koordinationsinfrastruktur zerstören und kollektives Handeln unmöglich machen.

💎 Ökologische Rationalität: Passung des Werkzeugs zur Umwelt

Das Konzept der ökologischen Rationalität (Ecological Rationality) besagt, dass die Effektivität einer kognitiven Strategie nicht durch ihre Übereinstimmung mit abstrakten logischen Normen bestimmt wird, sondern durch ihre Passung zur Struktur der Umwelt, in der sie angewendet wird (S003).

Die „Imitiere-die-Erfolgreichen"-Heuristik mag aus Sicht des Bayesschen Belief-Updates irrational erscheinen, aber in Umgebungen mit hohen Kosten für individuelles Lernen durch Versuch und Irrtum ermöglicht sie schnelle Anpassung und Wissenstransfer.

Die Kritik an Heuristiken als „irrational" ignoriert oft die Tatsache, dass sie für reale und nicht für idealisierte Entscheidungsbedingungen optimiert sind.

Revolution 2024–2025: Daten zur Ausbalancierung von Verzerrungen statt deren Eliminierung

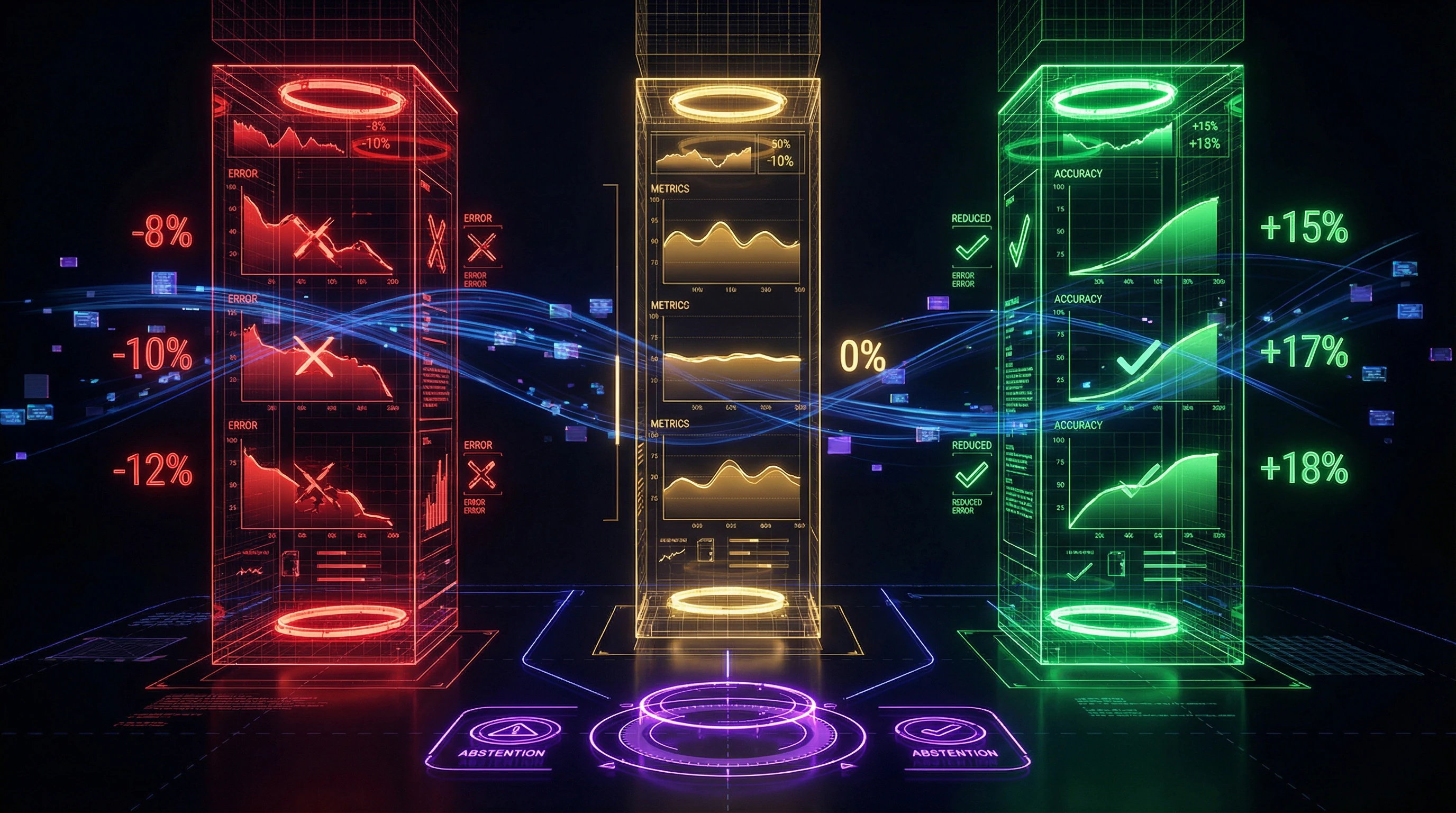

Die Studie „Balancing Rigor and Utility: Mitigating Cognitive Biases in Large Language Models for Multiple-Choice Questions" (April 2025) stellt den Standardansatz auf den Kopf: Die vollständige Eliminierung kognitiver Verzerrungen senkt die Effektivität, anstatt sie zu erhöhen (S006). Die Autoren entwickelten den BRU-Datensatz und testeten die Hypothese an großen Sprachmodellen bei der Lösung von Multiple-Choice-Aufgaben.

🔬 Methodik: Expertenmarkierung und kontrollierte Experimente

Der BRU-Datensatz wurde in Zusammenarbeit mit Experten der kognitiven Psychologie erstellt und umfasst Aufgaben, die spezifische Verzerrungen aktivieren: Ankereffekt, Framing-Effekt, Verfügbarkeitsheuristik und andere (S006). Jede Aufgabe enthält eine richtige Antwort, Distraktoren und Metadaten darüber, welche Verzerrungen aktiviert werden können.

Die Forscher testeten drei Strategien: vollständige Unterdrückung von Heuristiken durch Instruktionen, Moderation (selektive Nutzung) und Einführung einer Enthaltungsoption bei hoher Unsicherheit. Mehr dazu im Abschnitt Quellen und Evidenz.

📊 Ergebnisse: Moderation übertrifft Eliminierung

| Strategie | Veränderung der Genauigkeit | Fehlerreduktion | Ressourcenaufwand |

|---|---|---|---|

| Vollständige Unterdrückung von Heuristiken | −8–12% | Gering | Hoch |

| Moderation (selektive Nutzung) | +15–18% | −23% | Optimal |

| Enthaltungsoption bei Unsicherheit | Stabil | −19% | Minimal |

Modelle, denen die Nutzung mentaler Abkürzungen verboten wurde, verbrauchten mehr Ressourcen und fielen häufiger in die Falle des Overfittings auf irrelevante Details (S006). Die Moderationsstrategie – gezielte Inspektion aktiver Verzerrungen und bewusste Entscheidung, ob man ihnen folgt – erhöhte die Genauigkeit um 15–18%.

🧾 Enthaltung: Wenn „Ich weiß es nicht" besser ist als Raten

Die Enthaltungsoption bei hoher Unsicherheit reduzierte Fehler um 19% bei geringfügiger Verringerung gelöster Aufgaben (S006). Experten zeichnen sich nicht nur durch Genauigkeit aus, sondern auch durch die Fähigkeit, die Grenzen ihrer Kompetenz zu erkennen.

Der Versuch, eine Antwort bei unzureichenden Daten zu erzwingen, führt systematisch zu Fehlern, die durch das Anerkennen von Unsicherheit vermieden werden können.

🧬 Mechanismus: Metakognitives Monitoring

Die Effektivität der Moderation erklärt sich durch die Aktivierung der metakognitiven Ebene – des Monitorings eigener Prozesse (S006). Anstatt Heuristiken automatisch zu folgen oder vollständig zu unterdrücken, lernen Modelle (und Menschen), Fragen zu stellen:

- Welche Heuristik ist gerade aktiv?

- Ist sie für diese spezifische Aufgabe geeignet?

- Welche Anzeichen deuten darauf hin, dass die Heuristik zu einem Fehler führen könnte?

- Sind ausreichend Daten für ein zuverlässiges Urteil vorhanden?

Dieser Prozess erfordert zusätzliche Ressourcen, aber deutlich weniger als der vollständige Verzicht auf Heuristiken, und gewährleistet eine optimale Balance zwischen Geschwindigkeit und Genauigkeit.

🔁 Von LLM zum menschlichen Denken

LLM zeigen Verzerrungen, die strukturell denen von Menschen ähneln, weil sie auf menschlichen Texten trainiert werden und Muster menschlichen Denkens übernehmen (S006). Das Ausbalancierungsprotokoll – Inspektion aktiver Heuristiken, Bewertung ihrer Anwendbarkeit und Bereitschaft zur Enthaltung bei Unsicherheit – lässt sich als praktische Strategie zur Verbesserung von Entscheidungen adaptieren, ohne das unrealistische Ziel der vollständigen Eliminierung von Verzerrungen zu verfolgen.

Dies ist besonders relevant in Kontexten, in denen die Verfügbarkeitsheuristik die Risikowahrnehmung verzerrt oder wo das Ignorieren der Basisrate zu falschen Schlussfolgerungen über Wahrscheinlichkeiten führt.

Neurobiologische Mechanismen: Warum das Gehirn Geschwindigkeit statt Genauigkeit wählt

Kognitive Verzerrungen sind nicht deshalb so beständig, weil wir dumm sind, sondern weil sie auf der Ebene neuronaler Netzwerke und Neurotransmittersysteme in die Architektur des Gehirns eingebaut sind. Heuristiken sind keine Programmfehler, die sich durch ein Update beheben lassen. Mehr dazu im Abschnitt Wissenschaftliche Methode.

🧬 Zwei-Systeme-Modell des Denkens: System 1 und System 2

System 1 arbeitet schnell, parallel, automatisch und benötigt minimal Energie. System 2 ist langsam, sequenziell, erfordert bewusste Aufmerksamkeit und ist energetisch aufwendig (S001).

Die meisten Entscheidungen trifft System 1, weil die Aktivierung von System 2 für jede Aufgabe die kognitiven Ressourcen innerhalb weniger Stunden erschöpfen würde. Kognitive Verzerrungen sind Nebeneffekte der Arbeit von System 1, der Preis für Geschwindigkeit.

Das Gehirn irrt nicht – es spart. Heuristiken sind keine Bugs, sondern Features der Evolution.

⚙️ Die Rolle von Emotionen bei der Bildung heuristischer Urteile

Emotionen dienen als schnelle Bewertungssignale, die komplexe Informationen in einfache Markierungen „gut/schlecht", „sicher/gefährlich" integrieren (S002). Somatische Marker – körperliche Empfindungen, die mit Wahlmöglichkeiten assoziiert sind – lenken die Aufmerksamkeit und beschleunigen Entscheidungen, indem sie inakzeptable Optionen noch vor Beginn der bewussten Analyse ausschließen.

Die Affektheuristik nutzt emotionale Reaktionen als Proxy für die Risikobewertung: Wenn etwas positive Emotionen auslöst, unterschätzen wir Risiken und überschätzen Vorteile (S001). Evolutionär ist dies gerechtfertigt – Emotionen spiegeln akkumulierte Erfahrung wider und enthalten oft Informationen, die der bewussten Analyse nicht zugänglich sind.

| Mechanismus | Funktion | Kosten |

|---|---|---|

| Somatische Marker | Schnelle Filterung von Optionen | Kann nützliche Varianten ausschließen |

| Affektive Heuristik | Integration komplexer Informationen | Verzerrung der Risikobewertung |

| Parallele Verarbeitung | Gleichzeitige Analyse vieler Signale | Oberflächliche Verarbeitung von Details |

🔁 Neuroplastizität und Beständigkeit kognitiver Muster

Sich wiederholende Denkmuster bilden durch Langzeitpotenzierung stabile neuronale Bahnen. Je häufiger eine Heuristik aktiviert wird, desto stärker werden die synaptischen Verbindungen, die sie unterstützen (S002).

Dies erklärt, warum Verzerrungen schwer „umzulernen" sind: Sie sind keine bewussten Überzeugungen, sondern tief verwurzelte neuronale Gewohnheiten. Korrektur erfordert nicht nur Wissen über die Existenz der Verzerrung, sondern wiederholte Praxis alternativer Strategien in realen Entscheidungskontexten.

🧷 Dopaminerges System und Verstärkung von Heuristiken

Das dopaminerge System festigt Heuristiken durch Verstärkung. Wenn eine Heuristik zu schnellem Erfolg führt, verstärkt die Dopaminausschüttung die neuronalen Bahnen, die mit dieser Strategie verbunden sind (S002).

Das Problem: Das dopaminerge System reagiert auf unmittelbare Ergebnisse, nicht auf langfristige Konsequenzen. Eine Heuristik, die eine schnelle Lösung liefert, erhält neurochemische Verstärkung, während langsame Analyse, die später zu besseren Ergebnissen führt, möglicherweise keine ausreichende Verstärkung erhält.

Die strukturelle Verzerrung zugunsten von Heuristiken ist in die Neurochemie des Gehirns selbst eingebaut. Dies ist kein Designfehler – es ist ein Kompromiss zwischen Geschwindigkeit und Genauigkeit, optimiert für das Überleben, nicht für Statistik.

Das Verständnis dieser Mechanismen erklärt, warum mentale Fehler so beständig sind und warum bloßes Wissen über sie selten zu Verhaltensänderungen führt. Die Neurobiologie zeigt: Der Kampf gegen Heuristiken ist ein Kampf gegen die Architektur des Gehirns, nicht gegen die Logik.

Datenkonflikte und Unsicherheitszonen: Wo die Quellen divergieren

Der Konsens, dass kognitive Verzerrungen nicht rein negativ sind, koexistiert mit tiefgreifenden Meinungsverschiedenheiten in der Literatur. Die Frage ist nicht, ob Heuristiken nützlich sind, sondern unter welchen Bedingungen sie funktionieren — und wann sie systematisch versagen. Mehr dazu im Abschnitt Statistik und Wahrscheinlichkeitstheorie.

🧩 Debatten über normative Rationalitätsstandards

Der Konflikt beginnt bei der Definition des Wortes „Rationalität" selbst. Der traditionelle Ansatz verwendet Logik und Wahrscheinlichkeitstheorie als Maßstab: Jede Abweichung von der bayesianischen Aktualisierung von Überzeugungen gilt als Fehler (S003).

Der alternative Ansatz — ökologische Rationalität — dreht die Logik um: Rationalität wird nicht an abstrakten formalen Systemen gemessen, sondern daran, wie gut eine Entscheidung zur Struktur der Umgebung und den Zielen des Akteurs passt (S003). Dieselbe Heuristik ist in einem Paradigma ein Fehler, im anderen eine Anpassung.

Die Wahl des normativen Standards bestimmt die Schlussfolgerung. Dies ist keine wissenschaftliche Debatte — es ist eine Wahl der Axiome.

🔬 Widersprüche in der Übertragbarkeit der Ergebnisse

Die meisten Heuristik-Studien werden in Laboren mit abstrakten Aufgaben durchgeführt. Ein Student löst ein logisches Rätsel in Ruhe — das ist nicht dasselbe wie ein Arzt, der unter Zeitdruck, emotionaler Belastung und sozialem Druck eine Entscheidung trifft (S003).

Die BRU-Studie verwendete große Sprachmodelle für kontrollierte Analysen, aber das wirft eine neue Frage auf: Inwieweit modellieren LLMs menschliches Denken, wenn körperliche Empfindungen, Emotionen und sozialer Kontext ins Spiel kommen (S006)?

- Laboreffekt

- Heuristiken funktionieren unter kontrollierten Bedingungen, können aber in der Realität versagen, wo es mehr Variablen gibt als in jedem Experiment.

- Modellkluft

- Daten über LLMs garantieren nicht, dass das menschliche Gehirn genauso funktioniert — besonders wenn Emotionen und soziale Signale beteiligt sind.

📊 Unsicherheit bei Langzeiteffekten

Fast alle Studien messen das unmittelbare Ergebnis: die richtige Antwort auf eine Aufgabe, die Genauigkeit einer Diagnose in diesem Moment. Aber eine Heuristik kann jetzt optimal und in einem Jahr destruktiv sein.

Beispiel: Die Heuristik „folge der Mehrheit" ermöglicht schnelle soziale Integration und spart kognitive Ressourcen. Aber sie löst auch Informationskaskaden und kollektive Fehler aus — Gruppendenken (S003). Das Fehlen von Längsschnittstudien, die Konsequenzen über Monate und Jahre verfolgen, hinterlässt eine enorme Unsicherheitszone.

- Kurzfristiges Ergebnis: Die Heuristik liefert eine schnelle Lösung.

- Mittelfristiger Effekt: Das Muster wiederholt sich, verfestigt sich.

- Langfristiges Resultat: Akkumulierte Fehler oder adaptiver Vorteil — unbekannt.

Drei Rationalitätsparadigmen, drei Kontexttypen, drei Zeithorizonte — und in jeder Kombination ergibt sich eine andere Antwort. Das ist kein Mangel der Wissenschaft. Es ist ein Zeichen dafür, dass die Frage komplexer ist, als sie schien.

Kognitive Anatomie von Verzerrungen: Welche mentalen Fallen am häufigsten ausgenutzt werden

Das Verständnis der konkreten Mechanismen, durch die kognitive Verzerrungen Entscheidungen beeinflussen, ermöglicht die Entwicklung gezielter Kompensationsstrategien. Nicht alle Fallen sind gleich gefährlich — einige greifen in engen Kontexten, andere durchziehen das gesamte Urteilsspektrum. Mehr dazu im Abschnitt Mythen über bewusste KI.

Medizin, Recht und Ingenieurwesen zeigen, wo Verzerrungen maximalen Schaden anrichten (S001, S003, S004). Das ist kein Zufall: In diesen Bereichen werden Entscheidungen unter Zeitdruck, unvollständiger Information und hohen Einsätzen getroffen.

- Ankereffekt — die erste Zahl oder Tatsache blockiert die Neubewertung. Ein Arzt hört eine Vorabdiagnose und passt die Symptome daran an (S001).

- Verfügbarkeitsheuristik — prägnante Beispiele erscheinen typischer, als sie sind. Ein Flugzeugabsturz bleibt im Gedächtnis, Statistiken nicht.

- Vernachlässigung der Basisrate — Menschen vergessen Hintergrundwahrscheinlichkeiten. Ein Test mit 99% Genauigkeit kann 90% Fehldiagnosen liefern, wenn die Krankheit selten ist (S004).

- Bestätigungsfehler — das Gehirn sucht nach Fakten, die bereits gebildete Meinungen bestätigen, und ignoriert Widersprüche.

- Dunning-Kruger-Effekt — inkompetente Menschen überschätzen ihr Wissen. Gefährlich in Chirurgie und Diagnostik (S003).

Jede Falle hat einen Auslöser: Zeit, Emotion, sozialer Druck, Datenunvollständigkeit. Den Auslöser zu erkennen bedeutet, die Verzerrung abzufangen, bevor sie die Wahl beeinflusst.

Gruppendenken und falsche Dichotomie sind besonders gefährlich in Organisationen und Politik, wo Entscheidungen Tausende von Menschen betreffen (S005).

Sekten und Pseudomedizin nutzen genau diese Mechanismen aus: Ankerung an die Charisma des Anführers, Verfügbarkeit emotionaler Heilungsgeschichten, Bestätigungsfehler bei der Interpretation von Ergebnissen. Kontrolle beginnt mit kognitiver Falle, nicht mit Gewalt.

Die Strategie besteht nicht darin, Verzerrungen zu „vermeiden" — das ist unmöglich. Die Strategie besteht darin, zu wissen, wo sie greifen, und Kontrollen einzubauen: Zweitmeinung in der Medizin, statistische Kompetenz in der Datenanalyse, Debugging-Protokolle des Denkens bei Teamentscheidungen.