Base Rate Neglect: Kognitive Blindheit, die präzise Instrumente in Fehlergeneratoren verwandelt

Base Rate Neglect (Vernachlässigung der Basisrate) ist eine systematische kognitive Verzerrung, bei der Menschen die statistische Häufigkeit eines Ereignisses in der Grundgesamtheit ignorieren und sich auf spezifische Informationen über den Einzelfall konzentrieren (S001).

Die Enzyklopädie der Sozialpsychologie definiert dies als Fehler in Wahrscheinlichkeitsurteilen: Individuen vernachlässigen Informationen über die Häufigkeit eines Ereignisses in der Population und verlassen sich auf auffällige, aber statistisch weniger bedeutsame Details. Mehr dazu im Abschnitt Quellen und Evidenz.

Struktur des Fehlers: Drei Komponenten, die eine Illusion von Präzision erzeugen

Die klassische Struktur umfasst drei Elemente:

- Basisrate (Prior Probability)

- Häufigkeit des Ereignisses in der Population — beispielsweise haben 0,1% der Bevölkerung Krankheit X.

- Sensitivität des Tests (True Positive Rate)

- Der Test identifiziert 99% der Kranken korrekt.

- Spezifität des Tests (True Negative Rate)

- Der Test identifiziert 99% der Gesunden korrekt.

Der menschliche Verstand konzentriert sich intuitiv auf Sensitivität und Spezifität, nimmt „99% Genauigkeit" als Garantie wahr und ignoriert die Seltenheit der Krankheit selbst vollständig.

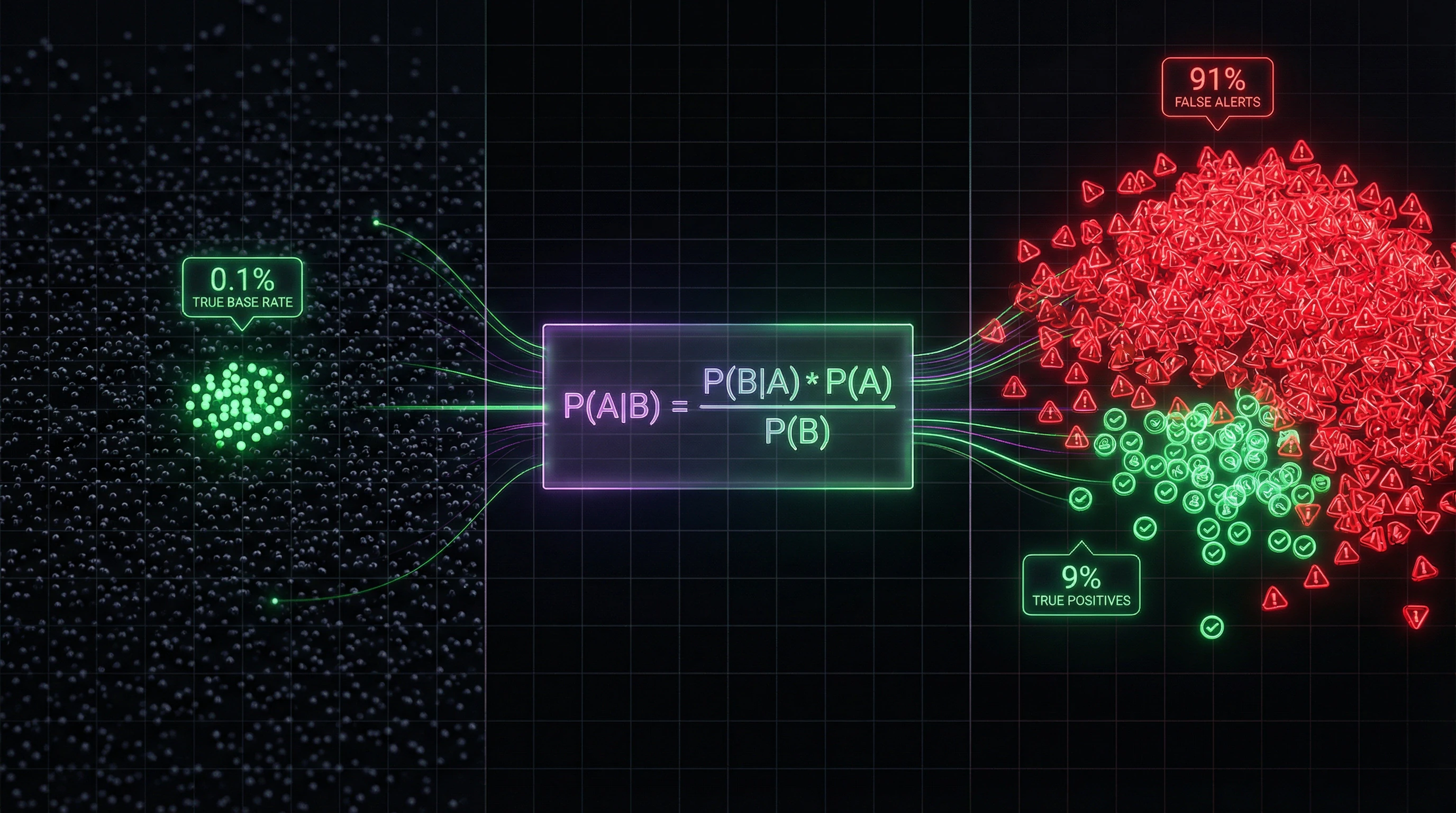

Warum 99% Genauigkeit 90% Fehlalarme bedeuten kann

Konkretes Beispiel: Die Krankheit tritt bei 1 von 1.000 Personen auf (Basisrate 0,1%). Der Test hat 99% Sensitivität und 99% Spezifität. Wir testen 100.000 Personen.

| Gruppe | Anzahl | Testergebnis | Anzahl Personen |

|---|---|---|---|

| Kranke (0,1%) | 100 | Richtig positiv (99%) | 99 |

| Gesunde (99,9%) | 99.900 | Falsch positiv (1%) | 999 |

| Gesamt positive Ergebnisse | 1.098 | ||

Wahrscheinlichkeit, dass eine Person mit positivem Ergebnis tatsächlich krank ist: 99 / 1.098 ≈ 9%. Wahrscheinlichkeit eines Fehlalarms: 999 / 1.098 ≈ 91%.

Grenzen des Phänomens: Vom individuellen Fehler zum systemischen Problem

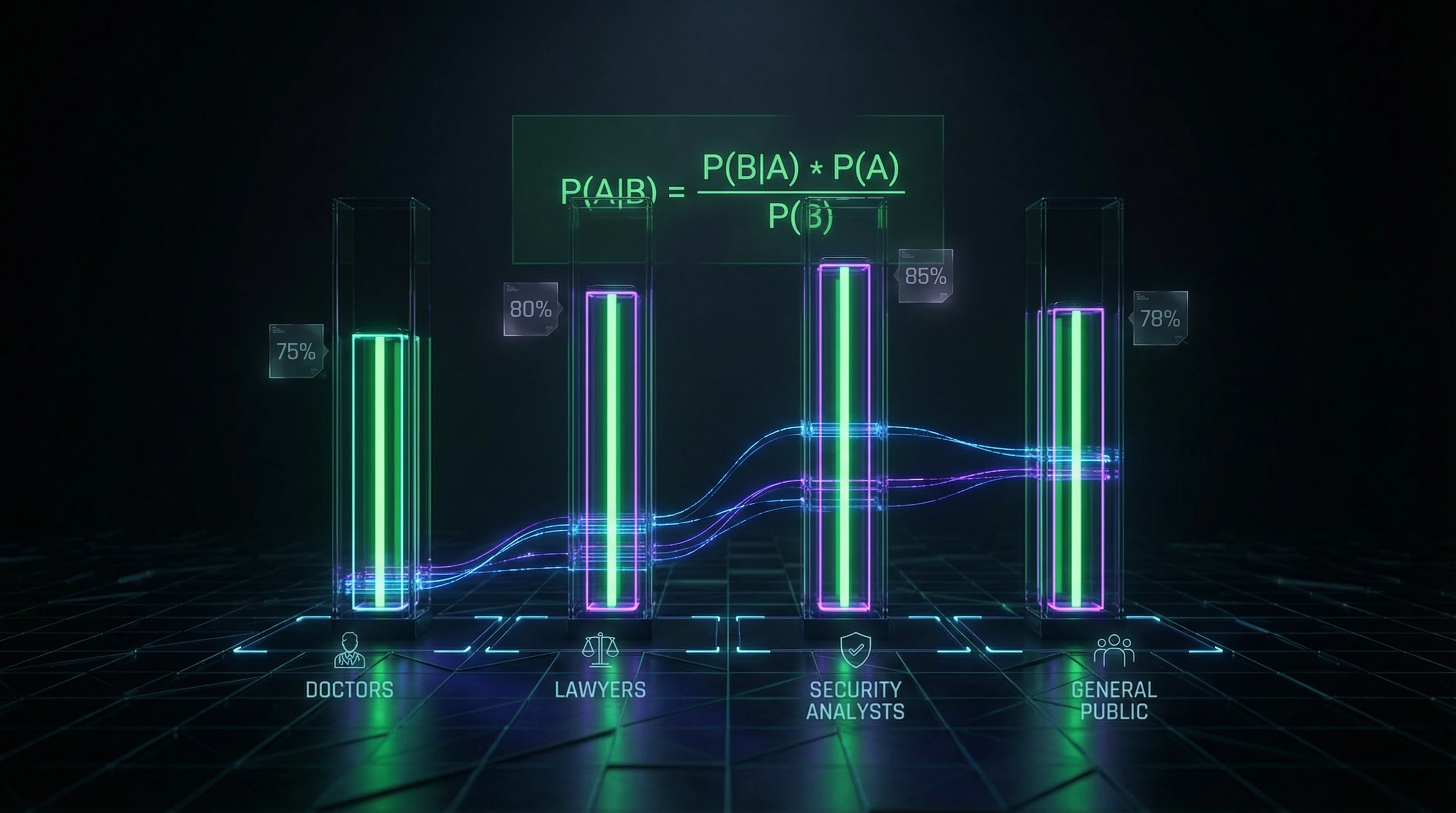

Base Rate Neglect ist nicht nur ein individueller Urteilsfehler. Diesem Fehler unterliegen Profis: Ärzte interpretieren Screening-Testergebnisse falsch, Richter überschätzen die Wahrscheinlichkeit von Schuld aufgrund von Gutachten, Cybersicherheitsspezialisten generieren Lawinen von Fehlalarmen (S001).

Das Phänomen zeigt sich in jeder Situation, die eine Integration statistischer Basisinformationen mit konkreten Falldaten erfordert — von Risikobewertung über medizinische Diagnostik bis zur Bewertung von Sicherheitsbedrohungen.

Sieben Argumente, die das Ignorieren der Basisrate so überzeugend und gefährlich machen

Das Ignorieren der Basisrate ist nicht das Ergebnis von Dummheit. Es ist die Folge tief verwurzelter Besonderheiten der menschlichen Kognition, die in den meisten Situationen effizient funktionieren, aber im Kontext probabilistischer Urteile systematische Verzerrungen erzeugen. Mehr dazu im Abschnitt Grundlagen der Erkenntnistheorie.

⚠️ Argument 1: Konkrete Informationen sind psychologisch eindrücklicher als abstrakte Statistiken

Das Gehirn hat sich entwickelt, um konkrete, anschauliche Ereignisse zu verarbeiten, nicht abstrakte Verteilungen. Die Information, dass „der Test gerade bei Ihnen positiv ausgefallen ist", wird als relevanter wahrgenommen als die abstrakte Information, dass „diese Erkrankung in der Bevölkerung selten vorkommt" (S001).

Die psychologische Eindringlichkeit des konkreten Falls unterdrückt den statistischen Kontext – dies ist kein Logikfehler, sondern eine Besonderheit der Aufmerksamkeitsarchitektur.

⚠️ Argument 2: Repräsentativität dominiert über Wahrscheinlichkeit in intuitiven Urteilen

Menschen bewerten die Wahrscheinlichkeit eines Ereignisses nicht nach seiner statistischen Häufigkeit, sondern danach, wie „repräsentativ" es ist – wie gut es einem Prototyp oder Stereotyp entspricht (S002). Wenn Symptome oder Testergebnisse einer Erkrankung „ähneln", erhöht das Gehirn automatisch die Wahrscheinlichkeitseinschätzung und ignoriert die Basisrate.

Die Repräsentativitätsheuristik ist eine schnelle, aber systematisch verzerrte Urteilsmethode, die bei seltenen Ereignissen gegen Sie arbeitet.

⚠️ Argument 3: Professionelle Expertise erzeugt die Illusion, dass die Basisrate „bereits berücksichtigt" wurde

Ärzte, Juristen und Sicherheitsanalysten gehen oft davon aus, dass ihre Erfahrung automatisch die Notwendigkeit kompensiert, Basisraten explizit zu berücksichtigen. Der Experte denkt: „Ich weiß, dass dies eine seltene Erkrankung ist, aber die Symptome sind so spezifisch, dass die Basisrate nicht anwendbar ist".

Dies ist eine Illusion – die Mathematik des Bayes-Theorems hängt nicht von der Expertenmeinung über die „Spezifität" des Falls ab (S004).

⚠️ Argument 4: Ausbildungssysteme fokussieren auf Testgenauigkeit, nicht auf Ergebnisinterpretation

Die medizinische Ausbildung lehrt, Sensitivität und Spezifität diagnostischer Tests zu bewerten, trainiert aber selten die Fähigkeit, diese Kennzahlen mit der Basisrate der Erkrankung in einer konkreten Population zu integrieren. Cybersicherheitsspezialisten lernen, Intrusion-Detection-Systeme für maximale Sensitivität zu konfigurieren, aber nicht zur Minimierung falsch-positiver Alarme unter Berücksichtigung der realen Angriffshäufigkeit.

Bildungssysteme reproduzieren den Fehler auf institutioneller Ebene.

⚠️ Argument 5: Asymmetrie der Konsequenzen schafft Motivation, die Basisrate zu ignorieren

In der Medizin wird das Übersehen einer seltenen, aber gefährlichen Erkrankung als schwerwiegenderer Fehler wahrgenommen als Panik durch eine Fehldiagnose auszulösen. In der Cybersicherheit ist das Übersehen eines echten Angriffs katastrophaler als das Generieren tausender Fehlalarme.

| Bereich | Falsch-negatives Ergebnis | Falsch-positives Ergebnis | Systemdruck |

|---|---|---|---|

| Medizin | Patient erhält keine Behandlung für seltene Erkrankung | Patient durchläuft unnötige Untersuchung | Erhöhung der Sensitivität |

| Cybersicherheit | Echter Angriff bleibt unbemerkt | Fehlalarm lenkt Analysten ab | Erhöhung der Sensitivität |

Diese Asymmetrie erzeugt institutionellen Druck in Richtung „Absicherung" – Erhöhung der Sensitivität von Systemen ohne zu berücksichtigen, dass dies bei niedriger Basisrate zu einer Lawine von Fehlalarmen führt.

⚠️ Argument 6: Kaskadeneffekte in Entscheidungsketten verstärken den ursprünglichen Fehler

Der Basisratenfehler auf einer Stufe wird zu Eingangsdaten für die nächste Stufe. Ein Arzt, der ein falsch-positives Screening-Ergebnis erhält, ordnet eine invasivere Untersuchung an, die selbst Risiken birgt und neue falsch-positive Ergebnisse liefern kann.

Ein Sicherheitsanalyst, der auf einen Fehlalarm des Intrusion-Detection-Systems reagiert, kann normale Aktivität als verdächtig interpretieren und eine Kaskade fehlerhafter Schlussfolgerungen erzeugen.

⚠️ Argument 7: Fehlendes Feedback macht den Fehler für Praktiker unsichtbar

Ein Arzt, der einen Patienten mit falsch-positivem Ergebnis zur weiteren Untersuchung überweist, erfährt selten die endgültige Diagnose – der Patient geht zu einem anderen Spezialisten. Der Sicherheitsanalyst erhält kein systematisches Feedback darüber, wie viele seiner Alarme Fehlalarme waren.

- Ohne explizites Feedback können Fachleute ihre intuitiven Wahrscheinlichkeitseinschätzungen nicht kalibrieren.

- Der Fehler reproduziert sich endlos und wird in die Routine eingebettet.

- Der Praktiker bleibt von der Richtigkeit seines Ansatzes überzeugt, weil er das vollständige Bild der Konsequenzen nicht sieht.

Dies erzeugt einen geschlossenen Kreislauf: Der Fehler bleibt unsichtbar, wird daher nicht korrigiert und reproduziert sich erneut.

Evidenzbasis: Was empirische Studien zur Vernachlässigung der Basisrate zeigen

Das Phänomen der Vernachlässigung der Basisrate wurde erstmals systematisch in einer Reihe von Experimenten von Kahneman und Tversky in den 1970er Jahren beschrieben und seitdem in Hunderten von Studien in verschiedenen Kontexten reproduziert — von Laborexperimenten bis zur Analyse realer professioneller Entscheidungen (S001).

📊 Klassische Experimente: Wie Menschen Statistiken selbst bei expliziter Präsentation ignorieren

In der ursprünglichen Studie von Kahneman und Tversky wurde den Teilnehmern folgende Aufgabe gestellt: „In einer Stadt sind 85% der Taxis grün und 15% blau. Ein Zeuge eines Unfalls behauptet, ein blaues Taxi gesehen zu haben. Die Zuverlässigkeit des Zeugen wurde geprüft: Er identifiziert die Farbe in 80% der Fälle korrekt. Wie hoch ist die Wahrscheinlichkeit, dass das Taxi tatsächlich blau war?" Die korrekte Antwort nach dem Bayes-Theorem: etwa 41%. Die typische Antwort der Teilnehmer: 80% — sie ignorierten die Basisrate (85% grüne Taxis) vollständig und konzentrierten sich nur auf die Zuverlässigkeit des Zeugen (S001).

Menschen integrieren Informationen nicht. Sie ersetzen eine komplexe Berechnung durch eine einfache Regel: „Der Zeuge ist zu 80% zuverlässig — also ist die Antwort 80%". Das ist kein Rechenfehler. Das ist die Verweigerung der Berechnung.

📊 Medizinische Diagnostik: Ärzte machen denselben Fehler wie Laien

Eine Studie, in der Ärzten die Aufgabe gestellt wurde, Mammographie-Ergebnisse zu interpretieren, zeigte eine massive Vernachlässigung der Basisrate. Den Teilnehmern wurde mitgeteilt: Die Basisrate für Brustkrebs in der Screening-Population beträgt 1%, die Sensitivität der Mammographie 90%, die Rate falsch-positiver Ergebnisse 9%. Frage: Wie hoch ist die Wahrscheinlichkeit für Krebs bei einem positiven Ergebnis? Die korrekte Antwort: etwa 9%. Die mediane Antwort der Ärzte: 75%. Die Mehrheit der Ärzte überschätzte die Krebswahrscheinlichkeit um das 8-fache, indem sie die niedrige Basisrate ignorierten (S002).

Das ist kein Kompetenzproblem. Ärzte kennen Statistik. Das Problem ist, dass die Verfügbarkeitsheuristik und die Konkretheit des klinischen Falls abstrakte Zahlen überwiegen. Mehr dazu im Abschnitt Medienkompetenz.

📊 Cybersicherheit: Lawine von Fehlalarmen als Folge der Vernachlässigung der Basisrate von Angriffen

Eine systematische Übersicht über die Anwendung von Intrusion Detection Systems (IDS) in der Cybersicherheit zeigte, dass die Vernachlässigung der Basisrate realer Angriffe zu einem katastrophalen Verhältnis von falschen zu echten Alarmen führt (S004). Bei einer typischen Basisrate von Angriffen von 0,01% (1 Angriff auf 10.000 Ereignisse) und einer IDS-Sensitivität von 99% wird ein System mit einer Fehlalarmrate von 1% 100 Fehlalarme pro echtem Angriff generieren.

| Parameter | Wert | Konsequenz |

|---|---|---|

| Basisrate der Angriffe | 0,01% | Angriffe sind selten |

| IDS-Sensitivität | 99% | Erkennt 99% der echten Angriffe |

| Fehlalarme | 1% | 100 falsche auf 1 echten |

Sicherheitsanalysten unterschätzen systematisch das Ausmaß dieses Problems, indem sie sich auf die „hohe Genauigkeit" des Systems (99%) konzentrieren und die Seltenheit echter Angriffe ignorieren (S004).

📊 Justizsystem: Sachverständigengutachten und Überschätzung der Schuldwahrscheinlichkeit

Die Analyse der Verwendung probabilistischer Sachverständigengutachten in Gerichtsverfahren (z.B. DNA-Übereinstimmung, ballistische Expertise) zeigte, dass Geschworene und Richter die Schuldwahrscheinlichkeit systematisch überschätzen, indem sie die Basisrate von Verbrechen in der Population ignorieren. Wenn ein Sachverständiger mitteilt, dass „die Wahrscheinlichkeit einer zufälligen DNA-Übereinstimmung 1 zu einer Million beträgt", interpretieren Geschworene dies als „die Wahrscheinlichkeit der Unschuld beträgt 1 zu einer Million", wobei sie die A-priori-Wahrscheinlichkeit vollständig ignorieren, dass eine zufällige Person aus der Population dieses Verbrechen begangen hat (S002).

- Staatsanwalts-Trugschluss

- Verwechslung zwischen P(Übereinstimmung | schuldig) und P(schuldig | Übereinstimmung). Ersteres ist nahe 1, letzteres hängt von der Basisrate der Verbrechen und anderen Verdächtigen ab.

- Warum das gefährlich ist

- Eine unschuldige Person kann verurteilt werden, wenn ihre DNA zufällig mit der DNA am Tatort übereinstimmt und das Gericht ignoriert, dass es in der Population Millionen Menschen mit ähnlicher DNA gibt.

🧾 Meta-Analyse: Robustheit des Effekts in verschiedenen Populationen und Kontexten

Eine Meta-Analyse von Studien zur Vernachlässigung der Basisrate zeigte, dass der Effekt über verschiedene Kulturen, Altersgruppen und Bildungsniveaus hinweg robust ist (S001). Die Effektgröße variiert je nach Art der Informationspräsentation: Wenn die Basisrate als natürliche Häufigkeiten (z.B. „10 von 1000") statt als Prozentsätze (z.B. „1%") dargestellt wird, verringert sich der Fehler, verschwindet aber nicht vollständig.

- Natürliche Häufigkeiten reduzieren den Fehler um 20–40%, beseitigen ihn aber nicht

- Visualisierung (Diagramme, Grafiken) hilft besser als Text

- Selbst bei optimalem Format ignoriert ein erheblicher Teil der Teilnehmer weiterhin die Basisrate

- Bildung und Erfahrung schwächen den Effekt ab, heben ihn aber nicht auf

🔬 Neurokognitive Korrelate: Welche Gehirnsysteme am Fehler beteiligt sind

Neuroimaging-Studien zeigten, dass Aufgaben, die die Integration der Basisrate mit konkreten Informationen erfordern, den dorsolateralen präfrontalen Kortex aktivieren — einen Bereich, der mit Arbeitsgedächtnis und kognitiver Kontrolle verbunden ist (S005). Teilnehmer, die die Basisrate erfolgreich berücksichtigen, zeigen eine höhere Aktivierung in diesem Bereich, was darauf hinweist, dass die richtige Lösung die Unterdrückung der intuitiven Antwort und eine explizite analytische Anstrengung erfordert.

Die richtige Antwort erfordert kognitive Ressourcen, die unter realen Bedingungen oft aufgrund von Belastung, Stress oder Zeitmangel nicht verfügbar sind. Der Fehler ist keine Dummheit. Es ist Energieeinsparung des Gehirns, die in Hochrisikosituationen gefährlich wird.

Das erklärt, warum Gruppendenken die Vernachlässigung der Basisrate verstärkt: In der Gruppe unterdrückt sozialer Druck die analytische Anstrengung noch stärker.

Mechanismus des Fehlers: Warum das Gehirn systematisch die Basisrate ignoriert

Die Vernachlässigung der Basisrate ist kein zufälliger Fehler, sondern eine systematische Folge der Architektur menschlicher Kognition. Das Verständnis des Mechanismus ist entscheidend für die Entwicklung wirksamer Präventionsstrategien. Mehr dazu im Abschnitt Kognitive Verzerrungen.

🧬 Repräsentativitätsheuristik: Schnelles Urteil statt langsamer Berechnung

Kahneman und Tversky zeigten, dass Menschen die Wahrscheinlichkeit eines Ereignisses nicht durch formale Anwendung des Bayes-Theorems bewerten, sondern durch die Repräsentativitätsheuristik: „Wie sehr ähnelt A dem B?" (S001). Wenn die Symptome eines Patienten dem „typischen" Krankheitsbild ähneln, erhöht das Gehirn automatisch die Wahrscheinlichkeitseinschätzung dieser Krankheit und ignoriert dabei deren Seltenheit.

Diese Heuristik arbeitet schnell und liefert in den meisten Situationen akzeptable Ergebnisse, irrt jedoch systematisch in Situationen mit niedriger Basisrate und hoher Spezifität der Information. Die Ähnlichkeit mit dem Prototyp wird stärker als die statistische Realität.

Das Gehirn fragt: „Wem ähnelt das?" — und nicht: „Wie häufig kommt das vor?"

🧬 Konkurrenz der Systeme: Intuitives System 1 gegen analytisches System 2

In den Begriffen von Kahnemans Zwei-Systeme-Modell ist die Vernachlässigung der Basisrate die Dominanz des schnellen intuitiven Systems 1 über das langsame analytische System 2. System 1 generiert automatisch eine Antwort basierend auf Repräsentativität und Verfügbarkeit von Informationen.

System 2 ist in der Lage, das Bayes-Theorem anzuwenden und die Basisrate zu berücksichtigen, aber das erfordert explizite Anstrengung, Zeit und Motivation. Unter Bedingungen kognitiver Belastung, Zeitdruck oder fehlender expliziter Signale für die Notwendigkeit analytischen Denkens wird System 2 nicht aktiviert, und die fehlerhafte Antwort von System 1 dominiert (S004).

| System 1 (intuitiv) | System 2 (analytisch) |

|---|---|

| Automatisch, schnell | Erfordert Anstrengung, langsam |

| Stützt sich auf Ähnlichkeit und Verfügbarkeit | Wendet formale Logik an |

| Standardmäßig aktiv | Wird bei expliziter Notwendigkeit aktiviert |

| Ignoriert die Basisrate | Berücksichtigt die Basisrate |

🔁 Framing-Effekt: Wie das Präsentationsformat der Information den Fehler moduliert

Studien zeigten, dass das Format der Präsentation probabilistischer Informationen die Häufigkeit des Basisratenfehlers kritisch beeinflusst (S002). Wenn Informationen in Form von Prozentsätzen oder Wahrscheinlichkeiten präsentiert werden („1% der Bevölkerung hat die Krankheit, der Test hat 99% Genauigkeit"), ist der Fehler maximal.

Wenn dieselbe Information in Form natürlicher Häufigkeiten präsentiert wird („von 1000 Menschen haben 10 die Krankheit, der Test identifiziert korrekt 9 davon und markiert fälschlicherweise 10 Gesunde"), sinkt der Fehler signifikant. Dies deutet darauf hin, dass das menschliche Gehirn evolutionär an die Verarbeitung von Häufigkeiten und nicht an abstrakte Wahrscheinlichkeiten angepasst ist.

- Natürliche Häufigkeiten

- Darstellung von Informationen in Form konkreter Zahlen aus einer Population (z.B. „von 1000"). Aktiviert System 2 und reduziert den Basisratenfehler um 50–70%.

- Abstrakte Wahrscheinlichkeiten

- Darstellung in Form von Prozentsätzen oder Dezimalbrüchen. Verbleibt im Modus von System 1, Fehler ist maximal.

🧬 Motivationale Verzerrungen: Wenn Wünschenswertes die Einschätzung des Wahrscheinlichen beeinflusst

Die Vernachlässigung der Basisrate wird durch motivationale Faktoren verstärkt. Wenn eine Person eine bestimmte Krankheit fürchtet, neigt sie dazu, deren Wahrscheinlichkeit selbst bei niedriger Basisrate und unspezifischen Symptomen zu überschätzen.

Wenn ein Sicherheitsanalyst unter dem Druck steht, „keinen Angriff zu übersehen", neigt er dazu, jede Anomalie als Bedrohung zu interpretieren und dabei die niedrige Basisrate tatsächlicher Angriffe zu ignorieren. Motivation verzerrt nicht nur die Interpretation von Informationen, sondern auch die Bereitschaft selbst, analytisches Denken anzuwenden (S001).

Angst und Druck verzerren nicht nur das Urteil — sie schalten analytisches Denken von Grund auf ab.

Der Zusammenhang mit der Verfügbarkeitsheuristik ist hier direkt: Motivational bedeutsame Ereignisse erscheinen häufiger, als sie tatsächlich sind, was die Vernachlässigung der Basisrate zusätzlich verstärkt.

Widersprüche in den Daten und Grenzen der Gewissheit: Wo die Evidenz auseinandergeht

Der Basisraten-Effekt ist robust, aber die Bedingungen seines Auftretens und die Methoden zu seiner Überwindung bleiben Gegenstand wissenschaftlicher Kontroversen. Drei zentrale Debatten zeigen, wo die Evidenz auseinandergeht und warum es keine universelle Lösung gibt. Mehr dazu im Abschnitt Realitätsprüfung.

Expertise: Schutzschild oder Illusion?

Erfahrene Diagnostiker begehen den Basisraten-Fehler seltener als Anfänger (S009). Doch sobald die Aufgabe in abstrakten Begriffen formuliert wird, verschwindet der Unterschied (S011).

Expertise funktioniert nur, wenn der Fachmann über ein explizites mentales Modell zur Integration der Basisrate verfügt und dieses Modell durch den Kontext aktiviert wird. In untypischen Situationen schützt Erfahrung nicht.

Ein Arzt, der an die diagnostischen Protokolle seines Fachgebiets gewöhnt ist, kann die Prävalenz einer Krankheit automatisch berücksichtigen. Wird die Aufgabe jedoch als abstraktes logisches Rätsel formuliert, schaltet sein Gehirn in den „Anfänger-Modus" – und der Fehler kehrt zurück.

Training: Ein Effekt, der nicht anhält

Kurztrainings zum Bayes-Theorem verbessern die Ergebnisse bei nachfolgenden Aufgaben, aber der Effekt überträgt sich nicht auf neue Kontexte und verblasst mit der Zeit (S011). Intensive Programme mit wiederholter Praxis und Feedback zeigen stabilere Ergebnisse, erfordern aber erhebliche Ressourcen (S010).

| Art der Intervention | Effekt unmittelbar danach | Transfer auf neue Kontexte | Zeitliche Stabilität |

|---|---|---|---|

| Kurztraining (Erklärung + Beispiele) | Vorhanden | Schwach | Verblasst |

| Intensivprogramm (Praxis + Feedback) | Vorhanden | Stärker | Stabiler |

Das Problem: Das Gehirn lernt den Kontext, nicht das Prinzip. Jemandem beizubringen, im Labor nach Bayes zu rechnen, bedeutet nicht, dass er es in der Arztpraxis oder bei der Risikobewertung am Arbeitsplatz tun wird.

Datenformat: Natürliche Häufigkeiten – kein Allheilmittel

Die Darstellung von Informationen in natürlichen Häufigkeiten (z. B. „10 von 1000" statt „1%") reduziert den Basisraten-Fehler konsistent (S011). Doch selbst bei optimalem Format ignorieren 30–40% der Teilnehmer weiterhin die Basisrate.

- Natürliche Häufigkeiten

- Ein Format, das das intuitive Verständnis von Wahrscheinlichkeiten erleichtert (z. B. „50 von 10.000 Patienten"). Funktioniert besser als Prozentangaben, ist aber nicht universell.

- Realer Kontext

- In medizinischen Protokollen, Sicherheitsberichten und Finanzdokumenten werden Informationen oft in Prozent oder Wahrscheinlichkeiten dargestellt. Die Änderung des Formats erfordert systemische Veränderungen in Dokumentation und Schulung.

Selbst wenn Sie die Daten perfekt umformatieren, kann das System, in dem diese Daten zirkulieren, gegen Sie arbeiten. Ein Arzt erhält ein Testergebnis in natürlichen Häufigkeiten, aber die elektronische Patientenakte verlangt die Eingabe in Prozent – und der Kreislauf schließt sich.

Diese drei Debatten weisen auf eines hin: Es gibt kein universelles Heilmittel. Jede Lösung funktioniert unter bestimmten Bedingungen und erfordert kontinuierliche Unterstützung. Das Ignorieren der Basisrate ist nicht einfach ein kognitiver Fehler, der sich mit einer einzigen Intervention beheben lässt. Es ist ein systemisches Problem, eingebettet in die Art, wie wir lernen, wie Information organisiert ist und wie wir unter Druck Entscheidungen treffen.

Kognitive Anatomie der Manipulation: Welche Verzerrungen die Vernachlässigung der Basisrate ausnutzt

Die Vernachlässigung der Basisrate führt nicht nur zu unbeabsichtigten Fehlern, sondern kann auch gezielt ausgenutzt werden, um die Risikowahrnehmung und Entscheidungsfindung zu manipulieren. Mehr dazu im Abschnitt Datenverschleierung durch Pharmaunternehmen.

⚠️ Ausbeutung durch selektive Darstellung der Testgenauigkeit

Hersteller von Diagnosetests, Sicherheitssystemen oder Machine-Learning-Algorithmen bewerben oft „99% Genauigkeit" oder „hohe Sensitivität", verschweigen aber die Basisrate des Ereignisses (S001). Das ist kein Fehler — das ist Strategie.

Wenn die Wahrscheinlichkeit eines Ereignisses niedrig ist (seltene Krankheit, seltener Hackerangriff), wird hohe Testgenauigkeit zur Illusion von Zuverlässigkeit. Der Verbraucher hört „99%" und ignoriert den Kontext, in dem die meisten positiven Ergebnisse Fehlalarme sind.

Manipulation funktioniert nicht, weil die Information falsch ist, sondern weil sie unvollständig ist. Die Tatsache bleibt eine Tatsache, aber ohne Basisrate wird sie zur Waffe.

🎯 Drei Mechanismen der Ausbeutung

- Selektive Offenlegung. Es wird die Sensitivität (Anteil korrekter Positive) mitgeteilt, aber nicht die Spezifität oder der positive prädiktive Wert.

- Emotionale Verankerung. „99% Genauigkeit" klingt wie eine Garantie und aktiviert die Verfügbarkeitsheuristik — die auffällige Zahl verdrängt den statistischen Kontext.

- Soziale Bestätigung. Wenn die Mehrheit an die Zuverlässigkeit des Tests glaubt (aufgrund der Vernachlässigung der Basisrate), verstärkt Gruppendenken die Illusion (S004).

🔗 Verbindung zu anderen kognitiven Verzerrungen

Die Vernachlässigung der Basisrate wirkt selten isoliert. Sie verflicht sich mit falscher Dichotomie (der Test funktioniert entweder oder nicht), mit Bestätigungsverzerrung (wir suchen Fakten, die das erste positive Ergebnis stützen) und mit Desinformation, die Basisraten bewusst verschleiert.

Das Ergebnis: Ein System, in dem präzise Instrumente zu Fehlergeneratoren werden und Menschen zu Opfern ihrer eigenen Unfähigkeit, statistischen Kontext zu integrieren.