Was sind kognitive Verzerrungen und logische Fehlschlüsse – und warum die Rationalisten des 17. Jahrhunderts katastrophal falsch lagen

Die Rationalisten des 17. Jahrhunderts – Descartes, Spinoza – glaubten: Das menschliche Denken ist makellos, wenn man ihm die richtigen Werkzeuge der Logik gibt (S003). Mehrere Jahrhunderte später zerstörten Kahneman und Tversky diese Illusion: Das Denken ist durchsetzt von systematischen Fehlern, Vorurteilen und kognitiven Fallen (S003).

Kognitive Verzerrungen sind systematische Abweichungen von der Rationalität, die in die Architektur des Gehirns eingebaut sind. Logische Fehlschlüsse sind Verstöße gegen die Regeln der formalen Logik in der Argumentation. Beide Kategorien machen uns vorhersehbar anfällig für Manipulationen. Mehr dazu im Abschnitt Denkwerkzeuge.

Die Rationalisten irrten nicht in der Logik, sondern im Verständnis dessen, dass Logik nicht der einzige Mechanismus des Denkens ist. Das Gehirn arbeitet nach Heuristiken: schnellen, unsauberen, sparsamen Regeln, die oft falsch liegen.

Die Grenze zwischen Verzerrung und Fehlschluss

Eine kognitive Verzerrung ist ein mentaler Bug in der Wahrnehmung. Der Verfügbarkeitsfehler lässt uns die Wahrscheinlichkeit von Ereignissen überschätzen, die leicht zu erinnern sind: Flugzeugabstürze erscheinen gefährlicher als Autounfälle, obwohl die Statistik das Gegenteil sagt (S003).

Ein logischer Fehlschluss ist ein Defekt in der Argumentationskette. „Danach, also deswegen" (post hoc ergo propter hoc) verwechselt Korrelation mit Kausalität (S008).

- Der entscheidende Unterschied

- Kognitive Verzerrungen erzeugen logische Fehlschlüsse. Die Vernachlässigung von Basisraten ist eine Verzerrung, die zu Fehlern in probabilistischen Urteilen führt. Menschen ignorieren Statistiken und konzentrieren sich auf markante Details (S003). Diese Verbindung macht uns besonders verwundbar: Wir irren nicht zufällig, sondern nach vorhersehbaren Mustern.

Das Ausmaß des Problems: dokumentierte Fallen

Forschungen haben Dutzende kognitiver Verzerrungen identifiziert, die sich in Experimenten mit hoher Zuverlässigkeit reproduzieren lassen (S001). Zu den am besten untersuchten gehören:

- Vernachlässigung von Basisraten (base-rate neglect)

- Verfügbarkeitsfehler (availability bias)

- Konjunktionsfehler (conjunction fallacy)

- Lockvogeleffekt (decoy effect)

- Framing-Effekt (framing effect)

- Allais-Paradoxon (Allais paradox)

Jede dieser Verzerrungen wurde unter kontrollierten Bedingungen vielfach bestätigt. Sie sind nicht zufällig – sie sind Teil unserer kognitiven Architektur, eingebaut in die Art, wie das Gehirn Informationen unter Zeit- und Unsicherheitsdruck verarbeitet.

Fünf überzeugende Argumente für die Existenz systematischer kognitiver Verzerrungen

Kognitive Verzerrungen sind keine theoretische Abstraktion, sondern ein reales Phänomen mit solider Beweisgrundlage. Hier sind die stärksten Argumente, die dieses Konzept unwiderlegbar machen. Mehr dazu im Bereich Kritisches Denken.

🔬 Argument 1: Reproduzierbarkeit in kontrollierten Experimenten

Kognitive Verzerrungen zeigen hohe Reproduzierbarkeit unter Laborbedingungen. Kahnemans und Tverskys Experimente zum Framing-Effekt zeigten: Dieselbe Information, präsentiert in Form von Verlusten oder Gewinnen, führt bei denselben Personen zu gegensätzlichen Entscheidungen (S003). Dies ist keine zufällige Schwankung – es ist ein systematisches Muster, das sich über verschiedene Kulturen und Zeiträume hinweg wiederholt.

| Merkmal | Zufälliger Fehler | Systematische Verzerrung |

|---|---|---|

| Reproduzierbarkeit | Unvorhersehbar | Wiederholt sich in 80–95% der Fälle |

| Richtung | Zufällig | Immer in eine Richtung |

| Ausmaß | Variiert | Stabil zwischen Gruppen |

📊 Argument 2: Vorhersagekraft der Modelle

Modelle, die auf kognitiven Verzerrungen basieren, sagen erfolgreich menschliches Verhalten in realen Situationen voraus. Der Decoy-Effekt wird in der Preisgestaltung eingesetzt: Das Hinzufügen einer bewusst unattraktiven dritten Option macht die Zieloption attraktiver (S003). Unternehmen nutzen dieses Wissen, um den Verkauf von Premium-Produkten zu steigern – und es funktioniert mit mathematischer Präzision.

Wären Verzerrungen zufälliges Rauschen, wäre Vorhersage unmöglich. Stattdessen sehen wir reproduzierbare Effekte in der Größenordnung von 15–40% der Basismetrik.

🧠 Argument 3: Neurobiologische Korrelate

Moderne Neuroimaging-Methoden zeigen, dass kognitive Verzerrungen mit der Aktivität spezifischer Hirnareale verbunden sind. Forschungen im Bereich kognitiver Berechnungen demonstrieren, wie die Architektur des Gehirns zu bestimmten Fehlertypen prädisponiert (S007). Dies ist nicht nur ein psychologisches Phänomen – es ist Physiologie.

Wenn das Gehirn Informationen unter Zeitdruck oder Unsicherheit verarbeitet, aktiviert es Systeme für schnelle Entscheidungsfindung (limbisches System, Basalganglien) statt langsamer analytischer Prozesse (präfrontaler Kortex). Dies ist eine architektonische Einschränkung, kein Mangel an Willenskraft.

⚙️ Argument 4: Evolutionäre Begründung

Viele kognitive Verzerrungen haben eine evolutionäre Erklärung. Der Verfügbarkeitseffekt war in einer Umgebung nützlich, in der leicht erinnerbare Bedrohungen tatsächlich häufiger und gefährlicher waren (S003). Unser Gehirn ist für das Überleben in der Savanne optimiert, nicht für statistische Analysen in der Informationsgesellschaft.

Diese „Bugs" sind Nebeneffekte von Anpassungen, die einst Leben retteten. Sie sind nicht verschwunden, weil die Evolution sie in den letzten 10.000 Jahren nicht korrigieren konnte.

🧾 Argument 5: Kulturübergreifende Universalität

Grundlegende kognitive Verzerrungen finden sich in verschiedenen Kulturen, was auf ihre universelle Natur hinweist. Die Vernachlässigung von Basisraten zeigt sich bei Probanden unabhängig von Bildung, kulturellem Kontext oder Sprache (S003). Dies ist kein Artefakt westlicher Psychologie – es ist eine Eigenschaft menschlicher Kognition als solcher.

- Framing-Effekt: reproduziert in den USA, Israel, Japan, Indien

- Ankereffekt: funktioniert gleichermaßen in Kulturen mit unterschiedlichen Sprachen und Zahlensystemen

- Bestätigungsfehler: universell unabhängig vom Bildungsniveau

- Decoy-Effekt: wirkt in verschiedenen Wirtschaftssystemen und Märkten

Evidenzbasis: Sechs experimentell bestätigte kognitive Fallen und Mechanismen ihrer Ausnutzung

Kommen wir zu konkreten Verzerrungen, die in Studien vielfach bestätigt wurden und von Manipulatoren aktiv genutzt werden. Jede ist eine offene Tür zu Ihrem Bewusstsein. Mehr dazu im Abschnitt Psychologie des Glaubens.

⚠️ Vernachlässigung von Basisraten (Base-Rate Neglect)

Diese Verzerrung bringt Menschen dazu, die statistische Häufigkeit eines Phänomens zu ignorieren und sich auf spezifische Details zu konzentrieren (S003). Wenn ein Test auf eine seltene Krankheit (tritt bei 1% der Bevölkerung auf) eine Genauigkeit von 95% hat, ist ein positives Ergebnis dennoch mit höherer Wahrscheinlichkeit falsch-positiv. Menschen überschätzen systematisch die Wahrscheinlichkeit der Krankheit und vergessen die Basisrate.

„Doktor Spin" nutzt dies so: Er präsentiert einen lebhaften, emotional aufgeladenen Fall (seltene Nebenwirkung einer Impfung) und bringt Sie dazu, die Basisrate zu vergessen (Millionen sicherer Impfungen). Ihr Gehirn klammert sich an die dramatische Geschichte und ignoriert die Statistik.

Eine tragische Geschichte wiegt schwerer als eine Million positiver Ausgänge — nicht weil es logisch ist, sondern weil unser Gedächtnis so funktioniert.

🧩 Verfügbarkeitsheuristik (Availability Bias)

Wir überschätzen die Wahrscheinlichkeit von Ereignissen, die leicht zu erinnern sind — meist weil sie kürzlich stattfanden, auffällig oder emotional aufgeladen waren (S003). Nach einer Serie von Nachrichten über Flugzeugabstürze halten Menschen Flugreisen für gefährlicher, obwohl sich die Statistik nicht verändert hat.

Diese Verzerrung wird durch Kontrolle der Informationsagenda ausgenutzt: Wenn Medien ständig über seltene, aber schreckliche Ereignisse berichten, beginnen Sie, diese für typisch zu halten. Mehr zum Mechanismus siehe Verfügbarkeitsheuristik und Risikowahrnehmung.

🔁 Konjunktionsfehler (Conjunction Fallacy)

Menschen schätzen systematisch die Wahrscheinlichkeit einer Konjunktion zweier Ereignisse (A und B) höher ein als die Wahrscheinlichkeit eines einzelnen (A), was mathematisch unmöglich ist (S003). Die berühmte Linda-Aufgabe: Die Mehrheit wählt die Variante „Bankangestellte und feministische Aktivistin", obwohl dies logisch unwahrscheinlicher ist als einfach „Bankangestellte".

Manipulatoren nutzen dies, indem sie plausible Details zu einer Aussage hinzufügen und sie dadurch „lebendiger" und überzeugender machen. Jedes zusätzliche Detail senkt die Wahrscheinlichkeit der gesamten Konjunktion, erhöht aber ihre psychologische Überzeugungskraft.

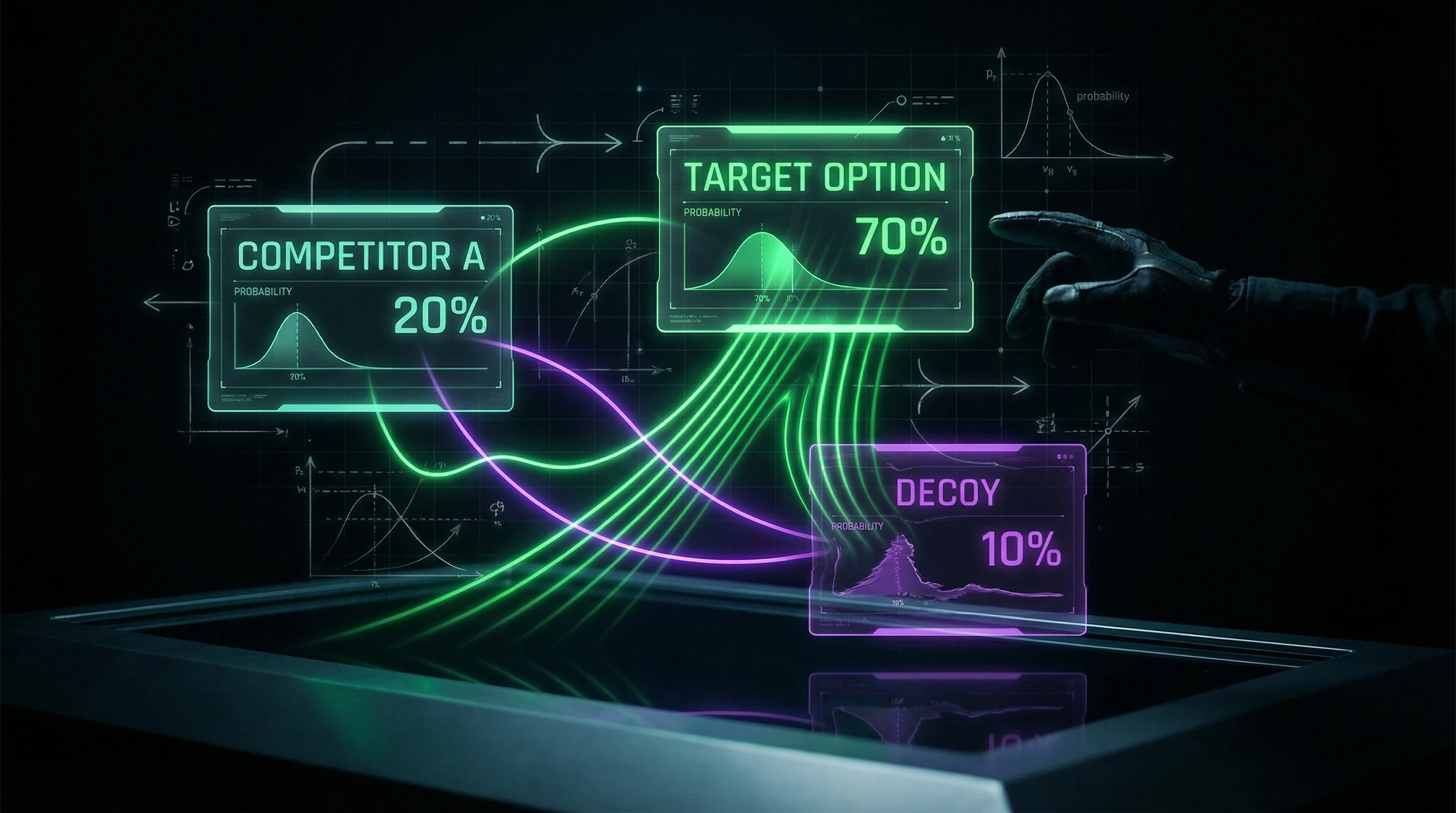

⚙️ Decoy-Effekt (Decoy Effect)

Das Hinzufügen einer dritten, bewusst unvorteilhaften Option (Decoy) verändert die relative Attraktivität der beiden anderen Optionen (S003). Beispiel: Zeitschriftenabo für 59€ (nur online) und 125€ (Print + online). Die Mehrheit wählt die günstige Variante.

Fügt man aber eine dritte Option hinzu — 125€ (nur Print) —, erscheint plötzlich das Kombi-Angebot „Print + online" für dieselben 125€ als unglaubliches Schnäppchen. Die Verkäufe dieser Variante steigen sprunghaft, obwohl sich objektiv nichts geändert hat.

| Szenario | Wahl der Mehrheit | Mechanismus |

|---|---|---|

| Zwei Optionen: 59€ (online) vs 125€ (Print + online) | 59€ (online) | Preis ist Hauptkriterium |

| Drei Optionen: 59€ (online) vs 125€ (Print + online) vs 125€ (nur Print) | 125€ (Print + online) | Decoy macht Kombi zum „besten Deal" |

📊 Framing-Effekt (Framing Effect)

Dieselbe Information, in unterschiedlichen Formulierungen präsentiert, führt zu unterschiedlichen Entscheidungen (S003). Klassisches Experiment: „Das Programm rettet 200 von 600 Leben" wird positiv wahrgenommen, während „Das Programm führt zum Tod von 400 von 600 Menschen" negativ wirkt, obwohl es dasselbe ist.

Politiker, Marketingexperten und Propagandisten nutzen Framing meisterhaft, um Ihre Wahrnehmung in die gewünschte Richtung zu lenken. Dieselbe Tatsache kann je nach gewähltem Blickwinkel als Triumph oder Katastrophe dargestellt werden.

🧬 Allais-Paradoxon (Allais Paradox)

Menschen verletzen systematisch die Axiome der Erwartungsnutzentheorie und treffen Entscheidungen, die ihren eigenen Präferenzen in einem anderen Kontext widersprechen (S003). Dies zeigt, dass unsere Entscheidungen nicht dem rationalen Modell der Nutzenmaximierung folgen.

Wir sind kontextsensitiv und reagieren auf die Aufgabenformulierung auf Weisen, die uns vorhersagbar irrational machen. Diese Vorhersagbarkeit ist das Hauptwerkzeug des Manipulators.

- Warum diese Fallen universell sind

- Sie sind in die Architektur des menschlichen Denkens eingebaut, nicht Folge mangelnder Bildung oder Intelligenz. Selbst Experten und Wissenschaftler fallen darauf herein, wenn sie außerhalb ihrer Spezialisierung arbeiten.

- Wie man sie erkennt

- Erstes Anzeichen — wenn Sie aufgefordert werden, eine Entscheidung auf Basis einer einzigen lebhaften Geschichte ohne Statistik zu treffen. Zweites — wenn Information so präsentiert wird, dass sie Emotion auslöst, bevor Sie die Fakten analysieren konnten.

- Schutz

- Keine vollständige Immunisierung (die gibt es nicht), sondern Bewusstsein für den Mechanismus. Wenn Sie Framing erkennen, können Sie die Information selbst umformulieren. Wenn Sie einen Decoy bemerken, können Sie ihn ignorieren. Wenn Sie eine einzelne Geschichte hören — können Sie nach der Basisrate fragen.

Mechanismen kognitiver Verzerrungen: Warum unser Gehirn systematisch irrt und wie das gegen uns verwendet wird

Das Verständnis der Mechanismen ist der Schlüssel zum Schutz. Kognitive Verzerrungen sind nicht zufällig; sie entstehen aus fundamentalen Eigenschaften unserer Gehirnfunktion. Mehr dazu im Abschnitt Kognitive Verzerrungen.

🔁 System 1 vs System 2: Architektur der Verwundbarkeit

Kahneman beschrieb zwei Denkmodi: System 1 (schnell, automatisch, intuitiv) und System 2 (langsam, analytisch, anstrengend). Die meisten kognitiven Verzerrungen entstehen, wenn System 1 eine schnelle, aber ungenaue Antwort liefert und System 2 nicht zur Überprüfung aktiviert wird (S003).

Manipulatoren nutzen dies aus, indem sie Bedingungen schaffen, unter denen System 2 keine Zeit hat zu reagieren: Zeitdruck, kognitive Belastung, emotionale Erregung.

🧷 Heuristiken: Nützliche Werkzeuge, die zu Waffen wurden

Heuristiken sind mentale „Abkürzungen", die schnelle Entscheidungen unter Unsicherheit ermöglichen. Verfügbarkeitsheuristik, Repräsentativitätsheuristik, Affektheuristik — alle waren in der evolutionären Vergangenheit adaptiv (S003).

Im modernen Informationsraum, wo Informationen sorgfältig gefiltert und präsentiert werden, verwandeln sich diese Heuristiken in Schwachstellen. „Doktor Spin" weiß, welche Trigger welche Heuristiken aktivieren, und nutzt dieses Wissen mit chirurgischer Präzision.

- Verfügbarkeitsheuristik

- Ereignisse, die leichter erinnert werden, erscheinen wahrscheinlicher. Der Manipulator wiederholt seltene, aber einprägsame Beispiele, bis sie im Gedächtnis „verfügbar" werden.

- Repräsentativitätsheuristik

- Wir beurteilen Wahrscheinlichkeit nach Ähnlichkeit mit einem typischen Beispiel. Ein eindrucksvoller Fall überwiegt die Statistik.

- Affektheuristik

- Die emotionale Färbung eines Ereignisses bestimmt unsere Einschätzung von Risiko und Nutzen. Angst verzerrt Kalkulationen.

🧬 Emotionen als Verstärker von Verzerrungen

Studien zeigen eine enge Verbindung zwischen kognitiven Prozessen und Emotionen (S005). Emotionale Erregung verstärkt kognitive Verzerrungen: Angst verstärkt den Verfügbarkeitseffekt (Sie überschätzen Bedrohungen), Wut reduziert kritisches Denken, Euphorie macht Sie blind für Risiken.

Manipulatoren nutzen bewusst emotionale Trigger, um Ihr System 2 abzuschalten und Sie maximal verwundbar zu machen. Das ist kein Zufall — das ist Engineering.

| Emotion | Effekt auf das Denken | Wie es genutzt wird |

|---|---|---|

| Angst | Überschätzung von Bedrohungen, Suche nach Schutz | Katastrophenszenarien, Appell an Sicherheit |

| Wut | Reduzierte Kritikfähigkeit, Suche nach Feinden | Schuldzuweisungen, Polarisierung, Schwarz-Weiß-Denken |

| Euphorie | Ignorieren von Risiken, Überschätzung von Vorteilen | Versprechen von Wunderlösungen, Verschweigen von Nebenwirkungen |

| Schuld | Bereitschaft zur Kompensation, Unterwerfung | Moralische Vorwürfe, Forderungen nach „Wiedergutmachung" |

⚙️ Kausalität vs Korrelation: Die fundamentale Falle

Kausale Fehlschlüsse sind eine Klasse logischer Fehler, die mit falscher Herstellung von Ursache-Wirkungs-Beziehungen verbunden sind (S008). Unser Gehirn ist evolutionär darauf programmiert, Ursachen zu suchen — das war überlebenswichtig.

Aber diese Neigung führt zu systematischen Fehlern: Wir sehen Kausalität, wo nur Korrelation besteht, ignorieren Störvariablen (dritte Variablen), verwechseln die Richtung der Kausalität. „Doktor Spin" nutzt dies, indem er Korrelationen als Beweise für Kausalität präsentiert und alternative Erklärungen verschweigt.

- Zwei Ereignisse treten nacheinander auf → Gehirn sucht Verbindung

- Verbindung gefunden (oft falsch) → Gewissheit wächst

- Alternative Erklärungen werden ignoriert → Kausalität „bewiesen"

- Entscheidung auf Basis falscher Ursache getroffen → Ergebnis unvorhersehbar

Konflikte und Unklarheiten: Wo Quellen voneinander abweichen und was das für das Verständnis kognitiver Verzerrungen bedeutet

Wissenschaftliche Redlichkeit erfordert das Eingeständnis: Nicht alle Aspekte kognitiver Verzerrungen sind eindeutig. Es gibt Bereiche, in denen Forscher unterschiedlicher Meinung sind. Mehr dazu im Abschnitt Klima und Geologie.

🔎 Debatten über Rationalität

Einige Forscher argumentieren, dass viele „kognitive Verzerrungen" tatsächlich rationale Anpassungen an reale Entscheidungsbedingungen darstellen.

Die Vernachlässigung von Basisraten kann gerechtfertigt sein, wenn spezifische Informationen vorliegen, die die Basisrate irrelevant machen – doch in kontrollierten Experimenten weichen Menschen systematisch von normativen Rationalitätsstandards ab (S003).

Diese Debatten sind wichtig, heben aber die grundlegende Tatsache nicht auf: Wenn wir mit Unsicherheit ohne zusätzlichen Kontext konfrontiert werden, wählt unser Gehirn vorhersagbare Fehler. Mehr darüber, wie das funktioniert, siehe im Artikel über die Vernachlässigung der Basisrate.

🧩 Das Problem der ökologischen Validität

Kritiker weisen darauf hin, dass viele Experimente unter künstlichen Laborbedingungen durchgeführt werden und möglicherweise nicht das reale Verhalten widerspiegeln.

- Marketing nutzt dieses Wissen mit vorhersagbarem Ergebnis

- Politische Kampagnen bauen Strategien auf kognitiven Fallen auf

- Native Advertising nutzt dieselben Mechanismen aus (S001)

Wären kognitive Verzerrungen ein Laborartefakt, würden sie in der realen Welt nicht mit solcher Vorhersagbarkeit funktionieren. Praktische Wirksamkeit ist der beste Validitätstest.

Der Unterschied zwischen Theorie und Praxis verschwindet hier: Was im Experiment funktioniert, funktioniert auch auf der Straße. Das ist kein Zufall – es ist ein Zeichen dafür, dass wir einen realen Mechanismus erfasst haben.

Kognitive Anatomie der Manipulation: Welche Verzerrungen „Doktor Spin" ausnutzt und wie man Angriffe erkennt

Manipulatoren nutzen selten nur eine Verzerrung. Sie kombinieren mehrere, um die Wirkung zu verstärken und die Abwehr zu erschweren. So funktioniert das in der Praxis. Mehr dazu im Abschnitt Hexerei.

🧩 Technik 1: Emotionales Framing + Verfügbarkeitsheuristik

Der Manipulator präsentiert Informationen in einem emotional aufgeladenen Rahmen und macht gleichzeitig bestimmte Beispiele leicht abrufbar. Das Ergebnis: Sie überschätzen die Wahrscheinlichkeit eines Ereignisses und treffen Entscheidungen auf Basis von Emotionen statt Fakten.

Eine Serie von Nachrichten über seltene, aber schreckliche Verbrechen von Migranten erzeugt den Eindruck einer massiven Bedrohung, obwohl die Statistik das Gegenteil zeigt. Die Verfügbarkeitsheuristik lässt Sie sich an markante Beispiele erinnern, nicht an Zahlen.

🔁 Technik 2: Vernachlässigung der Basisrate + Konjunktionsfehlschluss

Es wird eine lebendige, detaillierte Geschichte präsentiert, die Sie die statistische Häufigkeit des Phänomens vergessen lässt. Sie schätzen die Wahrscheinlichkeit eines komplexen Szenarios als hoch ein, weil es „plausibel klingt".

Das ist die Grundlage von Verschwörungstheorien: Je mehr Details, desto „überzeugender" die Geschichte, obwohl jedes Detail mathematisch ihre Wahrscheinlichkeit senkt. Die Vernachlässigung der Basisrate ermöglicht es dem Manipulator, Statistik durch Narrativ zu ersetzen.

⚙️ Technik 3: Lockvogel-Effekt bei politischen Wahlen

In der Politik wird der Lockvogel-Effekt zur Manipulation von Wählerpräferenzen eingesetzt (S003). Die Einführung eines dritten Kandidaten, der Stimmen von einem der Hauptkonkurrenten „abzieht", kann den Wahlausgang verändern.

| Szenario | Mechanismus | Ergebnis |

|---|---|---|

| Zwei gleichwertige Kandidaten | Wähler entscheidet nach Prinzipien | Vorhersagbares Ergebnis |

| Dritter hinzugefügt (ähnelt einem) | Lockvogel-Effekt verzerrt Vergleich | Stimmen verteilen sich unlogisch |

🧠 Technik 4: Kausale Fehlschlüsse in nativer Werbung

Native Werbung nutzt aktiv kognitive Verzerrungen, indem sie Werbeinhalte als redaktionelles Material präsentiert. Kausale Fehlschlüsse ermöglichen die Illusion eines Ursache-Wirkungs-Zusammenhangs zwischen Produkt und gewünschtem Ergebnis.

- „Erfolgreiche Menschen nutzen dieses Produkt"

- Der Manipulator zeigt eine Korrelation, verschweigt aber, dass erfolgreiche Menschen viele Produkte nutzen. Ihr Gehirn sucht automatisch nach kausalen Zusammenhängen und füllt die Lücken.

- „Wenn ich dieses Produkt nutze, werde ich erfolgreich"

- Das ist ein klassischer Fehlschluss, aber er funktioniert, weil wir die Rolle eines einzelnen Faktors überschätzen und die Komplexität der Realität unterschätzen. Mentale Fehler dieser Art sind in unsere kognitive Architektur eingebaut.

Einen Angriff erkennen Sie, wenn Sie innehalten und drei Fragen stellen: Welche Emotionen empfinde ich gerade, an welche Beispiele erinnere ich mich am besten und welche statistischen Daten ignoriere ich (S001).

Das 30-Sekunden-Verifikationsprotokoll: Sieben Fragen, die jede Manipulation durch kognitive Verzerrungen entlarven

Theorie ist ohne praktisches Werkzeug nutzlos. Hier ist ein Protokoll, das Sie auf jede Behauptung, Entscheidung oder Handlungsaufforderung anwenden können.

- Wie hoch ist die Basisrate? Bevor Sie auf ein eindrucksvolles Beispiel reagieren, fragen Sie: Wie häufig tritt dieses Phänomen statistisch auf? Wenn Ihnen ein dramatischer Fall gezeigt wird, aber keine Zahlen zur Häufigkeit genannt werden, ist das ein Warnsignal. (S003) zeigt, dass die Vernachlässigung von Basisraten eine der am meisten ausgenutzten Verzerrungen ist.

- Warum ist diese Information so leicht verfügbar? Wenn etwas „alle wissen" oder „ständig diskutiert wird", fragen Sie: Wer macht sie bewusst sichtbar? Der Verfügbarkeitsheuristik funktioniert nur, wenn Information leicht abrufbar ist – Manipulatoren wissen das.

- Erhöhen Details die Wahrscheinlichkeit oder nur die Plausibilität? Jedes zusätzliche Detail verringert die mathematische Wahrscheinlichkeit der gesamten Konjunktion (S003). Plausibilität ≠ Wahrscheinlichkeit. Das ist Ihr Schutz vor dem Konjunktionsfehler.

- Gibt es hier einen „Köder"? Wenn Ihnen eine Auswahl angeboten wird, prüfen Sie: Wurde eine dritte Option speziell hinzugefügt, um eine der Hauptoptionen attraktiver zu machen? Der Ködereffekt wirkt unbemerkt, aber er lässt sich erkennen, wenn Sie wissen, wonach Sie suchen müssen.

- Wie würde sich meine Entscheidung ändern, wenn ich sie in Verlust-/Gewinn-Begriffen umformuliere? Der Framing-Effekt bedeutet, dass Ihre Entscheidung von der Formulierung abhängt. Formulieren Sie die Aussage in entgegengesetzten Begriffen um: Wenn sich Ihre Entscheidung ändert, sind Sie Opfer von Framing geworden.

- Korrelation oder Kausalität? Wenn ein Ursache-Wirkungs-Zusammenhang behauptet wird, fragen Sie: Ist das bewiesene Kausalität oder nur Korrelation? Gibt es alternative Erklärungen? Kausale Fehlschlüsse (S008) sind die Grundlage der meisten pseudowissenschaftlichen Behauptungen.

- Welche Emotion löst das aus? Wenn eine Botschaft Wut, Angst oder Dringlichkeit auslöst, halten Sie inne. Emotionale Erregung schaltet den präfrontalen Kortex ab. Fragen Sie: Warum genau diese Emotion? Wem nützt meine Reaktion?

Manipulation funktioniert nicht, weil Sie dumm sind. Sie funktioniert, weil Ihr Gehirn Heuristiken zur Energieeinsparung nutzt. Das Verifikationsprotokoll ist einfach das Umschalten in den Modus langsamen Denkens.

Diese sieben Fragen erfordern keine Expertise. Sie erfordern eine Pause. Manipulatoren setzen auf die Geschwindigkeit Ihrer Reaktion – darauf, dass Sie emotional und nicht analytisch antworten.

Jede Frage zielt auf einen spezifischen Mechanismus: Die Basisrate blockiert die Vernachlässigung der Grundhäufigkeit, Verfügbarkeit entlarvt die Verfügbarkeitsheuristik, Details schützen vor dem Konjunktionsfehler, der Köder deckt Wahlmanipulation auf, Framing zeigt die Abhängigkeit von der Formulierung, Kausalität zerstört pseudowissenschaftliche Behauptungen, Emotion enthüllt die Absicht des Manipulators.

| Frage | Schützt vor | Warnsignal |

|---|---|---|

| Basisrate | Vernachlässigung von Statistik | Eindrucksvolles Beispiel ohne Zahlen |

| Verfügbarkeit der Information | Verfügbarkeitseffekt | „Alle reden darüber" |

| Details vs. Wahrscheinlichkeit | Konjunktionsfehler | Übermäßige Details in der Geschichte |

| Köder | Wahlmanipulation | Dritte Option, die „schlechter" ist |

| Framing | Abhängigkeit von Formulierung | Entscheidung ändert sich bei Umformulierung |

| Kausalität | Kausalen Fehlschlüssen | Korrelation wird als Ursache ausgegeben |

| Emotion | Emotionaler Vereinnahmung | Dringlichkeit, Wut, Angst |

Wenden Sie dieses Protokoll nicht als Dogma an, sondern als Kalibrierungswerkzeug. Wenn Sie drei von sieben Fragen nicht beantworten können – ist die Information für eine Entscheidung unzureichend. Wenn die Antworten auf Manipulation hinweisen – bedeutet das nicht, dass die Behauptung falsch ist, aber es bedeutet, dass sie eine unabhängige Überprüfung erfordert.

Kognitive Immunologie ist keine Paranoia. Es ist Denkhygiene. So wie Sie Ihre Zähne putzen, um Karies zu vermeiden, überprüfen Sie Informationen, um kognitive Kontamination zu vermeiden.