Terminologisches Chaos: Warum „systematisches Review" und „Meta-Analyse" keine Synonyme sind, aber alle so tun, als wären sie es

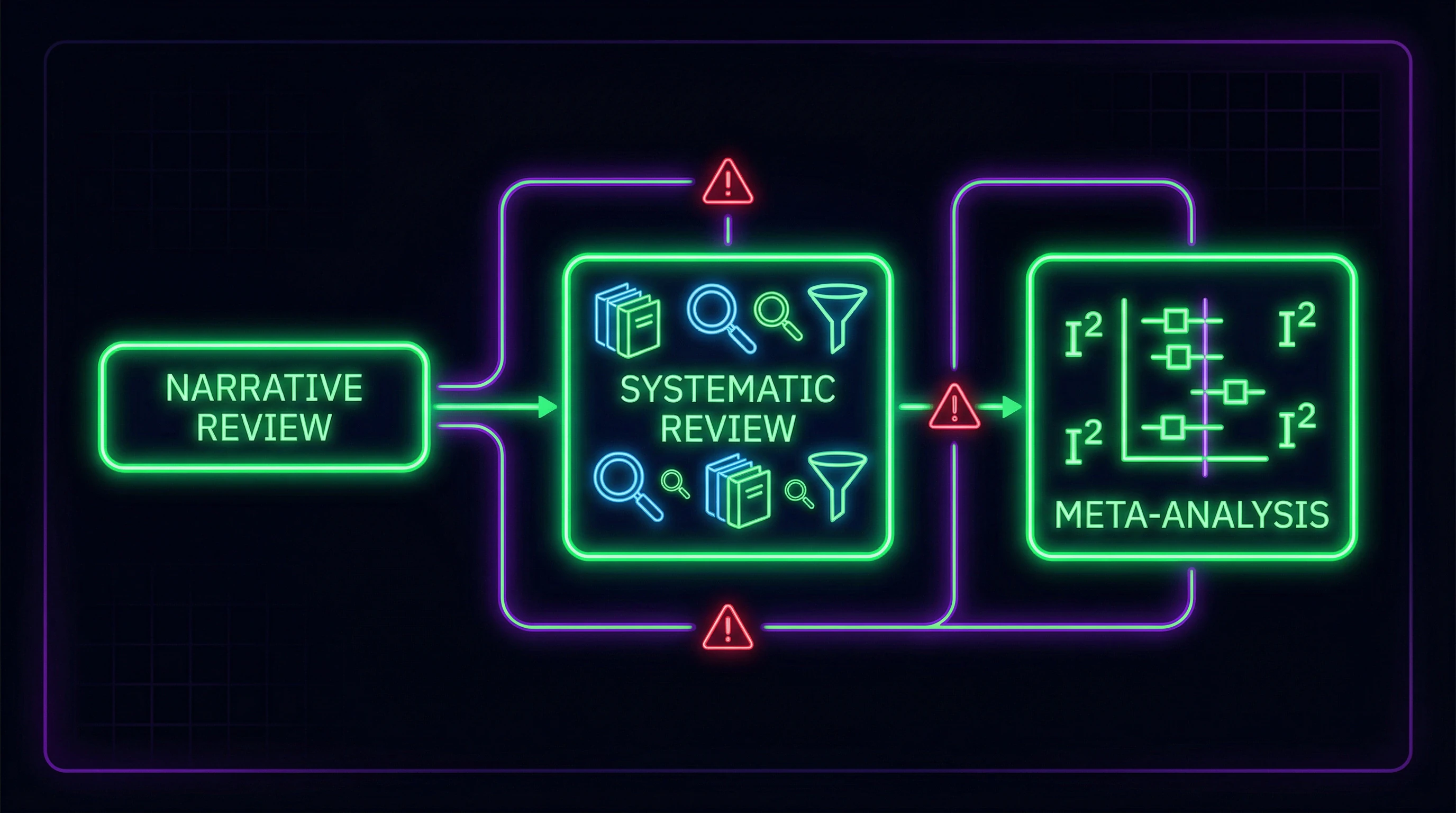

Der erste und häufigste Fehler in der wissenschaftlichen Literatur ist die Verwendung der Begriffe „systematisches Review" und „Meta-Analyse" als austauschbare Konzepte. Ein systematisches Review ist ein umfassender Prozess der Suche und Auswahl aller relevanten Studien zu einem bestimmten Thema unter Verwendung streng definierter Ein- und Ausschlusskriterien (S010).

Eine Meta-Analyse ist eine statistische Methode zur Zusammenführung quantitativer Daten aus einem systematischen Review (S010). Entscheidend: Eine Meta-Analyse ist ohne vorheriges systematisches Review unmöglich, aber ein systematisches Review kann ohne Meta-Analyse existieren, wenn die Daten zu heterogen sind oder die Studien nur qualitative Informationen liefern.

- Systematisches Review

- Methodologischer Rahmen für die Suche und Auswahl von Studien mit vorab definierten Kriterien. Gewährleistet Reproduzierbarkeit und Transparenz der Evidenzsynthese.

- Meta-Analyse

- Statistische Zusammenführung quantitativer Daten. Erfordert Datenhomogenität und korrekte Bewertung der Heterogenität.

- Scoping Review

- Systematischer Ansatz mit breiterem Umfang der Forschungsfrage (S010). Ideal für neue Bereiche und zur Identifizierung von Richtungen für weitere Forschung.

Warum die Begriffsverwirrung die wissenschaftliche Kommunikation zerstört

Die Vermischung von Konzepten erzeugt die Illusion von Strenge, wo keine vorhanden ist. Forscher bezeichnen ihre Arbeit oft als „systematisches Review mit Meta-Analyse", ohne eine systematische Suche oder korrekte statistische Analyse durchzuführen.

Das Ergebnis sind Publikationen, die wie hochwertige Evidenz aussehen, aber tatsächlich selektive Literaturübersichten mit willkürlicher Zusammenführung nicht vergleichbarer Daten darstellen.

Abgrenzungskriterien: Identifikationsprotokoll

| Element | Systematisches Review | Meta-Analyse |

|---|---|---|

| Protokoll | Vorab registriert | Enthält statistischen Plan |

| Suche | Systematisch in mehreren Datenbanken | Aus systematischem Review |

| Kriterien | Vor Suchbeginn definiert | Vor Analyse definiert |

| Qualitätsbewertung | Bias-Risiko durch zwei Gutachter | Heterogenitäts- und Publikationsbias-Analyse |

| Daten | Qualitativ oder quantitativ | Nur quantitativ, zusammenführbar |

Ein systematisches Review ohne Meta-Analyse bleibt eine valide Studie. Eine Meta-Analyse ohne systematisches Review ist statistische Manipulation, keine Wissenschaft. Mehr dazu im Bereich Kritisches Denken.

Sieben fundierte Argumente für strenge methodologische Anforderungen an systematische Reviews

Bevor wir analysieren, warum die meisten Reviews die Qualitätsprüfung nicht bestehen, müssen wir verstehen, warum die Anforderungen so streng sind. Dies ist keine akademische Pedanterie — jede Anforderung schützt vor einem spezifischen Typ systematischer Verzerrung. Mehr dazu im Abschnitt Denkfehler.

🧪 Argument eins: Reproduzierbarkeit als Grundlage der wissenschaftlichen Methode

Ein systematischer Review zielt darauf ab, Evidenz zu einem bestimmten Thema durch eine strukturierte, umfassende und reproduzierbare Literaturanalyse zu synthetisieren (S010). Reproduzierbarkeit bedeutet, dass ein unabhängiges Forscherteam, das demselben Protokoll folgt, denselben Satz eingeschlossener Studien erhalten sollte.

Dies ist entscheidend für die Entwicklung eines fundierten Verständnisses des jeweiligen Themas und ermöglicht evidenzbasierte Schlussfolgerungen zur Steuerung weiterer Forschung, politischer Entscheidungen und klinischer Praxis (S010).

📊 Argument zwei: Verhinderung selektiver Datenauswahl

Ohne systematische Suche und klare Einschlusskriterien wählen Forscher unweigerlich Studien aus, die ihre Hypothese bestätigen. Dies ist nicht notwendigerweise böswillige Manipulation — der Bestätigungsfehler wirkt automatisch.

Der systematische Ansatz mit vorheriger Protokollregistrierung macht Selektion unmöglich. Das vor Beginn der Analyse veröffentlichte Protokoll ist ein Anker, der verhindert, dass die Schlussfolgerungen in Richtung des gewünschten Ergebnisses abdriften.

🧾 Argument drei: Bewertung des Verzerrungsrisikos als Schutz vor minderwertigen Daten

Für randomisierte kontrollierte Studien ist das überarbeitete Cochrane Risk of Bias Tool (RoB-2) weithin als Standard anerkannt (S010). Das Cochrane Collaboration Tool zur Bewertung des Verzerrungsrisikos in randomisierten Studien bietet eine strukturierte Bewertung der methodologischen Qualität (S009).

Ohne eine solche Bewertung kann ein systematischer Review hochwertige RCTs mit Studien kombinieren, bei denen die Randomisierung verletzt wurde, Verblindung fehlte und Daten selektiv berichtet wurden.

🔁 Argument vier: Quantifizierung der Heterogenität verhindert sinnlose Mittelwertbildung

Die quantitative Bewertung der Heterogenität in Meta-Analysen (S009) ermöglicht es zu bestimmen, wie stark die Ergebnisse der eingeschlossenen Studien voneinander abweichen. Die Zusammenführung von Daten aus Studien mit hoher Heterogenität ohne deren Analyse ist ein statistischer Fehler, gleichbedeutend mit der Mittelwertbildung der Temperatur von Patienten in einem Krankenhaus: Eine Zahl entsteht, aber sie hat keine Bedeutung.

- I² berechnen — den Anteil der Variation, der durch Heterogenität und nicht durch Zufall erklärt wird

- Wenn I² > 75%, ist die Heterogenität hoch — eine Analyse der Unterschiedsquellen ist erforderlich

- Wenn die Heterogenität nicht erklärbar ist, ist die Zusammenführung von Daten unzulässig

- Random-Effects-Modell statt Fixed-Effects verwenden, wenn Heterogenität vorhanden ist

🧬 Argument fünf: Kritische Bewertung der Qualität nicht-randomisierter Studien

Die kritische Bewertung der Newcastle-Ottawa-Skala zur Qualitätsbewertung nicht-randomisierter Studien in Meta-Analysen (S009) zeigt, dass selbst weit verbreitete Instrumente Einschränkungen haben. Das Fehlen jeglicher Qualitätsbewertung von Beobachtungsstudien macht jedoch einen systematischen Review nutzlos.

Es ist unmöglich, eine gut durchgeführte Kohortenstudie von einer retrospektiven Analyse mit multiplen Verzerrungsquellen ohne strukturierte Bewertung zu unterscheiden.

🧰 Argument sechs: Die Aussagekraft eines systematischen Reviews ist direkt mit der Qualität der eingeschlossenen Studien verbunden

Während einige Themen zahlreiche hochwertige randomisierte kontrollierte Studien aufweisen können, sind andere möglicherweise auf Fallserien oder andere Studiendesigns mit niedrigeren Evidenzniveaus beschränkt (S010). Die Aussagekraft eines systematischen Reviews ist direkt mit der Qualität der eingeschlossenen Studien verbunden (S010).

Ein systematischer Review minderwertiger Studien bleibt minderwertige Evidenz. Die Methodik kann Müll nicht in Gold verwandeln — sie kann nur ehrlich zeigen, dass wir es mit Müll zu tun haben.

🛡️ Argument sieben: Schutz vor Publikationsbias

Studien mit positiven Ergebnissen werden häufiger publiziert als Studien mit negativen oder Null-Ergebnissen. Ohne systematische Suche nach unveröffentlichten Daten, Studienregistern und grauer Literatur wird eine Meta-Analyse den Effekt einer Intervention systematisch überschätzen.

Dies ist kein theoretisches Problem — in einigen medizinischen Bereichen verändert der Publikationsbias die Schlussfolgerungen zur Wirksamkeit von Behandlungen vollständig. Die Suche muss Datenbanken klinischer Studien, Dissertationen, Konferenzmaterialien und direkte Kontakte zu Autoren umfassen.

Schritt-für-Schritt-Anatomie eines qualitativ hochwertigen systematischen Reviews: Was enthalten sein muss und was fast nie vorhanden ist

Ein systematischer Review ist keine bloße Zusammenstellung von Artikeln. Es ist ein Protokoll mit sieben kritischen Phasen, von denen jede klare Anforderungen und Fehlerpunkte aufweist (S010).

Die meisten veröffentlichten „systematischen Reviews" überspringen oder vereinfachen mindestens drei davon. Das Ergebnis: Schlussfolgerungen, die wie Evidenz aussehen, es aber nicht sind. Mehr dazu im Abschnitt Medienkompetenz.

📌 Phase eins: Formulierung der Forschungsfrage und Vorabregistrierung des Protokolls

Die Forschungsfrage muss spezifisch und klar definiert sein (S010). Das PICO-Format (Population, Intervention, Comparison, Outcome) strukturiert die klinische Frage so, dass die Einschlusskriterien objektiv sind und nicht an das gewünschte Ergebnis angepasst werden.

Das Protokoll muss vor Beginn der Literaturrecherche in PROSPERO registriert werden. Dies macht es unmöglich, die Einschlusskriterien zu ändern, nachdem die Forscher die Ergebnisse gesehen haben – der Hauptmechanismus für p-hacking auf der Ebene systematischer Reviews.

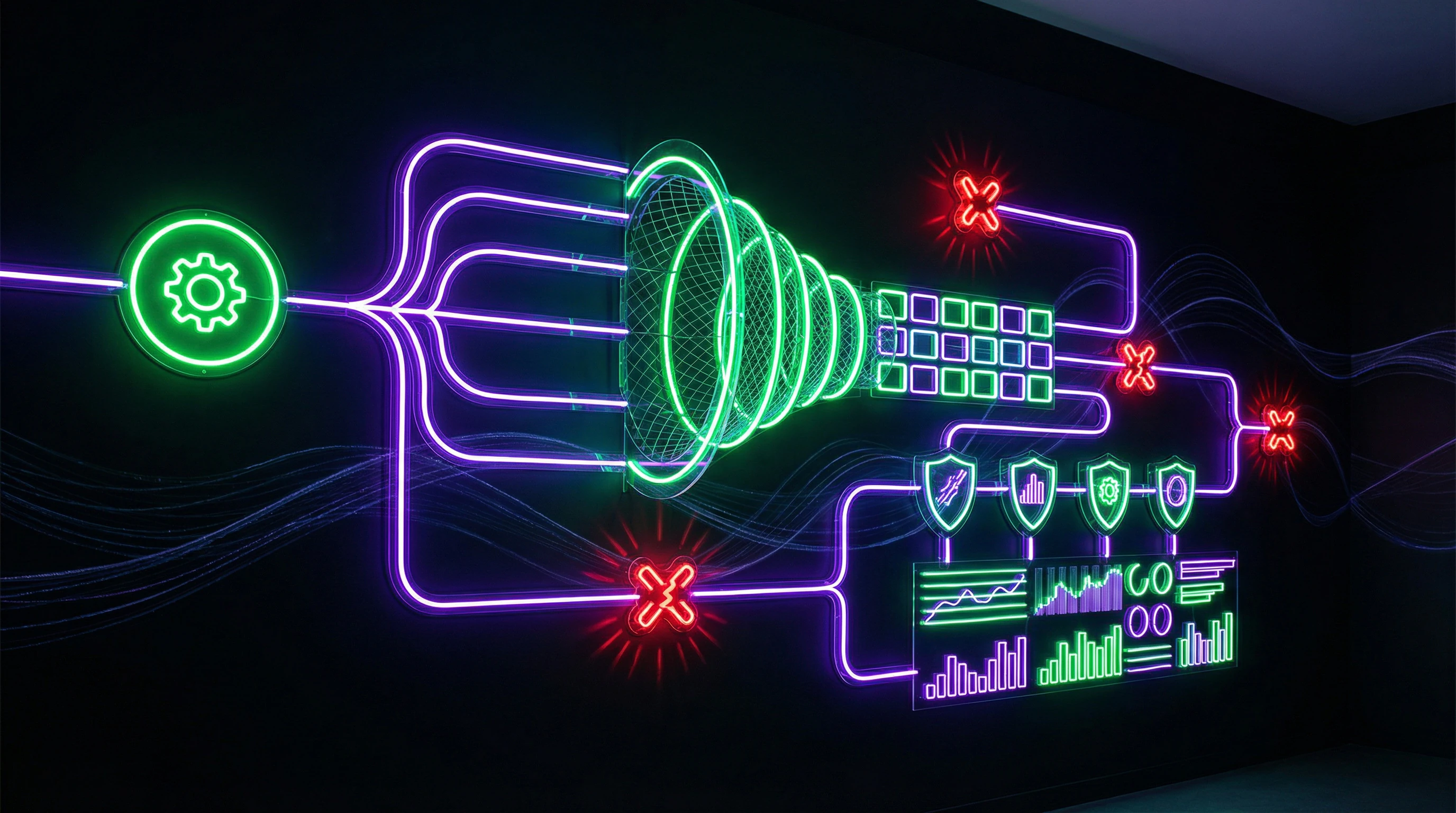

🔬 Phase zwei: Systematische Suchstrategie in mehreren Datenbanken

Die Suche umfasst mindestens drei große Datenbanken (PubMed, Embase, Cochrane Library), plus graue Literatur, Register klinischer Studien, manuelle Suche in Literaturverzeichnissen wichtiger Artikel. Die Strategie muss reproduzierbar sein – ein anderer Forscher erhält mit denselben Suchbegriffen und Filtern dieselben Ergebnisse.

Wenn die Suche auf eine Datenbank oder Publikationssprache beschränkt ist, liegt bereits ein systematischer Selektionsfehler vor.

🧾 Phase drei: Unabhängiges Screening durch zwei Gutachter

Zwei Gutachter bewerten jede Studie unabhängig anhand der Einschlusskriterien. Alle Unklarheiten werden in das Volltext-Screening einbezogen, um vorzeitigen Ausschluss zu vermeiden (S010).

Konflikte werden durch Diskussion, Konsens oder einen dritten Gutachter gelöst. Diese Anforderung schützt vor Subjektivität – ein einzelner Gutachter könnte eine relevante Studie übersehen oder die Kriterien falsch interpretieren.

🧪 Phase vier: Strukturierte Datenextraktion mit vordefinierten Formularen

Das Extraktionsformular wird vor Arbeitsbeginn entwickelt und getestet. Es enthält alle Variablen für die Analyse plus Informationen zur Bewertung des Verzerrungsrisikos. Die Extraktion wird unabhängig von zwei Gutachtern durchgeführt, gefolgt von Vergleich und Auflösung von Diskrepanzen.

- Warum dies kritisch ist

- Wenn das Formular nach Durchsicht mehrerer Artikel entwickelt wird, weiß der Forscher bereits, welche Daten seine Hypothese „bestätigen". Ein vordefiniertes Formular blockiert diese Falle.

- Wo es in der Praxis scheitert

- Ein Gutachter extrahiert Daten, der zweite prüft stichprobenartig. Oder das Formular enthält offene Felder, die es ermöglichen, dieselben Daten unterschiedlich zu interpretieren.

🔁 Phase fünf: Bewertung des Verzerrungsrisikos mit validierten Instrumenten

Für RCTs wird RoB-2 verwendet, für Beobachtungsstudien die Newcastle-Ottawa Scale oder ROBINS-I (S010). Die Bewertung wird unabhängig von zwei Gutachtern durchgeführt und dokumentiert.

Die Ergebnisse werden in Form von Tabellen und Grafiken dargestellt, die die Verteilung der Risiken nach Domänen zeigen. Dies ermöglicht es dem Leser zu sehen, welche Studien ein hohes Verzerrungsrisiko aufweisen und warum.

📊 Phase sechs: Statistische Synthese mit Bewertung der Heterogenität

Wenn die Daten eine Meta-Analyse ermöglichen, muss ein Modell (Fixed-Effect oder Random-Effects) basierend auf der erwarteten Heterogenität gewählt werden. Dann wird eine gepoolte Effektschätzung mit Konfidenzintervallen berechnet.

- Heterogenität bewerten (I², τ², Q-Statistik)

- Sensitivitätsanalyse durchführen – Studien mit hohem Verzerrungsrisiko ausschließen und Ergebnisse neu berechnen

- Publikationsbias bewerten (Funnel Plots, Egger-/Begg-Tests)

- Subgruppenanalyse durchführen, falls im Protokoll vorgesehen

🧬 Phase sieben: Bewertung der Evidenzsicherheit (GRADE)

Das GRADE-System bewertet die Qualität der Evidenz auf vier Ebenen: hoch, moderat, niedrig, sehr niedrig (S010). Die Bewertung berücksichtigt Verzerrungsrisiko, Inkonsistenz der Ergebnisse, Indirektheit der Evidenz, Ungenauigkeit der Schätzungen und Publikationsbias.

Hochwertige Evidenz bedeutet nicht, dass der Effekt groß oder klinisch bedeutsam ist. Es bedeutet, dass weitere Studien die Effektschätzung wahrscheinlich nicht ändern werden. Niedrige Qualität bedeutet, dass die nächste Studie die Schlussfolgerungen vollständig ändern könnte.

Der Zusammenhang zwischen methodologischer Strenge und Zuverlässigkeit der Schlussfolgerungen ist direkt. Jede übersprungene Phase ist eine offene Tür für systematische Fehler. Mehr über die kognitiven Mechanismen, die Forscher dazu bringen, diese Anforderungen zu ignorieren, finden Sie im Toolkit für kritisches Denken.

Kognitive Anatomie pseudosystematischer Reviews: Welche mentalen Fallen Forscher dazu bringen, Methodik zu ignorieren

Psychologische Mechanismen, die zur Erstellung minderwertiger systematischer Reviews führen, arbeiten automatisch und unbemerkt. Ihre Identifikation ist der erste Schritt zur Prävention. Mehr dazu im Abschnitt DNA-Energie und Quantenmechanik.

🧩 Bestätigungsfehler: Warum Forscher nur sehen, was sie sehen wollen

Der kognitive Bestätigungsfehler veranlasst Forscher, sich unverhältnismäßig auf Studien zu konzentrieren, die ihre Hypothese bestätigen, und widersprüchliche Daten zu ignorieren. Ohne systematische Suche und vorab definierte Einschlusskriterien wirkt diese Verzerrung automatisch.

Ein Forscher, der nach Wirksamkeitsnachweisen einer Methode sucht, findet drei bestätigende Studien und hört auf. Eine systematische Suche hätte weitere zwanzig identifiziert – die Hälfte davon zeigt keine Wirkung.

🕳️ Validitätsillusion: Wenn die Anzahl der Studien ein falsches Gefühl von Zuverlässigkeit erzeugt

Die Zusammenführung einer großen Anzahl von Studien erzeugt ein psychologisches Gefühl der Zuverlässigkeit der Schlussfolgerungen, selbst wenn alle diese Studien von geringer Qualität sind. Eine Meta-Analyse von 50 schlecht durchgeführten Studien bleibt systematisierter Müll.

- Quantitätsfalle

- Die Anzahl der Studien in einem Review korreliert nicht mit der Qualität der Schlussfolgerung. Kriterium ist die methodologische Strenge jeder eingeschlossenen Studie und die Transparenz des Auswahlprozesses.

- Wo dies auftritt

- Reviews, die mit „Analyse von 200+ Studien" prahlen, verbergen oft das Fehlen von Ausschlusskriterien und voreingenommene Auswahl.

🧠 Ankereffekt: Wie die zuerst gefundenen Studien die Richtung des gesamten Reviews bestimmen

Forscher, die mit unsystematischer Suche beginnen, „verankern" sich an den zuerst gefundenen Studien und suchen dann nach bestätigenden Daten. Systematische Suche mit vorbestimmter Strategie neutralisiert diesen Effekt.

Der Zusammenhang mit Denkwerkzeugen ist hier direkt: Der Anker ist ein kognitives Werkzeug, das durch ein Protokoll bewusst gemacht und kontrolliert werden muss, anstatt sich auf die Intuition des Forschers zu verlassen.

⚙️ Planungsfehler: Warum Forscher Zeit und Ressourcen unterschätzen

Ein qualitativ hochwertiger systematischer Review erfordert Hunderte von Arbeitsstunden eines Teams von mindestens drei Personen. Forscher unterschätzen diese Anforderungen systematisch und wählen „vereinfachte" Ansätze, die die methodologische Strenge zerstören.

- Literatursuche in 5+ Datenbanken (nicht in Google Scholar)

- Unabhängige Bewertung jeder Studie durch zwei Gutachter

- Dokumentation der Ausschlussgründe für jede Studie

- Bewertung des Verzerrungsrisikos mit standardisierten Instrumenten

- Analyse der Heterogenität vor Datenzusammenführung

Das Ergebnis des Überspringens dieser Schritte sind Publikationen, die sich systematische Reviews nennen, aber faktisch selektive Literaturübersichten sind. Der Unterschied zwischen ihnen ist keine Frage der Terminologie, sondern eine Frage der Zuverlässigkeit der Schlussfolgerungen.

Analyse der Evidenzbasis: Was die Daten über die Qualität moderner systematischer Reviews aussagen

Die Analyse veröffentlichter systematischer Reviews zeigt systemische Probleme mit der methodologischen Qualität in den meisten Bereichen der Medizin und Wissenschaft. Mehr dazu im Abschnitt Ängste rund um 5G.

📊 Empirische Daten zur Häufigkeit methodologischer Verstöße

Studien, die die Qualität veröffentlichter systematischer Reviews bewerten, stellen konsistent fest, dass ein erheblicher Anteil der Publikationen grundlegende methodologische Anforderungen nicht erfüllt.

Fehlende Vorabregistrierung des Protokolls, unvollständige Literaturrecherche, fehlende unabhängige Bewertung durch zwei Gutachter, fehlende Bewertung des Verzerrungsrisikos – diese Verstöße treten je nach Fachgebiet in 40–70% der veröffentlichten „systematischen Reviews" auf.

Methodologische Mängel sind in den meisten Fällen nicht das Ergebnis von Unwissenheit, sondern die Folge von Zeit- und Ressourceneinsparungen. Der Forscher weiß, was zu tun ist, wählt aber die Abkürzung.

🔬 Spezifische Beispiele aus der Pharmakogenetik: Variabilität der Warfarin-Dosierung

Ein systematischer Review und eine Meta-Analyse zum Einfluss des CYP2C9-Genotyps auf die Warfarin-Dosisanforderungen (S003) demonstriert korrekte Methodik: systematische Suche in mehreren Datenbanken, Verwendung validierter Software für Meta-Analysen, Einbeziehung randomisierter Studien zur genotyp-orientierten Warfarin-Dosierung, Analyse der Heterogenität zwischen Studien.

Dieses Beispiel zeigt, dass qualitativ hochwertige Reviews existieren. Die Frage ist nicht die Unmöglichkeit, sondern die Verbreitung.

🧾 Daten aus der Gastroenterologie: Wirkverlust bei Anti-TNFα-Therapie

Ein systematischer Review mit Meta-Analyse zum Wirkverlust und zur Notwendigkeit der Dosisintensivierung von Anti-TNFα bei Morbus Crohn (S009) folgt strengen methodologischen Standards: Verwendung des PRISMA-Statements (bevorzugte Berichtselemente für systematische Reviews und Meta-Analysen), Anwendung des Cochrane Collaboration-Tools zur Bewertung des Verzerrungsrisikos, quantitative Bewertung der Heterogenität.

Die Studie analysiert Daten aus großen RCTs, einschließlich ACCENT I (Erhaltungstherapie mit Infliximab) und CHARM (Adalimumab zur Aufrechterhaltung des klinischen Ansprechens und der Remission).

- Vorabregistrierung des Protokolls in PROSPERO

- Suche in mindestens 3 Datenbanken (MEDLINE, Embase, Cochrane)

- Unabhängige Qualitätsbewertung durch zwei Gutachter

- Formale Bewertung des Verzerrungsrisikos nach Cochrane

- Analyse der Heterogenität (I²-Statistik)

🧬 Mechanistische Daten: Zusammenhang zwischen Medikamentenspiegeln und klinischem Ansprechen

Post-Induktions-Serum-Talspiegel von Infliximab und Reduktion des C-reaktiven Proteins sind mit anhaltendem Langzeitansprechen auf Infliximab verbunden: retrospektive Analyse der ACCENT I-Studie (S009).

C-reaktives Protein ist ein Indikator für den Serumspiegel von Infliximab bei der Vorhersage des Wirkverlusts bei Patienten mit Morbus Crohn. Diese Daten zeigen, dass qualitativ hochwertige systematische Reviews nicht nur Daten zusammenführen, sondern auch mechanistische Zusammenhänge zwischen Biomarkern und klinischen Outcomes analysieren.

Der Unterschied zwischen Review und Meta-Analyse zeigt sich genau hier: Ein Review kann ein Muster erkennen, eine Meta-Analyse es quantifizieren, aber nur ein qualitativ hochwertiger Review versteht, warum es existiert.

🔁 Analyse der Geschwindigkeit und Größe des Induktionsansprechens

Ansprechen und Remission nach 18 Monaten Therapie mit Certolizumab Pegol bei Patienten mit aktivem Morbus Crohn sind unabhängig von Geschwindigkeit und Größe der Induktion: Analyse von PRECISE 2 und 3 (S009).

Diese Art der Analyse ist nur im Rahmen eines qualitativ hochwertigen systematischen Reviews möglich, der eine detaillierte Extraktion von Daten zu zeitlichen Parametern des Therapieansprechens umfasst. Dies erfordert nicht nur das Sammeln von Zahlen, sondern das Verständnis der klinischen Logik der Studien.

Kausalzusammenhänge versus Korrelationen: Warum die meisten Meta-Analysen diese Konzepte nicht unterscheiden können

Eines der fundamentalen Probleme moderner systematischer Reviews ist die Unfähigkeit, zwischen Kausalzusammenhängen und einfachen Korrelationen zu unterscheiden, insbesondere bei der Zusammenführung von Beobachtungsstudien.

🔬 Das Problem der Störfaktoren in Beobachtungsstudien

Selbst eine qualitativ hochwertige Meta-Analyse von Beobachtungsstudien kann systematische Fehler nicht beseitigen, die den eingeschlossenen Studien inhärent sind. Wenn alle Kohortenstudien in einer Meta-Analyse einen wichtigen Störfaktor nicht kontrolliert haben, wird die gepoolte Schätzung systematisch verzerrt sein.

Qualitätsbewertungsinstrumente (z.B. Newcastle-Ottawa) messen methodologische Strenge, können aber das Fehlen der Kontrolle kritischer Variablen in den Ausgangsdaten nicht kompensieren.

🧬 Biologische Plausibilität als notwendige, aber nicht hinreichende Bedingung

Das Vorhandensein eines biologisch plausiblen Mechanismus beweist keinen Kausalzusammenhang. Systematische Reviews sollten explizit diskutieren, welche Kausalitätskriterien für die beobachteten Assoziationen erfüllt sind.

- Bradford-Hill-Kriterien für Kausalität:

- Stärke der Assoziation — Effektgröße und statistische Signifikanz

- Konsistenz — Reproduzierbarkeit in verschiedenen Populationen und Bedingungen

- Spezifität — die Ursache führt zu einem spezifischen Effekt, nicht zu multiplen Outcomes

- Zeitliche Abfolge — die Ursache geht dem Effekt voraus

- Biologischer Gradient — Dosis-Wirkungs-Beziehung

- Kohärenz — Übereinstimmung mit bekannten Fakten

- Experimentelle Evidenz — kontrollierte Studien bestätigen den Mechanismus

📊 Heterogenität als Indikator verborgener Moderatoren

Hohe statistische Heterogenität (I² > 75%) weist auf das Vorhandensein nicht berücksichtigter Effektmoderatoren hin. Anstatt lediglich hohe Heterogenität zu vermerken, sollte ein qualitativ hochwertiger systematischer Review Subgruppenanalysen und Meta-Regressionen durchführen, um Quellen der Variabilität zu identifizieren.

- I² und Q-Statistik zur Bewertung der Heterogenität berechnen

- Subgruppenanalysen nach Schlüsselmerkmalen durchführen (Alter, Geschlecht, Interventionsdauer)

- Meta-Regression zur Identifikation kontinuierlicher Moderatoren ausführen

- Diskutieren, welche nicht gemessenen Variablen die verbleibende Variabilität erklären könnten

- Angeben, ob die identifizierte Heterogenität die Vertrauenswürdigkeit der Schlussfolgerungen verringert

🧾 Zeitliche Abfolge in Längsschnittdaten

Zur Etablierung eines Kausalzusammenhangs muss gezeigt werden, dass die vermutete Ursache dem Effekt zeitlich vorausgeht. Meta-Analysen von Querschnittsstudien können keine zeitliche Abfolge etablieren, was kausale Schlussfolgerungen einschränkt.

Systematische Reviews sollten diese Limitationen explizit angeben, anstatt kausale Aussagen auf Basis von Korrelationsdaten zu treffen. Die Trennung von Studien nach Design (randomisierte kontrollierte Studien, Kohortenstudien, Querschnittsstudien) und separate Analyse jeder Gruppe ist der Mindeststandard für eine ehrliche Interpretation.

Konflikte und Unsicherheiten: Wo Quellen voneinander abweichen und warum dies für die Interpretation entscheidend ist

Ein qualitativ hochwertiger systematischer Review verbirgt Abweichungen zwischen Studien nicht, sondern macht sie zum zentralen Element der Analyse.

🧩 Abweichungen in der Bewertung des Verzerrungsrisikos zwischen Gutachtern

Alle Konflikte in der Phase der Qualitätsbewertung werden durch Diskussion und Konsens zwischen zwei Gutachtern oder einem dritten Schiedsrichter gelöst (S010). Ein systematischer Review sollte jedoch über die Häufigkeit und Art der Abweichungen berichten – eine hohe Häufigkeit deutet auf unklare Bewertungskriterien oder Subjektivität des Instruments hin.

Schweigen über Meinungsverschiedenheiten zwischen Gutachtern bedeutet, methodologische Schwachstellen zu verbergen. Transparenz über Konflikte erhöht das Vertrauen in die Schlussfolgerungen.

Wenn Gutachter bei der Bewertung derselben Studie zu unterschiedlichen Ergebnissen kommen, ist dies ein Signal: Entweder sind die Kriterien unklar oder das Instrument bedarf einer Überarbeitung. Die Dokumentation solcher Fälle ist Teil einer ehrlichen Methodik.

🔬 Widersprüchliche Ergebnisse zwischen RCTs und Beobachtungsstudien

Randomisierte kontrollierte Studien und Beobachtungsstudien liefern oft gegensätzliche Schlussfolgerungen. Dies weist auf systematische Fehler in Beobachtungsdaten hin (Confounding, Selektion) oder auf reale Unterschiede in Populationen und Interventionen.

Ein qualitativ hochwertiger Review führt eine separate Analyse nach Studiendesign durch und diskutiert die Gründe für Abweichungen, anstatt sie zu einer einzigen Zahl zu mitteln. Dies erfordert eine kritische Analyse der Mechanismen und nicht die mechanische Zusammenführung von Daten.

📊 Inkonsistenz zwischen direkten und indirekten Vergleichen

In Netzwerk-Metaanalysen kann ein direkter Vergleich (A vs. B in einer Studie) von einem indirekten Vergleich abweichen (A vs. C und C vs. B, woraus wir A vs. B ableiten). Große Abweichungen deuten auf eine Verletzung der Transitivitätsannahme oder auf versteckte Unterschiede in den Populationen hin.

- Prüfen, ob die Patientenmerkmale in direkten und indirekten Vergleichen übereinstimmen

- Bewerten, ob sich Dosen, Dauer oder Arten der Interventionen unterscheiden

- Eine Sensitivitätsanalyse durchführen, bei der Studien mit der größten Abweichung ausgeschlossen werden

- Diskutieren, ob die Abweichung durch klinisch bedeutsame Unterschiede erklärt werden kann

Wenn Abweichungen ungeklärt bleiben, ist dies eine Einschränkung und kein Grund, das Problem zu ignorieren.