📈 Statistik und Wahrscheinlichkeitstheorie

📈 Statistik und WahrscheinlichkeitstheorieStatistik und Wahrscheinlichkeit: mathematische Grundlagen der Weltforschungλ

Fundamentale mathematische Disziplinen für Datenanalyse, Entscheidungsfindung und das Verständnis zufälliger Phänomene in Wissenschaft, Wirtschaft und Alltag

Overview

Statistik und Wahrscheinlichkeitstheorie bilden das mathematische Fundament für Datenanalyse, Entscheidungsfindung und das Verständnis zufälliger Phänomene. Von wissenschaftlichen Experimenten bis zur Finanzplanung 🧩 prägen diese Disziplinen objektive Erkenntnisgewinnung und schützen vor Datenmanipulation. Schlüsselkonzepte wie Zufallsstichprobe, Repräsentativität und empirische Verteilungsfunktion bilden die methodologische Grundlage korrekter Analyse.

🛡️

Laplace-Protokoll: Statistik und Wahrscheinlichkeitstheorie sind nicht nur Werkzeuge für den Umgang mit Zahlen, sondern fundamentale Erkenntnismethoden, die es ermöglichen, verlässliches Wissen aus Unsicherheit zu gewinnen und fundierte Entscheidungen unter Zufallsbedingungen zu treffen.

Reference Protocol

Wissenschaftliche Grundlage

Evidenzbasierter Rahmen für kritische Analyse

Protocol: Evaluation

Teste Dich

Quiz zu diesem Thema kommt bald

Sector L1

Artikel

Forschungsmaterialien, Essays und tiefe Einblicke in die Mechanismen des kritischen Denkens.

📈 Statistik und Wahrscheinlichkeitstheorie

📈 Statistik und Wahrscheinlichkeitstheorie 📈 Statistik und Wahrscheinlichkeitstheorie

📈 Statistik und Wahrscheinlichkeitstheorie⚡

Vertiefung

Wie Zufallsstichproben Datenchaos in wissenschaftliche Erkenntnis verwandeln

Statistische Analyse beginnt mit einer fundamentalen Frage: Wie wählt man aus Millionen von Objekten einige Hundert so aus, dass die Schlussfolgerungen für die gesamte Grundgesamtheit gültig sind? Zufallsstichproben und Repräsentativität bilden die methodologische Grundlage moderner Forschung — von Marktumfragen bis zu klinischen Studien.

Diese Konzepte definieren die Grenze zwischen wissenschaftlicher Analyse und bloßem Raten und verwandeln partielle Beobachtungen in verlässliche Aussagen über die Grundgesamtheit.

Zufallsstichprobe und Repräsentativität als Grundlage der Validität

Eine Zufallsstichprobe ist eine Auswahlmethode, bei der jedes Objekt der Grundgesamtheit eine bekannte, von Null verschiedene Wahrscheinlichkeit hat, in die Untersuchung einbezogen zu werden. Repräsentativität der Stichprobe bedeutet ihre Fähigkeit, die wesentlichen Merkmale der gesamten Grundgesamtheit widerzuspiegeln: Verteilung der Merkmale, Proportionen der Gruppen, Variabilität der Parameter.

| Stichprobentyp | Mechanismus | Wann verwenden |

|---|---|---|

| Einfache Zufallsstichprobe | Jedes Element hat gleiche Auswahlwahrscheinlichkeit | Homogene Grundgesamtheit, vollständiges Register verfügbar |

| Geschichtete Stichprobe | Grundgesamtheit in Schichten unterteilt, aus jeder proportional ausgewählt | Wichtige Untergruppen bekannt (Alter, Region, Einkommen) |

| Klumpenstichprobe | Ganze Gruppen (Cluster) ausgewählt, dann Elemente innerhalb | Grundgesamtheit geografisch verstreut, hohe Zugriffskosten |

Kritischer Irrtum: Große Stichprobengröße garantiert automatisch Qualität. Eine nicht-repräsentative Stichprobe von einer Million Menschen liefert weniger präzise Ergebnisse als eine korrekt gebildete Stichprobe von tausend.

Systematische Fehler bei der Stichprobenbildung lassen sich nicht durch Vergrößerung kompensieren — wenn der Auswahlmechanismus verzerrt ist, verstärkt jedes neue Element nur die Verzerrung.

Telefonumfragen schließen automatisch Menschen ohne Festnetzanschluss aus und erzeugen demografische Verzerrung unabhängig von der Respondentenzahl. Gewährleistung der Zufälligkeit erfordert strenge Protokolle: Zufallszahlentabellen, Pseudozufallsgeneratoren, Schichtung nach Schlüsselvariablen.

- Dokumentation des Auswahlverfahrens

- Obligatorisches Element der Methodik, das die Bewertung potenzieller Quellen systematischer Fehler und die Reproduktion der Studie ermöglicht.

- Stichprobenumfang

- Muss zwischen statistischer Power und verfügbaren Ressourcen ausbalanciert werden, aber die Bildungsmethode bleibt der prioritäre Faktor.

Empirische Verteilungsfunktion als Brücke zwischen Daten und Theorie

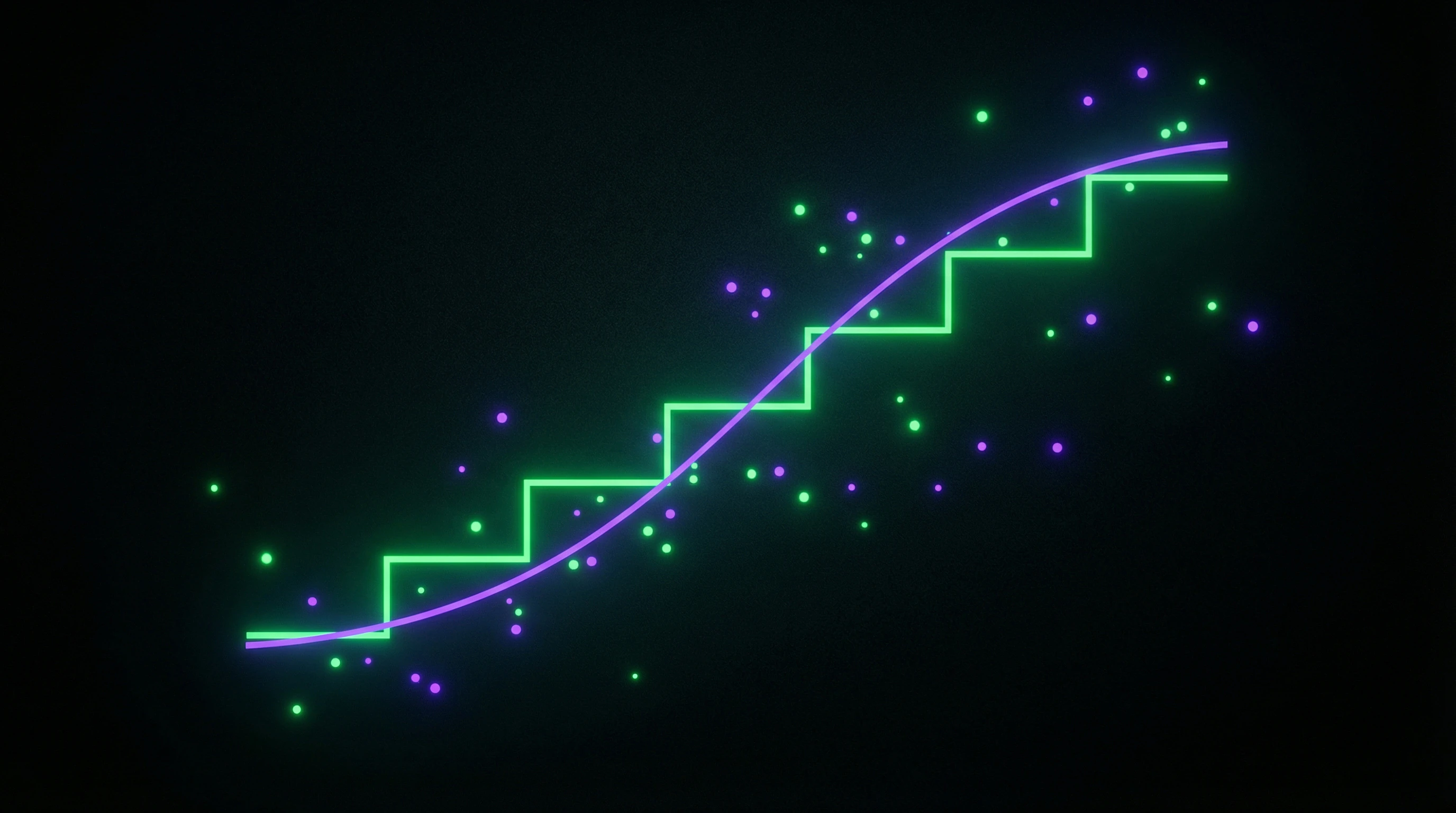

Die empirische Verteilungsfunktion (EVF) ist eine statistische Schätzung der wahren Wahrscheinlichkeitsverteilungsfunktion, die direkt auf Basis beobachteter Daten konstruiert wird. Für eine Stichprobe von n Elementen entspricht die EVF an der Stelle x dem Anteil der Beobachtungen, die x nicht überschreiten — eine Treppenfunktion, deren Sprünge an den Stellen der beobachteten Werte auftreten.

Die EVF dient als Visualisierungsinstrument der Datenverteilung ohne Vorannahmen über ihre Form und ermöglicht es, Asymmetrie, Multimodalität und Ausreißer vor Anwendung parametrischer Methoden zu erkennen. Der Vergleich der EVF mit theoretischen Verteilungen (Normal-, Exponential-, Binomialverteilung) bildet die Grundlage für die Wahl eines adäquaten statistischen Modells.

- Daten aufsteigend sortieren

- Kumulative Häufigkeiten für jeden eindeutigen Wert berechnen

- Treppenfunktion konstruieren, die den Anteil der Beobachtungen ≤ x widerspiegelt

- Konfidenzbänder zur Bewertung der Unsicherheit hinzufügen

Bei zunehmender Stichprobengröße konvergiert die EVF gegen die wahre Verteilungsfunktion — diese Aussage ist im Satz von Gliwenko-Cantelli formalisiert. Die grafische Darstellung der EVF wird oft von Konfidenzbändern begleitet, die den Unsicherheitsbereich der Schätzung bei gegebenem Stichprobenumfang zeigen.

Wahrscheinlichkeitsverteilungen: von abstrakter Mathematik zu realen Entscheidungen

Die Wahrscheinlichkeitstheorie bietet einen mathematischen Apparat zur Beschreibung zufälliger Phänomene durch Verteilungsfamilien — jede mit eigenen Parametern, Anwendungsbereichen und Interpretationen. Die Binomialverteilung und der Satz von Gliwenko-Cantelli repräsentieren zwei Pole der Wahrscheinlichkeitsanalyse: Erstere modelliert konkrete diskrete Prozesse, Letzterer begründet die fundamentale Verbindung zwischen empirischen Beobachtungen und theoretischen Modellen.

Binomialverteilung in Marktforschung und Entscheidungsfindung

Die Binomialverteilung beschreibt die Anzahl der Erfolge in einer Serie unabhängiger Bernoulli-Versuche — Experimente mit zwei möglichen Ausgängen (Erfolg/Misserfolg), bei denen die Erfolgswahrscheinlichkeit konstant ist. Klassische Beispiele: Anzahl der Konversionen aus n Werbeeinblendungen, Anzahl positiver Antworten in einer Umfrage mit n Befragten, Anzahl fehlerhafter Produkte in einer Charge von n Einheiten.

Die Verteilung wird durch zwei Parameter definiert: n (Anzahl der Versuche) und p (Erfolgswahrscheinlichkeit in einem Versuch). In der Marktforschung ermöglicht dies die Berechnung der Wahrscheinlichkeit, eine Zielanzahl von Konversionen zu erreichen, die Bewertung der Effektivität von A/B-Tests und die Planung der Stichprobengröße für Umfragen mit vorgegebener Genauigkeit.

- Unabhängigkeit der Versuche prüfen — das Ergebnis eines Versuchs beeinflusst die anderen nicht

- Konstanz der Erfolgswahrscheinlichkeit p über die gesamte Stichprobe sicherstellen

- Dichotomie des Ausgangs bestätigen (genau zwei Varianten)

- Bei großem n die Approximationsbedingung prüfen: np > 5 und n(1-p) > 5

Die Verletzung dieser Bedingungen führt zu systematischen Fehlern. Wenn sich Umfrageteilnehmer gegenseitig beeinflussen, überschätzt das Binomialmodell die Genauigkeit der Schätzungen. Bei Erfüllung der Approximationsbedingung geht die Binomialverteilung in die Normalverteilung über, was Berechnungen vereinfacht und die Verwendung von z-Tests zur Hypothesenprüfung ermöglicht.

Der Satz von Gliwenko-Cantelli als theoretische Grundlage statistischer Inferenz

Der Satz von Gliwenko-Cantelli besagt, dass die empirische Verteilungsfunktion gleichmäßig über den gesamten Definitionsbereich gegen die wahre Verteilungsfunktion konvergiert, wenn die Stichprobengröße gegen unendlich geht. Mathematisch: Das Supremum (Maximum) der absoluten Differenz zwischen empirischer Verteilungsfunktion und wahrer Verteilungsfunktion strebt mit Wahrscheinlichkeit eins gegen null bei n → ∞.

Eine ausreichend große Zufallsstichprobe ermöglicht es, die Verteilung der Grundgesamtheit mit beliebiger vorgegebener Genauigkeit zu rekonstruieren, ohne jegliche Annahmen über ihre Form.

Die praktische Bedeutung des Satzes geht über reine Mathematik hinaus: Er garantiert die Konsistenz nichtparametrischer Schätzmethoden, begründet die Anwendung von Bootstrap zur Konstruktion von Konfidenzintervallen und erklärt, warum Histogramme und Kerndichteschätzungen funktionieren.

Der Satz gibt keine Konvergenzgeschwindigkeit an — dafür werden Präzisierungen wie die Ungleichung von Dvoretzky-Kiefer-Wolfowitz verwendet, die probabilistische Grenzen für die Abweichung der empirischen Verteilungsfunktion von der wahren Verteilung bei endlichen Stichproben liefern. Das Verständnis dieses Satzes bildet die Intuition dafür, warum statistische Methoden funktionieren und welche Garantien sie bei korrekter Anwendung bieten.

Methodologie statistischer Untersuchungen: von der Hypothese zu den Schlussfolgerungen

Eine statistische Untersuchung ist ein strukturierter Prozess: Planung, Datenerhebung, Analyse, Interpretation. Jede Phase ist entscheidend für die Verlässlichkeit der Schlussfolgerungen.

Die Methodologie bestimmt die Logik wissenschaftlicher Schlussfolgerungen: wie man von einzelnen Beobachtungen zu allgemeinen Aussagen gelangt, während man die Kontrolle über Fehler und Unsicherheit behält.

Planung und Studiendesign als Grundlage der Validität

Die Planung beginnt mit einer klaren Definition der Grundgesamtheit — der Menge aller Objekte, über die Aussagen getroffen werden sollen.

- Die Wahl der Stichprobenziehungsmethode: einfache Zufallsstichprobe, geschichtete, Cluster-, systematische Stichprobe — hängt von der Struktur der Grundgesamtheit und den Zielen ab.

- Die Berechnung des Stichprobenumfangs erfordert die Spezifikation der Schätzgenauigkeit, des zulässigen Fehlers erster Art (üblicherweise 0,05), der erwarteten Effektgröße und der Teststärke (üblicherweise 0,80).

- Operationalisierung von Konzepten — Übersetzung abstrakte Begriffe in beobachtbare Indikatoren mit definierten Messskalen (nominal, ordinal, intervall, verhältnis).

Die Wahl der statistischen Analysemethoden sollte der Datenerhebung vorausgehen, nicht ihr folgen.

Dies verhindert p-hacking (Auswahl von Methoden, die das gewünschte Ergebnis liefern) und gewährleistet eine korrekte Fehlerkontrolle.

Eine Pilotstudie mit kleiner Stichprobe testet die Instrumente, identifiziert Probleme in Formulierungen, bewertet die Realitätsnähe von Annahmen über Verteilungen und Effektgrößen.

Die Dokumentation des Analyseplans (analysis plan) vor Beginn der Datenerhebung wird zum Standard in klinischen Studien und verbreitet sich allmählich in anderen Bereichen — dies erhöht die Transparenz und Reproduzierbarkeit von Untersuchungen.

Datenerhebung und -verarbeitung: von Rohbeobachtungen zum analytischen Datensatz

Die Entwicklung von Instrumenten erfordert eine Balance zwischen Messumfang und Belastung der Befragten — lange Fragebögen senken die Rücklaufquote und erhöhen fehlende Werte.

Die Gewährleistung zufälliger Auswahl stößt in der Praxis auf Nichtantworten (unit non-response) und Teilnahmeverweigerungen, die potenzielle Auswahlverzerrungen erzeugen. Die Dokumentation der Datenerhebungsbedingungen umfasst die Erfassung von Zeit, Ort, Verfahren, Abweichungen vom Protokoll — diese Informationen sind entscheidend für die Bewertung der externen Validität.

- Muster fehlender Werte

- MCAR (vollständig zufällig) — keine Verbindung zu anderen Variablen; erfordert minimale Korrekturen.

- MAR (zufällig) — hängen von beobachteten Variablen ab; erfordern Methoden multipler Imputation.

- MNAR (nicht zufällig) — hängen von den fehlenden Werten selbst ab; erfordern Sensitivitätsanalyse und inhaltliche Expertise.

Die Identifikation von Ausreißern verwendet statistische Kriterien (Drei-Sigma-Regel, Interquartilsabstand) und inhaltliche Expertise — nicht jeder Extremwert ist ein Fehler, manche repräsentieren reale seltene Ereignisse.

Die Konstruktion der empirischen Verteilungsfunktion für Schlüsselvariablen ermöglicht eine visuelle Bewertung der Verteilungsform, Asymmetrie, Vorhandensein von Modi vor Anwendung parametrischer Methoden, die Normalität voraussetzen.

Die Wahl der theoretischen Verteilung basiert auf grafischer Analyse (Q-Q-Plots, P-P-Plots) und formalen Anpassungstests (Kolmogorov-Smirnov, Shapiro-Wilk), aber inhaltliche Überlegungen zur Natur der Daten bleiben vorrangig.

Anwendung in der Marketingforschung — von der Theorie zur Geschäftspraxis

Analyse des Konsumentenverhaltens durch probabilistische Modelle

Die Binomialverteilung wird zum zentralen Instrument bei der Analyse dichotomischer Konsumentenentscheidungen — kaufen oder nicht kaufen, klicken oder ignorieren, zurückkehren oder zur Konkurrenz wechseln.

Marketingexperten nutzen dieses Modell zur Conversion-Prognose: Beträgt die Kaufwahrscheinlichkeit nach Werbekontakt 0,03, sind bei 1000 Impressionen 30±10 Käufe mit 95% Konfidenzwahrscheinlichkeit zu erwarten.

Zufallsstichproben von Kunden für A/B-Tests erfordern strikte Repräsentativität — Stratifizierung nach Alter, Geografie und Kaufhistorie verhindert systematische Verzerrungen, die zu fehlerhaften Schlussfolgerungen über Zielgruppenpräferenzen führen können.

Die empirische Verteilungsfunktion der Zeit zwischen Käufen ermöglicht die Identifikation von Segmenten mit unterschiedlicher Loyalität und optimiert die Kommunikationsfrequenz, wobei sowohl unzureichende Markenpräsenz als auch störende Aufdringlichkeit vermieden werden.

Segmentierung und Targeting auf Basis statistischer Cluster

Clusteranalyse von Transaktionsdaten identifiziert natürliche Konsumentengruppen mit ähnlichen Verhaltensmustern, doch kritische Stabilitätsprüfung der Cluster durch Bootstrap-Verfahren trennt reale Segmente von Algorithmus-Artefakten.

- Die Repräsentativität der Stichprobe für Segmentprofile bestimmt die Prognosegenauigkeit für neue Kunden — unzureichende Repräsentation junger Zielgruppen führt zu systematischer Unterschätzung ihrer Kaufkraft.

- Statistische Signifikanz der Unterschiede zwischen Segmenten wird durch Chi-Quadrat-Tests für kategoriale Variablen und t-Tests für kontinuierliche Variablen geprüft.

- Praktische Signifikanz (Effect Size) ist oft wichtiger als formale p-Werte — eine Differenz im durchschnittlichen Warenkorb von 0,50€ kann bei millionenfacher Stichprobe statistisch signifikant, aber ökonomisch bedeutungslos sein.

Das Gliwenko-Cantelli-Theorem garantiert, dass bei ausreichendem Stichprobenumfang die empirische Verteilung der Segmentmerkmale gegen die wahre konvergiert und begründet damit die Skalierung von Insights aus Pilotgruppen auf die gesamte Kundenbasis.

Statistik in der Entscheidungsfindung — wenn Zahlen die Strategie bestimmen

Hypothesentests und statistische Signifikanz im Business-Kontext

Die Nullhypothese in der Business-Analytik wird als Abwesenheit eines Effekts formuliert: Das neue Website-Design hat die Conversion nicht verändert, die Werbekampagne hat die Verkäufe nicht beeinflusst, die Preisänderung hat die Nachfrage nicht verschoben.

Das Signifikanzniveau α=0,05 ist zum Industriestandard geworden, aber seine blinde Anwendung ist gefährlich. Im Hochfrequenzhandel ist α=0,001 erforderlich, um Fehlsignale zu minimieren, während in der explorativen Marktforschung α=0,10 akzeptabel ist, um schwache, aber potenziell wichtige Effekte zu identifizieren.

- Die Teststärke (1-β) bestimmt die Wahrscheinlichkeit, einen realen Effekt zu entdecken — eine unzureichende Stichprobengröße führt zur Ablehnung einer vielversprechenden Innovation, selbst wenn sie das Produkt wesentlich verbessert.

- P-Hacking (Datenmanipulation durch multiples Testen, selektiven Ausschluss von Beobachtungen oder Änderung von Gruppierungen) ist zu einer Epidemie geworden, die das Vertrauen in die Unternehmensanalytik untergräbt.

- Hypothesentests erfordern die vorherige Festlegung von Stichprobengröße und Signifikanzniveau — die Änderung dieser Parameter nach der Datenanalyse macht die statistische Validität zunichte.

Konfidenzintervalle und Risikobewertung bei der strategischen Planung

Ein Konfidenzintervall für den durchschnittlichen Umsatz pro Kunde [4,50; 5,50] Euro bei 95% Konfidenzniveau bedeutet, dass der wahre Durchschnitt mit einer Wahrscheinlichkeit von 0,95 in diesem Bereich liegt — garantiert aber nicht, dass ein bestimmter Kunde Umsatz in diesen Grenzen bringt.

Die Breite des Konfidenzintervalls ist umgekehrt proportional zur Wurzel aus dem Stichprobenumfang: Um das Intervall zu halbieren, muss die Stichprobe vervierfacht werden. Dies erklärt die abnehmenden Erträge bei steigenden Forschungsbudgets.

Der Bayes'sche Ansatz integriert das Vorwissen von Experten mit empirischen Daten und ermöglicht die Aktualisierung von Wahrscheinlichkeiten bei Eintreffen neuer Informationen — kritisch wichtig für dynamische Märkte, wo historische Daten schnell veralten.

Quantilsregression schätzt nicht nur den Durchschnitt, sondern auch die Verteilungsenden und identifiziert Risiken extremer Szenarien. Das 95. Perzentil der Verluste zeigt maximale Verluste in den schlechtesten 5% der Fälle — wesentlich für Kapital- und Reservenmanagement.

Kritisches Denken und Schutz vor Manipulation — statistische Kompetenz als Überlebensfähigkeit

Häufige Fehler bei der Dateninterpretation und kognitive Fallen

Korrelation bedeutet keine Kausalität. Eisverkäufe steigen im Sommer zusammen mit Ertrinkungsfällen, aber die Ursache liegt nicht im Eis — der gemeinsame Faktor ist die Hitze.

Der Survivorship Bias verbirgt Misserfolge. Wir analysieren nur erfolgreiche Unternehmen und sehen ein universelles Rezept, vergessen aber Tausende Projekte mit derselben Strategie, die gescheitert und aus der Stichprobe verschwunden sind.

- Regression zum Mittelwert: Nach einem extrem erfolgreichen Quartal folgt ein Rückgang nicht wegen Fehlern, sondern weil Extreme statistisch selten sind und das System zur Norm zurückkehrt.

- Simpson-Paradoxon: Eine Behandlung kann in jeder Altersgruppe einzeln effektiver sein, aber in der Gesamtstichprobe schlechter aussehen aufgrund ungleicher Verteilung der Patienten über die Gruppen.

Ethische Aspekte der statistischen Analyse und Verantwortung des Forschers

Die Präregistrierung von Hypothesen vor der Datenerhebung blockiert HARKing — das Anpassen der Theorie an Ergebnisse, ausgegeben als Vorhersage. Das ist der Unterschied zwischen dem Suchen nach Mustern und deren Überprüfung.

Wir publizieren nur signifikante Ergebnisse — und die Wissenschaft wird zur Sammlung glücklicher Zufälle. Der File-Drawer-Effekt verzerrt die Literatur zugunsten positiver Effekte und erzeugt einen falschen Eindruck über die Zuverlässigkeit von Interventionen.

Der Schutz personenbezogener Daten bei der Analyse erfordert Balance. Differential Privacy fügt kontrollierten Rauschen hinzu, bewahrt statistische Eigenschaften und schützt Individuen vor De-Anonymisierung.

Der Forscher ist verpflichtet, Unsicherheit zu kommunizieren. Punktschätzungen ohne Konfidenzintervalle erzeugen die Illusion von Präzision — statistisches Rauschen wird als Signal ausgegeben, und darauf basierend werden katastrophale Entscheidungen getroffen.

Knowledge Access Protocol

FAQ

Häufig gestellte Fragen

Statistik ist die Wissenschaft der Datenerhebung, -analyse und -interpretation, während die Wahrscheinlichkeitstheorie die Gesetzmäßigkeiten zufälliger Phänomene untersucht. Diese Disziplinen bilden die Grundlage für fundierte Entscheidungen in Wissenschaft, Wirtschaft und Alltag. Sie sind als eigenständige inhaltliche Linie der Mathematik im Lehrplan verankert, um analytisches Denken zu fördern.

Das Studium der Statistik bereichert das Verständnis für das moderne Weltbild und dessen Erforschungsmethoden. Es entwickelt Fähigkeiten zur Datenanalyse, kritisches Denken und hilft, faktenbasierte Entscheidungen zu treffen. Die Kompetenz im Umgang mit Daten ist eine entscheidende Fähigkeit in der heutigen Informationsgesellschaft.

Eine repräsentative Stichprobe ist eine Teilmenge der Grundgesamtheit, die deren Merkmale genau widerspiegelt. Die Qualität der Stichprobe ist wichtiger als ihre Größe: Selbst eine große Stichprobe kann verzerrte Ergebnisse liefern, wenn sie nicht repräsentativ ist. Die korrekte Auswahl gewährleistet die Zuverlässigkeit statistischer Schlussfolgerungen und Prognosen.

Nein, das ist ein weit verbreiteter Irrtum. Statistik bietet objektive Werkzeuge zur Datenanalyse, aber Manipulationen sind bei falscher Anwendung der Methoden oder absichtlicher Verzerrung möglich. Kritisches Denken und Verständnis der Methodik helfen, unsachgemäße Verwendung von Statistik zu erkennen und sich vor Manipulation zu schützen.

Nicht immer – Repräsentativität ist wichtiger als die Stichprobengröße. Eine kleine, aber korrekt zusammengestellte Stichprobe liefert genauere Ergebnisse als eine große, aber verzerrte. Es bedarf einer Balance zwischen Stichprobenumfang, verfügbaren Ressourcen und Datenqualität, um verlässliche Schlussfolgerungen zu erhalten.

Nein, Wahrscheinlichkeitsmodelle sind Annäherungen an die Realität, keine absoluten Wahrheiten. Die Genauigkeit der Berechnungen hängt von der Datenqualität, der Anwendbarkeit der gewählten Verteilung und der Berücksichtigung aller Faktoren ab. Es ist wichtig, die Grenzen der Modelle und die Bedingungen ihrer korrekten Anwendung zu verstehen, um die Ergebnisse angemessen zu interpretieren.

Beginnen Sie mit einer klaren Formulierung des Ziels und der Hypothesen der Untersuchung. Definieren Sie die Grundgesamtheit, wählen Sie eine Methode zur Bildung einer repräsentativen Stichprobe und berechnen Sie den erforderlichen Umfang. Planen Sie die Datenerhebungsmethoden, Qualitätskriterien und Analyseverfahren unter Berücksichtigung der verfügbaren Ressourcen und zeitlichen Rahmenbedingungen.

Statistik hilft, Verbraucherverhalten zu analysieren, Zielgruppen zu segmentieren und die Wirksamkeit von Kampagnen zu bewerten. Die Binomialverteilung wird zur Prognose von Reaktionen verwendet, während Stichprobenmethoden zum Testen von Hypothesen über Kundenpräferenzen dienen. Dies ermöglicht fundierte Entscheidungen und die Optimierung von Marketingstrategien.

Ein Konfidenzintervall zeigt den Wertebereich, in dem sich mit einer bestimmten Wahrscheinlichkeit der wahre Parameter der Grundgesamtheit befindet. Beispielsweise bedeutet ein 95%-Konfidenzintervall, dass in 95 von 100 Fällen der wahre Wert in diesen Bereich fällt. Ein enges Intervall weist auf eine hohe Schätzgenauigkeit hin.

Dies ist eine statistische Schätzung der Wahrscheinlichkeitsverteilungsfunktion, die auf beobachteten Stichprobendaten basiert. Der Satz von Gliwenko-Cantelli beweist, dass bei zunehmendem Stichprobenumfang die empirische Funktion gegen die wahre Verteilungsfunktion konvergiert. Dies ist ein fundamentales Werkzeug zur Datenanalyse und Überprüfung von Hypothesen über Verteilungen.

Korrelation zeigt einen statistischen Zusammenhang zwischen Variablen, beweist aber keine Kausalität. Zwei Variablen können aufgrund des Einflusses eines dritten Faktors oder zufälliger Übereinstimmung korrelieren. Um Kausalität festzustellen, sind kontrollierte Experimente, theoretische Begründungen und der Ausschluss alternativer Erklärungen erforderlich.

Statistische Signifikanz zeigt, wie wahrscheinlich es ist, dass ein beobachteter Effekt nicht auf Zufall beruht. Üblicherweise wird ein Schwellenwert von p<0,05 verwendet, was eine Wahrscheinlichkeit von weniger als 5% für ein zufälliges Ergebnis bedeutet. Signifikanz ist jedoch nicht gleichbedeutend mit praktischer Relevanz — ein statistisch signifikanter Effekt kann für die praktische Anwendung zu gering sein.

Überprüfen Sie die Datenquelle, Stichprobengröße und Repräsentativität sowie die Forschungsmethodik. Achten Sie auf die Visualisierung — manipulative Grafiken verzerren oft den Maßstab oder schneiden Achsen ab. Suchen Sie nach absoluten Werten statt nur Prozentangaben und vergleichen Sie mit unabhängigen Quellen zur Überprüfung der Glaubwürdigkeit.

Die Anwendung klassischer Statistik auf einzelne einzigartige Ereignisse ist begrenzt, da Wiederholbarkeit zur Wahrscheinlichkeitsschätzung erforderlich ist. Der Bayes'sche Ansatz ermöglicht jedoch die Arbeit mit subjektiven Wahrscheinlichkeiten und die Aktualisierung von Schätzungen bei neuen Informationen. Dies ist nützlich für die Analyse seltener Risiken und Entscheidungsfindung unter Unsicherheit.

Hauptprobleme umfassen Datenschutz, Verzerrungen in Stichproben und Algorithmen sowie manipulative Darstellung von Ergebnissen. Forscher müssen die Anonymität der Teilnehmer gewährleisten, Cherry-Picking von Daten vermeiden und ehrlich über Studienlimitationen berichten. Transparenz der Methodik und verantwortungsvolle Nutzung der Ergebnisse sind entscheidend für ethische Praxis.

Statistische Methoden ermöglichen die Analyse von Einnahmen und Ausgaben, Prognose zukünftiger Bedürfnisse und Bewertung von Investitionsrisiken. Das Verständnis von Wahrscheinlichkeitsverteilungen hilft bei fundierten Entscheidungen über Versicherungen, Altersvorsorge und Portfoliodiversifikation. Dies verwandelt Finanzplanung von einem intuitiven Prozess in einen systematischen, datenbasierten Ansatz.