Kognitive Fallen und logische Fehlschlüsse: Wo Heuristik endet und Katastrophe beginnt

Der Begriff „kognitive Verzerrung" (cognitive bias) beschreibt systematische Abweichungen in der Informationsverarbeitung, die durch Limitierungen der Gehirnarchitektur entstehen. Logische Fehlschlüsse (logical fallacies) sind Verstöße gegen formale Ableitungsregeln, die ein Argument unabhängig von der Wahrheit der Prämissen ungültig machen. Mehr dazu im Abschnitt Mentale Fehler.

Die Grenze zwischen ihnen ist fließend: Der Bestätigungsfehler (confirmation bias) lässt uns nur unterstützende Daten suchen, und dann verwandelt der logische Fehlschluss „danach, also deswegen" (post hoc ergo propter hoc) Korrelation in Kausalität.

🧩 Drei Fehlerebenen: Wahrnehmung, Schlussfolgerung, Handlung

Kognitive Fallen wirken auf drei Ebenen der Entscheidungsfindung.

- Wahrnehmungsebene

- Die Verfügbarkeitsheuristik (availability heuristic) lässt uns die Wahrscheinlichkeit von Ereignissen überschätzen, die leicht erinnerbar sind — Flugzeugabstürze erscheinen häufig, weil sie medial präsent sind, obwohl sie statistisch selten vorkommen.

- Schlussfolgerungsebene

- Der Basisraten-Fehlschluss (base rate fallacy) ignoriert a priori Wahrscheinlichkeiten — ein Arzt sieht einen positiven Test auf eine seltene Krankheit und stellt die Diagnose, vergisst aber, dass bei niedriger Prävalenz die meisten Positivbefunde falsch sind (S005).

- Handlungsebene

- Die Eskalation des Commitments (sunk cost fallacy) zwingt uns, ein gescheitertes Projekt fortzusetzen, weil „schon so viel investiert wurde".

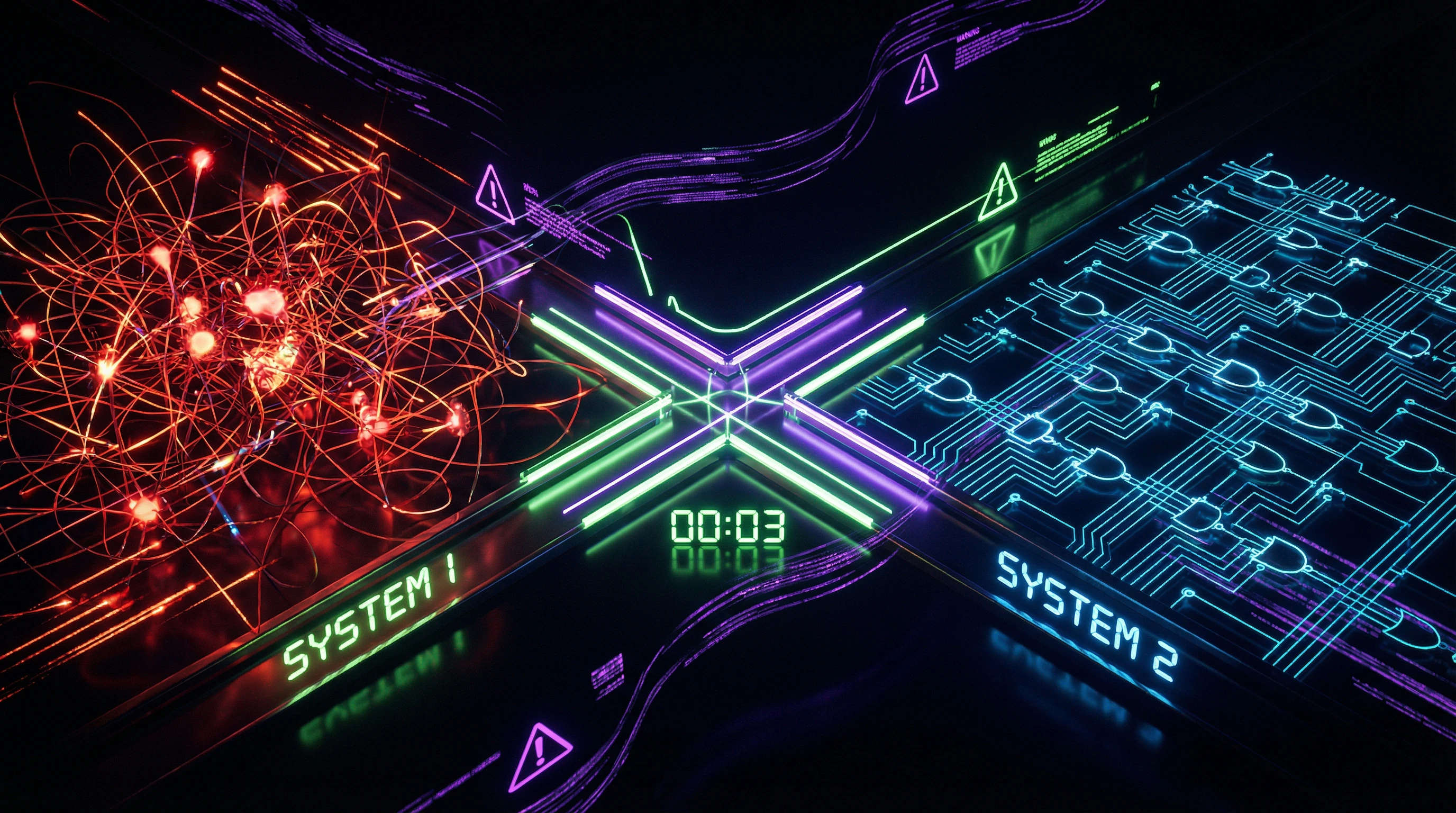

🔎 Warum schnelle Entscheidungen ein Schlachtfeld zwischen System 1 und System 2 sind

Daniel Kahneman teilte das Denken in zwei Systeme: System 1 (schnell, automatisch, emotional) und System 2 (langsam, analytisch, energieintensiv). Unter Zeitdruck schaltet System 2 ab — das Gehirn spart Glukose.

Diplomatische Verhandlungen, bei denen jede Sekunde Schweigen als Signal interpretiert wird, werden zum Testgelände für Fallen: Der Ankereffekt (anchoring) bestimmt die gesamte Verhandlungsspanne, und der Attributionsfehler (fundamental attribution error) schreibt die Härte des Gegners seinem Charakter zu, nicht dem situativen Druck (S001).

⚙️ Heuristiken als Waffe: Wenn Vereinfachung zur Manipulation wird

Die Repräsentativitätsheuristik (representativeness heuristic) lässt uns Wahrscheinlichkeiten nach Ähnlichkeit mit einem Prototyp beurteilen: „Er sieht aus wie ein Programmierer, also ist er wahrscheinlich Programmierer" — ignorierend, dass es in der Population mehr Bibliothekare gibt.

| Heuristik | Mechanismus | Manipulationsfeld |

|---|---|---|

| Repräsentativität | Nach Ähnlichkeit mit Prototyp urteilen | Stereotypisierung in Werbung und Recruiting |

| Affekt | Risikobewertung mit emotionaler Färbung verknüpfen | Positives Image umgeht Analytik (grüne Energie, neue Technologien) |

Im Marketing wird die Repräsentativitätsheuristik zur Stereotypisierung: Werbebilder nutzen Prototypen aus, um analytisches Denken zu umgehen. Die Affektheuristik verknüpft Risikobewertung mit emotionaler Färbung: Technologien mit positivem Image werden als sicher wahrgenommen, selbst wenn die Datenlage uneindeutig ist.

Mehr darüber, wie solche Fehler erkannt werden, siehe im Handbuch logischer Fehlschlüsse.

Die Stahlmann-Version des Arguments: Warum kognitive Fallen keine Bugs, sondern Adaptionen sind

Bevor wir Fehler analysieren, müssen wir anerkennen: Heuristiken existieren, weil sie funktionieren. Unter Bedingungen von Unsicherheit und begrenzten Ressourcen (Zeit, Information, Rechenleistung des Gehirns) liefern sie „hinreichend gute" Lösungen mit minimalem Aufwand. Mehr dazu im Abschnitt Debunking und Prebunking.

Kritik muss ökologische Rationalität berücksichtigen — die Passung der Strategie zur Umwelt. Das ist keine Rechtfertigung, sondern Kontext.

- Heuristiken siegen unter Bedingungen hoher Unsicherheit und Rauschen

- Soziale Heuristiken koordinieren kollektive Handlungen

- Kognitive Ökonomie ist ein evolutionärer Vorteil

- Logische Fehler können rhetorisch effektiv sein

- Kontextspezifität macht universelle Kritik sinnlos

- Das Quantenmodell von Entscheidungen erklärt „Irrationalität" als Rationalität anderer Ordnung

- Beratung reduziert Fehler durch Erhöhung wechselseitiger Information

Heuristiken siegen unter Bedingungen hoher Unsicherheit und Rauschen

Einfache Heuristiken (z.B. „wähle das Erkennbare") übertreffen oft komplexe statistische Modelle bei realen Aufgaben mit verrauschten Daten. Komplexe Modelle überfitten auf Rauschen, während Heuristiken es ignorieren.

In der Medizin rettet schnelle Musterdiagnose Leben, wenn keine Zeit für vollständige Analyse bleibt — ein erfahrener Arzt „sieht" einen Herzinfarkt anhand einer Kombination subtiler Zeichen schneller, als ein Algorithmus das EKG verarbeitet (S005).

Soziale Heuristiken koordinieren kollektive Handlungen

Die Heuristik „mach es wie die Mehrheit" wirkt wie Konformismus, löst aber das Koordinationsproblem ohne zentrale Steuerung. Bei Panik (Brand, Terroranschlag) kann dem Strom folgen die optimale Strategie sein — Sie haben keine Zeit, Evakuierungspläne zu analysieren.

Kollektives Verhalten aggregiert verteilte Information. Das Problem entsteht, wenn sich die Umwelt schneller ändert als die Heuristik sich anpasst: Die Menge rennt zum blockierten Ausgang, weil „alle dorthin rennen".

Kognitive Ökonomie ist ein evolutionärer Vorteil

Das Gehirn verbraucht 20% der Körperenergie bei 2% der Masse. Analytisches Denken ist energetisch teuer — man kann es nicht permanent aktiviert halten.

Heuristiken sind ein Cache, der es erlaubt, tausende Mikroentscheidungen pro Tag zu treffen (was anziehen, welche Route wählen, wem vertrauen), ohne Glukose zu verbrennen. Heuristiken zu kritisieren ohne diese Einschränkung zu berücksichtigen ist wie den Prozessor-Cache dafür zu kritisieren, dass er nicht die gesamte Datenbank speichert.

Logische Fehler können rhetorisch effektiv sein

Argumentum ad populum ist formal fehlerhaft, aber sozial überzeugend — es appelliert an das Bedürfnis nach Zugehörigkeit. In Diplomatie und Politik ist die rhetorische Kraft eines Arguments wichtiger als seine logische Validität (S001).

Der Fehlschluss „Dammbruch" kann begründet sein, wenn Eskalationsmechanismen existieren — etwa wenn der erste Kompromiss tatsächlich einen Präzedenzfall für weitere schafft. Ziel der Rhetorik ist nicht, Wahrheit zu beweisen, sondern das Publikum zum Handeln zu bewegen.

Kontextspezifität macht universelle Kritik sinnlos

Was in einem Bereich ein Fehler ist, kann in einem anderen die Norm sein. In der Wissenschaft ist post hoc ergo propter hoc ein grober Fehler, aber in der medizinischen Diagnostik ist die zeitliche Abfolge von Symptomen ein Schlüsselmerkmal.

- Dunning-Kruger-Effekt

- Kompetenzüberschätzung bei Anfängern wird in der Wissenschaft kritisiert, aber in der Startup-Kultur kann „naive Selbstsicherheit" ein Vorteil sein — sie ermöglicht es, ein Projekt zu starten, das ein Experte als unrealistisch abgelehnt hätte.

- Logische Fehler im Diskurs

- Intelligente Menschen glauben an Unsinn nicht, weil sie dumm sind, sondern weil Kontext und Rhetorik Logik neu definieren. Mehr dazu siehe logische Fehler im Diskurs.

Das Quantenmodell von Entscheidungen erklärt „Irrationalität" als Rationalität anderer Ordnung

Die klassische Entscheidungstheorie sagt voraus, dass Menschen erwarteten Nutzen maximieren. Aber Experimente zeigen systematische Verletzungen: Reihenfolgeeffekte, bei denen die Abfolge von Fragen Antworten verändert, und Disjunktionseffekte, bei denen Kenntnis des Ausgangs Präferenzen auf unlogische Weise ändert.

Das Quantenmodell sozialer Agenten erklärt dies durch Superposition von Zuständen und Interferenz von Wahrscheinlichkeiten (S003). Entscheidungen sind nicht determiniert bis zum Moment der „Messung" (Frage), und der Kontext kollabiert die Wellenfunktion der Präferenzen. Das ist kein Fehler, sondern andere Mathematik.

Beratung reduziert Fehler durch Erhöhung wechselseitiger Information

Paradoxien der klassischen Entscheidungstheorie (z.B. Ellsberg-Paradoxon, bei dem Menschen bekannte Wahrscheinlichkeiten unbekannten vorziehen) schwächen sich ab, wenn Agenten sich gegenseitig beraten. Informationsaustausch erhöht die wechselseitige Information zwischen Agenten, was die Entropie von Entscheidungen senkt und den Einfluss kognitiver Verzerrungen verringert (S003).

Kollektive Entscheidungen sind oft präziser als individuelle — nicht wegen „Schwarmintelligenz", sondern weil Informationsinterferenz zufällige Fluktuationen dämpft.

Das erklärt, warum logische Fehler in offenen Systemen weniger gefährlich sind, wo Dialog und Überprüfung möglich sind. Isolation verstärkt Verzerrungen; Vernetzung neutralisiert sie.

Evidenzbasis: Was Studien 2025 über Mechanismen kognitiver Fallen aussagen

Empirische Daten zu kognitiven Verzerrungen werden seit den 1970er Jahren gesammelt, doch erst in den letzten Jahren entstanden Modelle, die erklären, warum die klassische Rationalitätstheorie systematisch versagt. Der entscheidende Wandel — vom Beschreiben von Fehlern zum Verstehen ihrer Mechanismen. Mehr dazu im Bereich Kritisches Denken.

Quantentheorie der Entscheidungen: Warum das klassische Modell paradox ist

Die klassische Erwartungsnutzentheorie geht davon aus, dass Präferenzen stabil sind und nicht von der Reihenfolge der Fragen abhängen. Experimente zeigen das Gegenteil: Fragt man zuerst „Sind Sie glücklich in Ihrer Ehe?" und dann „Wie glücklich sind Sie insgesamt?", ist die Korrelation zwischen den Antworten hoch. Vertauscht man die Reihenfolge — sinkt die Korrelation.

Dies ist der Reihenfolgeeffekt (order effect), der im klassischen Modell nicht erklärbar ist (S003). Das Quantenmodell der Entscheidungen führt Nichtkommutativität ein: Die Messung eines Parameters verändert den Systemzustand und beeinflusst die Messung eines anderen. Mathematisch wird dies durch Projektionsoperatoren im Hilbert-Raum beschrieben — dieselben Gleichungen wie in der Quantenmechanik (S003).

Die Reihenfolge der Fragen ist kein bloßes Artefakt des Fragebogens. Es ist eine fundamentale Eigenschaft: Die Messung eines Aspekts rekonfiguriert den psychischen Zustand für den nächsten.

Ellsberg-Paradoxon und Ungewissheit: Warum Menschen unbekannte Wahrscheinlichkeiten meiden

Im Ellsberg-Paradoxon werden Teilnehmern zwei Urnen angeboten: In der ersten befinden sich 50 rote und 50 schwarze Kugeln (bekannte Verteilung), in der zweiten — 100 Kugeln mit unbekanntem Verhältnis. Die Mehrheit bevorzugt Wetten auf die erste Urne, selbst wenn der Gewinn identisch ist — dies verletzt das Unabhängigkeitsaxiom der klassischen Theorie.

Das Quantenmodell erklärt dies durch Entropie: Die Ungewissheit der zweiten Urne erhöht die Entscheidungsentropie, was als Risiko wahrgenommen wird. Wenn Akteure sich beraten, reduziert der Informationsaustausch die Entropie — und die Präferenz für die erste Urne schwächt sich ab (S003). Gruppenentscheidungen zeigen geringere Anfälligkeit für das Ellsberg-Paradoxon.

Kontextspezifität in der medizinischen Diagnostik: Wenn Heuristiken töten

Eine Studie zum klinischen Denken zeigte, dass Kontextfaktoren — Tageszeit, Erschöpfung des Arztes, Reihenfolge der Patientenaufnahme — systematisch die Diagnosegenauigkeit beeinflussen (S005). Der Verfügbarkeitseffekt veranlasst Ärzte, eine Diagnose zu stellen, die sie kürzlich gesehen haben.

Gab es morgens drei Pneumoniefälle, erhält der vierte Patient mit Husten dieselbe Diagnose, selbst wenn die Symptome abweichen. Der Basisraten-Fehlschluss ist besonders gefährlich bei seltenen Krankheiten: Ein Test mit 99% Sensitivität und 99% Spezifität für eine Krankheit mit 0,1% Prävalenz liefert 90% falsch-positive Ergebnisse — doch Ärzte ignorieren dies und fokussieren auf die „99% Genauigkeit" (S005).

- Verfügbarkeitseffekt

- Ein kürzlich gesehener Fall wird zum Anker für die Interpretation neuer Daten. Mechanismus: Aktivierte neuronale Netzwerke bleiben erregt, senken die Schwelle für ähnliche Muster.

- Basisraten-Fehlschluss

- Ignorieren der Ausgangswahrscheinlichkeit eines Ereignisses zugunsten der Testspezifität. Gefährlich in der Medizin: Seltene Krankheit + hochpräziser Test = Mehrheit der positiven Ergebnisse falsch.

Diplomatische Fehlschläge: Wie kognitive Fallen Verhandlungen zerstören

Die Analyse diplomatischer Fälle identifizierte typische Fallen: Ankereffekt (das erste Angebot definiert die Verhandlungsspanne), Attributionsfehler (Härte des Gegners wird dem Charakter statt der Situation zugeschrieben), Eskalation der Verpflichtungen (S001). Die Kubakrise 1962 — beide Seiten interpretierten die Handlungen des anderen durch die Brille feindseliger Absichten und ignorierten situativen Druck.

Erst direkte Kommunikation (die Hotline Kennedy-Chruschtschow) reduzierte die Informationsentropie und ermöglichte die Deeskalation.

Evidence-based Management: Warum Hyperrationalität ebenfalls eine Falle ist

Kritik am Evidence-based Management zeigt ein Paradoxon: Die Forderung nach strengen Beweisen für jede Entscheidung kann zum Handlungslähmung führen (S002). Unter Ungewissheit (Startup in neuer Nische) existieren schlicht keine Daten — auf ihr Erscheinen zu warten bedeutet, das Gelegenheitsfenster zu verpassen.

EBM funktioniert in stabilen Umgebungen (Medizin, Ingenieurwesen), doch in sich schnell verändernden Kontexten (Technologiegeschäft, Geopolitik) können Heuristiken und Expertenintuition effektiver sein. Der Fehler liegt nicht im Einsatz von Heuristiken, sondern in der Unfähigkeit, je nach Kontext zwischen Denkmodi zu wechseln (S002).

Hyperrationalität unter Ungewissheit ist keine Tugend, sondern Lähmung. Heuristiken existieren, weil sie in Echtzeit funktionieren.

Automatisierte Entscheidungssysteme: Neue Fallen alter Fehler

Automatisierte Entscheidungssysteme erben kognitive Verzerrungen ihrer Entwickler durch Daten und Algorithmen. Enthält der Trainingsdatensatz historische Vorurteile (z.B. Recruiting-Algorithmus trainiert auf Daten, bei denen 90% erfolgreicher Kandidaten Männer sind), reproduziert das System Diskriminierung.

Bestätigungsfehler wird in die Metrikauswahl kodiert: Optimiert man auf Genauigkeit unter Ignorierung falsch-negativer Ergebnisse, übersieht das System seltene, aber kritische Fälle. Ethics-based Auditing schlägt strukturierte Prüfung auf Übereinstimmung mit ethischen Normen vor, doch dies ist ein „weicher" Mechanismus — die Hauptaufgabe der Auditoren ist nicht Bestrafung, sondern Förderung ethischer Reflexion in Schlüsselphasen der Entwicklung.

Mehr zu logischen Fehlern, die in Algorithmen kodiert werden, siehe logische Fehler: Sophismen erkennen lernen und Korrelation ist nicht gleich Kausalität.

Mechanismen der Sabotage: Wie Heuristiken Geschwindigkeit in Verwundbarkeit verwandeln

Das Verständnis des Mechanismus ist der Schlüssel zum Schutz. Kognitive Fallen funktionieren nicht zufällig: Sie nutzen architektonische Besonderheiten des Gehirns, evolutionäre Prioritäten und soziale Instinkte aus. Mehr dazu im Abschnitt Statistik und Wahrscheinlichkeitstheorie.

Die Analyse von Ursache-Wirkungs-Ketten zeigt, wo genau die Rationalität zusammenbricht.

🔁 Verfügbarkeitsheuristik: Warum mediale Ereignisse die Risikobewertung verzerren

Die Verfügbarkeitsheuristik bewertet die Wahrscheinlichkeit eines Ereignisses nach der Leichtigkeit, mit der Beispiele in den Sinn kommen. Lebhafte, emotional aufgeladene Ereignisse (Terroranschläge, Flugzeugabstürze, Haiangriffe) werden besser erinnert und schneller aktiviert als statistisch häufige, aber langweilige (Herz-Kreislauf-Erkrankungen, Autounfälle).

Medien verstärken den Effekt: Die Berichterstattung über seltene, aber dramatische Ereignisse erzeugt eine Illusion von Häufigkeit. Menschen haben Angst zu fliegen, aber nicht Auto zu fahren, obwohl das Risiko, bei einem Verkehrsunfall zu sterben, um Größenordnungen höher ist.

Im Business führt dies zur Überbewertung von „schwarzen Schwänen" und zur Unterbewertung routinemäßiger Risiken — die Strategie konzentriert sich auf sichtbare Bedrohungen und ignoriert systemische.

🧷 Ankereffekt: Wie die erste Zahl den gesamten Verhandlungsbereich erobert

Der Anchoring-Effekt funktioniert durch Priming: Die erste Zahl, die Sie hören (selbst wenn sie zufällig ist), wird zum Bezugspunkt für alle nachfolgenden Bewertungen.

Klassisches Experiment: Teilnehmer drehten ein Glücksrad (Zufallszahl von 0 bis 100) und wurden dann gebeten, den Anteil afrikanischer Länder in der UNO zu schätzen. Diejenigen, die 10 erhielten, gaben eine Schätzung von ~25%, diejenigen mit 65 — ~45%. Das Glücksrad hatte nichts mit der Frage zu tun, aber der Anker wirkte.

- In Verhandlungen

- Das erste Angebot bestimmt den Verhandlungsbereich. Wenn ein Verkäufer einen Preis von 100.000€ nennt, wird der endgültige Deal näher an dieser Zahl liegen, als wenn er mit 50.000€ begonnen hätte.

- Schutz

- Selbst das erste Angebot machen oder den Anker explizit ablehnen: „Diese Zahl ist nicht relevant, lassen Sie uns mit einer Marktanalyse beginnen".

🧩 Basisraten-Fehlschluss: Warum Ärzte bei präzisen Tests falsche Diagnosen stellen

Der Base Rate Fallacy ignoriert die A-priori-Wahrscheinlichkeit (Basisrate) und konzentriert sich auf spezifische Informationen. Ein Test auf eine seltene Krankheit (Prävalenz 0,1%) mit einer Sensitivität von 99% und Spezifität von 99% ergibt ein positives Ergebnis.

Intuitive Antwort: Wahrscheinlichkeit der Krankheit ~99%. Korrekte Antwort (Bayes-Theorem): ~9% (S005).

| Gruppe | Größe | Testergebnis | Anzahl |

|---|---|---|---|

| Kranke (0,1%) | 10 von 10.000 | Positiv (99%) | ~10 |

| Gesunde (99,9%) | 9.990 von 10.000 | Falsch-positiv (1%) | ~100 |

| Wahrscheinlichkeit der Krankheit bei positivem Test | 10 / (10+100) ≈ 9% | ||

Ärzte ignorieren systematisch die Basisrate und konzentrieren sich auf die „99% Testgenauigkeit". Dies führt zu Überdiagnosen und unnötiger Behandlung.

🔁 Eskalation des Commitments: Warum versunkene Kosten Projekte töten

Der Sunk Cost Fallacy zwingt dazu, ein gescheitertes Projekt fortzusetzen, weil „schon so viel investiert wurde". Das Gehirn nimmt den Abbruch als Eingeständnis eines Fehlers wahr, was Schmerzzentren aktiviert (anteriorer cingulärer Cortex).

Rational: Versunkene Kosten sollten die Entscheidung nicht beeinflussen — wichtig sind nur zukünftige Vorteile und Kosten. Aber emotional: Abbruch = Gesichtsverlust, Eingeständnis von Inkompetenz.

In Unternehmen wird dies durch Gruppendenken verstärkt: Ein Team, das Jahre in ein Projekt investiert hat, kann das Scheitern nicht eingestehen, ohne seine Identität zu zerstören.

Beispiel: Concorde — die britische und französische Regierung finanzierten das defizitäre Projekt weiter, weil ein Stopp ein Fehlereingeständnis auf nationaler Ebene bedeutet hätte.

🧬 Fundamentaler Attributionsfehler: Warum wir Charakter sehen, nicht Situation

Der Fundamental Attribution Error überbewertet die Rolle persönlicher Faktoren und unterbewertet situative. Wenn jemand unhöflich ist, denken wir „er ist ein Rüpel", nicht „vielleicht hat er einen schweren Tag".

Mechanismus: Die Bewertung situativer Faktoren erfordert zusätzliche Informationen und kognitive Anstrengung, während die Attribution auf den Charakter schnell und automatisch erfolgt.

- Wir beobachten Verhalten (harte Position des Gegners)

- Wir attribuieren schnell auf den Charakter (Feindseligkeit, Aggression)

- Wir ignorieren situative Faktoren (innenpolitischer Druck, Einschränkungen)

- Wir treffen Entscheidungen auf Basis eines unvollständigen Modells (Verhandlungen scheitern) (S001)

Schutz: Situative Einschränkungen explizit modellieren. Sich selbst fragen: „Welche Faktoren könnten ihn zwingen, so zu handeln?" — dies schaltet die Aufmerksamkeit von System 1 auf System 2 um.

Mehr über logische Fehler und ihre Mechanismen — und wie sie in den Diskurs eingebettet werden.

Konflikte und Unklarheiten: Wo Quellen divergieren und warum das wichtig ist

Wissenschaftliche Redlichkeit erfordert das Eingeständnis: Nicht alle Fragen sind gelöst. Quellen divergieren in der Bewertung, wie universal kognitive Verzerrungen sind, wie korrigierbar sie sind und in welchen Kontexten Heuristiken gerechtfertigt sind. Mehr dazu im Abschnitt Epistemologie.

Drei Streitpunkte, die bestimmen, wie Sie weiter vorgehen werden.

- Universalität vs. Kontextabhängigkeit. (S003) behauptet, dass Heuristiken ein adaptives Werkzeug sind, das in den meisten Szenarien funktioniert. Doch (S001) zeigt: Motiviertes Denken und ideologische Filter sind so mächtig, dass „universelle" Regeln unter dem Druck von Überzeugungen zusammenbrechen. Fazit: Heuristiken funktionieren, solange der Identitätsschutz nicht aktiviert wird.

- Korrektur durch Training vs. strukturelle Unvermeidbarkeit. (S002) schlägt alternative Testformen vor und deutet auf die Plastizität kognitiver Prozesse hin. Jedoch weist (S004) auf strikte Grenzen des Arbeitsgedächtnisses hin — die Ressource ist endlich, und kein Training kann sie physisch erweitern.

- Assoziatives vs. propositionales Lernen. (S005) definiert den Mechanismus neu: Menschliches Lernen ist nicht nur assoziativ, sondern propositional (logisch-strukturiert). Das bedeutet, dass Denkfallen nicht einfach automatische Auslöser sind, sondern das Ergebnis falsch konstruierter Urteile.

Divergenzen zwischen Quellen sind keine Schwäche der Wissenschaft, sondern eine Karte der Realität. Jeder Konflikt weist auf einen Grenzfall hin, wo Ihr Weltmodell versagen kann.

Praktische Bedeutung: Suchen Sie nicht nach dem universellen Lifehack. Identifizieren Sie stattdessen logische Fehler in Ihren eigenen Urteilen und unterscheiden Sie Korrelation und Kausalität bei jeder konkreten Entscheidung.