❌ Logische Fehlschlüsse

❌ Logische FehlschlüsseLogisch-probabilistische Analyse: Von Boole bis zu modernen Systemenλ

Untersuchung der fundamentalen Einheit von Logik und Wahrscheinlichkeitstheorie zur Analyse von Zuverlässigkeit, Sicherheit und Entscheidungsfindung unter Unsicherheit

Overview

Logik und Wahrscheinlichkeit stellen zwei fundamentale Werkzeuge der Erkenntnis dar, die bereits 1854 von George Boole in seinem Werk „An Investigation of the Laws of Thought" vereint wurden. Die logisch-probabilistische Analyse verbindet die Strenge deduktiver Schlussfolgerungen mit der quantitativen Bewertung von Unsicherheit und schafft damit einen leistungsfähigen methodologischen Apparat zur Lösung praktischer Probleme. Dieses Gebiet umfasst die theoretischen Grundlagen der Booleschen Algebra, probabilistische Logik, Zuverlässigkeitsanalyse komplexer Systeme und moderne computergestützte Implementierungen.

🛡️ Laplace-Protokoll: Logik und Wahrscheinlichkeit konkurrieren nicht, sondern ergänzen einander — klassische Logik arbeitet mit Gewissheit, probabilistische Logik erweitert sie auf den Bereich der Unsicherheit und bewahrt dabei seit 1854 mathematische Strenge.

Reference Protocol

Wissenschaftliche Grundlage

Evidenzbasierter Rahmen für kritische Analyse

Navigation Matrix

Unterabschnitte

[logical-fallacies]

Logische Fehlschlüsse

Systematische Denkfehler begegnen uns überall – von wissenschaftlichen Studien bis zu Alltagsentscheidungen, doch man kann lernen, sie zu erkennen und zu vermeiden.

Erkunden

[stats-probability]

Statistik und Wahrscheinlichkeitstheorie

Fundamentale mathematische Disziplinen für Datenanalyse, Entscheidungsfindung und das Verständnis zufälliger Phänomene in Wissenschaft, Wirtschaft und Alltag

Erkunden

[thinking-tools]

Denkwerkzeuge

Visuelle und konzeptuelle Werkzeuge, die dabei helfen, komplexe Probleme zu strukturieren, Denken sichtbar zu machen und kognitive Fähigkeiten höherer Ordnung in Bildung und beruflicher Praxis zu entwickeln

Erkunden

Protocol: Evaluation

Teste Dich

Quiz zu diesem Thema kommt bald

Sector L1

Artikel

Forschungsmaterialien, Essays und tiefe Einblicke in die Mechanismen des kritischen Denkens.

❌ Logische Fehlschlüsse

❌ Logische Fehlschlüsse ❌ Logische Fehlschlüsse

❌ Logische Fehlschlüsse ❌ Logische Fehlschlüsse

❌ Logische Fehlschlüsse ❌ Logische Fehlschlüsse

❌ Logische Fehlschlüsse 🛠️ Denkwerkzeuge

🛠️ Denkwerkzeuge 🛠️ Denkwerkzeuge

🛠️ Denkwerkzeuge ❌ Logische Fehlschlüsse

❌ Logische Fehlschlüsse 📈 Statistik und Wahrscheinlichkeitstheorie

📈 Statistik und Wahrscheinlichkeitstheorie 📈 Statistik und Wahrscheinlichkeitstheorie

📈 Statistik und Wahrscheinlichkeitstheorie ❌ Logische Fehlschlüsse

❌ Logische Fehlschlüsse ❌ Logische Fehlschlüsse

❌ Logische Fehlschlüsse⚡

Vertiefung

Historische Grundlagen: von Boole bis Poretsky

Boole 1854: Logik trifft auf Wahrscheinlichkeit

George Boole etablierte in „An Investigation of the Laws of Thought" (1854) erstmals eine strenge mathematische Verbindung zwischen logischen Strukturen und Wahrscheinlichkeitstheorie. Die Boolesche Algebra wurde zur gemeinsamen Grundlage beider Disziplinen — dieselben Operationen funktionierten sowohl für logische Aussagen als auch für probabilistische Ereignisse.

Dies war keine theoretische Übung. Diese Vereinigung legte das Fundament für alle nachfolgenden Entwicklungen in der probabilistischen Logik über mehr als 170 Jahre hinweg.

Logische Operationen der Konjunktion, Disjunktion und Negation haben direkte Analoga in der Wahrscheinlichkeitstheorie als Operationen über Ereignisse. Die Boolesche Algebra lieferte eine einheitliche mathematische Sprache, in der Wahrheitswerte und Wahrscheinlichkeitsmaße innerhalb eines formalen Systems verarbeitet werden.

Diese Dualität ermöglichte die Entwicklung von Methoden zur quantitativen Analyse logischer Systeme unter Berücksichtigung von Unsicherheit.

Poretsky: klassisches Wahrscheinlichkeitskalkül

P.S. Poretsky entwickelte den klassischen Ansatz zum Wahrscheinlichkeitskalkül für zufällige Ereignisse, der eine fundamentale Methode in der modernen Theorie bleibt. Seine Arbeiten konzentrierten sich auf strenge Algorithmen zur Berechnung von Wahrscheinlichkeiten komplexer Ereignisse durch logische Kombinationen elementarer Ereignisse.

- Gruppe unvereinbarer Ereignisse

- Poretskys fundamentales Konzept, bei dem Ereignisse nicht gleichzeitig auftreten können. Dies ermöglicht präzise quantitative Schlussfolgerungen in logischen Systemen, in denen absolute Gewissheit unerreichbar ist.

Poretskys klassischer Ansatz wurde nicht durch moderne Methoden ersetzt, sondern wurde zur Grundlage, auf der neue Ansätze aufbauen — einschließlich Tupelalgebra und semantischer Modelle.

Theoretische Grundlagen der logisch-probabilistischen Analyse

Boolesche Algebra als gemeinsame Struktur

Die Boolesche Algebra ist eine universelle mathematische Struktur, die gleichzeitig klassische Logik und Wahrscheinlichkeitstheorie bedient. In der Logik operiert sie mit Wahrheitswerten (wahr/falsch), in der Wahrscheinlichkeit mit Ereignissen mit Maßen von 0 bis 1.

Diese Dualität reflektiert die tiefe Verbindung zwischen deduktivem Schließen unter Gewissheit und induktivem Schließen unter Unsicherheit.

| Operation | Logischer Kontext | Probabilistischer Kontext |

|---|---|---|

| Konjunktion (UND) | Logisches Produkt | Schnittmenge von Ereignissen |

| Disjunktion (ODER) | Logische Summe | Vereinigung von Ereignissen |

| Negation (NICHT) | Wertinversion | Komplement eines Ereignisses |

Die isomorphe Struktur der Operationen ermöglicht die Anwendung logischer Methoden auf probabilistische Probleme und umgekehrt, wodurch eine einheitliche methodologische Grundlage geschaffen wird.

Logik und Wahrscheinlichkeit sind nicht unvereinbar — sie sind komplementäre Werkzeuge, die auf derselben algebraischen Grundlage arbeiten.

Probabilistische Logik und quantitative Schlussfolgerungen

Probabilistische Logik erweitert die klassische Logik, indem sie Wahrheitswerte zu probabilistischen Werten verallgemeinert. Jeder Aussage wird ein numerischer Wert zugewiesen, der den Grad der Gewissheit ihrer Wahrheit widerspiegelt.

Schlussregeln beinhalten die quantitative Bewertung von Unsicherheit und kombinieren deduktives Schließen mit statistischen Belegen.

- Erhaltung der logischen Struktur bei Einbeziehung von Unsicherheit

- Kombination deduktiver Regeln mit probabilistischen Maßen

- Anwendung auf Schlussfolgerungen unter unvollständiger Information

Quantitative Schlussfolgerungen unterscheiden sich von reiner statistischer Analyse dadurch, dass sie die logische Struktur bei Einbeziehung von Unsicherheit bewahren. Dieser Ansatz findet Anwendung in Denkwerkzeugen für künstliche Intelligenz und maschinelles Lernen.

Probabilistische Logik vereint die normative Kraft der Logik mit der empirischen Flexibilität der Wahrscheinlichkeit — ein grundlegendes Element aller Handlungen und Analysen.

Methodologie der logisch-probabilistischen Modellierung

Wahrscheinlichkeitsrechnung in logischen Systemen

Logisch-probabilistische Kalkulation — ein mathematisches Framework zur Berechnung von Wahrscheinlichkeiten komplexer Ereignisse, die durch logische Kombinationen elementarer Ereignisse ausgedrückt werden. Vereint strukturelle Analyse logischer Abhängigkeiten mit quantitativer Bewertung von Wahrscheinlichkeiten.

Standardwerkzeug in der Zuverlässigkeitstechnik, Risikoanalyse und Sicherheitsbewertung kritischer Infrastruktur. Entgegen weit verbreiteter Annahmen ist dies kein rein theoretischer Apparat — praktische Anwendungen umfassen Zuverlässigkeitsanalyse komplexer Systeme, quantitative Risikomodellierung, Mustererkennung und Klassifikation.

- Strukturanalyse: Identifikation logischer Abhängigkeiten zwischen Systemkomponenten

- Quantitative Bewertung: Zuweisung von Wahrscheinlichkeiten zu elementaren Ereignissen

- Berechnung: Ermittlung von Wahrscheinlichkeiten komplexer Ereignisse durch logische Operationen

- Validierung: Prüfung der Konsistenz und Reproduzierbarkeit der Schlussfolgerungen

Die Methodologie liefert präzise quantitative Maße für Unsicherheit und macht Schlussfolgerungen in Szenarien rigoros, in denen absolute Gewissheit unerreichbar ist. Dies ist kritisch für ingenieurwissenschaftliches Denken bei der Arbeit mit komplexen Systemen.

Anforderung maximaler Spezifität und statistische Mehrdeutigkeit

Die Anforderung maximaler Spezifität (RMS) — eine formalisierte Regel zur Beseitigung von Problemen statistischer Mehrdeutigkeit (SAP). Garantiert, dass bei mehreren möglichen probabilistischen Interpretationen einer logischen Struktur die spezifischste gewählt wird, die Unsicherheit minimiert.

Problem: Logische Struktur erlaubt mehrere Wahrscheinlichkeitsverteilungen, die mit vorhandenen Daten kompatibel sind. Lösung: RMS löst diese Mehrdeutigkeiten systematisch auf und gewährleistet Konsistenz probabilistischer Schlussfolgerungen.

Besonders kritisch bei semantischer probabilistischer Inferenz, wo die Integration von Bedeutung und Wahrscheinlichkeit strenge Regeln zur Beseitigung interpretativer Unsicherheiten erfordert. Ohne RMS kann dasselbe logische Szenario unterschiedliche probabilistische Schlussfolgerungen erzeugen, abhängig von der gewählten Interpretation — was die Analyse unzuverlässig macht.

| Szenario | Ohne RMS | Mit Anwendung von RMS |

|---|---|---|

| Mehrere Verteilungen mit Daten kompatibel | Auswahl willkürlich oder implizit | Spezifischste wird gewählt |

| Reproduzierbarkeit der Schlussfolgerungen | Nicht garantiert | Garantiert |

| Interpretative Unsicherheiten | Bleiben ungelöst | Werden systematisch beseitigt |

RMS transformiert probabilistische Analyse von einer Kunst (wo Erfahrung und Intuition entscheiden) in eine ingenieurwissenschaftliche Disziplin mit reproduzierbaren Ergebnissen. Dies ist die Grundlage für Realitätsprüfung in logisch-probabilistischen Modellen.

Anwendung in der Zuverlässigkeits- und Sicherheitsanalyse komplexer technischer Systeme

Bewertung der Überlebensfähigkeit komplexer Systeme durch logisch-probabilistische Modelle

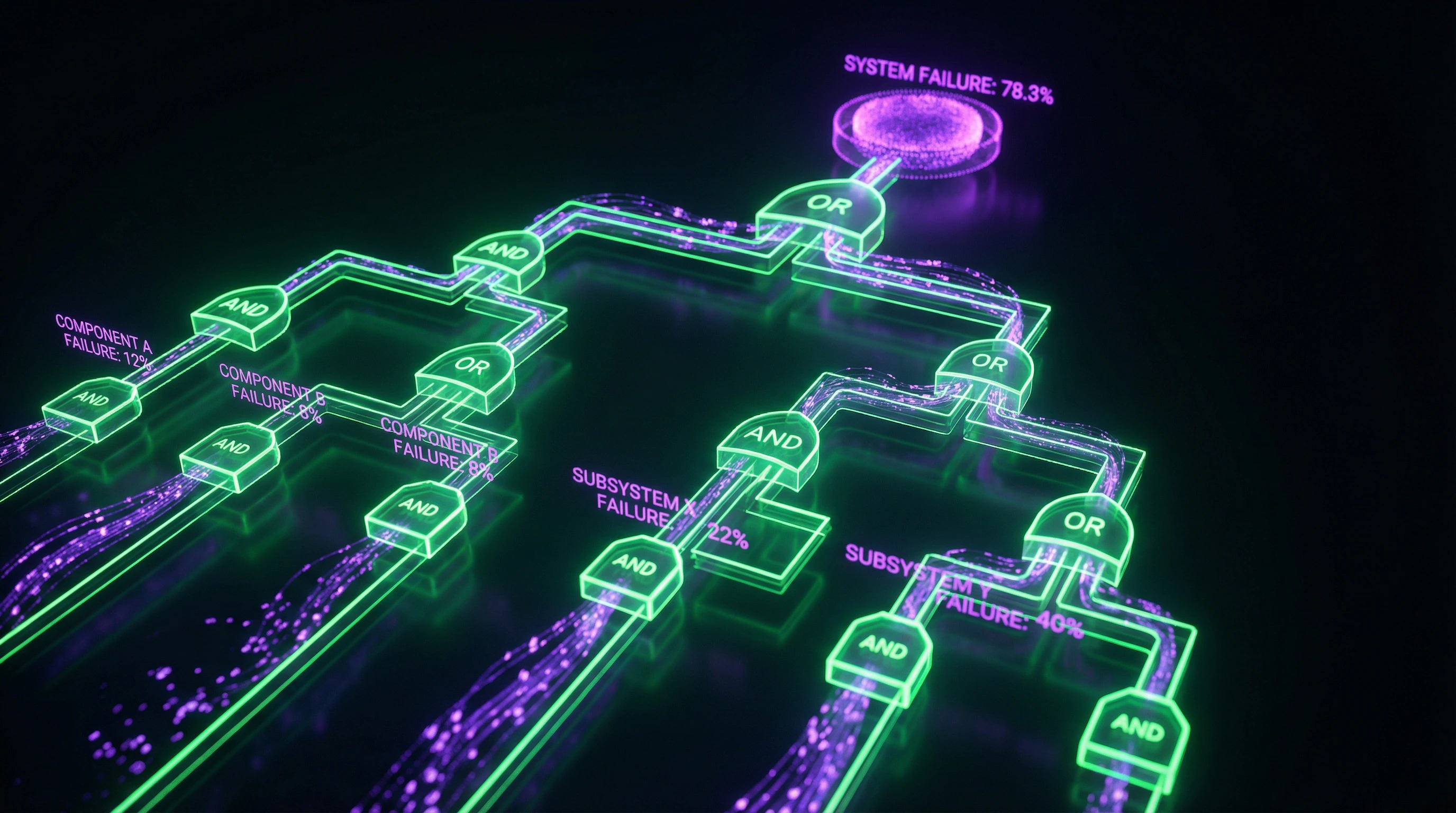

Die logisch-probabilistische Analyse ist eine Standardmethode zur Bewertung von Zuverlässigkeit, Überlebensfähigkeit und Sicherheit komplexer technischer Systeme. Sie verbindet strukturelle logische Modelle mit probabilistischen Ausfallcharakteristiken von Komponenten und ermöglicht die quantitative Bewertung der Wahrscheinlichkeit kritischer Ereignisse.

Überlebensfähigkeit eines Systems bezeichnet die Fähigkeit, bei Teilausfällen funktionsfähig zu bleiben. Dies erfordert die Analyse aller möglichen Kombinationen von Komponentenausfällen mittels boolescher Algebra.

- Fehlerbaum erstellen: Logische Operatoren (UND, ODER, NICHT) verknüpfen Basisereignisse mit probabilistischen Charakteristiken.

- Tupelalgebra für effiziente Wahrscheinlichkeitsberechnung anwenden – besonders kritisch für Systeme mit Tausenden von Komponenten.

- Kritische Ausfallpfade identifizieren und Redundanz optimieren, um die Gesamtzuverlässigkeit zu erhöhen.

Quantitative Risikoanalyse in kritischer Infrastruktur

Die quantitative Risikobewertung erfordert die Integration logischer Bedrohungsmodelle mit probabilistischen Verteilungen ihrer Realisierung. Der logisch-probabilistische Ansatz formalisiert die Verbindung zwischen initiierenden Ereignissen, Zwischenzuständen und finalen Konsequenzen durch strukturierte logische Ausdrücke.

Wahrscheinlichkeiten werden Basisereignissen auf Grundlage statistischer Daten, Experteneinschätzungen oder physikalischer Modelle zugewiesen. Anschließend wird probabilistischer Kalkül zur Berechnung der Gesamtrisiken angewendet.

Die Methode ist besonders effektiv für die Sicherheitsanalyse kritischer Infrastruktur, wo multiple Ausfallszenarien und deren Wechselwirkungen berücksichtigt werden müssen. Die Anforderung maximaler Spezifität eliminiert statistische Mehrdeutigkeiten bei unvollständigen Daten und gewährleistet konsistente Risikobewertungen.

Die Analyseergebnisse werden zur Priorisierung von Risikominderungsmaßnahmen und zur Begründung von Sicherheitsinvestitionen auf Basis quantitativer Kriterien verwendet.

Moderne computergestützte Ansätze zur probabilistischen Logik

Tupelalgebra für effiziente probabilistische Inferenz

Tupelalgebra ist ein computergestütztes Framework für probabilistisches Schließen, das effiziente Algorithmen für komplexe logische Strukturen bereitstellt. Wahrscheinlichkeitsverteilungen werden als Tupel dargestellt: geordnete Mengen von Werten, die verschiedenen logischen Zuständen des Systems entsprechen.

Algebraische Operationen auf Tupeln entsprechen direkt logischen Operationen (Konjunktion, Disjunktion, Negation) und ermöglichen die effiziente Berechnung resultierender Wahrscheinlichkeiten. Der Vorteil der Methode liegt in der Recheneffizienz für Systeme mit einer großen Anzahl von Variablen, bei denen klassische Methoden aufgrund kombinatorischer Explosion nicht anwendbar sind.

- Wahrscheinlichkeitsverteilungen als Tupel logischer Zustände darstellen

- Algebraische Operationen anwenden, die logischen Verknüpfungen entsprechen

- Gruppen sich gegenseitig ausschließender Ereignisse als fundamentale Einheit behandeln

- Resultierende Wahrscheinlichkeiten berechnen, ohne alle Kombinationen durchzugehen

Tupelalgebra findet Anwendung in der Mustererkennung, Klassifikation und anderen Bereichen, die probabilistische Inferenz in komplexen logischen Strukturen erfordern.

Semantische probabilistische Inferenz und Disambiguierung

Semantische probabilistische Inferenz integriert semantischen Gehalt mit probabilistischen Maßen und ermöglicht reichhaltigere Schlussfolgerungsmodelle. Der Ansatz erweitert die klassische probabilistische Logik durch Einbeziehung semantischer Beziehungen zwischen Konzepten und berücksichtigt kontextuelle Informationen bei probabilistischen Schlussfolgerungen.

Das Problem der statistischen Mehrdeutigkeit: Die logische Struktur lässt mehrere Wahrscheinlichkeitsverteilungen zu, die mit denselben beobachteten Daten kompatibel sind. Die Anforderung maximaler Spezifität löst diese Mehrdeutigkeit systematisch auf, indem sie die informativste Verteilung wählt, die die Entropie minimiert und dabei alle Einschränkungen erfüllt.

Die Konsistenz probabilistischer Inferenzen ist kritisch für künstliche Intelligenz und maschinelles Lernen – von ihr hängt die Zuverlässigkeit von Entscheidungssystemen ab. Die Formalisierung der Anforderung maximaler Spezifität in Begriffen von Logik und Wahrscheinlichkeit beseitigt Probleme, die bei multiplen Interpretationen von Daten entstehen.

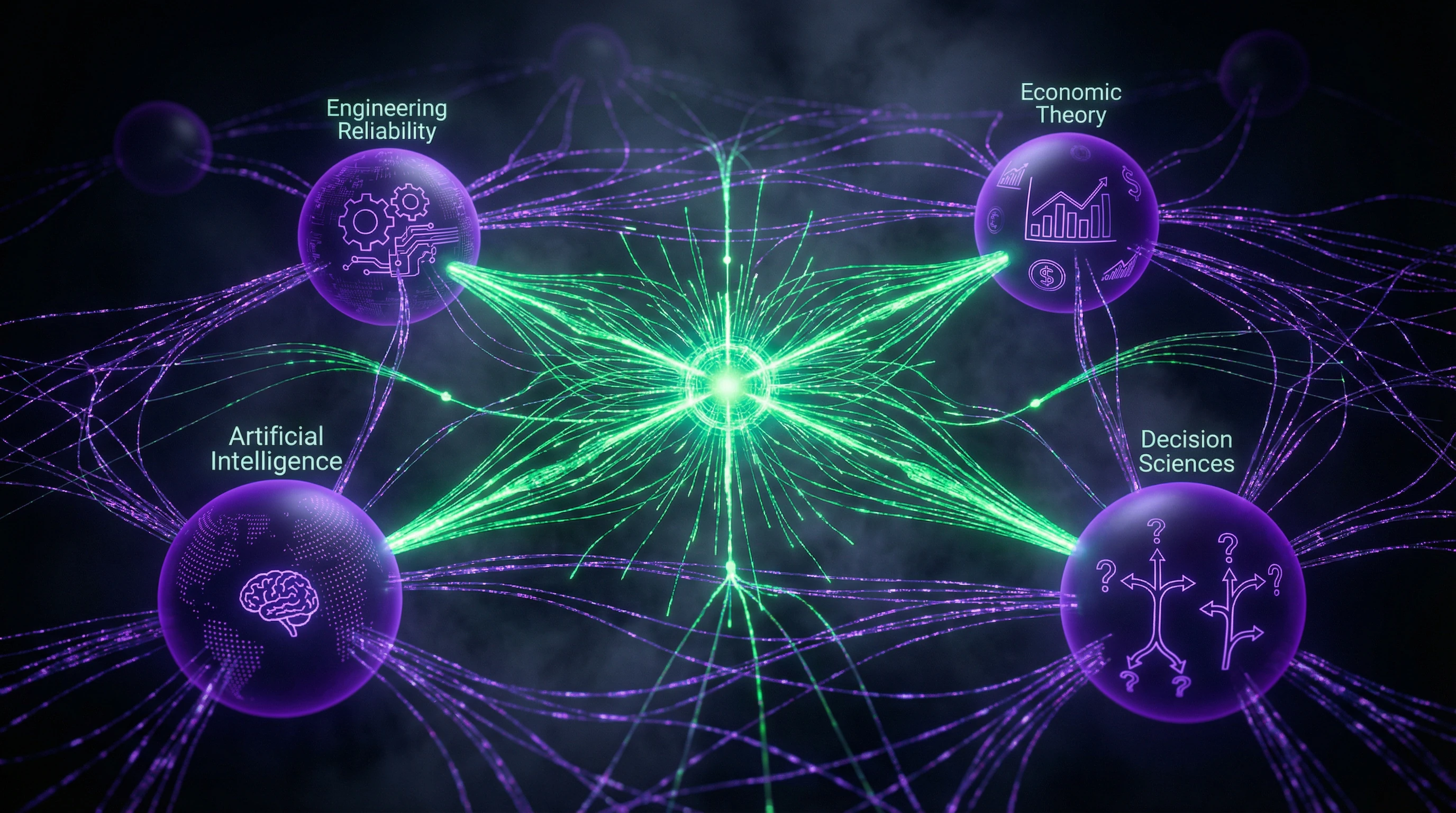

Interdisziplinäre Anwendungen und Entwicklungsperspektiven der Integration von Logik und Wahrscheinlichkeit

Künstliche Intelligenz und maschinelles Lernen unter Unsicherheit

Probabilistische Logik ist das Fundament für Schlussfolgerungen unter Unsicherheit in KI-Systemen. Sie ermöglicht die Kombination deduktiven Schließens mit induktivem Lernen aus Daten.

Bayessche Netze und probabilistische grafische Modelle folgen direkt aus den Prinzipien probabilistischer Logik. Sie funktionieren in der Mustererkennung, natürlichen Sprachverarbeitung, Planung und Entscheidungsfindung bei unvollständiger Information.

- Semantische probabilistische Inferenz interpretiert Bedeutung zusammen mit quantitativer Bewertung von Unsicherheit

- Transparente logische Strukturen mit probabilistischen Bewertungen machen KI-Entscheidungen erklärbar

- Die Zuverlässigkeit des Systems hängt von der Integration von Logik und Wahrscheinlichkeit in der Architektur ab

Entscheidungstheorie und ökonomische Anwendungen

Logik und Wahrscheinlichkeit sind grundlegende Elemente aller Handlungen und Analysen. John Maynard Keynes zeigte die fundamentale Rolle probabilistischen Schließens in der ökonomischen Analyse und Wahl unter Unsicherheit.

Die Integration logischer Präferenzstrukturen mit probabilistischen Bewertungen von Ergebnissen schafft eine mathematisch strenge Grundlage für rationale Wahl.

| Anwendungsbereich | Aufgabe | Instrument |

|---|---|---|

| Financial Engineering | Bewertung von Derivaten, Portfoliomanagement | Logisch-probabilistische Risikoanalyse |

| Systemisches Risiko | Quantitative Bewertung von Interdependenzen | Probabilistische Agentenmodelle |

| Verhaltensökonomie | Berücksichtigung kognitiver Einschränkungen | Integration von Abweichungen von Rationalität |

Entwicklungsperspektiven liegen in einer tieferen Integration verhaltensbezogener Aspekte der Entscheidungsfindung mit formalen probabilistischen Modellen, die systematische Abweichungen von Rationalität berücksichtigen.

Knowledge Access Protocol

FAQ

Häufig gestellte Fragen

Eine Methodik, die logische Strukturen (Boolesche Algebra) mit der Wahrscheinlichkeitstheorie verbindet, um Unsicherheit quantitativ zu bewerten. Sie wird zur Analyse von Zuverlässigkeit, Robustheit und Sicherheit komplexer Systeme eingesetzt, wobei die Logik die Struktur beschreibt und Wahrscheinlichkeiten die quantitativen Merkmale von Ereignissen erfassen.

George Boole 1854 in seiner Arbeit ‹An Investigation of the Laws of Thought›. Er schuf die mathematische Grundlage, die logische Operationen mit probabilistischen Berechnungen verknüpft, was zum Fundament moderner Methoden wurde. Poretskys Beitrag entwickelte die klassische Wahrscheinlichkeitsrechnung für zufällige Ereignisse.

Probabilistische Logik bewahrt die Struktur logischer Schlussfolgerungen, indem sie Wahrheitswerte auf Wahrscheinlichkeiten erweitert. Sie kombiniert deduktives mit induktivem Denken, im Gegensatz zur reinen statistischen Datenanalyse. Dies ermöglicht die Formalisierung von Schlussfolgerungen unter Unsicherheit.

Nein, das ist ein Mythos. Sie ergänzen sich: Die klassische Logik arbeitet mit Gewissheit, die Wahrscheinlichkeit mit Ungewissheit. Eine mathematisch strenge Integration existiert seit 1854 und ist durch 170 Jahre praktischer Anwendung bestätigt.

In Zuverlässigkeitstechnik, Risikobewertung, künstlicher Intelligenz und Entscheidungstheorie. Die Methode ist Standard für Sicherheitsanalysen komplexer technischer Systeme, probabilistische Programmierung und maschinelles Lernen. Wird auch in der Wirtschaft zur Modellierung von Entscheidungen unter Unsicherheit verwendet.

Eine formalisierte Anforderung in logisch-probabilistischen Systemen zur Beseitigung von Problemen statistischer Mehrdeutigkeit (SAP). Sie gewährleistet die Auswahl der konkretesten probabilistischen Schlussfolgerung aus möglichen Alternativen. Entscheidend für die Korrektheit semantischer probabilistischer Inferenz.

Man verwendet logisch-probabilistisches Kalkül: Zunächst wird ein logisches Modell der Ereignisse durch Boolesche Funktionen erstellt, dann werden Regeln zur Wahrscheinlichkeitsberechnung angewendet. Bei sich ausschließenden Ereignissen werden Wahrscheinlichkeiten addiert, bei abhängigen Ereignissen verwendet man bedingte Wahrscheinlichkeiten. Die Tupelalgebra automatisiert diese Berechnungen.

Eine Menge von Ereignissen, die nicht gleichzeitig eintreten können. Ein grundlegendes Konzept in der Wahrscheinlichkeitsmodellierung, bei dem die Summe der Wahrscheinlichkeiten solcher Ereignisse nicht größer als eins ist. Wird zur Konstruktion korrekter logisch-probabilistischer Systemmodelle verwendet.

Es wird ein logisches Modell der Komponentenausfälle erstellt (Fehlerbaum oder Boolesche Funktion), dann wird die Ausfallwahrscheinlichkeit des Systems über die Ausfallwahrscheinlichkeiten der Elemente berechnet. Die Methode berücksichtigt strukturelle Verbindungen und Abhängigkeiten zwischen Komponenten. Sie ermöglicht eine quantitative Bewertung von Robustheit und Sicherheit.

Sie dient als gemeinsame mathematische Struktur für Logik und Wahrscheinlichkeit. Boolesche Operationen (UND, ODER, NICHT) beschreiben logische Beziehungen zwischen Ereignissen, während Wahrscheinlichkeitsmaße den Ergebnissen dieser Operationen zugeordnet werden. Dies gewährleistet seit 1854 die Einheitlichkeit der Methodik.

Ja, dies ist einer der grundlegenden Ansätze für Schlussfolgerungen unter Unsicherheit. Bayessche Netze, probabilistische Programmierung und Fuzzy-Logik basieren auf diesen Prinzipien. Sie werden im maschinellen Lernen, in Expertensystemen und in der Robotik für Entscheidungsfindung eingesetzt.

Die Integration semantischer Beziehungen mit probabilistischen Bewertungen in logischen Systemen. Sie ermöglicht Schlussfolgerungen unter Berücksichtigung sowohl der logischen Wissensstruktur als auch des Vertrauensgrads. Erfordert die Formalisierung der Semantik durch probabilistische Maße.

Nein, das ist ein Irrtum. Probabilistische Logik bewahrt die Regeln der logischen Inferenz und erweitert sie auf Unsicherheit, während Statistik sich auf Datenanalyse konzentriert. Sie vereint Deduktion und Induktion in einem einheitlichen formalen System.

Sie bietet ein modernes rechnerisches Framework zur Automatisierung probabilistischer Schlussfolgerungen. Tupel repräsentieren Kombinationen von Ereignissen und deren Wahrscheinlichkeiten, algebraische Operationen führen logisch-probabilistische Berechnungen durch. Dies vereinfacht die Implementierung komplexer Modelle in Software.

Ja, dies ist ein Standardansatz in der quantitativen Risikoanalyse. Das logische Modell beschreibt Bedrohungsszenarien, Wahrscheinlichkeiten bewerten deren Realisierung, das Ergebnis ist ein quantitatives Risikomaß. Wird in der industriellen Sicherheit, im Finanzwesen und im Projektmanagement angewendet.

Entwicklung in Richtung KI, autonome Systeme und Big Data. Integration mit maschinellem Lernen für erklärbare KI, Anwendung in Quantencomputing und verteilten Systemen. Die Interdisziplinarität gewährleistet wachsende Anwendungen in Medizin, Wirtschaft und Sozialwissenschaften.