Epistemisches Eindringen als struktureller Defekt des modernen Expertendiskurses: Definition der Kompetenzgrenzen

Epistemisches Eindringen (epistemic trespassing) ist ein Phänomen, bei dem ein Spezialist mit anerkannter Expertise in einem Bereich kategorische Aussagen in einem anderen Bereich trifft, ohne über die notwendigen methodologischen Werkzeuge, kontextuelles Wissen oder epistemische Tugenden zu verfügen (S003). Das ist nicht nur ein Urteilsfehler — es ist eine systematische Verletzung epistemischer Normen.

Wenn sich ein Nobelpreisträger für Chemie zur Sozialpolitik äußert, werden seine Worte mit unverdientem Vertrauen aufgenommen. Der Halo-Effekt überträgt sich auf einen Bereich, in dem seine methodologische Ausbildung nicht anwendbar ist.

🧩 Warum sich epistemisches Eindringen von gewöhnlicher Inkompetenz unterscheidet

Der entscheidende Unterschied — das Vorhandensein legitimer Expertise im Ausgangsbereich. Einen Dilettanten, der sich über Quantenphysik äußert, kann man leicht ignorieren. Aber wenn das ein anerkannter Spezialist tut, erhalten seine Worte unverdientes Gewicht (S003).

Das Problem verschärft sich dadurch, dass der Experte selbst oft die Grenzen seiner Kompetenz nicht erkennt und annimmt, dass allgemeine Fähigkeiten des kritischen Denkens universell anwendbar sind. Das schafft die Illusion von Kompetenz dort, wo sie nicht existiert. Mehr dazu im Abschnitt Epistemologie.

🔎 Drei Dimensionen des epistemischen Eindringens

- Methodologisch

- Jede Disziplin entwickelt spezifische Werkzeuge für den Umgang mit Unsicherheit, Datenvalidierung und Schlussfolgerungen. Die Übertragung von Methoden ohne Anpassung führt zu systematischen Fehlern.

- Kontextuell

- Verständnis der historischen Entwicklung des Problems, zentraler Debatten, Nuancen der Terminologie. Das Fehlen dieses Kontexts macht das Urteil oberflächlich, selbst wenn die Methodologie formal eingehalten wird.

- Tugendhaft

- Epistemische Tugenden — intellektuelle Bescheidenheit, Sensibilität für Gegenargumente, Verständnis der Grenzen des eigenen Wissens (S003). Eindringen geschieht, wenn der Experte mindestens eine dieser Dimensionen ignoriert.

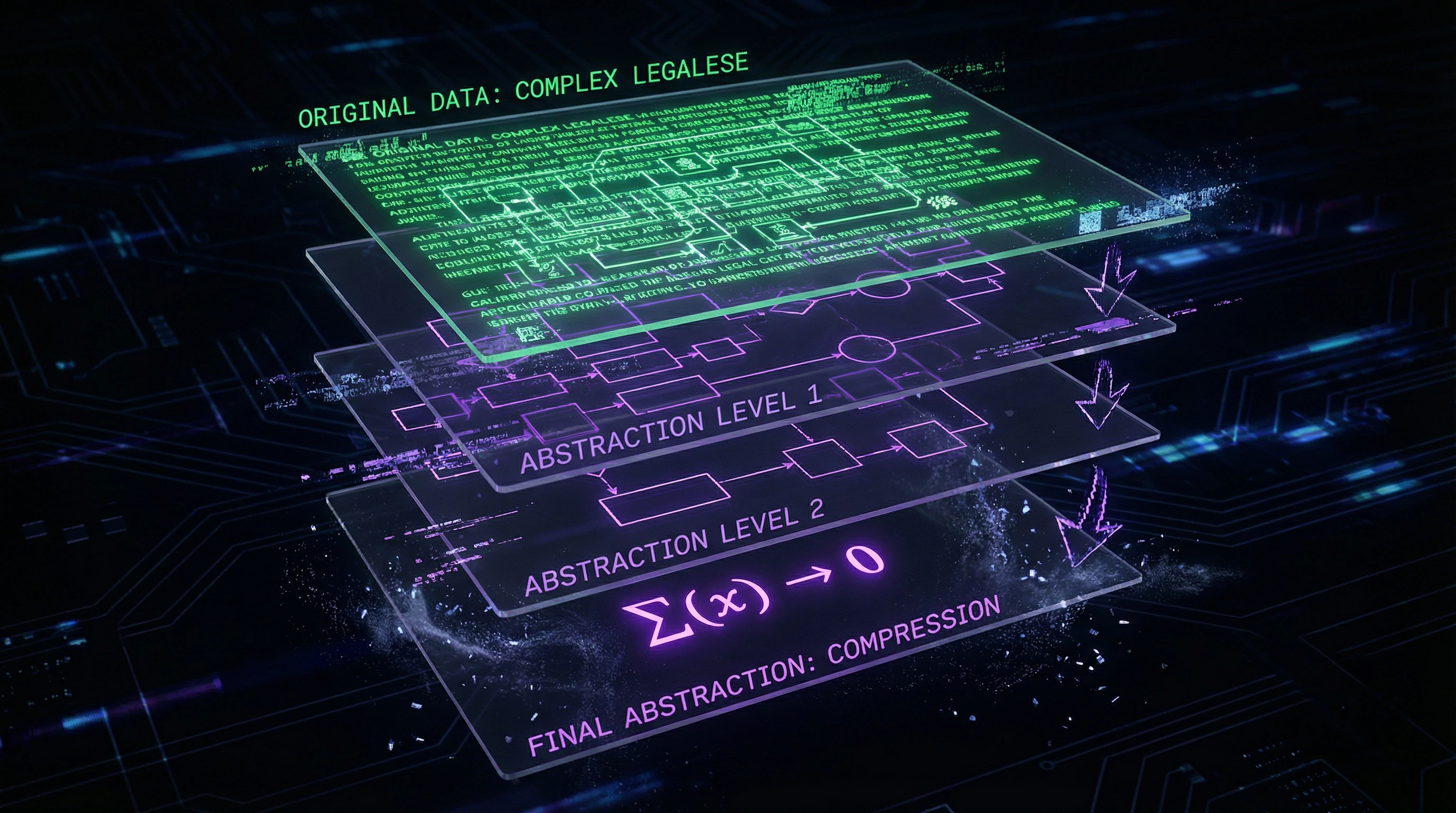

⚙️ Abstraktion als Mechanismus des epistemischen Eindringens

Informatiker sind darauf trainiert, Abstraktionen zu schaffen, die vereinfachen und verallgemeinern (S004). Diese professionelle Tugend wird zum epistemischen Laster, wenn die Abstraktion vorzeitig erstellt wird, ohne Verständnis kritischer kontextueller Details.

Vorzeitige Abstraktion, die wichtige Details auslässt, schafft das Risiko epistemischen Eindringens, indem sie fälschlicherweise ihre Relevanz in anderen Kontexten behauptet. So entstehen vereinfachte Metriken der algorithmischen „Fairness", die juristische Nuancen auslöschen und die Illusion einer Lösung des Diskriminierungsproblems schaffen.

Die Grenze zwischen nützlicher Abstraktion und gefährlicher Vereinfachung verläuft durch die Frage: Ist sich der Autor bewusst, was er auslässt, und ist er bereit, die Grenzen seines Ansatzes anzuerkennen?

Der Stahlmann: Fünf starke Argumente für interdisziplinäre Expertenaussagen

Bevor wir das Problem der epistemischen Grenzüberschreitung analysieren, müssen wir ehrlich die stärksten Argumente dafür betrachten, dass Experten das Recht und sogar die Pflicht haben, sich außerhalb ihrer engen Spezialisierung zu äußern. Dies ist keine Strohmann-Argumentation, sondern ein Stahlmann – die überzeugendste Version der Gegenposition. Mehr dazu im Abschnitt Realitätsprüfung.

💎 Das Argument des Kompetenztransfers: Kritisches Denken als universelles Werkzeug

Experten in jedem Bereich entwickeln Fähigkeiten des kritischen Denkens, der Arbeit mit Beweisen und des Aufbaus logischer Ketten, die universell anwendbar sind. Ein Physiker, der komplexe Kausalzusammenhänge in der Quantenmechanik analysieren kann, ist theoretisch in der Lage, dieselbe methodologische Strenge auf wirtschaftliche oder soziale Fragen anzuwenden.

Ein frischer Blick von außen ermöglicht es manchmal, Muster zu erkennen, die Spezialisten, die in innerdisziplinäre Debatten vertieft sind, übersehen. Das bedeutet nicht, dass dieser Blick richtig sein wird – aber er kann nützlich sein.

🔬 Das Argument der interdisziplinären Notwendigkeit: Komplexe Probleme erfordern Integration

Viele moderne Probleme – vom Klimawandel bis zur Ethik künstlicher Intelligenz – sind grundsätzlich interdisziplinär. Zu verlangen, dass ein Klimatologe sich nicht zu den wirtschaftlichen Folgen seiner Modelle äußert, bedeutet, jeden substanziellen Dialog unmöglich zu machen.

| Szenario | Epistemische Bescheidenheit | Ergebnis |

|---|---|---|

| Klimatologe schweigt zur Wirtschaft | Eingehalten | Ökonomen treffen Entscheidungen ohne Berücksichtigung physikalischer Grenzen |

| Ökonom schweigt zur Klimaphysik | Eingehalten | Klimatologen sehen die wirtschaftlichen Realitäten der Modellumsetzung nicht |

| Beide äußern sich, aber ohne gegenseitigen Respekt | Verletzt | Konflikt statt Integration |

📊 Das Argument der Informationsasymmetrie: Experten sehen, was der Öffentlichkeit verborgen bleibt

Experten verfügen oft über Zugang zu Informationen, methodologischen Werkzeugen oder ein Verständnis grundlegender Prinzipien, die der breiten Öffentlichkeit nicht zugänglich sind. Selbst wenn sie sich außerhalb ihrer engen Spezialisierung äußern, können sie eine fundiertere Analyse liefern als Laien.

Das Schweigen von Experten im öffentlichen Raum schafft ein Vakuum, das mit offener Desinformation gefüllt wird. Dies ist besonders kritisch in Bereichen, in denen alternative Praktiken oder Finanzbetrugssysteme aktiv um die Aufmerksamkeit des Publikums konkurrieren.

🧠 Das Argument der sozialen Verantwortung: Experten sind verpflichtet, vor Gefahren zu warnen

Wenn ein Kernphysiker sieht, dass Politiker Entscheidungen über Atomwaffen auf der Grundlage eines fundamentalen Missverständnisses physikalischer Prozesse treffen, ist er dann nicht verpflichtet, sich zu äußern? Wenn ein Epidemiologe katastrophale Fehler in der öffentlichen Gesundheitspolitik beobachtet, ist epistemische Bescheidenheit dann wichtiger als potenziell gerettete Leben?

Dieses Argument appelliert an die moralische Pflicht des Experten, sein Wissen zum Wohle der Allgemeinheit einzusetzen – selbst wenn dies bedeutet, die Grenzen der engen Kompetenz zu überschreiten.

⚙️ Das Argument der Wissensevolution: Disziplinäre Grenzen sind künstlich und beweglich

Die Grenzen zwischen Disziplinen sind historisch bedingt und werden ständig neu bewertet. Die Biochemie entstand aus der „Invasion" von Chemikern in die Biologie. Die Neuroökonomie – aus der „Invasion" von Neurobiologen in die Wirtschaftswissenschaften (S005).

- Die strikte Einhaltung disziplinärer Grenzen konserviert veraltete Wissensstrukturen

- Sie behindert Innovationen und die Entstehung neuer Bereiche

- Epistemische Grenzüberschreitung ist der Mechanismus, durch den Wissenschaft sich weiterentwickelt

- Was heute als Verstoß gilt, kann morgen zur Norm werden

Alle fünf Argumente haben eine ernsthafte Grundlage. Aber ihre Überzeugungskraft schafft eine gefährliche Illusion: dass die Abwesenheit von Kompetenzgrenzen einfach der Preis des Fortschritts ist.

Empirische Anatomie epistemischer Grenzüberschreitung: wo Abstraktion Bedeutung zerstört

Die stärksten Argumente für Interdisziplinarität heben die empirischen Belege für systematische Wissensverzerrung nicht auf. Das Problem liegt nicht in der Grenzüberschreitung selbst, sondern in den Mechanismen, durch die sie erfolgt. Mehr dazu im Abschnitt Medienkompetenz.

📊 Der Fall der Vier-Fünftel-Regel: wie Informatiker ein juristisches Konzept neu erfanden

Informatiker, die an algorithmischer Fairness arbeiten, haben das juristische Konzept des "disparate impact" massenhaft mit der statistischen "Vier-Fünftel-Regel" gleichgesetzt — einem vereinfachten Test, der nur eines von vielen Instrumenten zur Vorabprüfung darstellt (S004). Diese Auslöschung juristischer Nuancen signalisiert ein kritisches Problem: Die für maschinelles Lernen bequeme Abstraktion zerstört die Bedeutung, die Juristen über Jahrzehnte entwickelt haben.

Wenn ein Spezialist ein Konzept von einer Disziplin in eine andere überträgt, verliert er oft nicht Details, sondern die Logik selbst, die das Konzept im ursprünglichen Kontext funktionsfähig macht.

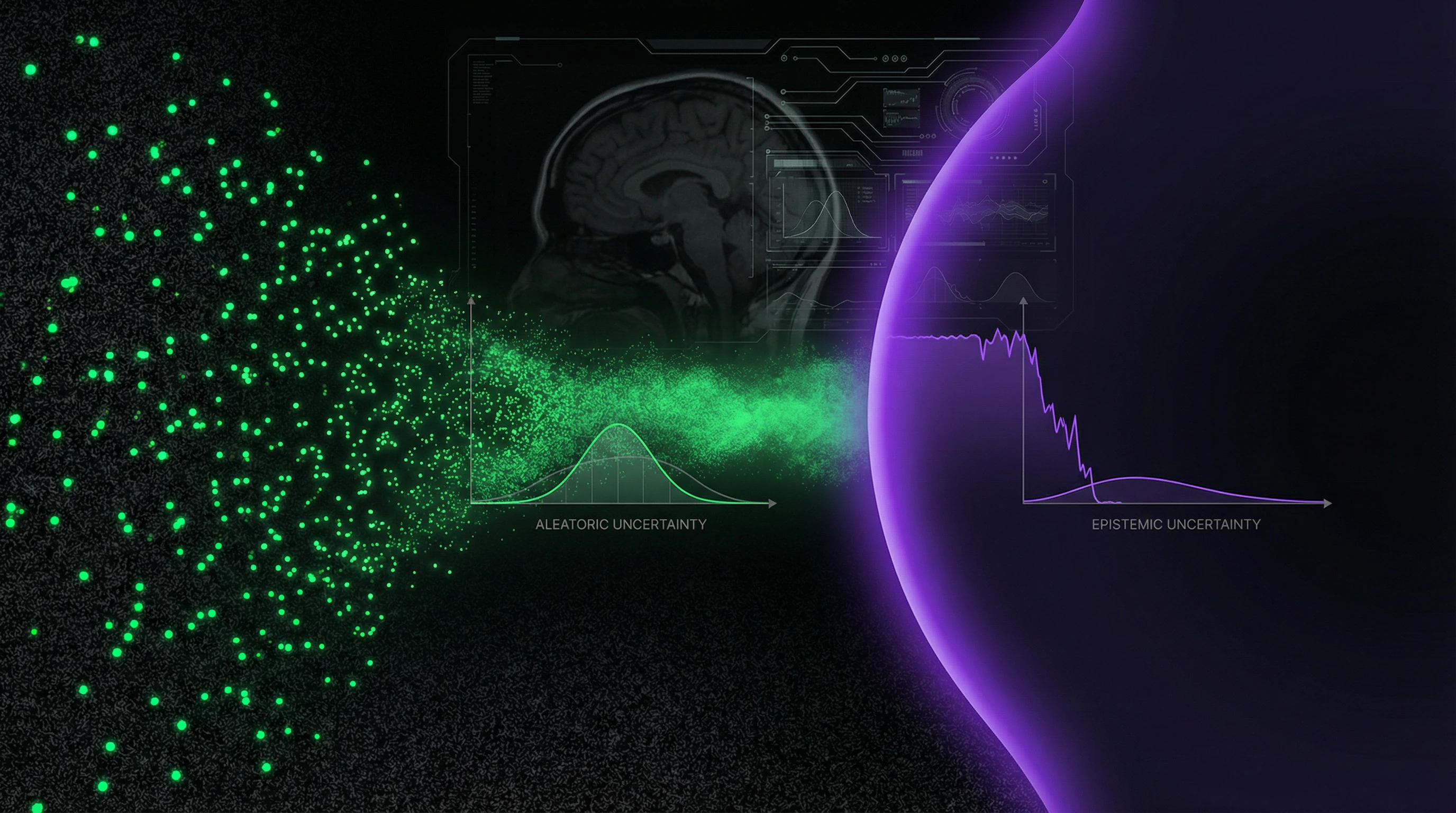

🧪 Strahlentherapie und epistemische Unsicherheit: wenn der Algorithmus nicht weiß, dass er nicht weiß

Die Präzision der Organkonturierung in der Strahlentherapieplanung ist kritisch für die Patientensicherheit (S002). Algorithmen zur automatischen Segmentierung, die von Machine-Learning-Spezialisten ohne tiefes Verständnis klinischer Unsicherheit entwickelt wurden, schaffen jedoch eine neue Risikoklasse.

Die Forschung zeigt, dass die Bewertung epistemischer Unsicherheit effektiv bei der Identifikation von Fällen ist, in denen Modellvorhersagen unzuverlässig sind (S002). Algorithmenentwickler verstehen oft nicht: Klinische Unsicherheit unterscheidet sich qualitativ von statistischer Unsicherheit.

- Statistische Unsicherheit ist Variabilität in Daten, die gemessen und reduziert werden kann.

- Klinische Unsicherheit ist unaufhebbare Ambiguität des Objekts selbst (Tumorgrenze, optimale Dosis).

- Der Algorithmus kann Erstere reduzieren, aber Letztere nicht auflösen.

🧾 Methodologische Kluft: warum statistische Signifikanz nicht klinischer Relevanz entspricht

Die aktuelle Forschungslandschaft enthält erhebliche Lücken: Fehlen von Ground Truth zur Bewertung von Unsicherheit und begrenzte empirische Evaluationen (S002). Das Kernproblem besteht darin, dass Machine-Learning-Spezialisten mit dem Konzept der "Ground Truth" (absoluten Wahrheit) operieren, die in der klinischen Praxis oft nicht existiert.

| Objekt | Position des ML-Spezialisten | Position des Klinikers |

|---|---|---|

| Tumorgrenze | Es existiert eine objektive Grenze, die gefunden werden muss | Die Grenze ist verschwommen; die Wahl hängt von klinischem Urteil ab |

| Optimale Strahlendosis | Maximierung der Vorhersagegenauigkeit | Balance zwischen Wirksamkeit und Risiko für den spezifischen Patienten |

| Algorithmenfehler | Zufällige Variation, die minimiert werden kann | Systematischer Fehler, der verstanden und kontrolliert werden muss |

🧬 Sachverständigengutachten vor Gericht: institutionalisierte epistemische Grenzüberschreitung

Der juristische Kontext liefert anschauliche Beispiele institutionalisierter epistemischer Grenzüberschreitung. Experten werden regelmäßig eingeladen, zu Fragen auszusagen, die über ihre enge Spezialisierung hinausgehen, und das Rechtssystem verfügt oft nicht über Instrumente zur Unterscheidung zwischen legitimer Interdisziplinarität und Grenzüberschreitung (S005).

Anwälte nutzen strategisch den Halo-Effekt: Sie präsentieren Experten mit beeindruckenden Credentials in einem Bereich für Aussagen in einem anderen. Der Richter sieht einen "Doktor der Wissenschaften" und nimmt Kompetenz an, ohne zwischen dem Prinzip der Einfachheit in verschiedenen Kontexten und tatsächlicher Wissenstiefe zu unterscheiden.

⚠️ Kognitive Modelle und epistemische Politiken: verborgene Prämissen von KI-Systemen

Das Verhalten der Überzeugungsbildung wird durch implizite, ungeprüfte epistemische Politiken gesteuert (S006). Dies gilt nicht nur für Menschen, sondern auch für KI-Systeme, die die epistemischen Prämissen ihrer Schöpfer erben.

Frontier-Modelle erzwingen Kohärenz von Identität und Position und bestrafen Argumente, die Quellen zugeschrieben werden, deren erwartete ideologische Position mit dem Inhalt kollidiert (S006). Dies ist epistemische Grenzüberschreitung zweiter Ordnung: Das System erzwingt ein vereinfachtes Modell davon, wie Identität und Überzeugungen korrelieren sollten, und ignoriert die Komplexität der realen Landschaft.

- Epistemische Politik erster Ordnung

- Regeln, nach denen sich ein Mensch bei der Überzeugungsbildung richtet (welchen Quellen vertrauen, welche Beweise fordern).

- Epistemische Politik zweiter Ordnung

- Regeln, die in das System eingebettet sind und bestimmen, welche Politiken erster Ordnung als legitim gelten. Ein KI-System kann ein Argument nicht blockieren, weil es falsch ist, sondern weil es das eingebettete Kohärenzmodell verletzt.

Mechanismen und Kausalität: Warum epistemische Übergriffe systematisch und nicht zufällig sind

Epistemischer Übergriff ist keine Serie individueller Urteilsfehler. Es ist ein systematisches Phänomen, das durch strukturelle Besonderheiten der modernen Wissensproduktion, akademischer Institutionen und des öffentlichen Diskurses erzeugt wird. Mehr dazu im Abschnitt Wissenschaftliche Methode.

🔁 Halo-Effekt und Vertrauenstransfer: Die kognitive Architektur epistemischer Übergriffe

Der grundlegende Mechanismus ist der Halo-Effekt: die Tendenz, eine positive Bewertung eines Attributs auf andere, nicht damit verbundene Attribute zu übertragen. Ein Nobelpreisträger für Physik äußert sich zur Wirtschaft, und das Publikum überträgt automatisch das in der Physik erworbene Vertrauen auf wirtschaftliche Urteile.

Diese Übertragung erfolgt auf vorreflexiver Ebene und ist äußerst resistent gegen Korrektur, selbst wenn Menschen sich ihrer Irrationalität bewusst sind (S001).

🧩 Institutionelle Anreize: Warum das akademische System Übergriffe fördert

Die moderne Akademie schafft starke Anreize für epistemische Übergriffe. Interdisziplinarität wird offiziell von Förderagenturen gefördert. Öffentliche Sichtbarkeit wird oft höher geschätzt als enge Spezialisierung.

Experten, die sich zu einem breiten Spektrum von Fragen äußern, erhalten mehr Konferenzeinladungen, mehr Medienzitate, mehr Beratungsmöglichkeiten – unabhängig von der tatsächlichen Kompetenz in diesen Bereichen.

- Förderagenturen verlangen „Translationspotenzial" und „gesellschaftliche Wirkung"

- Medieneinfluss erhöht das Universitätsranking und zieht Studierende an

- Beratung und Expertise bringen Einkommen, das zwischen Fakultät und Verwaltung aufgeteilt wird

- Enge Spezialisten werden in einem kompetitiven Umfeld als weniger „innovativ" wahrgenommen

🧷 Abstraktion als Berufsdeformation: Warum Programmierer besonders anfällig sind

Informatiker sind darauf trainiert, Abstraktionen zu schaffen, die vereinfachen und verallgemeinern (S004). Diese berufliche Tugend wird zur Quelle systematischer epistemischer Übergriffe.

Ein Programmierer, der erfolgreich eine Abstraktion für ein komplexes technisches System geschaffen hat, überträgt den Ansatz auf soziale, rechtliche oder ethische Probleme, ohne zu erkennen: Vorzeitige Abstraktion ist hier nicht nur ineffektiv, sondern aktiv schädlich. Sie maskiert fundamentales Unverständnis des Kontexts unter der Illusion einer Lösung.

Abstraktion funktioniert in der Technik, weil physikalische Gesetze universell sind. In sozialen Systemen ist Universalität selten, und Kontext ist die Regel.

⚙️ Thermodynamik des Lernens und epistemische Kosten: Physikalische Grenzen des Wissens

Lernen ist ein prinzipiell irreversibler Prozess, wenn es in endlicher Zeit durchgeführt wird, und die Realisierung epistemischer Strukturen führt notwendigerweise zur Entropieproduktion (S008). Diese Grenze hängt nur von der Wasserstein-Distanz zwischen der Anfangs- und Endverteilung des Ensembles ab und ist unabhängig vom konkreten Lernalgorithmus.

Es gibt fundamentale physikalische Grenzen der Geschwindigkeit des Wissenserwerbs – und diese Grenzen sind unabhängig von Intelligenz oder Methodologie. Epistemische Übergriffe treten oft auf, wenn Experten diese Grenzen ignorieren und glauben, dass ihre allgemeinen kognitiven Fähigkeiten es ihnen ermöglichen, ein neues Gebiet schnell zu beherrschen.

| Wissensgebiet | Abstraktionstyp | Risiko vorzeitiger Abstraktion |

|---|---|---|

| Physik, Mathematik | Universelle Gesetze | Niedrig – Gesetze sind tatsächlich universell |

| Biologie, Medizin | Mechanismen mit Ausnahmen | Mittel – Kontext ist wichtig, aber es gibt Gesetzmäßigkeiten |

| Soziologie, Recht, Wirtschaft | Kontextuelle Muster | Hoch – Abstraktion zerstört oft die Bedeutung |

Konflikte, Widersprüche und Grenzen der Gewissheit: Wo Quellen divergieren und warum das wichtig ist

Eine ehrliche Analyse epistemischer Übergriffe erfordert die Anerkennung von Bereichen, in denen Quellen einander widersprechen oder in denen die Datenlage keine eindeutigen Schlussfolgerungen zulässt. Diese Zonen der Ungewissheit schwächen das Argument nicht – im Gegenteil, sie demonstrieren eine epistemische Tugend, die jenen oft fehlt, die epistemische Übergriffe begehen. Mehr dazu im Abschnitt Denkfehler.

🔎 Normative vs. deskriptive Frage: Sollten Experten schweigen oder lernen, anders zu sprechen?

Eine zentrale Kontroverse in der Literatur betrifft die normative Frage: Ist epistemischer Übergriff immer epistemisch fehlerhaft, oder liegt das Problem darin, wie genau Experten sich außerhalb ihres Fachgebiets äußern?

(S003) argumentiert, dass es Fälle gibt, in denen Übergriffe prinzipiell unzulässig sind. Eine alternative Position geht davon aus, dass sich das Problem durch epistemische Bescheidenheit, explizite Markierung von Kompetenzgrenzen und Dialogbereitschaft mit Experten des Zielgebiets lösen lässt.

- Position 1: Übergriff ist strukturell fehlerhaft, unabhängig von Einschränkungen

- Position 2: Übergriff ist zulässig, wenn er von expliziter Grenzmarkierung und Kritikbereitschaft begleitet wird

- Position 3: Das Problem liegt nicht im Übergriff selbst, sondern in sozialen Effekten (Halo-Effekt, Aufmerksamkeitsasymmetrie)

Die empirische Datenlage erlaubt bislang keine eindeutige Klärung dieser Kontroverse. Dies ist kein Mangel der Forschung – es ist ein Hinweis darauf, dass die Frage teilweise normativ und nicht nur deskriptiv ist.

📊 Messung epistemischer Übergriffe: Methodologische Herausforderungen

Es besteht ein fundamentales methodologisches Problem: Wie lässt sich objektiv bestimmen, wann ein epistemischer Übergriff stattgefunden hat? Disziplingrenzen sind unscharf und historisch wandelbar.

Interdisziplinäre Bereiche erfordern per definitionem die Integration von Wissen aus verschiedenen Quellen. Einige Forscher schlagen vor, epistemische Übergriffe durch das Fehlen von Publikationen in peer-reviewed Zeitschriften des Zielgebiets zu operationalisieren, doch dieses Kriterium schließt legitime Fälle systematischer Reviews und Meta-Analysen von Forschern aus, die keine formale Sozialisation in der Disziplin durchlaufen haben, aber über relevante Expertise verfügen.

| Kriterium | Problem | Konsequenz |

|---|---|---|

| Publikationen in der Zieldisziplin | Schließt Neueinsteiger und transdisziplinäre Forscher aus | Konserviert Disziplingrenzen |

| Formale Ausbildung | Ignoriert praktische Erfahrung und Selbststudium | Privilegiert institutionellen Status |

| Zitation durch Spezialisten des Zielgebiets | Abhängig von sozialen Netzwerken und Sichtbarkeit | Spiegelt Einfluss wider, nicht Kompetenz |

🧾 Die Rolle epistemischer Tugenden: Reicht Bescheidenheit aus?

Eine der zentralen Fragen lautet: Kann epistemische Bescheidenheit das Fehlen spezialisierter Kenntnisse kompensieren? Wenn ein Experte die Grenzen seiner Kompetenz explizit markiert, Ungewissheit anerkennt und Spezialisten des Zielgebiets zur Kritik einlädt, bleibt dies dann ein epistemischer Übergriff?

Die Quellen divergieren in ihrer Antwort. (S003) argumentiert, dass epistemische Tugenden eine interdisziplinäre Äußerung legitim machen können. Andere weisen darauf hin, dass epistemische Bescheidenheit in der Praxis selten in ausreichendem Maße gezeigt wird und die bloße Tatsache einer öffentlichen Äußerung einen Halo-Effekt erzeugt, unabhängig von Einschränkungen.

- Halo-Effekt im Kontext epistemischer Übergriffe

- Das Publikum nimmt die Äußerung eines Experten in einem Gebiet als autoritativ in einem anderen wahr, selbst wenn der Experte die Grenzen explizit benennt. Mechanismus: Vertrauen in die Quelle überträgt sich auf den Inhalt, unter Umgehung kritischer Bewertung.

- Aufmerksamkeitsasymmetrie

- Die Äußerung eines bekannten Wissenschaftlers erhält mehr Aufmerksamkeit als die Kritik eines Spezialisten des Zielgebiets. Resultat: Der Übergriff prägt die öffentliche Meinung schneller, als er widerlegt werden kann.

- Soziale Legitimation durch Bescheidenheit

- Die explizite Anerkennung von Kompetenzgrenzen kann als Ehrlichkeit wahrgenommen werden, was paradoxerweise das Vertrauen verstärkt. Epistemische Tugend wird zum Überzeugungsinstrument.

Das Problem liegt nicht darin, dass Experten die Unwahrheit sagen. Das Problem liegt darin, dass nachträgliche Vorhersage und soziale Effekte unabhängig von Intentionen und Einschränkungen wirken.

Kognitive Anatomie der Überzeugungskraft: Welche mentalen Fallen epistemische Übergriffe ausnutzen

Epistemische Übergriffe sind nicht deshalb effektiv, weil die Argumente stark sind, sondern weil sie systematische kognitive Schwachstellen ausnutzen. Das Verständnis dieser Mechanismen ist entscheidend für die Entwicklung von Resilienz. Mehr dazu im Abschnitt Kryptozoologie.

🕳️ Der Halo-Effekt als grundlegende Schwachstelle

Der Halo-Effekt ist ein fundamentales Merkmal der Verarbeitung sozialer Informationen. Evolutionär war es sinnvoll, Erfolg in einem Bereich als Indikator für allgemeine Kompetenz zu nutzen: In kleinen Jäger-und-Sammler-Gruppen besaß ein erfolgreicher Jäger auch andere nützliche Fähigkeiten.

In der modernen Welt enger Spezialisierung versagt dieser heuristische Mechanismus systematisch. Wir vertrauen Physik-Nobelpreisträgern in wirtschaftlichen Fragen, weil das Gehirn nicht darauf ausgelegt ist, hochspezialisierte Expertise zu unterscheiden.

⚠️ Kohärenz von Identität und Position

Forschung zeigt, dass Systeme Kohärenz zwischen Identität und Position erzwingen und Argumente bestrafen, die Quellen zugeschrieben werden, deren erwartete ideologische Position mit dem Inhalt kollidiert (S006). Diese Tendenz spiegelt eine tiefe menschliche kognitive Prädisposition wider: Wir erwarten, dass die Überzeugungen von Menschen kohärente Cluster bilden.

Ein Physiker „sollte" Rationalist sein. Ein Geisteswissenschaftler „sollte" Technologie skeptisch gegenüberstehen. Diese Erwartungen erzeugen kognitive Dissonanz, wenn sich ein Experte „uncharakteristisch" äußert, und wir lösen sie auf, indem wir entweder die Aussage ablehnen oder unsere Einschätzung des Experten insgesamt überdenken.

🧠 Die Illusion des Verstehens durch Abstraktion

Wenn ein Experte aus einem anderen Bereich eine einfache Abstraktion für ein komplexes Problem anbietet, wird dies als Einsicht wahrgenommen, nicht als Vereinfachung. Ein Physiker, der ein wirtschaftliches Problem auf ein System von Differentialgleichungen reduziert, scheint zum Kern vorgedrungen zu sein, der Ökonomen, die in Details verstrickt sind, unzugänglich bleibt.

Dies ist eine kognitive Illusion: Eine Abstraktion, die kontextuelle Variablen ignoriert, enthüllt nicht den Kern – sie verbirgt ihn. Aber das Gehirn interpretiert mathematische Eleganz als Zeichen von Wahrheit.

Die Verbindung zwischen nachträglicher Vorhersage und dieser Falle ist direkt: Nachdem die Abstraktion vorgeschlagen wurde, suchen wir nach Fakten, die sie bestätigen, und ignorieren jene, die sie widerlegen.

📊 Drei Mechanismen der Überzeugungsausbeutung

| Mechanismus | Wie er funktioniert | Warum er gefährlich ist |

|---|---|---|

| Autorität + Neuheit | Ein Experte aus einem prestigeträchtigen Bereich sagt etwas Unerwartetes | Neuheit erscheint als Einsicht, Autorität blockiert Kritik |

| Semantische Distanz | Terminologie aus einer anderen Disziplin wird verwendet | Der Zuhörer kann nicht überprüfen, ob die Begriffe korrekt angewendet werden |

| Sozialer Beweis | Wenn eine Autorität dies sagt, müssen andere Experten zustimmen | Tatsächlich schweigen Kollegen, weil es nicht ihr Fachgebiet ist |

🔍 Überprüfungsprotokoll: Wie man Einsicht von Vereinfachung unterscheidet

- Fragen: Kann der Experte erklären, warum seine Abstraktion gerade in diesem Bereich funktioniert und nicht in einem benachbarten?

- Prüfen: Erwähnt er in seinem Argument kontextuelle Variablen, die er ignoriert?

- Vergleichen: Stimmt seine Schlussfolgerung mit dem Konsens der Fachleute in diesem Bereich überein?

- Bewerten: Bietet er einen Mechanismus an oder nur eine Korrelation, die als Kausalität getarnt ist?

Epistemische Übergriffe sind nicht deshalb überzeugend, weil sie richtig sind, sondern weil sie die Architektur unseres Vertrauens ausnutzen. Das Bewusstsein für diese Architektur ist der erste Schritt zu ihrer Stärkung.