Was sind systematische Reviews und Meta-Analysen: Definitionen, die einen kritischen Unterschied verbergen

Ein systematischer Review ist ein strukturierter Prozess der Suche, Auswahl und kritischen Bewertung aller verfügbaren Studien zu einer spezifischen Fragestellung, durchgeführt nach einem vorab definierten Protokoll (S003). Eine Meta-Analyse ist eine statistische Methode zur Zusammenführung quantitativer Ergebnisse mehrerer Studien, um eine Gesamtschätzung des Effekts zu erhalten (S008).

Der entscheidende Unterschied: Ein systematischer Review kann ohne Meta-Analyse existieren, aber eine Meta-Analyse ohne systematischen Review verliert ihre methodologische Stringenz. Mehr dazu im Abschnitt Chipimplantate und Weltregierung.

- Systematischer Review

- Protokollbasierte Suche und Bewertung aller verfügbaren Studien. Garantiert Vollständigkeit, aber nicht die Qualität der Ausgangsdaten.

- Meta-Analyse

- Statistische Zusammenführung von Ergebnissen. Erhöht die Präzision der Effektschätzung, korrigiert aber keine systematischen Fehler in den Ausgangsstudien.

🔎 Warum die Verwechslung der Begriffe falsche Sicherheit erzeugt

Die Studie zur Antibiotikaresistenz von H. pylori in Russland wurde in PROSPERO registriert und folgte den PRISMA 2020-Empfehlungen, was formal den Kriterien eines systematischen Reviews entspricht (S001). Die vorherige Protokollregistrierung garantiert jedoch nicht die Qualität der eingeschlossenen Studien – sie dokumentiert lediglich die Absichten der Autoren.

Wenn wir die Formulierung „systematischer Review und Meta-Analyse" sehen, ordnet das Gehirn den Ergebnissen automatisch die höchste Evidenzstufe zu und ignoriert dabei die Frage nach der Heterogenität der Ausgangsdaten.

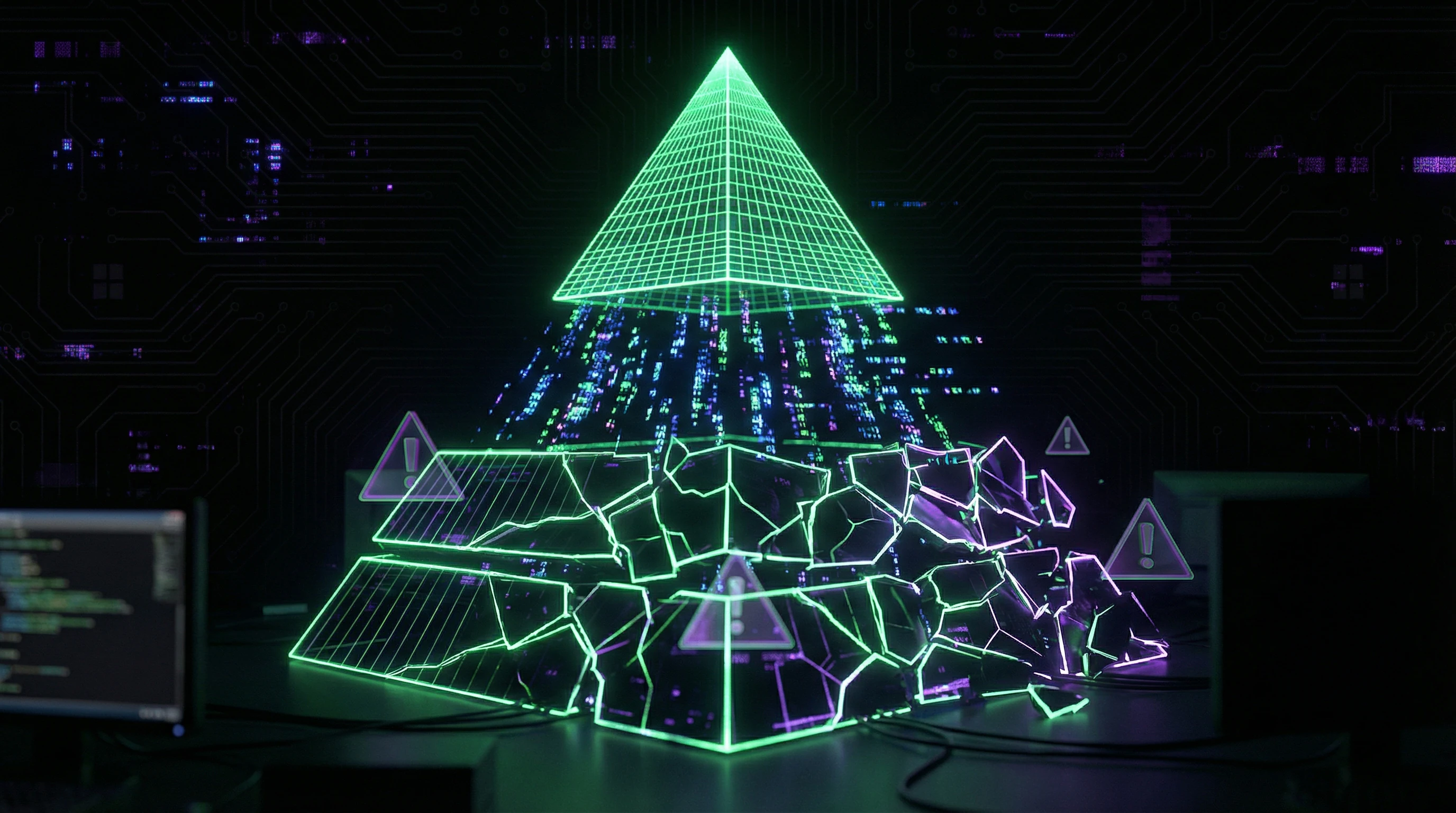

🧱 Evidenzhierarchie: Wo steht die Meta-Analyse und was steht darüber

Die traditionelle Pyramide der evidenzbasierten Medizin platziert systematische Reviews und Meta-Analysen an der Spitze, über randomisierten kontrollierten Studien (RCTs) und Kohortenstudien. Diese Hierarchie funktioniert jedoch nur unter Einhaltung kritischer Bedingungen: Homogenität der Populationen, Standardisierung der Messmethoden, Abwesenheit systematischer Fehler in den Ausgangsstudien.

| Bedingung | Erfüllt | Ergebnis |

|---|---|---|

| Homogene Populationen | Ja | Meta-Analyse verstärkt die Evidenz |

| Homogene Populationen | Nein | Meta-Analyse maskiert Heterogenität |

| Standardisierte Methoden | Ja | Ergebnisse sind vergleichbar |

| Standardisierte Methoden | Nein | Zusammenführung von Unvergleichbarem |

Eine Meta-Analyse minderwertiger Studien wird nicht zu hochwertiger Evidenz – sie wird zu einer präzisen Schätzung des systematischen Fehlers.

⚙️ PRISMA 2020-Protokoll: Was es garantiert und was nicht

Die PRISMA-Empfehlungen definieren einen Berichtsstandard, aber keinen Qualitätsstandard für Ausgangsdaten (S001). Eine Studie kann PRISMA perfekt folgen und dennoch unvergleichbare Populationen zusammenführen, veraltete Diagnosemethoden verwenden oder kritische Confounder ignorieren.

- Vollständigkeit der Suche (MEDLINE, EMBASE, regionale Indizes) – entspricht den Anforderungen

- Transparenz der Einschlusskriterien – dokumentiert

- Qualität der Ausgangsstudien – nicht garantiert

- Vergleichbarkeit der Populationen – wird von PRISMA nicht geprüft

- Abwesenheit von Confoundern – bleibt im Ermessen der Autoren

Vollständigkeit der Suche ist nicht gleich Vollständigkeit der Evidenz. Diese Unterscheidung ist kritisch für das Verständnis der Meta-Ebene der Evidenzbasis.

Fünf Argumente für die Meta-Analyse: Warum die Methodik unerschütterlich erscheint

Bevor wir die Einschränkungen untersuchen, müssen wir die Stärke der Methode verstehen. Die Meta-Analyse löst reale Probleme der medizinischen Wissenschaft, und diese Vorteile zu ignorieren bedeutet, den Kontext zu übersehen, in dem Forscher arbeiten. Mehr dazu im Abschnitt Datenverschleierung durch Pharmaunternehmen.

🔬 Erhöhung der statistischen Power: Wenn kleine Stichproben zu einer großen vereint werden

Eine einzelne Studie mit einer Stichprobe von 50 Patienten kann möglicherweise keinen statistisch signifikanten Behandlungseffekt nachweisen. Eine Meta-Analyse von 20 solcher Studien (n=1000) erhöht die Power und ermöglicht es, einen realen, aber kleinen Effekt zu identifizieren.

In einer Studie zur kognitiven Aufgabenanalyse (CTA) in der chirurgischen Ausbildung zeigte eine Meta-Analyse von 12 Studien einen großen Trainingseffekt zugunsten von CTA im Vergleich zu traditionellen Lehrmethoden (S007). Keine dieser 12 Studien hatte für sich genommen ausreichende Power für eine solche Schlussfolgerung.

📊 Auflösung von Widersprüchen: Wenn Studien unterschiedliche Ergebnisse liefern

Wenn eine RCT die Wirksamkeit einer Intervention zeigt und eine andere keine Wirkung feststellt, befinden sich Kliniker in einer Situation der Unsicherheit. Die Meta-Analyse ermöglicht es, die Heterogenität der Ergebnisse quantitativ zu bewerten und zu bestimmen, ob die Unterschiede zufällig oder systematisch sind.

Dies ist besonders wichtig in Bereichen mit hoher Populationsvariabilität, wie der Antibiotikaresistenz, wo regionale Unterschiede kritisch sein können (S001).

🧪 Identifizierung von Subgruppeneffekten: Wenn die Behandlung nicht für alle funktioniert

Die Meta-Analyse ermöglicht Subgruppenanalysen, die im Rahmen einer einzelnen Studie aufgrund unzureichender Power nicht möglich sind. Beispielsweise kann bewertet werden, ob die Wirkung eines Antibiotikums je nach Alter der Patienten, Wohnregion oder Methode zur Diagnose der Resistenz variiert.

In einer russischen Meta-Analyse zu H. pylori konnten die Autoren zeitliche Veränderungen der Resistenz über einen Zeitraum von 15 Jahren bewerten, was im Rahmen einer einzelnen Studie unmöglich gewesen wäre (S001).

🧾 Standardisierung der Evidenz: Wenn eine einheitliche Bewertung für klinische Leitlinien erforderlich ist

Klinische Leitlinien erfordern eine systematisierte Bewertung aller verfügbaren Evidenz. Die Meta-Analyse liefert eine quantitative Gesamtbewertung, die zur Formulierung von Empfehlungen verwendet werden kann.

- Die Schlussfolgerung der russischen Studie, dass Russland den vom Maastricht VI-Konsensus festgelegten Schwellenwert von 15% für Clarithromycin-Resistenz überschreitet, beeinflusst direkt die Überarbeitung empirischer Behandlungsstrategien (S001).

- Ohne Meta-Analyse würde eine solche Schlussfolgerung auf der subjektiven Bewertung einzelner Studien basieren.

⚙️ Living Systematic Reviews: Wenn Evidenz in Echtzeit aktualisiert wird

Das Konzept der Living Systematic Reviews und prospektiver Meta-Analysen löst das Problem der Veralterung von Evidenz (S002). Anstelle eines statischen Dokuments, das ein Jahr nach Veröffentlichung veraltet ist, wird ein Living Review kontinuierlich aktualisiert, sobald neue Studien erscheinen.

Die ALL-IN-Meta-Analyse-Methodik bietet eine Infrastruktur für solche Aktualisierungen, was besonders wichtig ist in sich schnell entwickelnden Bereichen wie der Bewertung der Empathie von KI-Chatbots in der Medizin (S004).

Kritische Analyse der Evidenzbasis: Was echte Meta-Analysen zeigen und was sie verschweigen

Wir wenden uns nun konkreten Studien zu, um die Kluft zwischen methodologischen Ansprüchen und tatsächlichen Limitationen aufzuzeigen. Mehr dazu im Abschnitt Bewegung der Souveränen Bürger.

🧪 Der Fall H. pylori in Russland: Wenn Meta-Analysen kritische Probleme aufdecken

Die systematische Übersichtsarbeit von Andreev et al. bewertete die Antibiotikaresistenz von Helicobacter pylori auf Basis von 15 Jahren Forschung (S001). Die Recherche erfolgte in MEDLINE/PubMed, EMBASE, Russian Science Citation Index und Google Scholar nach PRISMA 2020, vorab registriert in PROSPERO.

Hauptbefund: Russland überschreitet den vom Maastricht VI Konsensus festgelegten Resistenzschwellenwert von 15% für Clarithromycin (S001). Dies erfordert eine Überarbeitung empirischer Behandlungsstrategien und beeinflusst direkt die Wahl der Erstlinientherapie.

Jedoch sind methodologische Details, die im Abstract nicht offengelegt werden, kritisch wichtig: Welche Methoden zur Resistenzbestimmung wurden verwendet? Kulturelle, molekulare oder phänotypische Analysen? Unterschiede in den Methoden führen zu systematischen Unterschieden in den Schätzungen.

📊 Kognitive Aufgabenanalyse in der Chirurgie: Wenn Meta-Analysen große Effekte zeigen

Die systematische Übersichtsarbeit von Alexander Coombs zur kognitiven Aufgabenanalyse (CTA) in der chirurgischen Ausbildung umfasste 12 Studien (S007). Die Meta-Analyse zeigte signifikante Verbesserungen des prozeduralen Wissens und der technischen Fertigkeiten bei Auszubildenden, die CTA nutzten, im Vergleich zu traditionellen Methoden.

Die Effektstärke war groß, was CTA als hocheffektive Ergänzung zur traditionellen Ausbildung identifizierte (S007).

- Kritische Frage: Was wurde als „technische Fertigkeiten" gemessen?

- Objektive strukturierte Bewertungen (OSATS), Ausführungszeit, Fehlerrate oder subjektive Einschätzungen der Ausbilder? Heterogenität der Endpunkte ist das Hauptproblem von Meta-Analysen in der Bildungsforschung, wo die Standardisierung von Messungen deutlich geringer ist als in klinischen Studien.

🧬 KI-Chatbots gegen Ärzte: Meta-Analyse zu Empathie in der medizinischen Versorgung

Die systematische Übersichtsarbeit zum Vergleich der Empathie von KI-Chatbots und medizinischem Fachpersonal ist aufgrund der Komplexität der Empathiemessung von besonderem Interesse (S004). Empathie ist ein multidimensionales Konstrukt: kognitive, emotionale und verhaltensbezogene Komponenten.

Wie lassen sich Studien zusammenführen, die unterschiedliche Empathieskalen, verschiedene Interaktionstypen (Text, Sprache, Video) und unterschiedliche Patientenpopulationen verwenden?

Eine Meta-Analyse kann eine präzise quantitative Schätzung liefern, aber diese Präzision ist illusorisch, wenn die zugrundeliegenden Studien unterschiedliche Konstrukte unter demselben Namen messen. Statistische Homogenität (niedriges I²) garantiert keine konzeptuelle Homogenität.

🔎 Netzwerk-Meta-Analyse: Wenn Interventionen verglichen werden, die nie direkt verglichen wurden

Netzwerk-Meta-Analysen ermöglichen den Vergleich multipler Interventionen, selbst wenn diese nie direkt verglichen wurden (S005). Wenn es RCTs gibt, die A vs B und B vs C vergleichen, schätzt die Netzwerk-Meta-Analyse die relative Wirksamkeit von A vs C über den gemeinsamen Komparator B.

Dies basiert auf der kritischen Annahme der Transitivität: Populationen, Studiendesigns und Endpunktdefinitionen sind ausreichend ähnlich, damit der indirekte Vergleich valide ist.

| Szenario | Problem | Konsequenz |

|---|---|---|

| A vs B bei leichter Erkrankung; B vs C bei schwerer | Verletzung der Transitivität | Indirekter Vergleich A vs C ist systematisch verzerrt |

| Unterschiedliche Populationen (Alter, Geschlecht, Komorbiditäten) | Heterogenität der Effektmodifikatoren | Gemittelter Effekt ist für keine Subgruppe repräsentativ |

| Unterschiedliche Beobachtungszeiträume | Zeitliche Unvergleichbarkeit | Effekt kann Artefakt unterschiedlicher Follow-up-Perioden sein |

⚠️ Mediationsanalyse in systematischen Übersichtsarbeiten: Wenn Kausalität zur Spekulation wird

Systematische Übersichtsarbeiten von Mediationsanalysen stehen vor einzigartigen Herausforderungen (S008). Mediationsanalysen erklären, über welche Mechanismen eine Intervention auf einen Endpunkt wirkt: Reduziert körperliche Aktivität Depression direkt oder durch Verbesserung der Schlafqualität?

Die Zusammenführung von Mediationsanalysen erfordert, dass alle Studien dieselben Mediatoren mit denselben Methoden messen und dieselben statistischen Modelle verwenden.

In der Praxis wird dies selten erfüllt. Unterschiede in der Operationalisierung von Mediatoren, zeitlichen Messintervallen und statistischen Ansätzen machen Meta-Analysen von Mediationseffekten extrem anfällig für systematische Fehler. Das Ergebnis kann statistisch signifikant sein, aber die kausale Interpretation bleibt spekulativ.

Dieses Problem ist besonders akut bei Meta-Level-Analysen, wo der Versuch, Wirkmechanismen von Interventionen zu verallgemeinern, häufig zu Aggregationsartefakten führt.

Mechanismen und Confounder: Warum Korrelation in der Meta-Analyse nicht gleich Kausalität ist

Eine Meta-Analyse vereint die Ergebnisse von Studien, kann aber die fundamentalen Limitationen des Designs dieser Studien nicht korrigieren. Wenn alle eingeschlossenen Studien Beobachtungsstudien sind, bleibt die Meta-Analyse eine Beobachtungsstudie – mit allen inhärenten Einschränkungen bei der Feststellung von Kausalität. Mehr dazu im Abschnitt Medienkompetenz.

🧬 Das Problem nicht gemessener Confounder: Was nicht im Modell erfasst wurde

In der Meta-Analyse zur Antibiotikaresistenz von H. pylori können kritische Confounder sein: vorheriger Antibiotikaeinsatz in der Population, Verfügbarkeit rezeptfreier Antibiotika, regionale Unterschiede in H. pylori-Stämmen, Kultivierungsmethoden und Resistenzbestimmung (S001). Wenn die eingeschlossenen Studien diese Faktoren nicht kontrollierten oder unterschiedlich kontrollierten, vermischt die zusammengefasste Resistenzschätzung echte Resistenz mit systematischen Unterschieden in der Methodik.

Ein nicht gemessener Confounder ist eine Variable, die das Ergebnis beeinflusst, aber in der Studie nicht erfasst wurde. Sie kann statistisch nicht kontrolliert werden und bleibt dauerhaft eine Quelle systematischer Verzerrung.

🔁 Zeitliche Dynamik: Wenn die Zusammenfassung von Daten über 15 Jahre Trends verschleiert

Die russische Meta-Analyse zu H. pylori bewertete zeitliche Veränderungen der Resistenz über 15 Jahre (S001). Aber wenn die Resistenz nichtlinear anstieg – etwa ein starker Sprung in den letzten 5 Jahren – kann die zusammengefasste Schätzung über den gesamten Zeitraum die aktuelle Situation unterschätzen.

Eine Meta-Regression nach Publikationsjahr kann dieses Problem teilweise lösen, aber nur wenn die Anzahl der Studien ausreicht, um einen zeitlichen Trend zu erkennen. Ohne diese Analyse erhält man eine gemittelte Zahl, die weder die Vergangenheit noch die Gegenwart realistisch abbildet.

🧷 Publikationsbias: Wenn negative Ergebnisse nicht veröffentlicht werden

Studien, die keine hohe Resistenz fanden oder keine Wirksamkeit einer Intervention zeigten, werden seltener publiziert als Studien mit „positiven" Ergebnissen (S008). Dies erzeugt einen Publikationsbias, der die zusammengefassten Effektschätzungen in der Meta-Analyse überschätzt.

- Methoden zur Bewertung von Publikationsbias (Funnel Plot, Egger-Test) haben bei geringer Studienanzahl niedrige Power.

- Sie können falsch-negative Ergebnisse liefern – eine Verzerrung nicht erkennen, die tatsächlich vorhanden ist.

- Selbst wenn eine Verzerrung erkannt wird, lässt sich ihr Ausmaß nicht präzise schätzen.

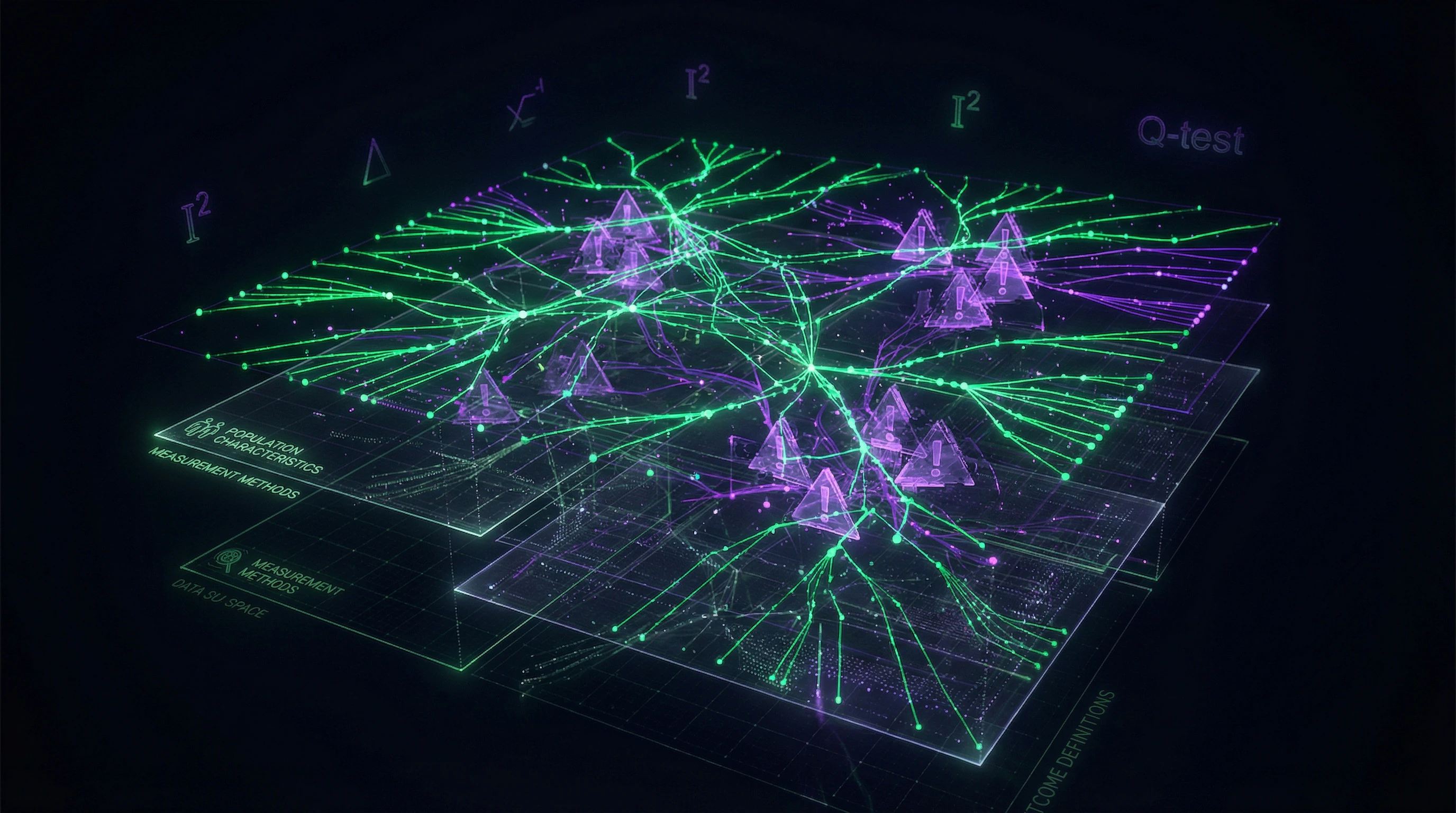

⚙️ Heterogenität der Populationen: Wenn „Patienten mit H. pylori" unterschiedliche Populationen sind

Patienten mit H. pylori in Moskau, St. Petersburg und Wladiwostok können sich in genetischen Faktoren, Ernährungsgewohnheiten, Zugang zur medizinischen Versorgung und vorherigem Antibiotikaeinsatz unterscheiden. Die Zusammenfassung von Daten aus diesen Regionen in einer Meta-Analyse setzt voraus, dass diese Unterschiede die Resistenz nicht beeinflussen – eine möglicherweise falsche Annahme.

Statistische Tests auf Heterogenität (I², Q-Test) bewerten die Variabilität der Ergebnisse, erklären aber nicht deren Quellen. Ein hoher I² sagt: „Hier stimmt etwas nicht", sagt aber nicht, was genau.

Konflikte und Unklarheiten: Wo Quellen voneinander abweichen und warum das wichtig ist

Selbst hochwertige systematische Übersichtsarbeiten können zu unterschiedlichen Schlussfolgerungen zur selben Fragestellung gelangen. Das Verständnis der Ursachen dieser Abweichungen ist entscheidend für die Interpretation der Ergebnisse. Mehr dazu im Abschnitt Kognitive Verzerrungen.

🧩 Unterschiede in den Einschlusskriterien: Wie die Definition der Population das Ergebnis verändert

Zwei Meta-Analysen zum selben Thema können unterschiedliche Einschlusskriterien für Studien verwenden. Eine kann nur RCTs einschließen, eine andere RCTs und Kohortenstudien. Eine kann sich auf erwachsene Patienten beschränken, eine andere alle Altersgruppen einbeziehen.

Diese Unterschiede sind keine Fehler – sie spiegeln unterschiedliche Forschungsfragen wider. Doch ein Leser, der zwei Meta-Analysen mit widersprüchlichen Schlussfolgerungen sieht, versteht möglicherweise nicht, dass sie unterschiedliche Fragen beantworten. Dies ist besonders gefährlich im Kontext von Meta-Ebenen-Interpretationen, wo Widersprüche zwischen Quellen oft als Zeichen einer Verschwörung oder verborgenen Wissens wahrgenommen werden.

🔬 Unterschiede in statistischen Methoden: Fixed-Effect vs. Random-Effects

Eine Meta-Analyse kann ein Fixed-Effect-Modell verwenden (geht davon aus, dass alle Studien einen wahren Effekt schätzen) oder ein Random-Effects-Modell (geht davon aus, dass der wahre Effekt zwischen Studien variiert).

Das Fixed-Effect-Modell liefert engere Konfidenzintervalle und zeigt häufiger statistisch signifikante Ergebnisse, ist aber nur bei Abwesenheit von Heterogenität valide. Das Random-Effects-Modell ist konservativer, kann aber bei geringer Studienanzahl den Effekt unterschätzen.

Die Wahl zwischen ihnen ist nicht neutral: Derselbe Datensatz kann je nach gewählter Methode zu gegensätzlichen Schlussfolgerungen führen (S002).

📊 Unterschiede in der Definition von Endpunkten: Wenn „Wirksamkeit" unterschiedlich gemessen wird

In der Meta-Analyse zur chirurgischen Ausbildung wurde die „Wirksamkeit" von CTA durch prozedurales Wissen und technische Fertigkeiten gemessen (S007). Aber was, wenn einige Studien Wissen durch schriftliche Tests maßen, andere durch Simulationsbewertungen?

Was, wenn technische Fertigkeiten in einigen Studien anhand der Durchführungszeit und in anderen anhand der Fehlerhäufigkeit bewertet wurden? Die Zusammenführung dieser heterogenen Endpunkte in einer Meta-Analyse erzeugt die Illusion eines einheitlichen Konstrukts „Wirksamkeit", das tatsächlich ein Kompositum nicht vergleichbarer Messungen ist.

- Prüfen, ob die Autoren primäre Endpunkte (vorab definiert) oder sekundäre (nachträglich gewählt) verwendet haben

- Definitionen desselben Endpunkts in verschiedenen Studien vergleichen

- Bewerten, wie heterogen die Messmethoden in den zusammengeführten Studien sind

- Nach Anzeichen für Cherry-Picking suchen: wenn Autoren nur jene Endpunkte einbezogen haben, die einen Effekt zeigten

Wenn zwei Meta-Analysen voneinander abweichen, lautet die erste Frage nicht „wer hat recht", sondern „welche unterschiedlichen Fragen beantworten sie". Dies erfordert das Lesen der Methodik, nicht nur des Abstracts. Genau hier gewinnen oft paranormale Interpretationen die Oberhand: Widersprüche zwischen Quellen werden als Beweis für verborgenes Wissen wahrgenommen und nicht als Ergebnis methodologischer Entscheidungen.

Kognitive Anatomie des Mythos: Welche mentalen Fallen führen zu blindem Vertrauen in Meta-Analysen

Meta-Analysen nutzen mehrere kognitive Verzerrungen aus, die ihre Ergebnisse besonders überzeugend erscheinen lassen, selbst wenn methodologische Einschränkungen offensichtlich sind. Mehr dazu im Abschnitt Moderation und Qualitätskontrolle.

⚠️ Repräsentativitätsheuristik: Wenn die Anzahl der Studien eine Illusion von Vollständigkeit erzeugt

Eine Meta-Analyse von 20 Studien erscheint überzeugender als eine einzelne Studie, unabhängig von der Qualität dieser 20. Das Gehirn nutzt Quantität als Proxy für Qualität — ein klassisches Beispiel der Repräsentativitätsheuristik.

Wenn alle 20 Studien ein hohes Risiko für systematische Fehler aufweisen, reduziert ihre Zusammenführung dieses Risiko nicht — sie liefert eine präzise Schätzung des systematischen Fehlers.

🕳️ Präzisionsillusion: Wenn enge Konfidenzintervalle Unsicherheit verschleiern

Eine Meta-Analyse liefert eine zusammenfassende Schätzung mit einem Konfidenzintervall, das oft enger ist als die Intervalle der Einzelstudien. Dies erzeugt eine Illusion von Präzision.

Ein enges Konfidenzintervall spiegelt nur statistische Unsicherheit (Zufallsfehler) wider und ignoriert systematische Unsicherheit (Bias, Heterogenität, nicht gemessene Confounder). Die wahre Unsicherheit kann erheblich größer sein.

🧠 Methodologie-Halo-Effekt: Wenn PRISMA und PROSPERO falsches Vertrauen schaffen

Die Erwähnung der Einhaltung von PRISMA 2020-Richtlinien und Präregistrierung in PROSPERO erzeugt einen Halo-Effekt — die Annahme hoher Qualität (S001).

- PRISMA

- Ein Berichtsstandard, kein Qualitätsstandard. Eine Studie kann PRISMA perfekt befolgen und dennoch minderwertige Studien einschließen oder unbegründete kausale Schlussfolgerungen ziehen.

- PROSPERO

- Registrierung reduziert das Risiko selektiver Berichterstattung, garantiert aber nicht die Qualität des Protokolls.

🔁 Vertrauenskaskade: Wie Meta-Analysen ohne kritische Bewertung zitiert werden

Nach Veröffentlichung einer Meta-Analyse werden ihre Ergebnisse oft in klinischen Leitlinien, Lehrbüchern und Übersichtsartikeln ohne erneute kritische Bewertung zitiert. Jede nachfolgende Zitation verstärkt die wahrgenommene Glaubwürdigkeit.

- Die ursprüngliche Meta-Analyse wird mit methodologischen Einschränkungen veröffentlicht

- Klinische Leitlinien zitieren das Ergebnis ohne Erwähnung der Einschränkungen

- Lehrbücher und Übersichten wiederholen das Zitat aus den Leitlinien

- Das Ergebnis wird zur „allgemein anerkannten Tatsache", obwohl die Evidenzbasis schwach bleibt

Der Mechanismus funktioniert als Meta-Level-Falle: Jede Zitationsebene entfernt den Leser weiter von den Originaldaten und methodologischen Details.

Protokoll zur kritischen Bewertung eines systematischen Reviews in fünf Minuten: Checkliste für Praktiker

Jeder systematische Review oder Meta-Analyse ist kein Urteil, sondern eine Hypothese, verpackt in Methodik. Bevor man seine Schlussfolgerungen akzeptiert, müssen drei Ebenen geprüft werden: Studiendesign, Datenqualität und Interpretationslogik.

Nachfolgend ein minimaler Fragenkatalog, der 80% problematischer Reviews in wenigen Leseminuten aussortiert.

- Einschlusskriterien: eng oder diffus? Wenn Autoren Studien mit unterschiedlichen Populationen, Dosierungen, Dauer oder Messungen eingeschlossen haben – das ist keine Synthese, sondern Mittelung von Rauschen. Prüfe die Tabelle der Studiencharakteristika (meist im Anhang). Bei großer Streuung wird die Heterogenität (I²) hoch sein, und das gepoolte Ergebnis verliert an Bedeutung.

- Finanzierungsquelle und Interessenkonflikte der Autoren. Meta-Analysen, die vom Hersteller eines Medikaments oder Geräts gesponsert werden, überschätzen systematisch den Effekt (S008). Das bedeutet nicht zwangsläufig Fälschung – oft wirkt selektives Zitieren und Interpretation.

- Publikationsbias: wurde die „Schublade" geprüft? Autoren sollten nach unveröffentlichten Studien gesucht haben (über Register, Anschreiben an Autoren, Konferenzen). Fehlt dies, ist das Ergebnis überschätzt. Ein Funnel Plot im Anhang ist das erste Zeichen von Redlichkeit.

- Qualität der eingeschlossenen Studien: randomisiert oder beobachtend? Eine Meta-Analyse aus 50 Beobachtungsstudien ist schwächer als eine gute RCT (S003). Prüfe, wie viele Studien ein niedriges Bias-Risiko hatten (nach Cochrane Risk of Bias-Skala). Wenn weniger als die Hälfte – ist das Ergebnis unzuverlässig.

- Heterogenität (I²): über 50% – rote Flagge. Das bedeutet, dass mehr als die Hälfte der Ergebnisvarianz durch Unterschiede zwischen Studien erklärt wird, nicht durch Zufall. Bei I² > 75% ist das gepoolte Ergebnis nahezu wertlos. Autoren hätten Subgruppenanalysen oder Metaregressionen durchführen müssen, um die Quelle der Unterschiede zu finden.

- Effektgröße: klinisch bedeutsam oder statistisch signifikant? Das Konfidenzintervall ist der Hauptindikator. Wenn das 95%-KI die Null einschließt oder die Grenze klinischer Relevanz kreuzt, ist die Schlussfolgerung unbestimmt. Die Number Needed to Treat (NNT) sollte explizit angegeben sein.

- Sensitivitätsanalyse: ist das Ergebnis robust? Autoren sollten jeweils eine Studie ausgeschlossen und das Ergebnis neu berechnet haben. Wenn sich die Schlussfolgerung grundlegend ändert – ist das ein Zeichen von Instabilität. Prüfe auch, ob eine Analyse nur für RCTs durchgeführt wurde (ohne Beobachtungsstudien).

- Protokollregistrierung: wurde es vor Beginn registriert? PROSPERO (für systematische Reviews) oder Open Science Framework sind Standard. Fehlt ein Protokoll, könnten Autoren Einschlusskriterien während der Analyse geändert haben (p-hacking auf Review-Ebene).

Wenn ein Review 5–6 von 8 Fragen nicht beantwortet – sind seine Schlussfolgerungen vorläufig. Das bedeutet nicht, dass sie falsch sind, aber sie erfordern Überprüfung durch unabhängige Daten oder RCTs.

Praktischer Tipp: Beginne mit dem Abstract und der Tabelle der Studiencharakteristika. Wenn dort bereits hohe Heterogenität oder gemischte Studientypen sichtbar sind, ist eine Vertiefung in die Methodik oft unnötig – das Ergebnis ist bereits kompromittiert.

Denke daran: Meta-Analyse ist ein Synthesewerkzeug, kein Wahrheitswerkzeug. Ihr Wert hängt von der Qualität der Eingangsdaten und der Redlichkeit der Autoren ab. Kritisches Lesen dauert 5–10 Minuten und bewahrt oft vor fehlerhaften Entscheidungen.