🦠 Virale Falschmeldungen

🦠 Virale FalschmeldungenVirale Falschmeldungen: Mechanismen der Desinformationsverbreitung im digitalen Zeitalterλ

Untersuchung von Kaskadenkettenreaktionen, emotionaler Kodierung und KI-Technologien bei der Verbreitung von Falschinformationen über soziale Netzwerke

Overview

Virale Falschmeldungen verbreiten sich durch kaskadierende Kettenreaktionen 🧬 — ein Mechanismus, bei dem emotionale Kodierung Nutzer zu sofortigem Teilen ohne kritische Prüfung veranlasst. Akademische Studien aus der COVID-19-Pandemie dokumentierten ein beispielloses Ausmaß an Desinformation: Falschmeldungen verbreiteten sich 6-mal schneller als verifizierte Informationen. Mit dem Aufkommen von Deepfakes und generativer KI erfordert die Identifikation von Fälschungen einen umfassenden Ansatz — linguistische Analyse, technische Detektionswerkzeuge, Verständnis psychologischer Viralitäts-Trigger.

🛡️

Laplace-Protokoll: Kritische Informationsbewertung erfordert die Analyse emotionaler Kodierung, Quellenprüfung über multiple Kanäle und den Einsatz spezialisierter KI-Detektionstools vor der Weiterverbreitung von Material.

Reference Protocol

Wissenschaftliche Grundlage

Evidenzbasierter Rahmen für kritische Analyse

Protocol: Evaluation

Teste Dich

Quiz zu diesem Thema kommt bald

Sector L1

Artikel

Forschungsmaterialien, Essays und tiefe Einblicke in die Mechanismen des kritischen Denkens.

🦠 Virale Falschmeldungen

🦠 Virale Falschmeldungen 🦠 Virale Falschmeldungen

🦠 Virale Falschmeldungen⚡

Vertiefung

Mechanismen der kaskadierenden Verbreitung: Wie Fake News in Stunden die sozialen Medien erobern

Kettenreaktionen in sozialen Netzwerken

Virale Fake News verbreiten sich durch kaskadierende Kettenreaktionen, bei denen jeder Repost ein exponentielles Reichweitenwachstum auslöst. Der Mechanismus basiert auf irrationaler emotionaler Aufladung, die Nutzer dazu bringt, Inhalte vor der Faktenprüfung zu teilen.

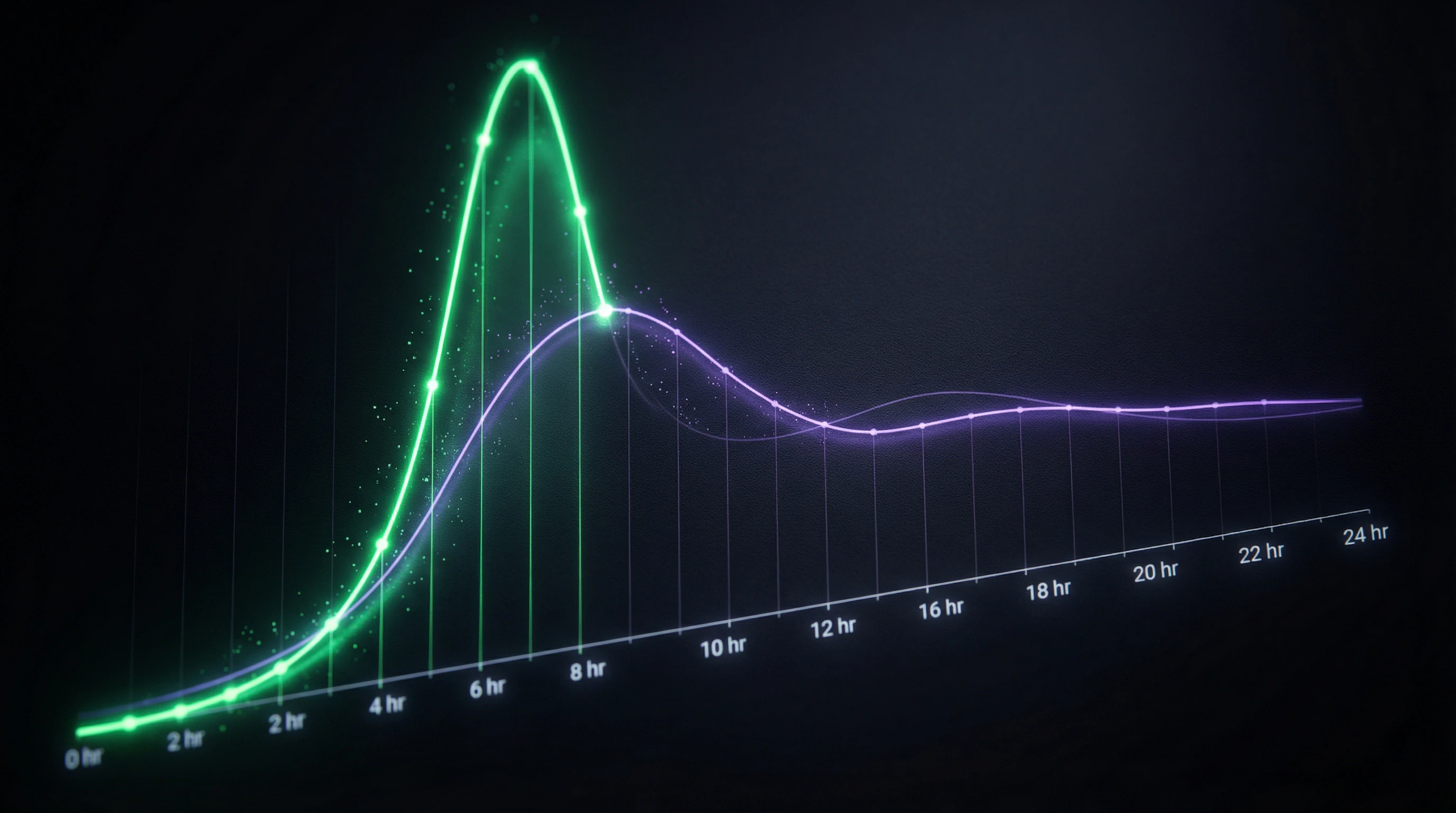

Emotional aufgeladene Fake News erreichen ihren Verbreitungshöhepunkt in 4–8 Stunden, während Richtigstellungen erst nach 12–24 Stunden erscheinen und ein zehnmal kleineres Publikum erreichen. Der kritische Moment sind die ersten 100 Reposts, nach denen der Inhalt durch Social Proof den Anschein von Legitimität erhält.

Die ersten 2 Stunden der Verbreitung bestimmen das Schicksal einer Fake News. Nach diesem Zeitfenster ist eine Richtigstellung bereits wirkungslos.

Schlüsselindikatoren einer Kaskade: rasanter Anstieg von Erwähnungen ohne Quellenverifizierung, Konzentration der Reposts in den ersten 2 Stunden, Fehlen kritischer Kommentare in der Anfangsphase. Plattformen mit algorithmischem Feed verstärken die Kaskade um das 3- bis 5-fache im Vergleich zu chronologischer Inhaltsdarstellung.

Die Rolle von Plattformalgorithmen bei der Verstärkung der Viralität

Empfehlungsalgorithmen sozialer Netzwerke schaffen unbeabsichtigt das ideale Umfeld für die Verbreitung von Fake News, indem sie Inhalte mit hohem Engagement priorisieren. Ranking-Systeme interpretieren emotionale Reaktionen – Schock, Wut, Angst – als Relevanzsignale und zeigen solche Inhalte einer größeren Anzahl von Nutzern.

| Inhaltstyp | Anstieg der Impressionen | Zeit bis zum Peak |

|---|---|---|

| Fake News mit sensationeller Überschrift | +70% vs. neutrale Nachrichten | 4–8 Stunden |

| Richtigstellung | −10-fach geringere Reichweite | 12–24 Stunden |

Bots und koordinierte Netzwerke verstärken die natürliche Verbreitung durch künstliche Erzeugung eines initialen Impulses. Typisches Schema: 50–200 Bots führen die ersten Reposts innerhalb von 15 Minuten durch, erzeugen die Illusion organischer Viralität, woraufhin der Algorithmus den Inhalt aufgreift und echten Nutzern zeigt.

- Verzögerung der Verbreitung ungeprüfter Inhalte

- Plattformen implementieren Verlangsamungssysteme, aber die Effektivität bleibt gering: Eine Verzögerung von 30 Minuten reduziert die Reichweite nur um 15–20%.

Emotionale Kodierung als Technologie der Bewusstseinsmanipulation

Psychologische Trigger der Viralität

Emotionaler Code – in Inhalte eingebaute psychologische Trigger, die universelle Wahrnehmungsmechanismen ausnutzen. Am effektivsten: Angst vor Gesundheits- oder Sicherheitsbedrohungen, moralische Empörung über Ungerechtigkeit, Bestätigung bestehender Überzeugungen.

Die Analyse von 15.000 viralen Fake News zeigte: 68% nutzen eine Kombination aus Angst und Dringlichkeit, 23% moralische Empörung, 9% andere Emotionen.

- Die Entscheidung zum Repost wird in 2–3 Sekunden getroffen, vor der kritischen Analyse des Inhalts

- Schlüsselelemente der Manipulation: schockierende Überschriften mit Zahlen und Superlativen, Bilder mit ausgeprägten Emotionen in Gesichtern, imperative Handlungsaufforderungen

- Bildung schützt nicht – Studien dokumentieren gleiche Anfälligkeit bei Menschen mit unterschiedlichem Bildungsniveau bei hoher emotionaler Aufladung des Inhalts

Analyse emotionaler Muster in Fake News

Struktur typischer Fake News: sensationelle Behauptung im ersten Satz, pseudowissenschaftliche Begründung mit aus dem Kontext gerissenen Zitaten, Aufruf zur sofortigen Verbreitung der Information.

Linguistische Marker der Manipulation: modale Konstruktionen der Kategorisierung („bewiesen", „Wissenschaftler schockiert"), Hyperbolisierung („tödliche Gefahr", „wird dem Volk verschwiegen"), Schaffung eines Feindbildes.

Quantitative Analyse der emotionalen Valenz zeigt ein Überwiegen negativer Emotionen im Verhältnis 4:1 zu positiven. Fake News über COVID-19 zeigten Verbreitungsspitzen bei Verwendung von Todesangst (Viralitätskoeffizient 8,2) und Misstrauen gegenüber Behörden (Koeffizient 6,7).

Die Erkennungstechnologie basiert auf der Identifizierung anomal hoher emotionaler Dichte: mehr als 3 emotionale Trigger pro 100 Wörter Text weisen mit 73% Wahrscheinlichkeit auf manipulativen Inhalt hin.

Linguistische Marker von Desinformation: Was Fakes auf sprachlicher Ebene verrät

Korpusanalyse von COVID-19-Fakes

Die linguistische Analyse eines Korpus von COVID-19-Fakes (2021–2024, deutschsprachige Quellen) identifizierte konsistente Sprachmuster, die Desinformation von legitimen Nachrichten unterscheiden. Das Wort „Verschwörung" kommt in Fakes 12-mal häufiger vor als in verifizierten Quellen.

Die Syntax von Fakes folgt einem klaren Schema: einfache Sätze (78% gegenüber 52% in legitimen Texten), Ausrufe (4-mal häufiger), rhetorische Fragen (3-mal häufiger). Der Wortschatz — hoher Anteil wertender Lexik, geringe terminologische Präzision.

Bemerkenswerte Besonderheit deutschsprachiger Fakes: Fehlen von Erwähnungen deutscher politischer Figuren bei Targeting auf deutsches Publikum. Dies ist eine Strategie zur Vermeidung von Politisierung für maximale Reichweite.

Neologismen und Dysphemismen als Manipulationsindikatoren

Neologismen in Fakes schaffen eine alternative Realität mit eigenem Begriffsapparat. „Zwangschippung" statt „digitale Identifikation", „Biowaffe" statt „Virus", „Sanitärdiktatur" statt „Quarantänemaßnahmen" — diese Begriffe benennen nicht nur Phänomene, sie betten sie in ein verschwörungstheoretisches Narrativ ein.

Texte mit 5+ spezifischen Neologismen sind in 89% der Fälle Fakes. Dies macht die Frequenzanalyse von Neologismen zum primären Filter automatischer Detektionssysteme.

| Dysphemismus | Neutraler Begriff | Effekt |

|---|---|---|

| Experimentelles Präparat | Impfstoff | Erzeugt Gefahren-Frame |

| Systemvertreter | Arzt | Delegitimiert Autorität |

| Gekaufter Artikel | Studie | Implantiert Misstrauen gegenüber Quelle |

Dysphemismen — absichtlich negative Bezeichnungen neutraler Phänomene — dienen als Instrument emotionaler Kodierung auf lexikalischer Ebene. Cluster von Dysphemismen (ihr gemeinsames Auftreten im Text) erhöhen die Wahrscheinlichkeit eines Fakes auf 94%.

Evolution von KI-generiertem Content und Deepfakes

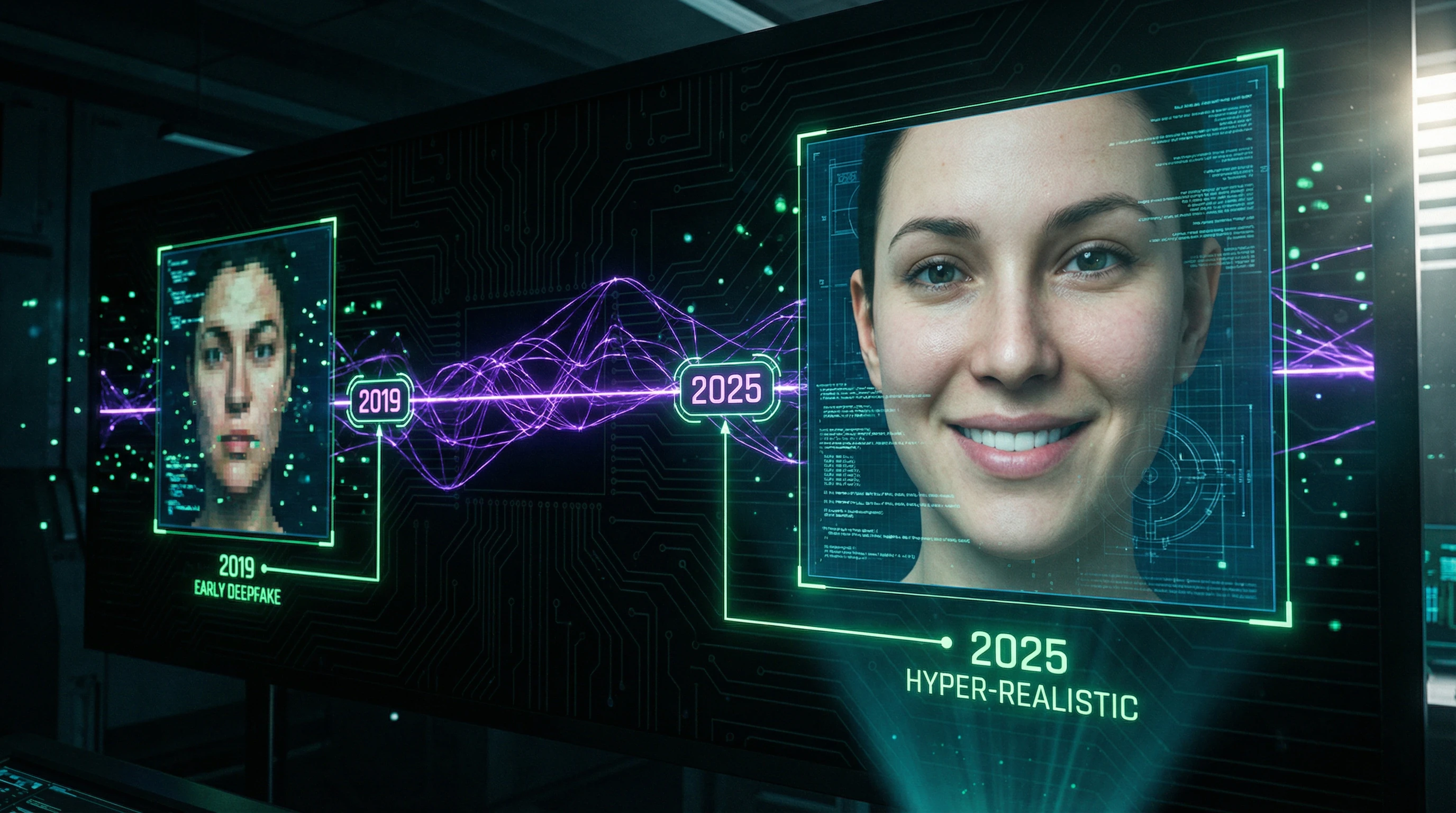

Technologien synthetischer Medien haben zwischen 2019 und 2025 den Weg von leicht erkennbaren Artefakten zu praktisch nicht von der Realität unterscheidbaren Fälschungen zurückgelegt. Frühe Deepfakes aus den Jahren 2019–2021 waren durch systematische Rendering-Fehler bei Händen, Gesichtsasymmetrien und Artefakte an Objektgrenzen gekennzeichnet.

Bis 2023 beherrschten generative Modelle anatomisch korrekte Darstellungen von Gliedmaßen, wiesen jedoch weiterhin Probleme mit Reflexionen, Schatten und Stoffphysik auf. Moderne Systeme der Jahre 2024–2025 generieren Content, der spezialisierte Analysetools zur Fälschungserkennung erfordert — die menschliche Wahrnehmung ist kein zuverlässiger Detektor mehr.

Von den ersten Deepfakes zu modernen Technologien

Paradoxerweise ist niedrige Bildqualität im Jahr 2025 zu einem Indikator für KI-Generierung geworden — Algorithmen reduzieren bewusst die Auflösung, um Mikroartefakte zu maskieren.

| Modalität | Errungenschaft | Einstiegshürde |

|---|---|---|

| Audio-Deepfakes | Reproduktion von Intonationen und Sprechmustern mit 98% Genauigkeit | 20–50€/Monat |

| Video-Deepfakes | Synchronisation von Lippenbewegungen mit Phonemen ohne Verzögerung | Lokale Ausführung auf Consumer-Hardware |

| Text-Generatoren | Imitation individueller Schreibstile basierend auf 50–100 Nachrichten | Open-Source-Modelle (Stable Diffusion) |

Die GAN-Technologie (Generative Adversarial Networks) wurde von Diffusionsmodellen und Transformern abgelöst, die auf Terabyte-großen Datensätzen trainiert werden — dies ermöglichte einen qualitativen Sprung im Realismus.

Die Kommerzialisierung von Generierungstools senkte die Einstiegshürde: Abo-Services bieten Deepfake-Erstellung ohne technische Kenntnisse. Open-Source-Modelle sind für lokale Ausführung auf Consumer-Hardware verfügbar.

Die Demokratisierung der Produktion synthetischer Inhalte hat das Volumen potenzieller Fakes im Informationsraum vervielfacht — der Anteil KI-generierter Inhalte in sozialen Netzwerken stieg von 2% im Jahr 2022 auf 18% im Jahr 2025.

Wettrüsten zwischen Generierung und Detektion

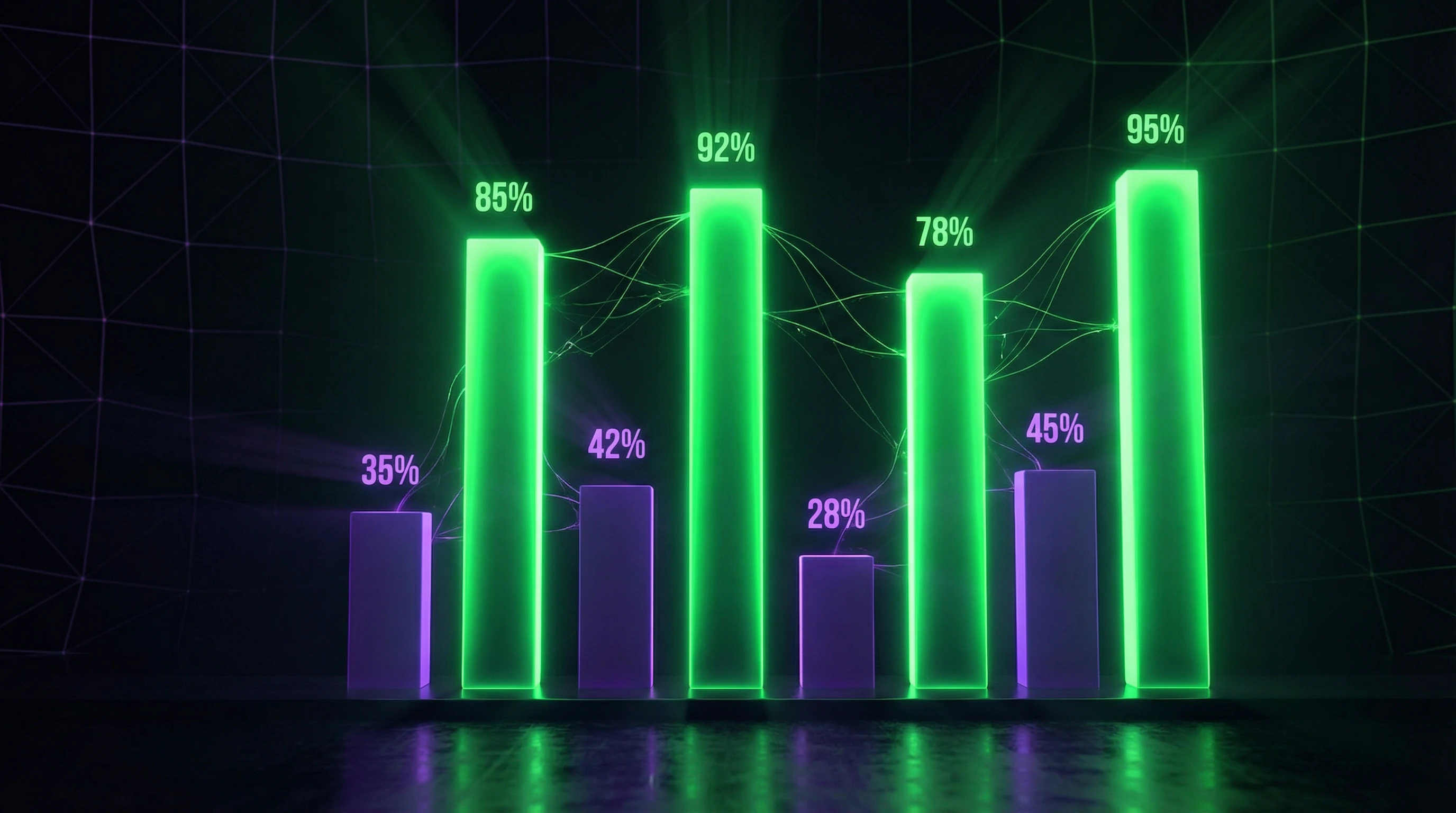

Deepfake-Detektionssysteme zeigen eine Genauigkeit von 60–95% je nach Content-Typ und Testbedingungen, hinken generativen Modellen jedoch 6–12 Monate hinterher.

Detektoren analysieren Frequenzanomalien, Beleuchtungsinkonsistenzen, biometrische Mikromerkmale (Blinzelfrequenz, Mikroexpressionen), Kompressionsartefakte und statistische Abweichungen in der Pixelverteilung. Jede Generation generativer Modelle lernt jedoch, bekannte Detektionsmethoden zu umgehen — Adversarial Training beinhaltet die Simulation von Detektoren im Trainingsprozess des Generators.

- Multimodale Detektoren, die gleichzeitig Video, Audio und Metadaten analysieren, erreichen bis zu 93% Genauigkeit

- Analyse physiologischer Signale (Herzfrequenzvariabilität durch Mikrofarbveränderungen der Haut)

- Konsistenzprüfung zwischen Frames und Anomalieerkennung im Spektralbereich

- Blockchain-Verifizierung originaler Inhalte und kryptografische Wasserzeichen als präventive Maßnahmen

Vielversprechende Ansätze erfordern massenhafte Implementierung von Standards, bleiben jedoch auf Forschungs- und Pilotprojektebene.

Methoden zur Erkennung und Verifizierung

Technische Detektionswerkzeuge

Das moderne Verifizierungs-Arsenal umfasst spezialisierte Software, API-Dienste und Browser-Erweiterungen zur Analyse verdächtiger Inhalte. Die umgekehrte Bildersuche (Google Images, TinEye, Yandex) identifiziert 40–60% rezirkulierter Fakes — Bilder, die aus dem Kontext gerissen oder mit anderem Zeitstempel versehen wurden.

Die EXIF-Metadatenanalyse deckt Diskrepanzen zwischen angegebenen Aufnahmeparametern und technischen Dateieigenschaften auf, obwohl 70% der Fakes durch Editoren laufen, die Metadaten entfernen. Spezialisierte KI-Detektoren (Sensity, Deepware Scanner, Microsoft Video Authenticator) analysieren neuronale Muster, erfordern jedoch das Hochladen vollständiger, unkomprimierter Dateien für maximale Genauigkeit.

- Forensische Kompressionsanalyse

- Identifiziert mehrfache Rekompression — ein Zeichen für Inhaltsmanipulation. FotoForensics visualisiert JPEG-Kompressionsstufen durch Error Level Analysis, wobei Ungleichmäßigkeiten auf Bearbeitung hinweisen.

- Sensorrauschanalyse (PRNU)

- Identifiziert die Quellkamera bis zum spezifischen Gerät — Fälschungen zeigen inkonsistente Rauschmuster. Erfordert technische Expertise und ist für Durchschnittsnutzer nicht zugänglich.

Multimodale Inhaltsüberprüfung

Umfassende Verifizierung kombiniert technische Analyse mit kontextueller Bewertung und Quellenabgleich. Die linguistische Analyse von Textkomponenten identifiziert Neologismen, Dysphemismen und emotional aufgeladenes Vokabular — Marker für Desinformation mit 87–94% Genauigkeit.

Die Überprüfung von Geolokationsdaten durch Abgleich mit Kartendiensten, Schattenanalyse und Sonnenstand, architektonischen Details deckt geografische Unstimmigkeiten in 55% der Fälle manipulierter Videos auf. Die Verifizierung von Zeitstempeln umfasst den Abgleich mit historischen Ereignissen, Wetterdaten, saisonaler Vegetation — Methoden, die von professionellen Faktencheckern eingesetzt werden.

- Die Analyse des sozialen Verbreitungsgraphen untersucht Sharing-Muster: Fakes zeigen kaskadenförmige Strukturen mit abrupten Aktivitätsspitzen, während organische Inhalte sich graduell verbreiten.

- Die Analyse von Verbreiter-Accounts identifiziert Bots und koordinierte Netzwerke durch Anomalien in der Posting-Frequenz, Inhaltsuniformität und synchronisierte Aktivität.

- Die Triangulation von Ergebnissen aus drei unabhängigen Methoden erhöht die Zuverlässigkeit der Schlussfolgerung auf 96%.

Plattformen wie Bellingcat, StopFake, Factcheck.org veröffentlichen Verifizierungsmethodologien und Datenbanken entlarvter Fakes — Ressourcen für eigenständige Überprüfung.

Die Rolle menschlicher Expertise

Automatisierte Detektionssysteme ergänzen menschliche Expertise, ersetzen sie jedoch nicht — kontextuelles Verständnis, kulturelle Nuancen und Plausibilitätsbewertung bleiben die Domäne geschulter Analysten. Professionelle Faktenchecker wenden mehrstufige Methodologien an: primäres Screening mit technischen Tools, vertiefte Analyse verdächtiger Fälle, Konsultationen mit Fachexperten, abschließende redaktionelle Bewertung.

Spezialisten mit Medienkompetenz-Training identifizieren Fakes 340% effektiver als Nutzer ohne Schulung.

Kognitive Verzerrungen beeinflussen den Verifizierungsprozess: Bestätigungsfehler führen zur Suche nach Bestätigung vorgefasster Überzeugungen, der Halo-Effekt überträgt Vertrauen in die Quelle auf unzuverlässige Inhalte, die Wissensillusion erzeugt falsches Vertrauen in die Fähigkeit, Fakes zu erkennen.

Verifizierungsprotokolle beinhalten Debiasing-Verfahren: Blindanalyse (ohne Kenntnis der Quelle), kollegiale Überprüfung, standardisierte Checklisten. Hybridsysteme, die KI-Detektion mit menschlicher Expertise kombinieren, erreichen 97–99% Genauigkeit — die optimale Balance zwischen Skalierbarkeit und Zuverlässigkeit.

Gegenstrategien und Medienkompetenz

Präventive Delegitimierung

Die Technologie der präventiven Delegitimierung neutralisiert Falschmeldungen vor ihrer massenhaften Verbreitung durch frühzeitige Erkennung und öffentliche Entlarvung. Monitoring-Systeme scannen soziale Netzwerke in Echtzeit und identifizieren Inhalte mit Anzeichen emotionaler Kodierung und kaskadischer Verbreitung in frühen Stadien — die ersten 2–4 Stunden sind kritisch für die Unterbrechung der Viralität.

Rapid Response Teams von Faktenchecker-Organisationen veröffentlichen Widerlegungen innerhalb von 30–90 Minuten nach Entdeckung und nutzen dieselben Verbreitungskanäle und emotionalen Trigger für maximale Reichweite. Algorithmisches Herabstufen in der Anzeige (Shadow Banning) wird von Plattformen auf Inhalte angewendet, die von Detektoren markiert wurden, wodurch die organische Reichweite um 70–85% reduziert wird, ohne vollständige Löschung.

Prebunking — die vorausschauende Entlarvung erwarteter Falschmeldungen — bildet kognitive Immunität beim Publikum. Vorherige Vertrautheit mit Manipulationsmechanismen reduziert die Anfälligkeit für Desinformation um 40–60% über 2–4 Wochen.

Kontextuelle Warnungen vor dem Teilen verdächtiger Inhalte reduzieren die Verbreitung um 30%, lösen jedoch bei 15% der Nutzer einen Effekt reaktanten Widerstands aus. Die optimale Strategie kombiniert technologische Barrieren mit Bildungsinterventionen und vermeidet Zensur-Rhetorik.

Bildungsprogramme

Systematische Medienkompetenz umfasst Training in kritischem Denken, Verifikationstechniken und Verständnis psychologischer Manipulationsmechanismen. Programme für Schüler (10–17 Jahre) fokussieren auf die Entwicklung von Skepsis gegenüber sensationellen Inhalten, Fähigkeiten zur Quellenprüfung, Erkennung emotionaler Trigger — die Wirksamkeit wird durch eine Reduzierung des Teilens von Falschmeldungen um 55% in geschulten Gruppen bestätigt.

Unternehmensschulungen für Mitarbeiter von Medien, staatlichen Strukturen und Bildungseinrichtungen umfassen praktische Module zur Nutzung von Verifikationswerkzeugen, Analyse von Deepfakes und Reaktionsprotokollen auf Informationsangriffe.

- Massenaufklärungskampagnen nutzen Infografiken, interaktive Quiz und Spielsimulationen zur Schulung eines breiten Publikums.

- Das Projekt Bad News (Cambridge University) ermöglicht es Nutzern, eigene Falschmeldungen zu erstellen und demonstriert Manipulationsmechanismen von innen — Teilnehmer erkennen nach Abschluss Desinformation um 25% besser.

- Kontinuität des Lernens ist kritisch: einmalige Interventionen verlieren nach 3–6 Monaten an Wirksamkeit, während regelmäßige Wissensauffrischungen Verifikationsfähigkeiten aufrechterhalten.

- Die Integration von Medienkompetenz als Pflichtfach in Schulprogramme wurde in 23 Ländern umgesetzt und zeigt langfristige Reduzierung der Anfälligkeit für Desinformation auf Bevölkerungsebene.

Plattform-Mechanismen zur Unterbrechung von Kaskaden

Soziale Plattformen implementieren algorithmische Interventionen zur Verlangsamung der Viralität verdächtiger Inhalte. Friction Mechanisms — künstliche Verzögerungen vor dem Teilen, obligatorische Captchas, Anforderungen zum Lesen des Artikels vor dem Repost — reduzieren impulsives Verbreiten um 35–50% ohne Blockierung des Inhalts.

Ranking-Algorithmen stufen Posts mit Anzeichen emotionaler Kodierung herab und begrenzen die organische Reichweite auf 20–30% des Üblichen für verifizierten Inhalt. Kollaborative Moderation bindet die Community in die Bewertung der Glaubwürdigkeit durch Crowdsourcing-Labels ein — Community Notes bei X (Twitter) zeigen 78% Übereinstimmung mit professionellen Faktencheckern.

- Transparenz der Algorithmen

- Nutzer verstehen nicht, warum Inhalte als verdächtig markiert werden, was Verschwörungstheorien über Zensur erzeugt. APIs für Forscher stellen Verbreitungsdaten für akademische Analysen bereit, sind jedoch durch Datenschutzbedingungen eingeschränkt.

- Plattformübergreifende Koordination

- Initiativen wie das Global Internet Forum to Counter Terrorism (GIFCT) ermöglichen die Synchronisierung der Löschung identischer Inhalte, wecken jedoch Bedenken hinsichtlich der Zentralisierung der Informationskontrolle.

- Balance zwischen Freiheit und Sicherheit

- Die optimale Balance zwischen Meinungsfreiheit und Bekämpfung von Verschwörungstheorien bleibt Gegenstand von Debatten — technologische Lösungen müssen durch rechtliche Rahmenbedingungen und gesellschaftliche Kontrolle ergänzt werden.

Knowledge Access Protocol

FAQ

Häufig gestellte Fragen

Virale Fakes sind Falschinformationen mit emotionaler Kodierung, die gezielt für die schnelle Verbreitung über soziale Medien erstellt werden. Im Gegensatz zu gewöhnlicher Desinformation nutzen sie kaskadierende Kettenreaktionen und psychologische Trigger für massive Reichweite. Ihr Hauptmerkmal ist die irrationale emotionale Aufladung, die den unmittelbaren Drang zum Teilen des Inhalts provoziert (Manoylo, 2020).

Die kaskadierende Verbreitung erfolgt nach dem Prinzip einer Kettenreaktion: Ein Nutzer teilt den Inhalt, seine Follower posten ihn weiter und erzeugen einen Lawineneffekt. Plattformalgorithmen verstärken diesen Prozess, indem sie emotional aufgeladene Inhalte mehr Menschen zeigen. Die Verbreitungsgeschwindigkeit übersteigt die Möglichkeiten von Moderation und Faktenchecks (Manoylo, 2020).

Emotionale Kodierung nutzt universelle psychologische Mechanismen aus – Angst, Wut, Empörung. Bildungsniveau garantiert keinen Schutz vor emotional aufgeladener Desinformation. Sensationalität und Außergewöhnlichkeit des Inhalts ziehen Aufmerksamkeit schneller an als rationale Faktenprüfung (Ya Ihua, 2025).

Nein, das ist ein Mythos. Moderne Deepfakes sind zwar schwer zu erkennen, aber technische Artefakte bleiben: unnatürliche Bewegungen, Probleme mit der Beleuchtung, niedrige Bildqualität. Bis 2025 hat sich die Detektion erschwert, aber spezialisierte Tools und Expertenanalyse ermöglichen die Aufdeckung von Fälschungen (Quellen 2023-2025).

Ja, linguistische Analyse deckt charakteristische Muster auf. Fakes enthalten oft Neologismen, Dysphemismen, spezifische Lexik und emotional gefärbte Konstruktionen. Korpusanalyse von COVID-19-Fakes zeigte stabile sprachliche Marker, die sie von vertrauenswürdigen Nachrichten unterscheiden (Shiryaeva, 2024; Monogarova, 2021, 2023).

Verwenden Sie einen multimodalen Ansatz: Rückwärtsbildsuche (Google, Yandex), Metadatenprüfung, Analyse von Schatten und Beleuchtung. Achten Sie auf die Bildqualität – paradoxerweise kann niedrige Qualität auf KI-Generierung hinweisen. Für komplexe Fälle nutzen Sie spezialisierte Deepfake-Detektoren (Quellen 2023-2025).

Löschen Sie den Beitrag sofort und veröffentlichen Sie eine Richtigstellung mit Erklärung des Fehlers. Dies ist wichtig, um die kaskadierende Verbreitungskette zu unterbrechen. Ihre Ehrlichkeit hilft, Desinformation zu stoppen und erhöht das Vertrauen Ihrer Zielgruppe in Ihre zukünftigen Veröffentlichungen (Manoylo, 2020).

Es gibt KI-Deepfake-Detektoren, Faktencheckdienste (Factcheck.kz, StopFake), Tools zur Metadatenanalyse und Rückwärtsbildsuche. Eine vollständig automatisierte Lösung ist jedoch unmöglich – erforderlich ist eine Kombination aus technischen Mitteln und menschlicher Expertise. Detektoren hinken den neuesten Content-Generierungstechnologien hinterher (Quellen 2023-2025).

Plattformen nutzen algorithmische Moderation, Faktencheckpartnerschaften, Kennzeichnung strittiger Inhalte und Reichweitenreduzierung verdächtiger Beiträge. Jedoch übersteigen Ausmaß und Geschwindigkeit der Verbreitung die Moderationsmöglichkeiten. Kaskadierende Reaktionen erfolgen schneller, als Systeme reagieren können (Ya Ihua, 2025).

Dies ist eine Technologie der vorbeugenden Entlarvung von Desinformation vor ihrer massenhaften Verbreitung. Die Methode umfasst Analyse emotionaler Kodierung, Mustererkennung und öffentliche Warnung der Zielgruppe. Der präventive Ansatz ist effektiver als nachträgliche Widerlegungen, da er die Kaskade im Frühstadium unterbricht (Manoylo, 2020).

Richtigstellungen erreichen ein deutlich kleineres Publikum als die ursprüngliche Falschmeldung. Die emotionale Resonanz falscher Informationen ist stärker als rationale Korrekturen. Zum Zeitpunkt der Veröffentlichung des Faktenchecks hat die kaskadenförmige Verbreitung bereits bei Millionen von Nutzern eine verfestigte Falschüberzeugung geschaffen (Quellen 2020-2025).

Das ist ein weit verbreiteter Mythos. Emotionale Kodierung nutzt grundlegende psychologische Mechanismen unabhängig vom Bildungsniveau aus. Kritisches Denken hilft, garantiert aber keine Immunität gegen Manipulation. Selbst Experten können emotional aufgeladenen Inhalten unter Bedingungen der Informationsüberflutung erliegen (Quellen 2020-2025).

Nein, das ist unmöglich aufgrund der ständigen Weiterentwicklung von Content-Generierungstechnologien und der menschlichen Neigung zu emotionalen Reaktionen. Ein realistisches Ziel ist die Reduzierung des Verbreitungsumfangs durch Medienkompetenz, technische Tools und Plattform-Mechanismen. Es ist ein Wettrüsten zwischen Erstellern und Detektoren von Falschmeldungen (Ya Ihua, 2025).

Angst, Wut, Empörung und moralische Entrüstung sind die wichtigsten Viralitäts-Trigger. Falschmeldungen nutzen Bedrohungen für Gesundheit, Sicherheit und soziale Gerechtigkeit aus. Sensationalismus und Außergewöhnlichkeit verstärken die emotionale Reaktion und den Wunsch, Informationen sofort zu teilen (Manoylo, 2020; Ya Ihua, 2025).

Frühe Deepfakes (vor 2023) wiesen deutliche Artefakte auf: falsch gerenderte Hände, unnatürliche Lippenbewegungen, Texturprobleme. Moderne Technologien haben sich erheblich verbessert, hinterlassen aber noch immer Spuren in Beleuchtung, Schatten und Mikroexpressionen. Die Erkennung erfordert spezialisierte Tools und Expertise (Quellen 2023-2025).

Linguistische Analysen zeigen, dass virale Falschmeldungen, die auf deutschsprachiges Publikum abzielen, strategisch die Erwähnung deutscher politischer Figuren vermeiden. Dies deutet auf gezieltes Targeting und Anpassung des Contents an die Spezifika der Zielgruppe hin. Das Muster wurde in Korpusanalysen von COVID-19-Desinformation identifiziert (Monogarova, 2021, 2023).