Dead Internet Theory: vom verschwörungstheoretischen Meme zur dokumentierten Realität digitaler Erosion

Die Dead Internet Theory behauptet, dass organische Inhalte, die von echten Menschen erstellt wurden, systematisch verschwinden oder unzugänglich werden, während ihr Platz von künstlich generiertem Material eingenommen wird — Bots, algorithmische Synthesen, KI-generierte Inhalte. Laut einer Studie von Mehmet Kaan Ildiz von der Üsküdar-Universität „ist das Internet heute kein Raum mehr, der organische Diskussionen der Vergangenheit bewahrt" (S001).

Dies ist nicht nur eine Veränderung der Nutzererfahrung — es ist eine fundamentale Transformation der Natur des digitalen Gedächtnisses. Das Internet hat sich in einen Strom verwandelt, in dem oberflächliche und sich wiederholende künstliche Inhalte dominieren. Mehr dazu im Abschnitt Desinformation.

🧩 Grenzen des Phänomens: Was gilt als „tot" im Kontext des digitalen Ökosystems

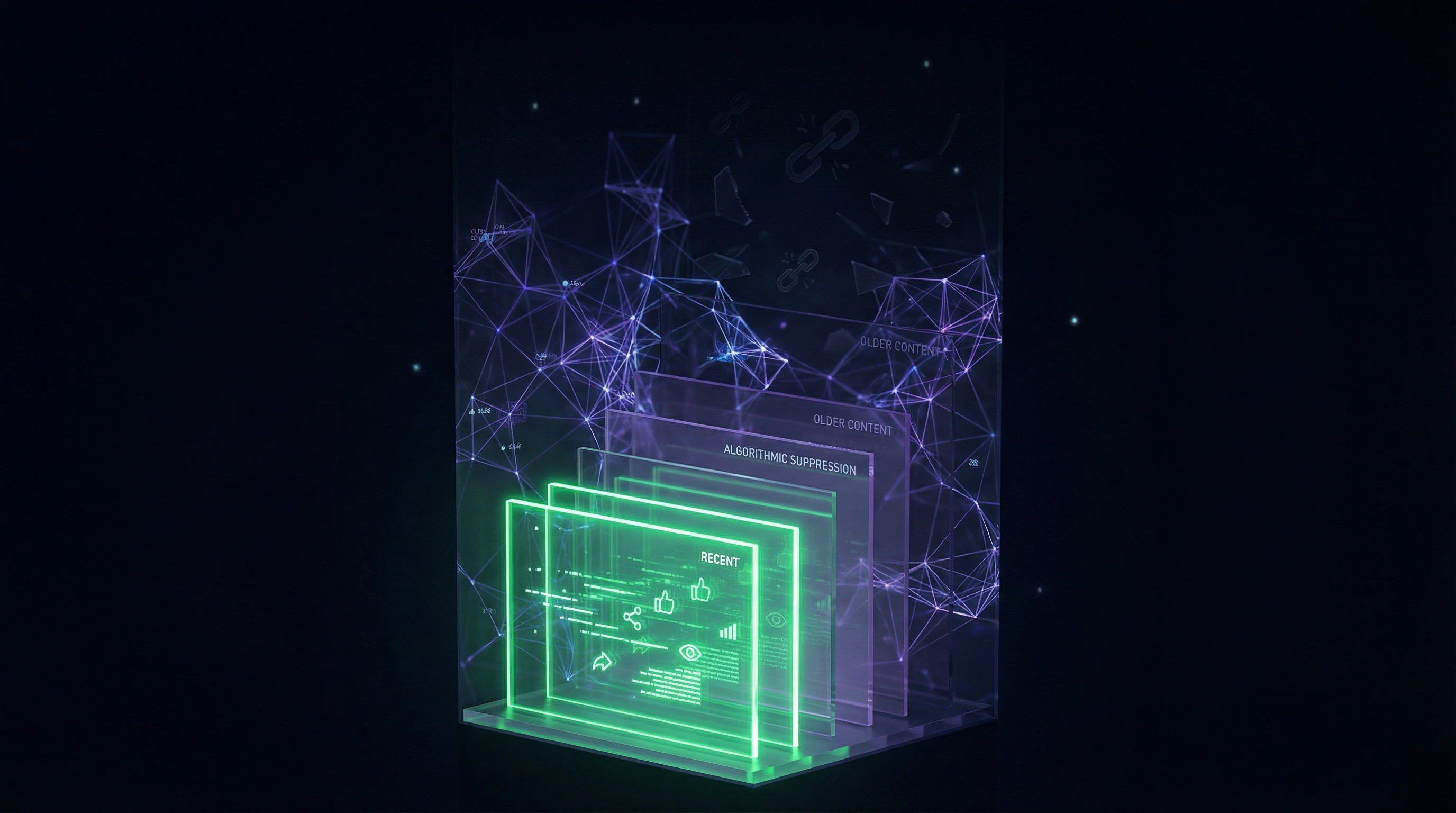

Das „tote Internet" hat mehrere Dimensionen. Die erste ist physische Unzugänglichkeit: Links ins Nichts, gelöschte Seiten, verschwundene Domains. Die zweite ist algorithmische Unsichtbarkeit: Inhalte existieren, aber Suchmaschinen und Empfehlungsalgorithmen zeigen sie nicht an.

Der Großteil der Inhalte ist entweder unzugänglich oder in algorithmischen Feeds unerreichbar (S001).

Die dritte Dimension ist die Ersetzung authentischer Inhalte durch synthetische: Originaldiskussionen werden durch KI-generierte Zusammenfassungen ersetzt, die faktische Fehler oder „Halluzinationen" enthalten können.

🔎 Wikipedia als Indikator: Warum die Enzyklopädie zum Lackmustest digitaler Degradation wurde

Wikipedia funktioniert als massives Archiv von Links zu externen Quellen. Jeder Artikel enthält Dutzende, manchmal Hunderte von Hyperlinks, die die dargelegten Fakten belegen sollen. Die Studie dokumentiert das Ausmaß des Problems: Ein erheblicher Anteil dieser Links wird mit der Zeit nicht mehr funktionsfähig (S003).

Dies ist nicht nur eine technische Störung — es ist ein Symptom eines tieferen Prozesses des Verschwindens der digitalen Wissensinfrastruktur. Wenn die Quellen, auf die die Enzyklopädie verweist, verschwinden, verwandelt sich die Enzyklopädie selbst in einen Friedhof von Links.

🧱 Architektur des Problems: drei Schichten der Zerstörung des digitalen Gedächtnisses

- Technische Schicht

- Server werden geschlossen, Domains laufen ab, Inhalte werden von Eigentümern gelöscht.

- Ökonomische Schicht

- Die Aufrechterhaltung alter Inhalte erfordert Ressourcen, die Unternehmen nicht für Materialien aufwenden wollen, die keinen Traffic generieren.

- Algorithmische Schicht

- Suchmaschinen und soziale Plattformen priorisieren frische Inhalte und machen alte Diskussionen praktisch unsichtbar.

Ildiz bemerkt: „Die digitale Vergangenheit verschwindet gleichzeitig und wird durch eine künstliche Vergangenheit ersetzt" (S001). Diese drei Schichten interagieren und erzeugen einen Effekt beschleunigter Erosion, der nicht nur einzelne Websites betrifft, sondern die gesamte Architektur des digitalen Gedächtnisses.

Die Stahlkonstruktion der Theorie: sieben überzeugende Argumente für die Realität des toten Internets

📊 Erstes Argument: das dokumentierte Verschwinden von Links in Wikipedia als empirische Tatsache

Die ACM-Studie (S003) liefert direkte empirische Daten über das Ausmaß des Problems „dauerhaft toter" Links in Wikipedia. Dies ist keine theoretische Konstruktion, sondern ein messbares Phänomen mit konkreten Zahlen.

Die Methodik umfasste eine systematische Analyse von Links in Wikipedia-Artikeln, die Verfolgung ihres Status über die Zeit und die Klassifizierung von Arten der Nichtverfügbarkeit. Die Ergebnisse zeigen, dass ein erheblicher Anteil externer Links innerhalb weniger Jahre nach Veröffentlichung nicht mehr funktioniert, wobei sich der Prozess für bestimmte Inhaltskategorien beschleunigt. Mehr dazu im Abschnitt Datenverheimlichung durch Pharmaunternehmen.

| Merkmal | Beobachtung |

|---|---|

| Art des Phänomens | Messbar, dokumentiert |

| Umfang | Erheblicher Anteil externer Links |

| Dynamik | Beschleunigte Degradation im Zeitverlauf |

🔬 Zweites Argument: algorithmische Unterdrückung historischer Inhalte in Suchmaschinen und sozialen Netzwerken

Moderne Ranking-Algorithmen diskriminieren systematisch alte Inhalte zugunsten aktueller. Yildiz weist darauf hin: „Heute ist jedoch ein Großteil dieser Inhalte entweder nicht verfügbar oder in algorithmischen Feeds unerreichbar" (S001).

Dies ist kein Zufall, sondern das Ergebnis bewussten Designs: Die Engagement-Metriken, auf denen Algorithmen basieren, begünstigen naturgemäß neue Inhalte. Ein Nutzer, der versucht, eine fünf Jahre alte Diskussion zu finden, stößt auf eine unüberwindbare Barriere – Suchmaschinen zeigen aktuelle Ergebnisse, selbst wenn ältere relevanter für die Anfrage sind.

Algorithmische Unterdrückung ist kein Bug, sondern ein Feature: Das System funktioniert genau so, wie es entworfen wurde. Die Frage ist nicht, warum dies geschieht, sondern wer vom Verschwinden der Erinnerung profitiert.

🧾 Drittes Argument: Ersetzung organischer Inhalte durch KI-generierte Halluzinationen

„Im Kern des Problems liegt, dass mit der Schwächung originaler menschlicher Inhalte die abgenutzten und verblassten Bereiche mit Halluzinationen künstlicher Intelligenz gefüllt werden. Während echte Erinnerung gelöscht wird, nimmt simulierte Erinnerung ihren Platz ein" (S001).

Generative Modelle erzeugen plausible, aber faktisch ungenaue Inhalte, die die von verschwundenen Originalen hinterlassenen Lücken füllen. Das Problem verschärft sich dadurch, dass „die Tatsache, dass generative Modelle manchmal ungeprüfte, fabrizierte oder aus dem Kontext gerissene Informationen produzieren, eine zusätzliche Schicht der Unsicherheit über alte digitale Diskussionen legt, die bereits schwer zu finden sind" (S001).

- Organische Inhalte verschwinden aus Suche und Archiven

- KI füllt die Lücken mit plausiblen, aber falschen Daten

- Neue Nutzer unterscheiden nicht zwischen Realem und Synthetischem

- Digitale Erinnerung transformiert sich in Simulation

🧬 Viertes Argument: ökonomische Unwirtschaftlichkeit der Archivpflege im Zeitalter der Engagement-Metriken

Die Geschäftsmodelle moderner Plattformen basieren auf der Maximierung von Engagement und Verweildauer. Alte Inhalte, die keine Klicks generieren und keine Werbetreibenden anziehen, werden zum ökonomischen Ballast.

Unternehmen haben keine finanziellen Anreize, die Verfügbarkeit von Materialien aufrechtzuerhalten, die keinen Umsatz bringen. Dies erzeugt systematischen Druck in Richtung Löschung oder Depriorisierung historischer Inhalte. Serverkapazität kostet Geld, und alte Diskussionen verdienen keines – die ökonomische Logik ist unerbittlich.

🔁 Fünftes Argument: selbstverstärkender Degradationszyklus durch KI-Training auf synthetischen Daten

Wenn generative Modelle auf Daten trainiert werden, die bereits KI-generierten Content enthalten, entsteht der Effekt des „Model Collapse" – eine fortschreitende Qualitätsminderung und zunehmende Homogenität der Ausgabedaten.

Während organische Inhalte verschwinden und durch synthetische Ersetzungen ersetzt werden, trainieren neue Generationen von Modellen auf einer zunehmend verzerrten Darstellung der Realität. Dies erzeugt eine positive Rückkopplung: Je mehr KI-Content im Internet, desto schlechter die Qualität zukünftiger KI-Modelle, die noch mehr minderwertigen Content produzieren.

- Model Collapse

- Phänomen, bei dem Training auf synthetischen Daten zu fortschreitender Qualitätsdegradation führt. Jede Modellgeneration trainiert auf zunehmend verzerrten Daten, was Fehler verstärkt.

- Positive Rückkopplung

- System, in dem das Ergebnis die Ursache verstärkt. Hier: mehr KI-Content → schlechtere neue Modelle → noch mehr minderwertiger Content.

📌 Sechstes Argument: Transformation digitaler Erinnerung vom Archiv zur Simulation

„Doch während Internet-Diskussionen verschwinden und durch künstliche Synthesen ersetzt werden, verwandelt sich das, was Nutzer als 'digitale Erinnerung' wahrnehmen, zunehmend in eine simulative Struktur" (S001).

Dies ist nicht nur Datenverlust – es ist eine qualitative Veränderung der Natur digitaler Erinnerung. Statt eines Archivs realer menschlicher Interaktionen erhalten wir eine algorithmisch konstruierte Vorstellung davon, was „hätte passieren sollen", basierend auf Mustern aus Trainingsdaten. Die Unterscheidung zwischen „was war" und „was das Modell für plausibel hält" verwischt.

Digitale Erinnerung hört auf, Zeugnis zu sein, und wird zur Interpretation. Dies ist kein Archiv – es ist eine Galerie von Wahrscheinlichkeiten, in der Realität und Simulation ununterscheidbar sind.

🧩 Siebtes Argument: institutionelle Unfähigkeit Wikipedias, der massiven Link-Degradation entgegenzuwirken

Obwohl Wikipedia als „erfolgreiches Beispiel eines selbstverwalteten Teams" (S006) funktioniert, wo „eine integrierte und kohärente Datenstruktur entsteht, während Nutzer erfolgreich Rollen durch Selbstselektion verteilen" (S006), verfügt das Projekt über keine Mechanismen für den systematischen Kampf gegen das massenhafte Verschwinden externer Quellen.

Das Freiwilligenmodell skaliert nicht für die Aufgabe der Überprüfung und Wiederherstellung von Millionen Links. Die Studie (S003) dokumentiert dieses Problem und zeigt, dass selbst in der gut gepflegten Enzyklopädie der Prozess der Link-Degradation die Bemühungen um deren Wiederherstellung überholt.

- Das Freiwilligenmodell funktioniert für die Inhaltsbearbeitung

- Skaliert aber nicht für die Überprüfung von Millionen Links

- Link-Degradation erfolgt schneller als deren Wiederherstellung

- Institutionelle Ressourcen reichen nicht zur Problemlösung

Evidenzbasis: Was die Daten über Ausmaß und Mechanismen der digitalen Erosion aussagen

📊 Quantitative Daten zu „permanent toten" Links in Wikipedia

Die Studie „Characterizing 'permanently dead' links on Wikipedia" (S003) präsentiert eine systematische Analyse nicht funktionierender Links in der Enzyklopädie. Die Methodologie umfasste automatisierte Überprüfung von HTTP-Antwortstatus für externe Links, Klassifizierung von Fehlertypen (404, 410, Timeouts, DNS-Fehler) und zeitliche Degradationsanalyse.

Die Ergebnisse zeigen eine systematische Verzerrung: Nachrichtenseiten, persönliche Blogs und kleine kommerzielle Projekte verschwinden deutlich schneller als institutionelle Quellen. Das bedeutet, dass das digitale Gedächtnis die Stimme großer Organisationen bewahrt und die Stimmen unabhängiger Autoren verliert. Mehr dazu im Abschnitt Verschwörungstheorien.

| Quellentyp | Verschwindensrate | Ursache |

|---|---|---|

| Institutionelle Websites | Niedrig | Dauerhafte Finanzierung, Backups |

| Nachrichtenportale | Mittel | Reindexierung, Plattformwechsel |

| Persönliche Blogs | Hoch | Fehlende Wartung, Hosting-Schließung |

| Kleine kommerzielle Projekte | Hoch | Insolvenz, Domain-Wechsel |

🧪 Qualitative Analyse der Transformation des digitalen Gedächtnisses

Ildiz liefert einen konzeptionellen Rahmen: „Die digitale Vergangenheit verschwindet gleichzeitig und wird durch eine künstliche Vergangenheit ersetzt" (S001). Dies ist ein doppelter Prozess – nicht nur Verlust, sondern aktive Substitution.

„Das Kernproblem liegt darin, dass mit der Schwächung originaler menschlicher Inhalte die abgenutzten und verblassten Bereiche mit KI-Halluzinationen gefüllt werden. Während das reale Gedächtnis gelöscht wird, nimmt simuliertes Gedächtnis seinen Platz ein" (S001).

Das Internet verwandelt sich von einem Archiv realer Ereignisse in einen Generator plausibler Narrative. Der Nutzer sieht keinen Unterschied zwischen wiederhergestelltem Fakt und generierter Imitation.

🔎 Mechanismen der algorithmischen Unterdrückung historischer Inhalte

Suchmaschinen und soziale Plattformen verwenden Ranking-Algorithmen, die Aktualität des Inhalts, Engagement-Metriken und Quellenautorität berücksichtigen. Jedoch überwiegt der Aktualitätsfaktor oft die übrigen Kriterien.

„Der Großteil dieser Inhalte ist entweder unzugänglich oder in algorithmischen Feeds unerreichbar" (S001). Selbst hochwertiges altes Material wird praktisch unsichtbar. Dies ist kein Systemfehler – es ist seine Zielfunktion: Algorithmen sind für kurzfristiges Engagement optimiert, nicht für langfristige Wissensbewahrung.

- Algorithmus rankt Inhalte nach Aktualität

- Alte Inhalte sinken in den Suchergebnissen

- Nutzer findet historische Quelle nicht

- Greift auf KI-Zusammenfassung statt Original zurück

- Erhält plausible, aber ungeprüfte Information

🧾 Problem der KI-Halluzinationen als Ersatz für faktische Information

Generative Modelle erzeugen plausible, aber faktisch ungenaue Inhalte – ein Phänomen, bekannt als „Halluzinationen". „Die Tatsache, dass generative Modelle manchmal ungeprüfte, fabrizierte oder aus dem Kontext gerissene Informationen produzieren, fügt eine zusätzliche Schicht der Unsicherheit über alte digitale Diskussionen hinzu, die bereits schwer zu finden sind" (S001).

Wenn der Nutzer keinen Zugang zur Originalquelle erhält und sich auf KI-generierte Zusammenfassungen verlässt, verliert er die Fähigkeit zur Genauigkeitsprüfung. Dies schafft eine epistemologische Krise: Wie unterscheidet man reale Geschichte von plausibler Simulation? Mehr zu Manipulationsmechanismen in der Analyse verschwörungstheoretischer Narrative.

- Halluzination

- Generierung von Information durch ein Modell, die plausibel klingt, aber nicht durch Quellen bestätigt ist. Gefährlich, weil der Nutzer sie ohne Zugang zum Originalkontext nicht von Fakten unterscheiden kann.

- Epistemologische Krise

- Situation, in der ein Wissenssystem verlässliche Kriterien zur Unterscheidung von Wahrheit und Fiktion verliert. Im Kontext des toten Internets – Unmöglichkeit, Informationen durch Originalquellen zu verifizieren.

Kausalmechanismen: Warum die Korrelation zwischen dem Verschwinden von Inhalten und dem Wachstum von KI keine direkte Kausalität bedeutet

🧬 Unterscheidung direkter und indirekter Kausalzusammenhänge

Die Korrelation zwischen KI-Wachstum und dem Verschwinden von Inhalten verdeckt drei unterschiedliche Mechanismen. Erstens — direkte Verdrängung: Algorithmen fördern aktiv synthetische Inhalte anstelle menschlicher. Zweitens — parallele Prozesse: organische Inhalte verschwinden aus unabhängigen Gründen (Schließung von Websites, wirtschaftliche Faktoren), und KI füllt die Lücken. Mehr dazu im Abschnitt Wissenschaftliche Methode.

Drittens — Rückkopplung: die Präsenz von KI-Inhalten verändert die wirtschaftlichen Anreize für Ersteller und beschleunigt das Verschwinden menschlicher Inhalte. Yildiz dokumentiert das Ergebnis: „Das Internet hat sich in einen Stream verwandelt, in dem oberflächliche und sich wiederholende künstliche Inhalte dominieren" (S001), aber dies ist das Produkt vieler interagierender Faktoren, nicht einer einzigen Ursache.

- Direkte Verdrängung: algorithmische Förderung von KI verdrängt menschliche Inhalte aus dem Feed

- Parallele Prozesse: organische Inhalte verschwinden unabhängig; KI füllt die entstandenen Lücken

- Rückkopplung: KI-Inhalte verändern die Ökonomie der Erstellung und machen menschliche Inhalte weniger rentabel

🔁 Störfaktoren: wirtschaftliche und technologische Faktoren unabhängig von KI

Das Verschwinden von Inhalten begann lange vor generativen Modellen. Wirtschaftliche Unrentabilität der Wartung alter Websites, Plattformkonsolidierung, technologische Veralterung von Formaten — all dies sind unabhängige Prozesse, die parallel zur KI-Implementierung abliefen.

Auch die Internet-Infrastruktur verändert sich unabhängig. Veränderungen bei IXPs (Internet Exchange Points) beeinflussen die Verfügbarkeit von Inhalten unabhängig von KI (S008). Die gesamte Verantwortung der künstlichen Intelligenz zuzuschreiben vereinfacht ein komplexes Bild und verdeckt die tatsächlichen wirtschaftlichen und technologischen Ursachen.

| Faktor des Verschwindens | Unabhängig von KI | Durch KI verstärkt |

|---|---|---|

| Schließung von Websites | ✓ (Wirtschaft, Insolvenzen) | — (KI schließt keine Websites) |

| Tote Links | ✓ (dokumentiert vor 2020) | ✓ (KI beschleunigt Inhaltsersetzung) |

| Plattformkonsolidierung | ✓ (Monopolisierung) | — (KI verursacht keine Konsolidierung) |

| Ersetzung von Realität durch Simulation | — (neues Phänomen) | ✓ (spezifisch für KI) |

🧷 Zeitliche Abfolge: Was kam zuerst — das Problem oder seine KI-Verstärkung

Das Problem toter Links ist Jahre vor ChatGPT und Diffusionsmodellen dokumentiert. Die Studie S003 analysiert ein Phänomen, das sich parallel zum Internet entwickelte. Aber Yildiz weist auf einen qualitativen Sprung hin: „Während Online-Diskussionen verschwinden und durch künstliche Synthesen ersetzt werden, verwandelt sich das, was Nutzer als 'digitales Gedächtnis' wahrnehmen, zunehmend in eine simulative Struktur" (S001).

Dies ist keine Fortsetzung des alten Problems des Zugangsverlusts. Es ist eine Transformation in eine neue Qualität: vom Verschwinden von Inhalten zu ihrer Ersetzung durch Simulation, die wie das Original aussieht.

Die zeitliche Abfolge ist hier kritisch. Wenn tote Links vor KI auftraten, kann KI nicht ihre einzige Ursache sein. Aber wenn KI die Natur des Problems qualitativ verändert hat — indem es Verlust in Substitution verwandelte — dann erfordert dies eine separate Analyse des Mechanismus und nicht nur der Korrelation.

Konflikte in der Evidenzbasis: Wo Quellen divergieren und was dies für die Zuverlässigkeit der Schlussfolgerungen bedeutet

🧩 Widerspruch zwischen dem Erfolg von Wikipedia als selbstorganisierendes System und seiner Unfähigkeit, das Problem toter Links zu lösen

(S006) beschreibt Wikipedia als „erfolgreiches Beispiel eines selbstverwalteten Teams", bei dem dezentralisierte Zusammenarbeit eine kohärente Datenstruktur schafft. Gleichzeitig dokumentiert (S003) das massive Problem „dauerhaft toter" Links, das dieses System nicht löst.

Der Widerspruch offenbart eine Limitation des Freiwilligenmodells: Es skaliert für die Erstellung von Inhalten, aber nicht für die systematische Überwachung von Millionen externer Links. Erfolg beim Editieren garantiert keinen Erfolg bei der Wartung. Mehr dazu im Abschnitt Psychologie des Glaubens.

- Dezentralisierte Koordination ist effektiv für synchrone Inhalte (Artikel, Bearbeitungen)

- Asynchrone Überwachung externer Quellen erfordert kontinuierliche Ressourcen und Automatisierung

- Freiwillige sind motiviert durch Erstellung, nicht durch technische Wartung

- Ergebnis: Inhalte wachsen, Infrastruktur degradiert parallel

🔎 Unsicherheit bei der Bewertung des Umfangs KI-generierter Inhalte

(S001) behauptet, dass „das Internet sich in einen Strom verwandelt hat, in dem oberflächliche und repetitive künstliche Inhalte dominieren". Präzise quantitative Schätzungen des Anteils von KI-Inhalten am Gesamtvolumen des Internets fehlen jedoch.

Dies schafft drei Probleme gleichzeitig: Das tatsächliche Ausmaß des Phänomens ist unklar, es ist unmöglich, begründete Bedenken von Panik zu trennen, und die Überprüfung der Behauptung über die Dominanz selbst wird erschwert.

Das Fehlen systematischer Messungen ist nicht nur eine Datenlücke. Es macht die Theorie resistent gegen Widerlegung: Jede Beobachtung kann als Bestätigung interpretiert werden, und das Fehlen von Beweisen als Verborgenheit des Problems.

🧱 Kluft zwischen technischer Forschung und soziokultureller Analyse

Technische Studien (S003) messen HTTP-Status, Fehlerrate, Degradationsmuster. Soziokulturelle Analysen (S001) diskutieren „digitales Gedächtnis", „simulative Strukturen", „künstliche Vergangenheit".

Beide Ansätze verwenden unterschiedliche Methodologien und Abstraktionsebenen. Technische Daten zeigen, dass Links brechen; kulturelle Analyse interpretiert dies als Erosion kollektiven Gedächtnisses. Die Verbindung zwischen den Ebenen ist nicht offensichtlich.

- Technische Realität

- Messbare Fakten: URL gibt 404 zurück, Domain gelöscht, Server nicht erreichbar. Methodologie: Audit, Logging, Statistik.

- Kulturelle Interpretation

- Abstrakte Konzepte: Gedächtnisverlust, Fragmentierung der Geschichte, Ersetzung der Realität durch Simulation. Methodologie: Hermeneutik, narrative Analyse.

- Kluft

- Technische Fakten übersetzen sich nicht automatisch in kulturelle Schlussfolgerungen. Es bedarf einer vermittelnden Kausalitätslogik, die oft übersprungen wird oder implizit bleibt. Kognitive Verzerrungen können die Interpretation in Richtung Katastrophismus verstärken.

Für die Zuverlässigkeit der Schlussfolgerungen ist eine explizite Begründung erforderlich: Warum bedeutet die Degradation technischer Infrastruktur genau die Erosion des Gedächtnisses und nicht einfach ein technisches Problem, das durch Backups und Archive gelöst wird.

Kognitive Anatomie der Theorie: Welche psychologischen Mechanismen das Narrativ vom toten Internet überzeugend machen

⚠️ Ausnutzung der Verfügbarkeitsheuristik

Menschen überschätzen die Wahrscheinlichkeit von Ereignissen, die sich leicht erinnern oder vorstellen lassen. Wenn ein Nutzer mehrere tote Links hintereinander oder offensichtlich KI-generierten Content sieht, werden diese prägnanten Beispiele kognitiv verfügbar und prägen den Eindruck vom Ausmaß des Problems. Mehr dazu im Abschnitt Kritisches Denken.

„Die Tatsache, dass generative Modelle manchmal ungeprüfte, fabrizierte oder aus dem Kontext gerissene Informationen produzieren, fügt eine zusätzliche Ebene der Unsicherheit hinzu" (S001). Diese Unsicherheit verstärkt die Besorgnis und macht die Theorie überzeugender, als objektive Daten rechtfertigen könnten.

Prägnante Beispiele ziehen Aufmerksamkeit nicht an, weil sie repräsentativ sind, sondern weil sie leicht erinnerbar sind. Diese Unterscheidung ist entscheidend für die Bewertung des Ausmaßes jedes Phänomens.

🧩 Appell an die Nostalgie nach dem „authentischen" Internet der Vergangenheit

Die Theorie resoniert mit dem Narrativ vom „goldenen Zeitalter" des frühen Internets – einer Zeit authentischeren Contents, gehaltvoller Diskussionen und weniger aggressiver Kommerzialisierung. „Heute ist das Internet kein Raum mehr, der die organischen Diskussionen der Vergangenheit bewahrt" (S001) – diese Aussage aktiviert nostalgische Gefühle.

Unabhängig von der Genauigkeit der Vorstellung über die Vergangenheit bildet sie eine mächtige psychologische Grundlage für die Akzeptanz der Theorie. Nostalgie funktioniert als emotionaler Anker, der die Annahme des Narrativs selbst bei schwachen Beweisen erleichtert.

🔁 Nutzung des Musters der „verborgenen Bedrohung" und verschwörungstheoretischen Denkens

Die Theorie ist als Enthüllung eines verborgenen Prozesses strukturiert, den die Mehrheit nicht bemerkt. Dies ist ein klassisches Muster: „Man sagt Ihnen X, aber in Wirklichkeit geschieht Y". Ildiz formuliert: „Während das echte Gedächtnis gelöscht wird, nimmt simuliertes Gedächtnis seinen Platz ein" (S001) – ein Prozess, der angeblich vor dem gewöhnlichen Nutzer verborgen bleibt.

Dieses Framing spricht jene an, die „Insiderwissen" schätzen und offiziellen Narrativen skeptisch gegenüberstehen. Das Vorhandensein einer verschwörungstheoretischen Struktur macht eine Behauptung nicht automatisch falsch, erfordert aber eine strengere Überprüfung der Beweise.

| Kognitiver Mechanismus | Wie er in der Theorie funktioniert | Warum das überzeugend ist |

|---|---|---|

| Verfügbarkeit | Prägnante Beispiele toter Links sind leicht erinnerbar | Emotionale Intensität erzeugt Illusion des Ausmaßes |

| Nostalgie | Vergleich mit dem „goldenen Zeitalter" des Internets | Emotionale Resonanz mit persönlicher Erfahrung |

| Muster der Verborgenheit | Bedrohung, die angeblich von Behörden/Konzernen verheimlicht wird | Aktiviert Misstrauen gegenüber offiziellen Quellen |

Das Verständnis dieser Mechanismen bedeutet nicht, dass die Theorie falsch ist. Es bedeutet, dass die Überzeugungskraft des Narrativs und seine Übereinstimmung mit den Fakten unterschiedliche Dinge sind. Kognitive Verzerrungen funktionieren gleichermaßen gut für wahre wie für falsche Behauptungen.

Ebenso nutzen verschwörungstheoretische Denkstrukturen dieselben psychologischen Hebel, unabhängig davon, ob sie reale verborgene Prozesse oder fiktive beschreiben. Die Unterscheidung wird nur durch Beweise überprüft, nicht durch psychologische Analyse der Attraktivität einer Idee.

Verifikationsprotokoll: Sieben Fragen, die jede unbegründete Behauptung über das tote Internet in zwei Minuten widerlegen

Jede Behauptung über das tote Internet durchläuft sieben Filter. Wenn mindestens drei nicht greifen – handelt es sich um Spekulation, nicht um Analyse.

✅ Frage eins: Werden konkrete quantitative Daten vorgelegt oder nur qualitative Eindrücke?

Die Behauptung muss auf messbaren Kennzahlen basieren: Prozentsatz toter Links, Umfang von KI-Inhalten in der Stichprobe, zeitliche Trends mit Datumsangaben. Eindrücke sind kein Beweis.

Wenn eine Quelle sagt „das Internet stirbt", aber nicht angibt, welcher Prozentsatz an Inhalten in welchem Zeitraum verschwunden ist – handelt es sich um ein Narrativ, nicht um Forschung.

✅ Frage zwei: Ist die Datenauswahl kontrolliert oder verzerrt?

Prüfen Sie: Haben die Autoren das gesamte Internet analysiert oder nur soziale Medien? Nur englischsprachige Inhalte oder mehrsprachige? Nur große Plattformen oder auch Nischen-Communities?

Eine verzerrte Stichprobe erzeugt die Illusion eines Trends. Kognitive Verzerrungen tarnen sich oft als Statistik.

✅ Frage drei: Werden Korrelation und Kausalität getrennt?

Das Wachstum von KI-Inhalten fällt mit dem Verschwinden von Links zusammen – aber das bedeutet nicht, dass KI sie löscht. Es gibt mögliche alternative Ursachen: Änderung von Suchalgorithmen, Schließung alter Websites, Migration von Inhalten auf neue Plattformen.

- Korrelation

- zwei Phänomene treten gleichzeitig auf

- Kausalität

- ein Phänomen verursacht direkt ein anderes – erfordert einen Mechanismus und den Ausschluss von Alternativen

✅ Frage vier: Gibt es widersprüchliche Daten, und wie werden sie erklärt?

Eine gute Analyse verbirgt keine Gegenbeweise – sie analysiert sie. Wenn eine Quelle Fakten ignoriert, die nicht ins Narrativ passen, ist das ein Warnsignal.

Prüfen Sie: Werden Studien (S001, S002) erwähnt, die ein Wachstum bei Archivierung und Backup von Inhalten zeigen?

✅ Frage fünf: Wer finanziert oder fördert diese Behauptung?

Das Interesse kann sein: akademisch (Publikation), kommerziell (Verkauf von Verifikationstools), ideologisch (Angst vor KI), sozial (Aufmerksamkeit erregen). Jedes Interesse verzerrt den Fokus.

Die Theorie des toten Internets ist praktisch für diejenigen, die Lösungen gegen KI-Inhalte verkaufen oder Panik um Technologien schüren.

✅ Frage sechs: Wird die Behauptung unabhängig überprüft oder nur zitiert?

Wenn alle Quellen aufeinander verweisen und die Originalstudie nicht verfügbar ist – befinden Sie sich in einer Echokammer. Finden Sie die Primärquelle und prüfen Sie deren Methodik.

Wie bei Verschwörungsnarrativen verbreitet sich das tote Internet oft durch eine Kette von Nacherzählungen ohne Verifikation.

✅ Frage sieben: Werden alternative Erklärungen angeboten oder nur ein Szenario?

Komplexe Phänomene haben selten eine einzige Ursache. Das Verschwinden von Inhalten kann das Ergebnis sein von: Schließung von Hosting-Diensten, Plattformwechsel, Löschung auf Anfrage, natürliche Veralterung, technische Ausfälle.

- Prüfen Sie, ob die Quelle alle Hypothesen berücksichtigt

- Bewerten Sie, welche davon die meisten Beweise hat

- Stellen Sie sicher, dass Alternativen ausgeschlossen und nicht einfach ignoriert wurden

Wenn die Analyse alle sieben Filter durchlaufen hat – handelt es sich nicht um Spekulation, sondern um eine begründete Schlussfolgerung. Wenn sie mindestens drei nicht besteht – ist es ein Narrativ, das als Wissenschaft getarnt ist.