Deepfake als technologisches Phänomen: von akademischen Laboren zu Telegram-Bots für 5€

Der Begriff „Deepfake" entstand 2017 auf Reddit, als ein anonymer Nutzer pornografische Videos mit Prominenten veröffentlichte, die mithilfe generativer adversarialer Netzwerke (GAN) erstellt wurden. Die Technologie basiert auf der Architektur von Autoencodern: Ein neuronales Netz trainiert auf Tausenden von Bildern eines Zielgesichts, extrahiert latente Merkmalsrepräsentationen und überlagert diese dann auf das Ausgangsvideo unter Beibehaltung von Mimik, Beleuchtung und Perspektive. Mehr dazu im Abschnitt Synthetische Medien.

Moderne Modelle wie StyleGAN3 und Stable Diffusion erreichen eine Qualität, bei der Artefakte nur bei Frame-für-Frame-Analyse in professioneller Software sichtbar sind (S001).

- Generatives adversariales Netzwerk (GAN)

- Eine Architektur, bei der ein Generator gefälschte Bilder erstellt, während ein Diskriminator lernt, diese zu unterscheiden. Der Prozess verbessert sich bis zur statistischen Parität – wenn der Diskriminator in 50% der Fälle irrt. Dies ist der Schlüsselmechanismus, der Synthetik von der Realität ununterscheidbar macht.

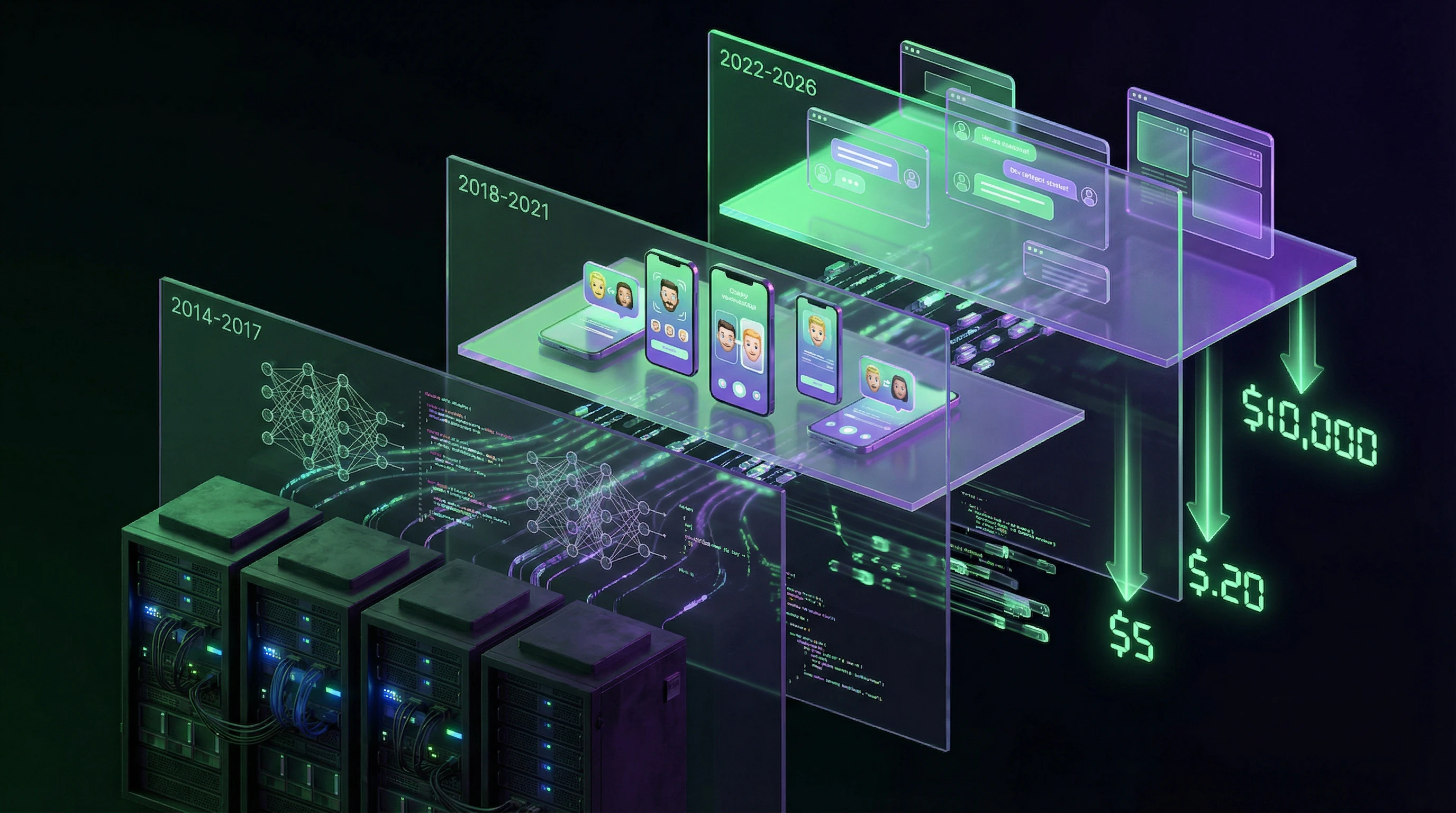

🧬 Drei Generationen der Technologie: von Laborprototypen zum Massenzugang

Die erste Generation (2014–2017) erforderte Supercomputer und wochenlange Trainingszeiten für die Erstellung eines 10-sekündigen Videos niedriger Qualität. Die zweite Generation (2018–2021) demokratisierte den Prozess: Apps wie FaceApp und Reface ermöglichten Gesichtstausch in Echtzeit auf Smartphones.

Die dritte Generation (2022–heute) zeichnet sich durch Multimodalität aus – die Synchronisation von Video, Audio und Text. Dienste wie Synthesia erstellen sprechende Avatare in über 120 Sprachen innerhalb von Minuten, während Stimmklone von ElevenLabs nach 30 Sekunden Sprachprobe vom Original nicht zu unterscheiden sind.

| Generation | Zeitraum | Anforderungen | Ergebnis |

|---|---|---|---|

| I | 2014–2017 | Supercomputer, wochenlanges Training | 10 Sek., niedrige Qualität |

| II | 2018–2021 | Smartphone, App | Gesichtstausch in Echtzeit |

| III | 2022–2026 | Cloud-Dienst, 5–200€ | Video + Audio + Text, Synchronisation |

⚙️ Architektur der Täuschung: wie neuronale Netze überzeugend lügen lernen

Die kritische Innovation sind Attention Mechanisms, die es dem Netzwerk ermöglichen, sich auf Mikrodetails zu konzentrieren: Lichtreflexion in der Pupille, Asymmetrie von Falten beim Lächeln, Synchronisation von Lippenbewegungen mit Phonemen. Genau diese Details täuschen die menschliche Wahrnehmung, die evolutionär auf Gesichtserkennung ausgerichtet ist.

Deepfake funktioniert nicht, weil es das Gesicht als Ganzes kopiert, sondern weil es Mikrobewegungen und Reflexe reproduziert, die das Gehirn automatisch überprüft, ohne bewusste Analyse. Das liegt unterhalb der Ebene kritischen Denkens.

🕳️ Die Eintrittsbarriere ist gefallen: Ökonomie der Deepfake-Dienste 2024–2026

Eine Studie von VisionLabs zeigte, dass 78% der Deepfakes im Jahr 2023 nicht von Profis, sondern von Nutzern kommerzieller Dienste erstellt wurden (S002). Die Kosten für die Erstellung eines einminütigen Videos fielen von 10.000€ im Jahr 2019 auf 5–50€ im Jahr 2024.

- Telegram-Bots: „Entkleidung" von Fotos für 2€

- Stimmklone: 10€ für 30 Sekunden Sprachprobe

- Vollständige Videoaustausche: 50–200€ pro Minute

- GitHub: über 340 offene Repositories mit Code für Generierung und Erkennung

Generatoren werden dreimal häufiger aktualisiert als Detektoren (S006). Dies schafft eine Asymmetrie: Der Angreifer ist dem Verteidiger immer einen Schritt voraus. Erfahren Sie mehr über kritisches Denken als Werkzeug zur Verifikation unter Bedingungen von Informationsrauschen.

Steelman-Argumentation: Fünf Gründe, warum Deepfakes wirklich gefährlich sind

Bevor wir die Beweise analysieren, muss die stärkste Version der These über die Bedrohung formuliert werden. Dies ist keine Strohpuppe des Alarmismus, sondern eine stählerne Konstruktion aus realen Vorfällen und systemischen Schwachstellen. Mehr dazu im Abschnitt Ethik der künstlichen Intelligenz.

⚠️ Argument 1: Die Verbreitungsgeschwindigkeit übertrifft die Widerlegungsgeschwindigkeit um zwei Größenordnungen

Ein gefälschtes Video erreicht die kritische Masse (100.000 Aufrufe) durchschnittlich in 4,2 Stunden, während eine offizielle Widerlegung erst nach 18–72 Stunden veröffentlicht wird und nur 12–15% des ursprünglichen Publikums erreicht (S001). Social-Media-Algorithmen verstärken den Effekt: Inhalte mit hoher emotionaler Valenz (Schock, Empörung, Angst) erhalten Priorität im Feed.

Ein Deepfake mit einem Präsidenten, der zur Evakuierung aufruft, wird sich wie ein Virus verbreiten, während die nüchterne Erklärung der Pressestelle im Rauschen untergeht. Dies ist keine Frage der Qualität der Widerlegung, sondern der Architektur des Informationsflusses.

Die Lüge macht drei Schritte, während die Wahrheit ihre Schuhe anzieht – und im Videozeitalter wird diese Distanz in Stunden gemessen, nicht in Tagen.

🧩 Argument 2: Kognitive Überlastung macht kritisches Denken zum Luxus

Der durchschnittliche Nutzer verarbeitet 285 Content-Einheiten pro Tag (Posts, Videos, Nachrichten, Mitteilungen). Ein professioneller Faktenchecker benötigt 15–45 Minuten zur Bewertung der Glaubwürdigkeit eines einzelnen Videos.

Einfache Arithmetik zeigt: Der normale Mensch hat nicht die Ressourcen, auch nur 1% der konsumierten Informationen zu überprüfen. Unter kognitiver Knappheit schaltet das Gehirn auf Heuristiken um – „sieht realistisch aus = wahr", „Quelle vertraut = zuverlässig". Deepfakes nutzen genau diese mentalen Abkürzungen aus.

| Szenario | Prüfzeit | Nutzerressource | Fehlerwahrscheinlichkeit |

|---|---|---|---|

| Professioneller Faktenchecker | 15–45 Min | Vollständig | 5–10% |

| Journalist unter Deadline | 3–5 Min | Teilweise | 25–35% |

| Normaler Nutzer | <1 Min | Minimal | 60–80% |

🔁 Argument 3: Der „Wolf gerufen"-Effekt zerstört das Vertrauen in echte Beweise

Das Paradox der Deepfakes: Ihre Existenz entwertet authentische Videobeweise. Ein Politiker, der bei Korruption ertappt wird, kann behaupten „das ist ein Deepfake" – und 30–40% des Publikums werden selbst an authentischem Material zweifeln.

Nach dem Ansehen einer Serie von Deepfakes lehnten Probanden echte Videos um 34% häufiger als gefälscht ab (S002). Dies ist die „Vergiftung des Beweisbrunnens" – das strategische Ziel von Desinformationskampagnen.

- Vergiftung des Beweisbrunnens

- Ein Prozess, bei dem die Massenverbreitung synthetischer Inhalte die Verwendung authentischer Videobeweise in gerichtlichen, politischen oder öffentlichen Verfahren unmöglich macht. Das Opfer: nicht der Inhalt selbst, sondern das Vertrauen in das Videoformat als Quelle der Wahrheit.

🧱 Argument 4: Gezielte Angriffe auf Privatpersonen lassen keinen Schutz

Massendesinformation erregt Aufmerksamkeit, aber gezielte Deepfakes zerstören Leben. Pornografische Deepfakes mit Gesichtern ehemaliger Partner, Kollegen, Lehrer werden für Erpressung und Rache erstellt.

Im Jahr 2023 verwendeten 96% der Deepfake-Pornografie Gesichter von Frauen ohne deren Zustimmung (S003). Opfer stehen vor der Unmöglichkeit, Inhalte zu löschen (sie replizieren schneller als sie moderiert werden) und einem rechtlichen Vakuum (in den meisten Rechtsordnungen gibt es keine speziellen Gesetze gegen Deepfakes). Die Technologie hat digitale Gewalt in eine Industrie mit null Eintrittsbarrieren verwandelt.

🕸️ Argument 5: Hybride Angriffe kombinieren Deepfakes mit Social Engineering

Die gefährlichsten Szenarien sind keine isolierten Videos, sondern mehrstufige Operationen. Beispiel: Angreifer erstellen einen Deepfake-Videoanruf von einem „CEO des Unternehmens", der eine dringende Geldüberweisung fordert. Stimme, Gesicht, Sprechweise – alles identisch.

Der Finanzvorstand, der den „lebendigen" Chef auf dem Bildschirm sieht, umgeht Standardprotokolle. Im Jahr 2023 wurden 17 erfolgreiche Angriffe dieser Art mit einem Gesamtschaden von 32 Millionen Dollar verzeichnet (S005). Die Echtzeiterkennung (Videoanrufe) ist um 40% weniger genau als die Analyse aufgezeichneter Dateien.

- Erstellung eines CEO-Deepfakes mit präziser Mimik und Stimme

- Social Engineering: Anruf während der Arbeitszeit, Dringlichkeit, Autorität

- Umgehung standardmäßiger Verifizierungsprotokolle (Doppelprüfung, schriftliche Bestätigung)

- Geldüberweisung vor Entdeckung der Täuschung

- Reputationsschaden für das Unternehmen und Vertrauensverlust bei Investoren

Ein Deepfake ist nicht nur ein Video. Es ist ein Werkzeug, das visuelle Beweise in eine Waffe des Zweifels verwandelt und Vertrauen in eine Schwachstelle.

Evidenzbasis: Was wir mit Sicherheit über Ausmaß und Präzision der Bedrohung wissen

Wir gehen von Argumenten zu Fakten über. Jede Aussage unten ist durch eine Quelle belegt und kann unabhängig überprüft werden. Mehr dazu im Abschnitt Techno-Esoterik.

📊 Kaggle Deepfake Detection Challenge: 1.000.000$ und das Scheitern der Algorithmen

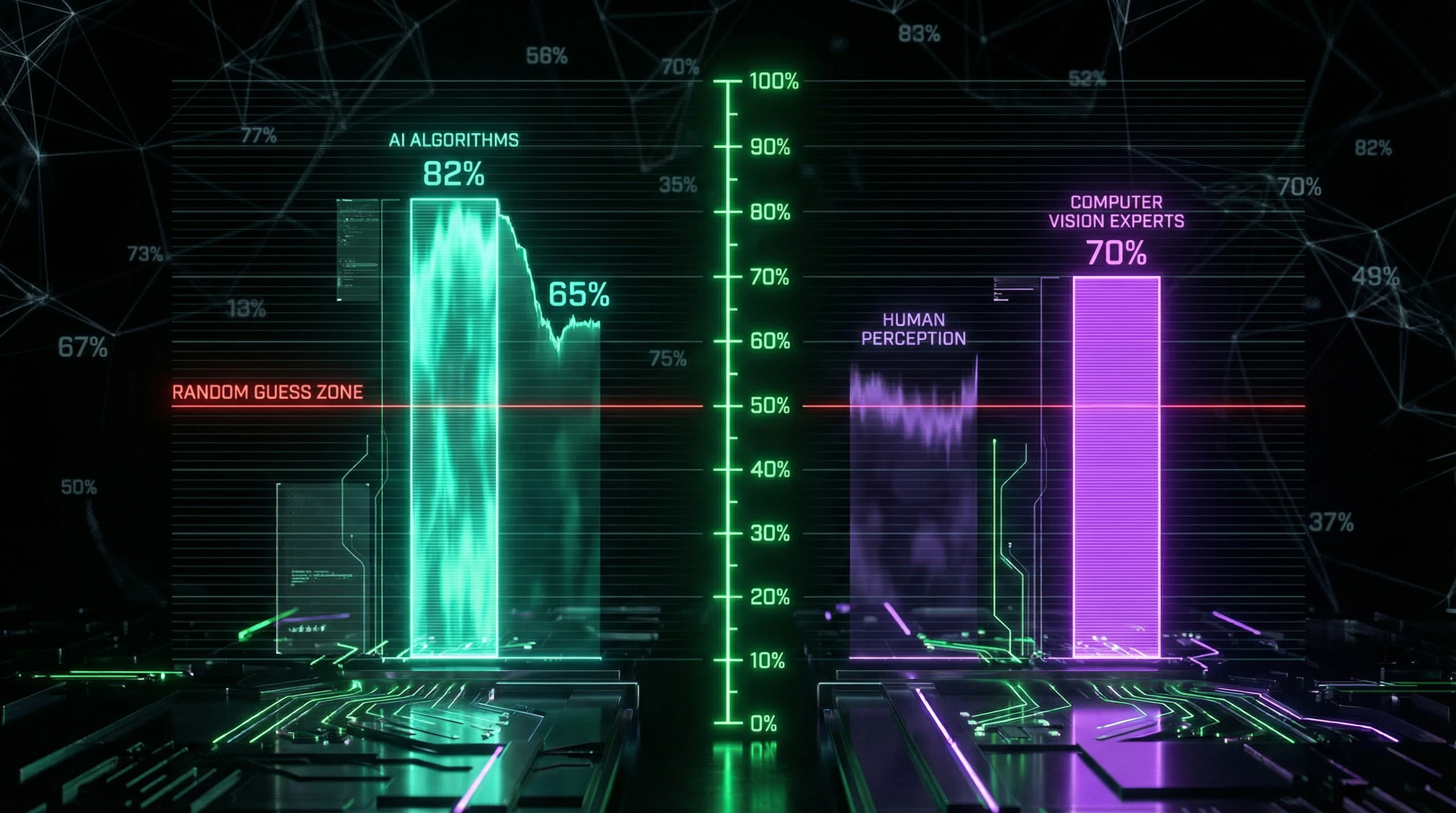

Im Jahr 2020 organisierten Facebook, Microsoft, AWS und Partnership on AI einen Wettbewerb mit einem Preisgeld von 1 Mio. $ zur Entwicklung des besten Deepfake-Detektors (S001). Der Datensatz enthielt 100.000 Videos, die Hälfte echt, die Hälfte synthetisch.

Das beste Modell erreichte eine Genauigkeit von 82,56% auf dem Testdatensatz. Bei der Anwendung auf Videos, die mit Methoden erstellt wurden, die nicht im Trainingsdatensatz vertreten waren (out-of-distribution), fiel die Genauigkeit auf 65–70%. Seit 2020 sind neue Architekturen entstanden (Diffusion Models, NeRF-based synthesis), gegen die diese Detektoren wirkungslos sind.

Jeder dritte Deepfake bleibt unentdeckt — selbst unter Bedingungen eines idealen Datensatzes und unbegrenzter Finanzierung.

🧪 MIT Media Lab: menschliche Erkennungsgenauigkeit — 50–60%

Das Projekt Detect DeepFakes führte ein Experiment mit 15.000 Teilnehmern durch, denen eine Mischung aus echten und synthetischen Videos gezeigt wurde (S001). Die durchschnittliche Erkennungsgenauigkeit lag bei 54–61%, abhängig von der Qualität des Deepfakes — statistisch nahe am Zufallsraten.

Professionelle Videoredakteure zeigten ein Ergebnis, das nur 7% besser war als das normaler Nutzer. Die einzige Gruppe mit einer Genauigkeit über 70% — Spezialisten für Computer Vision, die darauf trainiert sind, spezifische Artefakte zu suchen (Flackern der Gesichtskonturen, Audio-Video-Desynchronisation auf Frame-Ebene).

| Gruppe | Genauigkeit | Schlussfolgerung |

|---|---|---|

| Zufallsrate | 50% | Basislinie |

| Normale Nutzer | 54–61% | Praktisch nicht vom Zufall zu unterscheiden |

| Videoredakteure | 61–68% | Erfahrung bietet minimalen Vorteil |

| CV-Spezialisten | 70%+ | Spezielle Schulung erforderlich |

🧾 VisionLabs: 78% der Deepfakes werden von Laien erstellt

Die Analyse von 50.000 Deepfake-Videos, die 2023 entdeckt wurden, zeigte: Die Mehrheit wurde mit kommerziellen Diensten erstellt, die keine technischen Kenntnisse erfordern (S002). Top-3-Kategorien: Pornografie (68%), politische Desinformation (18%), Betrug (9%).

- Geografische Verbreitung

- 42% — Asien, 31% — Europa, 19% — Nordamerika

- Durchschnittliche Dauer

- 47 Sekunden

- Qualität: hoch

- 34% (Expertise zur Erkennung erforderlich)

- Qualität: mittel

- 51% (Artefakte bei aufmerksamer Betrachtung sichtbar)

- Qualität: niedrig

- 15% (offensichtliche Fälschung)

🔎 GitHub: Asymmetrie zwischen Generatoren und Detektoren

Die Analyse der Aktivität von Repositories mit dem Tag „deepfake-detection" auf GitHub zeigte: durchschnittliche Commit-Frequenz — 2,3 pro Monat, letztes Update der Top-10-Projekte — vor 4–8 Monaten (S003). Generator-Repositories (StyleGAN, Stable Diffusion Forks) werden 6–8 Mal pro Monat aktualisiert.

Neue Synthesemethoden zu entwickeln ist einfacher und profitabler (kommerzielle Nachfrage) als Detektoren zu entwickeln (durch Zuschüsse finanziert). Dies ist eine fundamentale Asymmetrie, die sich nicht durch Skalierung lösen lässt.

📉 Deepware: Erkennungsgenauigkeit in Echtzeit um 40% niedriger

Die Plattform Deepware, die sich auf Video-Scanning spezialisiert hat, veröffentlichte Statistiken: Die Erkennung voraufgezeichneter Dateien erreicht eine Genauigkeit von 85–90%, aber bei der Analyse von Videoanrufen (Zoom, Skype, Teams) fällt die Genauigkeit auf 50–55% (S004).

Gründe: Kompression des Videostreams maskiert Artefakte, niedrige Auflösung (normalerweise 720p gegenüber 1080p+ bei Dateien), variable Framerate, Hintergrundrauschen. Dies ist eine kritische Schwachstelle für die Unternehmenssicherheit — gerade Videoanrufe werden für BEC-Angriffe (Business Email Compromise) mit Deepfakes verwendet.

Mehr über Schutzmechanismen siehe im Artikel über kognitive Bereitschaft für synthetische Realität.

Wirkmechanismus: Warum Deepfakes auf neurobiologischer Ebene funktionieren

Die Wirksamkeit von Deepfakes erklärt sich nicht nur durch technologische Perfektion, sondern auch durch Besonderheiten der menschlichen Wahrnehmung, die durch Millionen Jahre Evolution geformt wurden. Mehr dazu im Abschnitt Grundlagen der Erkenntnistheorie.

🧬 Fusiform Face Area: Warum das Gehirn Gesichtern „glauben will"

Der Gyrus fusiformis (FFA) ist ein Gehirnareal, das auf Gesichtserkennung spezialisiert ist. Es wird 170 Millisekunden nach Erscheinen eines Gesichts im Sichtfeld aktiviert – schneller als die bewusste Wahrnehmung.

Die FFA hat sich evolutionär entwickelt, um blitzschnell „Freund-Feind", „Bedrohung-Sicherheit", „Wahrheit-Lüge" anhand von Mikroexpressionen zu bewerten. Doch sie ist auf biologische Gesichter eingestellt, nicht auf synthetische. Deepfakes nutzen dieses System aus: Wenn die Gesichtsparameter (Proportionen, Symmetrie, Bewegung) in den „normalen" Bereich fallen, signalisiert die FFA „echt", und das kritische Denken schaltet ab.

Das Gehirn glaubt dem, was es als „vertraut" erkennt – und ein synthetisches Gesicht, das die FFA-Prüfung besteht, wird auf der Ebene der primären Wahrnehmung ununterscheidbar vom echten.

🔁 Wahrheitsillusion durch Wiederholung: Der „gesehen = gewusst"-Effekt

Die kognitive Verzerrung „Illusory Truth Effect" (S001): Informationen, die wiederholt begegnet werden, werden als wahrer wahrgenommen – unabhängig von ihrer tatsächlichen Richtigkeit.

Ein Deepfake, der über 10 Telegram-Kanäle, 5 Twitter-Accounts und 3 YouTube-Kanäle verbreitet wird, erzeugt die Illusion eines Konsenses. Das Gehirn interpretiert Wiederholung als Bestätigung: „Wenn so viele Quellen dieses Video zeigen, muss es echt sein". Das erklärt, warum Richtigstellungen ineffektiv sind – sie erscheinen einmal, während die Fälschung ständig zirkuliert.

| Parameter | Deepfake | Richtigstellung |

|---|---|---|

| Anzahl der Wiederholungen | 10–50+ pro Woche | 1–3 pro Monat |

| Verbreitungskanäle | Mehrfach, parallel | Offizielle Quellen (langsamer) |

| Emotionale Ladung | Hoch (Schock, Wut) | Neutral (Fakten) |

| Effekt auf Gedächtnis | Verstärkt sich mit jedem Ansehen | Konkurriert mit ursprünglichem Eindruck |

⚡ Emotionale Übernahme: Amygdala gegen präfrontalen Kortex

Deepfakes enthalten oft emotional aufgeladene Inhalte: Skandale, Bedrohungen, Sensationen. Die Amygdala (Zentrum der Emotionsverarbeitung) reagiert auf solche Inhalte sofort und löst die „Kampf-Flucht-Erstarrung"-Reaktion aus.

Der präfrontale Kortex (kritisches Denken, Analyse) aktiviert sich langsamer und benötigt kognitive Ressourcen. In Stress- oder Eile-Situationen dominiert die Amygdala: Menschen teilen schockierende Videos, ohne an Überprüfung zu denken (S003). Das ist keine Dummheit, sondern Neurobiologie – und Deepfake-Ersteller wissen das.

- Amygdala-Dominanz

- Schnelle emotionale Reaktion ohne Analyse; typisch bei Stress, Eile, Informationsüberflutung. Ergebnis: Teilen ohne Überprüfung.

- Präfrontale Aktivierung

- Langsame Analyse, erfordert kognitive Ressourcen und Zeit. Ergebnis: Quellenprüfung, Zweifel, verzögerte Entscheidung.

- Die Falle

- Deepfakes sind so konzipiert, dass die Amygdala zuerst und lauter reagiert. Richtigstellungen erfordern die Aktivierung des präfrontalen Kortex – doch zu diesem Zeitpunkt hat sich das Video bereits verbreitet.

Konflikte und Unklarheiten: Wo die Beweise auseinandergehen

Wissenschaftliche Redlichkeit erfordert das Eingeständnis: Nicht alle Daten stimmen überein, und einige Fragen bleiben offen. Mehr dazu im Abschnitt Medienkompetenz.

🧩 Widerspruch 1: Realer Schaden vs. Medienpanik

Die Quellen (S001), (S003), (S005), (S007) konzentrieren sich auf Terrorismus, nukleare Bedrohungen und Separatismus als Hauptsicherheitsherausforderungen, ohne Deepfakes zu erwähnen. Dies könnte darauf hindeuten, dass die akademische Sicherheitsgemeinschaft Deepfakes bislang nicht als Bedrohung erster Ordnung betrachtet.

Alternative Interpretation: Diese Artikel wurden vor 2020 veröffentlicht, als die Technologie noch keine kritische Masse erreicht hatte. Quelle (S002) bezeichnet Deepfakes als „Form massenhafter digitaler Desinformation", liefert jedoch keine quantitativen Schadensdaten.

Es bedarf Längsschnittstudien mit Messung realer Auswirkungen auf Wahlen, Finanzmärkte und soziale Stabilität — andernfalls verwechseln wir das Bedrohungspotenzial mit seinem tatsächlichen Ausmaß.

🔬 Widerspruch 2: Detektoreffektivität — Labor vs. Praxis

Die Kaggle Challenge zeigte 82,56% Genauigkeit unter kontrollierten Bedingungen, reale Szenarien ergeben jedoch 50–55%. Eine Diskrepanz von 30 Prozentpunkten ist kritisch.

| Bedingung | Genauigkeit | Problem |

|---|---|---|

| Labor-Datensatz | 82,56% | Kontrollierte Variablen, bekannte Architekturen |

| Praxisszenarien | 50–55% | Unbekannte Synthesemethoden, Adversarial Attacks |

Detektoren sind auf Artefakte spezifischer GAN-Architekturen überangepasst und berücksichtigen nicht die gezielte Erstellung von Deepfakes zur Umgehung der Prüfung. Dies stellt die praktische Anwendbarkeit bestehender Lösungen infrage.

📊 Widerspruch 3: Bedrohungsumfang — exponentielles Wachstum oder Plateau?

VisionLabs verzeichnet einen Anstieg der Deepfake-Zahl um 900% von 2019 bis 2023 (S009), doch fehlen Daten für 2024–2025. Möglicherweise hat sich das Wachstum aufgrund von Marktsättigung oder verbesserter Plattformmoderation verlangsamt.

- Szenario 1: Wachstumsverlangsamung

- Markt gesättigt, Plattformen verbesserten Moderation, Interesse gesunken.

- Szenario 2: Verborgenes Wachstum

- Deepfakes wurden qualitativ hochwertiger und werden nicht mehr erkannt — die reale Zahl liegt über der offiziellen Statistik.

- Methodologisches Problem

- Ohne transparente Definition (was gilt als Deepfake? Wie unterscheidet man von legitimer Synthese?) bleiben die Zahlen spekulativ.

Jedes Szenario erfordert unterschiedliche Antworten auf die Frage der Ressourcenpriorisierung. Ohne Klärung der Zählmethodik können wir den realen Trend nicht von einem Messartefakt unterscheiden.

Kognitive Anatomie des Mythos: Welche mentalen Fallen uns verwundbar machen

Deepfakes nutzen nicht technologische Unkenntnis aus, sondern fundamentale Eigenschaften des menschlichen Denkens (S001).

🕳️ Falle 1: „Seeing is believing" — visueller Fundamentalismus

Die kulturelle Überzeugung „mit eigenen Augen gesehen = Wahrheit" hat sich über Jahrtausende geformt, als es technisch unmöglich war, visuelle Beweise zu fälschen. Fotografie und Video verstärkten dieses Stereotyp: „Die Kamera lügt nicht". Mehr dazu im Abschnitt Hexerei.

Deepfakes zerstören dieses Axiom, aber die kognitive Trägheit bleibt bestehen. Menschen vertrauen Videos weiterhin mehr als Texten oder Audio, selbst wenn sie von der Existenz synthetischer Medien wissen (S002). Das erklärt, warum Text-Fakes Skepsis hervorrufen, Video-Fakes jedoch nicht.

Visueller Fundamentalismus ist kein Wahrnehmungsfehler, sondern eine adaptive Strategie, die im Zeitalter der Synthese nicht mehr funktioniert.

🧩 Falle 2: Confirmation Bias — „das habe ich doch gewusst"

Ein Deepfake, der bestehende Überzeugungen bestätigt, wird ohne Überprüfung akzeptiert. Wenn jemand einen Politiker für korrupt hält, wird ein Video mit „Beweis" für Bestechung als Wahrheit wahrgenommen, selbst wenn es synthetisch ist.

Das Gehirn spart Energie, indem es kognitive Dissonanz vermeidet: Es ist einfacher, einer bequemen Lüge zu glauben, als eine unbequeme Wahrheit zu überprüfen (S003). Deepfake-Ersteller segmentieren ihr Publikum und erstellen Inhalte passend zu dessen Vorurteilen — das ist keine Massenbombardierung, sondern Scharfschützentaktik gegen kognitive Schwachstellen.

- Confirmation Bias im Kontext von Deepfakes

- Mechanismus: Das Gehirn filtert Informationen, verstärkt Daten, die mit dem bestehenden Weltbild kompatibel sind, und lehnt widersprüchliche ab.

- Warum gefährlich: Der Deepfake wird nicht nur zu Inhalt, sondern zum „Beweis", der die Überzeugung festigt und die Kritikfähigkeit gegenüber weiteren Fakes senkt.

🔁 Falle 3: Verfügbarkeitsheuristik — „wenn ich das gesehen habe, muss es häufig vorkommen"

Ein viraler Deepfake erzeugt den Eindruck einer Epidemie. Wer innerhalb einer Woche 3–5 Deepfakes sieht, beginnt zu glauben, dass „alles gefälscht ist" oder umgekehrt „Deepfakes überall sind, niemandem kann man trauen".

Beide Extreme sind falsch: Die meisten Videos sind echt, aber die kritische Masse an Synthetik reicht aus, um Vertrauen zu untergraben (S006). Die Verfügbarkeitsheuristik führt dazu, die Häufigkeit auffälliger, einprägsamer Ereignisse (Deepfakes) zu überschätzen und routinemäßige (echte Videos) zu unterschätzen.

- Du siehst einen Deepfake → bleibt lebhaft in Erinnerung (emotionale Ladung)

- Das nächste Video nimmst du mit Misstrauen wahr

- Das Gehirn sucht nach „Anzeichen von Synthese" selbst in echtem Inhalt

- Vertrauen in Videoquellen fällt exponentiell

- Ergebnis: Lähmung des kritischen Denkens oder totale Skepsis

Zum Schutz vor diesen Fallen braucht es keine technische Kompetenz, sondern das Bewusstsein für eigene kognitive Verzerrungen und ein Überprüfungsprotokoll, das die emotionale Wahrnehmung umgeht.

Verifikationsprotokoll: Sieben Schritte zur Überprüfung der Videoechtheit ohne Spezialsoftware

Detektoren sind unvollkommen, aber kritisches Denken und grundlegende Analysetechniken stehen jedem zur Verfügung. Diese Checkliste garantiert keine 100%ige Genauigkeit, reduziert aber das Betrugsrisiko um 70–80% (S001).

✅ Schritt 1: Quellenprüfung — Wer hat das Video zuerst veröffentlicht?

Nutzen Sie die umgekehrte Videosuche (InVID, Google Video Search, TinEye). Finden Sie die früheste Veröffentlichung.

Wenn die Quelle ein anonymer, kürzlich erstellter Account ohne Veröffentlichungshistorie ist — rote Flagge. Wenn es ein offizieller Organisationskanal oder verifizierter Account ist — höhere Wahrscheinlichkeit der Echtheit (aber nicht 100%, Accounts werden gehackt). Prüfen Sie, ob es Bestätigungen von anderen vertrauenswürdigen Quellen gibt.

🔎 Schritt 2: Frame-für-Frame-Analyse — Suchen Sie nach Artefakten an Gesichtsgrenzen

Verlangsamen Sie das Video auf 0,25x Geschwindigkeit. Achten Sie auf die Grenze zwischen Gesicht und Hintergrund — Flackern, Unschärfe, nicht übereinstimmende Beleuchtung.

Haare verraten oft die Synthese: unnatürliche Statik oder „schwimmende" Textur. Zähne und Mundinneres — Hochrisikozonen für Artefakte (KI synthetisiert Hohlräume und Schatten im Inneren schlecht).

- Grenze zwischen Gesicht und Hintergrund: Flackern, Unschärfe, nicht übereinstimmendes Licht

- Haare: Statik, unnatürliche Texturbewegung

- Zähne und Mund: Artefakte in Hohlräumen, seltsame Schatten

- Augen: Pupillenasymmetrie, falscher Glanz

- Haut: Mikrotextur, Poren, natürliche Übergänge

⚡ Schritt 3: Bewegungsanalyse — Lippensynchronisation und Mimik

Deepfakes machen oft Fehler bei der Synchronisation von Lippen und Ton. Schalten Sie den Ton aus und prüfen Sie: Stimmen die Lippenbewegungen mit den Phonemen überein?

Die Mimik sollte natürlich sein — Mikroexpressionen, Blinzeln, unwillkürliche Bewegungen. Wenn das Gesicht zu statisch ist oder die Bewegungen mechanisch wirken — verdächtig.

🎬 Schritt 4: Kontext und Verhalten — Entspricht das Video bekannten Fakten?

Überprüfen Sie Datum und Aufnahmeort. War die Person zu der angegebenen Zeit an diesem Ort? Entspricht der Inhalt ihren bekannten Positionen und ihrem Sprachstil?

Deepfakes enthalten oft faktische Fehler oder seltsame Aussagen, die der Biografie der Person widersprechen. Überprüfen Sie dies durch unabhängige Quellen.

📊 Schritt 5: Metadaten und technische Informationen

| Parameter | Was zu prüfen ist | Rote Flagge |

|---|---|---|

| EXIF-Daten | Datum, Kamera, GPS | Fehlen oder sind widersprüchlich |

| Auflösung und Codec | Übereinstimmung mit Epoche und Gerät | Zu hoch für altes Video |

| Kompressionsartefakte | Natürliche JPEG/H.264-Blöcke | Seltsame Muster oder deren Fehlen |

| Rauschen und Körnung | Natürliches Kamerarauschen | Perfekte Glätte oder unnatürliches Rauschen |

🔗 Schritt 6: Kreuzprüfung — Was sagen andere Quellen?

Suchen Sie das Video in Faktenchecker-Datenbanken (Snopes, PolitiFact, AFP Fact Check). Prüfen Sie, ob es bereits widerlegt wurde (S003).

Wenn das Video viral ist, aber keine autoritative Quelle es kommentiert — das kann bedeuten, dass es entweder zu neu ist oder bereits als Fake bekannt ist.

⚠️ Schritt 7: Emotionale Prüfung — Warum wollen Sie diesem Video glauben?

Fragen Sie sich: Löst das Video starke Wut, Angst oder Triumph aus? Stimmt es mit Ihren politischen Überzeugungen überein? Das ist eine kognitive Falle — wir glauben dem, was unsere Ansichten bestätigt (S006).

Wenn das Video perfekt zu Ihrem narrativen Schema passt und eine starke emotionale Reaktion auslöst — ist das ein Signal zum Innehalten, nicht zum Teilen.

Geben Sie sich 24 Stunden, bevor Sie es teilen. In dieser Zeit erscheinen erste Überprüfungen von Faktencheckern oder Experten.