🔍 Deepfake-Erkennung

🔍 Deepfake-ErkennungTechnologien zur Erkennung synthetischer Medien und Schutz vor Deepfakesλ

Künstliche Intelligenz erstellt realistische Video- und Audio-Fälschungen, doch dieselben Technologien helfen dabei, diese zu erkennen und die digitale Authentizität von Inhalten zu schützen

Overview

Deepfakes — synthetische Mediendateien, erstellt durch neuronale Netze: 🧬 Sie imitieren Stimme, Gesicht und Manierismen realer Personen mit erschreckender Präzision. Die Verfügbarkeit von KI-Tools hat das Problem von einem Labor- zu einem Massenphänomen gemacht — von politischen Manipulationen bis zur Erpressung von Privatpersonen. Die Erkennung nutzt maschinelles Lernen zur Suche nach Artefakten: Unstimmigkeiten in Beleuchtung, Mikrobewegungen des Gesichts, Audiosignalen — doch jede Verbesserung der Abwehr provoziert eine neue Angriffswelle.

🛡️

Laplace-Protokoll: Die Verifizierung digitaler Inhalte erfordert einen mehrschichtigen Ansatz, der automatisierte Analyse mit Expertenbewertung und kryptografischen Methoden zur Bestätigung der Quellauthentizität kombiniert.

Reference Protocol

Wissenschaftliche Grundlage

Evidenzbasierter Rahmen für kritische Analyse

Protocol: Evaluation

Teste Dich

Quiz zu diesem Thema kommt bald

Sector L1

Artikel

Forschungsmaterialien, Essays und tiefe Einblicke in die Mechanismen des kritischen Denkens.

🔍 Deepfake-Erkennung

🔍 Deepfake-Erkennung 🔍 Deepfake-Erkennung

🔍 Deepfake-Erkennung⚡

Vertiefung

Wie generative Netzwerke synthetische Gesichter erzeugen, die von echten nicht zu unterscheiden sind

Deepfakes basieren auf Deep-Learning-Architekturen, die fotorealistische Bilder und Videos durch Analyse Tausender Beispiele synthetisieren können. Moderne Methoden haben ein Qualitätsniveau erreicht, bei dem das menschliche Auge oft nicht in der Lage ist, eine Fälschung ohne spezielle Werkzeuge zu erkennen.

Das Verständnis der Generierungsmechanismen ist der erste Schritt zur Entwicklung effektiver Detektionssysteme. Dies ist keine Frage technischer Neugier: Jede neue Synthesemethode schafft einen neuen Angriffsvektor.

Generative Adversarial Networks (GAN)

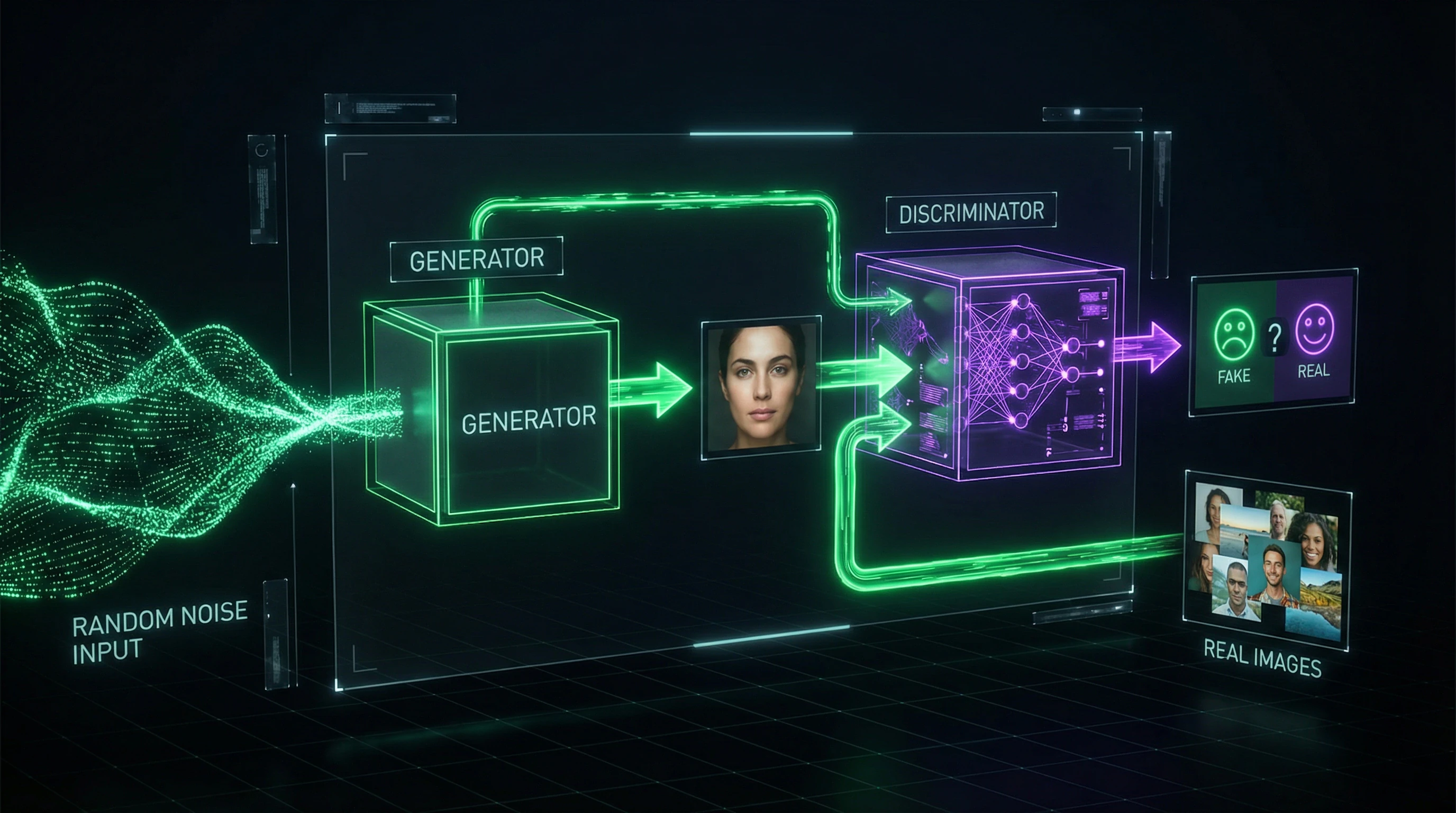

GANs bestehen aus zwei neuronalen Netzen: einem Generator, der synthetische Bilder erstellt, und einem Diskriminator, der versucht, diese von echten zu unterscheiden. Während des Trainingsprozesses verbessert sich der Generator, bis der Diskriminator Fälschungen nicht mehr erkennen kann.

| Architektur | Auflösung | Zentrale Schwachstelle |

|---|---|---|

| StyleGAN2 | bis 1024×1024 | Artefakte in hochfrequenten Komponenten |

| StyleGAN3 | bis 1024×1024 | Spektrale Anomalien bei Texturanalyse |

Moderne Modelle bewahren feinste Details von Hauttextur, Haaren und Iris, doch gerade diese Detailgenauigkeit erzeugt vorhersagbare Muster in der Spektralanalyse.

Autoencoder und Face-Swap-Algorithmen

Autoencoder komprimieren ein Gesichtsbild in eine kompakte latente Repräsentation und rekonstruieren es dann mit den Merkmalen einer anderen Person. Face-Swap-Technologie verwendet zwei Autoencoder: einer wird auf das Quellgesicht trainiert, der andere auf das Zielgesicht, wobei sie einen gemeinsamen Encoder teilen.

- DeepFaceLab und FaceSwap

- Benötigen 2000–10000 Frames für qualitativ hochwertige Ergebnisse. Sie ermöglichen die Übertragung von Ausdrücken und Bewegungen von einem Gesicht auf ein anderes unter Beibehaltung der Zielidentität.

- Kritischer Fehlerpunkt

- Diskrepanzen zwischen Gesichtsgeometrie und Beleuchtung im Ausgangsvideo verraten oft die Fälschung bei der Analyse von Schatten und Reflexionen.

Sprachsynthese und Voice Cloning

Stimmen-Deepfakes werden durch Modelle wie Tacotron 2 und WaveNet erstellt, die Text in Sprache mit den Intonationen einer bestimmten Person umwandeln. Moderne Systeme benötigen nur 5–10 Minuten Audioaufnahme, um eine Stimme mit akzeptabler Qualität zu klonen.

- Voice-Conversion-Technologie verändert Timbre und Akzent unter Beibehaltung des linguistischen Inhalts

- Die Hauptschwachstelle synthetischer Sprache ist das Fehlen von Mikrovariationen im Frequenzspektrum, die für den natürlichen Stimmtrakt charakteristisch sind

- Synthetische Stimmen zeigen oft übermäßige Regelmäßigkeit in Formantübergängen zwischen Phonemen

Jede Synthesemethode hinterlässt Spuren: GANs im Spektrum, Face-Swap in der Lichtgeometrie, Voice Cloning im Mikrorhythmus. Der Detektor sucht nicht nach Perfektion, sondern nach deren Abwesenheit.

Digitale Spuren der Fälschung: Was synthetische Videos verrät

Visuelle Deepfakes hinterlassen charakteristische Artefakte, die sich mittels Computer Vision und Bildanalyse aufdecken lassen. Die Detektionsmethoden entwickeln sich parallel zu den Generierungstechnologien weiter und schaffen ein Wettrüsten zwischen Erstellern und Detektoren.

Ein effektives Erkennungssystem muss mehrere Merkmale gleichzeitig analysieren, da keine einzelne Methode 100% Genauigkeit liefert.

Analyse von Kompressionsartefakten und Pixelierung

Deepfakes enthalten oft Inkonsistenzen in JPEG- und H.264-Kompressionsmustern, da synthetische Bereiche anders verarbeitet werden als originale. Die Analyse der diskreten Kosinustransformation (DCT) deckt Anomalien in 8×8-Pixel-Blöcken auf, die für eingefügte Fragmente charakteristisch sind.

Methoden auf Basis der Error Level Analysis (ELA) visualisieren Unterschiede in den Kompressionsstufen verschiedener Bildbereiche — die Detektionsgenauigkeit durch Kompressionsartefakte erreicht 87-92% auf bekannten Datensätzen wie FaceForensics++.

Detektion von Anomalien in Augenbewegungen und Blinzeln

Frühe Deepfakes blinzelten selten auf natürliche Weise, da Trainingsdatensätze überwiegend Frames mit offenen Augen enthielten. Moderne Algorithmen verfolgen die Blinzelfrequenz (Norm 15-20 Mal pro Minute), die Dauer des Lidschlusses (100-400 ms) und die Synchronität der Bewegungen beider Augen.

Neuronale Detektoren analysieren Pupillenbewegungstrajektorien und Hornhautreflexe, die sich synthetisch schwer reproduzieren lassen. Die Eye-tracking Consistency Analysis erreicht eine Genauigkeit von 94% bei Videos über 10 Sekunden Länge.

Überprüfung der Beleuchtungskonsistenz und Schatten

Physikalisch korrekte Beleuchtung erfordert die Einhaltung optischer Gesetze: Die Schattenrichtung muss der Position der Lichtquellen entsprechen, und Reflexionen in den Augen müssen mit der Umgebung übereinstimmen.

| Beleuchtungsparameter | Was der Detektor prüft | Methodengenauigkeit |

|---|---|---|

| Schattenrichtung | Übereinstimmung mit Lichtquellen in der Szene | 89% |

| Augenreflexionen | Übereinstimmung mit Umgebung und Spektrum | 89% |

| Spektrale Zusammensetzung | Einheitliche Farbtemperatur auf Gesicht und Hintergrund | 89% |

Algorithmen wie Lighting Environment Estimation analysieren Normalenkarten des Gesichts und vergleichen sie mit der vermuteten Szenenbeleuchtung. Methoden auf Basis sphärischer Harmonischer modellieren dreidimensionale Beleuchtung und decken Anomalien auf.

Akustische Forensik: Wie man synthetische Stimmen erkennt

Audio-Deepfakes bedrohen Authentifizierungssysteme von Banken und Unternehmen, die auf Sprachbiometrie setzen. Die Detektion synthetischer Sprache stützt sich auf die Analyse akustischer Merkmale, die für das menschliche Ohr unsichtbar sind.

Die Kombination aus Spektralanalyse und maschinellem Lernen erkennt synthetische Stimmen unter kontrollierten Bedingungen mit über 95% Genauigkeit.

Spektralanalyse und Erkennung synthetischer Muster

Natürliche Sprache enthält Mikrovariationen in Formantfrequenzen, Jitter (Unregelmäßigkeit der Grundtonperiode) und Shimmer (Amplitudenvariationen), die sich synthetisch schwer reproduzieren lassen.

| Merkmal | Natürliche Sprache | Synthetische Sprache |

|---|---|---|

| Formantfrequenzen | Mikrovariationen, organische Übergänge | Übermäßige Regelmäßigkeit |

| Hohe Frequenzen (>8 kHz) | Natürliche Fluktuationen | Regelmäßige Muster |

| Hintergrundrauschen | Vorhanden (reale Bedingungen) | Fehlend oder künstlich |

Die Analyse von Cepstralkoeffizienten (MFCC) und linearer Prädiktion (LPC) deckt Anomalien in der Spektralhüllkurve auf. Methoden auf Basis der Constant-Q Transform (CQT) erreichen 96% Detektionsgenauigkeit auf dem ASVspoof 2019-Datensatz.

Biometrische Stimmverifikation

Speaker-Verification-Systeme vergleichen akustische Stimmabdrücke mit Referenzaufnahmen und analysieren einzigartige Merkmale des Stimmtrakts. X-Vektoren und i-Vektoren — kompakte Stimmrepräsentationen, die von tiefen neuronalen Netzen extrahiert werden — sind robust gegenüber Variationen im Übertragungskanal und Rauschen.

Moderne Systeme erreichen eine Equal Error Rate (EER) von 1–3% bei sauberen Aufnahmen, doch adaptive Angriffe mit Adversarial Examples täuschen sie in 40–60% der Fälle.

Dies erfordert Multi-Faktor-Authentifizierung: Stimme + PIN-Code, Stimme + Gesichtsbiometrie oder Stimme + Hardware-Schlüssel. Kein einzelner Verifikationskanal sollte die einzige Vertrauensquelle sein.

Machine Learning in der Deepfake-Erkennung: von Datensätzen bis zur Adversarial-Robustheit

Training von Klassifikatoren auf annotierten Datensätzen

Die Effektivität von Deepfake-Detektoren hängt direkt von der Qualität und Vielfalt der Trainingsdaten ab. Die größten öffentlichen Datensätze — FaceForensics++ (über 1,8 Mio. Frames aus 1000 Videos), Celeb-DF (590 echte und 5639 gefälschte Promi-Videos) und DFDC (124 Tsd. Videos von Facebook) — enthalten Samples, die mit verschiedenen Generierungsmethoden erstellt wurden: DeepFakes, Face2Face, FaceSwap, NeuralTextures.

Die Annotation umfasst nicht nur binäre Labels „echt/gefälscht", sondern auch Masken der manipulierten Bereiche, Metadaten zur Generierungsmethode und zum Kompressionsgrad. Moderne Klassifikatoren auf Basis von EfficientNet, XceptionNet und Vision Transformers erreichen eine Genauigkeit von 95–99% auf Testdaten aus denselben Datensätzen.

Die Performance fällt auf 60–70% bei datensatzübergreifenden Tests aufgrund von Overfitting auf Artefakte spezifischer Generatoren.

Das Problem des Domain Shift ist ein kritischer Engpass für die Generalisierungsfähigkeit von Detektoren. Ein Modell, das auf Deepfakes mit 1080p-Auflösung und minimaler Kompression trainiert wurde, zeigt eine Genauigkeitsdegradation von 30–40% bei der Analyse von Videos, die mit H.264-Codec unter 2 Mbit/s komprimiert wurden.

Datenaugmentierungstechniken — Hinzufügen von Gaußschem Rauschen, JPEG-Artefakten, Bewegungsunschärfe, Änderung der Farbbalance — erhöhen die Robustheit um 15–20%. Ensemble-Methoden, die Vorhersagen mehrerer Modelle mit unterschiedlichen Architekturen kombinieren (CNN + Transformer + Frequenzanalyse), zeigen eine Verbesserung von 8–12% nach der AUC-ROC-Metrik.

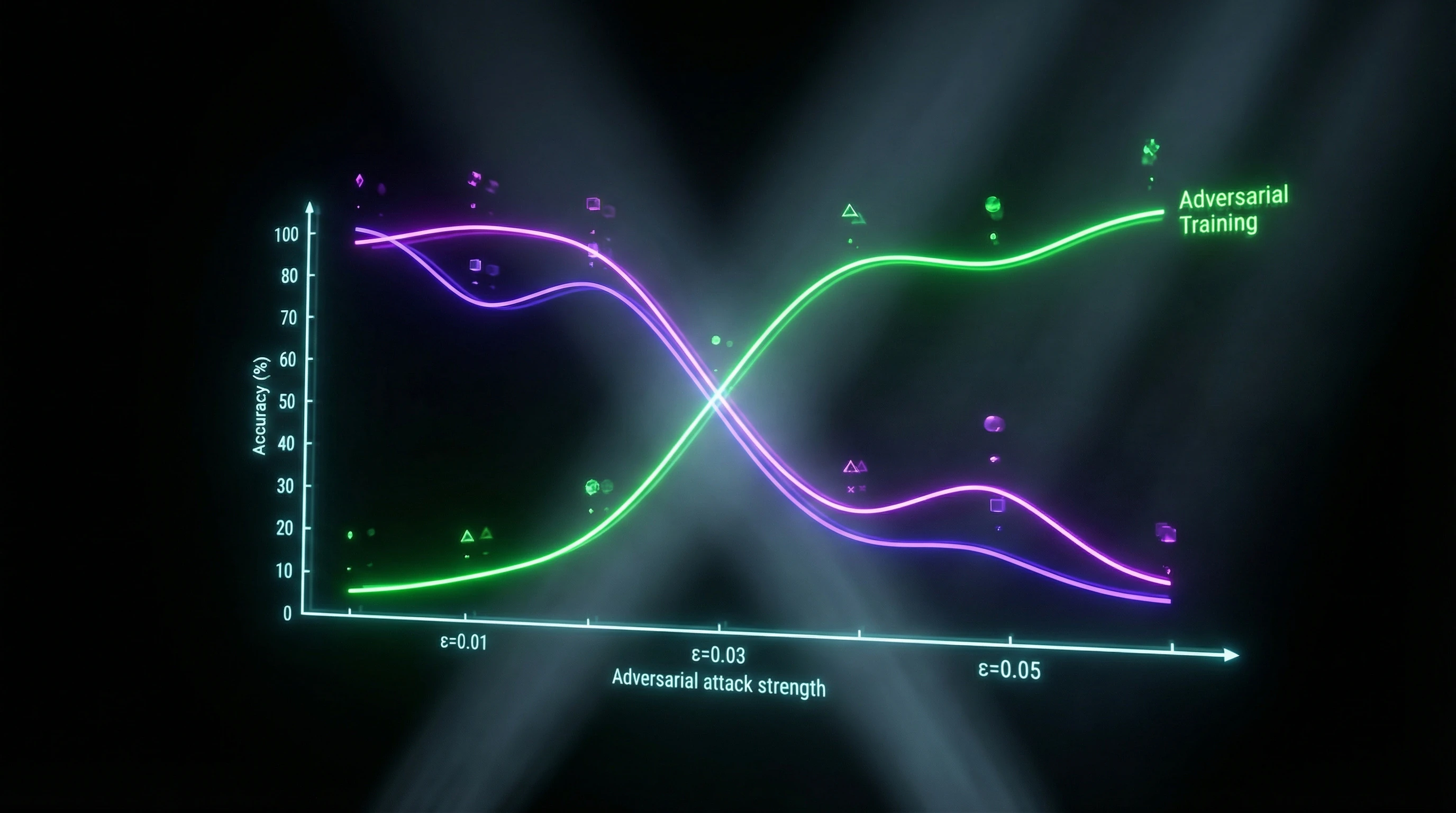

Adversarial Training und Robustheit gegen Angriffe

Adversarial Examples — speziell konstruierte Störungen der Eingabedaten, für Menschen unsichtbar, aber Klassifikationsfehler verursachend — stellen eine ernsthafte Bedrohung für Deepfake-Detektoren dar.

| Angriffsmethode | Genauigkeitsabfall | Rauschamplitude |

|---|---|---|

| FGSM (Fast Gradient Sign Method) | von 98% auf 20–30% | 8/255 in RGB |

| PGD (Projected Gradient Descent) | von 98% auf 20–30% | 8/255 in RGB |

| C&W (Carlini-Wagner) | von 98% auf 20–30% | 8/255 in RGB |

Adversarial Training — Einbeziehung von Adversarial Examples in den Trainingsdatensatz — erhöht die Robustheit um 25–35%, erfordert jedoch eine 2–3-fache Erhöhung der Rechenressourcen und Trainingszeit.

Certified Defenses auf Basis von Randomized Smoothing garantieren mathematisch beweisbare Robustheit in einer L2-Kugel mit Radius 0,5–1,0, jedoch auf Kosten einer Reduktion der Basisgenauigkeit um 5–8%.

Transfer Learning und Modelladaptation

Transfer Learning ermöglicht die Anpassung von Detektoren an neue Deepfake-Typen ohne vollständiges Neutraining von Grund auf. Modelle, die auf ImageNet oder Gesichtserkennungsaufgaben (VGGFace2, MS-Celeb-1M) vortrainiert wurden, enthalten universelle Merkmale von Texturen, Kanten und semantischen Strukturen, die auf die Manipulationserkennungsaufgabe übertragen werden.

- Fine-Tuning der letzten 2–3 Schichten

- Erfordert 10–15-mal weniger annotierte Daten (500–1000 Samples statt 10–20 Tsd.), verkürzt die Trainingszeit von mehreren Tagen auf 2–4 Stunden auf GPU.

- Few-Shot Learning (Siamese, Prototypical Networks)

- Zeigt die Fähigkeit, neue Deepfake-Typen anhand von 5–10 Beispielen mit einer Genauigkeit von 75–82% zu erkennen.

- Domain Adaptation (DANN, CORAL)

- Minimiert die Diskrepanz der Merkmalsverteilungen zwischen Quell- und Zieldomain, verbessert die Genauigkeit um 18–22% bei der Übertragung auf durch soziale Netzwerke komprimierte Videos.

Continual Learning-Strategien mit Elastic Weight Consolidation verhindern katastrophales Vergessen beim sequenziellen Training auf neuen Manipulationstypen und erhalten die Performance auf alten Aufgaben auf 90–93% des ursprünglichen Niveaus.

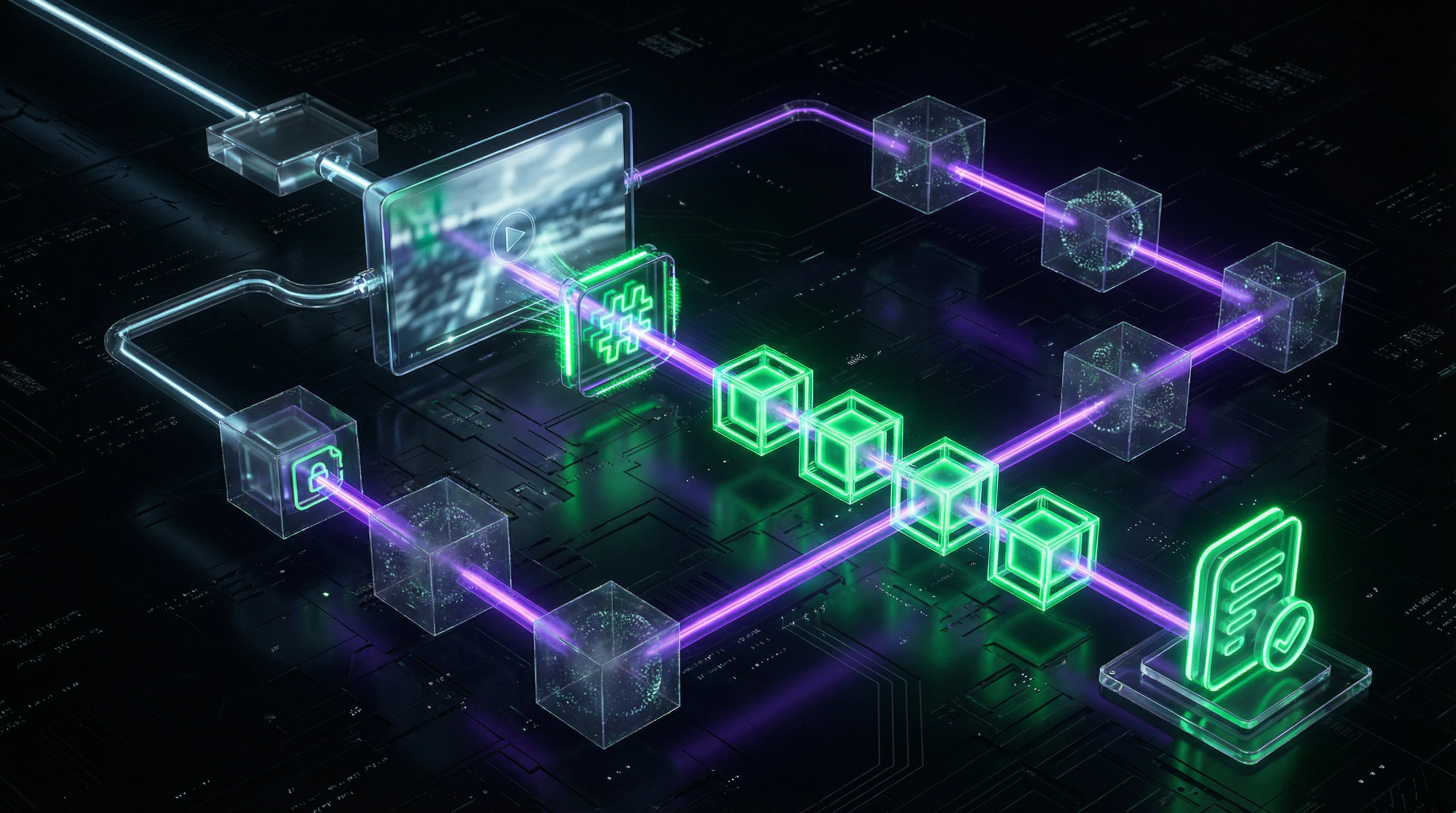

Blockchain und kryptografische Content-Verifikation: Vertrauenstechnologien im Zeitalter synthetischer Medien

Digitale Signaturen und Wasserzeichen

Kryptografische digitale Signaturen gewährleisten mathematisch beweisbare Authentizität und Integrität von Medieninhalten. Der C2PA-Standard bettet in die Metadaten von Bildern und Videos ein signiertes Manifest mit Herkunftsinformationen ein: Aufnahmegerät, Erstellungszeitpunkt, Bearbeitungskette, Autorenidentifikation.

Die Signatur wird mit dem privaten Schlüssel der Kamera oder des Editors erstellt und mit dem öffentlichen Schlüssel aus einem vertrauenswürdigen Zertifikat verifiziert. Jede Änderung von Pixeln oder Metadaten invalidiert die Signatur und signalisiert potenzielle Manipulation. Die Implementierung von C2PA in Sony Alpha 1 und Canon EOS R3 Kameras seit 2023 schafft eine Vertrauensinfrastruktur für professionellen Fotojournalismus.

Robuste Wasserzeichen — unsichtbare Muster, die in die Bildpixel eingebettet sind und resistent gegen Kompression, Zuschnitt und Filterung sind — ergänzen kryptografische Methoden.

Die SynthID-Technologie von Google DeepMind bettet das Wasserzeichen direkt in den Bildgenerierungsprozess ein, indem sie die Wahrscheinlichkeitsverteilung der Tokens so modifiziert, dass das Zeichen selbst nach JPEG-Kompression mit 75% Qualität und 50% Größenänderung erhalten bleibt.

Der Detektor extrahiert das Zeichen mit 95–98% Wahrscheinlichkeit ohne Angriffe und 70–80% nach aggressiven Transformationen. Einschränkung: Wasserzeichen schützen nicht vor gezielten Entfernungsangriffen, die die Detektierbarkeit auf 30–40% bei bekannter Einbettungsarchitektur reduzieren.

Dezentrale Register für Medien-Authentizität

Blockchain-Plattformen schaffen unveränderliche Herkunftsjournale für Inhalte, bei denen jede Transaktion — Registrierung einer Mediendatei, Rechteübertragung, Authentizitätsverifikation — in einem verteilten Register aufgezeichnet wird.

Das Starling Lab-Projekt nutzt die Filecoin-Blockchain und IPFS zur Archivierung von Beweisen für Menschenrechtsverletzungen: Fotos und Videos werden gehasht, der Hash mit Zeitstempel in die Blockchain geschrieben und schafft so einen kryptografischen Existenznachweis der Datei zu einem bestimmten Zeitpunkt. Die Verifikation dauert Sekunden und erfordert kein Vertrauen in eine zentrale Instanz.

- Numbers Protocol integriert NFT-Zertifikate mit C2PA-Metadaten und ermöglicht Fotografen die Monetarisierung authentischer Bilder.

- Die Nachverfolgung der Content-Nutzung erfolgt über Smart Contracts im verteilten Netzwerk.

- Jeder Rechteübergang oder jede Bearbeitung wird mit kryptografischer Signatur registriert.

Skalierbarkeit bleibt eine Herausforderung: Die Aufzeichnung jeder Mediendatei in einer öffentlichen Blockchain kostet je nach Netzwerk 0,01–0,50€ und erzeugt eine Latenz von 5–60 Sekunden.

Hybride Lösungen nutzen Off-Chain-Speicher für die Dateien selbst (IPFS, Arweave) und On-Chain-Einträge nur für Hashes und Metadaten, wodurch die Kosten um das 100- bis 1000-fache gesenkt werden. Konsortium-Blockchains (Hyperledger Fabric) für Unternehmensmedienarchive verarbeiten 1000–5000 Transaktionen pro Sekunde mit Finalität unter 1 Sekunde, opfern jedoch Dezentralisierung zugunsten der Performance.

Soziale und ethische Aspekte: Gesetzgebung, Bildung und Innovationsbalance

Gesetzliche Regulierung von Deepfakes

Rechtliche Rahmenbedingungen für Deepfakes entwickeln sich fragmentiert auf nationaler Ebene. In den USA verlangt der bundesweite DEEPFAKES Accountability Act (2023) die Kennzeichnung synthetischer Inhalte mit Wasserzeichen und kriminalisiert die Erstellung von Deepfakes mit Schadensvorsatz, mit Strafen bis zu 5 Jahren Haft und 250.000 USD Geldstrafe.

Kalifornien (AB 602, AB 730) verbietet Deepfake-Pornografie ohne Einwilligung und politische Deepfakes 60 Tage vor Wahlen. Die Europäische Union klassifiziert im Rahmen des AI Act Systeme zur Deepfake-Erstellung als „hohes Risiko" und fordert verpflichtende Kennzeichnung, Algorithmus-Audits und Transparenz der Trainingsdatensätze.

China (2023) verpflichtet Plattformen zur Implementierung von Deepfake-Detektoren und zur Sperrung nicht gekennzeichneter synthetischer Inhalte innerhalb von 24 Stunden unter Androhung von Geldstrafen bis zu 10% des Jahresumsatzes.

Die Rechtsdurchsetzung stößt auf technische und jurisdiktionale Barrieren. Die Anonymität von Deepfake-Erstellern durch VPN und Kryptowährungen erschwert die Identifizierung von Rechtsverletzern.

Die grenzüberschreitende Verbreitung von Inhalten über dezentralisierte Plattformen (BitTorrent, IPFS) macht Sperrungen ineffektiv. Die Feststellung von „Schadensvorsatz" erfordert den Nachweis von mens rea, was in Fällen von Satire oder künstlerischer Nutzung schwierig ist.

Die Balance zwischen Schutz vor Missbrauch und Meinungsfreiheit bleibt Gegenstand gerichtlicher Auseinandersetzungen: Klagen gegen Ersteller politischer Deepfakes werden in den USA häufig aufgrund des First Amendment abgewiesen.

Medienkompetenz und kritisches Denken

Bildungsprogramme zur Erkennung von Deepfakes erhöhen die Widerstandsfähigkeit der Gesellschaft gegen Manipulationen. Eine Studie des MIT Media Lab (2024) zeigte, dass ein 15-minütiges Training mit Beispielen von Artefakten die Fähigkeit der Teilnehmer, echte von gefälschten Videos zu unterscheiden, von 54% auf 73% Genauigkeit verbessert.

Langfristige Kurse (8-12 Wochen) mit Praxis in Metadatenanalyse, Rückwärtsbildsuche und Quellenprüfung erreichen 85-90% Genauigkeit. Kritisches Denken — die Gewohnheit, Fragen zu stellen wie „Wer hat das erstellt?", „Was ist der Zweck?", „Bestätigen unabhängige Quellen dies?" — ist effektiver als das Auswendiglernen spezifischer Artefakte, die mit der Weiterentwicklung der Generierungstechnologien veralten.

- Inkonsistente Beleuchtung und Schatten im Gesicht

- Unnatürliche Augen- und Lidbewegungen

- Desynchronisation von Lippen und Sprache

- Artefakte an den Grenzen zwischen Gesicht und Hintergrund

- Anomalien in Pupillenreflexionen

Die Integration von Deepfake-Detektoren in Bildungsplattformen und Browser-Erweiterungen demokratisiert den Zugang zur Verifikation. Die Erweiterung InVID-WeVerify für Chrome und Firefox analysiert Videos auf Manipulationsmerkmale, extrahiert EXIF-Metadaten und führt Rückwärtssuchen von Schlüsselbildern in Google-, Yandex- und Bing-Datenbanken in 10-15 Sekunden durch.

Mobile Apps wie Truepic Vision integrieren C2PA-Verifikation in die Smartphone-Kamera und signieren Fotos zum Aufnahmezeitpunkt. Die massenhafte Einführung solcher Tools in Schulprogramme und Unternehmensschulungen schafft eine „kollektive Immunität" gegen Desinformation.

Balance zwischen Innovation und Rechtsschutz

Mediensynthese-Technologien haben legitime Anwendungen: Filmsynchronisation mit Lippensynchronität, Restaurierung historischer Aufnahmen, personalisierte Bildung mit virtuellen Lehrkräften, Barrierefreiheits-Tools für Menschen mit Behinderungen.

Übermäßige Regulierung riskiert, Innovationen zu bremsen und Barrieren für die Forschung zu schaffen. Das „Safe Harbor"-Modell — Haftungsbefreiung für Plattformen, die Detektoren und Beschwerdeverfahren implementiert haben — fördert freiwillige Zusammenarbeit ohne Unterdrückung technologischer Entwicklung.

Die Lizenzierung von Deepfake-Erstellungstools mit der Anforderung eingebetteter Wasserzeichen und Nutzungsprotokollierung balanciert Zugänglichkeit und Rechenschaftspflicht.

Ethische Frameworks wie IEEE P7003 (Algorithmic Bias) und Partnership on AI Guidelines empfehlen Transparenz von Datensätzen, Bias-Audits (rassisch, geschlechtsspezifisch, altersbezogen), Einwilligungsmechanismen für die Nutzung biometrischer Daten und das Recht auf Erklärung von Detektorentscheidungen.

Die Beteiligung von Stakeholdern — Technologieunternehmen, Menschenrechtsaktivisten, Journalisten, Gesetzgebern — in Multi-Stakeholder-Governance-Gremien (Content Authenticity Initiative, AI Alliance) gewährleistet die Berücksichtigung vielfältiger Interessen.

Die Zukunft der Deepfake-Detektion liegt nicht in einem technologischen Wettrüsten, sondern in soziotechnischen Systemen, in denen Technologien, Gesetze, Bildung und ethische Normen synergetisch zum Schutz des Informationsökosystems zusammenwirken.

Knowledge Access Protocol

FAQ

Häufig gestellte Fragen

Ein Deepfake ist synthetischer Medieninhalt, der mithilfe künstlicher Intelligenz erstellt wird, um das Gesicht oder die Stimme einer Person zu ersetzen. Die Technologie basiert auf Generative Adversarial Networks (GAN) und Autoencodern, die mit Tausenden von Bildern des Zielgesichts trainiert werden. Moderne Algorithmen ermöglichen die Erstellung realistischer Videos innerhalb weniger Stunden auf einem handelsüblichen Computer.

Hochwertige Deepfakes sind ohne Spezialtools schwer zu erkennen, aber es gibt Anzeichen: unnatürliches Blinzeln, asynchrone Lippenbewegungen, Artefakte an Gesichtsrändern. Achten Sie auf Beleuchtung, Schatten und Hauttextur – Algorithmen machen hier oft Fehler. Bei geringstem Zweifel nutzen Sie spezialisierte Prüfdienste.

Die Detektion basiert auf maschinellem Lernen: Neuronale Netze analysieren Kompressionsartefakte, Anomalien in Augenbewegungen, Beleuchtungsinkonsistenzen und spektrale Audiomuster. Moderne Systeme nutzen Adversarial Training für Robustheit gegen neue Fälschungsmethoden. Auch Blockchain-Technologien werden für die kryptografische Verifizierung von Originalinhalten eingesetzt.

Das ist ein Mythos – moderne Deepfakes erreichen fotorealistische Qualität und täuschen selbst Experten. GAN- und Autoencoder-Technologien werden ständig weiterentwickelt und erzeugen immer überzeugendere Fälschungen. Die Qualität hängt vom Umfang der Trainingsdaten und der verfügbaren Rechenleistung ab.

Nutze spezialisierte Deepfake-Erkennungsdienste (Microsoft Video Authenticator, Sensity AI) oder lade das Video auf Prüfplattformen hoch. Analysiere die Datei-Metadaten, überprüfe Quelle und Veröffentlichungskontext. Bei wichtigem Content wende mehrere Verifikationsmethoden gleichzeitig an.

GAN (Generative Adversarial Network) ist eine KI-Architektur aus zwei neuronalen Netzen: Der Generator erstellt Fälschungen, während der Diskriminator versucht, sie zu erkennen. Im Prozess des ‹Wettstreits› lernt der Generator, immer realistischere Bilder zu erstellen, die der Diskriminator nicht von echten unterscheiden kann. GANs bilden die Grundlage der meisten modernen Deepfakes.

Ja, Blockchain ermöglicht die Erstellung unveränderlicher Aufzeichnungen über die Herkunft von Medieninhalten durch digitale Signaturen und Zeitstempel. Dezentrale Register speichern Hashes der Originaldateien, was die Verifizierung der Authentizität ermöglicht. Solche Lösungen werden bereits von Nachrichtenagenturen und Plattformen zur Bekämpfung von Desinformation implementiert.

Frühe Deepfake-Algorithmen reproduzierten natürliches menschliches Blinzeln schlecht – zu selten oder unnatürlich in der Dynamik. Detektoren analysieren Frequenz, Dauer und Blinzelmuster im Vergleich zu biologischen Normen. Moderne Deepfakes haben gelernt, Blinzeln zu imitieren, daher wird diese Methode mit anderen Techniken kombiniert.

Adversarial Training ist eine Methode zum Training von Detektoren mit ständig aktualisierten Deepfake-Beispielen, einschließlich speziell zur Täuschung des Systems erstellter. Das Modell lernt nicht nur bestehende Fälschungen zu erkennen, sondern passt sich auch an neue Generierungstechniken an. Es ist ein Wettrüsten zwischen Deepfake-Erstellern und -Detektoren.

Synthetische Sprache weist charakteristische Artefakte im Frequenzspektrum auf, die sich von der natürlichen menschlichen Stimme unterscheiden. Die Analyse von Spektrogrammen deckt anomale Obertöne, unnatürliche Übergänge zwischen Phonemen und das Fehlen von Mikrovariationen auf. Moderne Systeme nutzen Deep Learning zur automatischen Erkennung dieser Muster.

Das ist ein veralteter Mythos – heute lässt sich ein qualitativ hochwertiger Deepfake auf einem Gaming-PC mit Mittelklasse-Grafikkarte innerhalb weniger Stunden erstellen. Es gibt fertige Anwendungen und Online-Dienste, die den Prozess automatisieren. Die Zugänglichkeit der Technologie ist erheblich gestiegen, was das Problem der Deepfake-Verbreitung verschärft.

In Deutschland können Deepfakes unter Straftatbestände wie Verleumdung, Betrug, Urheberrechtsverletzung und Verbreitung von Falschinformationen fallen. Seit 2024 wurde die Haftung für den Einsatz von KI zur Erstellung kompromittierender Materialien verschärft. Die Gesetzgebung entwickelt sich als Reaktion auf neue Bedrohungen kontinuierlich weiter.

Kritisches Denken und Quellenprüfung sind die erste Verteidigungslinie gegen Manipulation. Die Schulung im Erkennen von Fälschungsmerkmalen, das Verständnis der Technologien und die Gewohnheit, Informationen zu verifizieren, verringern die Wirksamkeit von Deepfakes. Medienkompetenz ist besonders wichtig im Zeitalter der massenhaften Verbreitung synthetischer Inhalte.

Theoretisch möglich, aber in der Praxis bleiben immer Mikroartefakte bestehen, die durch spezialisierte Algorithmen erkennbar sind. Das Wettrennen zwischen Generierung und Detektion geht weiter – jede Verbesserung bei der Deepfake-Erstellung stimuliert die Entwicklung von Erkennungsmethoden. Vollständige Ununterscheidbarkeit bleibt ein unerreichbares Ziel.

Digitale Wasserzeichen sind unsichtbare Markierungen, die bei der Erstellung in eine Mediendatei eingebettet werden und deren Authentizität und Herkunft bestätigen. Sie sind resistent gegen Komprimierung und Bearbeitung und ermöglichen die Verifizierung originaler Inhalte. Die Technologie wird aktiv von Kameraherstellern und Nachrichtenagenturen implementiert.

Ja, die Technologie wird in der Filmproduktion zur Verjüngung von Schauspielern eingesetzt, in der Bildung zur Erstellung interaktiver historischer Persönlichkeiten, in der Medizin zur Sprachsynthese für Menschen mit Sprachstörungen. Deepfakes helfen bei der Lokalisierung von Inhalten und der Personalisierung von Lernprozessen. Die zentrale Frage ist die ethische Nutzung mit Zustimmung aller Beteiligten.