🔍 Deepfake-Erkennung

🔍 Deepfake-ErkennungSynthetische Medien: Von künstlicher Intelligenz erstellte digitale Inhalteλ

Bilder, Videos, Audio und Text, die mithilfe von maschinellem Lernen und neuronalen Netzen generiert oder modifiziert werden, um realistische Inhalte zu erstellen

Overview

Synthetische Medien sind Inhalte, die Algorithmen erstellen oder radikal verändern: 🧬 Bilder, Videos, Stimmen, Texte. Die Technologie findet Anwendung in der medizinischen Bildgebung (Erkennung von Strukturen während Operationen), in der Unterhaltung, im Marketing, in der Wissenschaft – eröffnet aber gleichzeitig Wege für Desinformation und Manipulation. Die zentrale Frage: Wie lässt sich Authentizität verifizieren, wenn Maschinen die Realität präziser imitieren als Menschen.

🛡️

Laplace-Protokoll: Bei der Bewertung synthetischer Medien ist es entscheidend, zwischen legitimen Anwendungen (medizinische Diagnostik, wissenschaftliche Forschung) und potenziell schädlichen (Deepfakes, Desinformation) zu unterscheiden. Prüfen Sie stets die Quelle des Inhalts, suchen Sie nach Anzeichen KI-generierter Inhalte und fordern Sie Transparenz hinsichtlich der Erstellungsmethoden digitaler Materialien.

Reference Protocol

Wissenschaftliche Grundlage

Evidenzbasierter Rahmen für kritische Analyse

Protocol: Evaluation

Teste Dich

Quiz zu diesem Thema kommt bald

Sector L1

Artikel

Forschungsmaterialien, Essays und tiefe Einblicke in die Mechanismen des kritischen Denkens.

🔍 Deepfake-Erkennung

🔍 Deepfake-Erkennung 🔍 Deepfake-Erkennung

🔍 Deepfake-Erkennung⚡

Vertiefung

Technologien zur Erstellung synthetischer Medien: von adversarialen Netzwerken zu Diffusionsmodellen

Synthetische Medien sind digitale Inhalte (Bilder, Videos, Audio, Text), die durch Algorithmen des maschinellen Lernens erstellt oder modifiziert werden. Neuronale Netze generieren diese Inhalte auf Basis großer Mengen realer Daten, im Gegensatz zur traditionellen Computergrafik, bei der jedes Element manuell programmiert wird.

Die Technologie hat die Einstiegshürden für die Content-Erstellung radikal gesenkt und neue Möglichkeiten für Forschung, Wirtschaft und Kreativität eröffnet.

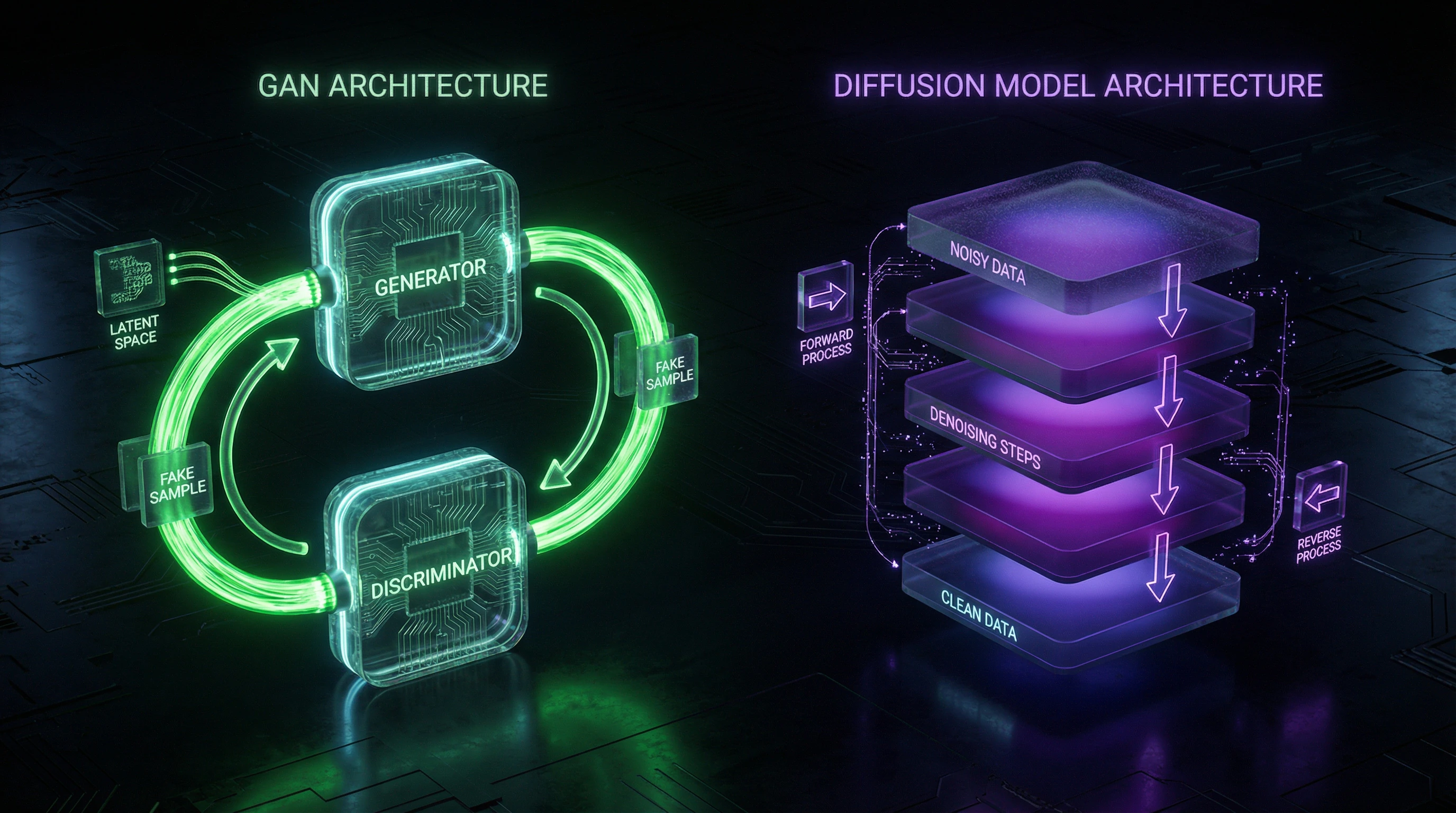

Generative Adversarial Networks (GAN)

Generative Adversarial Networks, 2014 vorgestellt, funktionieren durch den Wettbewerb zweier Komponenten: Der Generator erstellt synthetische Samples, der Diskriminator unterscheidet reale Daten von gefälschten.

| Komponente | Funktion | Dynamik |

|---|---|---|

| Generator | Erstellt synthetische Samples | Verbessert sich, indem er versucht, den Diskriminator zu täuschen |

| Diskriminator | Unterscheidet reale Daten von gefälschten | Verbessert seine Fähigkeit, Fälschungen zu erkennen |

Die adversariale Dynamik führt zur Erstellung hochrealistischer Bilder, die für das menschliche Auge nicht von Fotografien zu unterscheiden sind. Die Architekturen StyleGAN und BigGAN haben eine Qualität bei der Generierung von Gesichtern und Objekten erreicht, die die Möglichkeiten traditioneller Computergrafik-Methoden übertrifft.

GANs werden von der Erstellung von Trainingsdaten für medizinische Algorithmen bis zur Generierung fotorealistischer Texturen in der Gaming-Industrie eingesetzt. Die Technologie hat jedoch Einschränkungen: Komplexität beim Training, Instabilität des Prozesses und Neigung zur Generierung von Artefakten bei hohen Auflösungen.

Diffusionsmodelle und Transformer

Diffusionsmodelle, die seit 2020 weite Verbreitung gefunden haben, funktionieren nach dem Prinzip der schrittweisen Entfernung von Rauschen aus einem zufälligen Bild. Das Modell lernt, den Prozess der Datendegradation umzukehren und den ursprünglichen Inhalt aus dem Rauschen wiederherzustellen.

Im Gegensatz zu GANs zeigen Diffusionsmodelle ein stabileres Training und die Fähigkeit, vielfältige Inhalte ohne Mode Collapse zu generieren.

- DALL-E 2, Midjourney, Stable Diffusion

- Nutzen Diffusionsprozesse in Kombination mit Transformer-Architekturen zur Umwandlung von Textbeschreibungen in Bilder.

- Transformer

- Bieten einen Aufmerksamkeitsmechanismus, der es dem Modell ermöglicht, sich auf relevante Teile der Eingabedaten zu konzentrieren und Text-Prompts mit visuellen Darstellungen zu verknüpfen.

Die Kombination von Diffusionsmodellen und Transformern bietet eine beispiellose Kontrolle über den Generierungsprozess und ermöglicht es Nutzern, gewünschte Eigenschaften des Inhalts präzise über natürliche Sprache zu spezifizieren.

Diffusionsmodelle benötigen in der Generierungsphase mehr Rechenressourcen als GANs, bieten aber einen vorhersehbareren und besser steuerbaren Trainingsprozess. Dies hat sie zur Grundlage für kommerzielle Anwendungen gemacht, bei denen Zuverlässigkeit entscheidend ist.

Anwendung synthetischer Medien in der Medizin und wissenschaftlichen Forschung

Der medizinische Bereich hat sich zu einem der vielversprechendsten Anwendungsgebiete für Technologien synthetischer Medien entwickelt, wo generative Modelle kritische Probleme wie Datenmangel, Patientendatenschutz und Variabilität klinischer Fälle lösen. Synthetische Daten ermöglichen das Training von Algorithmen ohne Risiko von Datenlecks personenbezogener Informationen unter Einhaltung strenger medizinrechtlicher Anforderungen.

KI-gestützte chirurgische Visualisierung und Operationsplanung

Generative Modelle erstellen dreidimensionale Rekonstruktionen anatomischer Strukturen auf Basis zweidimensionaler medizinischer Aufnahmen, verbessern die präoperative Planung und reduzieren Risiken chirurgischer Eingriffe. Algorithmen synthetisieren fehlende Projektionen in der Computertomographie, rekonstruieren Details in niedrigauflösenden MRT-Bildern und generieren virtuelle Organmodelle für Operationssimulationen.

KI-Systeme erreichen eine Genauigkeit bei der Identifikation von Nebenschilddrüsen, die mit erfahrenen Chirurgen vergleichbar ist — entscheidend zur Vermeidung von Komplikationen bei Schilddrüsenoperationen. In der Ophthalmologie werden synthetische Medien zum Vergleich der Wirksamkeit von Anti-VEGF-Therapien bei neovaskulärer altersbedingter Makuladegeneration eingesetzt, indem sie Visualisierungen des Krankheitsverlaufs generieren und das Therapieansprechen prognostizieren.

- Personalisierte Fundusmodelle berücksichtigen individuelle anatomische Besonderheiten für präzise Prognosen des Krankheitsverlaufs.

- Analyse der Krankengeschichte bestimmt die Wahl der therapeutischen Strategie basierend auf Patientendaten und prognostischen Modellen.

- Wirksamkeitsmonitoring verfolgt das Therapieansprechen im zeitlichen Verlauf unter Verwendung synthetischer Visualisierungen.

Synthetische Daten für medizinische Forschung und Algorithmentraining

Der Mangel an annotierten medizinischen Daten stellt das Haupthindernis für die Entwicklung diagnostischer KI-Systeme dar, insbesondere bei seltenen Erkrankungen und atypischen klinischen Fällen. Generative Modelle erstellen synthetische Datensätze, die statistisch nicht von realen unterscheidbar sind, aber keine Informationen über konkrete Patienten enthalten.

Modelle, die auf einer Kombination aus realen und synthetischen Daten trainiert wurden, zeigen bessere Generalisierungsfähigkeit und Robustheit gegenüber Variationen in der Bildqualität.

In der Onkologie ergänzen synthetische Tumorbilder, die auf Basis realer Biopsien generiert wurden, effektiv Trainingsdatensätze für Algorithmen zur Klassifikation von Brustkrebssubtypen. Synthetische Daten werden zur Augmentation seltener Pathologien, zum Ausgleich unbalancierter Datensätze und zur Erstellung kontrollierter Szenarien für die Algorithmenvalidierung eingesetzt.

Metaanalysen zeigen, dass die Einbeziehung synthetischer Proben in Trainingsdatensätze die Genauigkeit diagnostischer Systeme um 8–15% im Vergleich zum Training ausschließlich auf realen Daten begrenzten Umfangs erhöht.

Synthetische Medien in Handel und Unterhaltungsindustrie

Der kommerzielle Sektor hat Technologien synthetischer Medien adaptiert, um Marketinginhalte zu erstellen, Nutzererlebnisse zu personalisieren und Produktionskosten zu senken. Generative Modelle ermöglichen es Marken, Tausende Variationen von Werbematerialien für verschiedene Zielgruppen und Plattformen zu erstellen, ohne kostspielige Fotoshootings.

Die Unterhaltungsindustrie nutzt synthetische Medien zur Erstellung virtueller Charaktere, digitaler Doppelgänger von Schauspielern und prozeduraler Generierung von Spielwelten.

Content-Generierung für Marketing und personalisierte Werbung

Marketingplattformen integrieren generative Modelle zur automatischen Erstellung visueller Inhalte auf Basis von Textbriefings, wodurch der Produktionszyklus von Kampagnen beschleunigt wird. Algorithmen generieren Produktbilder in verschiedenen Kontexten, passen den Stil an die Präferenzen der Zielgruppe an und erstellen Designvariationen für A/B-Tests.

Die Technologie ist besonders effektiv im E-Commerce: Synthetische Models präsentieren Kleidung und Accessoires, wodurch physische Fotoshootings überflüssig werden und Kataloge sofort aktualisiert werden können.

Die Personalisierung von Werbeinhalten erreicht durch die Fähigkeit generativer Systeme, visuelle Elemente an demografische Merkmale, kulturellen Kontext und Verhaltensmuster der Nutzer anzupassen, ein neues Niveau.

- Skalierbarkeit: Einzigartige Kreativinhalte für Mikrosegmente der Zielgruppe — Risiko des manipulativen Potenzials von Hyperpersonalisierung.

- Geschwindigkeit: Sofortige Aktualisierung von Katalogen ohne Fotoshootings — erfordert Transparenz bei der Verwendung KI-generierter Inhalte.

Virtuelle Influencer und digitale Charaktere in Medien

Virtuelle Influencer — vollständig synthetische Charaktere mit detailliert ausgearbeiteten Biografien, visuellem Stil und Persönlichkeitsmerkmalen — gewinnen Millionen Follower in sozialen Netzwerken und schließen Werbeverträge mit großen Marken ab.

Sie werden durch eine Kombination aus 3D-Modellierung, generativen neuronalen Netzen und Animationstechnologien erstellt. Sie bieten vollständige Kontrolle über das Image und eliminieren Reputationsrisiken realer Markenbotschafter. Sie altern nicht, werden nicht müde und können gleichzeitig bei zahlreichen Veranstaltungen präsent sein.

In der Spieleindustrie und im Kino ermöglichen synthetische Medien die Erstellung fotorealistischer digitaler Doppelgänger von Schauspielern, das Drehen von Szenen ohne physische Anwesenheit der Darsteller oder die Nachbildung verstorbener Künstler.

- Urheberrecht

- Unklarer Status der Rechte an synthetischen Abbildern und deren kommerzielle Nutzung.

- Einwilligung zur Verwendung des Abbilds

- Ethische Grenze zwischen dem Recht am eigenen Bild und der Möglichkeit seiner Reproduktion ohne Zustimmung.

- Postmortale Verwendung

- Frage der Zulässigkeit der Nachbildung verstorbener Künstler und der Kontrolle über ihr Erbe.

Synthetische Charaktere werden zu einem integralen Bestandteil der modernen Medienlandschaft und verwischen die Grenzen zwischen Realem und Künstlichem in der Massenkultur. Fragen der Regulierung dieses Bereichs werden im Abschnitt über Ethik und Sicherheit von KI behandelt.

Deepfakes und das Problem der Desinformation: Wie Technologie die Grenzen der Realität verwischt

Technologien zur Erstellung gefälschter Videos und ihre Entwicklung

Deepfakes sind synthetische Medien, die durch tiefe neuronale Netze erstellt werden und Gesichter sowie Stimmen in Videos mit hoher Realitätstreue ersetzen. Die Technologie basiert auf Generative Adversarial Networks (GANs): Ein Generator erstellt synthetische Inhalte, ein Diskriminator kritisiert diese, und beide verbessern sich schrittweise.

Moderne Algorithmen benötigen nur wenige Minuten Videomaterial für eine überzeugende Fälschung. Dies hat die Technologie nicht nur Profis, sondern auch normalen Nutzern über spezialisierte Apps und Online-Dienste zugänglich gemacht.

Frühe Deepfakes verrieten sich durch Artefakte im Augenbereich und unnatürliche Bewegungen. Moderne Modelle haben gelernt, Mimik korrekt zu verarbeiten, Lippenbewegungen mit Sprache zu synchronisieren und Beleuchtung anzupassen – die Grenze zwischen Fälschung und Realität verschwimmt.

Besonders gefährlich sind Audio-Deepfakes – synthetische Sprachaufnahmen auf Basis weniger Minuten Originalmaterial. Sie werden für Telefonbetrug und Manipulationen eingesetzt, wo die Stimme der einzige Identitätsmarker ist.

Methoden zur Erkennung synthetischer Inhalte und ihre Grenzen

Die Erkennung von Deepfakes ist ein Wettrüsten zwischen Erstellern synthetischer Inhalte und Entwicklern von Erkennungssystemen. Moderne Methoden analysieren biologische Unstimmigkeiten: unnatürliche Blinzelfrequenz, fehlende Mikrobewegungen der Gesichtsmuskulatur, Anomalien in der Pulsation von Blutgefäßen.

Technische Ansätze umfassen die Analyse von Kompressionsartefakten, Unstimmigkeiten in Metadaten und statistischen Anomalien in der Pixelverteilung, die für generative Modelle charakteristisch sind.

| Prüfebene | Methode | Zuverlässigkeit |

|---|---|---|

| Automatisch (bekannte Typen) | Analyse biologischer Marker, Kompressionsartefakte | ~95% |

| Automatisch (neue Varianten) | Gleiche Methoden bei unbekannten Modellen | ~65% |

| Menschliche Wahrnehmung | Visuelle und auditive Bewertung | 50–60% (Zufallsrate) |

Jede Verbesserung der Erkennungsalgorithmen stimuliert die Entwicklung ausgefeilterer generativer Modelle, die bestehende Prüfmethoden umgehen können. Die Genauigkeit sinkt mit dem Aufkommen neuer Architekturen, die Erkennungsentwickler noch nicht gesehen haben.

Das menschliche Auge und Ohr werden zu unzuverlässigen Verifizierungsinstrumenten im Zeitalter synthetischer Medien. Die Technologie entwickelt sich schneller als die Methoden zu ihrer Erkennung und schafft eine fundamentale Asymmetrie zugunsten der Ersteller gefälschter Inhalte.

Ethische und rechtliche Aspekte synthetischer Medien im digitalen Zeitalter

Urheberrecht an KI-generierten Inhalten und rechtliche Unsicherheit

Der rechtliche Status von durch künstliche Intelligenz erstellten Inhalten bleibt Gegenstand intensiver Debatten in der juristischen Gemeinschaft. Das traditionelle Urheberrecht setzt einen menschlichen Urheber voraus, dessen kreative Leistung gesetzlich geschützt wird, doch synthetische Medien werden von Algorithmen mit minimaler oder ganz ohne menschliche Beteiligung erstellt.

In verschiedenen Rechtsordnungen bilden sich widersprüchliche Ansätze heraus: Einige Länder verweigern KI-generierten Werken den Schutz, andere erkennen Urheberrechte dem Systembetreiber oder Algorithmus-Entwickler zu.

Wenn KI auf urheberrechtlich geschützten Werken trainiert wird und abgeleitete Arbeiten erstellt, entsteht ein Interessenkonflikt: Künstler und Fotografen reichen Sammelklagen ein und behaupten, dass das Training auf ihren Werken ohne Zustimmung das Urheberrecht verletzt. Das Rechtssystem hat noch keinen einheitlichen Ansatz entwickelt, ob die Verwendung von Werken zum KI-Training als faire Nutzung gilt oder Lizenzierung und Vergütung erfordert.

Regulierung synthetischer Medien und Kennzeichnungspflichten

Gesetzesinitiativen zur Regulierung synthetischer Medien entwickeln sich in mehrere Richtungen – von verpflichtender Kennzeichnung KI-generierter Inhalte bis zur strafrechtlichen Verantwortung für die Erstellung schädlicher Deepfakes.

| Rechtsordnung / Initiative | Ansatz | Mechanismus |

|---|---|---|

| Europäische Union (AI Act) | Verpflichtende Kennzeichnung | Expliziter Hinweis auf die synthetische Natur des Inhalts, insbesondere wenn er als real wahrgenommen werden könnte |

| Kalifornien | Kriminalisierung | Strafrechtliche Verantwortung für Deepfakes von Politikern vor Wahlen und pornografische Deepfakes ohne Einwilligung |

| Technische Standards | Herkunftsverifizierung | Digitale Wasserzeichen, kryptografische Signaturen, Metadaten bei der Generierung |

Die Content Authenticity Initiative vereint Technologieunternehmen zur Entwicklung von Standards für die Herkunft digitaler Inhalte, die es ermöglichen, die Entstehungs- und Änderungshistorie von Mediendateien nachzuverfolgen.

Die Wirksamkeit der Kennzeichnung ist durch technische Möglichkeiten zur Entfernung von Metadaten und soziale Faktoren begrenzt – Nutzer ignorieren häufig Warnhinweise über die synthetische Natur von Inhalten oder verstehen deren Bedeutung nicht. Dies schafft eine Kluft zwischen technischem Schutz und tatsächlichem Nutzerverhalten.

Zukunft synthetischer Medien: von Multimodalität zu Hyperrealität

Multimodale Content-Generierung und Technologiekonvergenz

Die nächste Generation synthetischer Medien zeichnet sich durch Multimodalität aus — die Fähigkeit, konsistenten Content gleichzeitig in mehreren Formaten zu generieren. Moderne Modelle erstellen bereits Text, Bilder und Code im Rahmen einer einzigen Anfrage.

Zukünftige Systeme werden vollständige Multimediaprojekte generieren: Videos mit synchronisiertem Ton, Musik und Textbegleitung. Text-to-Video entwickelt sich von Kurzclips zu abendfüllenden Filmen, bei denen Drehbuch, visuelle Gestaltung, Vertonung und Schnitt automatisch auf Basis einer Textbeschreibung erstellt werden.

Die Konvergenz der Technologien führt zur Entstehung personalisierter synthetischer Medien, die sich an die Präferenzen einzelner Nutzer anpassen.

Werbekampagnen werden einzigartige Varianten von Spots für jeden Zuschauer generieren. Bildungsplattformen erstellen individualisierte Lernmaterialien, und Unterhaltungsdienste bieten interaktive Narrative, bei denen sich Handlung und Charaktere in Echtzeit an die Entscheidungen der Nutzer anpassen.

Integration synthetischer Medien mit Augmented Reality

Die Verschmelzung synthetischer Medien mit Augmented- und Virtual-Reality-Technologien schafft eine neue Klasse immersiver Erlebnisse, bei denen die Grenzen zwischen Physischem und Digitalem verschwimmen. AR-Brillen der Zukunft werden synthetische Objekte und Charaktere mit fotorealistischer Qualität auf die reale Umgebung projizieren.

Spatial Computing in Kombination mit generativen Modellen eröffnet Möglichkeiten zur Erschaffung persistenter virtueller Welten, in denen Umgebung und Objekte prozedural als Reaktion auf Nutzeraktionen generiert werden.

| Möglichkeiten | Risiken |

|---|---|

| Beispiellose Möglichkeiten für Kreativität und Kommunikation | Vertiefung von Filterblasen |

| Personalisierte Erlebnisse | Ablösung von objektiver Realität |

Psychologische Studien dokumentieren das Phänomen der „synthetischen Nostalgie" — emotionaler Bindung an Ereignisse und Orte, die nur als KI-generierter Content existieren.

Die Zukunft synthetischer Medien erfordert nicht nur technologische Lösungen zur Gewährleistung von Sicherheit und Authentizität, sondern auch neue kulturelle Praktiken der kritischen Medienwahrnehmung in einer Ära, in der jedes Bild, jeder Ton oder jedes Video synthetisch sein kann.

Knowledge Access Protocol

FAQ

Häufig gestellte Fragen

Synthetische Medien sind digitale Inhalte (Bilder, Videos, Audio, Text), die mithilfe von künstlicher Intelligenz und maschinellem Lernen erstellt oder verändert wurden. Zu den Technologien gehören Generative Adversarial Networks (GANs), Diffusionsmodelle und Transformer, die realistische Inhalte ohne menschliches Zutun erzeugen können. Sie werden in der Medizin, im Marketing, in der Unterhaltung und in der wissenschaftlichen Forschung eingesetzt.

GANs bestehen aus zwei neuronalen Netzen: einem Generator, der Inhalte erstellt, und einem Diskriminator, der deren Realismus bewertet. Sie konkurrieren miteinander – der Generator lernt, immer überzeugendere Bilder zu erstellen, während der Diskriminator seine Fähigkeit verbessert, Fälschungen von Originalen zu unterscheiden. Das Ergebnis sind hochwertige synthetische Inhalte, die von echten nicht zu unterscheiden sind.

In der Medizin erstellt KI synthetische Daten zum Training diagnostischer Systeme, visualisiert chirurgische Verfahren und hilft bei der Identifizierung von Pathologien, beispielsweise der Nebenschilddrüsen. Synthetische Bilder ergänzen reale medizinische Daten unter Wahrung der Patientenvertraulichkeit. Anti-VEGF-Therapien und Bildanalysetechnologien nutzen aktiv KI-gestützte Lösungen.

Nein, das ist ein Mythos. Obwohl Deepfakes tatsächlich zur Erstellung von Desinformation und gefälschten Videos verwendet werden, hat die Technologie legitime Anwendungen: Filmsynchronisation, Erstellung virtueller Assistenten, Wiederherstellung historischer Aufnahmen. Das Problem liegt nicht in der Technologie, sondern in den Absichten der Nutzer und dem Fehlen von Regulierung.

Moderne Erkennungsmethoden analysieren Artefakte, Unstimmigkeiten in der Beleuchtung, unnatürliche Augenbewegungen und Mikroexpressionen im Gesicht. Spezialisierte Algorithmen prüfen digitale Spuren und Muster, die für KI-Generierung charakteristisch sind. Mit der Weiterentwicklung der Technologien steigt jedoch die Qualität synthetischer Inhalte, was die Erkennung selbst für Expertensysteme erschwert.

Nutzen Sie verfügbare Plattformen: Midjourney, DALL-E, Stable Diffusion oder europäische Alternativen. Beschreiben Sie das gewünschte Bild mit einem Text-Prompt und geben Sie Details zu Komposition, Stil und Stimmung an. Die Systeme generieren das Ergebnis in Sekunden und ermöglichen iterative Verbesserungen durch Präzisierung der Anfragen.

Virtuelle Influencer sind vollständig synthetische Charaktere, die mithilfe von KI und 3D-Modellierung erstellt wurden und Social-Media-Accounts betreiben. Sie bewerben Marken, interagieren mit dem Publikum und erstellen Inhalte wie echte Blogger. Beispiele sind Lil Miquela und Shudu, die Millionen Follower und kommerzielle Verträge haben.

Der Rechtsstatus ist uneindeutig und unterscheidet sich je nach Rechtsordnung. In den meisten Ländern erfordert das Urheberrecht menschliche Kreativität, daher sind vollständig KI-generierte Inhalte möglicherweise nicht geschützt. Wenn ein Mensch wesentlich an der Erstellung beteiligt war (Prompt-Engineering, Bearbeitung), können die Rechte anerkannt werden, aber die Rechtsprechung entwickelt sich erst.

Die Anforderungen unterscheiden sich nach Ländern, aber der Trend geht zur verpflichtenden Kennzeichnung. Die EU und einige US-Bundesstaaten führen Gesetze zur Offenlegung der KI-Herkunft von Inhalten ein, insbesondere bei politischer Werbung und Nachrichten. In Deutschland wird die Regulierung diskutiert, aber Plattformen implementieren bereits freiwillige Kennzeichnungen.

Das ist eine Vereinfachung. KI automatisiert Routineaufgaben und erweitert kreative Möglichkeiten, ersetzt aber nicht menschliche Vision, konzeptionelles Denken und emotionale Intelligenz. Profis passen sich an und nutzen KI als Werkzeug zur Beschleunigung der Arbeit und für Experimente, behalten aber ihre Rolle als Art Directors und Konzeptentwickler.

Nutzen Sie Multi-Faktor-Authentifizierung und Verifizierung über alternative Kommunikationskanäle bei ungewöhnlichen Anfragen. Vereinbaren Sie Codewörter mit Kollegen für kritische Vorgänge und prüfen Sie Videoanrufe auf Artefakte (unnatürliche Bewegungen, Lippensynchronisationsfehler). Schulen Sie Mitarbeiter darin, Anzeichen synthetischer Inhalte zu erkennen.

Diffusionsmodelle fügen einem Bild schrittweise Rauschen hinzu und lernen dann, es zu entfernen und Details wiederherzustellen. Der umgekehrte Diffusionsprozess ermöglicht die Generierung neuer Bilder aus zufälligem Rauschen, wobei das Ergebnis durch Textbeschreibungen gesteuert wird. Die Technologie gewährleistet hohe Qualität und Vielfalt und wird in Stable Diffusion und DALL-E eingesetzt.

Ja, synthetische Daten lösen das Problem fehlender realer Datensätze, insbesondere in der Medizin und vertraulichen Bereichen. KI generiert vielfältige Beispiele unter Beibehaltung der statistischen Eigenschaften der Originaldaten ohne Offenlegung persönlicher Informationen. Die Methode beschleunigt die Modellentwicklung und senkt die Kosten für die Datenerhebung.

Multimodale Systeme arbeiten gleichzeitig mit mehreren Datentypen: Text, Bildern, Audio und Video, um kohärente Inhalte zu erstellen. Beispielsweise die Generierung von Videos mit synchronisierter Sprache und Musik basierend auf Textbeschreibungen. Technologien wie GPT-4V und Gemini vereinen Modalitäten für natürlichere und kontextbezogene Interaktionen.

KI generiert virtuelle Objekte und Charaktere, die in Echtzeit über AR-Geräte auf die reale Welt projiziert werden. Anwendungen umfassen virtuelle Assistenten, interaktive Werbung und Schulungssimulationen. Die Kombination aus synthetischem Content und AR schafft immersive hybride Umgebungen für Arbeit, Bildung und Unterhaltung.

Ja, KI erstellt automatisch Untertitel, Audiodeskriptionen, Übersetzungen und passt Inhalte für Menschen mit Behinderungen an. Synthetische Stimmen vertonen Texte, und Bildgenerierung hilft, Konzepte für verschiedene Zielgruppen zu visualisieren. Die Technologien senken Barrieren beim Zugang zu Informationen und kulturellen Inhalten.