Was ein neuronales Netz wirklich ist — und warum der Begriff „Deep Learning" meist ungenau verwendet wird

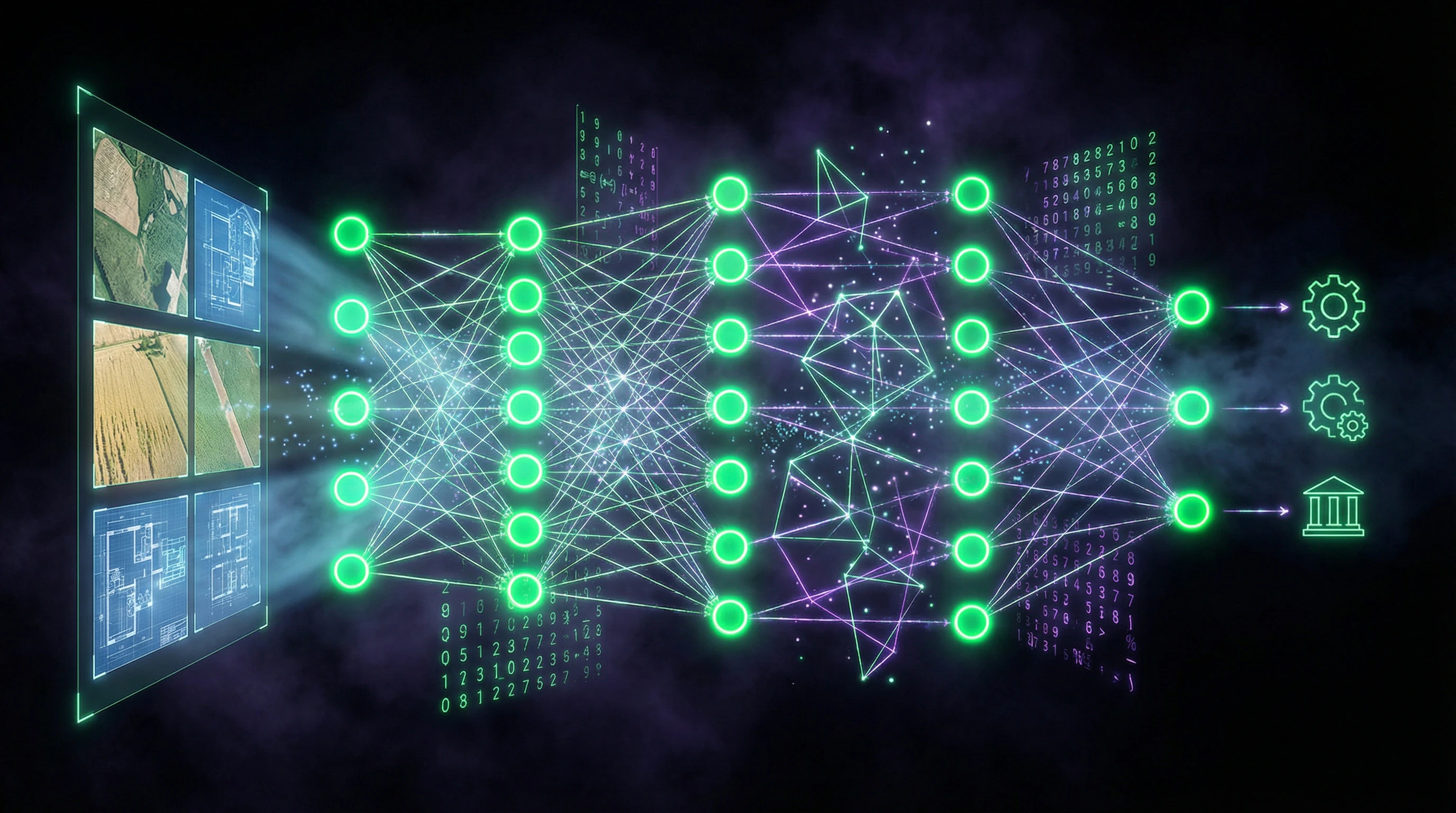

Ein neuronales Netz denkt nicht und versteht nicht. Es ist ein mathematisches Modell: Schichten gewichteter Funktionen, die Eingabedaten durch Matrixoperationen und nichtlineare Aktivierungen in Ausgabedaten transformieren. Mehr dazu im Abschnitt Ethik der künstlichen Intelligenz.

Der Begriff „neuronal" ist eine historische Metapher, die auf ein vereinfachtes Modell des biologischen Neurons aus den 1940er Jahren zurückgeht. Moderne Architekturen haben mit dem Gehirn so viel gemeinsam wie ein Flugzeug mit einem Vogel: Das Inspirationsprinzip existiert, der Funktionsmechanismus ist völlig anders (S012).

🔎 Architektonische Anatomie: vom Perzeptron zu Transformern

Die Grundeinheit ist das künstliche Neuron: Es empfängt Eingaben, multipliziert jede mit einem Gewicht, summiert, addiert einen Bias und leitet das Ergebnis durch eine Aktivierungsfunktion (Sigmoid, ReLU, tanh).

- Perzeptron (eine Schicht)

- Löst nur linear trennbare Probleme. Historisch die erste Architektur, aber praktisch nicht auf reale Daten anwendbar.

- Mehrschichtiges Perzeptron (MLP)

- Das Hinzufügen versteckter Schichten ermöglicht die Approximation jeder stetigen Funktion — universelles Approximationstheorem. Es sagt jedoch nichts darüber aus, wie viele Neuronen benötigt werden und wie man sie trainiert.

„Deep Learning" ist eine Unterklasse des maschinellen Lernens, die neuronale Netze mit vielen versteckten Schichten verwendet (üblicherweise mehr als drei). Der entscheidende Unterschied: Tiefe Netze extrahieren automatisch Merkmale aus Rohdaten, während traditionelle Algorithmen manuelles Feature Engineering erfordern (S012).

In Marketingmaterialien wird der Begriff „Deep Learning" oft auf jedes neuronale Netz angewendet, selbst auf ein zweischichtiges Perzeptron. Dies erzeugt die Illusion technologischer Komplexität, wo keine vorhanden ist.

🧱 Anwendungsgrenzen: wann ein neuronales Netz überdimensioniert ist

Kritischer Fehler: die Annahme, dass neuronale Netze anderen Methoden universell überlegen sind. In der Praxis stimmt das nicht.

| Bedingung | Neuronales Netz | Klassische Methoden |

|---|---|---|

| Kleines Datenvolumen (<1000 Beispiele) | Overfitting, Instabilität | Logistische Regression, Random Forest — besser |

| Klare lineare Abhängigkeiten | Überdimensioniert | Lineare Modelle — effizienter |

| Interpretierbarkeit erforderlich | „Black Box" | Gradient Boosting, Entscheidungsbäume — transparenter |

| Big Data + komplexe Muster | Optimal | Erfordern manuelles Feature Engineering |

Eine Studie zur Anwendung neuronaler Netze in der Landwirtschaft (2021) analysierte 147 Arbeiten: Nur 23% verwendeten Architekturen mit mehr als fünf Schichten, und 41% setzten neuronale Netze für Aufgaben ein, bei denen traditionelle Computer-Vision-Methoden (Schwellenwert-Segmentierung, morphologische Operationen) vergleichbare Ergebnisse bei deutlich geringerer Rechenkomplexität lieferten (S012).

Die Wahl des Werkzeugs wird oft nicht durch technische Anforderungen bestimmt, sondern durch den Technologie-Hype. Das ist ein systemisches Problem in der Branche.

Die fünf stärksten Argumente für neuronale Netze — und warum sie nur unter bestimmten Bedingungen funktionieren

Um einen Strohmann zu vermeiden, müssen die überzeugendsten Argumente der Befürworter eines breiten Einsatzes neuronaler Netze betrachtet werden. Diese Argumente haben eine reale Grundlage, aber ihre Validität ist streng auf den Anwendungskontext begrenzt. Mehr dazu im Abschnitt Synthetische Medien.

🔬 Erstes Argument: automatische Merkmalsextraktion aus Rohdaten

Traditionelle Algorithmen des maschinellen Lernens erfordern, dass ein Experte manuell festlegt, welche Dateneigenschaften für die Aufgabe wichtig sind. Bei Bildern können dies Kanten, Texturen, Farbhistogramme sein; bei Text — Worthäufigkeiten, N-Gramme, syntaktische Strukturen.

Tiefe neuronale Netze, insbesondere Convolutional Neural Networks (CNN) für Bilder und Recurrent Neural Networks (RNN) oder Transformer für Sequenzen, lernen automatisch, hierarchische Merkmale zu extrahieren: Die ersten Schichten detektieren einfache Muster (Kanten, Ecken), mittlere — Musterkombinationen (Texturen, Objektteile), letzte — komplexe Konzepte (ganze Objekte, semantische Beziehungen) (S008).

Dieser Vorteil ist in Bereichen kritisch wichtig, in denen der Merkmalsraum riesig und nicht offensichtlich ist. Anstatt Regeln manuell zu programmieren, lernt das Netz aus gelabelten Beispielen und identifiziert Muster, die ein menschlicher Experte möglicherweise übersehen hätte.

In der Landwirtschaft werden neuronale Netze erfolgreich zur Erkennung von Pflanzenkrankheiten anhand von Blattfotos eingesetzt. Eine Studie zeigt eine Genauigkeit von 94–98% bei der Klassifizierung von 12 Tomatenerkrankungen mit ResNet-50, während traditionelle Methoden mit manuellen Merkmalen nur 78–85% erreichten.

📊 Zweites Argument: Skalierbarkeit mit wachsenden Daten

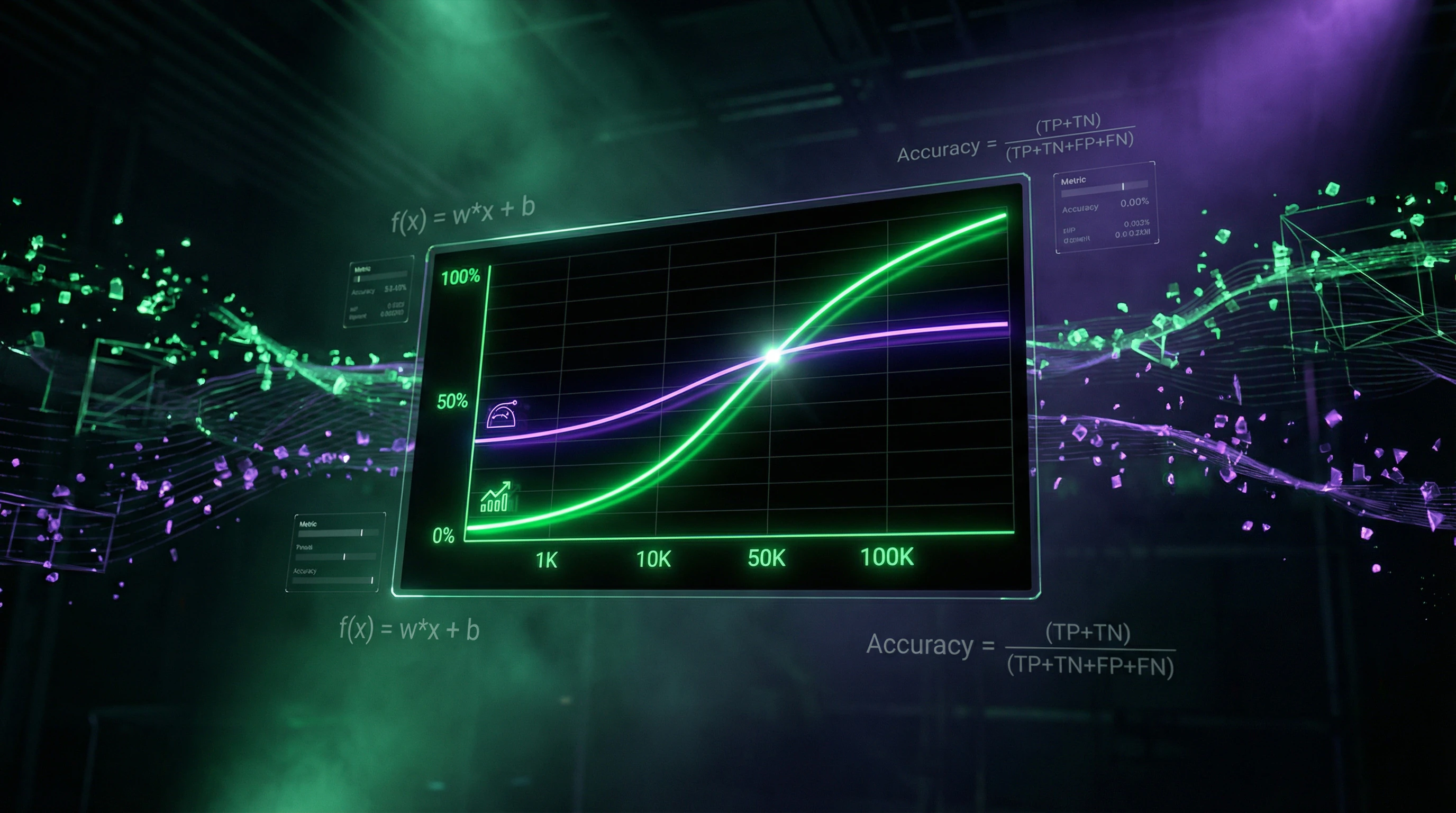

Klassische Algorithmen erreichen oft ein Leistungsplateau: Nach einem bestimmten Volumen an Trainingsdaten verbessern zusätzliche Beispiele die Modellqualität nicht mehr. Tiefe neuronale Netze zeigen eine Potenzabhängigkeit: Die Qualität steigt mit zunehmenden Daten weiter, wenn auch mit abnehmender Rate (S008).

Dies macht sie zur bevorzugten Wahl für Aufgaben, bei denen Millionen von Beispielen verfügbar sind — Spracherkennung (S001), maschinelle Übersetzung, Bildgenerierung.

- Dieses Argument hat jedoch eine kritische Einschränkung: Für die meisten angewandten Aufgaben in Wirtschaft und Wissenschaft stehen Hunderte oder Tausende von Beispielen zur Verfügung, nicht Millionen.

- Unter solchen Bedingungen neigen neuronale Netze zu Overfitting — dem Auswendiglernen von Trainingsbeispielen anstelle der Identifizierung allgemeiner Gesetzmäßigkeiten.

- Regularisierungsmethoden (Dropout, L2-Penalty, Data Augmentation) lösen das Problem teilweise, heben aber die fundamentale Tatsache nicht auf: Tiefe Netze benötigen große Datenmengen, um ihr Potenzial zu realisieren.

🧬 Drittes Argument: Transfer Learning und vortrainierte Modelle

Eine revolutionäre Entwicklung der letzten Jahre — die Möglichkeit, neuronale Netze zu verwenden, die auf riesigen Datensätzen vortrainiert wurden (ImageNet mit 14 Millionen Bildern, Common Crawl mit Terabytes an Text), und sie auf spezifischen Aufgaben mit wenigen Daten nachzutrainieren.

Transfer Learning funktioniert so: Die unteren Schichten des Netzes, die gelernt haben, universelle Merkmale zu erkennen (Kanten, Texturen, grundlegende Sprachmuster), werden eingefroren, während die oberen Schichten auf die Zielaufgabe umtrainiert werden (S008).

Im Immobilienbereich wird dieser Ansatz zur automatischen Bewertung von Objekten anhand von Fotos eingesetzt: Ein auf ImageNet vortrainiertes Modell wird auf einigen Tausend Wohnungsfotos mit bekannten Preisen nachtrainiert und erreicht einen mittleren absoluten Fehler von 8–12%, was mit den Bewertungen professioneller Gutachter vergleichbar ist, aber Sekunden statt Stunden benötigt.

🔁 Viertes Argument: Fähigkeit zur Modellierung komplexer nichtlinearer Abhängigkeiten

Viele reale Prozesse sind durch nichtlineare, multifaktorielle Abhängigkeiten mit Interaktionen höherer Ordnung gekennzeichnet. Beispielsweise hängt der Ernteertrag nicht einfach von Temperatur, Feuchtigkeit und Beleuchtung einzeln ab, sondern von deren komplexen Kombinationen: Hohe Temperaturen können bei ausreichender Feuchtigkeit günstig sein, aber bei Trockenheit verheerend.

Neuronale Netze modellieren solche Interaktionen auf natürliche Weise durch nichtlineare Aktivierungen und mehrere Schichten.

- Überbewertung des Arguments

- Gradient Boosting (XGBoost, LightGBM) modelliert ebenfalls effektiv nichtlineare Interaktionen und übertrifft oft neuronale Netze bei tabellarischen Daten mit geringerem Rechenaufwand und besserer Interpretierbarkeit.

- Wo neuronale Netze wirklich gewinnen

- Bei Daten mit räumlicher (Bilder) oder zeitlicher (Sequenzen) Struktur, wo ihre architektonischen Besonderheiten (Faltungen, rekurrente Verbindungen, Aufmerksamkeitsmechanismen) natürlich der Datenstruktur entsprechen.

✅ Fünftes Argument: End-to-End-Lernen und Optimierung der Zielmetrik

Traditionelle Systeme bestehen oft aus einer Sequenz von Modulen, die jeweils unabhängig optimiert werden: Datenvorverarbeitung → Merkmalsextraktion → Klassifikation → Nachbearbeitung. Fehler akkumulieren sich in jeder Phase, und die Optimierung eines Moduls garantiert keine Verbesserung des Endergebnisses.

Neuronale Netze ermöglichen das Training des gesamten Systems als Ganzes (End-to-End), wobei direkt die Zielmetrik optimiert wird (Klassifikationsgenauigkeit, Übersetzungsqualität, Gewinn aus Empfehlungen).

| Bedingung | Vorteil von End-to-End | Risiko |

|---|---|---|

| Klar definierte Qualitätsmetrik | Direkte Optimierung des Zielergebnisses | System kann Datenartefakte ausnutzen |

| Differenzierbarkeit aller Operationen | Fehlergradient propagiert durch alle Phasen | Unerwartete Lösungen statt Lösung der realen Aufgabe |

| Beispiel: Pneumonie-Klassifikation | Neuronales Netz lernte nicht die Pathologie zu erkennen, sondern den Röntgengerätetyp, weil Aufnahmen aus verschiedenen Krankenhäusern mit Diagnosen korrelierten | |

Dieser Ansatz erfordert zusätzliche Überprüfung: Validierung auf unabhängigen Daten, Analyse der Merkmale, die das Netz zur Lösung verwendet, und überzeugender Nachweis, dass das System genau die Zielaufgabe löst und nicht ein Nebenartefakt.

Evidenzbasis: Was in realen Anwendungen funktioniert und was in Präsentationen bleibt

Der Übergang von theoretischen Argumenten zu empirischen Daten offenbart eine erhebliche Kluft zwischen Versprechen und Ergebnissen. Eine systematische Analyse der Anwendung neuronaler Netze in zwei konkreten Bereichen — Landwirtschaft und Immobilien — ermöglicht es, Muster von Erfolg und Misserfolg zu identifizieren. Mehr dazu im Abschnitt Ethik und Sicherheit der KI.

🧪 Landwirtschaft: Von Krankheitserkennung bis Ertragsvorhersage

Eine Übersicht über 147 Studien zur Anwendung neuronaler Netze, Deep Learning und Computer Vision in der Landwirtschaft aus dem Jahr 2021 zeigt folgendes Bild: 68% der Arbeiten widmen sich Klassifikationsaufgaben (Pflanzenkrankheiten, Kulturarten, Fruchtreife), 22% der Objekterkennung (Unkraut, Schädlinge, einzelne Pflanzen), 10% der Segmentierung und Vorhersage.

| Aufgabe | Anteil der Studien | Durchschnittliche Genauigkeit |

|---|---|---|

| Klassifikation | 68% | 91–96% |

| Objekterkennung | 22% | 82–89% |

| Ertragsvorhersage | 10% | 76–84% |

Eine kritische Analyse der Methodik deckt systemische Probleme auf. 73% der Arbeiten verwenden öffentliche Datensätze (PlantVillage, ImageNet subset), die unter kontrollierten Bedingungen gesammelt wurden: Fotos von Blättern vor homogenem Hintergrund, ideale Beleuchtung, keine Verdeckungen (S012).

Die Leistung auf kontrollierten Daten lässt sich nicht auf reale Feldbedingungen übertragen. Studien, die Modelle in der Realität testeten, zeigen einen Genauigkeitsverlust von 15–30 Prozentpunkten.

Nur 12% der Arbeiten vergleichen neuronale Netze mit traditionellen Computer-Vision-Methoden auf denselben Daten. Von diesen Arbeiten zeigen 45%, dass neuronale Netze traditionelle Methoden um weniger als 5 Prozentpunkte übertreffen — ein Unterschied, der den vielfach höheren Rechenaufwand möglicherweise nicht rechtfertigt (S012).

Die Erkennung der Tomatenreife anhand der Farbe lässt sich effektiv durch einfache Schwellenwert-Segmentierung im HSV-Farbraum lösen, ohne ein tiefes Netzwerk trainieren zu müssen. Dies ist ein typisches Muster: Wo visuelle Merkmale eindeutig sind, fügen neuronale Netze Komplexität ohne Gewinn hinzu.

🏢 Immobilien: Wertermittlung und Nachfrageprognose

Eine systematische Übersicht über die digitale Transformation in der Immobilienbranche identifiziert drei Hauptanwendungsbereiche neuronaler Netze: automatische Immobilienbewertung (Automated Valuation Models, AVM), Nachfrage- und Preisprognose, Bildanalyse zur Klassifizierung und Beschreibung von Objekten (S009).

Von 89 analysierten Arbeiten verwenden 52% neuronale Netze für AVM, 31% für die Vorhersage von Preiszeitreihen, 17% für Bildanalyse.

- Ergebnisse für AVM (neuronale Netze vs. traditionelle Modelle)

- Mittlerer absoluter prozentualer Fehler (MAPE): 8–15% gegenüber 10–18%. Der Vorteil zeigt sich nur bei großen Stichproben (über 50.000 Objekte) und bei Einbeziehung unstrukturierter Daten (Textbeschreibungen, Bilder) (S009).

- Bei kleinen Stichproben (unter 5.000 Objekten)

- Gradient Boosting zeigt vergleichbare oder bessere Ergebnisse bei deutlich kürzerer Trainingszeit.

- Kritisches Problem: Intransparenz der Bewertung

- Regulierungsbehörden und Gerichte verlangen Erklärungen, warum ein Modell ein Objekt mit einem bestimmten Betrag bewertet hat. Neuronale Netze als „Black Boxes" können solche Erklärungen nicht liefern, was ihre Anwendung in rechtlich relevanten Kontexten einschränkt (S009).

Interpretationsmethoden (SHAP, LIME) liefern nur ungefähre Erklärungen und lösen das Problem nicht vollständig. Dies ist eine fundamentale Einschränkung, kein technisches Detail.

🧾 Metaanalyse: Muster von Erfolg und Misserfolg

Die Synthese der Daten aus beiden Übersichten ermöglicht es, Bedingungen zu identifizieren, unter denen neuronale Netze einen echten Vorteil gegenüber Alternativen zeigen (S009, S012).

- Große Datenmengen: mehr als 10.000 gelabelte Beispiele für Klassifikationsaufgaben, mehr als 50.000 für Regression. Bei kleineren Mengen sind traditionelle Methoden mit manueller Feature-Engineering oft effizienter.

- Komplexe Datenstruktur: Bilder, Videos, Audio, Texte — Daten, bei denen räumliche oder zeitliche Struktur kritische Informationen trägt. Bei tabellarischen Daten ist der Vorteil neuronaler Netze minimal.

- Verfügbarkeit von Rechenressourcen: Das Training tiefer Netze erfordert GPU oder TPU. Für Echtzeitaufgaben auf Edge-Geräten (Drohnen, mobile Anwendungen) ist Modelloptimierung erforderlich (Quantisierung, Pruning, Distillation), was Komplexität hinzufügt.

- Fehlertoleranz: Bei Aufgaben, bei denen Fehler nicht kritisch sind (Empfehlungssysteme, Ranking von Suchergebnissen), sind neuronale Netze effektiv. Bei Aufgaben mit hohen Fehlerkosten (medizinische Diagnostik, autonomes Fahren) sind zusätzliche Validierung und Sicherheitsmechanismen erforderlich.

Bedingungen für Misserfolg: kleine Daten, Anforderungen an Interpretierbarkeit, begrenzte Rechenressourcen, Notwendigkeit schneller Anpassung an Veränderungen (Concept Drift), Aufgaben mit klaren Regeln und Logik.

Die reale Wahl zwischen neuronalen Netzen und Alternativen ist keine Wahl zwischen „Magie" und „Gewöhnlichkeit". Es ist eine ingenieurtechnische Entscheidung, die von konkreten Aufgabenbeschränkungen abhängt. Marketing-Lärm entsteht, wenn diese Beschränkungen ignoriert werden.

Mechanismen und Kausalität: Warum neuronale Netze funktionieren — und warum das keine Magie ist

Das Verständnis der Mechanismen, die dem Erfolg neuronaler Netze zugrunde liegen, ist entscheidend, um reale Möglichkeiten von mythologisierten Vorstellungen zu trennen. Mehr dazu im Abschnitt Realitätsprüfung.

🧬 Hierarchische Merkmalsrepräsentation: Von Pixeln zu Konzepten

Eine fundamentale Eigenschaft tiefer Netze ist die Fähigkeit, hierarchische Datenrepräsentationen aufzubauen. In Convolutional Neural Networks für Bilder lernt die erste Schicht, einfache Muster zu erkennen (Kanten in verschiedenen Winkeln, Farbverläufe), die zweite Schicht kombiniert diese Muster zu komplexeren (Ecken, Bögen, einfache Texturen), die dritte zu noch komplexeren (Objektteile: Räder, Fenster, Blätter), und so weiter bis zu den finalen Schichten, die ganze Objekte und Szenen repräsentieren (S008).

Das ist keine Magie, sondern eine Folge der Optimierung: Jede Schicht lernt, die Eingabedaten so zu transformieren, dass die nächste Schicht ihre Teilaufgabe leichter lösen kann. Gradientenabstieg mit Backpropagation findet solche Transformationen automatisch, indem die Verlustfunktion auf den Trainingsdaten minimiert wird. Entscheidend: Das Netz „versteht" keine Konzepte, es findet statistische Regelmäßigkeiten in den Daten, die mit den Klassenlabels korrelieren.

Das Netz lernt keine universellen Merkmale, sondern spezifische Muster des Trainingsdatensatzes. Dieser Unterschied zwischen Korrelation und Kausalität ist die Hauptfalle, die hohe Genauigkeit zur Illusion werden lässt.

🔁 Korrelation versus Kausalität: Eine fundamentale Einschränkung

Neuronale Netze lernen, Korrelationen zu finden, nicht Kausalzusammenhänge. Wenn in den Trainingsdaten alle Fotos von Kühen vor Grashintergrund aufgenommen wurden, kann das Netz lernen, Gras statt Kühe zu erkennen — und wird jedes Bild mit Gras als „Kuh" klassifizieren, selbst wenn keine Kuh darauf ist. Das nennt man Spurious Correlation (Scheinkorrelation), und das ist ein systemisches Problem aller Machine-Learning-Methoden, nicht nur neuronaler Netze (S004).

In der Landwirtschaft zeigt sich dies in der Unfähigkeit von Modellen, auf neue Bedingungen zu generalisieren: Ein Netz, das trainiert wurde, Tomatenkrankheiten in einer Region zu erkennen, kann in einer anderen Region mit anderem Klima, anderen Pflanzensorten und Anbaumethoden niedrige Genauigkeit zeigen. Die Lösung erfordert entweder Datensammlung aus allen Zielbedingungen oder Domain-Adaptation-Methoden, die selbst ein aktives Forschungsgebiet ohne garantierte Lösungen sind.

- Prüfen: Decken die Trainingsdaten alle Zielbedingungen der Anwendung ab?

- Identifizieren: Welche Variablen in den Daten korrelieren mit der Zielvariable, sind aber nicht kausal verbunden?

- Testen: Das Modell auf Daten aus neuen Bedingungen, die nicht im Training waren.

- Dokumentieren: Anwendbarkeitsgrenzen des Modells und Bedingungen, unter denen es versagen kann.

🧷 Confounder und versteckte Variablen: Warum hohe Genauigkeit eine Illusion sein kann

Ein Confounder ist eine Variable, die sowohl die Eingabedaten als auch die Zielvariable beeinflusst und dadurch eine Scheinkorrelation zwischen ihnen erzeugt. Klassisches Beispiel aus der Medizin: Ein neuronales Netz zur Pneumonie-Diagnose aus Röntgenaufnahmen zeigte 95% Genauigkeit auf Testdaten, aber bei der Einführung in die klinische Praxis fiel die Genauigkeit auf 70%. Grund: In den Trainingsdaten wurden Aufnahmen von Pneumonie-Patienten häufiger mit portablen Röntgengeräten gemacht (weil schwerkranke Patienten nicht in die Röntgenabteilung kommen konnten), und das Netz lernte, den Gerätetyp zu erkennen, nicht die Pathologie (S003).

Im Immobilienbereich ein analoges Problem: Ein Bewertungsmodell kann die Korrelation zwischen Fotoqualität und Preis lernen (teure Objekte werden von Profis fotografiert) und die Bewertung für jedes Objekt mit professionellen Fotos überhöhen, unabhängig von den realen Eigenschaften. Die Identifikation und Kontrolle von Confoundern erfordert Fachexpertise und kann nicht vollständig automatisiert werden.

- Versteckter Confounder

- Eine Variable, die im Datensatz nicht gemessen wird, aber die Beziehung zwischen Eingabe und Ausgabe beeinflusst. Beispiel: Der sozioökonomische Status eines Patienten beeinflusst sowohl den Zugang zu qualitativ hochwertiger Diagnostik als auch das Behandlungsergebnis, kann aber in medizinischen Daten nicht erfasst sein.

- Erkennungsmethode

- Vergleichen Sie die Modellleistung auf Datenuntergruppen (nach Geschlecht, Alter, Geografie, Erhebungszeitpunkt). Wenn die Genauigkeit stark variiert, ist ein Confounder wahrscheinlich.

- Warum das kritisch ist

- Ein Modell kann auf Testdaten perfekt funktionieren, aber in der realen Anwendung versagen, wenn sich die Verteilung der Confounder geändert hat.

Hohe Genauigkeit auf einem Testdatensatz ist keine Garantie für Funktionsfähigkeit in der realen Welt. Es ist nur eine Garantie dafür, dass das Modell die Muster in einem spezifischen Datensatz gut gelernt hat, einschließlich seiner Artefakte und Verzerrungen.

Kognitive Anatomie des Mythos: Welche Denkfallen lassen uns an die „Magie der KI" glauben

Die Mythologisierung neuronaler Netze ist kein Zufall. Sie ist das Ergebnis des Zusammentreffens dreier kognitiver Fallen: Anthropomorphismus, selektive Aufmerksamkeit und sozialer Beweis. Mehr dazu im Abschnitt Grundlagen der Erkenntnistheorie.

Wenn ein System Text produziert, der menschlich wirkt, schreibt das Gehirn ihm automatisch Verständnis zu. Das ist kein Wahrnehmungsfehler – es ist evolutionäre Ökonomie: Wenn etwas wie ein Mensch spricht, denkt es wahrscheinlich wie ein Mensch.

- Anthropomorphismus: Wir schreiben jedem komplexen Verhalten Bewusstsein und Absicht zu

- Selektive Aufmerksamkeit: Wir bemerken Erfolge, ignorieren Fehler und Grenzfälle

- Sozialer Beweis: Wenn alle von der „Magie der KI" sprechen, muss sie real sein

- Illusion des Verstehens: Die Komplexität des Algorithmus erscheint uns als Synonym für Bewusstsein

Selektive Aufmerksamkeit verstärkt den Effekt. Wenn ChatGPT ein Gedicht schreibt, wird das zur Nachricht. Wenn es Fakten halluziniert oder Logik verwechselt – bleibt das im Schatten.

Der Mythos von der Magie der KI beruht nicht auf Fakten, sondern auf Informationsasymmetrie: Wir sehen den Output, aber nicht den Mechanismus. Ungewissheit wird mit Mystik gefüllt.

Sozialer Beweis schließt den Kreislauf. Medien, Investoren, selbst Wissenschaftler verwenden die Sprache der Magie – nicht weil sie daran glauben, sondern weil sie funktioniert. Sprache erschafft die Realität der Wahrnehmung.

Der Schutz vor diesen Fallen ist einfach: Überprüfe deine Annahmen, verlange den Mechanismus, nicht das Ergebnis, und denk daran – Komplexität ≠ Bewusstsein.