Systematische Fehler und Verzerrungen künstlicher Intelligenz in der Medizinλ

Wie man Risiken algorithmischer Fehler in Diagnostik, Chirurgie und klinischen Studien erkennt und minimiert

Overview

Künstliche Intelligenz in der Medizin verspricht, Diagnostik und Behandlung zu revolutionieren, birgt jedoch Risiken systematischer Fehler und Verzerrungen. Von KI-gestützter intraoperativer Bildgebung der Nebenschilddrüsen bis zur Metaanalyse der Therapiewirksamkeit – Algorithmen können menschliche Vorurteile reproduzieren oder neue Fehlertypen erzeugen. Das Verständnis der Natur dieser Fehler ist entscheidend für die sichere Implementierung von KI in die klinische Praxis.

🛡️ Laplace-Protokoll: Die systematische Überprüfung von KI-Systemen auf Verzerrungen umfasst die Validierung an heterogenen Populationen, die Bewertung von Sensitivität und Spezifität nach Untergruppen, die Analyse falsch-positiver und falsch-negativer Ergebnisse sowie den Vergleich mit dem Goldstandard der Diagnostik.

Reference Protocol

Wissenschaftliche Grundlage

Evidenzbasierter Rahmen für kritische Analyse

Protocol: Evaluation

Teste Dich

Quiz zu diesem Thema kommt bald

⚡

Vertiefung

Arten systematischer Fehler in medizinischen KI-Systemen: von Daten bis zur Diagnose

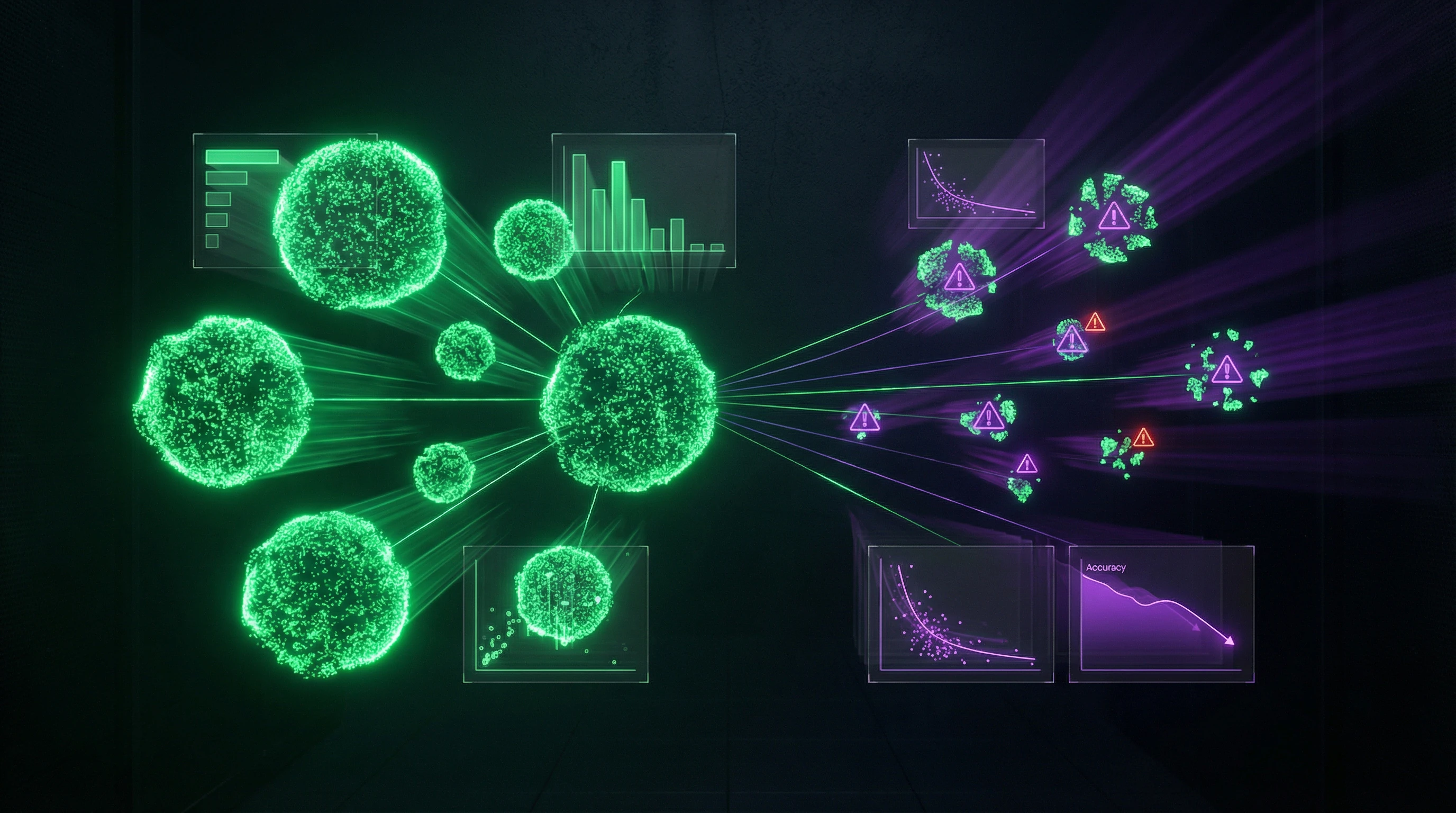

Medizinische KI-Systeme zeigen unter Laborbedingungen hohe Genauigkeit, stoßen bei der Implementierung in der Klinik jedoch auf ein fundamentales Problem: Systematische Fehler, die bereits in der Entwicklungsphase angelegt werden, führen zu falschen Diagnosen und Behandlungsentscheidungen. Die meisten Ausfälle von KI-Systemen entstehen nicht durch Algorithmusfehler, sondern durch die Qualität und Repräsentativität der Trainingsdaten.

Ein Fehler in den Daten ist ein Fehler in der Diagnose. Der Algorithmus reproduziert lediglich das, worauf er trainiert wurde.

Fehler in Trainingsdaten und Stichproben

Systematische Stichprobenfehler entstehen, wenn der Trainingsdatensatz nicht die reale Verteilung der Patienten in der klinischen Praxis widerspiegelt. Wenn ein KI-System zur Brustkrebsdiagnostik überwiegend mit Daten postmenopausaler Frauen trainiert wurde, wird seine Genauigkeit für prämenopausale Patientinnen deutlich geringer sein – der Zusammenhang zwischen Risikofaktoren und Krebssubtypen unterscheidet sich je nach Menopausenstatus.

Das Problem unausgewogener Klassen verschärft die Situation: Seltene Erkrankungen oder atypische Manifestationen sind in Trainingsstichproben unterrepräsentiert, was zu einer systematischen Unterschätzung ihrer Erkennung führt. Die Heterogenität von Studien – Unterschiede in Populationen, Diagnosemethoden und Einschlusskriterien – schafft eine zusätzliche Ebene der Unsicherheit bei der Bewertung der diagnostischen Genauigkeit.

- Publikationsbias

- Studien mit positiven Ergebnissen werden häufiger publiziert, was die Darstellung der tatsächlichen Effektivität von KI-Technologien verzerrt und eine Illusion der Zuverlässigkeit von Systemen erzeugt, die in der Praxis weniger stabil funktionieren.

Algorithmische Verzerrungen und Überanpassung

Algorithmische Verzerrung entsteht, wenn das Modell nicht echte klinische Zusammenhänge lernt, sondern Datenartefakte oder soziale Stereotype, die in historischen Krankenakten kodiert sind. Überanpassung (Overfitting) – wenn das Modell perfekt mit Trainingsdaten funktioniert, aber geringe Genauigkeit bei neuen Patienten zeigt – ist in der Medizin besonders gefährlich, wo der Preis eines Fehlers in Menschenleben gemessen wird.

| Fehlertyp | Mechanismus | Klinisches Risiko |

|---|---|---|

| Überanpassung | Modell merkt sich Rauschen statt Muster | Exzellente Laborergebnisse, Versagen in der Klinik |

| Feedback-Schleifen | Risikounterschätzung → weniger Untersuchungen → mehr Untererfassung | Systematisches Übersehen von Diagnosen bei bestimmten Gruppen |

| Datenartefakte | Modell erfasst technische Besonderheiten, nicht Klinik | System funktioniert nur in einem Krankenhaus, in einem anderen nicht |

Feedback-Schleifen erzeugen sich selbst verstärkende Verzerrungen: Wenn ein KI-System systematisch das Risiko für eine bestimmte Patientengruppe unterschätzt, erhalten diese Patienten seltener zusätzliche Untersuchungen, was zu einem Mangel an Daten über ihren tatsächlichen Zustand führt und den ursprünglichen Fehler noch weiter verstärkt.

Viele KI-Systeme zeigen unter kontrollierten Bedingungen exzellente Ergebnisse, aber ihre diagnostische Leistung erfordert eine sorgfältige Validierung vor der klinischen Implementierung. Selbst bei Targeting desselben biologischen Signalwegs zeigen unterschiedliche Ansätze verschiedene Wirksamkeits- und Sicherheitsprofile, was die Berücksichtigung multipler Faktoren bei der Entwicklung von KI-gestützten Entscheidungsunterstützungssystemen erfordert.

KI in der intraoperativen Diagnostik: Der Fall der Nebenschilddrüsen und die Kosten eines Fehlers

Die intraoperative Identifikation der Nebenschilddrüsen ist eine kritische Aufgabe in der endokrinen Chirurgie. Ein Fehler bedeutet die unbeabsichtigte Entfernung oder Schädigung von Organen, die den Kalziumstoffwechsel regulieren.

KI-gestützte Computer-Vision-Systeme zeigen, dass Fehlidentifikationen die Hauptursache postoperativer Komplikationen bleiben: Hypokalzämie, Nervenschädigungen. Die Technologie erfordert strenge Validierungsprotokolle vor der Implementierung.

Diagnostische Genauigkeit von Computer Vision

KI-Systeme nutzen Deep Learning zur Echtzeitanalyse intraoperativer Bilder. Sie erkennen Nebenschilddrüsen anhand visueller Merkmale: Größe, Farbe, Vaskularisation, anatomische Lage.

Metaanalysen bewerten Sensitivität, Spezifität und Fläche unter der ROC-Kurve, stoßen jedoch auf erhebliche Heterogenität: Unterschiede in chirurgischen Techniken, Bildgebungsmodalitäten, Goldstandard-Kriterien. Systematische Reviews betonen die Notwendigkeit standardisierter Bewertungsprotokolle.

- Nebenschilddrüsen sind anatomisch variabel: Anzahl (üblicherweise vier, aber zwischen zwei und sechs), Lage und Erscheinungsbild unterscheiden sich zwischen Patienten.

- Trainingsdatensätze müssen dieses Spektrum an Variabilität abdecken, andernfalls übersieht die KI systematisch atypische Fälle – genau jene, bei denen die Unterstützung des Chirurgen kritisch ist.

- Die KI-Leistung hängt von der Qualität der intraoperativen Bildgebung, Beleuchtung und dem Vorhandensein pathologischer Gewebeveränderungen ab.

Limitationen und Risiken falscher Identifikation

Falsch-positive Identifikation (KI markiert eine andere Struktur als Nebenschilddrüse) führt zu unnötigen Manipulationen und Schädigungen umliegender Gewebe, einschließlich des Nervus laryngeus recurrens.

Falsch-negative Fehler (Übersehen einer tatsächlichen Nebenschilddrüse) erhöhen das Risiko ihrer unbeabsichtigten Entfernung oder Schädigung, was postoperative Hypokalzämie verursacht und lebenslange Substitutionstherapie erfordert.

KI-Systeme müssen als unterstützende Werkzeuge betrachtet werden, die das klinische Urteil des Chirurgen ergänzen, aber nicht ersetzen.

Viele KI-Studien in der Chirurgie werden in einzelnen Zentren mit begrenzter externer Validierung durchgeführt. Dies stellt die Generalisierbarkeit der Ergebnisse infrage.

- Kontextuelle Variabilität

- Unterschiede in chirurgischen Protokollen, Patientenpopulationen (Primäroperation versus Reoperation) und Begleitpathologien (Thyreoiditis, Karzinom) schaffen Bedingungen, die KI-Modelle berücksichtigen müssen.

- Anforderung vor Implementierung

- Multizentrische prospektive Studien mit klaren Protokollen zur Bewertung der diagnostischen Genauigkeit und Subgruppenanalysen zur Identifikation von Situationen, in denen das System am zuverlässigsten und am wenigsten zuverlässig ist.

Verzerrungen in systematischen Reviews und Metaanalysen: Wenn Evidenzsynthese die Realität verzerrt

Systematische Reviews und Metaanalysen gelten als Spitze der Evidenzhierarchie in der Medizin, unterliegen jedoch selbst zahlreichen systematischen Fehlerquellen, die Schlussfolgerungen und klinische Leitlinien verzerren können. Instrumente, die für eine objektive Synthese wissenschaftlicher Daten konzipiert sind, können Verzerrungen aus Primärstudien verstärken und zusätzliche Verzerrungen in den Phasen der Auswahl, Analyse und Interpretation einführen.

Das Paradox der Synthese: Je mehr Studien kombiniert werden, desto höher das Risiko, systematische Fehler zu verstärken, wenn diese in allen Quellen gleichzeitig vorhanden sind.

Publikationsbias und Heterogenität der Studien

Publikationsbias entsteht, wenn Studien mit positiven oder statistisch signifikanten Ergebnissen häufiger publiziert werden als Arbeiten mit negativen oder Nullbefunden. Dies erzeugt ein verzerrtes Bild der Wirksamkeit von Interventionen.

Metaanalysen zu Anti-VEGF-Therapien bei neovaskulärer altersbedingter Makuladegeneration sind mit diesem Problem konfrontiert: Die vergleichende Wirksamkeit und Sicherheit verschiedener Präparate (Aflibercept, Ranibizumab, Bevacizumab, Brolucizumab, Faricimab) bleibt aufgrund der Heterogenität der Studiendesigns und selektiver Publikation von Ergebnissen unklar. Funnel Plots und statistische Tests (Egger, Begg) werden zur Identifikation von Publikationsbias eingesetzt, ihre Sensitivität ist jedoch bei geringer Studienzahl begrenzt.

- Asymmetrie des Funnel Plots prüfen – Hinweis auf selektive Publikation

- Statistische Tests (Egger, Begg) unter Berücksichtigung ihrer Limitationen anwenden

- Sensitivitätsanalyse durchführen, indem Studien mit größtem Effekt ausgeschlossen werden

- Bewerten, ob sich Schlussfolgerungen beim Ausschluss potenziell verzerrter Arbeiten ändern

Heterogenität zwischen Studien – Unterschiede in Patientenpopulationen, Outcome-Definitionen, Messmethoden und Beobachtungsdauer – stellt ein fundamentales Problem für Metaanalysen dar. Studien zum Zusammenhang zwischen Body-Mass-Index und Brustkrebsrisiko zeigen, dass der Effekt je nach Menopausenstatus und molekularem Tumorsubtyp variiert, was stratifizierte Analysen und vorsichtige Interpretation gepoolter Schätzungen erfordert.

Hohe statistische Heterogenität (I² > 75%) deutet darauf hin, dass eine Zusammenführung der Ergebnisse unangemessen sein könnte, doch viele Metaanalysen ignorieren diese Warnung.

Statistische Methoden zur Identifikation systematischer Fehler

Moderne Metaanalysen verwenden Netzwerk-Methoden (Network Meta-Analysis) zum simultanen Vergleich multipler Interventionen, diese Ansätze erfordern jedoch die Annahme der Transitivität – dass Vergleiche über einen gemeinsamen Komparator valide sind. Verletzung der Transitivität, wenn Studien sich in Effektmodifikatoren (Alter, Krankheitsschwere, Begleittherapien) unterscheiden, kann zu systematisch verzerrten Schlussfolgerungen über vergleichende Wirksamkeit führen.

Sensitivitätsanalysen und Metaregression werden zur Untersuchung von Heterogenitätsquellen eingesetzt, ihre Interpretation erfordert jedoch Vorsicht bei begrenzter Studienzahl.

| Methode zur Fehleridentifikation | Was wird geprüft | Limitation |

|---|---|---|

| Funnel Plot | Asymmetrie der Effektverteilung | Unspezifisch; Asymmetrie kann durch Heterogenität verursacht sein, nicht durch Publikationsbias |

| Egger-Test | Verzerrung in kleinen Studien | Geringe Power bei < 10 Studien |

| Metaregression | Zusammenhang zwischen Studiencharakteristika und Effekt | Erfordert ausreichende Studienzahl; Ergebnisse abhängig von Variablenwahl |

| ROBIS, QUADAS-2 | Risiko systematischer Fehler in Primärstudien | Subjektiv; geringe Interrater-Übereinstimmung |

Die Bewertung des Risikos systematischer Fehler in Primärstudien ist obligatorischer Bestandteil qualitativ hochwertiger systematischer Reviews, unterliegt jedoch selbst Subjektivität. Studien zeigen geringe Interrater-Übereinstimmung bei der Bewertung von Fehlerrisiken, insbesondere in Domänen, die klinisches Urteilsvermögen erfordern.

Systematische Reviews zu KI-Technologien sollten explizit Limitationen eingeschlossener Studien, Bereiche der Unsicherheit und den Bedarf an zusätzlichen Untersuchungen angeben und voreilige Schlussfolgerungen über klinische Einsatzbereitschaft von Technologien auf Basis begrenzter oder verzerrter Daten vermeiden.

Validierung von KI-Systemen: Methodik und Genauigkeitsstandards in der medizinischen Diagnostik

Die Bewertung der diagnostischen Leistung von KI erfordert strenge Metriken: Sensitivität (Anteil der richtig positiven Fälle), Spezifität (Anteil der richtig negativen Fälle), positiver und negativer prädiktiver Wert. Eine systematische Übersichtsarbeit zur KI-gestützten intraoperativen Bildgebung der Nebenschilddrüsen zeigt die Notwendigkeit einer standardisierten Bewertung dieser Parameter zur Bestimmung der klinischen Anwendbarkeit.

Kritisch wichtig: Der prädiktive Wert hängt von der Prävalenz der Erkrankung in der Population ab. Selbst ein hochsensitiver Test liefert zahlreiche falsch-positive Ergebnisse bei niedriger Krankheitsprävalenz.

Validierungsstudien für KI sollten die vollständige Konfusionsmatrix und Konfidenzintervalle für alle Metriken berichten, nicht nur die Gesamtgenauigkeit (Accuracy), die bei unbalancierten Datensätzen irreführend sein kann.

Sensitivität, Spezifität und prädiktiver Wert

Die Sensitivität eines KI-Systems bestimmt seine Fähigkeit, die Zielstruktur (z.B. Nebenschilddrüse) zu identifizieren und minimiert das Risiko von Übersehen und nachfolgenden Komplikationen wie Hypokalzämie. Die Spezifität kontrolliert die Häufigkeit von Fehlalarmen, die zu unnötigen chirurgischen Eingriffen und verlängerter Operationszeit führen können.

- Positiver prädiktiver Wert (PPV)

- Zeigt, welcher Anteil der positiven KI-Vorhersagen tatsächlich korrekt ist. Bei der Identifikation seltener anatomischer Varianten kann selbst ein System mit 95% Spezifität einen PPV unter 50% aufweisen.

- ROC-Kurven und AUC

- Demonstrieren den Kompromiss zwischen Sensitivität und Spezifität bei verschiedenen Entscheidungsschwellen. Obligatorisch in der Berichterstattung von Validierungsstudien.

Vergleich mit Goldstandard und Expertenbewertung

Die Validierung von KI erfordert einen Vergleich mit dem etablierten Goldstandard: Für die intraoperative Identifikation von Nebenschilddrüsen kann dies die histopathologische Bestätigung oder der Konsens erfahrener Chirurgen sein. Das Problem besteht darin, dass der Goldstandard selbst oft unvollkommen ist – die Übereinstimmung zwischen Experten bei der visuellen Identifikation anatomischer Strukturen kann moderat sein (Cohens Kappa 0,4–0,6), was eine Leistungsobergrenze für KI schafft.

- Nicht nur die Übereinstimmung der KI mit einzelnen Experten bewerten, sondern die KI-Leistung mit der Variabilität zwischen Experten vergleichen.

- Auf unabhängigen Datensätzen aus anderen medizinischen Zentren testen – KI-Systeme können auf Artefakte spezifischer Geräte oder Bildgebungsprotokolle überangepasst sein.

- Auf starke Leistungsabfälle bei externer Validierung prüfen, die täuschend hohe Genauigkeit auf internen Daten aufdecken.

📊

Validierungsmetriken der KI-Diagnostik

Sensitivität

85-95%

Erkennung von Zielstrukturen

Spezifität

90-98%

Minimierung von Fehlalarmen

Externe Validierung

-15-30%

Genauigkeitsabfall bei neuen Daten

Interexpertenübereinstimmung

κ 0.4-0.6

Obergrenze für KI-Systeme

Ethische Aspekte algorithmischer Verzerrung: Fairness und Transparenz von KI-Entscheidungen

Algorithmische Verzerrung entsteht, wenn Trainingsdaten bestimmte demografische Gruppen unverhältnismäßig repräsentieren, was zu systematisch schlechterer KI-Leistung bei unterrepräsentierten Populationen führt. KI-Systeme zur Brustkrebsdiagnostik, die überwiegend mit Daten europäischer Frauen trainiert wurden, zeigen reduzierte Sensitivität bei afroamerikanischen und asiatischen Frauen.

Das Problem wird dadurch verschärft, dass verschiedene Brustkrebssubtypen unterschiedliche Prävalenz in ethnischen Gruppen aufweisen und die Assoziation mit Risikofaktoren je nach Menopausenstatus und molekularem Subtyp variiert. Ethische Validierung von KI erfordert stratifizierte Leistungsanalyse nach demografischen Untergruppen und explizite Angabe der Anwendbarkeitsgrenzen des Systems.

- Repräsentativität der Trainingsdaten für alle demografischen Gruppen der Zielpopulation prüfen

- Stratifizierte Analyse der Genauigkeitsmetriken (Sensitivität, Spezifität) für jede Untergruppe durchführen

- Leistungsschwellenwerte dokumentieren, unterhalb derer das System nicht für klinischen Einsatz empfohlen wird

- Explizite Anwendbarkeitsgrenzen in der Gebrauchsanweisung angeben

Fairness und gleichberechtigter Zugang zu KI-Diagnostik

Fairness von KI-Systemen wird durch Metriken wie Chancengleichheit (equalized odds) und demografische Parität bewertet, die vergleichbare Fehlerraten erster und zweiter Art für alle Gruppen erfordern. Systematische Reviews zur Therapieeffektivität müssen berücksichtigen, dass der Zugang zu verschiedenen Medikamenten und Technologien je nach geografischer Region und Gesundheitssystem variiert.

KI-Systeme, die für teure Geräte oder Protokolle optimiert sind, die in ressourcenbeschränkten Umgebungen nicht verfügbar sind, schaffen eine neue Dimension der Ungleichheit im Gesundheitswesen.

Die Entwicklung sollte Tests mit Daten aus verschiedenen klinischen Umgebungen sowie explizite Dokumentation der minimalen technischen Anforderungen für zuverlässigen Systembetrieb umfassen.

Transparenz und Erklärbarkeit von KI-Entscheidungen

Transparenz von KI-Systemen erfordert Erklärbarkeit — die Fähigkeit, eine klinisch interpretierbare Begründung für jede Entscheidung zu liefern, nicht nur das finale Urteil. Techniken wie gradientengewichtete Klassenaktivierung visualisieren Bildbereiche, die die Entscheidung des neuronalen Netzes beeinflussen, und ermöglichen dem Kliniker zu beurteilen, ob die Vorhersage auf relevanten anatomischen Merkmalen oder Artefakten basiert.

- Post-hoc-Erklärungen

- Werden nach der Entscheidungsfindung generiert; können irreführend sein und eine Illusion des Verständnisses ohne echten Einblick in die Algorithmuslogik erzeugen.

- Inhärent interpretierbare Modelle

- Bieten direkten Zugang zur Entscheidungslogik; erfordern mehr Rechenressourcen, sind aber zuverlässiger für Hochrisikoanwendungen.

Regulatorische Anforderungen (z.B. EU AI Act) verlangen zunehmend Dokumentation der Entscheidungslogik für medizinische Hochrisiko-KI-Systeme, aber Standards für angemessene Erklärungen bleiben Gegenstand von Debatten zwischen Entwicklern, Klinikern und Regulierungsbehörden.

Protokolle zur Fehlerminimierung bei der AI-Implementierung: von der Validierung bis zur klinischen Integration

Die Minimierung von AI-Fehlern erfordert einen mehrschichtigen Ansatz: technische Validierung an diversen Datensätzen, klinische Validierung unter realen Einsatzbedingungen und Post-Market-Monitoring der Leistungsfähigkeit.

Systematische Reviews von AI-Technologien müssen die Limitationen der eingeschlossenen Studien, Bereiche der Unsicherheit und den Bedarf an weiterer Forschung explizit benennen und voreilige Schlussfolgerungen über die klinische Einsatzbereitschaft auf Basis limitierter Daten vermeiden.

Das Implementierungsprotokoll muss Pilottests unter Beteiligung der Endnutzer, die Bewertung der Auswirkungen auf den klinischen Workflow und Feedback-Mechanismen zur Identifikation von Edge Cases umfassen — seltene Szenarien, in denen AI systematisch Fehler macht.

Kritisch wichtig ist die Etablierung klarer Kriterien für den Verzicht auf AI-Empfehlungen und Eskalationsprotokolle bei Entdeckung systematischer Fehler.

Multizentrische Validierung und Performance-Monitoring

Multizentrische Validierung testet AI an Daten aus verschiedenen medizinischen Einrichtungen mit unterschiedlicher Ausstattung, Protokollen und Patientendemografie und identifiziert Generalisierungsprobleme vor breiter Implementierung.

Post-Market-Monitoring muss nicht nur die Gesamtgenauigkeit überwachen, sondern auch Performance-Drift — graduelle Verschlechterung aufgrund von Veränderungen in der Patientenpopulation, Equipment-Updates oder klinischen Protokollen.

- Automatisierte Monitoring-Systeme identifizieren statistisch signifikante Abweichungen von der Baseline-Performance

- Abweichungen triggern Revalidierung oder temporäre Systemabschaltung

- Problembehebung geht der Wiederaufnahme des Betriebs voraus

Integration von AI als unterstützendes Werkzeug

AI-Systeme müssen als unterstützende Werkzeuge (Decision Support) positioniert werden, nicht als Ersatz für klinisches Urteilsvermögen.

Das Interface muss das Konfidenzniveau des Systems explizit kommunizieren und Mechanismen für schnelle Überschreibung von Entscheidungen durch Kliniker ohne bürokratische Barrieren bereitstellen.

- Anwenderschulung

- Umfasst technische Aspekte der Systemnutzung und das Verständnis typischer Failure Modes von AI — Situationen, in denen der Algorithmus systematisch Fehler macht.

- Dokumentation von Diskrepanzen

- Fälle, in denen AI-Empfehlungen von klinischen Entscheidungen abweichen, generieren wertvolle Datensätze für iterative Systemverbesserung und Identifikation blinder Flecken des Algorithmus, die bei Standardtests an statischen Datensätzen unsichtbar bleiben.

🔄

Validierungs- und Monitoring-Zyklus für AI-Systeme

1️⃣

Interne Validierung

Testing an Entwicklerdaten (Overfitting-Risiko)

2️⃣

Multizentrische Validierung

Unabhängige Datensätze, unterschiedliche Geräte und Protokolle

3️⃣

Klinische Pilotierung

Reale Bedingungen, Integration in den Arbeitsablauf

4️⃣

Post-Market-Monitoring

Kontinuierliche Überwachung von Performance-Drift

Knowledge Access Protocol

FAQ

Häufig gestellte Fragen

Systematische Fehler sind vorhersehbare Abweichungen in der KI-Leistung, die durch unausgewogene Daten, algorithmische Verzerrungen oder fehlerhafte Validierung entstehen. Sie führen zu ungenauen Diagnosen für bestimmte Patientengruppen oder klinische Situationen. Die Identifizierung erfordert sorgfältige Tests an heterogenen Stichproben.

KI-basierte Computer-Vision-Systeme analysieren intraoperative Bilder in Echtzeit und unterstützen Chirurgen beim Erkennen von Nebenschilddrüsen, um deren Schädigung zu vermeiden. Dies reduziert das Risiko postoperativer Hypokalzämie und anderer Komplikationen. Die Technologie fungiert als Assistenzwerkzeug und ersetzt nicht die klinische Erfahrung des Chirurgen.

Erforderlich sind ausgewogene Datensätze, die verschiedene Altersgruppen, Geschlechter, ethnische Zugehörigkeiten und Krankheitsstadien repräsentieren. Die Daten sollten aus mehreren medizinischen Zentren mit unterschiedlicher Ausrüstung stammen. Sorgfältige Annotation durch Experten und Prüfung auf versteckte Korrelationen, die Verzerrungen erzeugen, sind entscheidend.

Nein, das ist eine Vereinfachung. KI übertrifft Ärzte bei eng definierten Aufgaben unter idealen Bedingungen, ist jedoch bei komplexen Bewertungen und atypischen Fällen unterlegen. Die besten Ergebnisse werden durch Zusammenarbeit von KI und Fachärzten erzielt. Systematische Reviews zeigen hohe Variabilität der KI-Genauigkeit je nach Anwendungskontext.

Publikationsbias entsteht, wenn Studien mit positiven Ergebnissen häufiger veröffentlicht werden als solche mit negativen, wodurch das Gesamtbild der KI-Wirksamkeit verzerrt wird. Dies überschätzt die diagnostische Genauigkeit in systematischen Reviews. Zur Identifizierung werden statistische Methoden wie Funnel-Plots und Asymmetrietests verwendet.

Verwendet werden Metriken wie Sensitivität (Anteil erkannter Kranker), Spezifität (Anteil korrekt identifizierter Gesunder), prädiktiver Wert und Fläche unter der ROC-Kurve. Die Validierung erfolgt an unabhängigen Stichproben, die nicht am Training beteiligt waren. Der Vergleich mit dem Goldstandard (Histologie, Expertenbewertung) ist für die klinische Anwendung obligatorisch.

KI lernt aus verfügbaren Daten, die oft Minderheiten, seltene Erkrankungen oder spezifische demografische Gruppen unterrepräsentieren. Der Algorithmus memoriert Muster der Mehrheit und funktioniert schlechter bei unzureichend repräsentierten Fällen. Dies schafft Ungleichheit in der medizinischen Versorgungsqualität und erfordert gezielte Korrektur der Datensätze.

Vollständige Beseitigung ist unmöglich, aber durch vielfältige Trainingsdaten, regelmäßige Audits und multizentrische Validierung erheblich reduzierbar. Verzerrungen spiegeln oft reale Ungleichheiten im Gesundheitswesen und in der Datenqualität wider. Kontinuierliches Monitoring der KI-Leistung in der klinischen Praxis ist entscheidend zur Identifizierung neuer Fehlerquellen.

Erforderlich ist mehrstufige Validierung: intern (an einem Teil der Ursprungsdaten), extern (an Daten anderer Zentren) und prospektiv (in der realen Praxis). Notwendig sind Tests an verschiedenen Patientensubgruppen, Geräten und klinischen Szenarien. Vergleich mit Expertenbewertungen und Analyse fehlerhafter Fälle sind vor der Zulassung obligatorisch.

Overfitting tritt auf, wenn KI bei Trainingsdaten hervorragend funktioniert, aber bei neuen Fällen versagt, indem sie Rauschen statt Gesetzmäßigkeiten memoriert. In der Medizin führt dies zu Fehldiagnosen bei geringsten Abweichungen von der Trainingsstichprobe. Verhindert wird es durch Datentrennung, Regularisierung und Validierung an unabhängigen Datensätzen aus anderen Kliniken.

Ja, Erklärbarkeit ist entscheidend für klinisches Vertrauen und rechtliche Verantwortung. Ärzte müssen verstehen, auf Basis welcher Merkmale die KI eine Entscheidung getroffen hat, um deren Begründetheit zu bewerten. Methoden zur Visualisierung der Algorithmus-Aufmerksamkeit und Hervorhebung relevanter Bildbereiche erhöhen die Transparenz, doch viele moderne KI-Systeme bleiben ‹Black Boxes›.

Nein, das ist ein Mythos. Moderne KI-Systeme in der Chirurgie erfüllen eng begrenzte Aufgaben wie die Erkennung anatomischer Strukturen oder Risikowarnungen, ersetzen aber nicht die menschliche Beteiligung. Sie funktionieren als unterstützende Werkzeuge, die der Kontrolle des Chirurgen bedürfen. Vollständige Autonomie von KI im OP ist bisher nicht erreicht und wirft ernsthafte ethische Fragen auf.

Unterschiede im Studiendesign, in Patientenpopulationen, KI-Versionen und Bewertungsmethoden erzeugen Heterogenität, die das Zusammenführen von Ergebnissen erschwert. Hohe Heterogenität verringert die Verlässlichkeit verallgemeinerter Aussagen über die Genauigkeit von KI. Statistische Methoden (I²-Statistik, Meta-Regression) helfen dabei, die Variabilität zwischen Studien zu bewerten und zu erklären.

Voreingenommene KI verschärft Ungleichheit im Gesundheitswesen, indem sie schlechtere Diagnosen für vulnerable Bevölkerungsgruppen liefert. Dies verletzt Prinzipien der Gerechtigkeit und des gleichberechtigten Zugangs zu qualitativ hochwertiger medizinischer Versorgung. Entwickler und Regulierungsbehörden müssen nachweislich gleiche KI-Leistung für alle demografischen Gruppen vor der Zulassung fordern.

Absolut unverzichtbar. Die Leistung von KI kann aufgrund von Veränderungen in der Patientenpopulation, Geräte-Updates oder «Datendrift» abnehmen. Regelmäßige Genauigkeitsprüfungen, Fehleranalysen und Feedback von Klinikern ermöglichen die rechtzeitige Erkennung von Problemen. Ein erneutes Training mit neuen Daten kann erforderlich sein, um die klinische Wirksamkeit aufrechtzuerhalten.

Die Arbeit mit seltenen Erkrankungen ist aufgrund der geringen Anzahl an Trainingsbeispielen eine Herausforderung, was das Risiko von Overfitting und Fehlern erhöht. Methoden wie Transfer Learning, synthetische Datengenerierung und Federated Learning helfen, das Problem teilweise zu lösen. Die Validierung bleibt jedoch schwierig, und KI für seltene Pathologien erfordert besonders sorgfältige Expertenprüfung.