📊 Grundlagen des maschinellen Lernens

📊 Grundlagen des maschinellen LernensWie künstliche Intelligenz funktioniert: Von Daten zu Entscheidungenλ

Verständnis der Funktionsweise von KI — von datenbasiertem Training bis zur praktischen Anwendung in Medizin, Wirtschaft und Alltag

Overview

Künstliche Intelligenz lernt aus Daten 🧠 — erkennt Muster, erstellt Prognosen, trifft Entscheidungen. Neuronale Netze, Machine-Learning-Algorithmen und Sprachverarbeitung ermöglichen es Maschinen, Aufgaben zu lösen, die früher menschliches Denken erforderten. Keine Magie: nur Mathematik, Statistik und Rechenleistung.

🛡️

Laplace-Protokoll: KI ist kein Ersatz für den menschlichen Verstand, sondern ein Werkzeug zu dessen Verstärkung. Das Verständnis der grundlegenden Funktionsweise von KI ist für jeden zugänglich und erfordert keine technische Ausbildung für die praktische Anwendung.

Reference Protocol

Wissenschaftliche Grundlage

Evidenzbasierter Rahmen für kritische Analyse

Navigation Matrix

Unterabschnitte

[ai-errors-biases]

KI-Fehler und Voreingenommenheit

Wie man Risiken algorithmischer Fehler in Diagnostik, Chirurgie und klinischen Studien erkennt und minimiert

Erkunden

[ml-basics]

Grundlagen des maschinellen Lernens

Lernen Sie grundlegende Algorithmen, mathematische Grundlagen und praktische Methoden des maschinellen Lernens kennen, die das Fundament moderner künstlicher Intelligenz und Datenanalyse bilden

Erkunden

Protocol: Evaluation

Teste Dich

Quiz zu diesem Thema kommt bald

Sector L1

Artikel

Forschungsmaterialien, Essays und tiefe Einblicke in die Mechanismen des kritischen Denkens.

📊 Grundlagen des maschinellen Lernens

📊 Grundlagen des maschinellen Lernens⚡

Vertiefung

Grundlagen der KI-Funktionsweise: von Daten zu Entscheidungen

Künstliche Intelligenz funktioniert als mathematisches System zur Mustererkennung in großen Datenmengen. Der Algorithmus erhält Beispiele, identifiziert statistische Zusammenhänge zwischen Eingabe und Ergebnis und wendet dann die gefundenen Muster auf neue Informationen an.

Dies unterscheidet sich grundlegend von traditioneller Programmierung: Dort schreibt der Entwickler jede Regel manuell vor, hier bildet die KI Regeln selbstständig auf Basis von Erfahrung.

Was ist maschinelles Lernen

Maschinelles Lernen ist eine Teilmenge der KI, bei der Systeme aus Daten lernen, ohne dass jeder Schritt explizit programmiert wird.

| Lerntyp | Prinzip | Aufgaben |

|---|---|---|

| Überwachtes Lernen (supervised) | Algorithmus erhält gelabelte Beispiele mit korrekten Antworten | Klassifikation, Prognose |

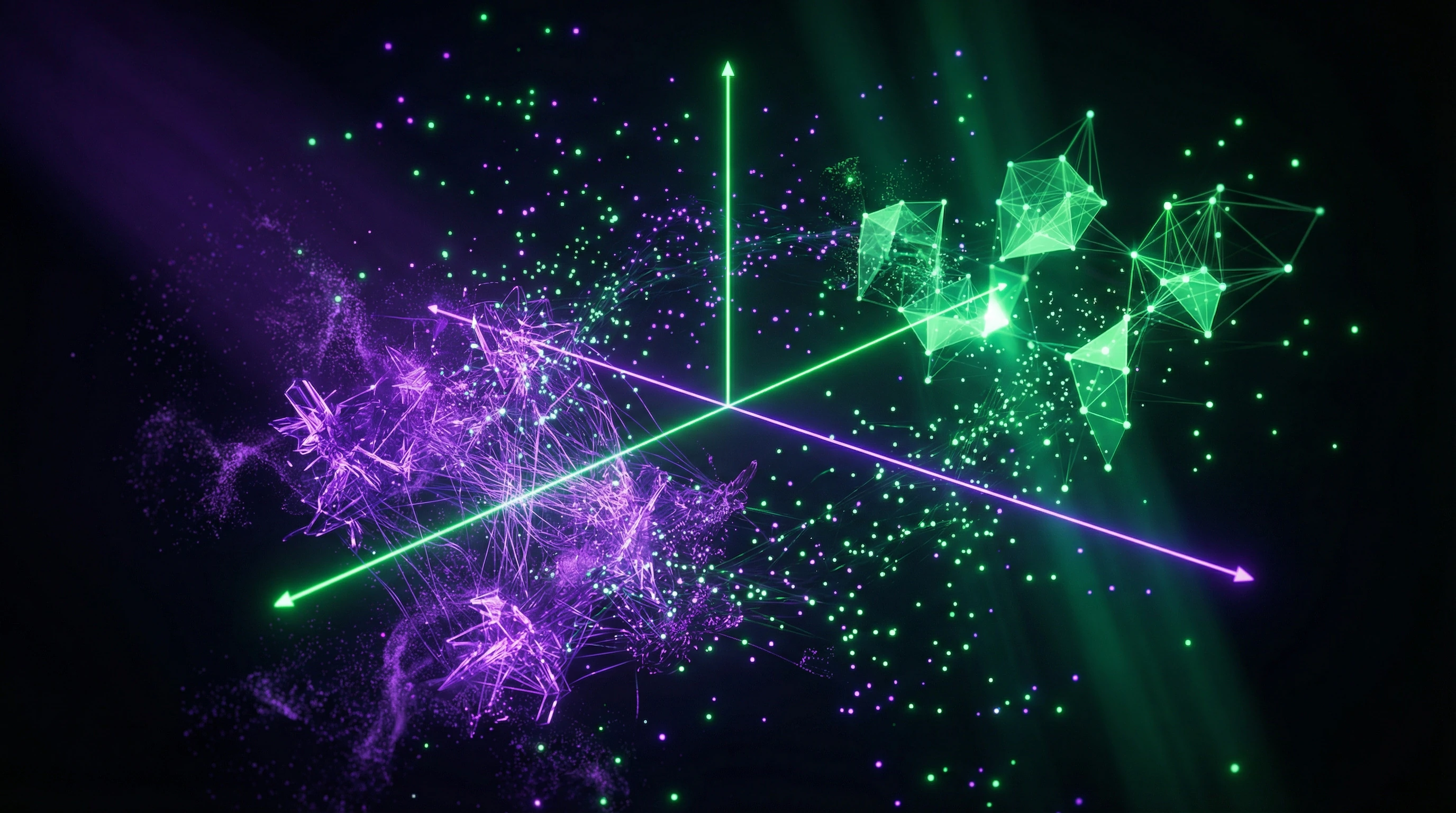

| Unüberwachtes Lernen (unsupervised) | System findet selbstständig Struktur in ungelabelten Daten | Clustering, Mustererkennung |

| Bestärkendes Lernen (reinforcement) | Modell lernt durch System von Belohnungen und Bestrafungen | Optimierung von Handlungssequenzen |

Die Rolle von Daten beim KI-Training

Daten sind der Treibstoff für KI: Qualität und Umfang des Trainingsdatensatzes bestimmen direkt die Genauigkeit des Modells.

- Sammlung relevanter Informationen

- Erste Phase: Auswahl von Quellen, die die Aufgabe tatsächlich widerspiegeln.

- Bereinigung und Normalisierung

- Entfernung von Fehlern, Ausreißern, Vereinheitlichung der Formate auf einen Standard.

- Labeling (für überwachtes Lernen)

- Hinzufügen korrekter Antworten, falls erforderlich.

- Repräsentativität

- Kritische Anforderung: Trainingsdaten müssen die reale Vielfalt von Situationen widerspiegeln. Fehlt dies, liefert das Modell verzerrte Ergebnisse. Beispielsweise funktioniert ein Gesichtserkennungssystem, das überwiegend mit Fotos von Menschen europäischer Herkunft trainiert wurde, schlechter bei anderen ethnischen Gruppen – eine direkte Folge von KI-Fehlern und Verzerrungen.

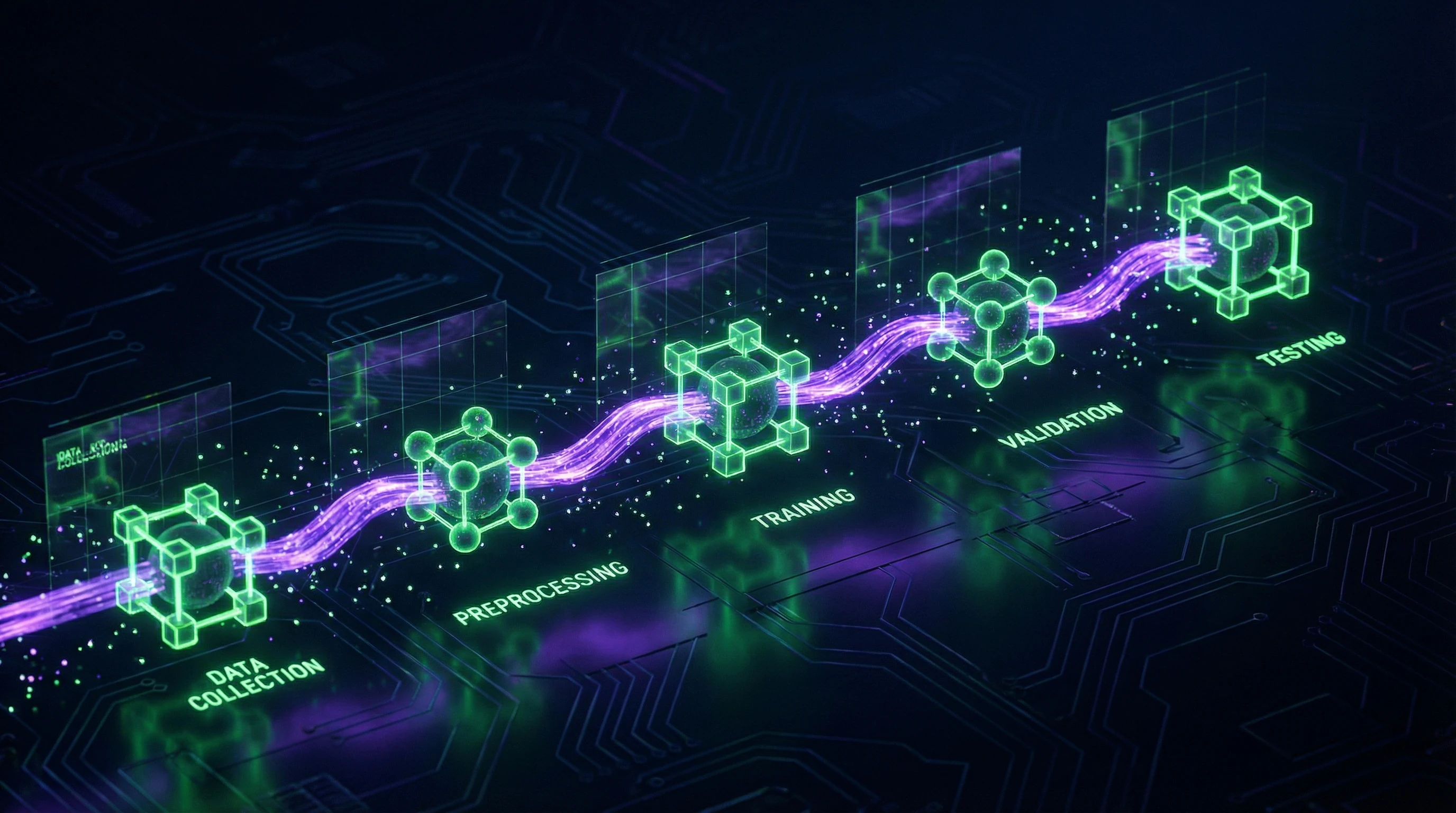

Prozess des Trainings und Testens von Modellen

Das KI-Training erfolgt in mehreren Phasen mit Aufteilung der Daten in drei Datensätze.

- Trainingsdatensatz (70–80%) — Modell passt interne Parameter an und minimiert den Fehler zwischen Vorhersagen und tatsächlichen Werten durch Optimierung.

- Validierungsdatensatz (10–15%) — wird zur Abstimmung von Hyperparametern und zur Vermeidung von Overfitting verwendet (wenn das Modell bei bekannten Daten hervorragend funktioniert, aber schlecht auf neue generalisiert).

- Testdatensatz (10–15%) — finale Überprüfung zeigt die reale Leistung des Systems unter Bedingungen, die der Praxis maximal nahekommen.

Datenqualität ist wichtiger als Datenmenge: Ein gut vorbereiteter Datensatz liefert bessere Ergebnisse als Gigabytes unsauberer, unausgewogener Daten.

Neuronale Netze: Architektur und Prinzipien

Neuronale Netze sind Rechenmodelle, die von der Struktur biologischer Neuronen inspiriert sind, aber nach völlig anderen Prinzipien funktionieren. Ein künstliches neuronales Netz besteht aus Knoten (Neuronen), die in Schichten organisiert und durch gewichtete Verbindungen verknüpft sind, welche Informationen übertragen und transformieren.

Jedes Neuron empfängt Eingangssignale, wendet eine mathematische Funktion darauf an (üblicherweise eine gewichtete Summe mit nichtlinearer Transformation) und gibt das Ergebnis an die nächste Schicht weiter. Gerade diese mehrschichtige Architektur ermöglicht es dem Netz, komplexe, hierarchische Muster in Daten zu erkennen – von einfachen Merkmalen in den ersten Schichten bis zu abstrakten Konzepten in den tiefen Ebenen.

Struktur eines künstlichen Neurons

Ein künstliches Neuron ist eine mathematische Funktion, die mehrere Eingaben empfängt, jede mit dem entsprechenden Gewicht multipliziert, die Ergebnisse summiert, einen Bias hinzufügt und durch eine Aktivierungsfunktion leitet.

- Gewichte

- Bestimmen die Wichtigkeit jedes Eingangssignals und werden während des Trainings durch den Backpropagation-Algorithmus angepasst.

- Aktivierungsfunktion

- Führt Nichtlinearität ein, ohne die selbst ein mehrschichtiges Netz sich wie ein einfaches lineares Modell verhalten würde. Gängige Varianten: ReLU, Sigmoid, Tanh.

- Bias

- Ermöglicht es dem Neuron, auch bei Null-Eingaben zu aktivieren, was die Flexibilität des Modells erhöht.

Schichten und spezialisierte Architekturen

Ein typisches neuronales Netz enthält eine Eingabeschicht (empfängt Rohdaten), eine oder mehrere versteckte Schichten (führen Transformationen durch) und eine Ausgabeschicht (generiert das Endergebnis).

| Architekturtyp | Verbindungsstruktur | Anwendung |

|---|---|---|

| Vollständig verbunden (Dense) | Jedes Neuron ist mit allen Neuronen der nächsten Schicht verbunden | Klassifikation, Regression |

| Convolutional (CNN) | Lokale Verbindungen und geteilte Gewichte | Bildverarbeitung |

| Rekurrent (RNN) | Rückkopplungen zur Verarbeitung von Sequenzen | Textanalyse, Zeitreihen |

Die Tiefe des Netzes (Anzahl der Schichten) und die Breite (Anzahl der Neuronen pro Schicht) bestimmen seine Ausdrucksfähigkeit, aber übermäßige Komplexität führt zu Overfitting und erfordert mehr Daten.

Unterschiede zum biologischen Gehirn

Trotz der Bezeichnung unterscheiden sich künstliche neuronale Netze radikal von biologischen: Sie verwenden vereinfachte mathematische Modelle statt komplexer elektrochemischer Prozesse, lernen durch Gradientenabstieg statt synaptischer Plastizität und arbeiten synchron Schicht für Schicht, nicht asynchron wie echte Neuronen.

Das biologische Gehirn enthält etwa 86 Milliarden Neuronen mit Billionen von Verbindungen, von denen jede Dutzende Arten von Neurotransmittern und komplexe zeitliche Dynamik aufweisen kann – moderne KI kommt dieser Komplexität nicht einmal annähernd nahe.

Das Gehirn ist energieeffizient (verbraucht etwa 20 Watt), während das Training großer neuronaler Netze Megawatt an Strom erfordert. Dieser fundamentale Unterschied wird in populären Beschreibungen von KI oft übersehen und erzeugt einen falschen Eindruck von der Nähe künstlicher und biologischer Systeme.

Schlüsseltechnologien der modernen KI

Moderne künstliche Intelligenz stützt sich auf drei sich ergänzende Technologien. Deep Learning nutzt mehrschichtige neuronale Netze zur automatischen Merkmalsextraktion, Natural Language Processing ermöglicht Maschinen das Verstehen und Generieren von Sprache, Computer Vision interpretiert visuelle Informationen.

Diese Bereiche werden oft kombiniert: Bildbeschreibungssysteme vereinen Computer Vision und NLP, multimodale Modelle wie GPT-4 arbeiten gleichzeitig mit Text und Bildern.

Deep Learning

Deep Learning ist ein Teilbereich des maschinellen Lernens, der neuronale Netze mit vielen versteckten Schichten (üblicherweise 10 bis Hunderte) verwendet, um hierarchische Datenrepräsentationen zu erkennen.

Der Durchbruch erfolgte 2012: Das Convolutional Network AlexNet gewann den ImageNet-Wettbewerb zur Bilderkennung mit enormem Vorsprung und demonstrierte die Überlegenheit tiefer Architekturen.

Schlüsselfaktoren des Erfolgs: Verfügbarkeit großer Datensätze, wachsende GPU-Rechenleistung und verbesserte Trainingsmethoden (Dropout, Batch Normalization, Residual Connections).

Heute dominiert Deep Learning in Computer Vision, Spracherkennung, maschineller Übersetzung und generativen Modellen.

Natural Language Processing (NLP)

NLP ermöglicht Computern die Analyse, das Verstehen und die Generierung menschlicher Sprache durch eine Kombination linguistischer Regeln und statistischer Modelle.

Moderne Systeme nutzen Transformer – eine auf dem Attention-Mechanismus basierende Architektur, die lange Textsequenzen effizient verarbeitet und kontextuelle Abhängigkeiten erfasst.

| Komponente | Funktion | Ergebnis |

|---|---|---|

| Large Language Models (LLM) | Trainiert auf Milliarden von Wörtern, sagen das nächste Wort voraus oder rekonstruieren fehlende Fragmente | Erlernen Grammatik, Fakten und Elemente des Schlussfolgerns |

| Anwendungen | Maschinelle Übersetzung, Chatbots, Zusammenfassung, Sentimentanalyse, Content-Generierung | Praktischer Einsatz in Produkten und Diensten |

Computer Vision

Computer Vision verleiht Maschinen die Fähigkeit, Informationen aus Bildern und Videos zu extrahieren: klassifizieren (was abgebildet ist), detektieren (wo sich Objekte befinden), segmentieren (Grenzen hervorheben) und Bilder generieren.

Convolutional Neural Networks (CNN) wurden zum Standard dank ihrer Fähigkeit, automatisch eine Hierarchie visueller Merkmale zu erlernen: erste Schichten erkennen Kanten und Texturen, mittlere – Objektteile, tiefe – ganze Objekte und Szenen.

Moderne Architekturen wie ResNet, EfficientNet und Vision Transformers erreichen übermenschliche Genauigkeit in spezifischen Aufgaben: Verkehrszeichenerkennung, Diagnose von Röntgenaufnahmen.

Anwendungen umfassen autonome Fahrzeuge, medizinische Diagnostik, Sicherheitssysteme, Augmented Reality und Qualitätskontrolle in der Produktion.

Entwicklungsphasen eines KI-Systems: von der Idee bis zur Produktion

Zielsetzung und Architekturwahl

Die Entwicklung eines KI-Systems beginnt mit der klaren Formulierung der Geschäftsaufgabe und deren Übersetzung in eine technische Problemstellung: Klassifikation, Regression, Clustering oder Generierung.

In dieser Phase werden Erfolgsmetriken (Accuracy, F1-Score, BLEU für NLP), verfügbare Rechenressourcen und Latenzanforderungen definiert. Die Architekturwahl hängt vom Datentyp ab: Für Bilder werden CNNs verwendet, für Sequenzen RNN/LSTM oder Transformer, für tabellarische Daten Gradient Boosting oder klassische ML-Algorithmen.

Entscheidend ist die Bewertung, ob ausreichend Daten für das Training eines tiefen Modells vorhanden sind oder ob mit Transfer Learning auf vortrainierten Gewichten begonnen werden sollte.

Datensammlung, -bereinigung und -vorbereitung

Die Datenqualität bestimmt 80% des Projekterfolgs: Ein Modell kann nicht lernen, was nicht im Trainingsdatensatz enthalten ist.

- Sammlung repräsentativer Beispiele und Annotation (für Supervised Learning)

- Entfernung von Duplikaten, Behandlung fehlender Werte und Ausreißer

- Normalisierung der Features; für Bilder – Augmentation (Rotationen, Zuschnitte, Helligkeitsänderungen)

- Für Text – Tokenisierung und Vektorisierung durch Embeddings

- Aufteilung in Trainings- (70–80%), Validierungs- (10–15%) und Testdatensätze (10–15%)

- Korrektur von Klassenungleichgewichten durch Oversampling, Undersampling oder Gewichtung der Verlustfunktion

Kritisch ist die Überprüfung auf Informationslecks zwischen den Datensätzen.

Training, Validierung und Deployment

Das Training besteht in der iterativen Optimierung der Modellgewichte durch Minimierung der Verlustfunktion auf dem Trainingsdatensatz mittels Algorithmen wie SGD, Adam oder AdamW.

Der Validierungsdatensatz wird zur Hyperparameter-Optimierung (Learning Rate, Batch Size, Architektur) und zum Early Stopping bei Overfitting verwendet. Nach Erreichen der Zielmetriken wird das Modell auf zurückgehaltenen Daten getestet, auf Edge Cases und Adversarial Examples geprüft, dann in eine API verpackt oder in eine Anwendung integriert.

In der Produktion ist Monitoring entscheidend: Überwachung von Drift in der Verteilung der Eingabedaten, Degradation der Metriken, Latenz und Ressourcenverbrauch.

Moderne MLOps-Praktiken umfassen Modellversionierung, A/B-Testing, automatisches Retraining bei Qualitätsverlust und Explainability-Tools für die Entscheidungsprüfung.

Praktische Anwendungen von KI: von der Medizin bis zum Alltag

KI in Medizin und Diagnostik

Medizinische KI analysiert Röntgenaufnahmen, MRT und CT mit einer Genauigkeit, die Radiologen bei spezifischen Aufgaben wie der Erkennung von Pneumonie, Tumoren oder Frakturen erreicht oder übertrifft. Algorithmen verarbeiten histologische Präparate zur Identifizierung von Krebszellen und prognostizieren das Risiko kardiovaskulärer Erkrankungen anhand von EKG-Daten.

Im Drug Discovery beschleunigt KI die Suche nach Molekülkandidaten, indem sie deren Eigenschaften und Interaktion mit Zielproteinen vorhersagt. Dies verkürzt die Entwicklungszeit von Medikamenten von 10–15 Jahren auf 3–5 Jahre.

Virtuelle Assistenten unterstützen Patienten beim Symptom-Tracking, erinnern an die Medikamenteneinnahme und bieten Erstberatung über Chatbots – wodurch ein Teil der ärztlichen Belastung auf Algorithmen verlagert wird.

Automatisierung von Geschäftsprozessen

Im Unternehmenssektor automatisiert KI Routineaufgaben: Dokumentenverarbeitung durch OCR und NLP, Routing von Kundenanfragen, Nachfrageprognosen und Logistikoptimierung. Empfehlungssysteme steigern die Conversion im E-Commerce um 20–30%, indem sie Kaufhistorie und Website-Verhalten analysieren.

| Anwendung | Effekt |

|---|---|

| Chatbots im Support | Bearbeiten bis zu 80% der Standardanfragen |

| Fraud Detection in Banken | Reduzieren Betrugsverluste um 40–60% |

| Predictive Maintenance | Verringern Ausfallzeiten und Reparaturkosten |

KI in Bildung und Alltag

Adaptive Lernplattformen passen Tempo und Schwierigkeitsgrad des Materials an das Niveau der Studierenden an, indem sie Fehlermuster analysieren. Systeme zur automatischen Korrektur von Essays und Code liefern sofortiges Feedback und sparen Lehrkräften Zeit.

Im Haushalt steuern Sprachassistenten das Smart Home, beantworten Fragen und führen Aufgaben über NLP aus. Empfehlungen für Musik, Filme und Content werden durch Collaborative Filtering und Deep Learning personalisiert.

Smartphone-Kameras nutzen KI zur Szenenerkennung, für den Porträtmodus mit Hintergrundunschärfe und Nachtaufnahmen durch Multi-Frame-Processing. Navigations-Apps prognostizieren Staus und optimieren Routen, indem sie Daten von Millionen Nutzern in Echtzeit verarbeiten.

Mythen und Realität über künstliche Intelligenz

KI ist nicht gleich neuronale Netze

Ein weit verbreiteter Irrtum setzt die gesamte KI mit neuronalen Netzen gleich, obwohl letztere nur eines von vielen Werkzeugen im Arsenal sind.

| Methode | Stärken | Wann anwenden |

|---|---|---|

| Klassisches ML (Entscheidungsbäume, SVM, logistische Regression) | Hohe Interpretierbarkeit, geringe Rechenleistung | Tabellarische Daten mit geringem Volumen |

| Regelbasierte Expertensysteme | Vollständige Transparenz der Logik | Medizinische Diagnostik, Finanzanalyse |

| Evolutionäre Algorithmen, Reinforcement Learning | Lösen Aufgaben ohne gelabelte Daten | Optimierung, Steuerung, Spiele |

| Deep Learning | Skalierbarkeit, Verarbeitung unstrukturierter Daten | Bilder, Text, Audio bei großen Datenmengen |

Die Methodenwahl hängt von Datenvolumen, Genauigkeitsanforderungen, Interpretierbarkeit und Rechenressourcen ab – eine Universallösung existiert nicht.

Grenzen moderner KI

Moderne KI-Systeme verfügen nicht über Verständnis im menschlichen Sinne: Sie finden statistische Korrelationen in Daten, ohne kausale Zusammenhänge zu erfassen.

Modelle sind anfällig für Adversarial Attacks – minimale, für das Auge unsichtbare Änderungen der Eingabe können katastrophale Fehler verursachen. Die Generalisierung über die Trainingsverteilung hinaus bleibt ein ungelöstes Problem: Ein Modell, das auf Sommerfotos trainiert wurde, kann bei Winteraufnahmen versagen.

Die Datenanforderungen sind enorm: Für das Training von GPT-3 wurden Hunderte Milliarden Token verwendet, ImageNet enthält 14 Millionen gelabelte Bilder. Der Energieverbrauch beim Training großer Modelle entspricht dem jährlichen CO₂-Ausstoß mehrerer Autos, was Fragen der ökologischen Nachhaltigkeit aufwirft.

Ethische Aspekte und verantwortungsvoller Einsatz

KI-Systeme erben und verstärken Vorurteile aus den Trainingsdaten: Recruiting-Algorithmen diskriminieren nach Geschlecht, Gesichtserkennungssysteme funktionieren bei dunkler Haut schlechter, Kredit-Scoring kann Minderheiten benachteiligen.

Die Intransparenz von Deep-Learning-Modellen erschwert Audits und die Erklärung von Entscheidungen, was in Medizin, Rechtswesen und Finanzwesen kritisch ist. Der Masseneinsatz von KI bedroht Arbeitsplätze in Transport, Produktion und Kundenservice und erfordert Umschulungsprogramme.

Deepfakes und generative Modelle schaffen Risiken für Desinformation und Manipulation der öffentlichen Meinung.

- Audit der Daten auf Voreingenommenheit und Repräsentativität

- Einsatz von Explainable-AI-Methoden für transparente Entscheidungen

- Menschliche Kontrolle bei kritischen Entscheidungen (Medizin, Rechtswesen, Finanzen)

- Dokumentation der Systemgrenzen und Fehlerszenarien

- Regelmäßiges Monitoring sozialer Auswirkungen und Nebenwirkungen

Knowledge Access Protocol

FAQ

Häufig gestellte Fragen

Künstliche Intelligenz ist eine Technologie, die es Computern ermöglicht, Aufgaben auszuführen, die menschliches Denken erfordern: Mustererkennung, Entscheidungsfindung, Sprachverständnis. KI lernt aus Daten durch Algorithmen, findet Gesetzmäßigkeiten und wendet sie zur Lösung neuer Aufgaben an. Beispiele: Sprachassistenten, Empfehlungen in sozialen Netzwerken, medizinische Diagnostik.

Ein neuronales Netz erhält einen großen Datensatz mit korrekten Antworten und passt schrittweise die Verbindungen zwischen Neuronen an, um Fehler zu minimieren. Der Prozess ähnelt dem Lernen eines Kindes: Wir zeigen Tausende Fotos von Katzen, bis das System sie erkennen kann. Nach dem Training wird das Modell an neuen Daten getestet, um die Genauigkeit zu überprüfen.

Bei herkömmlicher Programmierung schreibt der Mensch alle Regeln manuell, während beim maschinellen Lernen das System selbst Muster in den Daten findet. Der Programmierer gibt nur das Ziel vor und liefert Beispiele, der Algorithmus erstellt eigenständig ein Lösungsmodell. Dies ermöglicht die Lösung von Aufgaben, bei denen Regeln zu komplex für eine explizite Beschreibung sind.

Nein, das ist ein verbreiteter Mythos. Künstliche neuronale Netze sind lediglich von der Biologie inspiriert, funktionieren aber durch mathematische Operationen und statistische Methoden, nicht durch biologische Prozesse. Das menschliche Gehirn nutzt chemische Signale, Emotionen und Bewusstsein, die KI nicht besitzt.

Nein, Daten sind die Grundlage moderner KI. Ohne qualitativ hochwertige Trainingsdaten kann das System keine Muster erkennen und keine präzisen Vorhersagen treffen. Je größer und vielfältiger die Daten, desto besser funktioniert das Modell.

Der Prozess umfasst sechs zentrale Phasen: Zieldefinition, Datensammlung, Datenaufbereitung und -bereinigung, Modelltraining, Testen an neuen Daten und Deployment in die Produktion. Nach dem Launch ist kontinuierliches Monitoring und Verbesserung des Systems basierend auf dem realen Betrieb erforderlich.

Deep Learning ist ein Teilbereich des maschinellen Lernens, der mehrschichtige neuronale Netze zur Analyse komplexer Daten verwendet. Die Technologie ermöglicht es, automatisch Merkmale aus Bildern, Texten und Audio zu extrahieren, ohne manuelle Konfiguration. Anwendung findet sie in Gesichtserkennung, Sprachassistenten und autonomen Fahrzeugen.

Beginnen Sie mit fertigen Tools: ChatGPT für Texte, Midjourney für Bilder, Sprachassistenten zur Aufgabenautomatisierung. Viele Dienste haben eine einfache Benutzeroberfläche und erfordern keine Programmierung. Lernen Sie Grundbegriffe durch kostenlose Kurse auf Deutsch.

KI unterstützt bei der Diagnose von Krankheiten anhand von Aufnahmen, prognostiziert Komplikationsrisiken, beschleunigt die Medikamentenentwicklung und personalisiert Behandlungspläne. Systeme analysieren medizinische Daten schneller als Ärzte und erkennen Muster, die für Menschen unsichtbar sind. Die Technologie wird bereits in der Onkologie, Radiologie und Kardiologie eingesetzt.

Das Modell wird an einem separaten Datensatz getestet, der nicht beim Training verwendet wurde, wobei Genauigkeit, Vollständigkeit und F1-Score gemessen werden. Wichtig ist die Überprüfung der Funktion bei Grenzfällen und realen Nutzungsszenarien. Profis analysieren zudem die Fehlermatrix und führen A/B-Tests durch.

Nein, das ist ein Irrtum. KI umfasst zahlreiche Technologien: Expertensysteme, genetische Algorithmen, logische Inferenz, Entscheidungsbäume. Neuronale Netze sind nur eines von vielen Werkzeugen, wenn auch in den letzten Jahren besonders populär.

Moderne KI ist nicht vollständig autonom und erfordert menschliche Kontrolle, Zielsetzung und Interpretation der Ergebnisse. Die Technologie funktioniert am besten als Werkzeug, das menschliche Fähigkeiten verstärkt, nicht ersetzt. Kreativität, Empathie und strategisches Denken bleiben dem Menschen vorbehalten.

NLP ist ein Bereich der KI, der es Computern ermöglicht, menschliche Sprache zu verstehen, zu interpretieren und zu generieren. Die Technologie wird in Chatbots, Übersetzern, Sentimentanalysen und Sprachassistenten eingesetzt. Moderne Modelle wie GPT verstehen Kontext und erstellen kohärente Texte.

Erforderlich sind große Mengen qualitativ hochwertiger, annotierter Daten, die für die zu lösende Aufgabe relevant sind. Für Bildklassifizierung werden Tausende beschriftete Fotos benötigt, für NLP Textkorpora. Die Daten müssen vielfältig, ausgewogen und fehlerfrei sein.

Hauptprobleme: Algorithmische Verzerrungen durch voreingenommene Daten, Privatsphäre persönlicher Informationen, Transparenz bei Entscheidungsfindung und Verantwortung für Fehler. Wichtig ist die Entwicklung von KI unter Berücksichtigung ethischer Prinzipien sowie die Gewährleistung von Kontrolle und Erklärbarkeit der Systeme. Regulierungsbehörden verschiedener Länder schaffen rechtliche Rahmenbedingungen für verantwortungsvollen Einsatz.

Moderne KI kombiniert und transformiert Muster aus Trainingsdaten, besitzt aber keine echte Kreativität oder Verständnis. Systeme generieren neue Bilder, Texte, Musik basierend auf erlernten Beispielen, schaffen aber keine konzeptionell neuen Ideen. Bahnbrechende Innovationen bleiben vorerst der menschlichen Intelligenz vorbehalten.