Was genau verspricht der Singularitätsmythos — und warum verschwimmt die Definition jedes Mal, wenn man versucht, sie festzulegen

Das Konzept der technologischen Singularität geht auf die Arbeiten des Mathematikers Vernor Vinge (1993) und des Futuristen Ray Kurzweil zurück, doch in drei Jahrzehnten hat der Begriff zahlreiche Transformationen durchlaufen. Im strengen Sinne beschreibt die Singularität den Moment, in dem künstliche Intelligenz die Fähigkeit zur rekursiven Selbstverbesserung erreicht — indem sie intelligentere Versionen ihrer selbst erschafft, die wiederum noch intelligentere Versionen erschaffen und damit eine unkontrollierbare Kettenreaktion des Intelligenzwachstums auslösen (S004). Die mathematische Metapher ist aus der Physik schwarzer Löcher entlehnt, wo Singularität den Punkt bezeichnet, an dem bekannte Gesetze nicht mehr funktionieren.

Das Problem beginnt mit der Operationalisierung. Die Forschung zeigt, wie der Begriff auf jegliche schnellen Veränderungen in technologischen Systemen angewendet wird und dabei seine Spezifität verliert (S003). Autoren verwenden „Singularität" zur Beschreibung des Moments, in dem digitale Bildungsplattformen eine kritische Masse der Implementierung erreichen — eine Definition, die sich radikal vom ursprünglichen Konzept der rekursiven Selbstverbesserung von KI unterscheidet.

Dies ist kein Einzelfall: In der akademischen Literatur wird der Begriff auf die humanitär-technologische Revolution angewendet (S002), auf beliebige „Punkte ohne Wiederkehr" in sozialen Systemen, auf Momente rascher Digitalisierung. Wenn Singularität sowohl explosives Wachstum übermenschlicher KI bedeuten kann als auch einfach schnelle Implementierung neuer Technologien oder einen Wendepunkt in der Bildung, verliert der Begriff seine prädiktive und analytische Kraft.

⚠️ Drei unvereinbare Definitionen, die in einem Diskurs koexistieren

- Hard Takeoff

- Der Moment, in dem KI menschliches Intelligenzniveau (AGI) erreicht und dann innerhalb kurzer Zeit (Tage, Stunden) zu übermenschlicher Intelligenz (ASI) durch rekursive Selbstverbesserung übergeht. Die klassische Version von Vinge-Kurzweil, die einen Bruch der Kontinuität und Verlust menschlicher Kontrolle voraussetzt.

- Soft Takeoff

- Graduelle Beschleunigung des technologischen Fortschritts, bei der KI zunehmend leistungsfähiger wird, jedoch ohne abrupten Sprung. Der Übergang zu übermenschlicher Intelligenz dauert Jahre oder Jahrzehnte und lässt Zeit für Anpassung und Regulierung. Näher an der beobachtbaren Realität, verliert aber die Dramatik des „Punktes ohne Wiederkehr".

- Metaphorische Singularität

- Jeder Moment schneller, irreversibler Veränderungen in technologischen oder sozialen Systemen, ohne Bezug zu KI oder Selbstverbesserung. Genau diese Version dominiert in den Quellen (S002), (S003), (S004), wo Singularität als Synonym für „Revolution", „Transformation" oder „Wendepunkt" verwendet wird.

Die Unschärfe der Definition ist kein Mangel des Singularitätskonzepts — sie ist sein Schlüsselmerkmal, das seine Überlebensfähigkeit sichert. Die Frage „erneute planetare Revolution oder einzigartige Singularität?" bleibt gerade deshalb offen, weil die Unterscheidungskriterien nicht festgelegt sind.

Hätte die Singularität klare, messbare Parameter, könnte man sie überprüfen und potenziell widerlegen. Doch die Flexibilität des Begriffs ermöglicht es Befürwortern des Konzepts, ihn jedes Mal neu zu definieren, wenn Vorhersagen nicht eintreffen: Wenn der Hard Takeoff nicht stattfindet, kann man zum Soft Takeoff wechseln; wenn auch dieser nicht beobachtet wird, kann man jede Beschleunigung von Innovationen zur Singularität erklären.

Dies ist ein Mechanismus, der aus der Geschichte anderer Mythen bekannt ist: Ein Konzept bleibt genau so lange überzeugend, wie seine Definition unscharf bleibt. Sobald eine Überprüfungsmöglichkeit entsteht, transformiert sich der Mythos entweder oder verliert sein Publikum. Die Singularität hat den ersten Weg gewählt. Mehr dazu im Abschnitt Grundlagen des maschinellen Lernens.

Die sieben überzeugendsten Argumente für die Unvermeidlichkeit der Singularität — und warum sie auf intuitiver Ebene funktionieren

Bevor wir die Beweisgrundlage analysieren, müssen wir ehrlich die stärksten Argumente der Befürworter des Singularitätskonzepts darstellen. Dies ist kein Strohmann — es ist die stählerne Version der Position (Steelman), die erklärt, warum die Idee bei ernsthaften Forschern, Ingenieuren und Investoren Anklang findet. Mehr dazu im Abschnitt Synthetische Medien.

📊 Argument 1: Empirische Trajektorie des exponentiellen Wachstums der Rechenleistung

Das Mooresche Gesetz, das die Verdopplung der Transistoranzahl auf einem Chip alle 18–24 Monate beschreibt, galt von 1965 bis Anfang der 2020er Jahre. Singularitätsbefürworter weisen darauf hin, dass wenn das exponentielle Wachstum der Rechenleistung anhält (durch neue Architekturen, Quantencomputing, neuromorphe Chips), das Erreichen einer Rechenleistung, die dem menschlichen Gehirn entspricht (~10^16 Operationen pro Sekunde), nur eine Frage der Zeit ist.

Fügt man die Verbesserung von Algorithmen hinzu, die ebenfalls exponentielles Effizienzwachstum zeigt, erscheint das Aufkommen von AGI in absehbarer Zukunft unvermeidlich. Dieses Argument ist stark, weil es auf beobachtbaren historischen Trends basiert: Die Rechenleistung ist tatsächlich jahrzehntelang exponentiell gewachsen, und viele Durchbrüche in der KI (von Bilderkennung bis zu Sprachmodellen) wurden gerade durch die Skalierung von Berechnungen möglich.

| Zeitraum | Wachstumsquelle | Intuitive Attraktivität |

|---|---|---|

| 1965–2000 | Mooresches Gesetz (Transistoren) | Historische Tatsache, leicht zu extrapolieren |

| 2000–2020 | Paralleles Computing, GPUs | Sichtbarer KI-Fortschritt fällt mit Leistungswachstum zusammen |

| 2020+ | Quanten-, neuromorphe Architekturen | Neue Technologien versprechen noch größeren Sprung |

🧠 Argument 2: Grundsätzliche Möglichkeit rekursiver Selbstverbesserung

Wenn KI ein Niveau erreicht, auf dem sie ihren eigenen Code verstehen und verbessern kann (oder effizientere Algorithmen für maschinelles Lernen entwickeln kann), entsteht eine positive Rückkopplung: Jede Verbesserung macht das System fähiger zur nächsten Verbesserung. Menschliche Intelligenz ist durch biologische Konstanten begrenzt (Geschwindigkeit neuronaler Übertragung, Arbeitsgedächtniskapazität, Lebensdauer), aber KI hat solche Einschränkungen nicht.

Theoretisch kann ein System 24/7 arbeiten, horizontal skalieren (sich auf viele Server kopieren), Wissen sofort austauschen. Das Argument appelliert an die Logik: Wenn Selbstverbesserung grundsätzlich möglich ist und KI nicht die biologischen Grenzen des Menschen hat, kann der rekursive Prozess sich beschleunigen, bis er an die physikalischen Grenzen der Berechnung stößt (Thermodynamik, Lichtgeschwindigkeit).

Das Gegenargument erfordert den Beweis, dass Selbstverbesserung unmöglich ist oder dass es nicht offensichtliche Barrieren gibt — eine komplexere Position zur Verteidigung, als einfach die Logik der Rückkopplung zu extrapolieren.

🔬 Argument 3: Präzedenzfälle explosiven Wachstums in Evolution und Geschichte

Singularitätsbefürworter verweisen auf historische Beispiele von Phasenübergängen: das Aufkommen der Sprache bei Homo sapiens, die neolithische Revolution, die industrielle Revolution, die digitale Revolution. Jeder Übergang wurde von einer Beschleunigung des Veränderungstempos begleitet.

Erstellt man ein Diagramm „Zeit zwischen Revolutionen", zeigt es eine Verkürzung der Intervalle — von Millionen Jahren zwischen biologischen Übergängen bis zu Jahrzehnten zwischen technologischen. Die Extrapolation dieses Trends legt nahe, dass der nächste Übergang (Aufkommen übermenschlicher KI) in Jahren oder sogar Monaten erfolgen könnte. Induktion garantiert keine zukünftigen Ergebnisse, aber intuitiv erscheint das Muster überzeugend.

⚙️ Argument 4: Wirtschaftliche Anreize zur Schaffung immer leistungsfähigerer KI

Die Weltwirtschaft investiert Hunderte Milliarden Euro in die KI-Entwicklung. Unternehmen, die als erste AGI schaffen, erhalten einen kolossalen Wettbewerbsvorteil — die Möglichkeit, intellektuelle Arbeit zu automatisieren, wissenschaftliche Forschung zu beschleunigen, in jeder Branche zu dominieren.

Dieses Rennen schafft einen starken wirtschaftlichen Imperativ, die Skalierung von Modellen fortzusetzen, Datensätze zu vergrößern, Architekturen zu verbessern. Selbst wenn einzelne Forscher die Risiken erkennen, treibt die Marktlogik die Industrie voran. Investitionen in KI wachsen tatsächlich exponentiell, und der Wettbewerb zwischen Laboren (OpenAI, DeepMind, Anthropic, chinesische Unternehmen) intensiviert sich.

Wirtschaftliche Anreize sind ein starker Prädiktor für Verhalten, und es ist schwer vorstellbar, dass das Rennen freiwillig stoppt.

🧬 Argument 5: Fehlen fundamentaler Barrieren für AGI

Das menschliche Gehirn ist ein physikalisches System, das den Gesetzen der Physik und Chemie gehorcht. Wenn Intelligenz aus materiellen Prozessen entsteht (und nicht aus einer immateriellen Seele), kann sie prinzipiell in einem anderen Substrat reproduziert werden.

Wir wissen bereits, dass neuronale Netze zu Lernen, Verallgemeinerung und Problemlösung fähig sind. Moderne Sprachmodelle zeigen emergente Fähigkeiten — Fähigkeiten, die nicht explizit programmiert wurden, aber bei der Skalierung entstanden sind. Wenn es keine fundamentale Barriere gibt, ist AGI eine Frage der Ingenieurskunst und Ressourcen, nicht der prinzipiellen Unmöglichkeit.

- Materialismus: Gehirn = Maschine, Maschine kann kopiert werden

- Emergente Fähigkeiten: Fähigkeiten entstehen bei Skalierung, nicht explizit programmiert

- Gegenargument erfordert Postulierung von Immaterialität oder unbekannten Barrieren

🕳️ Argument 6: Asymmetrie der Risiken — der Preis des Irrtums ist zu hoch

Selbst wenn die Wahrscheinlichkeit eines harten Singularitäts-Takeoffs gering ist (sagen wir 5–10%), sind die potenziellen Konsequenzen so katastrophal (existenzielles Risiko für die Menschheit), dass es irrational wäre, die Bedrohung zu ignorieren. Dies ist eine Anwendung des Vorsorgeprinzips: Bei hohen Einsätzen erfordert selbst eine geringe Wahrscheinlichkeit ernsthafte Beachtung.

Befürworter weisen darauf hin, dass wir uns keinen Fehler leisten können — wenn die Singularität eintritt und wir nicht vorbereitet sind, sind die Konsequenzen irreversibel. Versicherungslogik: Wir zahlen eine Prämie, selbst wenn die Wahrscheinlichkeit einer Katastrophe gering ist. Emotional wird das Argument durch die Angst vor Kontrollverlust und existenzieller Bedrohung verstärkt.

👁️ Argument 7: Expertenkonsens über die Möglichkeit von AGI in absehbarer Zukunft

Umfragen unter KI-Forschern zeigen, dass ein erheblicher Teil der Experten das Aufkommen von AGI innerhalb der nächsten 20–50 Jahre für wahrscheinlich hält. Obwohl die Schätzungen variieren, weist die Medianprognose auf die Jahre 2040–2060 hin.

Wenn Experten, die auf diesem Gebiet arbeiten, AGI für erreichbar halten, ist dies ein gewichtiges Zeugnis. Singularitätsbefürworter weisen darauf hin, dass Skepsis oft von Menschen kommt, die weit von der Spitzenforschung entfernt sind, während diejenigen, die den Fortschritt von innen sehen, optimistischer (oder pessimistischer, je nach Perspektive) bezüglich der Entwicklungsgeschwindigkeit sind. Das Argument appelliert an die Autorität von Experten — eine Heuristik, die normalerweise gut funktioniert.

Das Problem ist, dass Expertenprognosen über zukünftige Technologien historisch unzuverlässig sind, aber intuitiv neigen wir dazu, der Meinung von Fachleuten zu vertrauen.

Alle sieben Argumente funktionieren auf intuitiver Ebene, weil jedes an unterschiedliche kognitive Mechanismen appelliert: Extrapolation von Trends, Rückkopplungslogik, historische Muster, wirtschaftliche Anreize, Materialismus, Risikomanagement, Expertenautorität. Zusammen schaffen sie ein überzeugendes Narrativ, das erklärt, warum die Idee der Singularität selbst bei Skeptikern Anklang findet.

Was die Daten 2024–2025 zeigen: drei Grafiken, die keinen exponentiellen Durchbruch bestätigen

Beim Übergang von theoretischen Argumenten zur empirischen Überprüfung ist es notwendig zu analysieren, was in der Realität mit der KI-Entwicklung geschieht. Wenn sich die Singularität nähert, sollten wir bestimmte Indikatoren beobachten: beschleunigte Fortschrittsraten, das Auftreten qualitativ neuer Fähigkeiten, Anzeichen rekursiver Selbstverbesserung. Mehr dazu im Bereich KI und Technologie.

Die Daten der letzten zwei Jahre zeichnen ein komplexeres Bild.

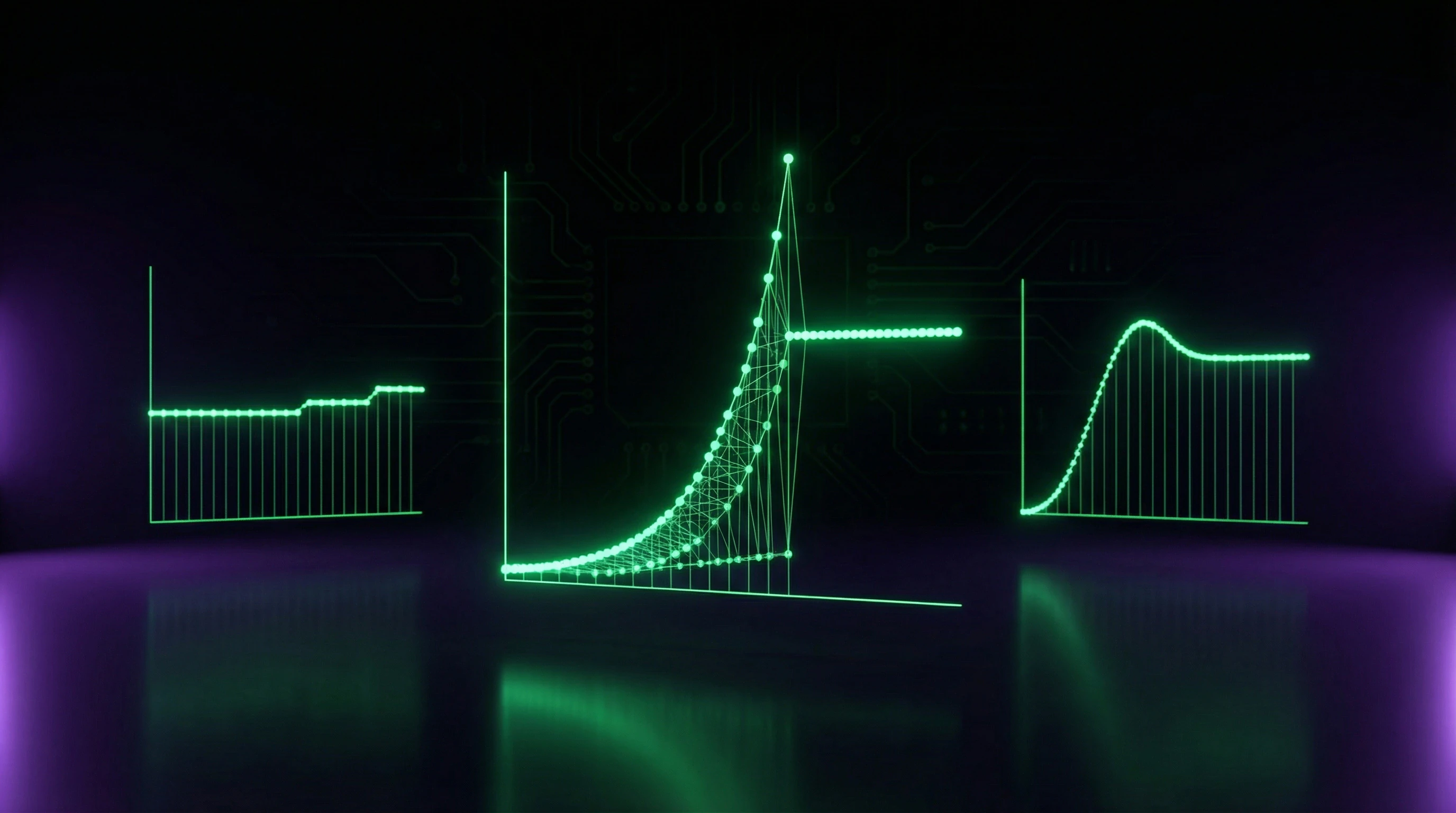

📊 Indikator 1: Verlangsamung des Leistungswachstums von Sprachmodellen bei der Skalierung

Von 2020 bis 2023 war ein beeindruckender Fortschritt zu beobachten: von GPT-3 (175 Milliarden Parameter) bis zu GPT-4 und Konkurrenten mit Billionen von Parametern. Die Analyse von Benchmarks zeigt jedoch, dass der Leistungszuwachs pro Einheit zusätzlicher Rechenleistung zu sinken begann.

Modelle werden größer und teurer im Training, aber die Qualitätsverbesserung der Ausgaben folgt nicht mehr der früheren exponentiellen Trajektorie. Dieses Phänomen, bekannt als Gesetz der abnehmenden Skalierungserträge, legt nahe, dass eine bloße Vergrößerung von Modell und Datensatz kein proportionales Wachstum der Fähigkeiten garantiert (S010).

| Zeitraum | Charakteristik des Fortschritts | Indikator |

|---|---|---|

| 2020–2022 | Exponentielles Leistungswachstum | Jede Verdopplung der Parameter → signifikanter Qualitätssprung |

| 2023–2025 | Verlangsamung der Erträge | Billionen Parameter → marginale Verbesserungen |

Eine systematische Übersicht moderner Ansätze zeigt, dass selbst die fortschrittlichsten KI-Systeme auf fundamentale Grenzen im Kontextverständnis, bei Kausalzusammenhängen und beim Wissenstransfer auf neue Domänen stoßen (S010). Würden wir uns einer AGI nähern, wäre eine Verbesserung gerade in diesen Bereichen zu erwarten.

🧪 Indikator 2: Fehlen von Anzeichen rekursiver Selbstverbesserung in existierenden Systemen

Ein Schlüsselelement des Hard-Takeoff-Szenarios ist die Fähigkeit der KI, ihre eigenen Algorithmen zu verbessern. In der Praxis zeigen moderne Machine-Learning-Systeme keine solche Fähigkeit.

Sprachmodelle können Code generieren, aber sie können nicht eigenständig neue neuronale Netzwerkarchitekturen entwickeln, den Trainingsprozess optimieren oder ihre eigenen Gewichte ohne menschliches Eingreifen verbessern. Alle Durchbrüche der letzten Jahre (Transformer, Reinforcement Learning from Human Feedback, Chain-of-Thought Prompting) wurden von menschlichen Forschern erzielt, nicht von den Modellen selbst.

Versuche, Systeme zu schaffen, die zur automatischen Algorithmenverbesserung fähig sind (AutoML, Neural Architecture Search), zeigten begrenzten Erfolg. Die Kluft zwischen „Optimierung innerhalb eines Paradigmas" und „Schaffung eines neuen Paradigmas" bleibt enorm.

Diese Systeme können Hyperparameter optimieren oder effiziente Architekturen in einem vorgegebenen Suchraum finden, sind aber nicht zu konzeptionellen Durchbrüchen fähig, die ein Umdenken fundamentaler Ansätze erfordern.

🧾 Indikator 3: Stabilisierung der Investitionen und Übergang vom Hype zur praktischen Implementierung

Nach dem Höhepunkt des Hypes um generative KI im Jahr 2023 begann der Markt nüchterner zu werden. Die Investitionen wachsen weiter, aber das Wachstumstempo hat sich verlangsamt, und der Fokus hat sich von der Entwicklung immer größerer Modelle auf die praktische Implementierung und Monetarisierung bestehender Technologien verlagert.

- Hohe Inferenzkosten

- Ökonomische Barriere für Masseneinführung; Unternehmen suchen nach Wegen, Kosten zu senken, statt Kapazitäten zu skalieren.

- Integrationskomplexität

- KI erfordert Überarbeitung bestehender Prozesse; dies ist keine Revolution, sondern eine Ingenieuraufgabe.

- Zuverlässigkeitsprobleme

- Halluzinationen, unvorhersehbares Verhalten – Anzeichen dafür, dass Systeme Werkzeuge bleiben, keine Agenten.

Dieses Muster ist typisch für Technologiezyklen: Nach der anfänglichen Euphorie folgt die Phase des „Tals der Enttäuschung" (nach dem Gartner Hype Cycle). Wäre die Singularität nahe, würden wir die entgegengesetzte Dynamik beobachten – beschleunigte Investitionen, panische Erklärungen über Kontrollverlust, Notfallmaßnahmen der Regulierungsbehörden.

Stattdessen geht die Industrie in einen Normalisierungsmodus über: KI wird zu einem gewöhnlichen Werkzeug, nicht zu einer revolutionären Bedrohung. Dies entspricht der Logik gradueller Transformation, nicht eines sprunghaften Übergangs.

🔎 Qualitative Analyse: Warum „emergent abilities" kein Beweis für die Annäherung an AGI sind

Befürworter der Singularität verweisen oft auf emergent abilities – Fähigkeiten, die bei großen Sprachmodellen plötzlich auftreten, wenn eine bestimmte Größenordnung erreicht wird, aber bei kleineren Versionen fehlen. Beispiele umfassen Fähigkeiten zur Arithmetik, logischem Denken, Übersetzung in Sprachen, die nicht in den Trainingsdaten vertreten waren.

Dies wird als Zeichen eines qualitativen Sprungs interpretiert, als Vorbote dramatischerer Übergänge. Eine detaillierte Analyse zeigt jedoch, dass viele „emergent abilities" Artefakte der Wahl von Metriken und Bewertungsschwellen sind.

- Forscher verwenden binäre Metriken (bestanden/nicht bestanden) statt kontinuierlicher.

- Bei Neuberechnung mit kontinuierlichen Metriken erweist sich das „plötzliche" Auftreten als graduelle Verbesserung.

- Fähigkeiten überschreiten eine willkürliche Schwelle und erzeugen die Illusion eines Sprungs.

- Fähigkeiten verbessern sich gleichmäßig mit der Skalierung, statt aus dem Nichts zu erscheinen.

Dies negiert nicht den beeindruckenden Fortschritt, stellt aber die Interpretation als qualitativen Sprung in Frage. Das Muster stimmt eher mit inkrementellem Fortschritt überein als mit der Annäherung an eine Singularität.

Mechanismen der Kausalität: Warum die Korrelation zwischen Rechenleistung und Intelligenz nicht linear ist

Eines der zentralen Argumente der Singularitäts-Befürworter basiert auf Extrapolation: Wenn die Rechenleistung exponentiell wächst und wenn Intelligenz mit Rechenleistung korreliert, dann muss auch die KI-Intelligenz exponentiell wachsen. Diese Logik enthält mehrere versteckte Annahmen, die einer Überprüfung nicht standhalten. Mehr dazu im Abschnitt Denkfehler.

🧬 Problem 1: Intelligenz lässt sich nicht auf Rechenleistung reduzieren — die Rolle von Architektur und Algorithmen

Das menschliche Gehirn arbeitet mit einer Frequenz von ~200 Hz (Geschwindigkeit der Nervenimpulsübertragung), was um Größenordnungen langsamer ist als moderne Prozessoren (Gigahertz). Dennoch löst das Gehirn Aufgaben, mit denen KI schlecht oder gar nicht zurechtkommt: Verständnis der physischen Welt, soziale Intelligenz, Kreativität, Wissenstransfer.

Die Effizienz von Intelligenz wird nicht durch die Geschwindigkeit von Berechnungen bestimmt, sondern durch die Architektur der Informationsverarbeitung. Eine Verdopplung der Prozessoren ohne Änderung des Algorithmus führt oft zu einem sublinearen Leistungszuwachs.

Dies weist auf einen fundamentalen Unterschied hin: Biologische Intelligenz ist auf Energieeffizienz und Anpassungsfähigkeit optimiert, nicht auf absolute Rechenleistung. Moderne neuronale Netze erfordern exponentielles Wachstum der Parameter für einen linearen Qualitätszuwachs — ein Phänomen, das als Scaling Plateau bekannt ist.

🔄 Problem 2: Das Gesetz des abnehmenden Ertrags bei der Skalierung

Daten aus 2023–2024 zeigen, dass die Vergrößerung von Modellen immer geringere Leistungssteigerungen pro verdoppeltem Rechenaufwand bringt. Dies ist kein Zufall — es ist eine Folge davon, dass die Qualität der Trainingsdaten endlich ist und die architektonischen Grenzen von Transformern bei der Skalierung sichtbar werden.

- Erste 10 Mrd. Parameter: signifikanter Fähigkeitszuwachs

- 100 Mrd. Parameter: bemerkenswerter, aber sich verlangsamender Zuwachs

- 1 Billion Parameter: marginale Verbesserungen bei den meisten Aufgaben

- Weitere Skalierung: erfordert qualitativ neue Architekturen, nicht einfach mehr Rechenleistung

Das bedeutet, dass exponentielles Wachstum der Rechenleistung sich nicht transformiert in exponentielles Wachstum der Intelligenz. Die Kurve flacht ab.

⚙️ Problem 3: Intelligenz ist mehrdimensional, Rechenleistung ist eindimensional

Intelligenz umfasst: Logik, Intuition, soziales Verständnis, Planung, Lernen mit kleinen Stichproben, Wissenstransfer, Metakognition. Rechenleistung ist einfach die Anzahl der Operationen pro Sekunde. Eine Korrelation zwischen ihnen existiert, aber sie ist weder kausal noch monoton.

- Logische Intelligenz

- Kann sich mit größerer Rechenleistung verbessern, stößt aber an algorithmische Grenzen (NP-Vollständigkeit, Unentscheidbarkeit).

- Soziale Intelligenz

- Erfordert keine Berechnungen, sondern Modelle menschlichen Verhaltens, die sich nicht einfach durch Erhöhung der Parameter gewinnen lassen.

- Kreativität

- Hängt von der Architektur der Suche im Lösungsraum ab, nicht von der Geschwindigkeit des Durchprobierens von Varianten.

Der Versuch, alle KI-Probleme durch Skalierung zu lösen, ist ein Kategorienfehler. Es ist, als würde man versuchen, Musik zu verbessern, indem man die Lautstärke erhöht.

🎯 Warum der Mythos der linearen Korrelation so überzeugend ist

Extrapolation funktioniert auf intuitiver Ebene: Wir sehen, dass die Rechenleistung wächst, sehen, dass KI besser wird, und nehmen an, dass dies ein Kausalzusammenhang ist. Aber das ist post hoc ergo propter hoc — ein logischer Fehlschluss.

Die Korrelation zwischen Rechenleistung und KI-Leistung existiert, aber sie verschleiert eine tiefere Ursache: Verbesserung von Architekturen, Algorithmen und Daten. Wenn diese Faktoren sich stabilisieren, verliert die Rechenleistung ihre magische Kraft.

Dies erklärt, warum Prognosen über die Singularität in 2030, 2040 oder 2050 ständig verschoben werden. Jedes Mal, wenn Skalierung nicht mehr funktioniert, suchen Singularitäts-Befürworter eine neue Quelle exponentiellen Wachstums — Quantencomputer, neuromorphe Chips, neue Architekturen. Aber das ist keine Extrapolation mehr, sondern die Suche nach Rettung des Mythos.

Die Realität: KI wird sich entwickeln, aber durch qualitative Sprünge in Architektur und Verständnis, nicht durch endlose Skalierung. Das ist langsamer, weniger dramatisch, aber viel wahrscheinlicher. Mehr darüber, wie Prognosen gescheitert sind, siehe Analyse der Kurzweil-Prognosen.