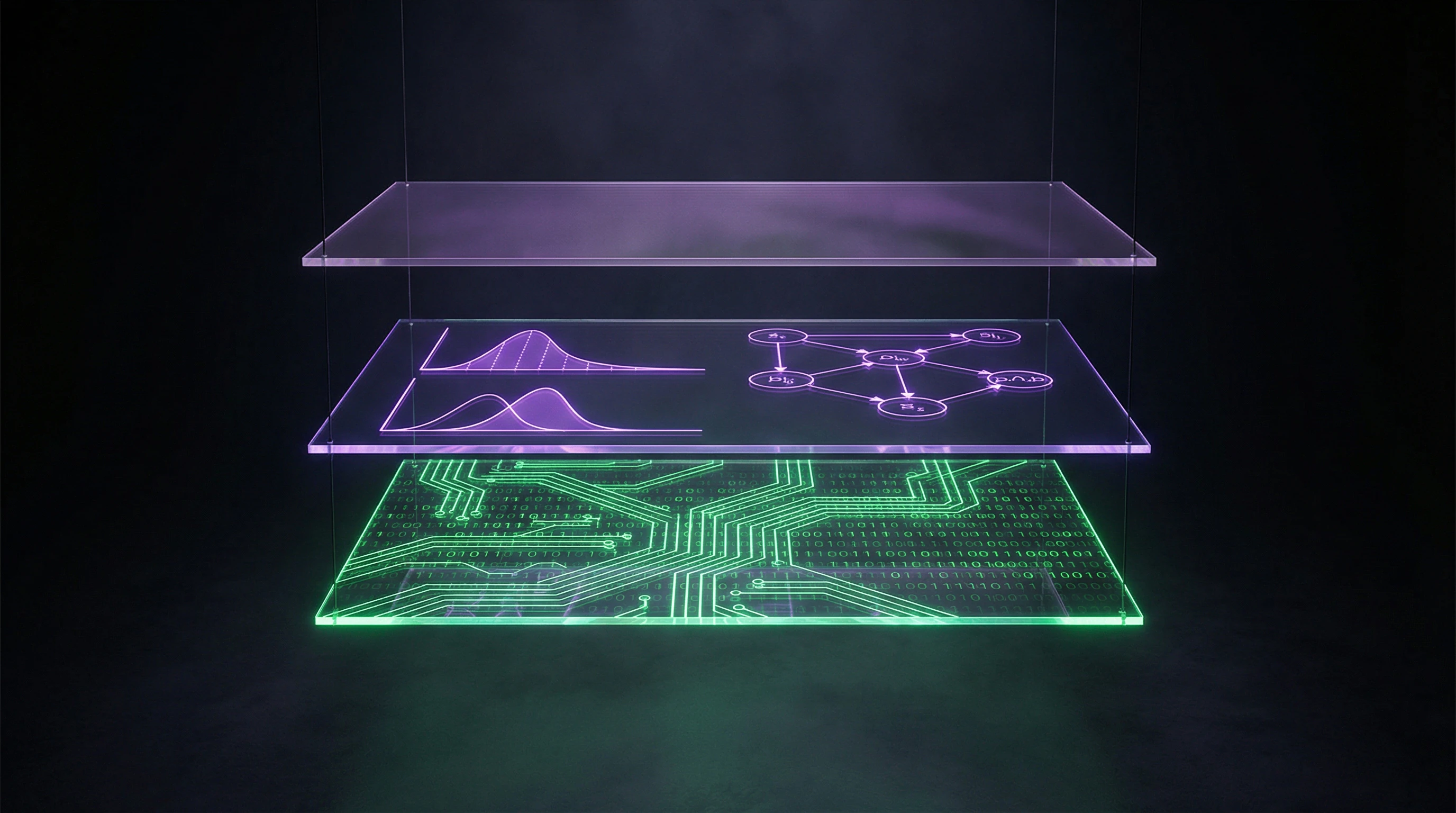

Die Simulationshypothese behauptet, dass unsere Realität ein Computerprogramm sein könnte. Trotz ihrer Popularität in der Popkultur und unter Technologie-Enthusiasten steht diese Idee vor einem fundamentalen Problem: Sie ist unwiderlegbar und nicht überprüfbar. Philosophen und Wissenschaftler weisen darauf hin, dass die Simulationshypothese keinen Testmechanismus bietet, keine Vorhersagen macht und nicht von alternativen Erklärungen der Realität unterschieden werden kann. Dies macht sie zu einem interessanten Gedankenexperiment, aber nicht zu einer wissenschaftlichen Theorie.

👁️ Stellen Sie sich eine Idee vor, die gleichzeitig die Fantasie von Millionen beflügelt, Blockbuster und philosophische Debatten inspiriert — aber für die Wissenschaft völlig nutzlos ist. Die Simulationshypothese wurde zum kulturellen Phänomen des 21. Jahrhunderts und drang aus akademischen Kreisen durch „Matrix", Elon Musks Auftritte und unzählige Podcasts ins Massenbewusstsein vor. Hinter der schillernden Fassade verbirgt sich jedoch ein fundamentales Problem: Diese Idee kann weder bewiesen noch widerlegt werden. Sie gehört zu einer besonderen Kategorie von Aussagen, die Philosophen als „unfalsifizierbar" bezeichnen — und genau das macht sie wissenschaftlich steril, trotz ihrer intellektuellen Anziehungskraft.

🧩 Was genau behauptet die Simulationshypothese — und warum die Grenzen dieser Behauptung bis zur Unkenntlichkeit verschwimmen

In ihrer Grundform geht die Simulationshypothese davon aus, dass die von uns beobachtete Realität kein fundamentales physikalisches Universum ist, sondern eine Computersimulation, die von einer fortgeschritteneren Zivilisation oder Entität erschaffen wurde. Nick Bostrom (2003) schlug ein Trilemma vor: Entweder sterben Zivilisationen aus, bevor sie technologische Reife erreichen, oder fortgeschrittene Zivilisationen haben kein Interesse daran, Simulationen zu erschaffen, oder wir befinden uns in einer Simulation (S001).

Drei Versionen der Hypothese mit radikal unterschiedlichen Konsequenzen

Das kritische Problem: Die „Simulationshypothese" ist keine einheitliche Behauptung. Es existieren mindestens drei verschiedene Versionen, die in populären Diskussionen häufig vermischt werden. Mehr dazu im Abschnitt Deepfakes.

- Schwache Version

- Es ist technisch möglich, eine Simulation bewusster Wesen zu erschaffen. Dies ist eine Aussage über prinzipielle Machbarkeit, nicht über Wahrscheinlichkeit.

- Mittlere Version

- Solche Simulationen werden in großer Anzahl erschaffen. Fügt Annahmen über Motivation und Umfang hinzu.

- Starke Version

- Wir befinden uns mit hoher Wahrscheinlichkeit gerade jetzt in einer solchen Simulation. Dies ist bereits eine konkrete Aussage über unsere Realität (S001).

David Chalmers versuchte, der Hypothese durch das Konzept der „digitalen Ontologie des Bewusstseins" eine strengere Form zu geben. Doch selbst dieser Versuch stößt auf das Problem der Operationalisierung: Wie genau definieren wir „Simulation"?

Wenn eine Simulation von der „Basisrealität" in allen beobachtbaren Parametern nicht zu unterscheiden ist, worin besteht dann der inhaltliche Unterschied zwischen diesen Konzepten?

Das Demarkationsproblem: Wo endet Physik und beginnt Metaphysik

Die Simulationshypothese balanciert an der Grenze zwischen empirischer Aussage und metaphysikalischer Spekulation. Im Gegensatz zu wissenschaftlichen Theorien, die konkrete Vorhersagen über beobachtbare Phänomene treffen, bietet die Simulationshypothese keinen Mechanismus, der es erlauben würde, ein „simuliertes" Universum von einem „realen" zu unterscheiden. Dies platziert sie in dieselbe Kategorie wie Descartes' klassisches skeptisches Szenario vom bösen Dämon oder die moderne Version des „Gehirns im Tank" (S003).

Damit eine Hypothese wissenschaftlichen Wert hat, muss sie falsifizierbar sein — es müssen potenzielle Beobachtungen existieren, die sie widerlegen könnten. Die Simulationshypothese wird in der Regel so formuliert, dass jede Beobachtung in ihrem Rahmen erklärt werden kann.

| Beobachtung | Erklärung im Rahmen der Hypothese |

|---|---|

| Anomalie in der Physik entdeckt | Das ist ein Bug in der Simulation |

| Physikalische Gesetze funktionieren perfekt | Die Simulation läuft korrekt |

| Diskrete Struktur des Raums gefunden | Das sind die Pixel der Simulation |

| Raum ist kontinuierlich | Die Simulation verwendet kontinuierliche Koordinaten |

Eine solche Struktur macht die Hypothese immun gegen Widerlegung — jedes Ergebnis kann als Bestätigung interpretiert werden (S003).

Warum die populäre Version der Hypothese nicht das ist, was Philosophen diskutieren

Es besteht eine erhebliche Kluft zwischen der akademischen Diskussion über die Simulationshypothese und ihrer populären Version. In der Massenkultur wird die Hypothese oft als konkrete Aussage über die Natur der Realität mit potenziell überprüfbaren Konsequenzen dargestellt — der Suche nach „Glitches" in physikalischen Gesetzen oder diskreten Strukturen der Raumzeit.

Akademische Philosophen wie Chalmers diskutieren die Hypothese im Kontext des Bewusstseinsproblems und der computationalen Theorie des Geistes — eine völlig andere Abstraktionsebene (S001). Technologieunternehmer und Popularisierer stellen die Hypothese oft so dar, als hätte sie praktische Konsequenzen oder sogar eine probabilistische Bewertung („50% Chance, dass wir in einer Simulation sind"), ohne zu präzisieren, auf welchen Prämissen diese Schätzungen basieren und welche alternativen Hypothesen in Betracht gezogen werden.

Die populäre Version der Simulationshypothese ist keine philosophische Aussage über die Natur des Bewusstseins, sondern ein technologischer Mythos, der Terminologie aus der akademischen Diskussion entlehnt, aber ihre logische Struktur verliert.

Die fünf stärksten Argumente für die Simulationshypothese — und warum sie keine wissenschaftliche Theorie ist

Vor der Kritik der Simulationshypothese muss man sie in ihrer überzeugendsten Form darstellen — das nennt man „Steelmanning". Befürworter bringen mehrere intellektuell ernsthafte Argumente vor, die aufmerksame Betrachtung verdienen. Mehr dazu im Abschnitt KI-Fehler und Verzerrungen.

🔬 Das Argument der Rechenleistung und des exponentiellen Technologiewachstums

In den letzten 70 Jahren ist die Rechenleistung exponentiell gewachsen und folgte dem Mooreschen Gesetz. Extrapoliert man diesen Trend über Jahrhunderte oder Jahrtausende, werden zukünftige Zivilisationen über Ressourcen verfügen, die heutige um viele Größenordnungen übertreffen.

Bei ausreichender Leistung wird die Simulation ganzer Universen mit allen physikalischen Prozessen technisch machbar. Die Entwicklung von Virtual Reality und Computerspielen zeigt: Die Kluft zwischen Simulation und Realität verringert sich ständig.

📊 Bostroms probabilistisches Argument: Wenn Simulationen möglich sind, muss es viele geben

Das zentrale Argument basiert auf probabilistischem Denken. Wenn technologisch reife Zivilisationen in der Lage sind, Simulationen bewusster Wesen zu erschaffen und daran interessiert sind, viele solcher Simulationen zu erstellen, dann zeigt eine einfache Rechnung: Die überwältigende Mehrheit bewusster Wesen müsste sich in Simulationen befinden, nicht in der Basisrealität.

Mathematisch: Wenn eine Basiszivilisation N Simulationen erstellt und jede M bewusste Wesen enthält, beträgt das Verhältnis simulierter zu „realen" Wesen N×M zu 1. Bei großen Werten von N und M strebt die Wahrscheinlichkeit, dass ein zufällig ausgewähltes Wesen sich in der Basisrealität befindet, gegen null.

🧠 Das Argument der Computertheorie des Bewusstseins und des Funktionalismus

Das dritte Argument stützt sich auf den Funktionalismus — die Position, dass Bewusstsein nicht durch das Substrat (biologische Neuronen) definiert wird, sondern durch funktionale Organisation und Rechenprozesse (S001). Wenn dies zutrifft, kann Bewusstsein auf jedem ausreichend komplexen Rechensubstrat realisiert werden, einschließlich digitaler Computer.

Wenn Bewusstsein ein Rechenprozess ist, dann wäre simuliertes Bewusstsein echtes Bewusstsein, keine Imitation. Simulierte Wesen hätten genuine subjektive Erfahrungen, ununterscheidbar von denen der Wesen in der Basisrealität.

🕳️ Das Argument der Quantenmechanik und der Diskretheit der Natur

Einige Befürworter verweisen auf Besonderheiten der Quantenmechanik als potenzielle Anzeichen der simulierten Natur der Realität. Quantenunbestimmtheit, das Superpositionsprinzip und der Kollaps der Wellenfunktion bei Beobachtung werden als Optimierungen von Rechenressourcen interpretiert: Das System berechnet den genauen Zustand eines Teilchens nicht, bis es notwendig wird.

Theoretische Ansätze zur Quantengravitation legen eine diskrete Struktur der Raumzeit auf Planck-Skalen nahe — analog zur Pixelstruktur eines Computerbildschirms. Obwohl diese Ideen spekulativ bleiben, werden sie zur Unterstützung der Intuition über die „digitale" Natur der Physik verwendet.

⚙️ Das Argument der Feinabstimmung physikalischer Konstanten

Das letzte Argument hängt mit dem Problem der Feinabstimmung fundamentaler physikalischer Konstanten zusammen. Die beobachteten Werte der kosmologischen Konstante, der Massenverhältnisse elementarer Teilchen und der Wechselwirkungskonstanten liegen in einem sehr engen Bereich, der die Existenz komplexer Strukturen und Lebens ermöglicht.

Die geringste Änderung dieser Werte würde das Universum für Leben ungeeignet machen. Die Simulationshypothese wird als Erklärung angeboten: Die Parameter unseres Universums wurden von den Schöpfern speziell gewählt, um interessante Phänomene zu ermöglichen, einschließlich Leben und Bewusstsein.

- Alle fünf Argumente beruhen auf der Extrapolation aktueller Trends (Rechenwachstum, VR-Entwicklung) in eine ungewisse Zukunft.

- Bostroms probabilistisches Argument erfordert die gleichzeitige Annahme dreier unbewiesener Prämissen.

- Funktionalismus ist eine philosophische Position, keine etablierte Tatsache über die Natur des Bewusstseins.

- Quantenmechanik wird durch die Brille der Rechenoptimierung interpretiert, aber das ist nicht die einzige Interpretation.

- Feinabstimmung wird durch zahlreiche alternative Hypothesen erklärt (Multiversum, anthropisches Prinzip).

Die Stärke dieser Argumente liegt darin, dass sie logisch kohärent sind und sich auf reale Phänomene stützen. Die Schwäche liegt darin, dass keines von ihnen eine Möglichkeit bietet, Simulation von Realität zu unterscheiden — und das ist eine fundamentale Anforderung an eine wissenschaftliche Hypothese.

Jedes Argument ist isoliert überzeugend, aber zusammen erzeugen sie die Illusion von Erklärungskraft. Tatsächlich beschreiben sie eine Möglichkeit, nicht eine Wahrscheinlichkeit, und bieten keinen Mechanismus zur Überprüfung.

Das unterscheidet die Simulationshypothese von wissenschaftlichen Theorien, die nicht nur Phänomene erklären, sondern auch beobachtbare Konsequenzen vorhersagen, die ihre Widerlegung ermöglichen. Mythen über bewusste KI folgen oft derselben Logik: überzeugende Beschreibung einer Möglichkeit ohne Überprüfungsmechanismus.

Warum keines dieser Argumente die Hypothese zu einer überprüfbaren wissenschaftlichen Aussage macht

Trotz der intellektuellen Raffinesse der oben genannten Argumente leiden alle unter einem fundamentalen Problem: Sie bieten keine Möglichkeit zur empirischen Überprüfung der Simulationshypothese. Jedes Argument basiert entweder auf unbewiesenen philosophischen Prämissen, macht logische Sprünge, die nicht aus den präsentierten Voraussetzungen folgen, oder formuliert das Problem lediglich um, ohne es zu lösen. Mehr dazu im Abschnitt Techno-Esoterik.

📊 Extrapolation technologischen Fortschritts ist kein Beweis

Das Argument der Rechenleistung setzt voraus, dass aktuelle Trends in der Technologieentwicklung unbegrenzt fortbestehen werden. Die Wissenschaftsgeschichte ist jedoch voll von Beispielen für Technologien, die fundamentale Grenzen erreicht haben.

Das Mooresche Gesetz verlangsamt sich bereits aufgrund von Quanteneffekten auf kleinen Skalen. Es existieren theoretische Grenzen der Berechnung, die mit Thermodynamik und Quantenmechanik zusammenhängen (Bremermann-Grenze, Bekenstein-Grenze).

Selbst bei unbegrenztem Wachstum der Rechenleistung beweist dies nicht, dass die Simulation bewusster Wesen technisch möglich ist. Wir wissen nicht, ob Bewusstsein eine berechenbare Funktion ist, und falls ja, welche Rechenressourcen für seine Simulation erforderlich sind.

Möglicherweise existieren prinzipielle Hindernisse für die Simulation von Bewusstsein, die nicht durch bloße Steigerung der Rechenleistung überwunden werden können (S001).

🧩 Bostroms probabilistisches Argument enthält versteckte Prämissen

Bostroms Trilemma erscheint als strenge logische Argumentation, basiert jedoch auf mehreren impliziten Prämissen, von denen jede angefochten werden kann.

- Erste Prämisse: Wahrscheinlichkeitsraum der Realitäten

- Das Argument setzt voraus, dass wir probabilistische Überlegungen sinnvoll auf die Frage anwenden können, in welcher „Realität" wir uns befinden. Dies erfordert die Existenz eines Wahrscheinlichkeitsraums, in dem ein Maß über verschiedene Realitätstypen definiert werden kann – eine Annahme, die selbst metaphysisch ist und keine offensichtliche Begründung hat (S003).

- Zweite Prämisse: Indifferenzprinzip

- Das Argument setzt voraus, dass wir uns als zufällig ausgewählt aus der Menge aller bewussten Wesen betrachten sollten. Dieses Prinzip ist im Kontext anthropischer Überlegungen problematisch und führt zu bekannten Paradoxien wie dem Weltuntergangsparadoxon. Philosophen weisen darauf hin, dass die Anwendung probabilistischer Überlegungen auf Fragen zur fundamentalen Natur der Realität zusätzliche Begründung erfordert, die Bostrom nicht liefert (S003).

🧠 Funktionalismus über Bewusstsein bleibt eine unbewiesene philosophische Position

Das Argument der computationalen Bewusstseinstheorie hängt vollständig von der Wahrheit des Funktionalismus ab – einer philosophischen Theorie über die Natur des Bewusstseins. Funktionalismus ist jedoch nur eine von vielen konkurrierenden Bewusstseinstheorien und sieht sich ernsthaften Einwänden gegenüber.

John Searles berühmtes Gedankenexperiment „Chinesisches Zimmer" richtet sich genau gegen den Funktionalismus und behauptet, dass syntaktische Symbolverarbeitung (Berechnung) kein semantisches Verständnis und keine subjektive Erfahrung erzeugen kann (S001).

Selbst wenn Funktionalismus wahr ist, löst dies nicht die Frage, ob wir feststellen können, ob wir uns in einer Simulation befinden. Wenn simuliertes Bewusstsein nach allen inneren Merkmalen von „echtem" Bewusstsein nicht zu unterscheiden ist, wird der Unterschied zwischen ihnen rein äußerlich und möglicherweise ohne praktische Bedeutung.

Chalmers erkennt dieses Problem an und schlägt vor, dass simulierte Realität in gewissem Sinne für ihre Bewohner „echt" ist (S001). Mehr über philosophische Fallen des Bewusstseins siehe in der Analyse der Mythen über bewusste KI.

⚠️ Quantenmechanik liefert keine Beweise für eine Simulation

Die Interpretation der Quantenmechanik als Zeichen einer Simulation ist ein klassisches Beispiel für Apophänie – die Wahrnehmung von Mustern dort, wo keine existieren. Quantenunbestimmtheit und Kollaps der Wellenfunktion haben zahlreiche Interpretationen im Rahmen der Standardphysik (Kopenhagener Interpretation, Viele-Welten-Interpretation, De-Broglie-Bohm usw.), von denen keine die Annahme einer Simulation erfordert.

Was die Diskretheit der Raumzeit betrifft, bleibt dies eine offene Frage in der Quantengravitation. Einige Ansätze (Schleifenquantengravitation) setzen Diskretheit voraus, andere (Stringtheorie) nicht. Doch selbst wenn die Raumzeit auf Planck-Skalen diskret ist, ist dies kein Beweis für eine Simulation – es ist einfach eine fundamentale Eigenschaft der Physik.

Die Analogie zu Pixeln eines Computerbildschirms ist oberflächlich und hat keine Erklärungskraft. Die Diskretheit der Physik erfordert keine Erklärung durch Simulation, ebenso wie die Welleneigenschaften der Materie keine Erklärung durch Wellen in einem Medium erfordern.

Ausführlicher über Quantenmystizismus und seine logischen Fehler siehe in der Analyse des Quantenmystizismus.

Das fundamentale Problem der Unwiderlegbarkeit — und warum es den wissenschaftlichen Wert der Hypothese zunichtemacht

Das zentrale Problem der Simulationshypothese liegt nicht darin, dass sie falsch ist, sondern darin, dass sie unwiderlegbar ist. Dies ordnet sie einer besonderen Kategorie von Aussagen zu, die Wissenschaftsphilosophen als wissenschaftlich unfruchtbar betrachten. Karl Popper formulierte das Falsifizierbarkeitskriterium als Demarkationslinie zwischen Wissenschaft und Nichtwissenschaft: Eine wissenschaftliche Theorie muss Vorhersagen treffen, die durch Beobachtungen widerlegt werden können. Mehr dazu im Abschnitt Realitätsprüfung.

🔎 Was macht eine Aussage unwiderlegbar und warum ist das problematisch

Eine unwiderlegbare Aussage ist eine Aussage, die mit jeder möglichen Beobachtung vereinbar ist. Ein klassisches Beispiel ist die Aussage „Gott existiert und wirkt in der Welt, aber seine Handlungen sind von natürlichen Prozessen nicht zu unterscheiden". Eine solche Aussage kann nicht widerlegt werden, weil jede Beobachtung als mit ihr vereinbar interpretiert werden kann.

Die Simulationshypothese hat dieselbe Struktur: Sie behauptet die Existenz einer „äußeren" Realität (der Erschaffer der Simulation), die per Definition von innerhalb der Simulation nicht beobachtbar ist (S003).

Wenn eine Theorie mit jeder Beobachtung vereinbar ist, erklärt sie nichts. Erklärung erfordert den Ausschluss von Alternativen — eine Theorie muss nicht nur sagen, was wir beobachten, sondern auch, was wir nicht beobachten sollten, wenn die Theorie wahr ist.

Die Simulationshypothese trifft solche Vorhersagen nicht (S003). Das Problem der Unwiderlegbarkeit liegt nicht darin, dass solche Aussagen notwendigerweise falsch sind, sondern darin, dass sie keine Erklärungskraft besitzen.

📊 Die Simulationshypothese und klassischer Skeptizismus: dasselbe Problem

Philosophen weisen darauf hin, dass die Simulationshypothese eine moderne Version klassischer skeptischer Szenarien ist, wie Descartes' böser Dämon oder das „Gehirn im Tank". Descartes schlug ein Gedankenexperiment vor: Was, wenn alles, was wir wahrnehmen, eine Illusion ist, die von einem bösen Dämon erschaffen wurde, der unsere Sinne täuscht?

Die moderne Version: Was, wenn wir Gehirne in Tanks sind, die an einen Computer angeschlossen sind, der all unsere Erfahrungen generiert? (S003)

| Szenario | Struktur des Problems | Warum nicht wissenschaftlich |

|---|---|---|

| Descartes' böser Dämon | Externe Instanz erschafft perfekte Illusion | Keine Möglichkeit, Täuschung von Realität zu unterscheiden |

| Gehirn im Tank | Computer generiert alle Erfahrungen | Perfekte Illusion ist von Realität nicht zu unterscheiden |

| Simulationshypothese | Erschaffer haben unsere Realität als Programm gestartet | Äußere Realität ist für Beobachtung unzugänglich |

Diese Szenarien sind philosophisch interessant, weil sie uns zwingen, über die Natur von Wissen und die Rechtfertigung von Überzeugungen nachzudenken. Aber sie sind keine wissenschaftlichen Hypothesen, weil sie keine Möglichkeit bieten, den „getäuschten" Zustand vom „ungetäuschten" zu unterscheiden (S003).

🧬 Warum die „Suche nach Glitches" kein wissenschaftliches Programm ist

Einige Enthusiasten der Simulationshypothese schlagen vor, nach „Glitches" oder Anomalien in den physikalischen Gesetzen als Beweis für die simulierte Natur der Realität zu suchen. Diese Idee ist attraktiv, stößt aber auf mehrere Probleme.

Erstens: Was genau gilt als „Glitch"? Jede Anomalie in den Daten kann entweder als Messfehler, als Hinweis auf neue Physik oder als „Glitch in der Simulation" erklärt werden. Ohne unabhängiges Kriterium zur Unterscheidung dieser Interpretationen ist die Suche nach Glitches keine Prüfung der Hypothese.

- Messfehler

- Problem im Gerät oder in der Methodik, erfordert Wiederholung des Experiments

- Neue Physik

- Phänomen, das eine Erweiterung bestehender Theorien erfordert, wird durch Vorhersagen geprüft

- Glitch in der Simulation

- Interpretation, die keine neuen Vorhersagen trifft und Alternativen nicht ausschließt

Zweitens: Selbst wenn wir eine unerklärliche Anomalie entdecken, wäre dies kein Beweis für eine Simulation — es wäre einfach eine unerklärliche Anomalie. Die Wissenschaftsgeschichte ist voll von Beispielen für Anomalien, die letztendlich im Rahmen erweiterter oder neuer Theorien erklärt wurden (Periheldrehung des Merkur, anomales magnetisches Moment des Elektrons usw.). Die Interpretation einer Anomalie als „Glitch in der Simulation" ist eine zusätzliche Annahme, die selbst einer Begründung bedarf.

⚙️ Das Problem der Unterbestimmtheit der Theorie durch Daten

Wissenschaftsphilosophen kennen das Problem der Unterbestimmtheit seit langem: Dieselben Daten können durch mehrere konkurrierende Theorien erklärt werden. Die Simulationshypothese ist ein Extremfall dieses Problems.

Jede Beobachtung, die wir innerhalb der Simulation machen können, ist sowohl mit der Simulationshypothese als auch mit der Hypothese vereinbar, dass wir in einer Basisrealität leben. Es gibt keine logische Möglichkeit, zwischen ihnen auf Grundlage von Daten zu wählen.

Das bedeutet, dass die Simulationshypothese weder empirisch bestätigt noch widerlegt werden kann. Sie verbleibt im Bereich der Metaphysik, nicht der Wissenschaft. Wissenschaft erfordert nicht nur die logische Möglichkeit einer Theorie, sondern auch ihre Fähigkeit, Alternativen durch Vorhersagen und Beobachtungen auszuschließen.

Ein verwandtes Problem — Mythen über bewusste KI stützen sich oft auf ähnliche Logik: Wenn wir Bewusstsein nicht von seiner Imitation unterscheiden können, wird die Unterscheidung philosophisch, nicht wissenschaftlich. Analog: Wenn wir Simulation nicht von Realität unterscheiden können, liegt diese Unterscheidung jenseits der Wissenschaft.

🔬 Warum dies den wissenschaftlichen Wert zunichtemacht

Der wissenschaftliche Wert einer Theorie liegt in ihrer Fähigkeit, Forschung zu leiten, neue Vorhersagen zu treffen und Alternativen auszuschließen. Die Simulationshypothese tut nichts davon. Sie sagt keine Phänomene voraus, die nicht auch von alternativen Theorien vorhergesagt würden. Sie schließt keine Beobachtungen aus, die von alternativen Theorien ausgeschlossen würden.

Darüber hinaus leitet die Simulationshypothese die Forschung nicht in neue Richtungen. Physiker, Biologen und andere Wissenschaftler nutzen sie nicht zur Planung von Experimenten oder zur Entwicklung neuer Methoden. Sie verbleibt im Bereich der Populärphilosophie und Science-Fiction, nicht im Bereich aktiver wissenschaftlicher Arbeit.

Das bedeutet nicht, dass die Simulationshypothese als philosophische Idee nutzlos ist. Sie kann nützlich sein, um über die Natur von Realität, Bewusstsein und Wissen nachzudenken. Aber als wissenschaftliche Hypothese ist sie bei der Geburt tot — nicht weil sie falsch ist, sondern weil sie unwiderlegbar ist und keine Vorhersagen trifft, die geprüft werden können.