Anatomie eines Mythos: Was macht KI-Irrtümer so hartnäckig und warum sind rationale Gegenargumente wirkungslos

Ein Mythos über künstliche Intelligenz ist nicht einfach eine falsche Behauptung. Es ist ein selbsterhaltenes kognitives Konstrukt, das fundamentale Eigenschaften menschlichen Denkens ausnutzt: Angst vor dem Unbekannten, die Neigung zur Vereinfachung komplexer Systeme und das Bedürfnis nach Narrativen, die schnelle technologische Veränderungen erklären (S005).

KI-Mythen verbreiten sich schneller als faktische Informationen, gerade weil sie einfache emotionale Antworten auf komplexe technische Fragen bieten (S005).

⚠️ Drei Komponenten eines beständigen Mythos

- Emotionaler Anker

- Angst vor Arbeitsplatzverlust, Sorge vor unkontrollierter Technologie oder Euphorie über Versprechen sofortiger Geschäftstransformation. Emotion ist der primäre Filter der Informationswahrnehmung.

- Vereinfachtes mentales Modell

- Reduktion eines komplexen Systems auf eine einzige Eigenschaft: „KI ersetzt Menschen", „KI ist immer objektiv", „KI ist Magie". Vereinfachung reduziert kognitive Last, verzerrt aber die Realität (S001).

- Soziale Verstärkung

- Wiederholung des Mythos durch Medien, Unternehmensmarketing und Expertenmeinungen ohne Überprüfung der Grundlagen. Die Autorität der Quelle ersetzt die Faktenprüfung (S003).

🧩 Warum Führungskräfte besonders anfällig sind

Unternehmensleiter befinden sich in der Zone maximalen Risikos: Sie müssen strategische Entscheidungen über KI-Investitionen ohne tiefgreifende technische Ausbildung treffen, unter dem Druck von Wettbewerbern und Aktionärserwartungen (S003).

Zeitmangel für Informationsüberprüfung, Abhängigkeit von Sekundärquellen und kognitive Belastung zwingen dazu, sich auf Heuristiken statt auf Analyse zu verlassen. 67% der Führungskräfte geben zu, dass sie KI-Entscheidungen auf Basis unvollständiger oder verzerrter Informationen getroffen haben (S004).

🔁 Bestätigungsschleife: Wie ein Mythos Realität schafft

Der gefährlichste Aspekt von KI-Mythen ist ihre Fähigkeit, selbsterfüllende Prophezeiungen zu erzeugen. Ein Unternehmen, das an den Mythos „KI ist zu teuer für uns" glaubt, investiert nicht in die Technologie, fällt hinter Wettbewerber zurück und erhält Bestätigung: „Sehen Sie, wir können uns das nicht leisten" (S004).

| Mythos | Unternehmenshandlung | Ergebnis | „Bestätigung" |

|---|---|---|---|

| „KI ist zu teuer" | Verzicht auf Investitionen | Rückstand gegenüber Wettbewerbern | „Wir können uns das nicht leisten" |

| „KI ersetzt alle" | Angstatmosphäre, Sabotage | Projektscheitern | „KI ist gefährlich für uns" |

Diese Rückkopplungsschleife macht den Mythos praktisch unverwundbar für externe Kritik – er wird durch seine eigenen Konsequenzen bestätigt. Rationale Argumente funktionieren nicht, weil sie weder den emotionalen Anker adressieren noch ein alternatives Narrativ bieten. Mehr dazu im Abschnitt Ethik der künstlichen Intelligenz.

Die Auseinandersetzung mit Mythen erfordert keine Widerlegung, sondern Rekonstruktion: Ersetzung des vereinfachten Modells durch ein präziseres, des emotionalen Ankers durch konkrete Mechanismen, der sozialen Verstärkung durch überprüfbare Fakten. Dies ist Arbeit kognitiver Immunologie, nicht Rhetorik.

Mythos Nummer eins: „KI ist ein Zauberstab, der sofort alle Geschäftsprobleme ohne unseren Aufwand löst"

Dieser Irrglaube ist der teuerste für Unternehmen. Launch Consulting nennt ihn den „Mythos der magischen Transformation" und stellt fest, dass gerade er zur größten Anzahl gescheiterter KI-Projekte führt (S003). Unternehmen erwarten, dass die Implementierung von KI automatisch Prozesse optimiert, Gewinne steigert und strukturelle Probleme löst, ohne Änderungen in der Organisation, den Daten oder der Strategie zu erfordern.

🔬 Realität: KI ist ein Verstärker bestehender Prozesse, kein Ersatz

Blue Prism betont: Die Effektivität von KI hängt direkt von der Qualität der Integration in bestehende Arbeitsprozesse und der Übereinstimmung mit den strategischen Zielen der Organisation ab (S001). KI entwickelt keine Strategie – sie führt sie schneller und in größerem Maßstab aus.

Launch Consulting führt eine kritische Tatsache an: KI gedeiht auf Daten, und ohne qualitativ hochwertige, strukturierte, relevante Daten wird jedes System nutzlose oder schädliche Ergebnisse liefern (S003). Studien zeigen, dass 70% gescheiterter KI-Projekte nicht wegen der Technologie scheiterten, sondern wegen schlechter Datenvorbereitung und fehlender klarer Geschäftsziele.

- Datenqualität bestimmt Ergebnisqualität – Müll rein = Müll raus.

- Das strategische Ziel muss VOR der Technologiewahl formuliert werden, nicht danach.

- Integration in bestehende Prozesse erfordert Workflow-Überarbeitung, nicht nur das Hinzufügen eines neuen Tools.

📊 Der Preis der Illusion: drei Kategorien von Verlusten durch den Glauben an magische Lösungen

Die erste Kategorie – direkte finanzielle Verluste durch ungerechtfertigte Investitionen. Unternehmen geben Mittel für die Implementierung von KI-Lösungen aus, ohne vorherige Prozessaudits durchzuführen, erhalten ein System, das ineffiziente Operationen automatisiert, und wundern sich über den fehlenden ROI (S001).

Die zweite – verpasste Chancen: Während die Organisation auf „Magie" wartet, implementieren Wettbewerber methodisch KI in konkrete, gut vorbereitete Prozesse und erzielen echte Vorteile (S003). Die dritte – Reputationsschaden: Das Scheitern eines hochkarätigen KI-Projekts erzeugt internen Widerstand gegen die Technologie für Jahre (S004).

Das Scheitern eines KI-Projekts ist nicht nur vergeudetes Geld. Es ist der Verlust des Vertrauens in die Technologie innerhalb der Organisation und das Einfrieren aller nachfolgenden Initiativen, selbst wenn diese begründet sind.

⚙️ Mechanismus des Irrglaubens: Warum das Marketing von KI-Anbietern den Mythos verstärkt

Arion Research weist auf die Rolle der KI-Lösungsanbieter bei der Aufrechterhaltung dieses Mythos hin (S004). Marketingmaterialien versprechen oft „Transformation in 90 Tagen", „Automatisierung ohne Programmierung" und „sofortigen ROI", verschweigen aber die Notwendigkeit von Datenvorbereitung, Personalschulung, iterativer Modelloptimierung und Integration mit Legacy-Systemen.

Dies ist kein Betrug im juristischen Sinne, aber die Schaffung unrealistischer Erwartungen, die Enttäuschung garantieren. ProfileTree stellt fest: Unternehmen, die KI erfolgreich implementiert haben, verbrachten durchschnittlich 6–18 Monate mit der Vorbereitung der Infrastruktur, bevor sie den ersten produktiven Algorithmus starteten (S008).

Vgl. auch: KI in der Medizin: Wie man Durchbruch von Marketing unterscheidet und ChatGPT und die Welle der KI-Durchbrüche: Wo endet die Realität und beginnt das Marketing-Rauschen.

Mythos zwei: „KI wird menschliche Arbeitsplätze vollständig ersetzen und die meisten Berufe überflüssig machen"

Dieser Mythos ist der emotional aufgeladenste und politisch am häufigsten instrumentalisierte. Blue Prism bezeichnet ihn als „Mythos der totalen Ersetzung" und stellt fest, dass er die KI-Implementierung stärker blockiert als jegliche technische Einschränkungen (S001). Die Angst vor Arbeitsplatzverlust erzeugt Widerstand auf allen Organisationsebenen – von einfachen Mitarbeitern über Gewerkschaften bis hin zu Regulierungsbehörden.

🧪 Daten gegen Angst: Was Studien über die tatsächlichen Auswirkungen von KI auf die Beschäftigung zeigen

Das Weltwirtschaftsforum prognostiziert die Schaffung von 97 Millionen neuen Arbeitsplätzen bis 2025 (S011). Das bedeutet nicht, dass es keine Verluste geben wird – einige Positionen werden tatsächlich verschwinden –, aber die Gesamtbilanz ist positiv.

Der Haupteffekt von KI ist die Transformation bestehender Rollen, nicht deren Eliminierung (S004). Routineoperationen werden automatisiert und schaffen Zeit für Analyse, Entscheidungsfindung und kreative Arbeit.

KI ersetzt keine Menschen – sie verstärkt menschliches Potenzial. KI ist hervorragend in der Verarbeitung großer Datenmengen und der Ausführung repetitiver Operationen, ist aber kritisch abhängig von menschlichem Kontext, ethischer Bewertung und strategischem Denken (S003).

🧬 Neue Rollen: Welche Berufe KI schafft und warum es mehr sind, als es scheint

Direkte Rollen, die durch die KI-Industrie geschaffen wurden: KI-Spezialisten, Data Scientists, Machine-Learning-Ingenieure, KI-Ethik-Experten, Algorithmus-Auditoren (S011).

Indirekte Rollen erweitern das Spektrum: Manager für Prozesstransformation, Datenaufbereitungsspezialisten, KI-Modell-Trainer, Business-Interpreter für KI-Ergebnisse, Designer für Mensch-Maschine-Schnittstellen (S010).

- Juristen für KI-Regulierung

- Psychologen, die die Mensch-KI-Interaktion erforschen

- Spezialisten für die Erkennung und Beseitigung algorithmischer Verzerrungen (S008)

⚠️ Die reale Bedrohung: Nicht Ersetzung, sondern mangelnde Transformationsbereitschaft

Die Gefahr liegt nicht darin, dass KI Arbeitsplätze wegnimmt, sondern darin, dass Arbeitnehmer und Organisationen sich nicht auf Veränderungen vorbereiten (S009). Unternehmen, die nicht in die Umschulung ihrer Mitarbeiter investieren, werden mit einer Beschäftigungskrise konfrontiert – nicht weil KI Menschen ersetzt hat, sondern weil Menschen nicht die Fähigkeiten erworben haben, um mit KI zu arbeiten.

Erfolgreiche Organisationen nutzen KI für das Upskilling ihrer Mitarbeiter und die Schaffung neuer Rollen, die sich auf die Zusammenarbeit mit KI-Technologien konzentrieren (S004). Dies ist eine strategische Entscheidung, keine technologische Unvermeidlichkeit.

Mythos drei: „Alle KI-Technologien sind gleich — es sind nur unterschiedliche Bezeichnungen für dasselbe"

Dieser Irrglaube ist besonders gefährlich für Führungskräfte, die Investitionsentscheidungen treffen. Arion Research bezeichnet ihn als „Mythos der KI-Monolithik" und stellt fest, dass er zur Auswahl ungeeigneter Technologien für spezifische Aufgaben führt (S004). Führungskräfte denken über KI als einheitliche Technologie nach, aber tatsächlich ist es ein Oberbegriff, der ein breites Spektrum von Methoden, Werkzeugen und Fähigkeiten mit unterschiedlichen Anwendungen und Einschränkungen umfasst.

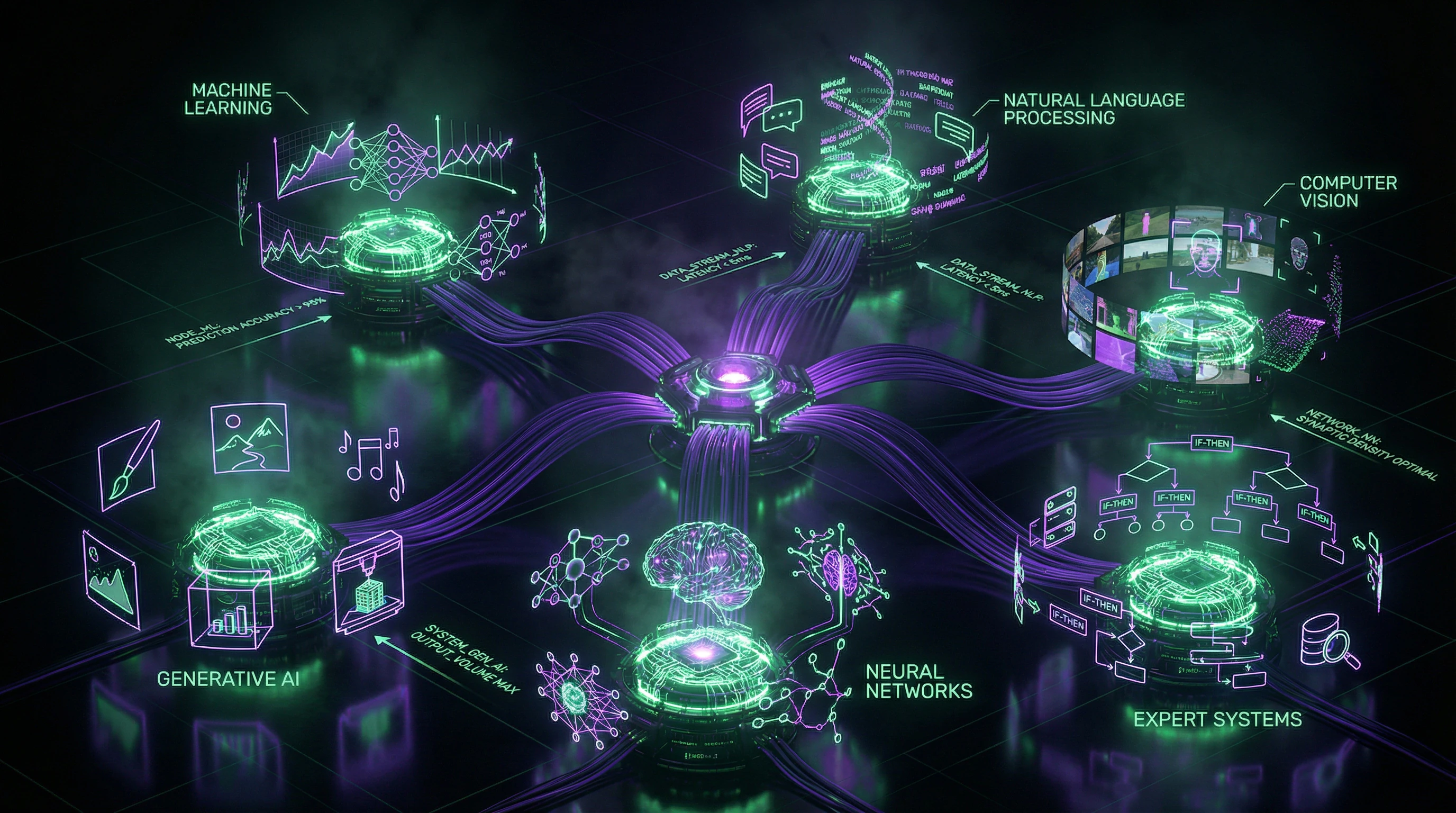

🔎 Taxonomie der Realität: sechs Hauptkategorien der KI

Arion Research unterscheidet zentrale Kategorien: maschinelles Lernen (ML), natürliche Sprachverarbeitung (NLP), Computer Vision, generative KI, neuronale Netze und Expertensysteme (S004). Jede Kategorie löst spezifische Aufgaben und erfordert unterschiedliche Daten, Infrastruktur und Expertise.

| Kategorie | Hauptaufgabe | Eingabedaten | Ausgabe |

|---|---|---|---|

| Maschinelles Lernen (ML) | Prädiktive Analytik, Klassifikation | Strukturierte numerische Daten | Wahrscheinlichkeit, Klasse, Bewertung |

| NLP | Text- und Sprachverarbeitung | Text, Audio | Bedeutung, Klassifikation, Übersetzung |

| Computer Vision | Bild- und Videoanalyse | Bilder, Videostream | Objekte, Koordinaten, Anomalien |

| Generative KI | Content-Erstellung | Textprompts, Beispiele | Text, Bilder, Code |

| Neuronale Netze | Erkennung komplexer Muster | Mehrdimensionale Daten | Verborgene Repräsentationen, Vorhersagen |

| Expertensysteme | Formalisierte Entscheidungsfindung | Fakten, Domänenregeln | Entscheidung mit Erklärung |

📊 Praktische Konsequenzen: wie die falsche Wahl Projekte scheitern lässt

Typischer Fehler: Ein Unternehmen wählt generative KI für eine Aufgabe, die präzise Klassifikation erfordert, und erhält kreative, aber ungenaue Ergebnisse (S012). Eine Organisation implementiert Deep Learning für einfache Regression, zahlt zu viel für Rechenressourcen und erhält ein Modell, das nicht interpretierbar ist.

Ein anderes Szenario: Ein Unternehmen versucht, ein auf Englisch trainiertes NLP-Modell zur Analyse spezialisierter technischer Dokumentation in einer anderen Sprache zu verwenden und wundert sich über die niedrige Qualität (S012). Blue Prism betont: Generative KI eignet sich zur Lösung bedeutender Aufgaben, insbesondere bei der Automatisierung und Effizienzsteigerung von Legacy- und modernen Systemen, ist aber keine Universallösung (S001).

Die Wahl der falschen KI-Kategorie ist kein technischer Fehler, sondern ein strategischer. Sie führt zu Investitionsverlusten, Teamfrustration und Diskreditierung der KI in der Organisation.

🧰 Auswahlkriterien: fünf Fragen zur Bestimmung der geeigneten Kategorie

- Natur der Eingabedaten: strukturierte Zahlen, Text, Bilder, Zeitreihen?

- Art der Ausgabe: Klassifikation, Vorhersage, Generierung, Optimierung?

- Anforderungen an Interpretierbarkeit: muss jede Entscheidung erklärt werden oder reicht allgemeine Genauigkeit?

- Ressourcenbeschränkungen: welche Rechenkapazitäten und Trainingszeit stehen zur Verfügung?

- Datenverfügbarkeit: wie viele gelabelte Beispiele gibt es für das Training?

Launch Consulting stellt fest: Die Antworten auf diese fünf Fragen bestimmen die geeignete KI-Kategorie mit 80–90% Genauigkeit (S003). Das Überspringen dieser Analyse ist der Hauptgrund für gescheiterte Implementierungen.

Mythos vier: „KI-Implementierung ist zu teuer und komplex für unsere Organisation"

Dieser Mythos blockiert die KI-Einführung in kleinen und mittleren Unternehmen und verschafft Großkonzernen einen Wettbewerbsvorteil. Arion Research bezeichnet ihn als „Mythos der Unzugänglichkeit" und stellt fest, dass er auf veralteten Vorstellungen über Kosten und Komplexität von KI-Technologien basiert (S004).

Die Realität hat sich in den letzten fünf Jahren dank Cloud-Computing und vortrainierten Modellen verändert (S004). Fortschritte im Cloud-Computing und die Verfügbarkeit vortrainierter KI-Modelle haben KI zugänglicher gemacht als je zuvor (S004).

🔬 Revolution der Zugänglichkeit: Wie Cloud-Plattformen die KI-Ökonomie verändert haben

Viele Cloud-basierte KI-Tools bieten niedrige Einstiegshürden und Skalierbarkeit, die sowohl für kleine als auch für große Unternehmen geeignet sind (S004). Launch Consulting betont: Dank Cloud-Computing und Open-Source-KI-Frameworks können Organisationen jeder Größe Zugang zu KI-Lösungen zu einem Bruchteil der historischen Kosten erhalten (S003).

Blue Prism ergänzt: Mittlerweile können die meisten Organisationen von KI profitieren, ohne hohe Kosten zu tragen (S001).

📊 Die tatsächlichen Kosten: Drei Preismodelle und ihre Anwendbarkeit

ProfileTree unterscheidet drei Hauptmodelle für den KI-Zugang (S008).

- Cloud-APIs mit nutzungsbasierter Abrechnung: Das Unternehmen zahlt nur für tatsächliche Anfragen an das Modell, ohne Investitionen in Infrastruktur. Die Kosten beginnen bei Cent-Beträgen pro tausend Anfragen für Basismodelle.

- Vortrainierte Modelle mit Fine-Tuning: Die Organisation nimmt ein fertiges Modell (oft kostenlos oder kostengünstig) und trainiert es mit eigenen Daten nach. Die Kosten entstehen hauptsächlich für Rechenressourcen beim Training, die temporär gemietet werden können.

- Vollständig maßgeschneiderte Lösungen: Entwicklung von Grund auf, die ein Spezialistenteam und erhebliche Investitionen erfordert. Dieses Modell ist nur für einzigartige Aufgaben nötig, bei denen fertige Lösungen nicht funktionieren.

Die meisten Geschäftsaufgaben werden durch die ersten beiden Modelle gelöst (S008).

⚙️ Versteckte Komplexität: Wo tatsächlich Probleme entstehen

Bernard Marr (Forbes) weist auf die tatsächlichen Quellen der Komplexität hin: nicht die KI-Technologie selbst, sondern die Integration mit bestehenden Systemen, das Change Management in der Organisation und die Sicherstellung der Datenqualität (S010). Launch Consulting bestätigt: Die Kostenbarriere ist nicht mehr so hoch wie früher, aber die Barriere der organisatorischen Bereitschaft bleibt erheblich (S003).

Unternehmen unterschätzen die Notwendigkeit der Mitarbeiterschulung, des Process Reengineering und der Schaffung einer Kultur, die das Experimentieren mit KI unterstützt (S003). Dies ist keine technische, sondern eine organisatorische Herausforderung – und genau hier liegen die tatsächlichen Kosten der Implementierung.

| Barriere | Art des Problems | Überwindungsstrategie |

|---|---|---|

| Technologiekosten | Überbewertet; Cloud-Lösungen sind günstig | Beginnen Sie mit Cloud-APIs, zahlen Sie nach Nutzung |

| Systemintegration | Erfordert Prozessüberarbeitung | Pilotprojekte bei isolierten Aufgaben |

| Teamkompetenzen | Wissensmangel, kein Personalmangel | Schulung bestehender Mitarbeiter, keine Experteneinstellung |

| Organisationskultur | Angst vor Misserfolg, Konservatismus | Förderung des Experimentierens, Transparenz der Ergebnisse |

Arion Research empfiehlt: Beginnen Sie mit kleinen Pilotprojekten, nutzen Sie fertige Cloud-Lösungen und investieren Sie in den Aufbau von KI-Kompetenzen bei bestehenden Mitarbeitern, anstatt teure externe Experten einzustellen (S004).

Wenn Sie interessiert, wie man echte Durchbrüche von Marketing-Hype in verwandten Bereichen unterscheidet, siehe KI in der Medizin: Wie man Durchbruch von Marketing unterscheidet. Mehr dazu im Bereich Deepfakes.

Mythos fünf: „KI ist vollständig objektiv und frei von Voreingenommenheit, im Gegensatz zu Menschen"

Dies ist einer der gefährlichsten Mythen, weil er ein falsches Sicherheitsgefühl erzeugt. Blue Prism nennt ihn den „Mythos der maschinellen Objektivität" und warnt: Kein System kann vollständig objektiv sein, genauso wie kein Mensch unbeeinflusst von der umgebenden Welt sein kann (S001). KI erbt und verstärkt oft Voreingenommenheiten, die in den Trainingsdaten vorhanden sind (S001).

Ein Algorithmus ist kein Richter, sondern ein Spiegel. Wenn eine voreingenommene Gesellschaft in den Spiegel blickt, wird das Spiegelbild voreingenommen sein.

🧬 Mechanismus der Voreingenommenheit: Wie menschliche Verzerrungen in Algorithmen kodiert werden

Das grundlegende Problem ist einfach: KI-Modelle werden mit Daten trainiert, und menschliche Voreingenommenheiten können von Anfang an in diesen Daten existieren (S004). Wenn historische Einstellungsdaten eine Bevorzugung bestimmter demografischer Gruppen zeigen, wird ein KI-System, das mit diesen Daten trainiert wurde, diese Voreingenommenheit reproduzieren und verstärken (S004).

Blue Prism fügt hinzu: Unfaire KI-Voreingenommenheiten entstehen, wenn eine KI-Anwendung mit inhärenten menschlichen Vorurteilen entwickelt wird (S001). KI-Algorithmen müssen regelmäßig aktualisiert und auditiert werden, um Voreingenommenheiten zu vermeiden und Genauigkeit sicherzustellen (S011).

🔬 Dokumentierte Fälle: Drei Kategorien algorithmischer Diskriminierung

ProfileTree klassifiziert Arten von KI-Voreingenommenheit (S008):

- Datenverzerrung: Der Trainingsdatensatz ist nicht repräsentativ für die reale Population. Ein Gesichtserkennungssystem, das überwiegend mit Bildern einer ethnischen Gruppe trainiert wurde, zeigt geringe Genauigkeit für andere Gruppen (S008).

- Verzerrung im Algorithmus-Design: Die Wahl der Optimierungsmetrik oder Modellarchitektur begünstigt implizit bestimmte Ergebnisse. Ein Kreditscoring-System, das nur auf Minimierung von Ausfällen optimiert ist, kann systematisch Gruppen mit geringerer Kredithistorie ablehnen, selbst wenn sie zahlungsfähig sind (S008).

- Verzerrung in der Interpretation: KI-Ergebnisse werden ohne Berücksichtigung des Kontexts verwendet. Ein System zur Rückfallvorhersage, dessen Risikobewertungen mechanisch verwendet werden, ohne soziale Faktoren zu berücksichtigen (S008).

Jede Kategorie erfordert unterschiedliche Ansätze zur Erkennung und Korrektur. Das Ignorieren einer dieser Kategorien führt zu systematischer Diskriminierung, getarnt als „Objektivität".

🛡️ Schutzprotokoll: Fünf obligatorische Praktiken zur Minimierung von Voreingenommenheit

| Praktik | Was sie bewirkt | Warum kritisch |

|---|---|---|

| Vielfalt der Trainingsdaten | Aktive Suche und Einbeziehung von Daten aus unterrepräsentierten Gruppen (S004) | Ohne dies ist das Modell blind für ganze Segmente der Realität |

| Regelmäßiges Monitoring auf Voreingenommenheit | Automatisierte Tests, die Leistungsunterschiede für verschiedene demografische Gruppen prüfen (S004) | Voreingenommenheit ist unsichtbar, bis man sie misst |

| Anpassungsfähigkeit | Bereitschaft, das System bei Entdeckung von Problemen zu korrigieren (S004) | Ein statischer Algorithmus degradiert, während sich die Realität verändert |

| Schutzmechanismen (Guardrails) | Verhinderung von Problemen; Kennzeichnung unfairen Verhaltens (S001) | Das System muss in der Lage sein, sich selbst „Nein" zu sagen |

| Transparenz der Entscheidungen | Auditoren und Nutzer verstehen, warum das System eine bestimmte Entscheidung getroffen hat (S011) | Eine Black Box ist keine Objektivität, sondern Verantwortungslosigkeit |

Diese Praktiken garantieren keine Perfektion, aber sie verwandeln KI von einer Black Box in ein System, das auditiert, kritisiert und verbessert werden kann. Dies ist der einzige Weg zu verantwortungsvoller Nutzung.

Mehr darüber, wie Marketing die realen Einschränkungen von Technologien verschleiert, finden Sie im Artikel über KI in der Medizin und der Analyse der KI-Durchbruchwelle. Mehr dazu im Abschnitt Deepfake-Erkennung.

Mythos sechs: „KI braucht nichts außer Daten — einfach Informationen hochladen und Ergebnisse erhalten"

Diese Vereinfachung ignoriert die kritische Bedeutung von Qualität, Relevanz und Datenmanagement (S001). Schmutzige Daten — Müll rein, Müll raus.

Ein KI-System arbeitet nicht mit Informationen im Allgemeinen, sondern mit konkreten Mustern in konkreten Datensätzen. Wenn Daten Fehler, Lücken, veraltete Einträge oder Stichprobenverzerrungen enthalten — lernt das Modell, diese Defekte mit mathematischer Präzision zu reproduzieren. Mehr dazu im Abschnitt Statistik und Wahrscheinlichkeitstheorie.

Die Datenqualität bestimmt die Obergrenze der Ergebnisqualität. Kein Algorithmus kann ein Signal aus Rauschen extrahieren, wenn Rauschen alles ist, was Sie ihm gegeben haben.

Zweite Ebene: Daten müssen vorbereitet werden. Das bedeutet Normalisierung, Kodierung von Kategorien, Behandlung von Lücken, Entfernung von Ausreißern, Klassenbalancierung (falls erforderlich). Jeder Schritt — eine Entscheidung, die das Ergebnis beeinflusst.

Dritte Ebene: Relevanz. Daten über Kaffeeverkäufe helfen nicht, die Nachfrage nach Strom vorherzusagen. Man muss verstehen, welche Variablen tatsächlich mit dem Zielphänomen verbunden sind und welche — Rauschen oder Korrelationsartefakte.

- Audit der Datenquellen: Woher stammen sie, wie wurden sie gesammelt, wer hat sie überprüft

- Vollständigkeitsprüfung: Gibt es Lücken, wie sind sie verteilt, warum sind sie entstanden

- Verzerrungsanalyse: Ist die Stichprobe repräsentativ oder spiegelt sie nur einen Teil der Realität wider

- Relevanzvalidierung: Sind die Merkmale mit dem Ziel verbunden oder ist es eine Scheinkorrelation

- Drift-Monitoring: Ändern sich die Muster in den Daten im Laufe der Zeit

Vierte Ebene: Management. Daten müssen versioniert, dokumentiert, zugangskontrolliert und aktualisiert werden. Wenn Sie vor einem Jahr einen Datensatz hochgeladen und ihn vergessen haben — arbeitet das Modell mit toten Daten.

Fünfte Ebene: Ethik und Regulierung. Wenn Daten Informationen über geschützte Kategorien (Ethnie, Geschlecht, Gesundheit) enthalten, muss man verstehen, wie dies die Fairness der Ergebnisse beeinflusst (S005). Das ist kein technisches Problem — das ist ein Problem der Verantwortung.

„Einfach Daten hochladen" — das ist, als würde man einem Chirurgen sagen: „Nehmen Sie einfach ein Skalpell". Das Werkzeug ist da, aber ohne Diagnose, Vorbereitung und Erfahrung wird das Ergebnis katastrophal sein.

Die realen Kosten: Datenvorbereitung nimmt oft 60–80% der Projektzeit in Anspruch. Das ist kein Bug, das ist ein Feature. Organisationen, die das verstehen, erhalten funktionierende Systeme. Diejenigen, die es ignorieren, erhalten teure Misserfolge.