Was wir genau als „KI-Durchbruch" bezeichnen – und warum diese Definition für die Analyse entscheidend ist

Bevor wir ChatGPT bewerten können, müssen klare Kriterien festgelegt werden. Der Begriff „Durchbruch" im KI-Kontext hat seine operationale Bedeutung verloren – die einen bezeichnen Verbesserungen bei Benchmark-Metriken als Durchbruch, andere nur fundamentale architektonische Innovationen, wieder andere die massenhafte Integration in den Alltag. Mehr dazu im Abschnitt Ethik und Sicherheit der KI.

Ohne Definition vergleichen wir Unvergleichbares. Ein Experte sieht eine Revolution, ein anderer einen überbewerteten Chatbot – und beide haben recht, sie sprechen nur über unterschiedliche Dinge.

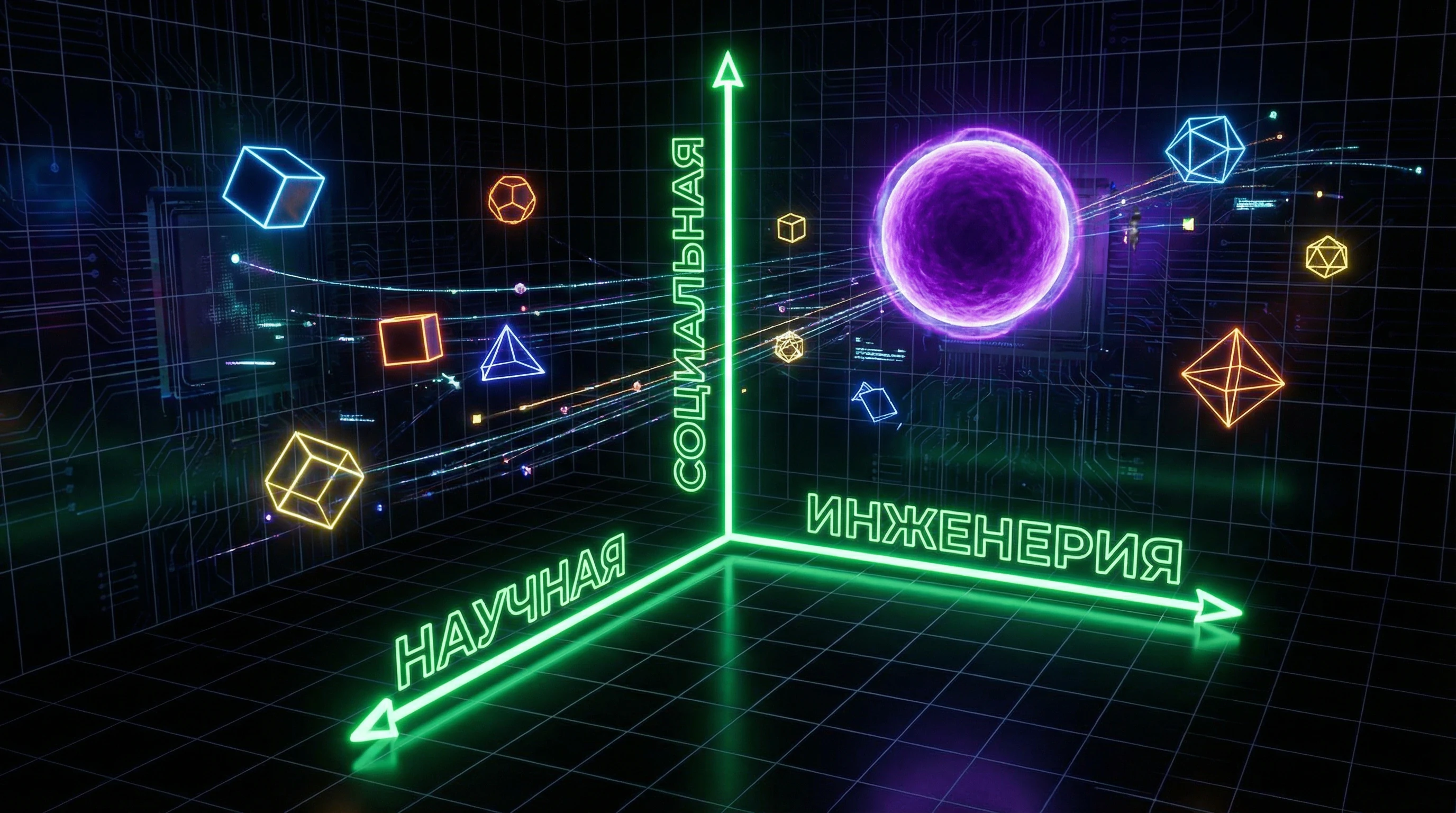

🔎 Drei Dimensionen des technologischen Durchbruchs

- Wissenschaftlicher Durchbruch

- Fundamentale Erweiterung des theoretischen Verständnisses – ein neuer Algorithmus, eine Architektur oder ein Lernprinzip, das zuvor unerreichbare Möglichkeiten eröffnet. Kriterien: Veröffentlichung in erstklassigen Peer-Review-Journals, Reproduzierbarkeit durch unabhängige Gruppen, Erweiterung theoretischer Grenzen.

- Technischer Durchbruch

- Qualitativer Sprung in der praktischen Umsetzung – Skalierung, Effizienz, Zuverlässigkeit, Zugänglichkeit bestehender Ansätze. Kriterien: Verbesserung zentraler Metriken um eine Größenordnung, Kostensenkung oder Energieverbrauchsreduktion um ein Vielfaches, neue Skalierungsniveaus.

- Gesellschaftlicher Durchbruch

- Übergang der Technologie aus den Laboren in die Massennutzung, Verhaltensänderung von Millionen Menschen, Schaffung neuer Märkte (S001). Kriterien: exponentielles Wachstum der Nutzerbasis, Veränderung etablierter Praktiken, Entstehung neuer Berufe, regulatorische Reaktion.

⚠️ Die Asymmetrie von ChatGPT: wo es ein Durchbruch ist und wo nicht

ChatGPT zeigt eine interessante Asymmetrie. Aus wissenschaftlicher Sicht wurde die Transformer-Architektur 2017 vorgestellt, GPT-3 erschien 2020. Fundamental neue algorithmische Prinzipien enthält ChatGPT nicht.

Der technische Durchbruch ist offensichtlich: OpenAI hat ein System geschaffen, das Millionen gleichzeitiger Anfragen mit akzeptabler Latenz und Kosten verarbeitet. Der gesellschaftliche Durchbruch ist unbestreitbar – erstmals wurde generative KI zu einem Masseninstrument, das jedem Menschen mit Browser zugänglich ist (S001).

Popularität ist kein Beweis für wissenschaftliche Innovation. Das iPhone war ein gesellschaftlicher und technischer Durchbruch, enthielt aber keine fundamental neuen wissenschaftlichen Prinzipien. Analog kann ChatGPT ein technischer und gesellschaftlicher Durchbruch sein, ohne wissenschaftliche Revolution.

🎯 Warum diese Verwechslung praktische Konsequenzen hat

Journalisten und Marketingexperten vermischen systematisch die drei Dimensionen und nutzen gesellschaftlichen Erfolg (Nutzerzahlen, mediale Aufmerksamkeit) als Beweis für wissenschaftlichen Durchbruch. Dies ist ein klassischer Kategorienfehler.

- Investoren, die Entscheidungen auf Basis medialen Hypes treffen, überschätzen das kurzfristige Potenzial und unterschätzen langfristige Herausforderungen.

- Forscher, deren Fördergelder von „Durchbruchs"-Rhetorik abhängen, stehen unter Druck, die Neuheit ihrer Arbeiten zu übertreiben.

- Bildungsinstitutionen, die KI überstürzt einführen, riskieren Investitionen in Werkzeuge, die keine realen pädagogischen Probleme lösen (S006).

📊 Anwendung der Kriterien auf ChatGPT

| Dimension | Status | Begründung |

|---|---|---|

| Wissenschaftlich | Nicht vorhanden | Grundprinzipien seit Jahren bekannt; fundamentale Probleme (Halluzinationen, fehlendes echtes Verständnis, Unmöglichkeit des Echtzeit-Lernens) bleiben ungelöst |

| Technisch | Teilweise | Skalierung beeindruckend, aber architektonische Limitierungen nicht überwunden |

| Gesellschaftlich | Uneingeschränkt | Technologie hat den öffentlichen Diskurs über KI verändert und eine neue Klasse von Anwendungen geschaffen (S001) |

Diese Asymmetrie erklärt, warum Experten gegensätzliche Bewertungen abgeben: Sie fokussieren sich auf unterschiedliche Dimensionen. Für die Analyse der restlichen Abschnitte des Artikels ist zu beachten: ChatGPT ist ein gesellschaftlicher und technischer Erfolg, keine wissenschaftliche Revolution. Dies verändert alle nachfolgenden Schlussfolgerungen über seine Wirkung und sein Potenzial.

Die Steel-Man-Version des Arguments: Fünf stärkste Argumente für die Revolutionierung durch ChatGPT

Intellektuelle Redlichkeit erfordert, mit der stärkstmöglichen Version der Gegenposition zu beginnen. Bevor wir den Hype um ChatGPT kritisieren, müssen wir die überzeugendsten Argumente dafür formulieren, dass es sich tatsächlich um eine revolutionäre Technologie handelt. Das „Steel-Man"-Prinzip (Gegenteil des „Strohmann"-Arguments) setzt voraus, die stärkstmögliche Version der gegnerischen Position zu konstruieren, nicht eine schwache Karikatur davon. Mehr dazu im Bereich KI und Technologie.

🔬 Erstes Argument: Beispiellose Geschwindigkeit der Massenakzeptanz als Indikator für echten Wert

ChatGPT erreichte 100 Millionen aktive Nutzer in 2 Monaten – schneller als jede Verbraucher-App in der Geschichte. Zum Vergleich: TikTok brauchte 9 Monate, Instagram 2,5 Jahre, Facebook 4,5 Jahre.

Dieses exponenzielle Wachstum lässt sich nicht allein durch Marketing oder Neugier erklären. Millionen Menschen nutzen ChatGPT täglich weiterhin zur Lösung realer Aufgaben: Code schreiben, Dokumente erstellen, Lernen, kreative Arbeit. Wäre die Technologie nicht von echtem Wert, wären die Nutzerbindungsraten niedrig. Stattdessen beobachten wir stetiges Wachstum und Integration in Arbeitsprozesse (S001).

Die Geschwindigkeit der ChatGPT-Einführung im Unternehmenssektor ist beispiellos. Die größten Unternehmen der Welt – von Microsoft bis Salesforce – integrieren GPT-Technologien in ihre Produkte. Dies sind keine spekulativen Investitionen, sondern strategische Entscheidungen, die auf messbaren Produktivitätssteigerungen basieren.

📊 Zweites Argument: Qualitativer Sprung in der KI-Zugänglichkeit für Nicht-Programmierer

Vor ChatGPT erforderte die Nutzung fortgeschrittener Machine-Learning-Modelle technische Expertise: Python-Kenntnisse, API-Verständnis, Prompt-Engineering-Fähigkeiten. ChatGPT demokratisierte den Zugang zu KI, indem es sie über natürliche Sprache zugänglich machte.

Dies ist keine inkrementelle Verbesserung – es ist ein qualitativer Sprung, vergleichbar mit dem Übergang von der Kommandozeile zur grafischen Benutzeroberfläche in den 1980er Jahren. Millionen Menschen, die nie Code geschrieben haben, können nun die Möglichkeiten großer Sprachmodelle zur Aufgabenautomatisierung, Informationsanalyse und Content-Generierung nutzen (S001).

- KI-gestütztes Lernen

- Studierende nutzen ChatGPT nicht nur zum Abschreiben, sondern auch zum vertieften Studium komplexer Konzepte, für personalisierte Erklärungen und Sprachpraxis (S006). Die Technologie hat eine neue Kategorie von Bildungspraktiken geschaffen, die potenziell den Lernansatz transformieren kann.

🧬 Drittes Argument: Emergente Fähigkeiten als Zeichen eines qualitativen Übergangs

Große Sprachmodelle zeigen emergente Fähigkeiten – Fertigkeiten, die nicht explizit programmiert wurden und erst bei Erreichen einer bestimmten Skalierung entstehen. GPT-3 und GPT-4 zeigen Fähigkeiten zu mehrstufigem Denken, Lösen mathematischer Aufgaben, Schreiben funktionalen Codes und Kontextverständnis auf einem Niveau, das für frühere Modellgenerationen unerreichbar war.

Dies ist nicht nur eine quantitative Verbesserung von Metriken – es ist ein qualitativer Übergang, bei dem das System Verhalten zeigt, das menschlicher Intelligenz in engen Domänen ähnelt. Kritiker wenden ein, dass es sich immer noch um statistische Vorhersage des nächsten Tokens handelt, nicht um echtes Verständnis. Aber funktional wird der Unterschied unwesentlich, wenn das System Aufgaben löst, die zuvor menschliche Intelligenz erforderten.

Die philosophische Frage nach „echtem Verständnis" mag weniger wichtig sein als die praktische Tatsache: ChatGPT besteht viele Tests, die wir traditionell zur Bewertung von Intelligenz verwendet haben.

💎 Viertes Argument: Katalysator für das gesamte KI-Innovations-Ökosystem

Selbst wenn ChatGPT selbst kein fundamentaler wissenschaftlicher Durchbruch ist, hat es eine Innovationswelle in verwandten Bereichen katalysiert. Hunderte von Startups sind entstanden, die spezialisierte Anwendungen auf Basis der GPT-API entwickeln. Wettbewerber (Google Bard, Anthropic Claude, Meta LLaMA) haben die Entwicklung eigener Modelle beschleunigt.

Die Forschungsgemeinschaft hat die Arbeit an fundamentalen Problemen intensiviert: Halluzinationen, Interpretierbarkeit, Ausrichtung an menschlichen Werten. ChatGPT schuf einen „Sputnik-Moment" für KI – ein Ereignis, das Ressourcen und Aufmerksamkeit der gesamten Branche mobilisierte (S001).

- Regierungen entwickeln regulatorische Rahmenbedingungen für KI

- Bildungsinstitutionen überarbeiten Lehrpläne

- Die Rechtsgemeinschaft diskutiert Fragen des Urheberrechts und der Haftung

- Philosophen kehren zu fundamentalen Fragen über die Natur von Intelligenz und Bewusstsein zurück

Unabhängig davon, ob ChatGPT selbst ein Durchbruch ist, wurde es zweifellos zum Auslöser systemischer Veränderungen in der Gesellschaft.

⚙️ Fünftes Argument: Wirtschaftliche Transformation und neue Geschäftsmodelle

ChatGPT schuf eine neue Wirtschaftskategorie: „KI als Service" für den Massenmarkt. OpenAI demonstriert, dass sich große Sprachmodelle durch Abonnements (20€/Monat für ChatGPT Plus) und API-Zugang monetarisieren lassen und ein nachhaltiges Geschäftsmodell schaffen.

Dies löst ein kritisches Problem, das die KI-Industrie jahrzehntelang plagte: wie man Forschungsdurchbrüche in profitable Produkte verwandelt. Die Bewertung von OpenAI mit über 80 Milliarden US-Dollar ist keine reine Spekulation – sie basiert auf realen Einnahmen und messbarem Einfluss auf die Produktivität im Unternehmenssektor.

| Geschäftsmodell | Vorteil | Skalierbarkeit |

|---|---|---|

| Abonnement (20€/Monat) | Vorhersehbare Einnahmen, direkte Nutzerbindung | Begrenzt durch Zahlungsfähigkeit |

| API-Zugang | Einbettung in Unternehmenssysteme, Netzwerkeffekte | Exponentiell bei Ökosystem-Wachstum |

| Foundation Model | Universelle Basis für Tausende Anwendungen | Dominanz weniger großer Player |

ChatGPT bewies die Lebensfähigkeit des „Foundation Model"-Modells – eines universellen Basismodells, das für Tausende spezialisierter Anwendungen angepasst werden kann. Dies schafft Netzwerkeffekte und Skaleneffekte, die zur Dominanz weniger großer Player in der KI-Infrastruktur führen können, ähnlich wie AWS im Cloud Computing dominiert. Die wirtschaftlichen Folgen dieser Verschiebung könnten bedeutender sein als die technischen Details der Modelle selbst.

Evidenzbasis: Was die Daten über die tatsächlichen Möglichkeiten und Grenzen von ChatGPT aussagen

Empirische Studien zeichnen ein Bild, das komplexer ist als Marketing-Narrative. Mehr dazu im Abschnitt Techno-Esoterik.

📊 Benchmarks und Metriken: Was Standard-KI-Tests tatsächlich messen

OpenAI veröffentlicht beeindruckende Ergebnisse: GPT-4 erreicht das 90. Perzentil beim Juristenexamen (Bar Exam) und das 89. Perzentil beim SAT Math. Doch eine kritische Analyse offenbart drei wesentliche Probleme (S001).

Erstens – „Datenkontamination": Testbeispiele könnten im Trainingskorpus enthalten gewesen sein, was die Ergebnisse überbewertet. Zweitens – Benchmarks messen enge Fähigkeiten zur Mustererkennung, nicht tiefes Verständnis. Das Modell kann eine Physikfrage richtig beantworten, indem es einfach statistische Muster in der Formulierung erkennt, ohne konzeptuelles Verständnis der Gesetze.

Das dritte Problem ist kritisch: Standardtests spiegeln keine realen Bedingungen wider – es fehlen Zeitbeschränkungen, Konsequenzen für Fehler, Kontextdruck. Dies erzeugt eine systematische Verzerrung in Richtung Überbewertung.

🧪 Studien zur Leistung bei realen Aufgaben

Eine Studie von MIT und Stanford (2023) zeigte: Die Nutzung von GPT-4 durch Programmierer erhöht die Geschwindigkeit um 55%, die Codequalität verbessert sich nach Experteneinschätzung um 40%. Doch die Ergebnisse variieren radikal.

| Aufgabentyp | Produktivitätssteigerung | Ergebniszuverlässigkeit |

|---|---|---|

| Routineoperationen (CRUD, Basisalgorithmen) | +80% | Hoch |

| Mittlere Komplexität (Integration, Optimierung) | +40% | Mittel |

| Architekturentscheidungen | +10% | Niedrig |

Beim akademischen Schreiben ein Paradox: Studierende schreiben schneller mit weniger Grammatikfehlern, zeigen aber oberflächlicheres Verständnis und geringere Originalität in der Argumentation (S006). Die Technologie ist gleichzeitig ein Durchbruch in der Effizienz und eine Degradierung in der Lerntiefe.

⚠️ Systematische Fehler und Halluzinationen

Halluzinationen – die Generierung plausibler, aber faktisch falscher Informationen – sind ein kritisches Problem. GPT-4 halluziniert in 15–20% der Antworten auf Faktenfragen (S001).

- Quellenerfindung

- Das Modell „zitiert" wissenschaftliche Artikel, die nicht existieren. Gefährlich in Medizin und Recht, wo Fehler Konsequenzen haben.

- Faktenverzerrung

- Vermischung von Details aus verschiedenen Ereignissen, Schaffung hybrider Narrative, die überzeugend klingen.

- Logische Inkonsistenzen

- Widersprüchliche Aussagen innerhalb einer Antwort, die Nutzer beim flüchtigen Lesen übersehen können.

- Zeitliche Fehler

- Veraltete Informationen, die als aktuell präsentiert werden. Besonders gefährlich in sich schnell verändernden Bereichen.

Kritisch: Halluzinationen sind nicht zufällig – sie treten systematisch häufiger in Bereichen auf, in denen die Trainingsdaten weniger qualitativ oder widersprüchlich waren. In Medizin und Recht erreicht die Häufigkeit 30%. Das Modell gibt falsche Informationen mit hoher Sicherheit aus, ohne Unsicherheitsindikatoren.

🧾 Vergleichende Analyse: ChatGPT versus Alternativen

Eine objektive Bewertung erfordert den Vergleich nicht mit einem abstrakten Ideal, sondern mit realen Alternativen. In der Programmierung übertrifft GitHub Copilot traditionelle IDE-Autovervollständigungen, ist aber erfahrenen Programmierern bei Architekturentscheidungen unterlegen. In der medizinischen Diagnostik zeigt GPT-4 Ergebnisse auf dem Niveau von Medizinstudenten, ist praktizierenden Ärzten bei seltenen Fällen deutlich unterlegen.

Das Kompetenzparadox: ChatGPT ist am effektivsten als Verstärker für Spezialisten mittleren Niveaus. Für Anfänger gefährlich – sie erkennen Halluzinationen nicht. Für Experten oft überflüssig – sie lösen Aufgaben schneller selbst, als Prompts zu formulieren und Ergebnisse zu prüfen (S001).

🔎 Langzeitstudien: Nachhaltigkeit der Effekte und Anpassung

Die meisten Studien fokussieren auf kurzfristige Effekte. Langzeitdaten offenbaren ein komplexeres Bild: Die anfängliche Begeisterung weicht oft der Enttäuschung, wenn Nutzer auf Grenzen stoßen.

Eine Studie zur Anpassung von Studierenden an KI-Assistenten zeigte, dass sich nach 6 Monaten drei Gruppen bilden (S006):

- Abhängige (30%) – entwickeln eigene Fähigkeiten nicht weiter, verlassen sich selbst bei einfachen Aufgaben auf KI.

- Integratoren (50%) – nutzen KI strategisch zur Beschleunigung von Routine, behalten Fokus auf komplexen Aufgaben.

- Abbrecher (20%) – beenden die Nutzung aufgrund von Enttäuschung über die Qualität oder ethischen Bedenken.

Der langfristige Einfluss von ChatGPT wird differenzierter sein, als Optimisten und Pessimisten vorhersagen. Die Technologie ist nicht universell – ihre Wirkung hängt von Kontext, Nutzerkompetenz und Aufgabentyp ab. Dies erfordert systematische Realitätsprüfung statt abstrakter Prognosen.

Wirkmechanismen: Wie ChatGPT kognitive Prozesse und Arbeitspraktiken verändert

Jenseits direkter Produktivitätskennzahlen liegt eine fundamentalere Frage: Wie verändert die Nutzung von ChatGPT unsere Denkweisen, Problemlösungsansätze und Arbeitsorganisation? Das Verständnis dieser Mechanismen ist entscheidend für die Bewertung der langfristigen Folgen dieser Technologie. Mehr dazu im Abschnitt Logische Fehlschlüsse.

🧬 Kognitive Entlastung versus Kompetenzatrophie: Wo verläuft die Grenze

Die Nutzung von ChatGPT für Routineaufgaben setzt kognitive Ressourcen für komplexere Probleme frei – ein klassischer Effekt kognitiver Entlastung, vergleichbar mit der Verwendung eines Taschenrechners für Arithmetik. Es besteht jedoch das Risiko einer Atrophie grundlegender Fähigkeiten, die als Fundament für höhere Expertise dienen.

Ein Programmierer, der nie manuell Schleifen geschrieben hat, versteht möglicherweise die Feinheiten algorithmischer Komplexität nicht. Ein Autor, der sich bei der Strukturierung von Argumenten auf KI verlässt, entwickelt möglicherweise keine kritischen Denkfähigkeiten.

- Für Experten mit tiefem Verständnis erhöht die kognitive Entlastung von Routineaufgaben die Produktivität ohne Qualitätsverlust.

- Für Anfänger verhindert vorzeitige Entlastung die Bildung mentaler Modelle, die für Expertise notwendig sind.

- Kritischer Punkt: Eine Fähigkeit muss durch Übung automatisiert werden, bevor sie an ein Werkzeug delegiert werden kann.

Dies schafft ein pädagogisches Dilemma (siehe kognitive Verzerrungen): Ein System, das die Arbeit erfahrener Fachkräfte beschleunigt, kann die Entwicklung von Anfängern verlangsamen. (S001) zeigt, dass Organisationen, die ChatGPT ohne Neugestaltung der Ausbildung eingeführt haben, mit einem Paradoxon konfrontiert wurden – die Produktivität stieg, aber die Entscheidungsqualität neuer Mitarbeiter sank.

🔄 Verantwortungsverschiebung und Kompetenzillusion

Wenn KI eine Antwort generiert, wechselt der Nutzer oft vom Erstellungs- in den Überprüfungsmodus. Dies ist eine fundamentale Veränderung der kognitiven Position.

Überprüfung erfordert weniger mentale Ressourcen als Generierung und erzeugt eine Illusion des Verstehens. Man sieht einen plausiblen Text, stimmt ihm zu und nimmt an, das Problem zu verstehen. Tatsächlich hat man nur eine oberflächliche Übereinstimmung mit den eigenen Erwartungen validiert.

| Modus | Kognitive Belastung | Fehlerrisiko | Langfristiger Effekt |

|---|---|---|---|

| Erstellung (ohne KI) | Hoch | Sichtbare Fehler | Expertiseentwicklung |

| Überprüfung (mit KI) | Niedrig | Versteckte Fehler | Kompetenzillusion |

(S003) stellt fest, dass Studierende, die ChatGPT zum Verfassen von Essays nutzen, oft ihre eigenen Argumente nicht erklären können. Sie sind durch den Text gegangen, aber nicht durch das Denken.

⚙️ Transformation der Arbeitspraktiken: Von Meisterschaft zu Workflow-Management

In Berufen, in denen ChatGPT zum Standardwerkzeug wird, verschiebt sich die Definition von Kompetenz. Statt der Fähigkeit, Code oder Text zu schreiben, wird die Fähigkeit geschätzt, Anfragen zu formulieren, Ergebnisse zu interpretieren und sie in einen größeren Kontext zu integrieren.

Das ist nicht per se schlecht – es ist eine Neudefinition von Kompetenz. Aber es schafft eine neue Klasse der Realitätsprüfung: Wie stellt man sicher, dass jemand das Fachgebiet wirklich versteht, wenn seine Hauptarbeit im KI-Management besteht?

Die Gefahr liegt nicht darin, dass KI Experten ersetzt, sondern darin, dass sich Expertise vom Fachgebiet auf das Werkzeugmanagement verlagert – und niemand bemerkt, wann die Substitution stattfindet.

(S007) dokumentiert, dass in HR-Praktiken diese Transformation bereits stattgefunden hat: Personalverantwortliche verbringen nun Zeit mit der Optimierung von Prompts statt mit der Entwicklung von Intuition über Kandidaten. Die Produktivität ist gestiegen, aber die Urteilstiefe gesunken.

🎯 Soziale Dynamik: Von individueller Meisterschaft zu kollektiver Abhängigkeit

Wenn ChatGPT zum Standard wird, erscheint es irrational, es nicht zu nutzen. Dies erzeugt einen sozialen Effekt, ähnlich Netzwerkeffekten: Der Wert des Werkzeugs steigt mit der Nutzerzahl, aber gleichzeitig wächst der Druck auf jene, die unabhängig bleiben wollen.

Organisationen, in denen alle ChatGPT nutzen, beginnen, Arbeit um dieses Werkzeug herum zu strukturieren. Wer sich verweigert, wird zum Außenseiter. Das ist keine Verschwörung – es ist die natürliche Dynamik der Anpassung an einen neuen Standard.

- Netzwerkeffekt

- Der Wert des Werkzeugs steigt mit der Nutzerzahl, erzeugt aber Druck auf die Minderheit, die es nicht verwendet.

- Pfadabhängigkeit

- Eine Organisation, die in ChatGPT-orientierte Prozesse investiert hat, kann nicht leicht zu Alternativen zurückkehren, selbst wenn diese sich als besser erweisen.

- Verlust von Alternativen

- Wenn ein Werkzeug dominiert, verschwinden Anreize zur Entwicklung konkurrierender Ansätze – und mit ihnen die Absicherung gegen sein Versagen.

(S004) zeigt, dass Studierende, die ChatGPT zu nutzen begonnen haben, selten zu traditionellen Methoden zurückkehren, selbst wenn dies vorteilhafter wäre. Das ist keine Faulheit – es ist eine rationale Wahl unter sozialem Druck.

Langfristiges Risiko: Wenn das gesamte Ökosystem von Bildung und Arbeit auf ChatGPT optimiert ist, wird jede Störung seiner Verfügbarkeit oder Qualität eine systemische Krise auslösen, nicht nur eine lokale Unannehmlichkeit.