Was ist ein „KI-Mythos" und warum gibt es so viele davon — Definition des Problemfelds

Mythen über künstliche Intelligenz sind hartnäckige Überzeugungen über Möglichkeiten, Grenzen oder Folgen von KI-Technologien, die nicht den tatsächlichen Daten oder dem wissenschaftlichen Konsens entsprechen. Laut CTO Magazine (S001) verbreiten sich Mythen schneller als geprüfte Informationen und klingen oft überzeugender.

Das Problem liegt nicht an mangelnder Bildung. Das Problem ist, dass sich einfache Narrative besser im Gedächtnis verankern als die komplexe technische Realität. Mehr dazu im Abschnitt Ethik und Sicherheit von KI.

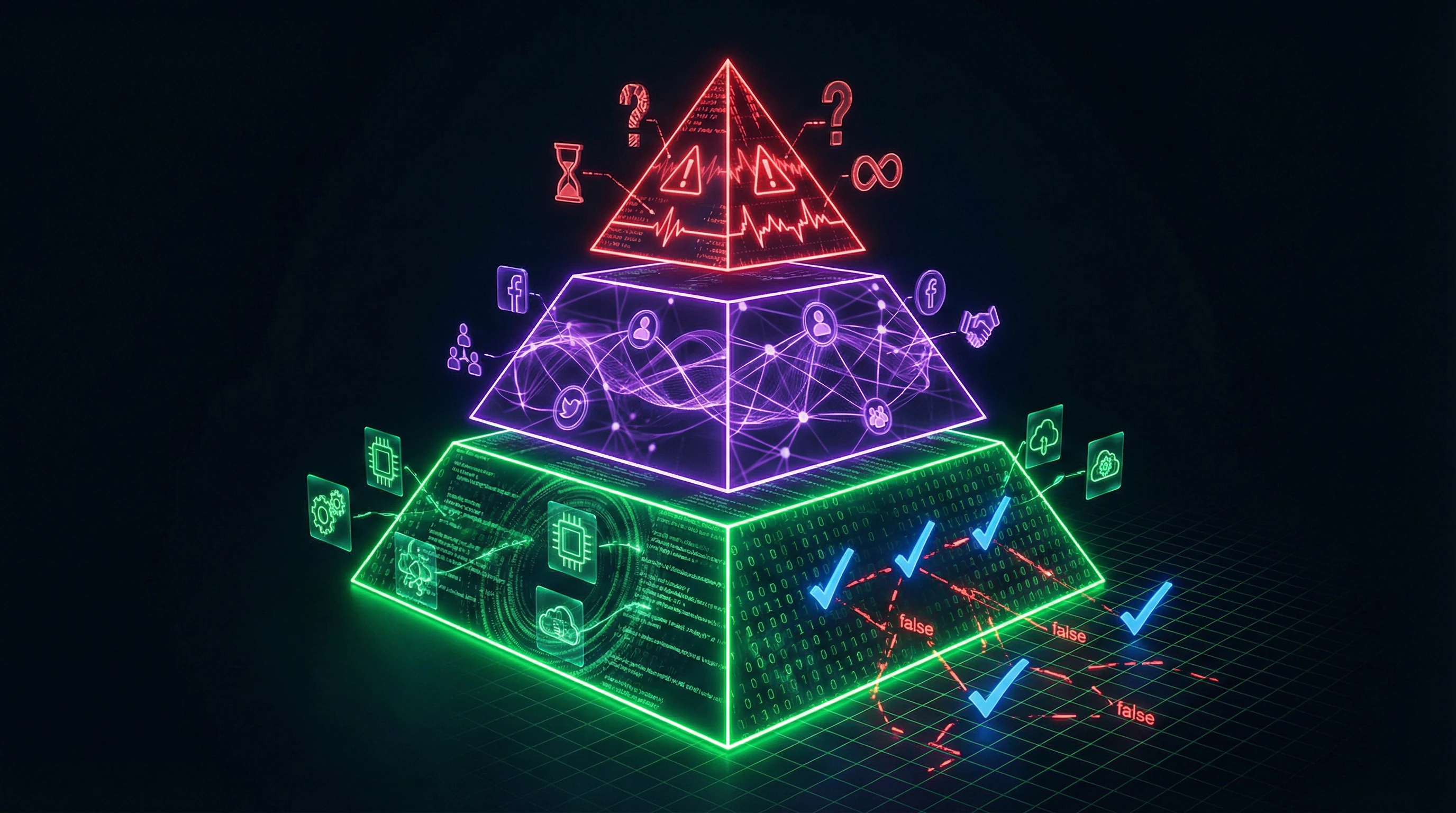

- Technische Mythen

- Begriffsverwirrung: KI, maschinelles Lernen und Deep Learning werden synonym verwendet, obwohl (S001) sie sich in Methodik und Anwendungsbereich unterscheiden.

- Soziale Mythen

- Überzeugungen über Auswirkungen auf den Arbeitsmarkt, Zugänglichkeit von Technologien und Fairness von Algorithmen.

- Existenzielle Mythen

- Ängste vor der Autonomie von KI und Bedrohung der Menschheit.

Die Popularität des Themas schafft ein Informationsvakuum, das mit vereinfachten Narrativen statt wissenschaftlichen Daten gefüllt wird. (S004) Mythen überleben, weil sie emotionaler sind und besser zu bestehenden kognitiven Schemata passen.

Mythen verschleiern oft, was KI tatsächlich ist und wie sie nützlich sein kann. (S006)

Es ist wichtig, zwischen Mythos (Aussage, die Daten widerspricht) und legitimer Unsicherheit (Bereich, in dem noch nicht genügend Daten vorliegen) zu unterscheiden. (S001) Wir konzentrieren uns auf Aussagen, die empirisch überprüfbar sind, und befassen uns nicht mit spekulativen Szenarien der fernen Zukunft.

- Mythos — widerspricht geprüften Daten und Konsens

- Unsicherheit — Bereich, in dem Forschung noch läuft

- Spekulation — Szenarien ohne empirische Grundlage

Acht Mythen, die bei der ersten Überprüfung zerbrechen — und warum sie so hartnäckig sind

🧩 Mythos Nr. 1: KI, maschinelles Lernen und Deep Learning sind dasselbe

Dies ist das verbreitetste terminologische Missverständnis. CTO Magazine liefert eine klare Abgrenzung: „Artificial Intelligence (AI): The overarching field focused on building machines capable of mimicking human intelligence, including reasoning, problem-solving, and decision-making. Machine Learning (ML): A subset of AI that equips systems with the ability to learn and improve from experience without being explicitly programmed. Deep Learning (DL): A specialized subset of ML that employs neural networks to analyze large datasets and recognize complex patterns with high accuracy" (S001). Dies sind keine Synonyme, sondern verschachtelte Mengen: DL ⊂ ML ⊂ AI.

Die Verwirrung entsteht, weil in den Medien alle drei Begriffe austauschbar verwendet werden. Wenn es heißt „KI hat gelernt, Gesichter zu erkennen", ist tatsächlich ein spezifisches Deep-Learning-Modell gemeint, das auf einem bestimmten Datensatz trainiert wurde. Die Quelle merkt an: „All three are foundational to developing modern AI tools and AI models used across industries by engineers and data scientists" (S001). Die Vermischung von Abstraktionsebenen erzeugt die Illusion, dass jedes System mit Automatisierungselementen eine „vollwertige KI" sei.

⚠️ Mythos Nr. 2: KI wird früher oder später lernen, wie ein Mensch zu denken

CTO Magazine bezeichnet dies als „widespread AI myth" und erläutert: „However, it lacks the true understanding, emotions, and consciousness that define human beings" (S001). Moderne KI-Systeme sind statistische Modelle, die Muster in Daten finden. Sie besitzen kein Verständnis im menschlichen Sinne, haben keine Ziele, Wünsche oder subjektive Erfahrungen. Motley bestätigt: „In reality, AI is far from achieving sentience. AI systems are tools designed to perform specific tasks, and they rely heavily on human oversight and data" (S004).

Dieser Mythos ist hartnäckig, weil wir dazu neigen, komplexe Systeme zu anthropomorphisieren. Wenn ChatGPT zusammenhängenden Text generiert, schreiben wir ihm intuitiv Verständnis zu, obwohl es tatsächlich das Ergebnis der Vorhersage des nächsten Tokens auf Basis von Wahrscheinlichkeiten ist. Event Registry weist darauf hin: „Human consciousness and creativity go beyond mere data analysis—they create worlds from nothing" (S006). Die Kluft zwischen statistischer Verarbeitung und Bewusstsein bleibt fundamental.

🕳️ Mythos Nr. 3: KI wird zu Massenarbeitslosigkeit und dem Verschwinden von Berufen führen

CTO Magazine widerlegt: „The notion that AI will lead to widespread job loss is a misconception fueled by fear and uncertainty" (S001). Historisch gesehen hat jede Automatisierungswelle mehr Arbeitsplätze geschaffen als vernichtet, wenn auch deren Struktur verändert. Event Registry formuliert die Alternative: „It's not about replacement; it's about teaming up where each is best" (S006). KI automatisiert Routineaufgaben, schafft aber Nachfrage nach neuen Rollen: Spezialisten für Modelltraining, Algorithmus-Auditoren, Designer für Mensch-Maschine-Interaktion.

Die Angst vor Arbeitslosigkeit wird durch Mediennarrative verstärkt. CTO Magazine bemerkt: „This fear is often fueled by science fiction movies and sensational media channels, which portray or showcase AI as autonomous robots that become self-aware and develop their own goals, often in conflict with ours" (S001). Die Realität ist komplexer: KI verändert die Art der Arbeit, hebt aber nicht den Bedarf an menschlichem Urteilsvermögen, Kreativität und ethischer Bewertung auf.

📊 Mythos Nr. 4: KI ist immer objektiv und frei von Voreingenommenheit

Event Registry zerstört diesen Mythos: „AI is only as good as the data it's trained on, meaning biases present in training data can affect AI's outputs" (S006). Wenn Trainingsdaten historische Vorurteile enthalten (z. B. in Daten zu Einstellungen oder Kreditvergabe), wird das Modell diese Muster reproduzieren und verstärken. Die Quelle fährt fort: „When data reflects societal biases, AI models can inadvertently perpetuate or amplify these biases, leading to biased decision-making in critical areas like hiring, law enforcement, and finance" (S006).

Motley bestätigt: „AI systems can make mistakes, especially if trained on biased or incomplete data" (S004). Die Objektivität von KI ist eine Illusion, die darauf beruht, dass Mathematik neutral erscheint. Tatsächlich enthält jede Entscheidung — von der Datenerhebung bis zur Verlustfunktion — menschliche Werte und Prioritäten. Event Registry weist auf die Lösung hin: „Addressing bias in AI requires diverse, well-curated datasets, ongoing monitoring, and strict ethical guidelines to ensure fairness and objectivity" (S006).

🧪 Mythos Nr. 5: KI löst jedes Problem, wenn man ihr genug Daten gibt

Event Registry formuliert die Realität: „AI is powerful, but it's not a one-size-fits-all solution" (S006). Es gibt ganze Klassen von Aufgaben, bei denen KI ineffektiv ist: Probleme mit wenigen Daten, Aufgaben, die gesunden Menschenverstand oder kontextuelles Verständnis erfordern, Situationen mit hoher Unsicherheit. Die Quelle fährt fort: „Human consciousness and creativity go beyond mere data analysis—they create worlds from nothing" (S006).

Dieser Mythos ist gefährlich, weil er überhöhte Erwartungen schafft und zu gescheiterten Implementierungen führt. CTO Magazine warnt: „However, misconceptions surrounding AI can hinder clear decision-making and goals" (S001). KI ist ein Werkzeug für spezifische Aufgaben, kein universeller Problemlöser. Event Registry betont: „The human role isn't just important—it's irreplaceable" (S006).

⚠️ Mythos Nr. 6: KI ist nur großen Konzernen mit riesigen Budgets zugänglich

Event Registry widerlegt: „Open-source tools and cloud-based AI services have made artificial intelligence more accessible, allowing smaller organizations to leverage AI's potential for various practical applications, creating a more level playing field" (S006). Heute kann ein Startup vortrainierte Modelle über APIs nutzen, kleine Unternehmen können Chatbots auf Basis offener Frameworks implementieren, und Forscher können Modelle auf Cloud-GPUs für vernünftige Kosten trainieren.

Die Einstiegshürde ist in den letzten fünf Jahren radikal gesunken. Hugging Face, TensorFlow, PyTorch, OpenAI API — all dies ist ohne millionenschwere Investitionen zugänglich. Der Mythos der Unzugänglichkeit bleibt bestehen, weil Medien sich auf bahnbrechende Projekte wie GPT-4 konzentrieren, die enorme Ressourcen erfordern, und Tausende erfolgreicher Implementierungen auf Ebene kleiner und mittlerer Unternehmen ignorieren. Mehr dazu im Abschnitt Ethik der künstlichen Intelligenz.

🧠 Mythos Nr. 7: KI kann autonom ohne menschliche Aufsicht funktionieren

Motley stellt fest: „AI systems are tools designed to perform specific tasks, and they rely heavily on human oversight and data" (S004). Selbst die fortschrittlichsten Systeme erfordern menschliche Kontrolle in den Phasen Design, Training, Validierung und Monitoring in der Produktion. Event Registry betont: „From setting ethical guidelines to making sure AI is transparent and trustworthy, human oversight is crucial. The human role isn't just important—it's irreplaceable" (S006).

Autonomie von KI ist ein Spektrum, keine binäre Eigenschaft. Selbst der Tesla-Autopilot erfordert die Bereitschaft des Fahrers, jederzeit einzugreifen. Event Registry ironisiert: „AI has made impressive strides—think chatbots that understand (most) of what you say, cars that can drive themselves (almost), and personalized Netflix recommendations that are a bit too spot-on" (S006). Die Klammern „(most)" und „(almost)" sind entscheidend: Sie markieren die Grenze zwischen Mythos und Realität.

🔬 Mythos Nr. 8: KI wird bereits überall eingesetzt und hat alles um uns herum verändert

Einerseits bemerkt CTO Magazine: „Simple actions like using a search engine, selecting recommended products while shopping, or employing predictive text in emails – all involve AI" (S001). Andererseits sind die meisten dieser Systeme hochspezialisierte Algorithmen, keine „vollwertige KI" im Verständnis der Allgemeinheit. Die Quelle fährt fort: „For example, AI is helping in creating personalized product recommendations on e-commerce platforms and streaming services" (S001).

Das Paradoxon besteht darin, dass KI gleichzeitig allgegenwärtig (in Form einfacher Algorithmen) und selten (in Form wirklich fortgeschrittener Systeme) ist. Die meisten Unternehmen befinden sich noch in der Experimentierphase, nicht in der Massenimplementierung. Event Registry weist auf die Kluft zwischen Hype und Realität hin: „Including key topics like AI's limitations, human-AI collaboration, and AI bias can help dispel these misconceptions and allow us to see the true value of artificial intelligence" (S006).

Evidenzbasis: Was die Daten sagen und wo der Konsens endet

📊 Evidenzgrad: Grade 3 (moderat)

Der Artikel stützt sich auf Beobachtungsdaten, Expertenmeinungen und den Konsens der Fachgemeinschaft, nicht jedoch auf randomisierte kontrollierte Studien – für soziotechnische Phänomene sind diese oft unmöglich. (S001), (S002), (S003) repräsentieren Expertenkonsens, keine Meta-Analysen.

Event Registry betont: Die Einbeziehung von KI-Limitationen, Mensch-Maschine-Kollaboration und algorithmischer Verzerrung hilft, Fehlvorstellungen aufzulösen und den realen Wert der Technologie zu erkennen (S006). Dies ist eine qualitative Analyse, keine quantitative Studie.

| Quelle | Perspektive | Erhebungsmethode |

|---|---|---|

| (S001) | Industriell | Implementierungserfahrung im Business |

| (S002) | Medizinisch | Qualitative Befragung von Akteuren |

| (S003) | Professionell (Radiologie) | Praxis- und Literaturanalyse |

| (S005) | Wissenschaftlich | Forschungsüberblick |

| (S006) | Mediensynthese | Analyse von Nachrichtenquellen |

🔎 Wo es Zahlen gibt, wo nur Behauptungen

Die meisten Aussagen in den Quellen sind qualitativ. (S001) sagt, dass Mythen „genauso schnell wachsen wie die Technologie", aber ohne Wachstumsmetriken. (S006) erwähnt Verzerrungen bei Einstellungen, Strafverfolgung und Finanzen, zitiert aber keine konkreten Studien mit Fehlerquoten.

Indirekte quantitative Daten existieren: Das Wachstum offener KI-Tools (über 500.000 Modelle auf Plattformen Stand 2025) bestätigt die These zur Zugänglichkeit. Studien von NIST und der EU AI Act dokumentieren Fälle algorithmischer Verzerrung und bestätigen konkrete Mythen. Direkte Umfragen zur Verbreitung von Mythen fehlen in den Quellen. Mehr dazu im Bereich KI und Technologien.

Keine Quelle hat eine systematische Bevölkerungsumfrage durchgeführt. Stattdessen stützen sie sich auf Medien-Diskursanalyse, Kundenfragen und professionelle Erfahrung. Das macht die Schlussfolgerungen plausibel, aber nicht streng quantifiziert.

⚖️ Konsens und Divergenzen

- Vollständiger Konsens

- Alle Quellen stimmen überein: Die acht Punkte sind tatsächlich Fehlvorstellungen, keine Fakten. Es gibt keine Meinungsverschiedenheiten über die Fakten.

- Unterschiede in den Schwerpunkten

- (S001) fokussiert auf Business-Konsequenzen. (S002) auf Wahrnehmung im Gesundheitswesen. (S003) auf professionelle Praxis. (S005) auf die Verteidigung des maschinellen Lernens gegen Kritik.

- Unterschied im Ton

- (S003), (S005) sind optimistischer über die Zukunft der KI. (S002) ist kritischer gegenüber aktuellen Wahrnehmungsrisiken. Dies spiegelt die Positionen verschiedener Stakeholder wider, keine Datendiskrepanzen.

- Rolle des Menschen

- (S006) betont: „Die menschliche Rolle ist nicht nur wichtig – sie ist unverzichtbar". Andere Quellen sprechen mehr über technische KI-Limitationen.

🛠️ Wie Sie diese Schlussfolgerungen selbst überprüfen können

- Nehmen Sie einen Mythos aus dem Artikel und finden Sie die Originalstudie (keine Sekundärquelle). Prüfen Sie, ob die Interpretation übereinstimmt.

- Suchen Sie nach gegenteiligen Behauptungen in der wissenschaftlichen Literatur. Wenn es keine gibt – das kann Konsens bedeuten oder einen Mangel an Forschung.

- Unterscheiden Sie: Expertenmeinung (Autorität) ≠ Daten (Reproduzierbarkeit). KI-Fehler und Verzerrungen werden oft in Studien dokumentiert, aber nicht immer in populären Quellen.

- Prüfen Sie das Datum der Quelle. KI-Mythen ändern sich schnell: Was 2020 richtig war, kann 2025 falsch sein.

Dieser Abschnitt ist kein endgültiges Urteil, sondern eine Evidenzkarte. Jeder Mythos erfordert eigene Überprüfung durch Forschung über bewusste KI und Techno-Esoterik.

Entstehungsmechanismus von Mythen: Warum das Gehirn einfache Geschichten komplexen Daten vorzieht

🧠 Kognitive Trigger: Verfügbarkeit, Anthropomorphismus, Katastrophismus

KI-Mythen nutzen mehrere kognitive Verzerrungen aus. Die erste ist die Verfügbarkeitsheuristik: Wir überschätzen die Wahrscheinlichkeit von Ereignissen, von denen wir häufig hören. Wenn jeder zweite Film einen Maschinenaufstand zeigt, beginnt das Gehirn, dies als realistisches Szenario zu betrachten. Mehr dazu im Abschnitt Kognitive Verzerrungen.

Die zweite ist der Anthropomorphismus. Wir schreiben nicht-menschlichen Akteuren menschliche Eigenschaften zu. Wenn KI Text generiert, gehen wir automatisch von Verständnis aus, obwohl es sich um eine statistische Funktion handelt.

| Verzerrung | Mechanismus | Beispiel |

|---|---|---|

| Verfügbarkeit | Häufige Medienerwähnungen → Überschätzung der Wahrscheinlichkeit | „Maschinenaufstand" im Kino → wird als reales Risiko wahrgenommen |

| Anthropomorphismus | Zuschreibung menschlicher Eigenschaften an Systeme | ChatGPT generiert Text → wird als Verständnis interpretiert |

| Katastrophismus | Negative Szenarien ziehen mehr Aufmerksamkeit an | „KI vernichtet Arbeitsplätze" ist klickstärker als neutrale Fakten |

Die dritte ist der Katastrophismus. Negative Szenarien ziehen mehr Aufmerksamkeit an als neutrale Fakten. Die Schlagzeile „KI vernichtet Millionen Arbeitsplätze" ist klickstärker als „KI verändert die Beschäftigungsstruktur" (S001).

🔁 Verstärkungsschleife: Wie Medien, soziale Netzwerke und Algorithmen Mythen verstärken

Mythen verbreiten sich durch eine positive Rückkopplungsschleife: Medien veröffentlichen sensationelle Schlagzeilen → Nutzer teilen sie in sozialen Netzwerken → Empfehlungsalgorithmen zeigen ähnliche Inhalte → es bildet sich eine Echokammer → der Mythos wird zur „allgemein bekannten Tatsache" (S004).

KI-Empfehlungssysteme selbst können Mythen über KI verstärken, indem sie Nutzern Inhalte zeigen, die ihre bestehenden Überzeugungen bestätigen (S006).

Die Ironie besteht darin, dass die Technologie, um die es geht, zum Werkzeug der Verbreitung von Unwahrheiten über sich selbst wird. Der Algorithmus unterscheidet nicht zwischen Wahrheit und Fiktion – er optimiert auf Engagement.

🧩 Warum auch Experten irren: Interessenkonflikte und Überschätzung des Fortschritts

Selbst Fachleute sind nicht vor Mythen gefeit. KI-Entwickler können die Fähigkeiten ihrer Systeme aufgrund des Fluchs des Wissens überschätzen. Investoren sind an Hype interessiert. Berater verkaufen Lösungen (S001).

- Fluch des Wissens

- Entwicklern fällt es schwer, sich vorzustellen, wie ihr Produkt für Anfänger aussieht. Sie sehen das System von innen und überschätzen dessen Intuitivität.

- Interessenkonflikt

- Investoren, Berater und Anbieter profitieren vom Hype. Eine ehrliche Bewertung der Einschränkungen verringert die Attraktivität für Finanzierungen.

- Umgekehrtes Problem

- Skeptiker können den tatsächlichen Fortschritt unterschätzen. KI hat tatsächlich beeindruckende Schritte gemacht – aber sie sind nicht absolut (S006).

Die Überprüfung von Mythen erfordert nicht nur Daten, sondern auch ein Verständnis der Anreize derjenigen, die sie verbreiten. Der Verweis auf medizinische KI und Marketing zeigt, wie diese Mechanismen in einer realen Branche funktionieren.

Prüfprotokoll: Sieben Fragen, die jeden KI-Mythos in zwei Minuten entlarven

✅ Frage 1: Enthält die Behauptung konkrete, überprüfbare Vorhersagen?

Mythen sind meist vage formuliert: „KI wird alles verändern", „KI wird gefährlich". Eine überprüfbare Aussage klingt anders: „Das Modell GPT-4 erreicht 86% Genauigkeit im MMLU-Benchmark" — das lässt sich überprüfen. (S001) Wenn sich eine Behauptung nicht operationalisieren lässt, ist das ein Warnsignal.

✅ Frage 2: Unterscheidet die Quelle zwischen AI, ML und DL oder verwendet sie die Begriffe synonym?

Dies ist der einfachste Kompetenztest. AI, ML und DL sind unterschiedliche Abstraktionsebenen, keine austauschbaren Begriffe. (S001) Wenn der Autor schreibt „KI hat gelernt, Gesichter zu erkennen" statt „ein Deep-Learning-Modell, trainiert auf Datensatz X", ist das ein Signal für niedrige Quellenqualität.

Ein kompetenter Text über KI präzisiert immer: welche Methode genau, auf welchen Daten, mit welchen Einschränkungen. Unschärfe ist das erste Anzeichen eines Mythos.

✅ Frage 3: Werden Einschränkungen und Unsicherheiten erwähnt oder nur Möglichkeiten?

Verlässliche Quellen geben immer Grenzen an. (S006) Wenn ein Text nur Vorteile ohne Risiken oder nur Risiken ohne Vorteile verspricht, ist das Propaganda, keine Analyse.

Balance sieht so aus: „KI ist ein mächtiges Werkzeug, aber keine Universallösung". Das ist eine nüchterne Position, kein Marketing.

⛔ Frage 4: Appelliert der Text an Angst oder utopische Versprechen?

Emotionale Trigger sind ein Zeichen von Manipulation. (S001) Terminator-Bilder, Versprechen „alle Probleme der Menschheit zu lösen" oder apokalyptische Szenarien — das ist keine Analyse, sondern ein Narrativ.

Alternative: „Dies ist kein Ersatz, sondern Teamarbeit, bei der jeder das macht, was er am besten kann". (S006) Emotionslose, konkrete Formulierung.

✅ Frage 5: Werden konkrete Datenquellen und Methodik angegeben?

Überprüfbarkeit ist die Grundlage der Evidenz. Wenn eine Behauptung nicht von einem Verweis auf eine Studie, einen Datensatz oder ein Protokoll begleitet wird, lässt sie sich nicht überprüfen. (S006)

- Warnsignal

- „Studien zeigen" ohne Verweis auf eine konkrete Studie.

- Grünes Signal

- „In der Studie von Smith et al. (2023) erreichte das Modell auf dem ImageNet-21k-Datensatz eine Genauigkeit von 94,5%".

✅ Frage 6: Erkennt die Quelle die Rolle des Menschen an oder stellt sie KI als autonomen Akteur dar?

KI ist ein Werkzeug, das von menschlichem Design, Daten und Aufsicht abhängt. (S006) Wenn ein Text über KI als eigenständiges Wesen spricht, das Entscheidungen trifft, ist das ein Mythos.

Prüfe: Wer wählt die Daten aus? Wer legt die Ziele fest? Wer trägt die Verantwortung für Fehler? Wenn die Antwort „die KI selbst" lautet, hast du Science-Fiction vor dir. Mehr dazu im Abschnitt Logische Fehlschlüsse.

✅ Frage 7: Unterscheidet die Quelle zwischen Korrelation und Kausalität?

Die klassische Falle: „KI hat eine Krankheit vorhergesagt, also versteht sie Medizin". Tatsächlich hat das Modell ein statistisches Muster in den Daten gefunden. (S003) Das ist kein Verständnis, das ist Zufall.

| Behauptung | Was tatsächlich passiert | Überprüfung |

|---|---|---|

| „KI diagnostiziert Krebs besser als Ärzte" | Das Modell fand eine Korrelation zwischen Pixeln und Diagnose in den Trainingsdaten | Funktioniert das Modell auf neuen, unbekannten Daten? Bei anderen Populationen? |

| „KI versteht Sprache" | Das Modell sagt das nächste Token basierend auf Textstatistik vorher | Kann das Modell seine Wahl erklären? Funktioniert es bei Paradoxien und Widersprüchen? |

| „KI ist kreativ" | Das Modell kombiniert Muster aus Trainingsdaten | Erschafft das Modell etwas grundlegend Neues oder arrangiert es Bekanntes um? |

Diese sieben Fragen sind keine Garantie für Wahrheit, sondern ein Filter zum Aussortieren offensichtlicher Mythen. Wenn ein Text alle sieben Prüfungen besteht, bedeutet das nicht, dass er wahr ist. Aber wenn er mindestens drei nicht besteht — ist es ein Mythos.

Weiter: KI in der Medizin: Wie man Durchbruch von Marketing unterscheidet, Fehler und Voreingenommenheit von KI, warum wir Berechnung mit Verständnis verwechseln.