Künstliche Intelligenz in der Medizin ist zum Gegenstand massiven Hypes geworden: von Krebsdiagnosen bis zur personalisierten Therapie. Doch hinter den reißerischen Schlagzeilen verbirgt sich eine komplexe Realität: Die meisten Systeme funktionieren nur unter engen Bedingungen, Daten sind widersprüchlich und regulatorische Hürden hoch. Dieser Artikel analysiert den Mechanismus des medizinischen KI-Hypes, zeigt das tatsächliche Evidenzniveau der Technologien und liefert ein Prüfprotokoll für Behauptungen über die „Revolution im Gesundheitswesen".

🖤 Jede Woche taucht ein neues Start-up auf, das eine „Revolution in der Diagnostik" oder „personalisierte Medizin der Zukunft" verspricht. Investoren stecken Milliarden hinein, Medien verbreiten Schlagzeilen über „Durchbrüche", und Patienten warten auf ein Wunder. Doch zwischen dem Marketing-Narrativ und der klinischen Realität klafft eine Lücke, die kaum jemand zu vermessen versucht. Dieser Artikel ist kein Manifest gegen Technologie, sondern eine Anleitung zur Navigation in einer Welt, in der jedes Versprechen einer Überprüfung bedarf und jede Zahl einen Kontext braucht. Wir analysieren den Hype-Mechanismus, zeigen auf, wo die Wissenschaft endet und die Spekulation beginnt, und geben Ihnen ein Protokoll an die Hand, das unabhängig davon funktioniert, wie überzeugend eine Präsentation klingt.

Was genau wird versprochen: Anatomie der Behauptungen über medizinische KI und Grenzen der Technologieanwendbarkeit

Das erste Problem beginnt bei den Definitionen. Der Begriff „Künstliche Intelligenz in der Medizin" wird so weit gefasst verwendet, dass er seine Konkretheit verloren hat: Darunter fallen sowohl einfache Bildklassifizierungsalgorithmen als auch komplexe klinische Entscheidungsunterstützungssysteme und hypothetische AGI, die Ärzte ersetzen könnte. Mehr dazu im Abschnitt Wie künstliche Intelligenz funktioniert.

Wenn ein Start-up von einer „Revolution" spricht, ist es entscheidend zu verstehen, um welche Systemklasse es sich genau handelt – und unter welchen Bedingungen diese funktionieren.

🔎 Drei Kategorien medizinischer KI-Systeme

- Spezialisierte Klassifikatoren

- Lösen eine Aufgabe unter streng kontrollierten Bedingungen: Sie erkennen diabetische Retinopathie auf Fundusfotos oder identifizieren Pneumonie auf Röntgenaufnahmen. Sie sind auf großen Datensätzen trainiert, aber ihre Anwendbarkeit ist durch die Qualität der Eingangsdaten und die Trainingspopulation begrenzt (S001).

- Klinische Entscheidungsunterstützungssysteme (CDSS)

- Werden in den klinischen Workflow integriert und bieten Empfehlungen basierend auf elektronischen Patientenakten, Labordaten und Fachliteratur. Sie hängen von der Qualität der Datenstrukturierung, der Aktualität der Protokolle und der Fähigkeit des Arztes ab, die Empfehlung kritisch zu bewerten (S004).

- Integrierte Plattformen

- Versprechen, Diagnostik, Prognose und Therapiepersonalisierung zu vereinen. Hier konzentriert sich das Maximum an Hype und das Minimum an Evidenzbasis: Die meisten befinden sich im Pilotstadium (S002).

🧱 Anwendbarkeitsgrenzen: Labor vs. Klinik

Der zentrale Fehler ist das Ignorieren der Kluft zwischen Laborvalidierung und klinischer Praxis. Ein System kann 95% Genauigkeit auf einem Testdatensatz zeigen, aber im realen Krankenhaus versagen – aufgrund von Unterschieden bei Geräten, Aufnahmeprotokollen oder der demografischen Zusammensetzung der Patienten.

Dieses als Dataset Shift bekannte Phänomen wird in Marketingmaterialien systematisch unterschätzt.

Die meisten Studien werden retrospektiv durchgeführt: Der Algorithmus analysiert bereits gesammelte Daten, bei denen die Diagnosen bekannt sind. In prospektiven Studien, bei denen das System in Echtzeit arbeitet, fallen die Ergebnisse oft bescheidener aus. Der Übergang von retrospektiver Validierung zu prospektiver Implementierung senkt die Leistungskennzahlen im Durchschnitt um 15–30% (S001).

⚠️ Regulatorische Hürden und ihre Grenzen

| Bewertungskriterium | Was die Regulierungsbehörde prüft | Was NICHT garantiert wird |

|---|---|---|

| Sicherheit | Keine Schädigung bei Anwendung | Verbesserung der Patientenergebnisse |

| Analytische Validität | Korrekte Datenverarbeitung | Klinischer Nutzen unter realen Bedingungen |

| Anwendungsbereich | Enges Szenario (z.B. Retinopathie-Screening) | Extrapolation auf breitere Anwendungen |

Die Erlangung einer behördlichen Zulassung (FDA in den USA, CE-Kennzeichnung in Europa) ist ein wichtiges, aber unzureichendes Kriterium. Regulierungsbehörden bewerten Sicherheit und analytische Validität, verlangen aber nicht immer Nachweise für den klinischen Nutzen – die Verbesserung der Patientenergebnisse (S004).

Die Zulassung wird oft für eine enge Anwendung erteilt, aber das Marketing extrapoliert sie auf breitere Szenarien. Ein Algorithmus, der für das Screening diabetischer Retinopathie bei Patienten mit Typ-2-Diabetes zugelassen ist, kann als „universelles Diagnosesystem für Augenerkrankungen" beworben werden – was über den validierten Anwendungsbereich hinausgeht.

Die Stahlmann-Version des Arguments: Fünf stärkste Argumente für das revolutionäre Potenzial medizinischer KI

Bevor wir Schwächen analysieren, müssen wir ehrlich die stärksten Argumente der Befürworter medizinischer KI darstellen. Dies ist kein Strohmann, sondern die Stahlmann-Version der Position: Wenn wir die besten Argumente nicht widerlegen können, ist Kritik sinnlos. Mehr dazu im Abschnitt KI-Fehler und Verzerrungen.

🔬 Argument 1: Überlegenheit bei eng definierten Mustererkennungsaufgaben ist bereits bewiesen

Bei streng definierten visuellen Diagnoseaufgaben erreichen KI-Systeme tatsächlich Expertenniveau oder übertreffen es. Algorithmen zur Erkennung diabetischer Retinopathie, Melanomen auf dermatoskopischen Bildern und bestimmten Lungenkrebsarten im CT zeigen Sensitivität und Spezifität, die mit erfahrenen Spezialisten vergleichbar sind (S001).

Bei Fachkräftemangel (besonders in Entwicklungsländern und ländlichen Regionen) kann selbst ein System mit 85–90% Genauigkeit klinisch nützlich sein, wenn die Alternative völlig fehlende Diagnostik ist. Das Argument der „Unvollkommenheit" verliert an Kraft, wenn der Vergleich nicht mit dem idealen Arzt, sondern mit der realen Verfügbarkeit medizinischer Versorgung erfolgt.

- Randomisierte kontrollierte Studien bestätigen Äquivalenz oder Überlegenheit bei eng definierten Aufgaben

- 85–90% Genauigkeit ist klinisch nützlich, wenn keine Alternative besteht

- Skalierung in Regionen mit Fachkräftemangel löst das Zugänglichkeits-, nicht das Qualitätsproblem

🧬 Argument 2: Die Fähigkeit zur Verarbeitung multimodaler Daten eröffnet neue diagnostische Möglichkeiten

Ein menschlicher Arzt ist in seiner Fähigkeit begrenzt, gleichzeitig Dutzende Datenquellen zu analysieren: Genomprofile, Proteomik, Krankengeschichte, Bildgebung, Laborwerte und Literatur. KI-Systeme können diese heterogenen Daten integrieren und Muster erkennen, die traditioneller Analyse unzugänglich sind (S002), (S006).

Systeme, die Kombinationen genetischer Marker und Bildgebungsdaten analysieren, können potenziell das Therapieansprechen präziser vorhersagen als jede Datenquelle einzeln. Dies ist kein Ersatz für den Arzt, sondern eine Erweiterung seiner kognitiven Fähigkeiten — das Argument der „Intelligenzverstärkung", nicht der Substitution.

⚙️ Argument 3: Skalierbarkeit und Standardisierung reduzieren die Variabilität der Versorgungsqualität

Die Qualität medizinischer Versorgung variiert stark abhängig von Arzterfahrung, Ermüdung, kognitiven Verzerrungen und Zugang zu aktuellen Informationen. Einmal validierte KI-Systeme bieten stabile Qualität unabhängig von Tageszeit, Arbeitsbelastung oder Geografie (S004).

Dieses Argument ist besonders stark im Kontext seltener Erkrankungen: Ein Allgemeinmediziner begegnet einer bestimmten Pathologie vielleicht einmal in seiner Karriere, während ein auf Tausenden Fällen trainierter Algorithmus die Expertise bewahrt. Standardisierung durch KI ist ein Mechanismus zur Verbreitung bester Praktiken.

Eine seltene Erkrankung, der ein Arzt einmal in seiner Karriere begegnet, ist Routine für einen auf Tausenden Fällen trainierten Algorithmus. Standardisierung durch KI degradiert den Beruf nicht, sondern verbreitet Expertise.

📊 Argument 4: Die Kosteneffizienz von Screening-Programmen kann radikal steigen

Massen-Screening-Programme (Brustkrebs, kolorektales Karzinom, diabetische Retinopathie) erfordern enorme Ressourcen für die Bildanalyse, wobei die meisten Bilder keine Pathologie enthalten. KI-Systeme können eine Vorsortierung durchführen und nur verdächtige Fälle zur Expertenbeurteilung weiterleiten, was die Belastung der Spezialisten und die Programmkosten senkt (S005).

Eine systematische Übersicht von Screening-Programmen zeigt, dass die Implementierung von KI-Triage die Anzahl der Fälle, die eine Expertenbewertung erfordern, um 50–70% reduzieren kann, bei gleichzeitiger Sensitivität über 95%. Wenn sich diese Zahlen in prospektiven Studien bestätigen, wird das ökonomische Argument unwiderlegbar.

🔁 Argument 5: Kontinuierliches Lernen ermöglicht Systemen, sich schneller an neue Daten anzupassen als klinische Protokolle aktualisiert werden

Medizinisches Wissen aktualisiert sich schneller, als Bildungsprogramme und klinische Leitlinien angepasst werden können. KI-Systeme mit kontinuierlichen Lernmechanismen können theoretisch neue Daten aus Literatur und klinischer Praxis in Echtzeit integrieren und so die Aktualität der Empfehlungen gewährleisten (S004).

Dieses Argument ist besonders relevant in sich schnell entwickelnden Bereichen wie Onkologie und Infektionskrankheiten, wo monatlich neue Medikamente und Protokolle erscheinen. Hier liegt jedoch auch die Hauptgefahr: Kontinuierliches Lernen ohne strenge Kontrolle kann zur Fehlerakkumulation und Modelldrift führen.

- Kontinuierliches Lernen

- Integration neuer Daten in Echtzeit. Vorteil: Aktualität der Empfehlungen. Risiko: Modelldrift und Fehlerakkumulation ohne Kontrolle.

- Klinische Protokolle

- Werden über Jahre aktualisiert. Vorteil: Konservativität und Überprüfung. Nachteil: Verzögerung gegenüber neuen Daten.

Evidenzbasis unter dem Mikroskop: Was systematische Reviews und Metaanalysen über die tatsächliche Wirksamkeit aussagen

Nachdem wir die stärksten Argumente präsentiert haben, wenden wir uns nun der kritischen Analyse der Evidenzbasis zu. Mehr dazu im Abschnitt Ethik und Sicherheit der KI.

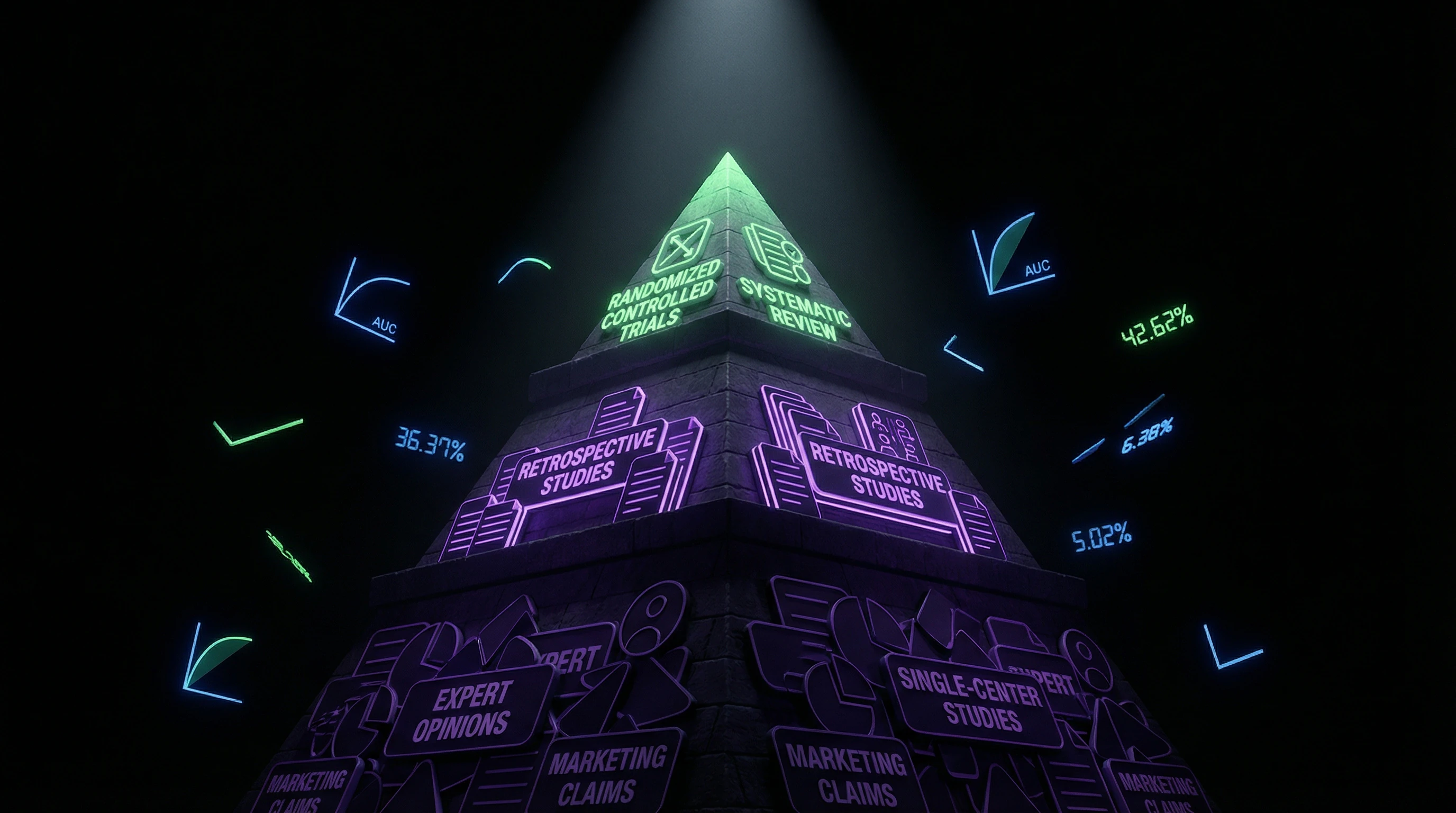

📊 Qualität der Studien: Überwiegend retrospektive monozentrische Arbeiten statt prospektiver RCTs

Ein systematischer Review von Studien zu medizinischen KI-Systemen deckt ein kritisches Problem auf: Die überwiegende Mehrheit der Publikationen sind retrospektive Studien auf Basis von Daten eines einzigen medizinischen Zentrums. Solche Arbeiten haben ein hohes Risiko für Overfitting und erlauben keine Bewertung der Generalisierbarkeit der Ergebnisse (S001).

Prospektive RCTs, bei denen ein KI-System in die reale Praxis implementiert wird und der Einfluss auf klinische Endpunkte (Mortalität, Lebensqualität, Komplikationsrate) gemessen wird, sind kritisch rar. Ein Review von Screening-Programmen zeigt, dass weniger als 15% der Studien zu medizinischer KI den Kriterien hoher methodologischer Qualität entsprechen (S001). Das bedeutet nicht, dass die Technologien nicht funktionieren – aber es bedeutet, dass das Evidenzniveau niedriger ist als bei den meisten Arzneimitteln.

Hohe Genauigkeit auf einem Testdatensatz eines einzelnen Zentrums ist kein Wirksamkeitsnachweis. Es ist der Nachweis, dass der Algorithmus diese spezifischen Daten gut auswendig gelernt hat.

🔎 Problem des Publication Bias: Negative Ergebnisse bleiben in der Schublade

Wie in anderen Bereichen der Medizin unterliegen Studien zu medizinischer KI dem Publication Bias: Arbeiten mit positiven Ergebnissen werden häufiger publiziert als solche mit negativen oder Null-Ergebnissen. Dies verzerrt die Wahrnehmung der Wirksamkeit der Technologien (S004).

Kommerzielle Entwickler publizieren oft nur die beeindruckendsten Ergebnisse und verschweigen gescheiterte Implementierungsversuche oder Limitationen der Systeme. Das Fehlen einer verpflichtenden Registrierung von Studien zu medizinischer KI (im Gegensatz zu klinischen Arzneimittelstudien) verschärft das Problem.

- Studie mit positivem Ergebnis: wird in Fachzeitschrift publiziert, in Pressemitteilungen zitiert.

- Studie mit Null-Ergebnis: bleibt im Archiv, beeinflusst die Wahrnehmung der Technologie nicht.

- Resultat: verzerrtes Bild der Wirksamkeit in wissenschaftlicher Literatur und Medien.

🧪 Heterogenität der Metriken: Warum hohe Genauigkeit nicht immer klinischen Nutzen bedeutet

Studien zu medizinischer KI verwenden heterogene Bewertungsmetriken: Accuracy, Sensitivität, Spezifität, Fläche unter der ROC-Kurve (AUC), F1-Score. Aber keine dieser Metriken misst direkt das, was für den Patienten wichtig ist: Verbesserung der Outcomes (S001).

Ein System kann eine AUC von 0,95 haben (exzellenter Wert), aber wenn seine Implementierung weder die Behandlungsstrategie ändert noch die Prognose verbessert, ist der klinische Nutzen null. Systematische Reviews zeigen, dass die Korrelation zwischen analytischen Metriken und klinischen Outcomes schwach und unvorhersehbar ist (S001).

| Metrik | Was sie misst | Zusammenhang mit klinischem Outcome |

|---|---|---|

| Accuracy (Genauigkeit) | Anteil korrekter Vorhersagen | Schwach – abhängig von Klassenverteilung |

| Sensitivity (Sensitivität) | Anteil erkannter Kranker | Mittel – wichtig für Screening, garantiert aber keine Verbesserung |

| AUC (Fläche unter Kurve) | Fähigkeit, Klassen zu unterscheiden | Schwach – berücksichtigt keine Entscheidungsschwellen und klinische Fehlerkosten |

| Mortalität, Lebensqualität | Reale Outcomes für Patienten | Stark – wird aber selten in KI-Studien gemessen |

🧬 Externe Validierung: Warum Algorithmen bei Tests auf unabhängigen Datensätzen versagen

Der Goldstandard zur Bewertung medizinischer KI ist die externe Validierung: Testung auf Daten aus anderen medizinischen Zentren, die unabhängig vom Trainingsdatensatz erhoben wurden. Systematische Reviews zeigen, dass bei externer Validierung die Performance der Algorithmen im Durchschnitt um 10–25% gegenüber der internen Validierung sinkt (S001).

Die Gründe sind vielfältig: Unterschiede in der Ausrüstung (verschiedene MRT-, CT-, Röntgengeräte-Modelle), Aufnahmeprotokollen, Patientendemografie, Krankheitsprävalenz. Ein Algorithmus, der auf Daten einer Universitätsklinik in den USA trainiert wurde, kann in einem Kreiskrankenhaus in Indien niedrige Genauigkeit zeigen – nicht wegen technischer Mängel, sondern wegen fundamentaler Unterschiede in Populationen und Bedingungen (S002), (S006).

Overfitting ist kein Entwicklerfehler. Es ist eine natürliche Folge davon, dass der Algorithmus Muster in spezifischen Daten sucht. Das Problem ist, dass diese Muster sich oft nicht auf neue Daten übertragen lassen.

⚙️ Integration in den klinischen Workflow: Warum ein technisch funktionierendes System von Ärzten nicht genutzt werden kann

Selbst ein validiertes System kann in der Implementierungsphase scheitern, wenn es sich nicht in den bestehenden klinischen Prozess integriert. Studien zeigen, dass Ärzte Empfehlungen von KI-Systemen in 30–50% der Fälle ignorieren, wenn das System zusätzliche Aktionen erfordert, die Arbeit verlangsamt oder Empfehlungen ohne Erklärungen ausgibt (S004).

Das Problem der „Black Box" ist besonders akut: Wenn ein System nicht erklären kann, warum es eine bestimmte Diagnose oder Strategie vorschlägt, vertrauen Ärzte ihm nicht. Das Vertrauen in ein Instrument hängt nicht nur von seiner Genauigkeit ab, sondern auch von der Transparenz des Entscheidungsmechanismus (S003). Dies ist keine Irrationalität der Ärzte, sondern rationale Vorsicht unter Bedingungen rechtlicher Verantwortung.

- Klinischer Workflow

- Abfolge der Handlungen eines Arztes bei Diagnostik und Behandlung. Ein KI-System muss sich in diesen Prozess einfügen, nicht dessen Neugestaltung erfordern.

- Erklärbarkeit (Explainability)

- Fähigkeit des Systems, seine Entscheidung zu begründen. Ohne sie kann der Arzt die Logik nicht überprüfen und keine Verantwortung für das Ergebnis übernehmen.

- Rechtliche Verantwortung

- Wenn das System einen Fehler macht, haftet der Arzt gegenüber Patient und Gericht. Daher muss der Arzt jede Entscheidung verstehen und kontrollieren.

Mechanismus oder Korrelation: Warum KI Muster findet, aber keine Kausalzusammenhänge versteht

Eine fundamentale Einschränkung moderner medizinischer KI-Systeme besteht darin, dass sie auf das Auffinden von Korrelationen optimiert sind, nicht auf das Verstehen kausaler Mechanismen. Dies birgt das Risiko falscher Entdeckungen und fragiler Vorhersagen. Mehr dazu im Abschnitt Grundlagen der Erkenntnistheorie.

🔁 Das Confounder-Problem: Wenn der Algorithmus nicht das lernt, was wir denken

Ein klassisches Beispiel: Ein Algorithmus, der trainiert wurde, Pneumonie auf Röntgenbildern zu erkennen, kann tatsächlich lernen, portable Röntgengeräte zu identifizieren (die häufiger bei schwerkranken Patienten eingesetzt werden) anstatt die Pneumonie selbst.

Dies ist ein Confounder – eine verborgene Variable, die mit dem Zielmerkmal korreliert. Das Problem verschärft sich dadurch, dass tiefe neuronale Netze Muster finden, die für Menschen unsichtbar sind – aber das garantiert nicht, dass diese Muster klinisch relevant sind.

Ein Algorithmus kann hohe Genauigkeit erreichen, indem er Datenartefakte nutzt (Markierungen auf Bildern, Dateikompressionsmerkmale, Geräteeigenschaften) statt biologischer Krankheitszeichen. Das ist kein Modellfehler – es ist ein Fehler im Verständnis dessen, was das Modell tatsächlich gelernt hat.

🧬 Fehlende Kausalmodelle: Warum Korrelation nicht die Wirkung einer Intervention vorhersagt

Medizinische Entscheidungen erfordern kausales Denken: „Wenn ich diese Behandlung verordne, was wird passieren?" Aber die meisten KI-Systeme sind auf Beobachtungsdaten trainiert, die keine kausalen Schlussfolgerungen erlauben (S004).

Ein System kann vorhersagen, dass ein Patient mit hoher Wahrscheinlichkeit sterben wird, kann aber nicht sagen, ob eine bestimmte Intervention dieses Ergebnis ändern wird. Dieser Unterschied zwischen Vorhersage und Handlung ist entscheidend für die Klinik.

- Vorhersage (Korrelation)

- „Dieser Patient hat ein hohes Sterberisiko" – basiert auf Mustern in den Daten, erklärt aber nicht die Ursache.

- Kausales Wissen (Mechanismus)

- „Wenn Medikament X verabreicht wird, sinkt das Risiko um Y%" – erfordert Verständnis des biologischen Mechanismus und Überprüfung durch randomisierte Studien (S004).

- Warum das kritisch ist

- Der Arzt muss zwischen mehreren Interventionen wählen. Vorhersage ohne Mechanismus lässt ihn ohne Werkzeug für diese Wahl.

Die erkenntnistheoretische Analyse der klinischen Medizin betont, dass das Wissen um den Krankheitsmechanismus für die Therapiewahl entscheidend ist. KI-Systeme, die als „Black Boxes" funktionieren, liefern dieses Wissen nicht – sie geben Vorhersagen ohne Erklärungen, was ihre Anwendbarkeit in komplexen klinischen Szenarien einschränkt (S003).

📊 Data Drift: Warum Modelle schneller veralten, als wir denken

Die medizinische Praxis verändert sich ständig: Neue Medikamente kommen auf den Markt, Protokolle ändern sich, Pathogene entwickeln sich weiter. Ein Modell, das auf Daten von 2020 trainiert wurde, kann 2026 ungenau sein – nicht wegen technischer Probleme, sondern weil sich die Realität selbst verändert hat.

| Drift-Faktor | Beispiel | Konsequenz für das Modell |

|---|---|---|

| Evolution des Pathogens | Neue COVID-19-Varianten, Antibiotikaresistenzen | Modell, das auf alten Stämmen trainiert wurde, verliert an Genauigkeit |

| Änderung des Behandlungsprotokolls | Übergang zu neuem Therapiestandard | Verteilung der Outcomes in den Daten verschiebt sich |

| Demografische Verschiebungen | Alterung der Bevölkerung, Migration | Patientenmerkmale unterscheiden sich von der Trainingsstichprobe |

Machine-Learning-Modelle erfordern regelmäßiges Nachtraining zur Aufrechterhaltung der Genauigkeit, aber in der Medizin ist das komplizierter: Jede Modellaktualisierung erfordert erneute Validierung und behördliche Genehmigung (S001). Dies schafft ein Paradox: Systeme müssen sich anpassen, aber der Anpassungsprozess ist langsam und teuer.

Das Ergebnis: Ein KI-System, das bei der Einführung genau war, kann nach einigen Jahren unzuverlässig werden, nicht weil der Algorithmus versagt hat, sondern weil sich die Welt verändert hat. Dies erfordert kontinuierliches Monitoring und Nachtraining – Kosten, die bei der Implementierungsplanung oft unterschätzt werden.

Konflikte und Unklarheiten: Wo Quellen divergieren und warum kein Konsens besteht

Die Literaturanalyse zeigt mehrere Bereiche, in denen Daten widersprüchlich sind und Expertenmeinungen auseinandergehen. Dies ist kein Zeichen wissenschaftlicher Schwäche, sondern ein Indikator für die Komplexität des Problems. Mehr dazu im Abschnitt Kognitive Verzerrungen.

🧩 Die Debatte um Ersetzbarkeit: Intelligenzsteigerung versus Automatisierung

Einer der zentralen Konflikte betrifft die Frage, ob KI-Systeme die Fähigkeiten von Ärzten erweitern (Augmentation) oder sie ersetzen (Automation). Optimisten behaupten, KI werde Ärzte von Routineaufgaben befreien und ihnen ermöglichen, sich auf komplexe Fälle und die Kommunikation mit Patienten zu konzentrieren.

Skeptiker weisen darauf hin, dass ökonomischer Druck zum Abbau medizinischen Personals führen und die Versorgungsqualität senken wird (S007). Systematische Analysen der KI-Auswirkungen auf Beschäftigung zeigen, dass Automatisierung in anderen Sektoren oft zu Polarisierung führt: Hochqualifizierte Fachkräfte profitieren, während Beschäftigte im mittleren Segment Positionen verlieren.

Ob dies auf die Medizin zutrifft, ist eine offene Frage, die von regulatorischen Entscheidungen und ökonomischen Modellen des Gesundheitswesens abhängt.

📊 Unsicherheit bei der Bewertung der Wirtschaftlichkeit: Wer zahlt, wer profitiert?

Behauptungen über Kostensenkungen in der medizinischen Versorgung durch KI berücksichtigen oft nicht die Gesamtkosten: Entwicklung, Validierung, Implementierung, Personalschulung, Infrastrukturunterhalt. Die Wirtschaftlichkeit von KI-Triage hängt stark vom Kontext ab: In Ländern mit Ärztemangel ist der Gewinn höher, in Ländern mit Überangebot an Diagnostikern niedriger.

Zudem verteilt sich der Nutzen ungleich: Softwarehersteller und große Krankenhäuser erzielen Gewinne, während ambulante Kliniken und ländliche Zentren möglicherweise ohne Zugang bleiben (S001).

- Die Total Cost of Ownership (TCO) umfasst nicht nur Lizenzen, sondern auch Integration, Validierung mit lokalen Daten und Personalweiterbildung.

- Der ROI hängt vom Patientenvolumen und Einrichtungstyp ab: Große Zentren amortisieren Investitionen schneller.

- Zugangsgerechtigkeit bleibt ungelöst: KI könnte Ungleichheiten im Gesundheitswesen vertiefen.

🔍 Black Box versus Transparenz: Wenn Erklärbarkeit mit Genauigkeit kollidiert

Tiefe neuronale Netze zeigen oft bessere Genauigkeit, erklären ihre Entscheidungen jedoch schlechter. Ärzte und Regulierungsbehörden fordern Transparenz: Warum empfiehlt das System genau diese Diagnose? Doch die Hinzufügung von Interpretierbarkeit kann die Genauigkeit verringern (S003).

Dies schafft ein Dilemma: hochpräzise Black Box oder weniger genaues, aber erklärbares System? Verschiedene Länder und Einrichtungen entscheiden unterschiedlich, was die Standardisierung erschwert.

| Parameter | Black Box (DL) | Interpretierbares Modell |

|---|---|---|

| Genauigkeit | Oft höher | Oft niedriger |

| Erklärbarkeit | Niedrig | Hoch |

| Regulatorische Zulassung | Schwieriger | Einfacher |

| Vertrauen der Ärzte | Niedriger | Höher |

🌍 Generalisierung und Kontext: Funktioniert KI außerhalb der Trainingsstichprobe?

Ein System, das mit Daten amerikanischer Krankenhäuser trainiert wurde, kann in Europa oder Asien schlecht funktionieren aufgrund von Unterschieden in Population, Ausrüstung und Protokollen. Dies ist kein Bug, sondern ein fundamentales Problem des maschinellen Lernens (S002).

Einige Forscher behaupten, lokale Validierung löse das Problem. Andere weisen darauf hin, dass dies hohe Kosten verursacht und die Implementierung verlangsamt. Es gibt keinen Konsens: Validierungsstandards unterscheiden sich zwischen Ländern und Regulierungsbehörden.

Paradox: Je spezialisierter das System, desto höher seine Genauigkeit im engen Kontext, aber desto geringer seine Universalität und Skalierbarkeit.

⚖️ Verantwortung und Regulierung: Wer trägt das Risiko?

Wenn ein KI-System einen Fehler macht, wer ist schuld: der Entwickler, das Krankenhaus, der Arzt, der es verwendet hat? Die Gesetzgebung verschiedener Länder gibt unterschiedliche Antworten (S004). In den USA liegt der Schwerpunkt beim Hersteller, in der EU beim Anwender, in anderen Ländern beim Staat.

Diese Unsicherheit bremst Investitionen und verlangsamt die Implementierung. Start-ups fürchten Klagen, Krankenhäuser die Haftung, Ärzte den Lizenzverlust. Ergebnis: KI bleibt in Pilotprojekten stecken, ohne in die Routinepraxis überzugehen.

- Haftungsmodell (USA)

- Der Hersteller trägt die Hauptverantwortung für Softwarequalität und Validierung. Der Arzt für die Entscheidung, das System zu nutzen und Ergebnisse zu interpretieren.

- Haftungsmodell (EU)

- Der Anwender (Krankenhaus/Arzt) trägt die Verantwortung für Implementierung und Monitoring. Der Hersteller für die Offenlegung von Limitationen.

- Praktisches Ergebnis

- Unterschiedliche Standards bremsen die globale Implementierung und schaffen einen fragmentierten Markt.

🎯 Warum es keinen Konsens gibt und warum das normal ist

Medizinische KI befindet sich an der Schnittstelle von Technologie, Ökonomie, Ethik und Politik. Jede Interessengruppe sieht das Problem anders: Hersteller als Chance, Ärzte als Bedrohung, Patienten als Hoffnung, Regulierungsbehörden als Risiko.

Das Fehlen eines Konsenses bedeutet nicht, dass KI nicht funktioniert. Es bedeutet, dass ihre Rolle in der Medizin eine offene Frage bleibt, abhängig davon, wie wir sie regulieren, finanzieren und implementieren. Dies ist kein technisches Problem – es ist eine Frage der Entscheidung.

Gegenposition

⚖️ Kritischer Kontrapunkt

Der Artikel nimmt eine vorsichtige Position ein, könnte aber sowohl das Tempo des Fortschritts als auch die tatsächlichen Erfolge bei der Implementierung unterschätzen. Hier sind Punkte, an denen die Logik der Argumentation einer Präzisierung bedarf.

Unterschätzung der Fortschrittsgeschwindigkeit

Die letzten 2–3 Jahre haben ein exponentielles Wachstum der Fähigkeiten großer Sprachmodelle und multimodaler Systeme (GPT-4, Med-PaLM 2) gezeigt, die ein qualitativ neues Niveau des Verständnisses medizinischer Kontexte demonstrieren. Möglicherweise stehen wir an der Schwelle zu wirklich transformativen Veränderungen, und die Skepsis des Artikels spiegelt veraltete Vorstellungen über die Möglichkeiten von AI wider.

Ignorierung erfolgreicher Implementierungsfälle

Der Artikel konzentriert sich auf Probleme und Einschränkungen, könnte aber die tatsächlich erfolgreichen Implementierungen von AI in der klinischen Praxis unterschätzen. Systeme zur Analyse diabetischer Retinopathie (IDx-DR) haben regulatorische Zulassungen erhalten und werden in der realen Praxis eingesetzt, wobei sie messbaren Nutzen zeigen. Die Kritik könnte übermäßig verallgemeinernd sein.

Methodologische Voreingenommenheit der Quellen

Die verwendeten Quellen sind keine spezialisierten Übersichtsarbeiten zu medizinischer AI – es handelt sich um fragmentierte Arbeiten zu Nanotechnologie, Epistemologie und Softwareanforderungen. Das Fehlen direkter systematischer Reviews zur Wirksamkeit von AI in der Medizin (z.B. aus Nature Medicine, Lancet Digital Health) macht die Schlussfolgerungen des Artikels potenziell voreingenommen. Aktuellere und spezialisierte Quellen hätten ein anderes Bild ergeben können.

Unterschätzung des wirtschaftlichen Drucks

Der Artikel berücksichtigt nicht, dass ökonomische Faktoren (Ärztemangel, steigende Gesundheitskosten, Effizienzdruck) die Implementierung von AI auch bei unvollständiger Evidenzbasis beschleunigen können. Regulierungsbehörden könnten Kompromisse eingehen und „Fast-Track-Verfahren" für die Zulassung von AI-Systemen in Zeiten der Gesundheitskrise schaffen. Die Realität könnte pragmatischer ausfallen, als der Artikel annimmt.

Risiko der Veralterung der Schlussfolgerungen

Medizinische AI entwickelt sich so schnell, dass die Schlussfolgerungen innerhalb von 6–12 Monaten veraltet sein könnten. Durchbrüche bei der Interpretierbarkeit von Algorithmen, beim föderierten Lernen oder bei neuen Architekturen könnten die Situation radikal verändern. Der Artikel läuft Gefahr, ein Beispiel für verfrühte Skepsis zu werden, wie es bei der frühen Kritik am Deep Learning in den 2000er Jahren der Fall war.

FAQ

Häufig gestellte Fragen