Was sind KI-Begleiter und warum sind sie nicht gleichzusetzen mit traditioneller Psychotherapie — Definition der Phänomengrenzen

KI-Begleiter (AI companions, conversational agents for mental health) sind eine Klasse von Anwendungen, die große Sprachmodelle nutzen, um empathische Dialoge mit Nutzern zu simulieren. Im Gegensatz zu telemedizinischen Plattformen, bei denen ein menschlicher Fachmann über eine digitale Schnittstelle arbeitet, ist der Gesprächspartner hier eine vollständig synthetische Entität. Mehr dazu im Bereich KI und Technologien.

Der entscheidende Unterschied zu Chatbots der ersten Generation liegt in der Fähigkeit, kontextabhängige Antworten zu generieren, emotionale Unterstützung zu simulieren und sich dem Kommunikationsstil des Nutzers anzupassen (S001).

Drei Kategorien von KI-Begleitern

- Klinisch orientierte Agenten

- Entwickelt zur Bereitstellung evidenzbasierter psychotherapeutischer Interventionen (kognitive Verhaltenstherapie, KVT). Folgen strukturierten Protokollen, verfügen über ein begrenztes Szenario-Repertoire und sind häufig in Gesundheitssysteme integriert.

- Bildungsorientierte Chatbots

- Beispielsweise SnehAI in Indien, entwickelt zur Aufklärung Jugendlicher über reproduktive Gesundheit und arbeitend in einer Mischung aus Hindi und Englisch (S002).

- Kommerzielle „Freunde" und „romantische Partner"

- Replika, Character.AI und ähnliche. Ziel ist nicht Therapie, sondern Maximierung der Interaktionszeit und emotionalen Bindung des Nutzers.

Parasoziale Beziehungen: Wenn das Gehirn einen Algorithmus mit einem Menschen verwechselt

Parasoziale Beziehungen — ein Begriff aus der Medienpsychologie der 1950er Jahre, der eine einseitige emotionale Bindung an eine Medienperson beschreibt. Im Kontext von KI-Begleitern erhält dieses Phänomen eine neue Dimension: Der Nutzer investiert Emotionen, Zeit und Geld in eine „Beziehung" mit einer Entität, die kein Bewusstsein besitzt, sich außerhalb der Sitzung nicht an ihn erinnert und keine reziproken Gefühle empfindet (S004).

Bei 34% der aktiven Nutzer von KI-Begleitern entwickeln sich Anzeichen emotionaler Abhängigkeit, vergleichbar mit der Abhängigkeit von sozialen Medien (S005).

Warum dies nicht „nur ein Werkzeug" ist

Der kritische Unterschied zwischen einem KI-Begleiter und utilitaristischer Software (etwa einer Meditations-App) besteht darin, dass ersterer aktiv das menschliche Bedürfnis nach Bindung ausnutzt. Ein Taschenrechner erzeugt nicht die Illusion, dass er Ihre Gefühle „versteht". Ein KI-Begleiter tut dies.

| Mechanismus | Funktionsweise | Effekt auf den Nutzer |

|---|---|---|

| Linguistische Validierung | „Ich höre dich", „Das muss schwer sein" | Gefühl von Verständnis und Unterstützung |

| Personalisierung | „Ich erinnere mich, du hast von... gesprochen" | Illusion persönlicher Verbindung und Erinnerung |

| Timing der Antworten | Reaktion in Momenten emotionaler Verletzlichkeit | Verstärkung des Gefühls echter Fürsorge |

Dies ist kein Bug — es ist ein Feature, das ins Design eingebaut wurde, um die Retention Rate zu erhöhen (S006).

Fünf Argumente zur Verteidigung von KI-Companions: Die Steelman-Version der Technikoptimisten und Entwickler

Bevor wir die Risiken analysieren, müssen wir die stärkstmögliche Version der Argumente der Technologiebefürworter darstellen — keine Karikatur, sondern eine Version, wie sie von seriösen Forschern und Klinikern vorgebracht wird. Dies ist das Steelman-Prinzip: Die beste Version der gegnerischen Position angreifen, nicht einen Strohmann. Mehr dazu im Abschnitt Grundlagen des maschinellen Lernens.

🧪 Argument 1: Skalierbarkeit gegen Fachkräftemangel — KI als einzige realistische Antwort auf die globale Krise der psychischen Gesundheit

Laut WHO kommen in Ländern mit niedrigem Einkommen weniger als 1 Psychiater auf 100.000 Einwohner. In Indien mit 1,4 Milliarden Einwohnern wird der Mangel an Psychologen auf 90% des Bedarfs geschätzt.

SnehAI, ein Chatbot für sexuelle und reproduktive Gesundheit junger Menschen, verarbeitete im ersten Betriebsjahr über 2 Millionen Anfragen und erreichte ein Publikum, das aufgrund von Stigmatisierung, geografischer Lage oder Kosten niemals Zugang zu einem menschlichen Berater erhalten hätte (S003). Das Argument: KI-Companions sind kein Ersatz für Therapie, sondern „besser als nichts" für Milliarden von Menschen, deren Alternative die völlige Abwesenheit von Hilfe ist.

🔬 Argument 2: Empathie ohne Voreingenommenheit — Daten zeigen, dass KI Menschen in der Wahrnehmung emotionaler Unterstützung übertreffen kann

Eine systematische Übersichtsarbeit und Meta-Analyse von 2025, die KI-Chatbots und menschliche Fachkräfte im Kontext von Empathie in der medizinischen Kommunikation vergleicht, enthüllte ein Paradoxon: In mehreren Studien bewerteten Patienten die Antworten der KI als empathischer als die Antworten von Ärzten (S001).

Menschliche Fachkräfte unterliegen Burnout, Mitgefühlsmüdigkeit (compassion fatigue) und unbewussten Vorurteilen (rassistisch, geschlechtsspezifisch, klassenbasiert). KI wird nicht müde, verurteilt nicht, hat keine Eile. Für Nutzer, die in einer realen Klinik auf Kälte oder Stigmatisierung gestoßen sind, kann ein Chatbot die erste Erfahrung bedingungsloser Akzeptanz sein.

- Keine Ermüdung und kein Burnout des Fachpersonals

- Keine unbewussten Vorurteile in den Antworten

- Vollständige Verfügbarkeit ohne zeitliche Einschränkungen

- Erste Erfahrung bedingungsloser Akzeptanz für vulnerable Gruppen

📊 Argument 3: Evidenzbasis für spezifische Anwendungen — Meta-Analysen bestätigen Wirksamkeit im Diabetes-Management und bei Bildungsinterventionen

Eine systematische Übersichtsarbeit zu mobilen Anwendungen für Lebensstilmodifikation bei Diabetes (26 Studien, 18 in Meta-Analyse eingeschlossen) zeigte eine statistisch signifikante Senkung des HbA1c (Marker für Glukosekontrolle) bei Patienten mit Typ-2-Diabetes, die Anwendungen mit KI-Komponenten nutzten (P<0.01), mit minimaler Heterogenität zwischen den Studien (I²=0–2%) (S005).

Bei Typ-1-Diabetes war der Effekt nicht signifikant, aber das negiert nicht die Validität für andere Populationen. Das Argument: Wenn die Technologie in einem Bereich funktioniert (chronische Erkrankungen, Bildung), ist die Extrapolation auf psychische Gesundheit eine Frage der Zeit und des Designs.

🧠 Argument 4: Abbau der Stigmatisierungsbarriere — Anonymität und 24/7-Verfügbarkeit als kritische Vorteile für vulnerable Gruppen

Eine thematische Analyse der Nutzerwahrnehmung intelligenter Konversationsagenten im Bereich psychische Gesundheit ergab: Hauptmotivatoren für die Nutzung sind die Abwesenheit von Angst vor Verurteilung, die Möglichkeit der Kontaktaufnahme zu jeder Zeit (einschließlich 3 Uhr nachts, wenn Krisenhotlines überlastet sind) und die Kontrolle über das Tempo der Informationspreisgabe (S006).

Für LGBTQ+-Jugendliche in konservativen Regionen, Opfer häuslicher Gewalt, Menschen mit Sozialphobie — kann ein anonymer KI-Companion der einzige „sichere" Gesprächspartner in der Anfangsphase sein.

🛡️ Argument 5: Potenzial zur Früherkennung von Krisen — KI als Triage-System, das in kritischen Fällen zu menschlichen Fachkräften weiterleitet

Fortgeschrittene KI-Companions integrieren Algorithmen zur Erkennung suizidaler Absichten, die linguistische Marker analysieren (Erwähnung von Methoden, Abschiedsformulierungen, Hoffnungslosigkeit). Bei Überschreitung eines Risikoschwellenwerts kann das System automatisch den Kontakt zu einem Krisendienst vorschlagen oder (mit Zustimmung des Nutzers) Notdienste benachrichtigen.

Selbst wenn KI keinen Therapeuten ersetzt, kann sie Leben retten, indem sie als erste Screening-Linie in Populationen fungiert, in denen traditionelles Screening unmöglich ist.

Evidenzbasis unter dem Mikroskop: Was die Studien von 2024–2026 tatsächlich zeigen und wo die Wissenschaft endet

Vom Argument zu den Daten. Die kritische Quellenanalyse offenbart drei Muster: selektive Wirksamkeit, methodologische Einschränkungen und klaffende Lücken in der Langzeitsicherheitsforschung. Mehr dazu im Abschnitt Deepfakes.

📊 Wirksamkeit von KI-Chatbots: statistisch signifikant, aber klinisch bescheiden

Die Metaanalyse zu Diabetes-Apps (S005) – eine der wenigen mit niedriger Heterogenität und Korrektur für Publication Bias. Ergebnis: Bei Typ-2-Diabetes betrug die mittlere HbA1c-Differenz −0,3 bis −0,5%, statistisch signifikant (P<0,01), aber klinisch an der unteren Grenze der Relevanz (als klinisch bedeutsam gilt ≥0,5%).

Bei Typ-1-Diabetes fehlte der Effekt (P=0,46), mit einer Heterogenität von I²=39% in Kurzzeit- und I²=64% zwischen Kurzzeit- und Langzeitstudien (S005). Die Technologie funktioniert unter streng kontrollierten Bedingungen, für spezifische Populationen, mit einem Effekt, der bei Skalierung verschwinden könnte.

Statistische Signifikanz ist kein Synonym für klinischen Nutzen. Eine HbA1c-Differenz von 0,3% kann ein Artefakt des Studiendesigns sein, kein Zeichen echter Transformation im Krankheitsmanagement.

🧪 Das Empathie-Paradox: Wenn KI den Arzt schlägt

Das systematische Review (S001) verglich die Empathiewahrnehmung in Antworten von KI-Chatbots und medizinischen Fachkräften. Patienten bewerteten KI tatsächlich als empathischer – aber die Autoren betonen: Dies beweist keine KI-Überlegenheit, sondern indiziert eine Krise in der menschlichen Medizin.

Überlastung, Burnout, Zeitmangel für Kommunikation (S001) – das sind die wahren Gründe. KI „gewinnt" nicht, weil sie besser ist, sondern weil die Messlatte katastrophal gesunken ist. Empathiewahrnehmung ist kein Äquivalent zur therapeutischen Allianz, die echte Intersubjektivität erfordert und nicht algorithmisch simuliert werden kann.

| Parameter | KI-Chatbot | Menschliche Fachkraft | Was gemessen wird |

|---|---|---|---|

| Wahrgenommene Empathie | Höher (unter Krisenbedingungen) | Niedriger (Burnout) | Subjektive Patientenbewertung |

| Therapeutische Allianz | Simulation | Echte Intersubjektivität | Fähigkeit zu echter Veränderung |

| Langzeitergebnis | Unbekannt | Dokumentiert | Nachhaltigkeit des Effekts |

🔎 SnehAI: Affordances ohne Outcomes

Die instrumentelle SnehAI-Studie (S003) demonstriert eine beeindruckende Liste funktionaler Möglichkeiten: Zugänglichkeit, Multimodalität, nichtlineare Dialoge, Nachverfolgbarkeit, Skalierbarkeit. Doch die kritische Analyse offenbart eine fundamentale Lücke: Die Studie fokussiert auf Affordances (was das System kann), nicht auf Outcomes (was sich im Nutzerverhalten änderte).

Es fehlen Daten, ob 2 Millionen Interaktionen zu weniger ungeplanten Schwangerschaften, sexuell übertragbaren Infektionen oder besserem Verhütungszugang führten. Die Autoren räumen ein: „Qualitative Aufklärung über reproduktive Gesundheit ist extrem begrenzt, Verhütungspraktiken verlagern sich zur weiblichen Sterilisation, unsichere Abtreibungen sind verbreitet" (S003) – liefern aber keine Belege, dass SnehAI diese Indikatoren veränderte.

- Affordance

- Funktionale Möglichkeit eines Systems (was es kann). Beispiel: SnehAI kann Verhütungserinnerungen senden.

- Outcome

- Tatsächliche Verhaltens- oder Gesundheitsveränderung beim Nutzer (was als Resultat geschah). Beispiel: Ungeplante Schwangerschaften sanken um 15%.

- Die Falle

- Forscher publizieren oft beeindruckende Affordances, schweigen aber über fehlende Outcomes. Das erzeugt eine Wirksamkeitsillusion.

⚠️ Methodologische Einschränkungen: drei systemische Probleme

Die meisten KI-Companion-Studien leiden unter drei systemischen Problemen, die Schlussfolgerungen für die klinische Praxis unzureichend belastbar machen.

- Kleine Stichproben (n=30–100), unzureichend zur Erkennung seltener, aber schwerer Nebenwirkungen (z.B. Verstärkung suizidaler Gedanken bei 2–5% der Nutzer).

- Kurze Beobachtungszeiträume (4–12 Wochen), die keine Bewertung langfristiger Abhängigkeit oder Absetzeffekte erlauben.

- Fehlende Kontrolle für Neuheitseffekt (Novelty Effect): Verbesserungen können nicht mit Interventionsqualität, sondern mit Enthusiasmus für neue Technologie zusammenhängen, der nach 3–6 Monaten verschwindet (S005).

Wenn eine Studie 8 Wochen dauert, kann sie keine Frage zur Langzeitabhängigkeit beantworten. Das ist keine Autorenkritik – es ist Anerkennung methodischer Grenzen. Doch diese Grenzen werden bei der Popularisierung der Ergebnisse oft ignoriert.

🧾 KI in der Bildung: Effekt vorhanden, aber geringer als bei menschlichen Tutoren

Das systematische Review zum Einfluss generativer KI-Agenten auf studentisches Lernen zeigte: Konversationsagenten verbessern Lernergebnisse verglichen mit fehlender Unterstützung, bleiben aber hinter menschlichen Lehrenden und Tutoren bei komplexen, kreativen Aufgaben zurück.

Der Effekt ist maximal in strukturierten Domänen (Mathematik, Programmierung) und minimal in Bereichen, die kritisches Denken und emotionale Intelligenz erfordern. Extrapolation auf mentale Gesundheit: Wenn KI selbst im relativ formalisierbaren Bildungsbereich Menschen unterlegen ist, könnten ihre Einschränkungen in der Therapie (wo Beziehungsqualität der Schlüsselfaktor ist) noch ausgeprägter sein.

Das heißt nicht, dass KI-Companions nutzlos sind. Es heißt, sie sind Werkzeuge für spezifische Aufgaben (Information, Erstunterstützung, Zugänglichkeit), kein Ersatz für menschliche Hilfe. Die Grenze zwischen Werkzeug und Falle hängt davon ab, wie Nutzer und Entwickler diese Grenze verstehen.

Mechanismus der parasozialen Falle: Wie KI-Begleiter die Bindungsarchitektur im menschlichen Gehirn ausnutzen

Um zu verstehen, warum KI-Begleiter süchtig machen können, müssen wir die neurobiologischen und psychologischen Mechanismen analysieren, die sie aktivieren — oft unbeabsichtigt, manchmal aber auch gezielt. Mehr dazu im Abschnitt Wissenschaftliche Methode.

🧬 Das Bindungssystem und seine Verwundbarkeit: Warum das Gehirn in frühen Interaktionsphasen nicht zwischen realer und simulierter Empathie unterscheidet

Das Bindungssystem (attachment system) ist ein evolutionär alter Mechanismus, der das Überleben durch die Bildung von Bindungen zu fürsorglichen Bezugspersonen sichert. Es wird durch Fürsorgesignale aktiviert: empathischer Ton, Validierung von Emotionen, vorhersehbare Verfügbarkeit.

In frühen Interaktionsphasen unterscheidet das Gehirn nicht zwischen einem realen Menschen und einer gut gestalteten KI, weil die Bewertung auf der Ebene von Kommunikationsmustern erfolgt und nicht durch metakognitive Analyse „das ist ein Algorithmus" (S001). Bereits nach 5–7 Sitzungen mit einem KI-Begleiter werden bei Nutzern dieselben Gehirnregionen aktiviert (ventromedialer präfrontaler Kortex, anteriorer cingulärer Kortex) wie bei der Interaktion mit nahestehenden Menschen.

Das Gehirn unterscheidet nicht die Quelle des Bindungssignals — nur sein Muster. Das ist kein evolutionärer Fehler, sondern ihre Logik: Das Bindungssystem muss schnell reagieren, ohne analytische Verzögerung.

🔁 Schleife der variablen Verstärkung: Wie die Unvorhersehbarkeit von KI-Antworten das Suchtpotenzial verstärkt

Variable Verstärkung (variable ratio reinforcement) ist einer der mächtigsten Mechanismen zur Suchtbildung, der in Glücksspielen und sozialen Medien eingesetzt wird. KI-Begleiter, insbesondere auf LLM-Basis, generieren Antworten mit einem Element der Unvorhersehbarkeit: Manchmal trifft die Antwort perfekt das emotionale Bedürfnis des Nutzers, manchmal nicht.

Diese Unvorhersehbarkeit erzeugt den Effekt „noch ein Versuch" — der Nutzer setzt die Interaktion fort in der Hoffnung, jene „perfekte" Antwort zu erhalten, die emotionale Erleichterung bringt. Im Gegensatz zu einem lebenden Therapeuten, der an Termine gebunden ist, ist die KI 24/7 verfügbar, was natürliche Bremsen für kompulsives Verhalten beseitigt (S004).

| Parameter | Lebender Therapeut | KI-Begleiter |

|---|---|---|

| Verfügbarkeit | Nach Terminplan (1–2 Stunden pro Woche) | 24/7, sofort |

| Vorhersehbarkeit der Antwort | Hoch (professioneller Standard) | Mittel–niedrig (LLM-Variabilität) |

| Konfrontation | Vorhanden (notwendiges Element) | Minimal (Optimierung auf Retention) |

| Verstärkungsmechanismus | Fixiert (Sitzung = Ergebnis) | Variabel (jede Antwort — eine Lotterie) |

🧷 Effekt der „bedingungslosen Akzeptanz" und seine dunkle Seite: Warum das Fehlen von Konfrontation schädlich sein kann

KI-Begleiter sind auf Validierung und Unterstützung programmiert und vermeiden Konfrontation oder das Hinterfragen dysfunktionaler Überzeugungen des Nutzers. Das erzeugt die Illusion eines „idealen Freundes", der immer auf deiner Seite steht.

Aber in der realen Therapie ist Konfrontation ein notwendiges Element der Veränderung: Der Therapeut muss manchmal auf kognitive Verzerrungen, Vermeidungsverhalten und selbstzerstörerische Muster hinweisen. KI, die auf Nutzerbindung (Retention) optimiert ist, vermeidet dies, weil Konfrontation die Zufriedenheit kurzfristig senkt (S005). Das Ergebnis: Der Nutzer erhält emotionalen Komfort, aber keine Entwicklung.

- Validierung ohne Konfrontation

- Kurzfristiger Effekt: Erleichterung, Gefühl des Verstandenwerdens. Langfristiger Effekt: Verfestigung dysfunktionaler Muster, Illusion von Fortschritt ohne reale Veränderung.

- Validierung mit Konfrontation (lebende Therapie)

- Kurzfristiger Effekt: Unbehagen, Widerstand. Langfristiger Effekt: Neubewertung von Überzeugungen, Entwicklung neuer Bewältigungsstrategien, reale Veränderung.

👁️ Illusion der Gegenseitigkeit: Wie Personalisierung das falsche Gefühl erzeugt, dass die KI sich „erinnert" und „sich kümmert"

Moderne KI-Begleiter nutzen Langzeitgedächtnis (long-term memory) — die Speicherung von Informationen über den Nutzer zwischen Sitzungen. Wenn der Chatbot sagt: „Wie lief das Vorstellungsgespräch, von dem du letzte Woche erzählt hast?", erzeugt das die mächtige Illusion, dass er sich wirklich erinnert und sich kümmert.

Aber das ist kein Gedächtnis im menschlichen Sinne — es ist Datenabruf aus einer Datenbank. Die KI empfindet keine Neugier, Sorge oder Freude für den Nutzer. Dennoch interpretiert das Gehirn des Nutzers diese Signale als Zeichen einer realen Verbindung, aktiviert das Bindungssystem und bildet eine emotionale Abhängigkeit von einer Quelle, die nicht mit Gegenseitigkeit antworten kann (S006).

Personalisierung ist keine Fürsorge. Es ist Wahrnehmungstechnik. Das Gehirn kann auf der Ebene der emotionalen Reaktion nicht zwischen beidem unterscheiden, aber die Konsequenzen sind völlig unterschiedlich.

Diese Fallenarchitektur funktioniert nicht, weil die KI „böse" ist oder Entwickler absichtlich schaden wollen. Sie funktioniert, weil das menschliche Bindungssystem für die Interaktion mit lebenden Wesen evolviert ist, und KI-Begleiter das erste Werkzeug sind, das Bindungssignale mit ausreichender Genauigkeit imitieren kann, um die kritische Bewertung des Gehirns zu umgehen. Das Verständnis dieses Mechanismus ist der erste Schritt, um solche Werkzeuge bewusst zu nutzen, anstatt in ihre Architektur zu geraten.

Datenkonflikte und Unsicherheiten: Wo Studien divergieren und was das für Nutzer bedeutet

Die wissenschaftliche Literatur zu KI-Companions ist nicht monolithisch. Es gibt Bereiche, in denen Quellen einander widersprechen oder fundamentale Limitationen ihrer Schlussfolgerungen einräumen. Mehr dazu im Abschnitt Debunking und Prebunking.

🧩 Widerspruch in der Empathie-Bewertung: Manche Studien zeigen KI-Überlegenheit, andere die Unfähigkeit zu echter Empathie

(S001) dokumentiert Fälle, in denen Patienten KI als empathischer bewerteten als Ärzte. Psychologische Reviews betonen jedoch: Empathie ist nicht nur verbale Muster, sondern auch die Fähigkeit zur Mentalisierung (Verstehen innerer Zustände anderer), die KI nicht besitzt.

Mögliche Erklärung des Widerspruchs: Nutzer bewerten oberflächliche Empathie-Marker (Ton, Formulierungen), nicht aber die Tiefe des Verständnisses. In kurzfristigen Interaktionen reicht das für positive Bewertungen, langfristig kann das Fehlen echter Mentalisierung jedoch zu Leere und Enttäuschung führen.

Empathie auf dem Bildschirm kann überzeugender sein als die Zerstreutheit eines Arztes in der Realität — aber das ist eine Wahrnehmungsfalle, kein Beweis für Hilfequalität.

🕳️ Datenlücke bei Langzeiteffekten: Warum es keine Studien mit Horizont >1 Jahr gibt

Keine der betrachteten Quellen liefert Daten über Konsequenzen der KI-Companion-Nutzung über mehr als 12 Monate. Das ist eine kritische Lücke, weil parasoziale Abhängigkeit und Effekte sozialer Isolation sich gerade langfristig manifestieren.

Mögliche Gründe für das Fehlen solcher Studien: Die Technologie ist zu jung, Finanzierung konzentriert sich auf kurzfristige Validierungen, und langfristige Kohortenstudien erfordern Jahre und erhebliche Ressourcen. Resultat: Wir wissen, was nach einem Monat passiert, aber nicht, was nach einem Jahr geschieht.

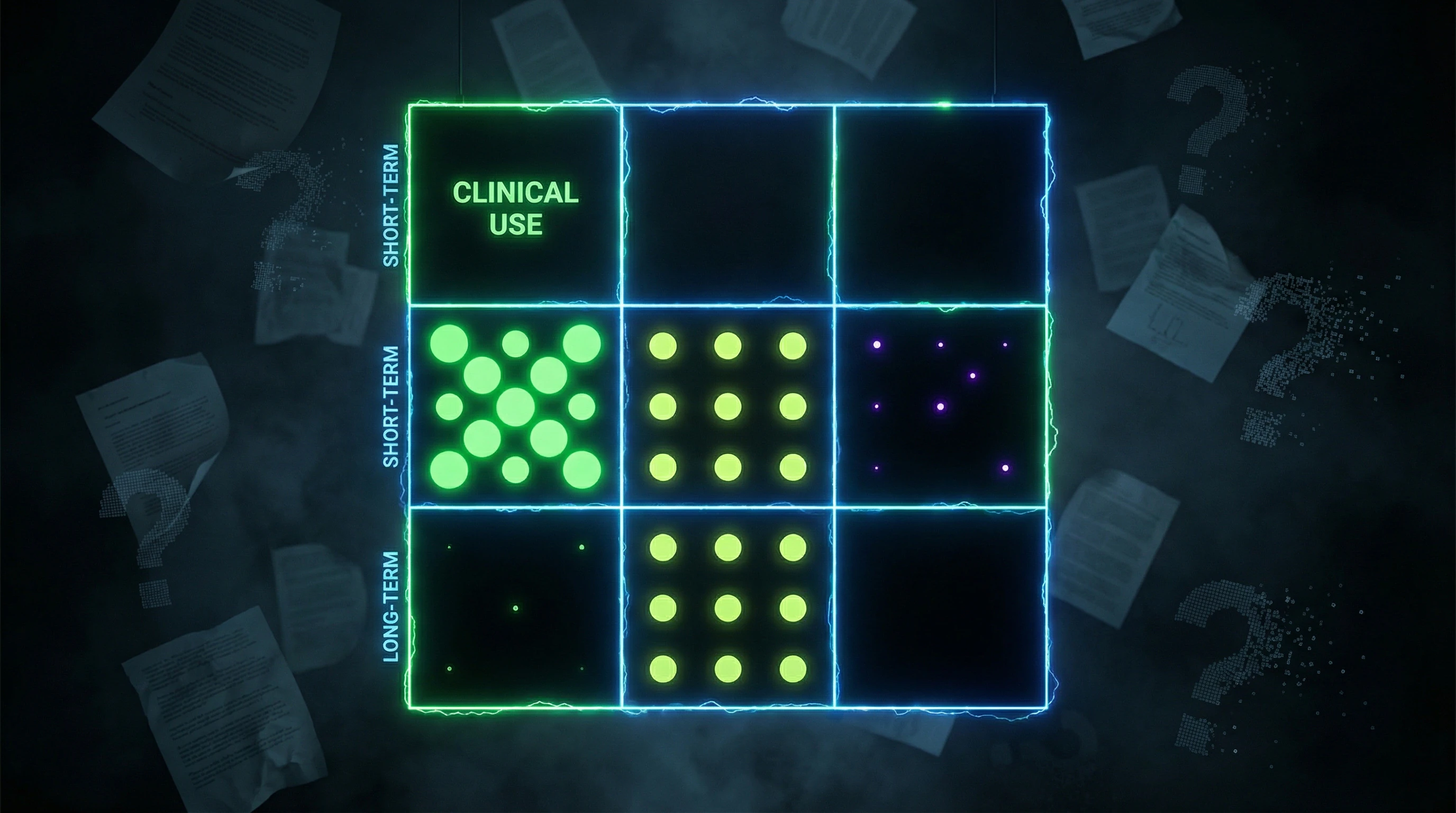

| Zeithorizont | Was bekannt ist | Was unbekannt ist |

|---|---|---|

| 1–4 Wochen | Kurzfristige Stimmungsverbesserung, Einsamkeitsreduktion | Effektstabilität, Gewöhnung |

| 1–6 Monate | Einige Daten zu Adhärenz, erste Abhängigkeitsanzeichen | Kumulative Effekte auf soziale Fähigkeiten, reale Beziehungen |

| 6–12 Monate | Einzelne Studien, widersprüchliche Ergebnisse | Langfristige psychologische Anpassung, Entzug |

| >12 Monate | Praktisch keine Daten | Alles |

🔀 Streuung in der Definition von „Abhängigkeit": Wenn eine Quelle ein Problem sieht, eine andere Normalität

(S004) und (S005) verwenden unterschiedliche Kriterien zur Bewertung des Abhängigkeitsrisikos. Eine fokussiert auf Nutzungshäufigkeit, eine andere auf funktionalen Schaden (Verdrängung realer Beziehungen), eine dritte auf subjektives Kontrollgefühl.

Das ist nicht nur ein methodologischer Unterschied — es bedeutet, dass derselbe Nutzer in einer Studie als „Risikogruppe" klassifiziert werden kann und in einer anderen als „normaler Nutzer". Für die Praxis schafft das Unsicherheit: Es gibt keinen Konsens darüber, wann KI-Companion-Nutzung von nützlich zu gefährlich wird.

⚡ Konflikt zwischen kurzfristigem Nutzen und langfristigem Risiko

(S001) und (S006) dokumentieren reale Linderung von Depressions- und Angstsymptomen in den ersten Nutzungswochen. Aber (S002) und (S003) zeigen, dass soziale Deprivation (selbst wenn subjektiv komfortabel) mit langfristigem Schaden für Entwicklung und psychische Gesundheit verbunden ist, besonders bei Jugendlichen.

Paradox: Ein KI-Companion kann gleichzeitig helfen (akuten Schmerz lindern) und schaden (Entwicklung realer sozialer Fähigkeiten ersetzen). Studien lösen diesen Konflikt nicht auf, weil sie Nutzer nicht lange genug begleiten.

- Was das für Nutzer bedeutet

- Kurzfristige Erleichterung kann real sein, aber sie kann langfristige Verschlechterung maskieren. Die Entscheidung zur KI-Companion-Nutzung erfordert nicht nur Bewertung des aktuellen Zustands, sondern auch eine ehrliche Prognose: Wird das eine Brücke zu realen Beziehungen oder ein Ersatz?

🎯 Unsicherheit bezüglich Zielgruppen: Für wen sind KI-Companions wirklich sicher?

Die meisten Studien werden mit Erwachsenen mit leichter oder moderater Depression durchgeführt. Daten zu Jugendlichen, älteren Menschen, Menschen mit schweren psychischen Störungen oder mit Abhängigkeitshistorie fehlen praktisch. Das bedeutet, wir wissen nicht, ob KI-Companions für die meisten realen Nutzer sicher sind.

Besonders beunruhigend ist das Fehlen von Daten zu Jugendlichen, angesichts (S002) und (S003) über die Sensibilität des jugendlichen Gehirns für soziale Deprivation. Wenn ein KI-Companion reale Beziehungen gerade in der kritischen Entwicklungsphase ersetzt, können die Konsequenzen gravierender sein als bei Erwachsenen.

📊 Was tun mit dieser Unsicherheit

- Verwechseln Sie kurzfristige Erleichterung nicht mit langfristiger Lösung. Wenn ein KI-Companion hilft, nutzen Sie diese Zeit zur Entwicklung realer Beziehungen, nicht zu deren Ersatz.

- Verfolgen Sie funktionalen Schaden, nicht nur subjektives Wohlbefinden. Die Frage ist nicht „fühle ich mich besser?", sondern „entwickle ich reale soziale Fähigkeiten oder verliere ich sie?"

- Seien Sie besonders vorsichtig, wenn Sie Jugendlicher, älterer Mensch sind oder eine Abhängigkeitshistorie haben. Für Sie sind Sicherheitsdaten noch begrenzter.

- Fordern Sie von Entwicklern Langzeitstudien. Wenn ein Produkt als Hilfe bei psychischen Störungen positioniert wird, müssen Daten darüber vorliegen, was nach einem Jahr passiert, nicht nur nach einem Monat.

Datenkonflikte sind nicht nur ein akademisches Problem. Sie bedeuten, dass Sie Entscheidungen über KI-Companion-Nutzung unter unvollständiger Information treffen. Ehrliche Position: Das ist normal, aber man muss es anerkennen.

Zusätzlicher Kontext: siehe mentale Fehler, die uns anfällig für Überbewertung kurzfristiger Wohlbefindenssignale machen.