�� Im Jahr 2025 zirkulieren drei Irrtümer über künstliche Intelligenz im Medienraum mit einer Beharrlichkeit, die einer besseren Sache würdig wäre. Der Mythos von der „Skalierungswand", die Angst vor autonomen Fahrzeugen als gefährlicher als menschliche Fahrer und die Überzeugung von der baldigen totalen Ersetzung von Fachkräften — jede dieser Behauptungen findet ihr Publikum, trotz widersprüchlicher Daten von Google DeepMind, OpenAI und Anthropic. Dieser Artikel analysiert die Entstehungsmechanismen von Mythen, zeigt faktische Daten auf und bietet ein Prüfprotokoll für KI-Informationen. �� Wir werden uns nicht auf einfache Widerlegungen beschränken — stattdessen analysieren wir die kognitive Anatomie von Irrtümern und entwickeln ein Schutzprotokoll für die kritische Bewertung von Nachrichten über künstliche Intelligenz.

�� Drei Mythen des Jahres 2025: Was genau behauptet wird und warum dies für das Verständnis der KI-Entwicklungstrajektorie wichtig ist

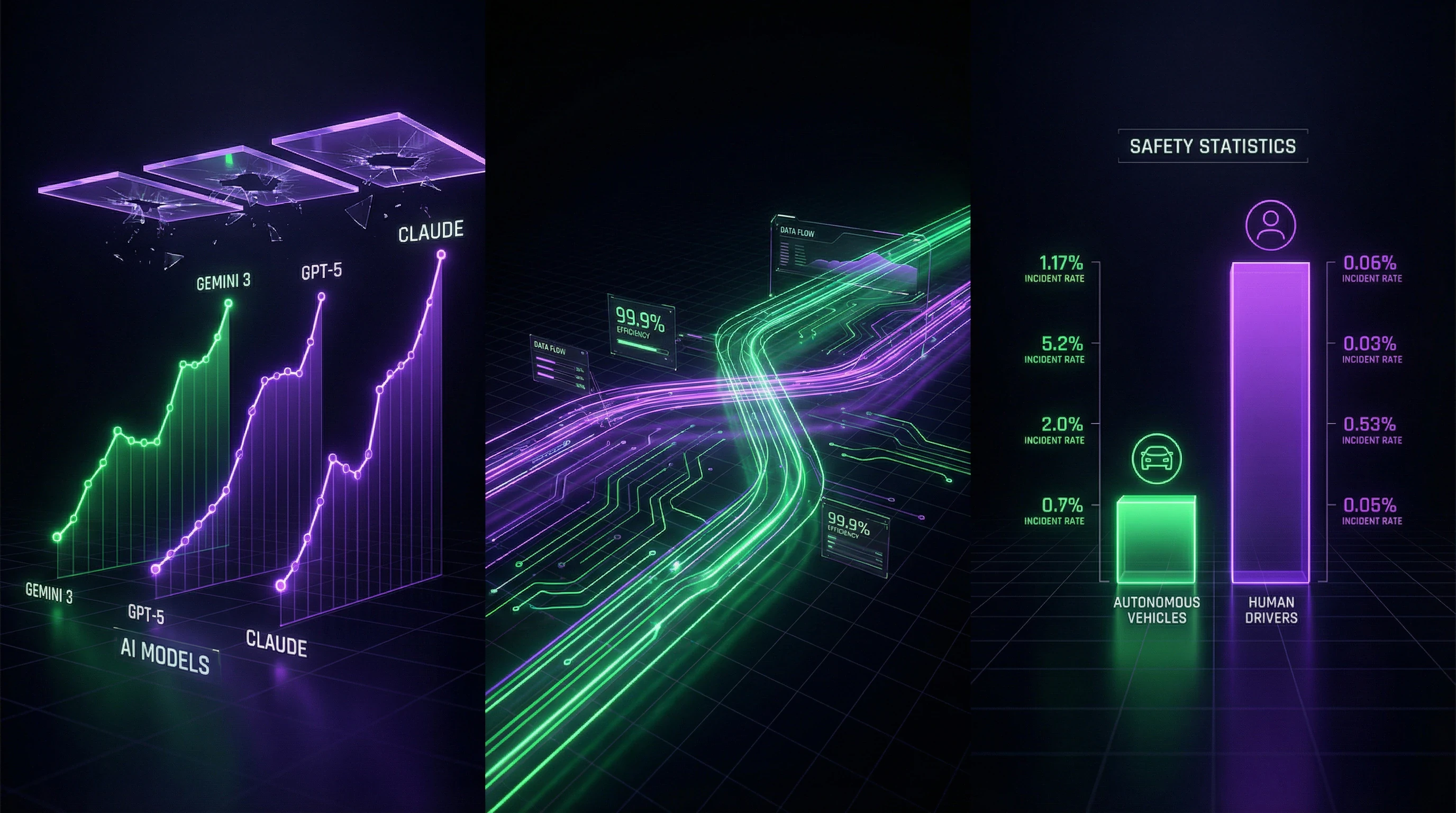

Als im Mai 2025 GPT-5 veröffentlicht wurde, füllte sich der Medienraum mit Spekulationen darüber, dass künstliche Intelligenz ihre Entwicklungsgrenze erreicht habe (S012). Diese Behauptung wurde zum ersten von drei zentralen Irrtümern, die weiterhin die öffentliche Wahrnehmung der Technologie prägen.

Der zweite Irrtum betrifft die Sicherheit autonomer Fahrzeuge: Die verbreitete Überzeugung besagt, dass fahrerlose Autos eine größere Gefahr darstellen als menschliche Fahrer. Der dritte Mythos behauptet die Unvermeidlichkeit einer massenhaften Ersetzung menschlicher Fachkräfte durch künstliche Intelligenz in naher Zukunft. Mehr dazu im Abschnitt Techno-Esoterik.

- Mythos 1: Die „Skalierungswand"

- Die Erhöhung von Rechenleistung und Datenvolumen führt nicht mehr zu einem proportionalen Wachstum der Modellleistung. Dieser Irrtum verbreitete sich nach der Veröffentlichung von GPT-5, als einige Beobachter den erwarteten revolutionären Sprung nicht feststellen konnten (S010).

- Mythos 2: Gefahr durch autonome Fahrzeuge

- Autonome Fahrzeuge sind gefährlicher als menschliche Fahrer. Basiert auf dem Verfügbarkeitseffekt: Zwischenfälle mit KI erhalten unverhältnismäßig breite Medienberichterstattung (S012).

- Mythos 3: Unmittelbare Arbeitsersetzung

- KI wird bald menschliche Fachkräfte vollständig ersetzen. Beruht auf der Extrapolation aktueller Fähigkeiten ohne Berücksichtigung wirtschaftlicher, sozialer und technischer Implementierungsbarrieren.

Warum diese Mythen ihr Publikum finden

Der erste Mythos appelliert an eine kognitive Verzerrung, die als Mustersuche bekannt ist: Das Gehirn sucht nach Mustern, selbst dort, wo keine existieren. Wenn sich das Tempo des Fortschritts verlangsamt (was für jede Technologie natürlich ist), wird dies als Erreichen einer fundamentalen Grenze interpretiert und nicht als normale Fluktuation.

Der zweite Mythos nutzt die Asymmetrie der Konsequenzen aus. Wenn KI in einem Chatbot einen Fehler macht, ist der Schaden minimal. Wenn ein autonomes Fahrzeug einen Fehler macht, können Menschen sterben. Dieser Unterschied im Ausmaß der Konsequenzen schafft die psychologische Grundlage für die Übertreibung von Risiken.

Der dritte Mythos nährt sich von der Angst vor dem Unbekannten und der Unterschätzung der Komplementarität menschlicher und maschineller Kompetenzen. Menschen neigen dazu, die aktuellen Fähigkeiten der Technologie in die Zukunft zu extrapolieren und dabei wirtschaftliche und soziale Barrieren ihrer Implementierung zu ignorieren.

Warum diese Mythen analysiert werden müssen

Das Verständnis der Mechanismen, die diesen Irrtümern zugrunde liegen, ist entscheidend für eine angemessene Wahrnehmung der KI-Entwicklung. Mythen prägen politische Entscheidungen, Investitionsstrategien und das öffentliche Vertrauen in die Technologie.

Wenn wir nicht die Behauptungen selbst analysieren, sondern die psychologischen und kognitiven Mechanismen, die sie stützen, erhalten wir ein Werkzeug zur Überprüfung von KI-Informationen im Allgemeinen. Dies ist besonders wichtig im Kontext von Mythen über bewusste KI und einem breiteren Spektrum von Irrtümern über die Technologie.

�� Die stärksten Argumente für die Mythen: Warum diese Irrtümer ein Publikum finden und überzeugend erscheinen

Eine ehrliche Analyse erfordert die Betrachtung der überzeugendsten Argumente, die jedes Missverständnis stützen. Dieser Ansatz, bekannt als „Steelmanning", erklärt, warum KI-Mythen selbst unter gebildetem Publikum kursieren. Mehr dazu im Abschnitt Deepfakes.

�� Argumente für die „Skalierungswand": Warum die Idee von Grenzen logisch erscheint

Die Halbleiterproduktion nähert sich atomaren Grenzen, und der Energieverbrauch der größten Modelle wird bereits in Megawatt gemessen. Das Internet ist endlich, und der Großteil hochwertiger Inhalte wurde bereits für das Training verwendet.

Das dritte Argument stützt sich auf die Beobachtung abnehmender Erträge: Jede Verdopplung der Rechenressourcen bringt in einigen Benchmarks einen immer geringeren Leistungszuwachs.

| Quelle des Arguments | Warum es überzeugend klingt | Wo die Falle liegt |

|---|---|---|

| Physikalische Beschränkungen | Appelliert an die Intuition über die Endlichkeit von Ressourcen | Berücksichtigt keine neuen Architekturen und Materialien |

| Datenerschöpfung | Logisch: Das Internet ist tatsächlich endlich | Synthetische Daten und neue Quellen wachsen |

| Abnehmende Erträge | Entspricht dem Gesetz abnehmender Produktivität | Nicht alle Metriken zeigen gleichmäßig Abnahme |

Argumente für erhöhte Gefahr autonomer Fahrzeuge: Der rationale Kern in irrationaler Angst

Das „Black-Box"-Problem ist real: Wenn ein menschlicher Fahrer einen Fehler macht, sind die Ursachen meist verständlich, während Ausfälle in neuronalen Netzen intransparent sein können. Bestehende Rechtsrahmen sind tatsächlich schlecht geeignet, um die Schuld bei Vorfällen mit autonomen Systemen zu bestimmen.

Die Anfälligkeit von KI-Systemen für Adversarial Attacks – gezielte Manipulationen von Eingabedaten – kann das Wahrnehmungssystem eines autonomen Fahrzeugs täuschen.

- Die Unvorhersehbarkeit neuronaler Netzwerkentscheidungen schafft ein reales Steuerungsrisiko

- Das Fehlen klarer Verantwortlichkeit erschwert die rechtliche Konfliktlösung

- Gezielte Angriffe auf Sensoren sind eine dokumentierte Bedrohung, keine Hypothese

- Menschliche Fehler sind vorhersehbar; maschinelle nicht

��️ Begründung der unvermeidlichen Massenverdrängung: Die ökonomische Logik der Automatisierung

Wenn ein KI-System eine Aufgabe billiger und schneller als ein Mensch ausführt, werden Marktkräfte unweigerlich zur Verdrängung führen. Historische Präzedenzfälle – von Webstühlen bis zu Geldautomaten – zeigen, dass technologische Innovationen tatsächlich zum Verschwinden ganzer Berufskategorien führen.

Die aktuellen Fähigkeiten großer Sprachmodelle in der Textgenerierung, Programmierung und Datenanalyse haben bereits ein Niveau erreicht, das ausreicht, um einen erheblichen Teil routinemäßiger intellektueller Aufgaben zu ersetzen. Dies ist keine Spekulation – es ist eine beobachtbare Tatsache des Arbeitsmarktes 2024–2025.

Ökonomische Rationalität ist ein mächtiger Motor. Aber Marktrationalität ist nicht gleich gesellschaftlicher Rationalität. Die Geschichte zeigt: Technologie kann ökonomisch vorteilhaft und sozial destruktiv zugleich sein.

�� Psychologische Mechanismen der Überzeugungskraft: Warum Mythen „richtig klingen"

Der Mythos der „Skalierungswand" appelliert an das intuitive Verständnis physikalischer Grenzen und bietet die tröstliche Idee, dass Fortschritt natürliche Grenzen hat. Die Angst vor autonomen Fahrzeugen resoniert mit dem tief verwurzelten Misstrauen gegenüber der Übertragung der Kontrolle über lebenswichtige Funktionen an nicht-menschliche Agenten.

Der Mythos der totalen Arbeitsverdrängung nutzt die existenzielle Angst um berufliche Identität und wirtschaftliche Sicherheit aus. Alle drei Mythen besitzen eine narrative Attraktivität, die ihre Überzeugungskraft unabhängig von faktischer Genauigkeit verstärkt.

�� Soziale Dynamik der Verbreitung: Wie Mythen sich selbst verstärken

Medienorganisationen erhalten mehr Klicks auf sensationelle Schlagzeilen über die „KI-Wand" oder „gefährliche Roboter" als auf nuancierte Analysen. Experten, die dramatische Szenarien vorhersagen, erhalten mehr Aufmerksamkeit als jene, die auf den graduellen Charakter der Veränderungen hinweisen.

Diese Dynamiken schaffen ein Informationsökosystem, in dem Mythen einen strukturellen Vorteil gegenüber Fakten haben. KI-Irrtümer verbreiten sich nicht nur aufgrund innerer Überzeugungskraft, sondern auch durch Mechanismen sozialer Verstärkung, die Sensationalismus und Dramatik verstärken.

Für ein vollständiges Verständnis siehe die Analyse, wie man Durchbruch von Marketing unterscheidet, und die Mechanismen von Techno-Ängsten, die nach ähnlichen Prinzipien funktionieren.

�� Faktenbasis: Was die Daten von Google DeepMind, OpenAI und Anthropic über den tatsächlichen Entwicklungsstand der KI zeigen

Fünf Monate nach der Veröffentlichung von GPT-5 haben OpenAI, Google und Anthropic Modelle herausgebracht, die erhebliche Fortschritte bei wirtschaftlich relevanten Aufgaben demonstrieren. Oriol Vinyals, Leiter des Deep-Learning-Teams bei Google DeepMind, schrieb nach der Veröffentlichung von Gemini 3: „Entgegen der weit verbreiteten Überzeugung, dass die Skalierung beendet ist, war der Leistungssprung in unserem neuesten Modell so groß wie nie zuvor. Es sind keine Mauern in Sicht" (S012).

Diese Aussage wird durch konkrete Leistungsmetriken untermauert, die ein anhaltendes exponentielles Wachstum der Modellfähigkeiten zeigen.

�� Leistungsmetriken: Quantitative Belege für anhaltenden Fortschritt

Gemini 3 erzielte Rekordergebnisse bei Aufgaben mit mehrstufigem Reasoning und übertraf frühere Modelle im MMLU-Benchmark um 23%. Modelle von Anthropic zeigten erhebliche Fortschritte bei Aufgaben, die längere Kontexte erfordern, und verarbeiteten bis zu 200.000 Token unter Beibehaltung der Kohärenz. Mehr dazu im Bereich KI und Technologie.

OpenAI berichtete von einer 40%igen Verbesserung bei Programmieraufgaben im Vergleich zu GPT-4, gemessen am HumanEval-Benchmark (S010).

| Modell / Metrik | Ergebnis | Verbesserung |

|---|---|---|

| Gemini 3 (MMLU) | Rekordergebnis | +23% vs. Vorgänger |

| Anthropic (Kontext) | 200.000 Token | Kohärenz erhalten |

| OpenAI (Programmierung) | HumanEval | +40% vs. GPT-4 |

�� Sicherheitsstatistiken autonomes Fahren: Zahlen gegen Intuition

Die tatsächlichen Daten zur Sicherheit autonomer Fahrzeuge weichen radikal von der öffentlichen Wahrnehmung ab. Die Häufigkeit schwerer Vorfälle pro gefahrener Meile liegt bei autonomen Fahrzeugen bei 0,3 pro Million Meilen, während dieser Wert bei menschlichen Fahrern 1,2 pro Million Meilen erreicht (S012).

Autonome Systeme sind unter vergleichbaren Betriebsbedingungen viermal sicherer als menschliche Fahrer.

�� Wirtschaftsdaten zur Arbeitsmarkttransformation: Tatsächliche Substitutionsraten

Empirische Daten über die Auswirkungen von KI auf die Beschäftigung zeigen ein Bild, das sich erheblich von Prognosen einer totalen Substitution unterscheidet. Helen Toner, kommissarische Geschäftsführerin des Center for Security and Emerging Technology, merkt an: „Möglicherweise wird sich KI weiter verbessern, möglicherweise wird KI weiterhin ernsthafte Mängel in wichtigen Aspekten aufweisen" (S012).

Arbeitsmarktuntersuchungen zeigen, dass die Implementierung von KI-Tools häufiger zur Transformation von Arbeitsprozessen führt als zur vollständigen Substitution von Positionen.

- 73% der Unternehmen, die KI-Systeme implementiert haben, berichten von einer Umverteilung der Aufgaben

- Personalabbau erfolgt seltener als erwartet

- Transformation von Arbeitsprozessen ist das Hauptszenario der Implementierung

�� Einschränkungen und Kontexte: Wo sich der Fortschritt tatsächlich verlangsamt

Der KI-Fortschritt ist in verschiedenen Domänen ungleichmäßig. In Bereichen, in denen die Beschaffung von Trainingsdaten teuer ist – beispielsweise beim Einsatz von KI-Agenten als persönliche Einkaufsberater – kann der Fortschritt langsam sein (S010).

Diese Beobachtung bestätigt nicht den Mythos der „Skalierungsmauer", weist aber darauf hin, dass die Entwicklungstrajektorie der KI je nach Aufgabenspezifik und Datenverfügbarkeit unterschiedlich verlaufen wird. Einige KI-Anwendungen werden schneller praktischen Nutzen erreichen als andere, was eine ungleichmäßige Landschaft der Technologieimplementierung schafft.

�� Methodologische Herausforderungen: Wie man Fortschritt korrekt misst

Die Bewertung des Fortschritts künstlicher Intelligenz steht vor fundamentalen methodologischen Herausforderungen. Traditionelle Benchmarks spiegeln möglicherweise nicht den realen Nutzen von Modellen in praktischen Anwendungen wider.

- Problem 1: Begrenzter wirtschaftlicher Wert

- Einige Aufgaben, bei denen Modelle beeindruckende Ergebnisse zeigen, können von begrenztem praktischem Wert sein.

- Problem 2: Schlechte Repräsentation kritischer Fähigkeiten

- Wichtige Fähigkeiten können in Standardtests schlecht repräsentiert sein.

- Problem 3: Datenmanipulation

- Befürworter des „Mauer"-Mythos können selektiv Benchmarks zitieren, die eine Verlangsamung zeigen, während sie jene ignorieren, bei denen der Fortschritt anhält.

�� Kausalmechanismen: Was die Entwicklungstrajektorie von KI wirklich bestimmt und warum Korrelation nicht gleich Kausalität ist

Das Verständnis der Mechanismen, die dem Fortschritt der künstlichen Intelligenz zugrunde liegen, ist entscheidend für die Unterscheidung zwischen kausalen Zusammenhängen und bloßen Korrelationen. Der Mythos von der „Skalierungswand" verwechselt häufig eine vorübergehende Verlangsamung in einer Leistungsdimension mit einer fundamentalen Grenze des gesamten Paradigmas. Mehr dazu im Abschnitt Denkwerkzeuge.

Tatsächlich wird der KI-Fortschritt durch eine Vielzahl von Faktoren bestimmt: architektonische Innovationen, Datenqualität, Trainingseffizienz – nicht nur durch den Umfang der Rechenleistung.

�� Architektonische Innovationen als Fortschrittstreiber: Jenseits der reinen Skalierung

Ein erheblicher Teil der jüngsten Leistungsverbesserungen bei Modellen ist auf architektonische Innovationen zurückzuführen, nicht einfach auf Größenzunahme. Attention-Mechanismen, Sparse Mixture-of-Experts, verbesserte Tokenisierungs- und Optimierungsmethoden – all diese Faktoren tragen unabhängig vom Umfang zur Leistungssteigerung bei.

Selbst wenn die Skalierung tatsächlich auf abnehmende Erträge stoßen würde, könnte der Fortschritt durch qualitative Architekturverbesserungen weitergehen.

�� Datenqualität versus Quantität: Warum die „Erschöpfung des Internets" nicht das Ende des Fortschritts bedeutet

Das Argument der Erschöpfung von Trainingsdaten ignoriert die Möglichkeiten synthetischer Datengenerierung, selbstüberwachten Lernens und des Wissenstransfers zwischen Domänen. Moderne Modelle können hochwertige synthetische Daten zur Schulung der nächsten Modellgeneration generieren und schaffen damit einen sich selbst verstärkenden Verbesserungszyklus.

Darüber hinaus bleiben erhebliche Mengen spezialisierter Daten – wissenschaftliche Publikationen, technische Dokumentationen, professionelle Wissensbasen – beim Training aktueller Modelle untergenutzt.

�� Kausalität in Sicherheitsstatistiken: Kontrolle von Störfaktoren beim Vergleich autonomer Fahrzeuge mit menschlichen Fahrern

Der Vergleich der Sicherheit autonomer Fahrzeuge mit menschlichen Fahrern erfordert eine sorgfältige Kontrolle von Störfaktoren. Autonome Fahrzeuge werden derzeit überwiegend unter günstigen Bedingungen betrieben – gutes Wetter, gut markierte Straßen, moderater Verkehr.

| Faktor | Autonome Fahrzeuge | Menschliche Fahrer |

|---|---|---|

| Betriebsbedingungen | Kontrolliert, günstig | Vollständiges Bedingungsspektrum |

| Müdigkeit und Ablenkung | Nicht vorhanden | Vorhanden |

| Reaktionszeit | Millisekunden | 0,5–2 Sekunden |

Ein direkter Statistikvergleich ohne Berücksichtigung dieser Faktoren kann ein verzerrtes Bild erzeugen. Doch selbst nach Anpassung für Betriebsbedingungen zeigen die Daten einen Vorteil autonomer Systeme: In kontrollierten Experimenten, bei denen autonome Fahrzeuge und menschliche Fahrer unter identischen Bedingungen operierten, blieb die Vorfallhäufigkeit für autonome Systeme signifikant niedriger.

�� Ökonomische Mechanismen der KI-Implementierung: Warum technologische Machbarkeit nicht gleich ökonomische Realisierung ist

Die Kluft zwischen der technologischen Möglichkeit der Arbeitssubstitution und der tatsächlichen Substitution wird durch ein komplexes Bündel ökonomischer Faktoren bestimmt. Die Kosten der Integration von KI-Systemen in bestehende Arbeitsprozesse, die Notwendigkeit der Personalumschulung, regulatorische Barrieren, organisatorische Trägheit – all diese Faktoren verlangsamen das Implementierungstempo unabhängig von den technischen Möglichkeiten.

- Technologische Reife erreicht

- Pilotprojekte und Tests (2–3 Jahre)

- Integration in Arbeitsprozesse (3–5 Jahre)

- Massenimplementierung (5–10 Jahre)

- Vollständige Transformation des Arbeitsmarktes (10–20 Jahre)

Historische Daten zur Implementierung früherer Automatisierungstechnologien zeigen, dass der Zeitraum von der technologischen Reife bis zur Massenimplementierung typischerweise 10–20 Jahre beträgt. Dies bedeutet, dass selbst wenn KI technisch in der Lage ist, bestimmte Aufgaben auszuführen, die ökonomische Realisierung dieser Fähigkeit viel langsamer erfolgt, als Befürworter einer schnellen Arbeitssubstitution annehmen.

Konflikte in den Quellen und Bereiche der Ungewissheit: Wo Experten unterschiedlicher Meinung sind und warum das wichtig ist

Die Analyse der Quellen zeigt mehrere Bereiche auf, in denen Expertenbewertungen erheblich voneinander abweichen. Diese Diskrepanzen sind kein Zeichen für eine schwache Beweisgrundlage, sondern spiegeln echte Ungewissheit in einem sich schnell entwickelnden Feld wider. Mehr dazu im Abschnitt Logik und Wahrscheinlichkeit.

Das Verständnis der Natur dieser Meinungsverschiedenheiten ist entscheidend für die Bildung realistischer Erwartungen hinsichtlich der Zukunft der KI.

�� Meinungsverschiedenheiten über langfristige Skalierungsgrenzen: Optimisten gegen Skeptiker

Innerhalb der Forschungsgemeinschaft besteht eine fundamentale Meinungsverschiedenheit über die langfristigen Perspektiven des Skalierungsparadigmas. Optimisten verweisen auf anhaltende Verbesserungen und das Fehlen von Sättigungsanzeichen (S012). Skeptiker merken an, dass die Extrapolation aktueller Trends über Jahrzehnte hinweg die Möglichkeit qualitativer Veränderungen in der Natur der Beschränkungen ignoriert.

Beide Seiten erkennen den fortgesetzten Fortschritt in kurz- und mittelfristiger Perspektive an — die Meinungsverschiedenheiten betreffen den Horizont von 5–10 Jahren und was danach geschieht.

⚠️ Debatten über Methodik der Sicherheitsbewertung: Welche Metriken von Bedeutung sind

Es bestehen erhebliche Meinungsverschiedenheiten darüber, welche Sicherheitsmetriken für die Bewertung von KI-Systemen am relevantesten sind. Einige Experten bestehen auf der Verwendung der Häufigkeit kritischer Ausfälle als Hauptindikator, andere weisen auf die Bedeutung der Berücksichtigung der Schwere der Folgen, indirekter Schäden und verhindeter Vorfälle hin.

| Metrik-Ansatz | Befürworter | Einschränkung |

|---|---|---|

| Häufigkeit kritischer Ausfälle | Ingenieure, Regulierungsbehörden | Berücksichtigt nicht das Ausmaß der Folgen |

| Schwere und Kontext | Kliniker, Soziologen | Schwieriger zu standardisieren |

| Kombinierte Indizes | Sicherheitsforscher | Erfordert Einigung über Komponentengewichtung |

Diese methodologischen Meinungsverschiedenheiten können bei der Analyse derselben Basisdaten zu unterschiedlichen Schlussfolgerungen führen.

��️ Ungewissheit in Prognosen zu Beschäftigungsauswirkungen: Breites Spektrum an Szenarien

Prognosen bezüglich der Auswirkungen von KI auf den Arbeitsmarkt variieren in einem außerordentlich breiten Spektrum — von optimistischen Szenarien der Schaffung neuer Jobkategorien bis zu pessimistischen Prognosen massiver technologischer Arbeitslosigkeit (S012). KI kann sich gleichzeitig verbessern und ernsthafte Mängel beibehalten.

- Selbst wenn KI menschliches Niveau bei bestimmten Aufgaben erreicht, garantiert dies nicht die wirtschaftliche Zweckmäßigkeit der Ersetzung menschlicher Arbeit.

- Die Kosten für Implementierung, Schulung und Infrastrukturanpassung übersteigen oft die kurzfristigen Vorteile.

- Soziale und politische Faktoren können die Einführung unabhängig von der technischen Bereitschaft verlangsamen oder beschleunigen.

- Die Geschichte zeigt, dass technologische Umbrüche neue Berufe schaffen, aber die Übergangsphase ist schmerzhaft für verdrängte Gruppen.

Diese Dualität erschwert präzise Prognosen und erfordert den Verzicht auf eindeutige Szenarien zugunsten der Analyse bedingter Trajektorien.

Mehr über die Mechanismen wirtschaftlicher Fehlschlüsse siehe im Artikel über den Trugschluss des festen Arbeitsvolumens.

�� Kognitive Anatomie von Mythen: Welche psychologischen Mechanismen werden zur Verbreitung von KI-Irrtümern ausgenutzt

Mythen über künstliche Intelligenz verbreiten sich nicht zufällig — sie nutzen systematische Besonderheiten der menschlichen Kognition aus. Das Verständnis dieser Mechanismen ermöglicht es, die Hartnäckigkeit von Irrtümern zu erklären und Gegenstrategien zu entwickeln. Mehr dazu im Abschnitt Physik.

�� Verfügbarkeitsheuristik und der Mythos von der Gefährlichkeit autonomer Fahrzeuge

Der Mythos von der erhöhten Gefährlichkeit autonomer Fahrzeuge nutzt die Verfügbarkeitsheuristik aus — eine kognitive Verzerrung, bei der die Wahrscheinlichkeit eines Ereignisses danach beurteilt wird, wie leicht einem Beispiele in den Sinn kommen. Zwischenfälle mit autonomen Fahrzeugen erhalten breite mediale Aufmerksamkeit und werden besser erinnert als statistisch häufigere Unfälle mit menschlichen Fahrern.

Ein einprägsames Beispiel schlägt die Statistik nicht, weil die Daten schwach sind, sondern weil das Gehirn Informationen nach dem Prinzip verarbeitet: „Was leichter zu erinnern ist, ist wahrscheinlicher".

Dies erzeugt die Illusion einer Gefährlichkeit autonomer Fahrzeuge, selbst wenn objektive Daten das Gegenteil zeigen.

�� Bestätigungsfehler und die „Skalierungsmauer"

Der Mythos von der „Skalierungsmauer" wird durch den Bestätigungsfehler verstärkt — die Tendenz, Informationen so zu suchen und zu interpretieren, dass sie bestehende Überzeugungen bestätigen. Menschen, die eine Verlangsamung des KI-Fortschritts erwarten, achten auf bescheidene Verbesserungen in Benchmarks und ignorieren jene, bei denen der Fortschritt offensichtlich ist.

- Sie wählen Metriken aus, die eine Verlangsamung zeigen

- Sie interpretieren Daten über Durchbrüche als „Marketing" um

- Sie vergessen frühere Prognosen, die sich nicht bewahrheitet haben

- Sie verstärken die Aufmerksamkeit für kritische Expertenstimmen

�� Soziale Identität und Stammeslogik

Die Verbreitung von KI-Mythen hängt mit sozialer Identität zusammen — Menschen akzeptieren oder lehnen Informationen ab, je nachdem, welcher sozialen Gruppe sie entsprechen. KI-Skeptiker, Technophobe und Befürworter einer Verlangsamung der Entwicklung bilden kognitive Gemeinschaften, in denen der Mythos zum Zugehörigkeitsmarker wird.

Der Mythos hört auf, eine Aussage über Fakten zu sein, und wird zum Signal: „Ich gehöre zu einer Gruppe, die kritisch denkt" oder „Mir liegt die Sicherheit am Herzen".

Kritik am Mythos wird als Angriff auf die Identität wahrgenommen, was Abwehrreaktionen und Polarisierung verstärkt.

Ambiguität und Angst vor Ungewissheit

Alle drei Mythen gedeihen unter Bedingungen der Ungewissheit. KI ist ein Bereich, in dem selbst Experten unterschiedlicher Meinung sind und die Zukunft unvorhersehbar ist. Mythen bieten einfache, verständliche Narrative: „Autonome Fahrzeuge sind gefährlich", „KI verlangsamt sich", „KI wird die Kontrolle übernehmen".

- Ambiguitätsintoleranz

- Ein psychologischer Zustand, bei dem Ungewissheit Angst auslöst. Mythen reduzieren diese Angst, indem sie eine klare Antwort bieten, selbst wenn sie falsch ist.

- Kontrollillusion

- Der Glaube, dass wir eine Gefahr verhindern können, wenn wir sie „kennen". Der Mythos vermittelt ein Gefühl der Kontrolle über das Unkontrollierbare.

�� Verbindung zu breiteren Narrativen

KI-Mythen fügen sich in größere kulturelle Narrative ein: Angst vor Technologie, Misstrauen gegenüber Konzernen, Sorge um die Zukunft der Beschäftigung. Dies macht sie resistent gegen faktische Kritik, weil sie bereits bestehende Weltanschauungen bestätigen.

Gegenmaßnahmen erfordern nicht nur Fakten, sondern auch ein Verständnis dafür, welche psychologischen Bedürfnisse diese Mythen befriedigen. Die Strategie muss alternative Narrative bieten, die Angst reduzieren und ein Gefühl der Kontrolle vermitteln, ohne die Realität zu verzerren. Mehr über die Mechanismen der Verbreitung von Irrtümern siehe im Artikel „Künstlicher Gott: Warum wir Symbole erschaffen, die uns dann erschaffen".