Physiognomik und KI: Was Nutzer genau suchen und warum diese Anfrage ein Indikator für ein kritisches Problem des akademischen Ökosystems ist

Die Suchanfrage „pdf physiognomy in the age of ai researchgate" spiegelt den Versuch wider, akademische Arbeiten zu finden, die die alte Praxis der Physiognomik mit modernen Technologien der künstlichen Intelligenz verbinden. Physiognomik ist ein diskreditiertes Glaubenssystem, das behauptet, dass die Gesichtszüge eines Menschen seinen Charakter, seine Intelligenz, kriminelle Neigungen oder moralische Eigenschaften offenbaren können. Mehr dazu im Abschnitt Deepfake-Erkennung.

Historisch wurde diese Praxis zur Rechtfertigung von Rassentrennung, Eugenik und Diskriminierung eingesetzt (S007). Heute kehrt sie nicht in Form offener Manifeste zurück, sondern getarnt als algorithmische Objektivität.

⚠️ Was die moderne „digitale Physiognomik" im KI-Kontext darstellt

Im Zeitalter des maschinellen Lernens erhielt die Physiognomik neues Leben durch Gesichtserkennungsalgorithmen, die angeblich in der Lage sind, Persönlichkeitsmerkmale, sexuelle Orientierung, politische Ansichten oder Neigung zu Verbrechen auf Basis der Analyse von Fotografien zu bestimmen (S001).

Diese Systeme tarnen sich als „objektive Datenanalyse", verwenden die Terminologie neuronaler Netze und statistischer Signifikanz, reproduzieren aber im Kern dieselben diskreditierten Annahmen über die Verbindung zwischen Äußerem und inneren Eigenschaften. Biometrische Erkennung wird zum Instrument, durch das alte Vorurteile einen neuen legitimen Status erhalten.

- Digitale Physiognomik

- Einsatz von Computer-Vision-Algorithmen zur Ableitung von Persönlichkeits- oder Verhaltensmerkmalen auf Basis von Gesichtsanalysen. Gefährlich, weil das technologische Ambiente das Fehlen kausaler Zusammenhänge zwischen Äußerem und inneren Eigenschaften verbirgt.

- ResearchGate als Verbreitungsvektor

- Die Plattform erzeugt den Anschein akademischer Legitimität für Arbeiten, die kein strenges Peer-Review durchlaufen haben. Ein dort hochgeladener Preprint erhält allein durch die Platzierung unter Millionen von Nutzern eine Aura der Wissenschaftlichkeit.

🔎 Warum ResearchGate zum Verbreitungskanal pseudowissenschaftlicher Praktiken wird

ResearchGate positioniert sich als Plattform für den Austausch wissenschaftlicher Arbeiten, aber das Fehlen eines strengen Pre-Publication-Peer-Reviews verwandelt sie in eine Müllhalde ungeprüfter Materialien (S003). Jeder Forscher kann einen Preprint hochladen, der allein durch die Platzierung auf der Plattform den Anschein akademischer Legitimität erhält.

Dies erzeugt die Illusion eines wissenschaftlichen Konsenses um Ideen, die keine kritische Prüfung durchlaufen haben. Der Leser sieht: viele Zitationen, hoher h-Index des Autors, ansprechende Grafiken — und nimmt an, dass die Arbeit einen Qualitätsfilter durchlaufen hat. Tatsächlich gibt es keinen Filter.

🧩 Mechanismus der Substitution: Wie sich Pseudowissenschaft als KI-Forschung tarnt

Die zentrale Taktik ist die Verwendung technischen Jargons und Datenvisualisierungen zur Erzeugung des Eindrucks wissenschaftlicher Strenge. Eine Arbeit kann Grafiken zur Klassifikationsgenauigkeit, Beschreibungen neuronaler Netzarchitekturen, Verweise auf Datensätze enthalten — dabei aber auf fundamental fehlerhaften Annahmen über Kausalzusammenhänge basieren (S006).

| Merkmal legitimer Forschung | Merkmal der Tarnung in KI-Physiognomik |

|---|---|

| Explizit formulierte Hypothese über den Mechanismus des Zusammenhangs | Es wird angenommen, dass der Algorithmus den Zusammenhang „selbst findet", ohne theoretische Begründung |

| Kontrolle von Confoundern (Alter, Beleuchtung, Kamerawinkel) | Verwendung eines „rohen" Datensatzes mit vielen unkontrollierten Variablen |

| Ergebnisse sind auf unabhängigen Stichproben reproduzierbar | Test nur auf einem Datensatz oder auf einer Teilstichprobe desselben Datensatzes |

| Diskussion von Einschränkungen und alternativen Erklärungen | Ergebnisse werden als endgültige Beweise präsentiert |

Das Problem wird dadurch verschärft, dass generative KI-Systeme plausibel aussehende Forschungstexte ohne reale empirische Grundlage erstellen können. Ein Artikel kann überzeugend geschrieben sein, Verweise auf reale Arbeiten enthalten (oft mit Verzerrung ihrer Bedeutung) und wie das Ergebnis ernsthafter Forschung aussehen.

Dies ist nicht nur eine Frage der Publikationsqualität. Ethik und Sicherheit von KI hängen direkt davon ab, welche Annahmen in Algorithmen eingebettet werden. Wenn ein System auf Arbeiten trainiert wird, die historische Vorurteile reproduzieren, wird es diese skalieren.

Steelman-Analyse: Sieben Argumente zur Rechtfertigung der „wissenschaftlichen Physiognomik" im KI-Zeitalter — und warum sie überzeugend wirken

Um zu verstehen, warum pseudowissenschaftliche Arbeiten zur Physiognomik im akademischen Umfeld Gehör finden, müssen die stärksten Versionen der Argumente ihrer Befürworter betrachtet werden. Dies bedeutet keine Zustimmung zu diesen Positionen, ermöglicht aber, den Überzeugungsmechanismus und Schwachstellen in der Logik aufzudecken. Mehr dazu im Abschnitt KI-Mythen.

- „Korrelationen existieren objektiv — wir messen sie nur". Wenn ein Algorithmus statistische Korrelationen zwischen Gesichtsmerkmalen und Eigenschaften im Datensatz entdeckt, sei dies angeblich eine objektive Tatsache. Das Modell „findet einfach Muster" ohne Voreingenommenheit. Berufung auf Positivismus: Wenn eine Korrelation reproduzierbar ist, verdient sie Untersuchung.

- „Moderne Datensätze und Rechenleistung machen die Analyse grundlegend anders". Statt subjektiver Bewertungen weniger Beobachter — Millionen von Bildern und tiefe neuronale Netze, die subtile Muster erkennen. Der Datenumfang überwindet angeblich die Grenzen der Vergangenheit.

- „Genetik und embryonale Entwicklung verbinden Gesicht und Gehirn". Gesicht und Gehirn entwickeln sich aus denselben embryonalen Geweben, unterliegen denselben genetischen Faktoren. Folglich seien Korrelationen zwischen Morphologie und neurokognitiven Eigenschaften möglich. Klingt wissenschaftlich und ist ohne Fachwissen schwerer zu widerlegen.

- „Praktische Anwendung rechtfertigt die Forschung". Potenzielle Anwendungen: Verbesserung der Sicherheit, Früherkennung von Störungen, Personalisierung der Bildung. Utilitaristisches Argument: Wenn Technologie Leben retten kann, sind ethische Einwände zweitrangig.

- „Kritik basiert auf politischer Korrektheit, nicht auf Wissenschaft". Gegner seien ideologisch motiviert, fürchten „unbequeme Wahrheiten" über biologische Unterschiede. Dieser Frame macht Kritiker zu Gegnern des wissenschaftlichen Fortschritts.

- „Menschen nutzen Physiognomik bereits intuitiv — KI formalisiert dies nur". Menschen urteilen ständig über andere nach Äußerem. Wenn diese Urteile Vorhersagekraft enthalten, könne Algorithmisierung den Prozess gerechter machen, indem individuelle Vorurteile eliminiert werden. Paradox: KI-Physiognomik wird als Kampf gegen Diskriminierung positioniert.

- „Forschungsverbot stoppt Entwicklung nicht — besser offen regulieren". Technologie werde sich in geschlossenen Laboren entwickeln. Öffentliche Forschung ermöglicht der Gesellschaft, Risiken zu verstehen und Regulierungsrahmen zu schaffen. Verbot treibt das Problem in den Untergrund.

Jedes dieser Argumente enthält Logikkerne, die sie für Menschen überzeugend machen, die mit der Geschichte der Physiognomik oder der Methodologie des maschinellen Lernens nicht vertraut sind. Genau deshalb funktionieren sie im akademischen Umfeld.

Die ersten vier Argumente appellieren an technologischen Optimismus und positivistische Wissenschaftsphilosophie: Wenn wir messen können, ist es real. Die letzten drei nutzen soziale Rhetorik — Beschuldigung der Kritiker der Ideologie, Berufung auf praktischen Nutzen und Pragmatismus.

Das Problem ist, dass diese Argumente den fundamentalen Unterschied zwischen Korrelation im Datensatz und kausaler Verbindung in der Realität ignorieren. Ein Datensatz ist nicht die Natur, sondern ein soziales Artefakt, das historische Vorurteile, Datenerhebungsmethoden und Variablenauswahl widerspiegelt. Der Algorithmus „entdeckt keine Wahrheit", sondern reproduziert die Struktur der Daten, auf denen er trainiert wurde.

Die Verbindung zwischen KI-Physiognomik und der Rückkehr der Phrenologie zeigt, dass Datenumfang und Rechenleistung methodologische Probleme nicht lösen — sie verschärfen sie, indem sie Ergebnissen falsche Wissenschaftlichkeit verleihen. Das genetische Argument klingt überzeugend, ignoriert aber, dass Korrelation auf Populationsebene keine individuellen Eigenschaften vorhersagt, und soziale Faktoren (Ernährung, Stress, Lebensstil) Gesicht und Verhalten unabhängig voneinander beeinflussen.

Das utilitaristische Argument über praktischen Nutzen enthält eine versteckte Prämisse: dass die Technologie tatsächlich funktioniert. Aber wenn die Grundlage unzuverlässig ist, verstärkt die Anwendung den Schaden. Die Beschuldigung der Kritiker der politischen Korrektheit ist ein klassischer Trick, der die Diskussion von Methodologie zu Ideologie verschiebt und konkrete wissenschaftliche Einwände vermeidet.

Das Argument über „Formalisierung der Intuition" ist paradox: Wenn Menschen bereits aufgrund von Äußerem diskriminieren, beseitigt Algorithmisierung die Diskriminierung nicht, sondern skaliert sie, indem sie ihr den Anschein von Objektivität verleiht. Dies verstärkt den Schaden, anstatt ihn zu verringern.

Das letzte Argument über offene Regulierung macht Sinn, aber nur wenn Forschung methodologisch fundiert ist. Wenn nicht, rettet Öffentlichkeit nicht — sie legitimiert Pseudowissenschaft. Regulierung muss mit dem Kriterium beginnen: Funktioniert das tatsächlich? — nicht mit der Annahme, dass es funktioniert, und dem Versuch, es zu kontrollieren.

Das Verständnis dieser Argumente ist wichtig nicht für ihre Widerlegung (das ist Aufgabe der folgenden Abschnitte), sondern für die Diagnose: Warum akzeptieren intelligente Menschen sie. Die Antwort liegt in kognitiven Fallen, die diese Argumente ausnutzen — und darin, wie KI-Ethik und -Sicherheit kritische Analyse erfordern, nicht blindes Vertrauen in Technologie.

Evidenzbasis: Was die Daten tatsächlich über den Zusammenhang zwischen Aussehen und Persönlichkeitsmerkmalen aussagen — und warum die meisten „KI-physiognomischen" Arbeiten methodologisch unhaltbar sind

Eine kritische Analyse der empirischen Basis zeigt, dass die überwiegende Mehrheit der Arbeiten, die behaupten, KI könne Persönlichkeitsmerkmale anhand des Gesichts bestimmen, unter fundamentalen methodologischen Problemen leidet, die ihre Schlussfolgerungen ungültig machen. Mehr dazu im Abschnitt Fehler und Verzerrungen der KI.

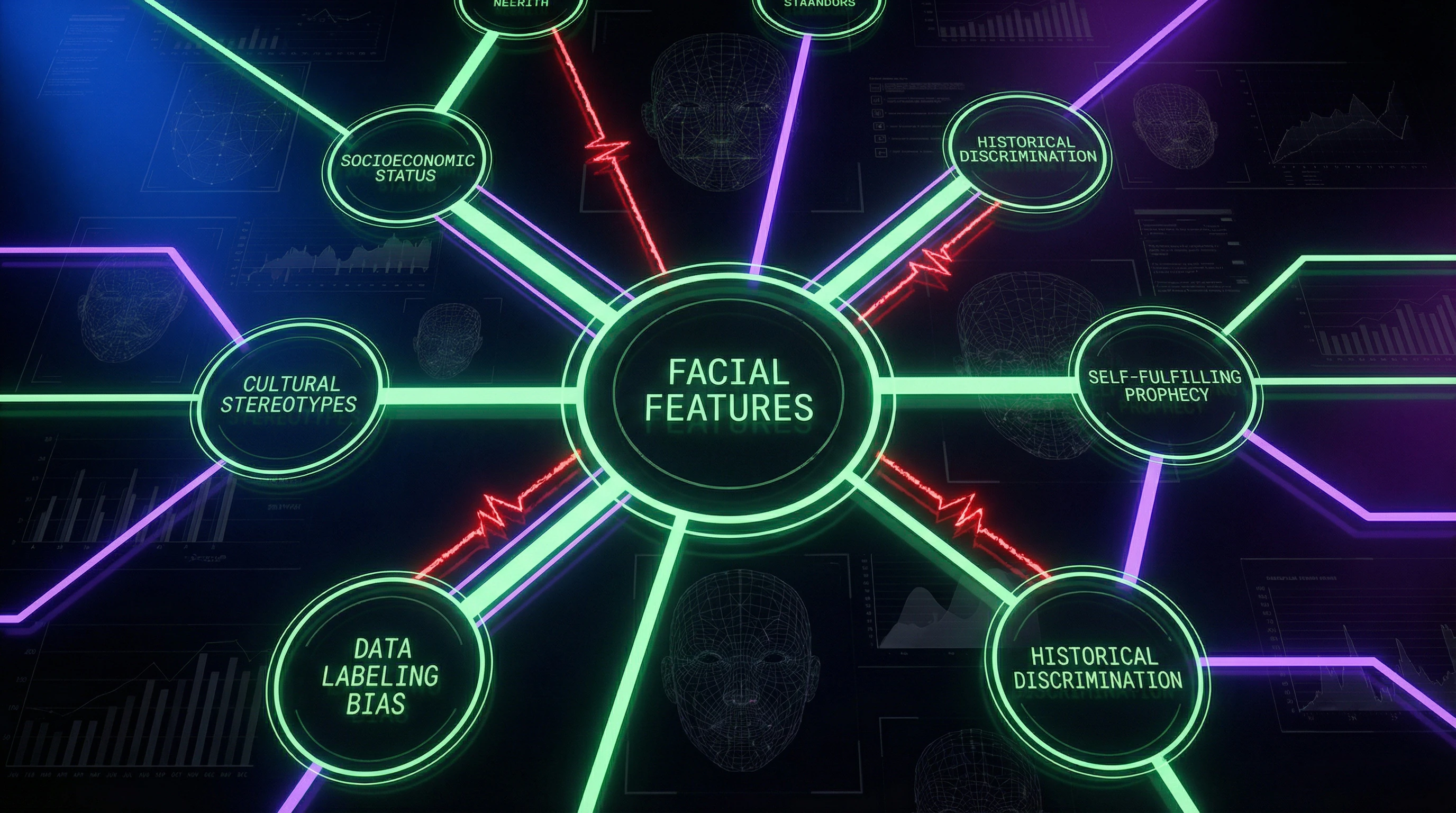

🧪 Problem 1: Verwechslung von Korrelation und Kausalität unter Bedingungen multipler Störfaktoren

Selbst wenn ein Algorithmus einen statistischen Zusammenhang zwischen Gesichtsmerkmalen und einer bestimmten Eigenschaft im Datensatz entdeckt, bedeutet dies keine Kausalbeziehung. Das Gesicht kann mit dem sozioökonomischen Status korrelieren (durch Zugang zu Kosmetik, Ernährung, Medizin), der wiederum mit Bildung, Möglichkeiten und weiter mit messbaren Eigenschaften korreliert.

Das Modell „prognostiziert" nicht innere Qualitäten, sondern den sozialen Kontext (S001).

📊 Problem 2: Datensätze spiegeln bestehende Vorurteile wider, nicht die objektive Realität

Maschinelle Lernsysteme werden mit Daten trainiert, die von Menschen mit Vorurteilen erstellt wurden. Wenn im Trainingsdatensatz Menschen mit bestimmten Gesichtsmerkmalen aufgrund von Voreingenommenheit der Polizei oder Richter häufiger als „kriminell" markiert sind, lernt das Modell, diese Voreingenommenheit zu reproduzieren, anstatt einen realen Zusammenhang zu entdecken.

Dies ist keine „objektive Messung", sondern eine Automatisierung von Diskriminierung (S004).

Mehr über die Mechanismen solcher Verzerrungen siehe in der Analyse der biometrischen Gesichtserkennung.

🧬 Problem 3: Biologische Argumente werden durch genetische Forschung nicht bestätigt

Obwohl sich Gesicht und Gehirn tatsächlich aus verwandten embryonalen Strukturen entwickeln, finden genetische Studien keine signifikanten Korrelationen zwischen Genen, die die Gesichtsmorphologie beeinflussen, und Genen, die mit kognitiven oder Persönlichkeitsmerkmalen verbunden sind. Gemeinsame Entwicklungsfaktoren bedeuten keine funktionale Verbindung im ausgereiften Organismus.

Das Argument aus der Embryologie ist eine biologisierte Version eines logischen Fehlschlusses (S001).

⚠️ Problem 4: Der Effekt der selbsterfüllenden Prophezeiung verzerrt jede Messung

Wenn Menschen mit bestimmten Gesichtsmerkmalen aufgrund bestehender Stereotypen systematisch unterschiedlich behandelt werden (z.B. als weniger kompetent oder aggressiver wahrgenommen werden), beeinflusst dies ihre Lebensverläufe, Möglichkeiten und psychischen Zustände. Jede entdeckte Korrelation kann das Ergebnis sozialer Einflüsse sein, nicht einer angeborenen Verbindung.

Diese Effekte in Beobachtungsdaten zu trennen ist unmöglich.

🔎 Problem 5: Publikationsverzerrung und p-hacking in KI-Forschung

Arbeiten, die keinen Zusammenhang zwischen Gesichtsmerkmalen und Persönlichkeitsmerkmalen gefunden haben, werden seltener publiziert als Arbeiten mit „positiven" Ergebnissen. Dies erzeugt ein verzerrtes Bild in der Literatur. Darüber hinaus ist es bei großen Datensätzen und vielen möglichen Merkmalen leicht, zufällig statistisch signifikante Korrelationen zu finden.

Ohne vorherige Registrierung von Hypothesen und strenge Korrektur für multiple Vergleiche sind die meisten „Entdeckungen" falsch-positiv (S002).

🧾 Problem 6: Fehlende Reproduzierbarkeit der Ergebnisse in unabhängigen Stichproben

Der kritische Test jeder wissenschaftlichen Behauptung ist die Reproduzierbarkeit mit unabhängigen Daten. Die meisten Arbeiten zur „KI-Physiognomik" bestehen diesen Test nicht: Modelle, die auf einem Datensatz trainiert wurden, zeigen einen starken Genauigkeitsabfall bei anderen Stichproben, insbesondere aus unterschiedlichen kulturellen Kontexten.

Dies deutet darauf hin, dass Modelle spezifische Artefakte eines bestimmten Datensatzes lernen, nicht universelle Gesetzmäßigkeiten (S001).

📌 Was systematische Reviews und Meta-Analysen aussagen

Systematische Literaturübersichten zum Zusammenhang zwischen Gesichtsmerkmalen und Persönlichkeitseigenschaften zeigen, dass nach Kontrolle methodologischer Probleme die Effekte entweder verschwinden oder so klein werden, dass sie keine praktische Bedeutung haben. Effektgrößen erklären üblicherweise weniger als 5% der Variation, was individuelle Vorhersagen sinnlos macht, selbst wenn Gruppenunterschiede statistisch signifikant sind (S001).

Der Kontext dieses Problems ist breiter: siehe wie moderne Algorithmen die Fehler des 19. Jahrhunderts wiederholen und Prinzipien der verantwortungsvollen KI-Entwicklung.

Mechanismus der Täuschung: Warum intelligente Menschen an „wissenschaftliche Physiognomik" glauben — kognitive Fallen und Ausnutzung des Vertrauens in Technologie

Das Verständnis der psychologischen Mechanismen, die pseudowissenschaftliche Behauptungen über Physiognomik überzeugend machen, ist entscheidend für die Entwicklung wirksamer Gegenstrategien. Mehr dazu im Abschnitt Statistik und Wahrscheinlichkeitstheorie.

🧩 Falle 1: Repräsentativitätsheuristik und Illusion der Validität

Menschen neigen dazu, ihren intuitiven Urteilen über andere aufgrund des Aussehens zu vertrauen, weil diese Urteile schnell und selbstsicher erscheinen. Wenn Technologie diese Intuitionen scheinbar bestätigt, entsteht eine Illusion der Validität: „Ich habe immer gefühlt, dass das wahr ist, und jetzt beweist es die Wissenschaft".

In Wirklichkeit können sowohl Intuition als auch Algorithmus dieselben kulturellen Stereotype reproduzieren, ohne tatsächliche Vorhersagekraft zu besitzen.

⚙️ Falle 2: Technologischer Determinismus und Glaube an die „Objektivität von Maschinen"

Es herrscht die weit verbreitete Fehlvorstellung, dass Computer und Algorithmen frei von menschlichen Vorurteilen sind, weil sie „nur Zahlen verarbeiten". Dies ignoriert die Tatsache, dass Algorithmen von Menschen entwickelt, mit von Menschen gesammelten und annotierten Daten trainiert und für von Menschen definierte Ziele optimiert werden (S008).

Jede Phase der Algorithmenentwicklung — von der Datenauswahl bis zur Definition der Erfolgsmetrik — ist durchdrungen von menschlichen Werten und Vorurteilen. Die „Objektivität der Maschine" ist ein Mythos, der die Verantwortung der Entwickler verschleiert.

🔁 Falle 3: Ersetzung von Erklärung durch Beschreibung mittels mathematischer Formalisierung

Wenn Korrelation durch Gleichungen, Grafiken und statistische Kennzahlen ausgedrückt wird, erhält sie den Anschein einer Erklärung. „Das Modell erreichte eine Genauigkeit von 73% bei der Vorhersage von X anhand von Gesichtsmerkmalen" klingt wie eine wissenschaftliche Entdeckung (S002).

In Wirklichkeit ist dies nur eine Beschreibung von Mustern in einem spezifischen Datensatz ohne Verständnis kausaler Mechanismen. Die mathematische Form erzeugt die Illusion tiefen Verständnisses.

- Korrelation in Daten ≠ kausaler Zusammenhang

- Hohe Genauigkeit auf Trainingsdaten ≠ Validität auf neuen Daten

- Statistisches Muster ≠ biologischer Mechanismus

🧬 Falle 4: Biologisierung sozialer Phänomene als Schutz vor kognitiver Dissonanz

Die Anerkennung, dass soziale Ungleichheiten das Ergebnis historischer und struktureller Faktoren sind, erfordert die Anerkennung kollektiver Verantwortung und der Notwendigkeit systemischer Veränderungen. Biologische Erklärungen (einschließlich Physiognomik) entbinden von dieser Verantwortung: „Das ist einfach die Natur, wir können nichts dagegen tun" (S001).

Dies ist psychologisch komfortabler, besonders für diejenigen, die von der bestehenden Ordnung profitieren. Biologismus wird zum Instrument des Schutzes vor kognitiver Dissonanz und nicht zum Ergebnis wissenschaftlicher Analyse.

Mehr darüber, wie KI-Physiognomik die Fehler des 19. Jahrhunderts wiederholt und warum KI-Ethik einen kritischen Ansatz gegenüber solchen Systemen erfordert.

Widersprüche in den Quellen und Unsicherheitszonen: Wo selbst Kritiker der Physiognomik unterschiedlicher Meinung sind — und was das für die Praxis bedeutet

Selbst unter Forschern, die physiognomische KI-Systeme kritisieren, gibt es Meinungsverschiedenheiten zu zentralen Fragen. Das ist keine Schwäche der Kritik — es ist ein Zeichen dafür, dass das Problem komplexer ist, als es auf den ersten Blick scheint. Mehr dazu im Abschnitt Kognitive Verzerrungen.

🔬 Widerspruch 1: Gibt es überhaupt valide Korrelationen zwischen Gesicht und Persönlichkeit

Eine Position: Alle Korrelationen sind Artefakte methodologischer Probleme und sozialer Störfaktoren. Die zweite: Es sind sehr schwache, aber reale Zusammenhänge möglich — durch hormonelle Einflüsse auf die Entwicklung oder Effekte der Selbstpräsentation (Menschen mit bestimmten Merkmalen entwickeln bestimmte Interaktionsstile als Reaktion auf ihr Umfeld).

Diese Diskussion definiert die Grenzen zulässiger Forschung (S001). Wenn Korrelationen existieren, selbst schwache, wird die Frage nicht „ob forschen", sondern „wie forschen ohne Schaden".

📊 Widerspruch 2: Liegt das Problem in der Idee selbst oder in der aktuellen Umsetzung

Erste Position: Physiognomik ist grundlegend fehlerhaft, methodologische Verbesserungen können sie nicht retten. Zweite: Aktuelle Systeme sind schlecht wegen mangelhafter Daten und Modelle, aber theoretisch sind ausgefeiltere Ansätze möglich.

Dieser Widerspruch beeinflusst direkt die Regulierungsstrategie: vollständiges Verbot oder strenge methodologische Standards (S004). Die Wahl zwischen ihnen ist nicht technisch, sondern politisch.

🧾 Widerspruch 3: Die Rolle akademischer Plattformen bei der Verbreitung problematischer Forschung

Eine Seite: Plattformen wie ResearchGate sollten strenge Moderation einführen und pseudowissenschaftliche Inhalte entfernen. Die andere befürchtet, dass dies Zensurmechanismen schafft, die gegen legitime, aber kontroverse Forschung eingesetzt werden könnten.

Die Balance zwischen Offenheit und Qualität bleibt ein ungelöstes Problem (S003). Es gibt keinen universellen Algorithmus, der „unbequeme Wahrheit" von „bequemer Lüge" unterscheidet.

⚙️ Unsicherheit: Wie Risiken bei rasanter Technologieentwicklung bewerten

Aktuelle physiognomische Systeme sind ineffektiv. Aber unklar ist, ob das bei grundlegend neuen Ansätzen so bleibt — Integration genetischer Daten, Langzeitstudien, Neuroimaging.

Das Vorsorgeprinzip sieht Beschränkungen auch bei Unsicherheit vor. Aber das kollidiert mit dem Prinzip der Forschungsfreiheit (S008).

- Was das für die Praxis bedeutet

- Ein Kritiker der Physiognomik kann nicht einfach sagen „das ist unwahr". Man muss angeben, welche Mechanismen genau fehlerhaft sind, unter welchen Bedingungen sie zutreffend sein könnten, und warum die aktuellen Belege unzureichend sind. Das erfordert mehr Arbeit, aber es ist der einzige Weg, überzeugend zu sein.

- Warum Widersprüche die Position der Kritiker nicht schwächen

- Das Vorhandensein von Debatten innerhalb der kritischen Gemeinschaft zeigt, dass sie nicht ideologisch ist. Ideologen streiten nicht — sie deklarieren. Forscher streiten, weil sie Wahrheit suchen, nicht Sieg.

Für Journalisten, Regulierungsbehörden und Forscher bedeutet das: Verlangt nicht Übereinstimmung, sondern Transparenz. Welche Annahmen genau trifft der Autor? Wo könnten sie falsch liegen? Welche Daten könnten sie widerlegen?

Verifikationsprotokoll: Sieben Fragen, die pseudowissenschaftliche Arbeiten zur „KI-Physiognomik" in drei Minuten entlarven — Checkliste für Forscher, Journalisten und Regulierungsbehörden

Ein praktisches Instrument zur schnellen Bewertung der wissenschaftlichen Validität von Arbeiten, die behaupten, KI könne Persönlichkeitsmerkmale anhand des Aussehens bestimmen. Mehr dazu im Abschnitt Grundlagen der Epistemologie.

✅ Frage 1: Wurde die Arbeit einem unabhängigen Peer-Review in einer Zeitschrift mit Impact-Faktor über 3.0 unterzogen?

Preprints auf ResearchGate oder arXiv durchlaufen keine strenge Prüfung. Eine Veröffentlichung in einer begutachteten Zeitschrift garantiert keine Qualität, aber ihr Fehlen ist eine Warnung.

Prüfen Sie die Zeitschrift in den Datenbanken Scopus oder Web of Science. Wenn die Arbeit seit über einem Jahr nur als Preprint existiert, ist das verdächtig (S003).

✅ Frage 2: Wurden Hypothese und Analyseplan vor der Datenerhebung registriert?

Eine Präregistrierung auf Plattformen wie dem Open Science Framework schützt vor p-hacking und HARKing (Hypothesizing After Results are Known).

Wenn die Autoren keinen Link zur Präregistrierung vorlegen können, könnten die Ergebnisse das Resultat von Datenanpassung sein (S002).

✅ Frage 3: Wurde das Modell an einer unabhängigen Stichprobe aus einem anderen kulturellen Kontext getestet?

Eine Validierung nur an einem Teil desselben Datensatzes (train-test split) reicht nicht aus. Erforderlich ist eine Prüfung an vollständig unabhängigen Daten, die in einem anderen Land, zu einer anderen Zeit, von anderen Forschern erhoben wurden.

Fehlt eine solche Prüfung, könnten die Ergebnisse spezifisch für den jeweiligen Datensatz sein (S001).

⛔ Frage 4: Werden offensichtliche Störfaktoren (Alter, Geschlecht, Ethnizität, sozioökonomischer Status) kontrolliert?

Wenn ein Modell ein Merkmal „vorhersagt", die Autoren aber nicht zeigen, dass die Vorhersage nach Kontrolle soziodemografischer Variablen bestehen bleibt, könnte das Ergebnis vollständig durch diese Störfaktoren erklärt werden.

Fordern Sie Tabellen mit Ergebnissen multivariater Analysen (S001).

⛔ Frage 5: Sind Daten und Code für eine unabhängige Überprüfung offengelegt?

Reproduzierbarkeit ist die Grundlage der Wissenschaft. Wenn Autoren keinen Zugang zu Daten (oder zumindest zu synthetischen Daten mit denselben Eigenschaften) und Analysecode bereitstellen, lassen sich die Ergebnisse nicht überprüfen.

Verweise auf „Vertraulichkeit" oder „Geschäftsgeheimnisse" sind in akademischen Arbeiten inakzeptabel (S002).

⛔ Frage 6: Werden ethische Risiken und Missbrauchsmöglichkeiten diskutiert?

Eine legitime Arbeit in einem sensiblen Bereich sollte eine detaillierte Diskussion potenzieller Risiken enthalten: wie die Ergebnisse für Diskriminierung, Profiling oder Verletzung der Privatsphäre genutzt werden könnten.

Das Fehlen einer solchen Diskussion deutet darauf hin, dass die Autoren sich der Konsequenzen entweder nicht bewusst sind oder sie absichtlich verschweigen. Machen Sie sich mit den Prinzipien verantwortungsvoller KI-Entwicklung vertraut.

⛔ Frage 7: Wird eine für Pseudowissenschaft typische Sprache verwendet?

Warnzeichen im Text: absolute Aussagen ohne Einschränkungen („KI bestimmt Kriminelle präzise anhand des Gesichts"), Autoritätsargumente ohne Belege, fehlende Diskussion von Limitationen, Vorwürfe an Kritiker wegen „Voreingenommenheit" oder „politischer Korrektheit".

- Wissenschaftliche Sprache

- „Das Modell zeigte eine Korrelation von r = 0,32 (p < 0,05) bei Kontrolle von Alter und Geschlecht, aber der Effekt könnte durch kulturelle Unterschiede im emotionalen Ausdruck erklärt werden".

- Pseudowissenschaftliche Sprache

- „Unsere KI hat eine verborgene Verbindung zwischen Gesichtszügen und Persönlichkeit aufgedeckt, die Wissenschaftler aus politischer Korrektheit ignoriert haben".

Wenn eine Arbeit 4+ Warnzeichen aus dieser Liste enthält, verdient sie kein Vertrauen. Bei 2–3 Warnzeichen ist eine kritische Lektüre und Konsultation mit einem Methodologen erforderlich. Fehlen Warnzeichen, könnte die Arbeit legitim sein — aber das garantiert nicht ihre Richtigkeit.

Denken Sie daran: Das Fehlen von Schadensbeweisen ist kein Beweis für die Abwesenheit von Schaden. Die Beweislast liegt bei den Autoren, die behaupten, KI könne Persönlichkeitsmerkmale anhand des Aussehens bestimmen. Machen Sie sich mit der Analyse physiognomischer KI und Bedrohungen für Bürgerrechte vertraut.