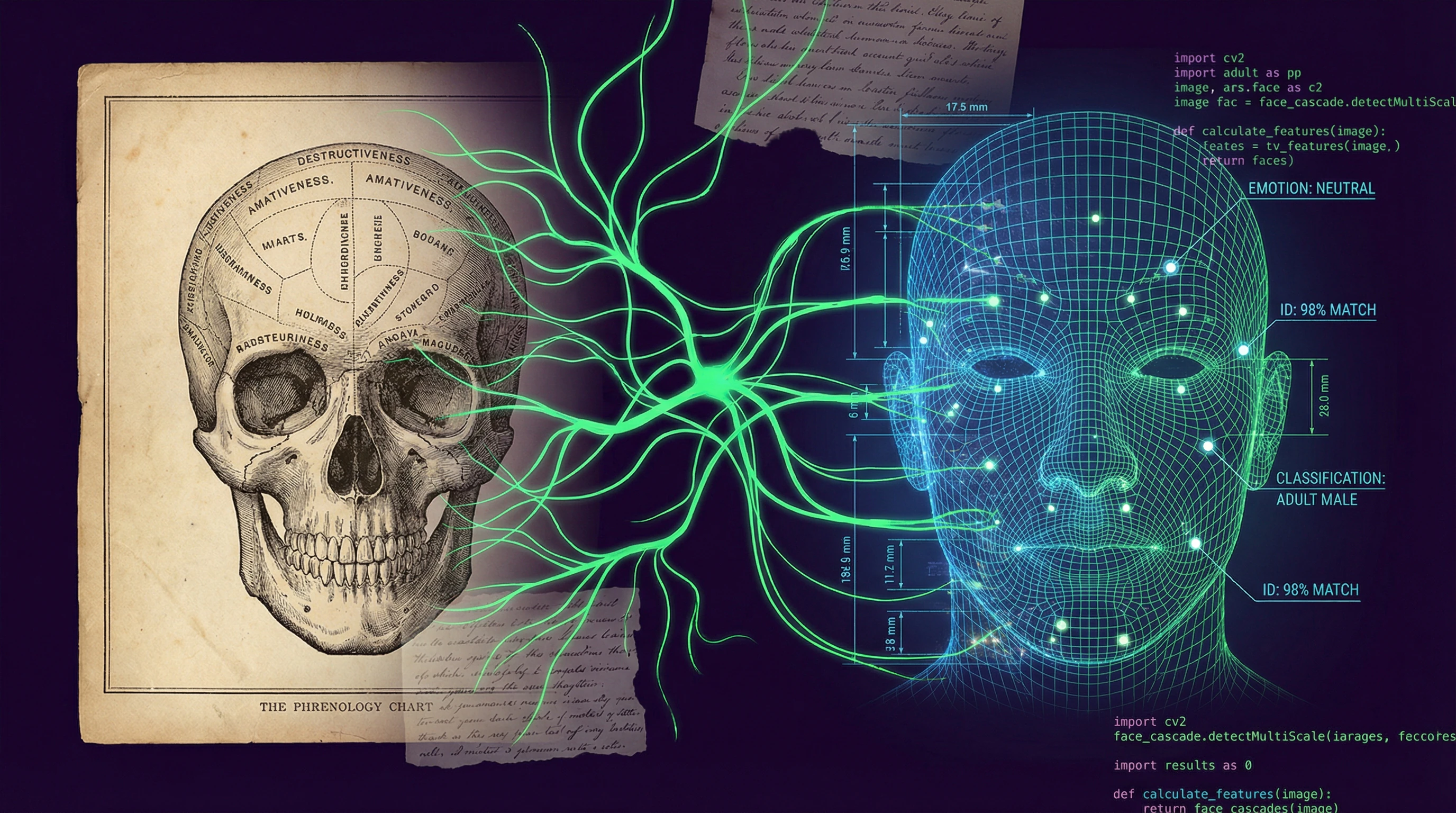

Physiognomische KI: Wenn Algorithmen Menschen nach Schädeln und Nasen beurteilen — Definition eines Phänomens, das Tech-Giganten lieber ignorieren

Physiognomische künstliche Intelligenz ist die Praxis, Computer Vision zu nutzen, um Hierarchien der Körperzusammensetzung, den Status geschützter Klassen, wahrgenommenen Charakter, Fähigkeiten und zukünftige soziale Ergebnisse auf Basis physischer oder verhaltensbezogener Merkmale abzuleiten (S003, S004). Das Spektrum umfasst Systeme zur Gesichtserkennung von Emotionen, Algorithmen zur Vorhersage krimineller Neigungen anhand der Schädelform und die Bewertung der „Vertrauenswürdigkeit" eines Menschen anhand des Augenabstands.

Das ist keine Hypothese über die Zukunft. Solche Systeme sind bereits in Strafverfolgungsbehörden, Kreditinstituten und Einstellungssystemen im Einsatz (S008). Tech-Giganten schweigen darüber, weil das Phänomen ein Eingeständnis erfordert: Sie haben die Physiognomie des 19. Jahrhunderts wiederbelebt und ihr eine GPU gegeben.

Drei Mechanismen physiognomischer KI

- Klassifikation

- Einteilung von Menschen nach physischen Merkmalen: Hautfarbe, Gesichtsform, Knochenstruktur, Augenabstand. Der Algorithmus extrahiert diese Merkmale automatisch aus dem Bild.

- Hierarchisierung

- Zuweisung von Gruppeneigenschaften auf Basis der Klassifikation: Bestimmte Gruppen werden als vertrauenswürdiger, intelligenter oder gesetzestreuer erklärt als andere. Das ist keine Beschreibung, sondern ein Ranking.

- Vorhersage

- Die Behauptung, dass der Algorithmus zukünftiges Verhalten bestimmen kann: Ob eine Person zum Verbrecher, erfolgreichen Mitarbeiter oder loyalen Bürger wird (S003). Das ist der Schritt von der Klassifikation zum Schicksal.

Warum Computer Vision der ideale Träger für Physiognomie des 21. Jahrhunderts ist

Computer Vision ist der zentrale Vektor für physiognomische KI (S003, S004). Systeme werden auf riesigen Datensätzen markierter Gesichter trainiert, bei denen jedes Bild mit Labels verknüpft ist — Geschlecht, Alter, Ethnie, Emotion.

Der Algorithmus lernt, Korrelationen zwischen Pixeln und sozialen Kategorien zu finden, ohne zu verstehen, dass diese Kategorien soziale Konstrukte und keine biologischen Fakten sind. Das Ergebnis: Die Maschine reproduziert und verstärkt menschliche Vorurteile und verleiht ihnen den Anschein von Objektivität.

Die Grenze zwischen Biometrie und Physiognomie

| Biometrische Identifikation | Physiognomische Ableitung |

|---|---|

| Gleicht ein Gesicht mit einer Datenbank ab, um die Identität festzustellen | Behauptet, innere Eigenschaften aus dem Äußeren ableiten zu können |

| Technisch möglich und manchmal gerechtfertigt | Wissenschaftlich unhaltbar und ethisch inakzeptabel |

| Antwort: „Das ist Person X" | Antwort: „Diese Person ist ein Verbrecher / unzuverlässig / gefährlich" |

Die Grenze ist verschwommen: Viele Systeme beginnen mit Identifikation, fügen dann aber Ebenen der Ableitung über Charakter, Absichten oder zukünftiges Verhalten hinzu (S003). Das verwandelt ein Kontrollinstrument in ein Verurteilungsinstrument.

Mehr über die Mechanismen dieser Transformation siehe im Artikel „KI-Physiognomie und die Rückkehr der Phrenologie".

Fünf Argumente zur Verteidigung physiognomischer KI — und warum sie für jene überzeugend wirken, die die Wissenschaftsgeschichte nicht kennen

Bevor wir physiognomische KI mit Beweisen widerlegen, müssen wir verstehen, warum diese Idee attraktiv erscheint. Steelmanning — die Darstellung der stärksten Version des gegnerischen Arguments — zeigt, dass Befürworter physiognomischer KI sich auf fünf äußerlich logische Thesen stützen. Mehr dazu im Abschnitt Synthetische Medien.

🔬 Erstes Argument: Korrelationen existieren, und Algorithmen finden sie

Befürworter behaupten: Wenn ein Algorithmus einen statistischen Zusammenhang zwischen Gesichtsform und bestimmtem Verhalten entdeckt, dann ist dieser Zusammenhang real. Die Maschine ist nicht voreingenommen — sie analysiert einfach Daten.

Wenn ein Modell kriminelles Verhalten mit 70% Genauigkeit vorhersagt, ist das besser als zufälliges Raten. Das Problem ist, dass Korrelation nicht gleich Kausalität ist, und 30% falsche Anschuldigungen sind keine statistische Fehlerquote, sondern reale Leben.

📊 Zweites Argument: Emotionen spiegeln sich im Gesicht wider — das ist eine bewiesene Tatsache der Psychologie

Befürworter beziehen sich auf Paul Ekmans Forschung über universelle Gesichtsausdrücke. Wenn Wut, Angst und Freude erkennbare mimische Muster haben, warum sollte man nicht einen Algorithmus trainieren, sie zu erkennen?

Kritiker weisen jedoch darauf hin: Ekmans Theorie vereinfacht die kulturelle Vielfalt emotionaler Ausdrücke und ignoriert den Kontext. Der Gesichtsausdruck ist kein Fenster zur Seele, sondern ein soziales Signal, das von Kultur, Situation und dem Betrachter abhängt.

🧬 Drittes Argument: Genetik beeinflusst Aussehen und Verhalten — warum kann KI diese Verbindung nicht erfassen

Genetische Faktoren beeinflussen tatsächlich sowohl physische Merkmale als auch einige Verhaltenstendenzen. Wenn bestimmte genetische Marker mit Gesichtsform und mit Impulsivitätsneigung korrelieren, könnte ein Algorithmus theoretisch diese Verbindung entdecken.

Das klingt wissenschaftlich — ignoriert aber, dass Verhalten durch komplexe Wechselwirkungen von Genen, Umwelt und Kultur bestimmt wird, nicht durch die Nasenform. Das ist Reduktionismus, getarnt als Statistik.

⚙️ Viertes Argument: Technologie ist neutral — das Problem liegt in den Daten, nicht in der Methode

Dies ist das gefährlichste Argument: Computer Vision selbst ist nicht rassistisch, sie wurde nur mit voreingenommenen Daten trainiert. Korrigiert man den Datensatz — ist das Problem gelöst.

- Physiognomische Logiken sind in den technischen Mechanismus von Computer Vision eingebaut, wenn sie auf Menschen angewendet wird (S003, S004)

- Das Problem liegt nicht in den Daten — das Problem liegt in der Idee selbst, dass Aussehen innere Eigenschaften vorhersagen kann

- Selbst ein perfekter Datensatz rettet nicht vor dem konzeptionellen Fehler

🛡️ Fünftes Argument: Ablehnung der Technologie bedeutet Verzicht auf Sicherheit und Effizienz

Das letzte Argument appelliert an die Angst: Wenn wir physiognomische KI verbieten, können wir Verbrechen nicht verhindern, Terroristen nicht identifizieren oder Einstellungen nicht optimieren.

Das ist ein falsches Dilemma. Es gibt alternative Methoden zur Risikobewertung, die auf Verhalten basieren, nicht auf Aussehen. Aber Angst ist ein mächtiger Motivator, und dieses Argument funktioniert bei Politikern und Unternehmensführern.

Für eine vertiefte Analyse der Mechanismen, durch die diese Argumente überzeugend werden, siehe die Analyse der Rückkehr der Phrenologie im KI-Zeitalter und Protokolle zum Debunking pseudowissenschaftlicher Behauptungen.

Evidenzbasis gegen physiognomische KI: Warum die Wiederbelebung von Physiognomie und Phrenologie kein Fortschritt ist, sondern ein Rückschritt ins Mittelalter mit GPU

Die Wiederbelebung der Pseudowissenschaften Physiognomie und Phrenologie durch Computer Vision und maschinelles Lernen ist ein Grund zu dringender Besorgnis (S003, S004). Die historische Analyse zeigt: Physiognomie und Phrenologie rechtfertigten Sklaverei, Kolonialismus, Zwangssterilisation und Völkermord.

Die Wiederbelebung dieser Theorien durch KI birgt das Risiko, diese Schrecken im digitalen Zeitalter zu wiederholen – jedoch mit einem Ausmaß und einer Geschwindigkeit, die das 19. Jahrhundert sich nicht vorstellen konnte.

📊 Historischer Hintergrund: Wie Physiognomie Völkermord rechtfertigte

Im 19. Jahrhundert waren Physiognomie und Phrenologie Mainstream-Wissenschaft. Cesare Lombroso behauptete, Kriminelle ließen sich an der Schädelform erkennen. Phrenologen vermaßen Köpfe, um die Überlegenheit der Europäer gegenüber Afrikanern und Asiaten zu beweisen. Mehr dazu im Abschnitt Deepfakes.

Diese Theorien wurden zur Rechtfertigung der Sklaverei in den USA, des Kolonialismus in Afrika und Asien sowie eugenischer Programme in Europa und Amerika verwendet. Die Nationalsozialisten wendeten physiognomische Vermessungen zur Rassenklassifizierung und Deportation von Menschen in Konzentrationslager an. Mitte des 20. Jahrhunderts verwarf die wissenschaftliche Gemeinschaft diese Theorien als Pseudowissenschaft – doch Algorithmen erwecken sie wieder zum Leben.

🧪 Aktuelle Forschung: Warum Emotionserkennungsalgorithmen nicht funktionieren

Zahlreiche Studien belegen die Unhaltbarkeit physiognomischer KI. Emotionserkennungssysteme zeigen unter realen Bedingungen eine Genauigkeit, die nicht über Zufallsniveau liegt, insbesondere bei Menschen nicht-europäischer Herkunft.

Algorithmen zur Kriminalitätsvorhersage anhand von Gesichtern reproduzieren rassistische Vorurteile: Sie klassifizieren Schwarze häufiger als potenzielle Kriminelle, unabhängig vom tatsächlichen Verhalten. Dies ist kein Kalibrierungsfehler – es ist ein fundamentales Problem der Methode (S003).

- Emotionserkennungssysteme: Genauigkeit von 50–60% bei unterrepräsentierten Gruppen (Frauen, ältere Menschen, nicht-weiße Ethnien)

- Kriminalitätsalgorithmen: Systematische Überschätzung der Risiken für Afroamerikaner

- Biometrische Systeme: Zugangsverweigerung für Menschen mit neurologischen Besonderheiten

🧾 Drei Skandale, die die Gefahr physiognomischer KI offenlegten

HireVue: Ein Gesichtsanalysesystem zur Bewertung von Bewerbern wurde der Diskriminierung beschuldigt. Der Algorithmus bewertete nicht Kompetenzen, sondern Mimik und Tonfall, was Menschen mit Autismus, neurologischen Besonderheiten und Angehörige nicht-westlicher Kulturen benachteiligte.

Uigurische Gesichtserkennung: Das chinesische System zur Erkennung von Uiguren anhand von Gesichtern wurde für Massenverhaftungen und Deportationen in Umerziehungslager eingesetzt.

COMPAS: Ein Algorithmus zur Rückfallvorhersage in den USA überschätzte systematisch die Risiken für Afroamerikaner, was zu härteren Urteilen führte (S003).

🔎 Meta-Analyse: Was systematische Reviews über die Genauigkeit aussagen

Systematische Literaturübersichten zeigen: Physiognomische KI erreicht in unabhängigen Tests nicht die behauptete Genauigkeit. Von Entwicklern finanzierte Studien weisen eine Genauigkeit von 80–90% aus, doch unabhängige Überprüfungen senken diese Zahl auf 50–60% – das Niveau zufälligen Ratens.

| Testbedingung | Behauptete Genauigkeit | Unabhängige Überprüfung | Schlussfolgerung |

|---|---|---|---|

| Kontrolliertes Labor | 80–90% | 70–75% | Überschätzung unter idealen Bedingungen |

| Reale Bedingungen | — | 50–60% | Niveau zufälligen Ratens |

| Unterrepräsentierte Gruppen | — | 30–45% | Diskriminierungsinstrument |

Die Genauigkeit fällt drastisch bei unterrepräsentierten Gruppen: Frauen, ältere Menschen, nicht-weiße Ethnien. Das bedeutet, dass die Systeme als Diskriminierungsinstrumente funktionieren, nicht als objektive Bewertungstools (S003, S004).

Mehr über die Mechanismen dieser Fehler in der Analyse zur Rückkehr der Phrenologie in modernen Algorithmen und den Prinzipien verantwortungsvoller KI-Entwicklung.

Mechanismen des Irrtums: Warum physiognomische KI Korrelation mit Kausalität verwechselt und selbsterfüllende Prophezeiungen schafft

Physiognomische KI begeht einen fundamentalen epistemologischen Fehler: Sie verwechselt Korrelation mit Kausalität. Wenn der Algorithmus feststellt, dass Menschen mit einer bestimmten Gesichtsform häufiger verhaftet werden, schlussfolgert er, dass die Gesichtsform kriminelles Verhalten verursacht. Mehr dazu im Abschnitt Deepfake-Erkennung.

In Wirklichkeit liegt die Ursache im systemischen Rassismus: Die Polizei stoppt und verhaftet häufiger Menschen mit bestimmtem Aussehen, wodurch ein verzerrter Datensatz entsteht (S003).

Der Algorithmus sieht die Verbindung zwischen Gesicht und Verhaftung, aber er sieht nicht Armut, polizeiliche Überwachung und strukturelle Ungleichheit als gemeinsame Ursachen. Das System bestraft Menschen für ihre soziale Lage und tarnt dies als objektive Risikobewertung.

🧬 Confounder: Verborgene Variablen, die Algorithmen nicht sehen

Ein Confounder ist eine verborgene Variable, die gleichzeitig Aussehen und Verhalten beeinflusst. Armut beeinflusst die Ernährung (spiegelt sich im Gesicht wider) und die Wahrscheinlichkeit einer Verhaftung (aufgrund polizeilicher Überwachung in armen Vierteln).

Das Ergebnis: Der Algorithmus erzeugt die Illusion eines kausalen Zusammenhangs zwischen Gesichtszügen und Kriminalität, obwohl beide Variablen von einem dritten Faktor abhängen – dem sozioökonomischen Status.

🔁 Feedback-Schleifen: Wie physiognomische KI die Realität erschafft, die sie vorhersagt

Die selbsterfüllende Prophezeiung ist ein zentraler Schadensmechanismus. Wenn der Algorithmus Kriminalität anhand des Aussehens vorhersagt, verstärkt die Polizei die Überwachung solcher Menschen.

- Verstärkte Überwachung führt zu mehr Verhaftungen

- Mehr Verhaftungen bestätigen die Vorhersage des Algorithmus

- Das System schafft Beweise für seine eigene Richtigkeit

- Diese Beweise sind ein Artefakt der Diskriminierung, keine objektive Realität (S003, S004)

🧷 Reduktionismus: Warum komplexes Verhalten nicht auf Pixel reduziert werden kann

Menschliches Verhalten wird durch das Zusammenspiel von Genetik, Epigenetik, Neurobiologie, Psychologie, sozialem Umfeld, Kultur, Ökonomie und Zufall bestimmt. Physiognomische KI reduziert diese Komplexität auf Pixelmuster.

Das ist keine Vereinfachung – es ist ein kategorialer Fehler, vergleichbar mit dem Versuch, das Wetter anhand der Himmelsfarbe vorherzusagen. Einige Informationen sind im Aussehen enthalten, aber sie reichen nicht für verlässliche Vorhersagen über Charakter oder zukünftiges Verhalten aus (S003).

Mehr darüber, wie KI historische Fehler der Wissenschaft reproduziert, siehe KI-Physiognomik und die Rückkehr der Phrenologie.

Konflikte in den Quellen: Wo Forscher unterschiedlicher Meinung sind und warum dies für das Verständnis des Problems wichtig ist

Die wissenschaftliche Gemeinschaft ist sich in der Bewertung physiognomischer KI nicht einig. Drei Hauptpositionen — Abolitionismus, Reformismus, Technooptimismus — spiegeln eine fundamentale Spaltung im Verständnis wider, ob die Technologie korrigiert oder verboten werden muss. Mehr dazu im Abschnitt Kognitive Verzerrungen.

Diese Meinungsverschiedenheiten sind nicht akademisch. Sie bestimmen, welche Gesetze verabschiedet werden, welche Systeme eingesetzt werden, wessen Rechte geschützt werden.

🧩 Abolitionisten gegen Reformisten: Kann physiognomische KI korrigiert werden oder muss sie verboten werden

Abolitionisten, darunter die Autoren der Fordham Law-Studie, argumentieren: Physiognomische Logiken sind in den technischen Mechanismus des Computer Vision eingebettet, der auf Menschen angewendet wird (S003, S004). Das Problem kann nicht durch bessere Daten oder Algorithmen gelöst werden — ein vollständiges Verbot ist erforderlich.

Reformisten widersprechen: Die Technologie ist neutral, das Problem liegt in der Anwendung. Sie schlagen Algorithmen-Audits, Transparenz und Rechenschaftspflicht vor. Abolitionisten antworten: Audits können ein grundlegend fehlerhaftes Konzept nicht korrigieren.

Die Meinungsverschiedenheit hier betrifft nicht die Details der Implementierung. Es ist ein Streit darüber, ob es überhaupt eine technische Lösung für ein Problem gibt, das seiner Natur nach nicht technisch, sondern konzeptionell ist.

🔬 Streit über Genauigkeit: Reichen 70% aus, um Entscheidungen über Menschenleben zu treffen

Technooptimisten verweisen auf die verbesserte Genauigkeit von Algorithmen: Moderne Systeme erreichen unter Laborbedingungen 70–80% Genauigkeit. Kritiker antworten: 70% Genauigkeit bedeuten 30% Fehler, und wenn es um Freiheit, Arbeit oder Leben geht, ist das inakzeptabel.

Darüber hinaus sinkt die Genauigkeit bei Minderheiten, was systematische Diskriminierung schafft. Der Streit ist nicht gelöst, aber der Konsens verschiebt sich zugunsten der Kritiker: Selbst hohe durchschnittliche Genauigkeit rechtfertigt nicht den Einsatz der Technologie, wenn sie vulnerable Gruppen diskriminiert (S003).

- Durchschnittliche Genauigkeit von 70–80% verbirgt Varianz zwischen demografischen Gruppen

- Ein Fehler in 30% der Fälle ist für lebenswichtige Entscheidungen inakzeptabel

- Systematischer Fehler bei Minderheiten ist kein technisches Problem, sondern ein Gerechtigkeitsproblem

📊 Meinungsverschiedenheiten über Regulierung: Verbot, Moratorium oder Selbstregulierung der Industrie

Die Fordham Law-Studie empfiehlt Gesetzgebern, physiognomische KI an öffentlichen Orten zu verbieten (S003, S004). Die Industrie schlägt Selbstregulierung durch ethische Kodizes und freiwillige Standards vor.

Regierungen erwägen Zwischenlösungen: Moratorium für bestimmte Anwendungen, obligatorische Audits, Transparenzanforderungen. Die Meinungsverschiedenheiten spiegeln einen Interessenkonflikt wider: Die Industrie will einen profitablen Markt erhalten, Forscher und Aktivisten priorisieren Menschenrechte.

- Verbot

- Vollständiger Ausschluss physiognomischer KI aus dem öffentlichen Raum. Position: Die Technologie ist von Natur aus diskriminierend.

- Moratorium

- Vorübergehende Aussetzung der Einführung bis zur Entwicklung von Standards. Position: Zeit für Regulierung wird benötigt.

- Selbstregulierung

- Ethische Kodizes und freiwillige Standards der Industrie. Position: Der Markt wird sich selbst korrigieren.

Für Bürger und Gesetzgeber ist es wichtig zu verstehen: Das Fehlen eines Konsenses bedeutet keine Ungewissheit. Es bedeutet, dass die Entscheidung politisch und nicht wissenschaftlich getroffen wird. Die Wahl zwischen Verbot, Moratorium und Selbstregulierung ist eine Wahl zwischen dem Schutz der Menschenrechte und den Interessen der Industrie.

Informieren Sie sich über die Analyse, wie moderne Algorithmen die Fehler des 19. Jahrhunderts wiederholen, und das Protokoll für verantwortungsvolle KI-Entwicklung.

Kognitive Anatomie des Mythos: Welche psychologischen Trigger Menschen dazu bringen, an physiognomische KI zu glauben

Physiognomische KI nutzt tief verwurzelte kognitive Verzerrungen aus. Das Verständnis dieser Mechanismen erklärt, warum diskreditierte Pseudowissenschaft in der Ära von Big Data und maschinellem Lernen neue Anhänger findet. Mehr dazu im Abschnitt Psychologie des Glaubens.

⚠️ Essenzialismus: Warum das Gehirn glauben will, dass Äußeres das Wesen widerspiegelt

Psychologischer Essenzialismus ist die Tendenz, Menschen eine unveränderliche innere Essenz zuzuschreiben, die ihre Eigenschaften bestimmt. Das Gehirn sucht automatisch nach Verbindungen zwischen Aussehen und Charakter, um die soziale Navigation zu vereinfachen.

Physiognomische KI nutzt diese Tendenz aus, indem sie technologische Bestätigung für intuitive, aber falsche Überzeugungen bietet. Menschen glauben, dass der Algorithmus das verborgene Wesen eines Menschen enthüllt, weil dies der Funktionsweise ihres eigenen Gehirns entspricht.

🧠 Halo-Effekt: Wie der erste Eindruck vom Äußeren alle nachfolgenden Urteile verzerrt

Der Halo-Effekt ist eine kognitive Verzerrung, bei der der Gesamteindruck einer Person die Bewertung ihrer spezifischen Eigenschaften beeinflusst. Attraktive Menschen erscheinen intelligenter, ehrlicher und kompetenter.

Physiognomische KI institutionalisiert den Halo-Effekt: Der Algorithmus lernt aus Daten, in denen Attraktivität mit Erfolg korreliert (attraktive Menschen werden häufiger eingestellt und befördert), und reproduziert diese Diskriminierung als objektive Bewertung.

🕳️ Illusion der Objektivität: Warum Zahlen und Algorithmen unvoreingenommen erscheinen

Menschen neigen dazu, quantitativen Bewertungen mehr zu vertrauen als qualitativen Urteilen. Der Algorithmus liefert eine Zahl – 73% Wahrscheinlichkeit für kriminelles Verhalten – und diese Zahl erscheint als objektive Tatsache, nicht als Ergebnis eines voreingenommenen Modells, das mit voreingenommenen Daten trainiert wurde.

- Die Zahl wird als Tatsache wahrgenommen, nicht als Interpretation

- Der Algorithmus erscheint neutral, obwohl er die Vorurteile der Daten widerspiegelt

- Die Illusion der Objektivität tarnt Diskriminierung als wissenschaftliche Präzision (S003, S004)

🧷 Technologischer Determinismus: Der Glaube an die Unvermeidlichkeit und Neutralität des Fortschritts

Technologischer Determinismus ist die Überzeugung, dass technologische Entwicklung einer eigenen Logik folgt, unabhängig von sozialen Werten, und dass Fortschritt unvermeidlich und wohltätig ist. Diese Ideologie veranlasst Menschen, physiognomische KI als unvermeidlichen Teil der Zukunft zu akzeptieren, anstatt ihre Konsequenzen kritisch zu bewerten.

Determinismus unterdrückt Handlungsfähigkeit: Wenn Technologie unvermeidlich ist, warum Widerstand leisten? Tatsächlich ist technologische Entwicklung das Ergebnis menschlicher Entscheidungen, und diese Entscheidungen können geändert werden. Mehr über das Erbe, das wir ignorieren, finden Sie in der Analyse der KI-Geschichte und ihrer sozialen Wurzeln.

Diese vier Trigger wirken synergistisch: Essenzialismus schafft die Bereitschaft zu glauben, der Halo-Effekt liefert emotionale Verstärkung, die Illusion der Objektivität maskiert Voreingenommenheit, und Determinismus blockiert kritischen Widerstand. Zusammen bilden sie eine kognitive Falle, aus der man ohne bewusste Analyse der eigenen Vorurteile schwer entkommen kann.

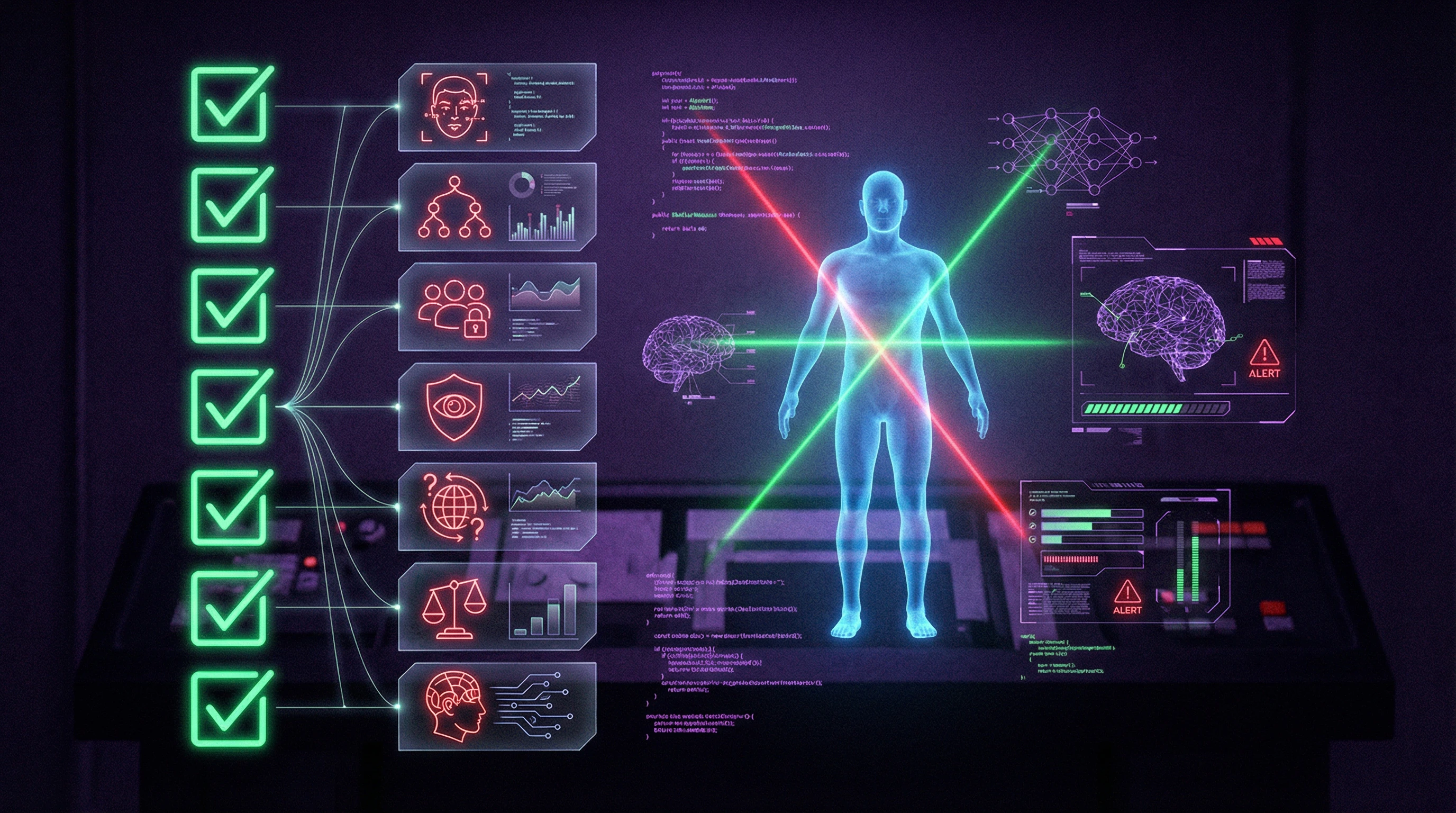

Verifikationsprotokoll: Sieben Fragen, die physiognomische KI in dreißig Sekunden entlarven

Eine Studie der Fordham Law schlägt vor, physiognomische KI zu konzeptualisieren und politische Empfehlungen für deren Regulierung zu entwickeln. Hier sind sieben Fragen, die ein System in einer halben Minute entlarven. Mehr dazu im Abschnitt Karma und Reinkarnation.

- Wurde das System mit einer repräsentativen Stichprobe oder einer Gelegenheitsdatenbank trainiert? Wenn mit Fotos aus dem Internet – das ist bereits eine Verzerrung.

- Haben die Entwickler Fehlermetriken nach demografischen Gruppen veröffentlicht? Schweigen = Vertuschung des Problems.

- Sagt das System Verhalten voraus oder klassifiziert es nur visuelle Merkmale? Wenn ersteres – das ist Physiognomik, wenn letzteres – das könnte legitim sein (aber selten).

- Gibt es eine unabhängige Überprüfung oder nur interne Tests des Unternehmens? Externe Validierung ist obligatorisch.

- Wird das System für Entscheidungen über Menschen verwendet (Einstellung, Kredit, Strafverfolgung) oder nur für Analysen? Ersteres – eine rote Linie.

- Wissen die Menschen, auf die das System angewendet wird, davon und können sie widersprechen? Wenn nein – das ist eine Verletzung der Transparenz.

- Gibt es einen Mechanismus zur Berufung oder Überprüfung einer vom System getroffenen Entscheidung? Fehlen = Fehlen von Gerechtigkeit.

Wenn die Antwort auf vier oder mehr Fragen „nein" oder „unbekannt" lautet – haben Sie es mit physiognomischer KI zu tun, die als Objektivität getarnt ist. (S001), (S004)

Journalisten können diese Checkliste bei der Überprüfung von Unternehmensbehauptungen verwenden. Gesetzgeber – bei der Entwicklung von Standards. Bürger – bei der Bewertung von Systemen, die ihr Leben beeinflussen.

Die Falle physiognomischer KI besteht darin, dass sie objektiver erscheint als menschliches Urteilsvermögen. Tatsächlich verbirgt sie nur Vorurteile innerhalb der Mathematik. Verantwortungsvoller KI-Einsatz beginnt damit, diese Fragen vor der Implementierung eines Systems zu stellen, nicht nach einem Skandal.

Das Protokoll funktioniert, weil es nicht die Technologie angreift, sondern die Logik ihrer Anwendung. Physiognomische KI fällt nicht unter dem Druck der Kritik, sondern unter dem Druck der Transparenz. Debunking beginnt mit Fragen, nicht mit Antworten.