Was ist biometrische Gesichtserkennung im rechtlichen und technischen Sinne – und warum ist das nicht einfach nur ein „Foto"

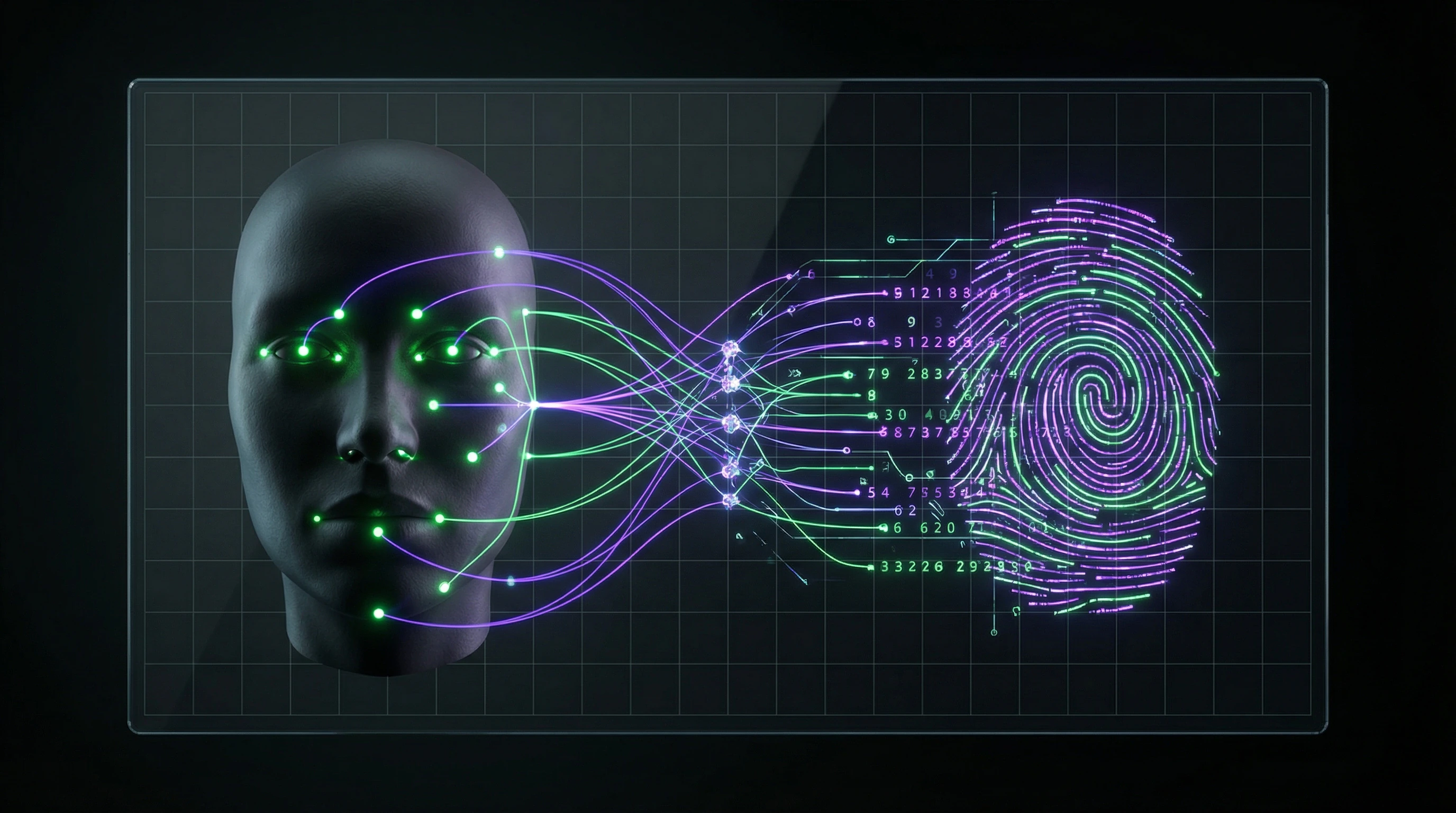

Biometrische Gesichtserkennung (Facial Recognition) ist eine automatisierte Technologie zur Identifizierung von Personen auf Basis einzigartiger physiologischer Gesichtsmerkmale. Im Gegensatz zu einem Foto erstellt das System ein mathematisches Modell: eine „biometrische Vorlage" oder einen „Faceprint" – eine Reihe numerischer Werte, die die Abstände zwischen Schlüsselpunkten des Gesichts beschreiben (S001).

Die Vorlage enthält den Abstand zwischen den Pupillen, die Nasenbreite, die Tiefe der Augenhöhlen und die Kieferkontur. Dies ermöglicht den Abgleich von Gesichtern unter verschiedenen Licht- und Winkelbedingungen, schafft aber ein Problem: Das Gesicht lässt sich im öffentlichen Raum nicht verbergen – anders als Fingerabdrücke oder die Iris. Mehr dazu im Abschnitt Grundlagen des maschinellen Lernens.

📌 Technische Architektur: vier Schritte vom Bild zur Entscheidung

- Detektion

- Das System trennt das Gesicht vom Hintergrund und anderen Objekten im Bild.

- Normalisierung

- Korrektur von Neigungswinkel, Skalierung und Beleuchtung zur Vereinheitlichung der Daten.

- Merkmalsextraktion

- Ein neuronales Netz analysiert das Bild und erstellt einen Vektor mit 128 bis 512 Zahlenwerten (S001).

- Abgleich

- Der erhaltene Vektor wird mit einer Datenbank verglichen und der Ähnlichkeitsgrad berechnet. Überschreitet dieser einen Schwellenwert, wird eine Übereinstimmung ausgegeben.

⚖️ Rechtliche Einordnung: warum Biometrie verstärkten Schutz erfordert

Im internationalen Recht sind biometrische Daten eine besondere Kategorie personenbezogener Daten. Die DSGVO ordnet sie den „besonderen Kategorien" zu, deren Verarbeitung grundsätzlich verboten ist (S001).

Ausnahmen sind nur bei ausdrücklicher Einwilligung der betroffenen Person, zum Schutz lebenswichtiger Interessen oder zur Erfüllung arbeitsrechtlicher Pflichten möglich. Auch die russische Gesetzgebung verlangt eine schriftliche Einwilligung zur Verarbeitung biometrischer personenbezogener Daten.

🧱 Kritischer Unterschied: Unmöglichkeit der Wiederherstellung und des Austauschs

Wenn ein Passwort geleakt wird, ändert man es. Wenn eine Karte gestohlen wird, sperrt man sie. Aber eine biometrische Gesichtsvorlage lässt sich nicht ändern: Ein Mensch kann sein „Gesicht nicht wechseln".

| Identifikator | Änderbar | Sichtbarkeit im öffentlichen Raum |

|---|---|---|

| Passwort | Ja, einfach | Verborgen |

| Bankkarte | Ja, Neuausstellung | Verborgen |

| Fingerabdruck | Nein | Erfordert physischen Kontakt |

| Gesicht (Biometrie) | Nein | Immer und überall sichtbar |

Einmal kompromittierte biometrische Daten bleiben ein Leben lang verwundbar. Dies schafft einzigartige Risiken, die Biometrie von allen anderen Formen der Identifikation unterscheiden.

Sieben Argumente der Befürworter massenhafter Gesichtserkennung — und warum sie überzeugend klingen

Bevor wir die Risiken analysieren, müssen wir die Argumente der Befürworter ehrlich betrachten. Die Technologie hätte sich nicht so weit verbreitet, wenn sie keine echten Vorteile böte. Das Verständnis der Logik dieser Argumente ermöglicht es zu bewerten, wo berechtigte Vorteile enden und ungerechtfertigte Risiken beginnen. Mehr dazu im Abschnitt Techno-Esoterik.

🛡️ Das Sicherheitsargument: Terrorprävention und Verbrecherverfolgung

Gesichtserkennungssysteme ermöglichen die Echtzeitidentifikation gesuchter Personen, von Terroristen aus Datenbanken und vermissten Kindern. Die biometrische Identifikation erfolgt augenblicklich und erfordert keine Kooperation der betroffenen Person — im Gegensatz zur manuellen Dokumentenprüfung, die durch gefälschte Papiere getäuscht werden kann.

Überwachungskameras mit Gesichtserkennungssystemen decken große Bereiche ab — Flughäfen, Bahnhöfe, Stadien — wo manuelle Kontrolle physisch unmöglich ist.

⚙️ Das Effizienzargument: Kostensenkung und Prozessbeschleunigung

Die Automatisierung der Identifikation verkürzt die Durchlaufzeit von Kontrollverfahren radikal. An Flughäfen durchlaufen Passagiere Check-in, Passkontrolle und Boarding ohne Vorlage von Dokumenten — ein Blick in die Kamera genügt.

Im Bankensektor beschleunigt biometrische Identifikation die Kontoeröffnung und Transaktionsabwicklung bei gleichzeitiger Reduzierung von Betrugsrisiken. In Unternehmen eliminieren Zugangskontrollsysteme die Notwendigkeit physischer Ausweise, die verloren gehen oder an Dritte weitergegeben werden können.

🧠 Das Komfortargument: Kontaktlose Identifikation ohne zusätzliche Handlungen

Biometrische Erkennung erfordert vom Nutzer keine aktiven Handlungen — keine Dokumente herausholen, keinen Finger auf einen Scanner legen, keine Passwörter eingeben. Dies ist besonders wichtig für Menschen mit Behinderungen (S002).

Die Technologie funktioniert auf Distanz, erfordert keinen physischen Kontakt mit Geräten, was im Kontext epidemiologischer Risiken relevant ist. Für ältere Menschen, denen das Merken von Passwörtern schwerfällt, kann biometrische Identifikation eine zugänglichere Authentifizierungsmethode sein.

- Erfordert keine aktiven Handlungen des Nutzers

- Funktioniert auf Distanz ohne physischen Kontakt

- Zugänglich für Menschen mit Behinderungen

- Reduziert kognitive Belastung (keine Passwörter merken)

📊 Das Genauigkeitsargument: Moderne Systeme übertreffen menschliche Fähigkeiten

Gesichtserkennungsalgorithmen auf Basis tiefer neuronaler Netze erreichen auf Standard-Testdatensätzen eine Genauigkeit von über 99% und übertreffen die menschliche Fähigkeit, Gesichter unter schwierigen Bedingungen zu erkennen (S001).

Systeme unterliegen nicht Ermüdung, emotionalen Zuständen oder kognitiven Verzerrungen, die die menschliche Wahrnehmung beeinflussen. Sie verarbeiten Tausende Gesichter pro Sekunde und können Gesichter bei schlechter Beleuchtung, teilweiser Verdeckung und Altersveränderungen erkennen.

Algorithmen lösen Aufgaben, bei denen Menschen schlechter abschneiden: Erkennung unter suboptimalen Bedingungen, Verarbeitung massiver Datenströme, Abwesenheit subjektiver Wahrnehmungsfehler.

🔁 Das Skalierbarkeitsargument: Die Technologie funktioniert auf Stadt- und Länderebene

Gesichtserkennungssysteme werden auf Ebene ganzer Städte ausgerollt und schaffen ein einheitliches Überwachungsnetzwerk mit der Möglichkeit, Personenbewegungen zu verfolgen. Dies ermöglicht Aufgaben, die mit traditionellen Methoden nicht lösbar sind: Suche nach vermissten Personen in der ganzen Stadt innerhalb von Minuten, Analyse von Besucherströmen in Einkaufszentren, Optimierung von Verkehrsrouten.

Die Technologie skaliert linear: Das Hinzufügen neuer Kameras erfordert keine proportionale Erhöhung der Anzahl von Bedienern.

💎 Das Unvermeidbarkeitsargument: Die Technologie ist bereits Teil der Infrastruktur

Gesichtserkennung ist bereits in kritische Infrastruktur integriert: Banksysteme, öffentliche Dienste, Verkehrsnetze, Unternehmenssicherheit. Ein Verzicht auf die Technologie würde den Abbau bestehender Systeme mit enormen Kosten und einer Verringerung des Sicherheitsniveaus erfordern.

Die Technologie entwickelt sich global: Wenn ein Land auf ihre Nutzung verzichtet, stoppt das nicht die Entwicklung in anderen Jurisdiktionen, schafft aber Wettbewerbsnachteile in den Bereichen Sicherheit und öffentliche Verwaltung.

🧭 Das Regulierbarkeitsargument: Die Technologie ist rechtlicher Kontrolle zugänglich

Im Gegensatz zu anonymer Überwachung erzeugen biometrische Identifikationssysteme eine digitale Spur, die überprüft und kontrolliert werden kann. Jeder Identifikationsvorgang wird in Systemprotokollen mit Angabe von Zeit, Ort und Bediener festgehalten.

Dies schafft Möglichkeiten für Audits und Rechenschaftspflicht bei Missbrauch. Die Technologie kann mit verschiedenen Genauigkeitsstufen und Auslöseschwellen konfiguriert werden, was eine Balance zwischen Sicherheit und Privatsphäre ermöglicht. Rechtliche Mechanismen wie die Anforderung eines richterlichen Beschlusses für den Zugang zu Datenbanken können die willkürliche Nutzung von Systemen begrenzen (S003).

- Digitale Spur

- Jede Systemhandlung wird mit Metadaten (Zeit, Ort, Bediener) erfasst, was theoretisch ein Audit und die Aufdeckung von Missbrauch ermöglicht.

- Konfigurierbare Parameter

- Genauigkeitsstufen und Auslöseschwellen können je nach Nutzungskontext und erforderlicher Balance zwischen Sicherheit und Privatsphäre variiert werden.

- Gerichtliche Kontrolle

- Die Anforderung eines Beschlusses für den Zugang zu Datenbanken schafft eine formale Barriere gegen willkürliche Systemnutzung.

Alle sieben Argumente stützen sich auf reale Vorteile der Technologie. Die Überzeugungskraft dieser Argumente basiert jedoch oft darauf, dass sie nur eine Seite der Gleichung betrachten — die Vorteile — und die Risiken ignorieren oder minimieren, die bei massenhafter Einführung entstehen. KI-Ethik und -Sicherheit erfordern eine umfassende Analyse, nicht die Wahl zwischen Komfort und Kontrolle.

Evidenzbasis: Was Studien über Genauigkeit, Fehler und systematische Verzerrungen von Erkennungsalgorithmen sagen

Behauptungen über hohe Genauigkeit erfordern kritische Überprüfung: Unter welchen Bedingungen wurden Tests durchgeführt, an welchen Stichproben, welche Metriken wurden verwendet. Besondere Aufmerksamkeit gilt systematischen Fehlern, bei denen Algorithmen vorhersagbar schlechtere Leistung für bestimmte Bevölkerungsgruppen zeigen. Mehr dazu im Abschnitt Synthetische Medien.

📊 Genauigkeitsmetriken: Was sich hinter der Zahl „99% accuracy" verbirgt

Behauptungen über 99% Genauigkeit erfordern Kontextverständnis. Es gibt zwei Modi: Verifikation (1:1-Vergleich — ist das dieselbe Person?) und Identifikation (1:N-Suche — wer ist diese Person unter N Einträgen?). Verifikation ist üblicherweise genauer, da das System zwei Vorlagen vergleicht.

Bei der Identifikation in einer großen Datenbank steigt die Wahrscheinlichkeit falscher Treffer proportional zur Datenbankgröße (S011). Wenn ein System eine Falsch-Positiv-Rate von 0,1% hat (Genauigkeit 99,9%), liefert es bei Prüfung gegen eine Datenbank mit 1 Million Einträgen 1000 falsche Übereinstimmungen.

Genauigkeit unter Laborbedingungen und Genauigkeit im realen Betrieb sind zwei unterschiedliche Metriken. Die erste misst Potenzial, die zweite Risiko.

⚠️ Systematische Verzerrungen: rassistische und geschlechtsspezifische Voreingenommenheit

Zahlreiche Studien haben signifikant höhere Fehlerquoten bei der Identifikation von Menschen mit dunkler Hautfarbe, Frauen und älteren Menschen festgestellt (S012). Ursache: Trainingsdatensätze enthalten überwiegend Bilder weißer Männer mittleren Alters.

Neuronale Netze erkennen Gesichter schlechter, die von diesem „Standard" abweichen. Solche Verzerrungen schaffen Diskriminierungsrisiken: Menschen aus unterrepräsentierten Gruppen werden häufiger Opfer falscher Anschuldigungen oder können aufgrund von Identifikationsfehlern keinen Zugang zu Dienstleistungen erhalten.

| Bevölkerungsgruppe | Typisches Problem | Fehlermechanismus |

|---|---|---|

| Menschen mit dunkler Haut | Hohe Falsch-Positiv-Rate | Unzureichende Repräsentation im Trainingsdatensatz |

| Frauen | Fehler bei Erkennung mit Make-up | Algorithmus trainiert auf Gesichtern ohne oder mit minimalem Make-up |

| Ältere Menschen | Nichtübereinstimmung mit jungen Fotos in der Datenbank | Altersbedingte Veränderungen der Gesichtszüge im Modell nicht berücksichtigt |

🧪 Testbedingungen vs. realer Betrieb

Labortests werden an sorgfältig vorbereiteten Datensätzen durchgeführt: hochwertige Fotos, kontrollierte Beleuchtung, frontale Perspektiven, keine Verdeckungen. Unter realen Bedingungen — auf Straßen, in U-Bahnen, Flughäfen — ist die Bildqualität deutlich geringer.

Niedrige Kameraauflösung, schlechte Beleuchtung, beliebige Aufnahmewinkel, teilweise Verdeckung des Gesichts durch Kleidung oder Accessoires führen dazu, dass die tatsächliche Genauigkeit erheblich unter der angegebenen liegt (S011). Die Kluft zwischen Labor und Feld ist kein technisches Detail, sondern eine Quelle systematischer Fehler in der Rechtsdurchsetzung.

- Laborbedingungen: kontrollierte Beleuchtung, frontale Perspektive, hohe Auflösung

- Feldbedingungen: natürliche Beleuchtung, beliebige Winkel, niedrige Auflösung

- Ergebnis: Genauigkeit sinkt je nach System um 5–15%

- Rechtliche Konsequenz: Anschuldigungen auf Basis von Erkennung erfordern zusätzliche Verifikation

🔎 Problem der Veränderung des Aussehens: Make-up, Alterung, medizinische Zustände

Erkennungssysteme sind anfällig für Veränderungen des Aussehens. Make-up, insbesondere Konturierung, kann die wahrgenommene Geometrie des Gesichts so verändern, dass der Algorithmus die Person nicht erkennt. Natürliche Alterung verändert Züge: Haut verliert Elastizität, Falten entstehen, die Gesichtsform ändert sich.

- Make-up und Konturierung

- Verändert die Gesichtsgeometrie im Merkmalsraum des Algorithmus. Das System erkennt möglicherweise eine Person nicht, die anders aussieht als auf dem Ausgangsfoto in der Datenbank. Das Problem verschärft sich, wenn Make-up professionell aufgetragen wurde.

- Natürliche Alterung

- Falten, Veränderung der Gesichtsform, Verlust der Hautelastizität — all dies verschiebt die biometrische Vorlage. Eine Person, deren Foto in der Datenbank vor 10 Jahren aufgenommen wurde, stimmt möglicherweise nicht mit der aktuellen Erkennung überein.

- Medizinische Zustände

- Schwellungen, Verletzungen, plastische Operationen verändern die Gesichtsgeometrie. Dies schafft die Notwendigkeit regelmäßiger Aktualisierung biometrischer Vorlagen, was den Betrieb erschwert und zusätzliche Risiken von Datenlecks schafft.

Das Problem verschärft sich dadurch, dass Menschen oft nicht wissen, dass ihre biometrischen Daten aktualisiert werden müssen. Das System kann den Zugang verweigern oder eine falsche Übereinstimmung liefern, und die Person bleibt ohne Erklärung des Grundes.

Eine biometrische Vorlage ist kein statischer Identifikator wie ein Fingerabdruck. Es ist ein dynamisches Abbild, das sich mit Alter, Gesundheit und persönlicher Wahl verändert. Systeme, die diese Realität ignorieren, schaffen die Illusion von Genauigkeit, nicht die Genauigkeit selbst.

Der Zusammenhang zwischen diesen technischen Einschränkungen und der Rückkehr der Physiognomik im KI-Zeitalter wird offensichtlich: Algorithmen wiederholen die Fehler des 19. Jahrhunderts, aber mit dem Anschein von Wissenschaftlichkeit. Zum Verständnis der ethischen Konsequenzen siehe Ethik und Sicherheit der KI.

Funktionsweise neuronaler Netze bei der Gesichtserkennung: Warum die „Black Box" rechtliche Probleme schafft

Das Verständnis des technischen Mechanismus ist entscheidend für die Bewertung rechtlicher Konsequenzen. Moderne Systeme basieren auf tiefen Convolutional Neural Networks (CNN), die mit Millionen von Gesichtsbildern trainiert werden. Mehr dazu im Abschnitt Logische Fehlschlüsse.

Der Entscheidungsprozess innerhalb des neuronalen Netzes bleibt selbst für Entwickler undurchsichtig — das „Black Box"-Problem, das fundamentale Schwierigkeiten für die rechtliche Regulierung schafft.

🧠 Architektur tiefer neuronaler Netze: Von Pixeln zur Entscheidung

Erkennungssysteme verwenden Architekturen wie FaceNet, VGGFace, ArcFace — tiefe neuronale Netze mit Dutzenden oder Hunderten von Schichten. Die ersten Schichten extrahieren einfache Merkmale: Kanten, Ecken, Texturen.

Mittlere Schichten kombinieren diese Merkmale zu komplexeren Mustern: Formen von Augen, Nase, Mund. Tiefe Schichten erzeugen abstrakte Repräsentationen, die keine direkte visuelle Interpretation mehr haben — mehrdimensionale Vektoren im Merkmalsraum (S001). Die finale Schicht transformiert diese Vektoren in eine kompakte Darstellung — eine biometrische Vorlage zum Vergleich.

- Eingabeschicht: Verarbeitung der Bildpixel

- Schichten 1–5: Extraktion lokaler Merkmale (Texturen, Kanten)

- Schichten 6–15: Kombination zu regionalen Mustern

- Schichten 16–25: Abstrakte Gesichtsrepräsentationen

- Ausgabeschicht: Biometrische Vorlage und Übereinstimmungsentscheidung

⚙️ Das Erklärbarkeitsproblem: Warum hat das System genau diese Entscheidung getroffen

Das kritische Problem: Die Unmöglichkeit zu erklären, warum eine bestimmte Entscheidung getroffen wurde. Wenn das System eine Person als übereinstimmend mit einem Datenbankeintrag identifiziert hat, ist es unmöglich anzugeben, welche konkreten Gesichtsmerkmale zu dieser Schlussfolgerung führten.

Das Recht auf Erklärung von Entscheidungen automatisierter Systeme ist in der DSGVO verankert (S002). Aber es technisch für tiefe neuronale Netze zu realisieren ist äußerst schwierig — dies schafft eine Kluft zwischen rechtlicher Anforderung und technischer Realität.

Wie kann eine Person eine Entscheidung anfechten, wenn es unmöglich ist, deren Grundlagen zu verstehen? Dies ist ein fundamentales Problem für die Fairness des Gerichtsverfahrens.

🔁 Training mit Daten: Woher kommen Millionen von Gesichtern für das Training

Für das Training eines effektiven Systems werden Millionen von Gesichtsbildern mit Annotationen benötigt. Woher kommen sie? Oft aus öffentlich zugänglichen Quellen: sozialen Netzwerken, Fotodatenbanken, Videoaufzeichnungen.

Viele Menschen wissen nicht, dass ihre Fotos zum Training kommerzieller Systeme verwendet werden. Dies verletzt Datenschutzprinzipien (S002). Wenn der Trainingsdatensatz unausgewogen ist (wenige Bilder von Menschen bestimmter ethnischer Gruppen), führt dies zu systematischen Verzerrungen in der Systemleistung.

| Datenquelle | Umfang | Problem |

|---|---|---|

| Soziale Netzwerke | Milliarden Fotos | Fehlende Einwilligung der Betroffenen |

| Fotodatenbanken | Hunderte Millionen | Unklare Lizenznutzung |

| Videoaufzeichnungen (Kameras) | Millionen Frames | Massenüberwachung ohne Benachrichtigung |

| Staatliche Datenbanken | Dutzende Millionen | Zentralisierte Kontrolle |

🧷 Adversarial Attacks: Wie man Erkennungssysteme täuscht

Neuronale Netze sind anfällig für Adversarial Attacks — speziell konstruierte Störungen der Eingabedaten, die das System zu falschen Entscheidungen veranlassen. Bei der Gesichtserkennung kann dies spezielles Make-up, Brillen mit bestimmten Mustern oder Aufkleber im Gesicht sein.

Diese Störungen sind für Menschen unsichtbar, verändern aber radikal die Ausgabe des neuronalen Netzes (S003). Die Existenz solcher Angriffe zeigt, dass Erkennungssysteme unter Gegenwehr nicht zuverlässig sind.

Wenn ein Angreifer weiß, wie man das System täuscht, verliert es seine Schutzfunktion. Dies ist kritisch für Sicherheitsanwendungen — das System wird zu einem Werkzeug, das umgangen werden kann, statt zu einem verlässlichen Kontrollmechanismus.

Das Paradox: Je „intelligenter" das System wird, desto spezifischer werden die Methoden zu seiner Umgehung. Dies schafft ein Wettrüsten zwischen Entwicklern von Schutzmaßnahmen und jenen, die Schwachstellen suchen.

Interessenkonflikt: Wo gesellschaftliche Sicherheit und individuelles Recht auf Privatsphäre aufeinandertreffen

Die biometrische Gesichtserkennung steht im Zentrum eines fundamentalen Konflikts zwischen kollektiver Sicherheit und individueller Freiheit. Einerseits hat der Staat die legitime Pflicht, Bürger vor Kriminalität und Terrorismus zu schützen. Andererseits schafft Massenüberwachung Risiken für Missbrauch, Unterdrückung von Andersdenkenden und totale Kontrolle. Mehr dazu im Abschnitt Psychologie des Glaubens.

Dieser Konflikt hat keine einfache Lösung – er erfordert eine sorgfältige Abwägung der Interessen, bei der jede Entscheidung zugunsten einer Seite automatisch die andere schwächt.

🕳️ Unschuldsvermutung auf dem Kopf: Wenn jeder zum Verdächtigen wird

Massenhafte biometrische Überwachung kehrt die Unschuldsvermutung um. Im traditionellen Rechtssystem gilt ein Mensch als unschuldig, bis seine Schuld bewiesen ist, und Überwachung beginnt erst nach Entstehung eines Verdachts. Systeme zur massenhaften Gesichtserkennung funktionieren umgekehrt: Jede Person im öffentlichen Raum wird automatisch gescannt und mit Datenbanken abgeglichen.

Das bedeutet, dass jeder als potenzieller Krimineller betrachtet wird, der überprüft werden muss. Dieser Ansatz verändert fundamental das Verhältnis zwischen Bürger und Staat und schafft eine Atmosphäre totalen Misstrauens.

🧩 Abschreckungseffekt: Wie Überwachung die Meinungsfreiheit unterdrückt

Das Bewusstsein, dass das eigene Gesicht ständig gescannt und die eigenen Bewegungen verfolgt werden, verändert das Verhalten der Menschen. Dieses Phänomen wird als „Chilling Effect" (Abschreckungseffekt) bezeichnet: Menschen vermeiden es, bestimmte Orte zu besuchen, an Protesten teilzunehmen oder sich mit bestimmten Personen zu treffen, aus Angst vor Konsequenzen.

Selbst wenn das System nur zur Suche nach Kriminellen eingesetzt wird, erzeugt allein seine Existenz psychologischen Druck. Dies ist besonders gefährlich für die Versammlungs- und Meinungsfreiheit: Wenn Demonstrationsteilnehmer wissen, dass ihre Gesichter identifiziert und aufgezeichnet werden, werden viele auf eine Teilnahme verzichten (S001).

| Szenario | Ohne Massenüberwachung | Mit Massenüberwachung |

|---|---|---|

| Teilnahme an Demonstration | Entscheidung basiert auf Überzeugungen | Entscheidung beinhaltet Risikoabwägung der Identifizierung |

| Besuch eines Treffpunkts | Ortswahl ist frei | Wahl eingeschränkt durch Angst vor Aufzeichnung |

| Öffentliche Aktivität | Anonymität in der Menge | Vollständige Nachverfolgbarkeit |

🛡️ Schutz vulnerabler Gruppen: Kinder, Geflüchtete, Gewaltopfer

Bestimmte Personengruppen sind besonders anfällig für die Risiken biometrischer Überwachung. Kinder können keine informierte Einwilligung zur Verarbeitung ihrer biometrischen Daten geben, doch ihre Gesichter gelangen durch schulische Sicherheitssysteme oder öffentliche Überwachung in Erkennungssysteme.

- Geflüchtete und Asylsuchende

- Können identifiziert und abgeschoben werden, wenn ihre biometrischen Daten in die Hände der Behörden des Landes gelangen, aus dem sie geflohen sind (S006).

- Opfer häuslicher Gewalt

- Verlieren die Möglichkeit der Anonymität, wenn ihre Gesichter durch Erkennungssysteme gefunden werden können, was es Verfolgern erleichtert, sie aufzuspüren (S008).

- Aktivisten und Journalisten

- Werden anfällig für gezielte Repressionen in Ländern mit eingeschränkter Pressefreiheit.

⚠️ Risiken autoritärer Nutzung: Von Kontrolle bis Repression

Die Geschichte zeigt, dass Überwachungstechnologien, die zur Verbrechensbekämpfung geschaffen wurden, für politische Repression missbraucht werden können. Gesichtserkennungssysteme ermöglichen es, Demonstrationsteilnehmer zu identifizieren, Bewegungen von Oppositionellen zu verfolgen und Profile politischer Aktivität zu erstellen.

In autoritären Regimen werden solche Systeme zu Instrumenten der Unterdrückung von Andersdenkenden. Selbst in demokratischen Ländern besteht das Risiko des „Function Creep" (schleichende Funktionserweiterung): Systeme, die ursprünglich für eng begrenzte Sicherheitszwecke geschaffen wurden, erweitern schrittweise ihren Anwendungsbereich und erfassen immer mehr Aspekte des Lebens der Bürger (S001).

Technologie ist neutral, aber ihre Anwendung hängt vom politischen Kontext ab. Ein Werkzeug, das in einer Demokratie sicher ist, wird in den Händen autoritärer Regime zur Waffe.

Verwandte Materialien: Ethik und Sicherheit von KI: Wie man verantwortungsvoll entwickelt und nutzt und KI-Physiognomik und die Rückkehr der Phrenologie: Warum Gesichtserkennungsalgorithmen die Fehler des 19. Jahrhunderts wiederholen.

Internationale Standards zum Schutz biometrischer Daten: Anforderungen der DSGVO, Konvention 108+ und nationaler Gesetzgebungen

Die Rechtsregulierung der biometrischen Gesichtserkennung entwickelt sich auf mehreren Ebenen: internationale Konventionen, regionale Verordnungen (wie die DSGVO in der EU), nationale Gesetze. Diese Normen legen Grundsätze für die Verarbeitung biometrischer Daten, Anforderungen an die Einwilligung der Betroffenen und Einschränkungen bei der Nutzung der Technologie fest. Mehr dazu im Bereich Kosmologie und Astronomie.

Die Rechtsdurchsetzung bleibt jedoch problematisch: Die Technologie entwickelt sich schneller als die Gesetzgebung, und die Kontrolle der Einhaltung von Normen ist erschwert.

📌 DSGVO: Biometrie als besondere Datenkategorie

Die DSGVO (Datenschutz-Grundverordnung) klassifiziert biometrische Daten als besondere Kategorie – gleichrangig mit genetischen Informationen und Gesundheitsdaten (S001). Dies bedeutet ein Verarbeitungsverbot ohne ausdrückliche Einwilligung der betroffenen Person, mit Ausnahme enger Fälle (Sicherheit, Strafverfolgung, lebenswichtige Interessen).

Das DSGVO-Paradox: Die Verordnung schützt Daten, löst aber nicht das Problem systematischer Algorithmusfehler. Selbst bei vollständiger Einhaltung der Verfahren kann die Technologie nach Geschlecht, Alter und ethnischer Zugehörigkeit diskriminieren.

Artikel 9 DSGVO verbietet die Verarbeitung biometrischer Daten zur Identifizierung im öffentlichen Raum ohne spezielle gesetzliche Grundlage. Dies schafft eine Barriere für die massenhafte Einführung von Facial Recognition auf Flughäfen, Straßen und in Einkaufszentren.

📌 Konvention 108+: globales Minimum

Die Konvention 108+ (Europarat) etabliert einen internationalen Standard zum Schutz personenbezogener Daten, einschließlich Biometrie. Ihre Anforderungen sind weicher als die DSGVO, umfassen aber einen breiteren Kreis von Ländern (einschließlich Russland, Ukraine, Moldau).

- Rechtmäßigkeitsprinzip: Verarbeitung nur auf Grundlage eines Gesetzes oder einer Einwilligung

- Verhältnismäßigkeitsprinzip: Der Zweck muss die Mittel rechtfertigen

- Transparenzprinzip: Die betroffene Person muss wissen, dass ihre Daten verarbeitet werden

- Recht auf Zugang und Berichtigung: Die betroffene Person kann Daten überprüfen und anfechten

Die Konvention 108+ verbietet Facial Recognition nicht, verlangt aber, dass jeder Staat eigene Beschränkungen in der nationalen Gesetzgebung festlegt.

📌 Nationale Gesetzgebungen: Fragmentierung und Lücken

Verschiedene Länder wählen unterschiedliche Ansätze. Frankreich und Deutschland beschränken Facial Recognition im öffentlichen Raum. Die USA setzen auf sektorale Regulierung (Biometriegesetz in Illinois, Videoüberwachungsgesetze in einzelnen Bundesstaaten).

| Rechtsraum | Ansatz | Beschränkungen |

|---|---|---|

| EU (DSGVO) | Restriktiv | Facial Recognition im öffentlichen Raum erfordert Gesetz |

| USA | Sektoral | Abhängig von Bundesstaat und Sektor (Polizei, Handel, Fintech) |

| China | Permissiv | Minimale Beschränkungen, breite Nutzung im Sozialkreditsystem |

| Russland | Gemischt | Konvention 108+, aber nationale Gesetzgebung entwickelt sich |

Die Fragmentierung schafft ein Problem: Unternehmen, die in mehreren Rechtsräumen tätig sind, müssen unterschiedliche Standards einhalten. Dies verlangsamt Innovationen, schützt aber Bürger vor einer Vereinheitlichung nach dem schwächsten Standard.

Der Zusammenhang mit Ethik und KI-Sicherheit wird in einem separaten Artikel behandelt. Dort wird auch diskutiert, wie moderne Algorithmen Fehler des 19. Jahrhunderts wiederholen.

📌 Problem der Rechtsdurchsetzung: Technologie überholt das Gesetz

Selbst strenge Gesetze (wie die DSGVO) stoßen auf Kontrollprobleme. Wie lässt sich überprüfen, dass ein Unternehmen Facial Recognition nicht im Hintergrund nutzt? Wie lässt sich Diskriminierung nachweisen, wenn der Algorithmus als „Black Box" funktioniert?

- Problem 1: Informationsasymmetrie

- Regulierungsbehörden haben keinen Zugang zu Quellcode und Trainingsdaten der Algorithmen. Unternehmen können Fehler und Verzerrungen verbergen.

- Problem 2: Grenzüberschreitende Natur

- Daten werden in der Cloud verarbeitet, Server befinden sich in verschiedenen Ländern. Welches Gesetz gilt? Wer trägt die Verantwortung?

- Problem 3: Innovationsgeschwindigkeit

- Neue Anwendungen von Facial Recognition (Deepfakes, synthetische Videos) entstehen schneller, als Gesetzgeber reagieren können. Die Erkennung von Deepfakes ist ein eigenständiges Problem.

Fazit: Internationale Standards legen Grundsätze fest, aber ihre Umsetzung hängt vom politischen Willen und den technischen Kontrollmöglichkeiten ab. Ohne Transparenz der Algorithmen und unabhängige Audits bleiben selbst die strengsten Gesetze auf dem Papier.