⚖️ KI-Ethik

⚖️ KI-EthikEthische Prinzipien und Sicherheit künstlicher Intelligenz in der Medizinλ

Untersuchung ethischer Normen, Informationssicherheit und verantwortungsvoller Einsatz von KI-Technologien in der klinischen Praxis und medizinischen Forschung

Overview

Die Implementierung künstlicher Intelligenz in der Medizin erfordert die strikte Einhaltung ethischer Prinzipien und Sicherheitsprotokolle. KI-Systeme für die intraoperative Visualisierung von Nebenschilddrüsen, Algorithmen zur Analyse von Brustkrebsrisikofaktoren und Entscheidungsunterstützungssysteme bei der Behandlung altersbedingter Makuladegeneration demonstrieren das Potenzial der Technologie, werfen jedoch gleichzeitig Fragen zum Datenschutz, zur Transparenz von Algorithmen und zur klinischen Verantwortung auf. Ethische Rahmenbedingungen müssen ein Gleichgewicht zwischen Innovation und dem Schutz von Patientenrechten gewährleisten und sicherstellen, dass KI ein Unterstützungsinstrument bleibt und kein Ersatz für professionelles medizinisches Urteilsvermögen.

🛡️ Laplace-Protokoll: Alle KI-Systeme durchlaufen eine mehrstufige Prüfung auf Übereinstimmung mit ethischen Standards, einschließlich der Bewertung von Algorithmustransparenz, Schutz personenbezogener Daten, klinischer Validierung und Einhaltung der Prinzipien der informierten Einwilligung vor der Implementierung in die Praxis.

Reference Protocol

Wissenschaftliche Grundlage

Evidenzbasierter Rahmen für kritische Analyse

Protocol: Evaluation

Teste Dich

Quiz zu diesem Thema kommt bald

Sector L1

Artikel

Forschungsmaterialien, Essays und tiefe Einblicke in die Mechanismen des kritischen Denkens.

⚖️ KI-Ethik

⚖️ KI-Ethik ⚖️ KI-Ethik

⚖️ KI-Ethik ⚖️ KI-Ethik

⚖️ KI-Ethik ⚖️ KI-Ethik

⚖️ KI-Ethik ⚖️ KI-Ethik

⚖️ KI-Ethik ⚖️ KI-Ethik

⚖️ KI-Ethik⚡

Vertiefung

Ethische Prinzipien der KI-Anwendung in der klinischen Praxis: Wo der Algorithmus endet und der Arzt beginnt

Die Implementierung künstlicher Intelligenz in der Medizin schafft ein fundamentales ethisches Paradoxon: Eine Technologie, die die Versorgungsqualität verbessern soll, kann grundlegende Prinzipien der ärztlichen Ethik verletzen, wenn die Grenzen ihrer Anwendung nicht berücksichtigt werden. Systematische Übersichtsarbeiten zur Anwendung KI-assistierter Systeme in der Chirurgie zeigen, dass sich die Technologie in der Validierungsphase befindet und klinische Expertise nicht ersetzen kann.

Die zentrale Frage lautet nicht „kann KI", sondern „sollte KI" Entscheidungen ohne menschliche Beteiligung in kritischen klinischen Situationen treffen.

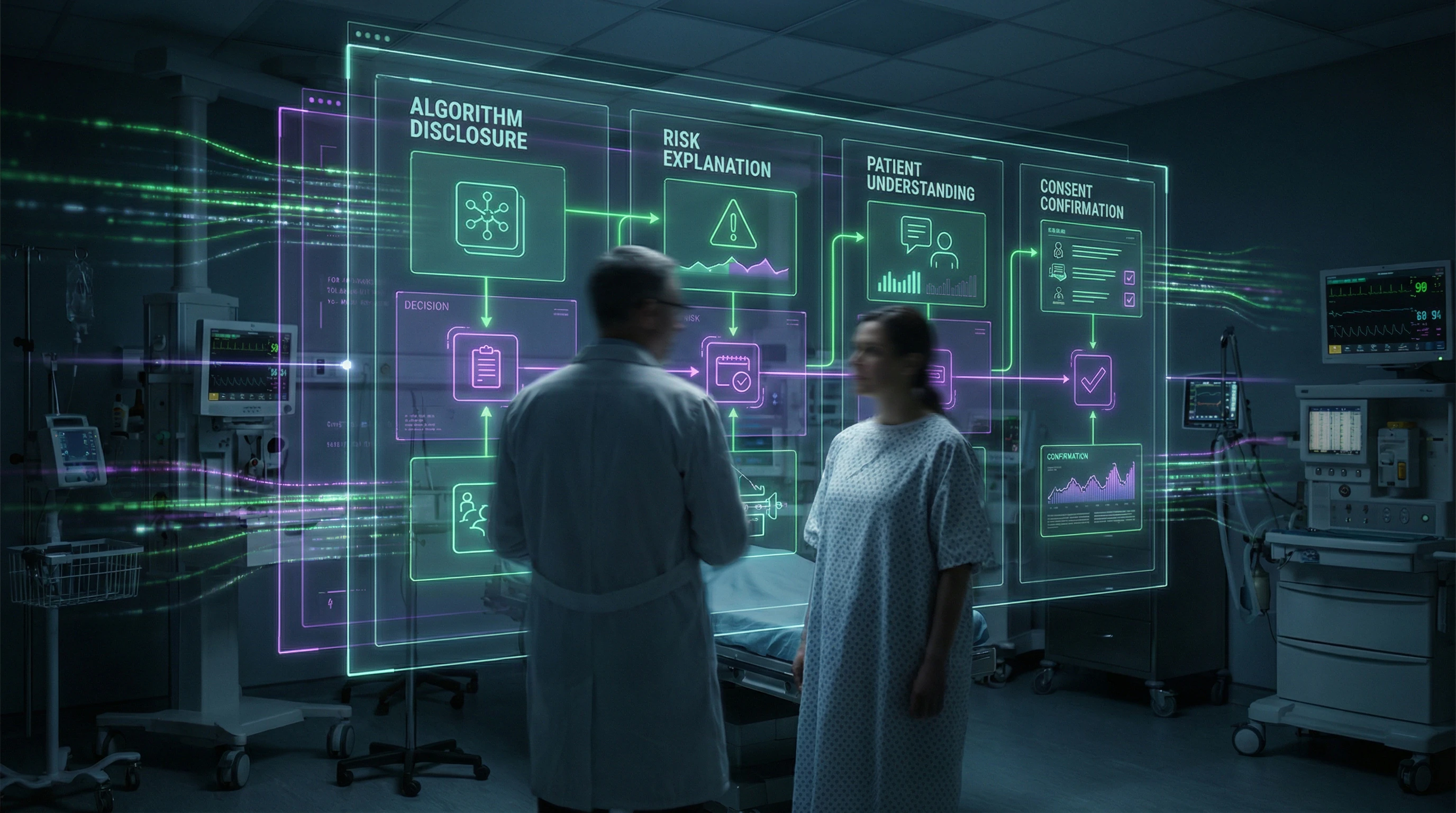

Patientenautonomie und informierte Einwilligung im Zeitalter der Algorithmen

Das traditionelle Modell der informierten Einwilligung setzt voraus, dass der Patient die Art des vorgeschlagenen Eingriffs versteht, doch KI-Systeme schaffen eine „Black Box", in der die Entscheidungslogik selbst für Ärzte undurchsichtig bleibt. Studien zur KI-assistierten intraoperativen Bildgebung zur Identifikation von Nebenschilddrüsen zeigen, dass Computer-Vision-Systeme komplexe Algorithmen verwenden, deren Funktionsweise nicht immer in klinischen Begriffen erklärbar ist.

Der Patient hat das Recht zu wissen, dass eine diagnostische oder therapeutische Entscheidung auf einem Algorithmus basiert und nicht ausschließlich auf dem klinischen Urteil des Arztes. Ohne dieses Wissen wird die Autonomie des Patienten – seine Fähigkeit, informierte Entscheidungen über die eigene Gesundheit zu treffen – verletzt.

- Einwilligungsprotokoll

- Muss eine Erklärung der Rolle des KI-Systems umfassen: Ist es ein unterstützendes Werkzeug oder trifft es autonome Entscheidungen, wie hoch ist die Genauigkeit des Algorithmus, welche alternativen Methoden existieren.

- Klinische Relevanz

- Besonders hoch im Kontext chirurgischer Eingriffe, wo Fehler bei der Identifikation anatomischer Strukturen zu schwerwiegenden Komplikationen führen können – beispielsweise versehentliche Entfernung von Nebenschilddrüsen mit nachfolgender Hypokalzämie oder Schädigung des Nervus laryngeus recurrens.

Der Arzt bleibt für die endgültige Entscheidung verantwortlich, aber der Patient muss verstehen, auf welcher Datengrundlage diese Entscheidung getroffen wurde.

Transparenz und Erklärbarkeit von Algorithmen: Anforderung oder Utopie

Moderne KI-Systeme, insbesondere solche auf Basis von Deep Learning, stellen mehrschichtige neuronale Netze mit Millionen von Parametern dar, was ihre Entscheidungen im traditionellen Sinne praktisch unerklärbar macht. Die systematische Übersichtsarbeit zur KI-assistierten Identifikation von Nebenschilddrüsen weist auf die Notwendigkeit der Validierung der diagnostischen Leistung dieser Systeme hin, offenbart jedoch nicht die Mechanismen, durch die der Algorithmus Gewebe erkennt.

Der Arzt muss einem Instrument vertrauen, ohne vollständig zu verstehen, wie es funktioniert – eine Situation, die der Verwendung komplexer medizinischer Geräte ähnelt, jedoch mit einem kritischen Unterschied: KI beeinflusst das klinische Urteil, nicht nur die Messung von Parametern.

Die praktische Lösung liegt in der Entwicklung „erklärbarer KI" (explainable AI, XAI) – Systeme, die klinisch relevante Begründungen für ihre Empfehlungen liefern können. Für chirurgische Anwendungen könnte dies die Visualisierung von Bildbereichen bedeuten, die der Algorithmus als Nebenschilddrüsengewebe identifiziert hat, mit Angabe des Konfidenzlevels.

- Daten, mit denen das System trainiert wurde

- Leistungsmetriken aus Validierungsstudien

- Bekannte Einschränkungen und Fälle fehlerhafter Ergebnisse

- Bedingungen, unter denen die Empfehlung des Algorithmus unzuverlässig sein könnte

Ohne diese Informationen kann der Arzt die Empfehlung des Algorithmus nicht kritisch bewerten und trägt die Verantwortung für Entscheidungen, die auf intransparenten Daten basieren.

Informationssicherheit medizinischer Daten: Warum ein Datenleck nicht nur eine Geldstrafe bedeutet, sondern Leben gefährdet

Medizinische Daten sind die sensibelste Kategorie personenbezogener Informationen. Ihre Kompromittierung führt nicht nur zu Verletzungen der Privatsphäre, sondern auch zu direktem physischem Schaden für Patienten.

KI-Systeme benötigen massive Datensätze für Training und Validierung. Netzwerk-Metaanalysen zur Wirksamkeit von Anti-VEGF-Therapien bei neovaskulärer altersbedingter Makuladegeneration vereinen Daten zahlreicher klinischer Studien, um visuelle Ergebnisse und Sicherheitsprofile verschiedener Medikamente zu vergleichen. Jeder Datenpunkt ist ein realer Patient mit einer einzigartigen Krankengeschichte.

| Risiko eines Datenlecks | Folgen |

|---|---|

| Diskriminierung bei Versicherungen | Ablehnung der Deckung, Erhöhung der Prämien |

| Diskriminierung bei Einstellungen | Ablehnung der Beschäftigung aufgrund des Gesundheitszustands |

| Gezielte Angriffe | Körperlicher Schaden, Erpressung, Nötigung |

Schutz personenbezogener Patientendaten: Von der Anonymisierung bis zur differenziellen Privatsphäre

Traditionelle Anonymisierung – die Entfernung direkter Identifikatoren (Name, Adresse, Geburtsdatum) – erweist sich im Zeitalter von Big Data und maschinellem Lernen als unzureichend.

Systematische Reviews, die den Zusammenhang zwischen Body-Mass-Index und dem Risiko für Brustkrebs nach molekularen Subtypen analysieren, verwenden Daten, die demografische Merkmale, Menopausenstatus, Hormonrezeptorstatus und HER2-Status umfassen. Die Kombination dieser Merkmale kann einzigartig sein und eine Re-Identifizierung selbst bei Entfernung des Namens ermöglichen. Die klinische Bedeutung des Verständnisses differenzieller BMI-Effekte auf verschiedene Krebssubtypen erfordert detaillierte Daten – dies schafft eine Spannung zwischen wissenschaftlichem Wert und Schutz der Privatsphäre.

Differenzielle Privatsphäre ist eine mathematische Methode, die kontrolliertes „Rauschen" zu Daten hinzufügt, sodass statistische Schlussfolgerungen valide bleiben, aber individuelle Datensätze nicht wiederhergestellt werden können.

Für das Training von KI-Systemen zur Identifizierung von Nebenschilddrüsen bedeutet dies, dass der Algorithmus aus realen chirurgischen Bildern lernen kann, ohne dass ein bestimmtes Bild mit einem bestimmten Patienten verknüpft werden kann.

Föderiertes Lernen ist ein weiterer Ansatz, bei dem das Modell lokal auf den Daten jeder medizinischen Einrichtung trainiert wird und nur die Aktualisierungen der Modellparameter, nicht aber die Daten selbst, zentral übermittelt werden. Diese Technologien bieten keinen absoluten Schutz, erhöhen aber die Komplexitätsschwelle für potenzielle Angriffe erheblich.

Verschlüsselungsprotokolle und Zugangskontrollen: Technische Barrieren gegen den menschlichen Faktor

Die meisten Datenlecks medizinischer Daten entstehen nicht durch technische Schwachstellen, sondern durch menschliche Faktoren: Phishing-Angriffe, schwache Passwörter, unbefugter Zugriff durch Insider.

Netzwerk-Metaanalysen, die die Wirksamkeit verschiedener Anti-VEGF-Wirkstoffe (Aflibercept, Ranibizumab, Bevacizumab, Brolucizumab, Faricimab) vergleichen, erfordern Zugang zu detaillierten Daten klinischer Studien, die oft in verteilten Systemen gespeichert sind. Jeder Zugangspunkt ist eine potenzielle Schwachstelle.

- Prinzip der minimalen Berechtigungen: Jeder Benutzer erhält nur Zugriff auf die notwendigen Daten und nur für die Dauer der Ausführung einer bestimmten Aufgabe

- End-to-End-Verschlüsselung von Daten im Ruhezustand und bei der Übertragung

- Multi-Faktor-Authentifizierung für alle Benutzer

- Audit aller Datenzugriffe mit automatischer Erkennung anomaler Zugriffsmuster

- Regelmäßige Penetrationstests

- Verpflichtende Schulung des Personals in den Grundlagen der Informationssicherheit

Für KI-Systeme, die mit medizinischen Bildern arbeiten, ist die Verschlüsselung auf Speicherebene von entscheidender Bedeutung. Intraoperative Bilder von Nebenschilddrüsen enthalten nicht nur die anatomische Zielstruktur, sondern auch umgebendes Gewebe, anhand dessen der Patient potenziell identifiziert werden könnte.

Die Technologie zum Schutz von Daten entwickelt sich langsamer als die Technologie zu ihrer Nutzung – diese Lücke schafft ein Fenster der Verwundbarkeit, das mit jeder neuen KI-Anwendung in der Klinik wächst.

KI als Instrument zur Unterstützung chirurgischer Entscheidungen: Assistent, nicht Autopilot

Ein grundlegendes Missverständnis in Diskussionen über KI in der Chirurgie ist die Vorstellung, dass die Technologie den Chirurgen ersetzen kann oder sollte. KI-gestützte Systeme zur intraoperativen Bildgebung für die Identifikation von Nebenschilddrüsen werden als unterstützende Instrumente positioniert, die sich in der Validierungsphase befinden.

Der klinische Bedarf für solche Systeme ergibt sich aus objektiver Komplexität: Versehentliche Entfernung oder Schädigung von Nebenschilddrüsen führt zu Hypokalzämie, fehlerhafte Identifikation erhöht das Risiko einer Schädigung des Nervus laryngeus recurrens. Die KI trifft nicht die Entscheidung „entfernen oder nicht entfernen" – sie liefert zusätzliche Informationen für diese Entscheidung durch den Chirurgen.

Intraoperative Identifikation von Nebenschilddrüsen: Wo Computer Vision dem menschlichen Auge überlegen ist

Computer-Vision-Systeme analysieren intraoperative Bilder in Echtzeit unter Verwendung von Algorithmen, die auf Tausenden annotierten chirurgischen Bildern trainiert wurden. Der Vorteil der KI liegt in der Fähigkeit, zahlreiche visuelle Merkmale gleichzeitig zu verarbeiten: Farbe, Textur, Vaskularisation, Position relativ zu anderen Strukturen.

Das menschliche Auge kann subtile Unterschiede übersehen, insbesondere bei atypischer Lage der Drüse oder veränderter Anatomie nach vorherigen Operationen. Die KI vergleicht das aktuelle Bild mit einer umfangreichen Datenbank von Referenzfällen, was das diagnostische Spektrum erweitert.

| Parameter | KI-Fähigkeit | Einschränkung |

|---|---|---|

| Größe der Nebenschilddrüse | Erkennung von Strukturen 3–8 mm in Echtzeit | Seltene anatomische Varianten können im Trainingsdatensatz fehlen |

| Visuelle Merkmale | Simultane Analyse von Farbe, Textur, Vaskularisation | Ähnlichkeit mit Lymphknoten, Fettgewebe, Schilddrüsengewebe |

| Klinischer Kontext | Bereitstellung bildbasierter Empfehlungen | Fehlender Zugang zu präoperativen Daten, Laborwerten, Krankengeschichte |

Die diagnostische Leistung des Systems ist kein Ersatz für klinisches Urteilsvermögen, sondern dessen Erweiterung. Nur der Chirurg kann die KI-Informationen mit dem vollständigen klinischen Kontext integrieren: präoperative Bildgebungsdaten, Parathormon-Laborwerte, intraoperative Befunde.

Grenzen der Automatisierung und die Rolle des Chirurgen: Warum das letzte Wort immer beim Menschen liegt

Automatisierung in der Chirurgie hat strikte Grenzen, die nicht nur durch technologische Einschränkungen, sondern auch durch ethische und rechtliche Rahmenbedingungen definiert werden. Die Technologie befindet sich in der Validierungsphase, was bedeutet: Sie ist nicht bereit für autonome Anwendung ohne Aufsicht eines erfahrenen Spezialisten.

Eine chirurgische Entscheidung ist nicht nur die Identifikation einer anatomischen Struktur, sondern auch die Bewertung von Risiken und Nutzen einer bestimmten Maßnahme für einen bestimmten Patienten in einer bestimmten klinischen Situation. Die KI hat keinen Zugang zum vollständigen Kontext: Krankengeschichte, Patientenpräferenzen, Begleiterkrankungen, soziale Faktoren, die das Ergebnis beeinflussen können.

Das optimale Modell ist „Human-in-the-Loop": Die KI liefert eine Empfehlung mit Angabe des Konfidenzlevels, der Chirurg bewertet diese Empfehlung kritisch und trifft die endgültige Entscheidung.

- Das System markiert eine verdächtige Struktur auf dem Bildschirm mit Angabe des Konfidenzlevels.

- Der Chirurg bestätigt den Befund visuell und bewertet ihn im Kontext der umgebenden Anatomie.

- Der Chirurg trifft die Entscheidung über das weitere Vorgehen basierend auf dem vollständigen klinischen Kontext.

- Die rechtliche Verantwortung für das Operationsergebnis liegt beim Chirurgen, nicht beim Algorithmus.

KI ist ein Instrument, das die Möglichkeiten des Chirurgen erweitert, aber nicht dessen Expertise, Erfahrung und Fähigkeit zum klinischen Urteil unter Unsicherheit ersetzt.

Verantwortung und Rechenschaftspflicht in KI-Systemen: Wer haftet, wenn der Algorithmus irrt

Verantwortungsverteilung zwischen Entwicklern und Klinikern

Das rechtliche Haftungsmodell für medizinische KI-Systeme bleibt fragmentiert: Der Entwickler haftet für Produktmängel, der Kliniker für klinische Entscheidungen, die unter Verwendung dieses Produkts getroffen werden.

Für Computer-Vision-Systeme in der Nebenschilddrüsenchirurgie bedeutet dies: Wenn der Algorithmus eine Drüse aufgrund eines technischen Fehlers übersieht, kann die Haftung beim Hersteller liegen; wenn der Chirurg eine korrekte Warnung ignoriert oder blind einem falsch-positiven Signal ohne klinische Verifikation folgt, geht die Verantwortung auf ihn über.

Wenn das System eine Empfehlung ohne Erklärung der Logik ausgibt, kann der Kliniker deren Zuverlässigkeit nicht bewerten — dies schafft ein ethisches Dilemma: einem intransparenten Algorithmus vertrauen oder sich nur auf die eigene Erfahrung verlassen.

Regulierungsbehörden (FDA, EMA) fordern Validierung an unabhängigen Datensätzen und Post-Market-Monitoring, aber Standards für „ausreichende Transparenz" in der klinischen Anwendung befinden sich noch in der Entwicklung.

Rechtliche Aspekte medizinischer Fehler bei KI-Einsatz

Präzedenzfälle zu KI-assistierten medizinischen Fehlern existieren praktisch nicht, was rechtliche Unsicherheit für alle Beteiligten schafft.

| Fehlerszenario | Gerichtliche Frage | Verantwortlicher |

|---|---|---|

| Algorithmus identifizierte Nebenschilddrüse nicht | Technischer Systemdefekt? | Hersteller |

| Chirurg absolvierte keine KI-Schulung | Unzureichende Vorbereitung? | Einrichtung |

| Chirurg ignorierte Systemwarnung | Klinische Fahrlässigkeit? | Chirurg |

Die Doktrin der informierten Einwilligung erfordert Überarbeitung: Muss der Patient darüber informiert werden, dass in der Operation ein KI-System verwendet wird, wie hoch dessen Genauigkeitswerte sind, und hat er das Recht, dessen Einsatz abzulehnen.

Versicherungsgesellschaften beginnen, KI-assistierte Verfahren in Berufshaftpflichtpolicen aufzunehmen, aber Prämien und Deckungsbedingungen variieren stark und spiegeln die Unsicherheit der Risiken wider.

FIG_02: Modell der Verantwortungsverteilung in KI-assistierter Chirurgie

┌─────────────────────────────────────────────────────────────┐ │ HAFTUNGSEBENE │ SUBJEKT │ RISIKOTYP │ ├─────────────────────────────────────────────────────────────┤ │ Technischer Algorithmusfehler │ Entwickler │ Product │ │ Unzureichende Validierung │ Regulator │ Regulatory │ │ Fehlerhafte Interpretation │ Kliniker │ Clinical │ │ Fehlende Personalschulung │ Einrichtung│ Institutional│ │ Ignorieren von Warnungen │ Chirurg │ Professional│ └─────────────────────────────────────────────────────────────┘

Systematische Reviews und Meta-Analysen: Ethik der Datensynthese im Zeitalter der Informationsüberflutung

Minimierung von Publikationsbias und selektiver Ergebnisdarstellung

Publication Bias — eine systematische Verzerrung, bei der Studien mit positiven Ergebnissen häufiger publiziert werden als solche mit negativen oder Nullergebnissen — bleibt die Hauptbedrohung für die Validität von Meta-Analysen.

Für ein systematisches Review zur Anti-VEGF-Therapie bei neovaskulärer altersbedingter Makuladegeneration ist dies kritisch: Wenn Studien, die keine Unterschiede zwischen Präparaten zeigten, unveröffentlicht bleiben, überschätzt die Netzwerk-Meta-Analyse die Wirksamkeit bestimmter Wirkstoffe gegenüber anderen.

Detektionsmethoden (Funnel Plots, Egger-Test, Trim-and-Fill-Analyse) haben bei geringer Studienzahl limitierte Sensitivität — dies ist kein Bug, sondern eine fundamentale Limitation der Statistik kleiner Stichproben.

Ethisches Protokoll für Autoren systematischer Reviews:

- Suche nach unveröffentlichten Daten über Studienregister (ClinicalTrials.gov, EudraCT).

- Kontakt mit Autoren der Originalstudien zur Erlangung unveröffentlichter Ergebnisse.

- Explizite Diskussion des potenziellen Einflusses von Publication Bias auf die Schlussfolgerungen.

Transparenz der Methodik bei Studienauswahl und Subgruppenanalysen

Die Präregistrierung des Protokolls eines systematischen Reviews (PROSPERO für medizinische Reviews) fixiert Einschlusskriterien, Suchstrategie und Analyseplan vor Arbeitsbeginn.

Für ein Review zum Zusammenhang zwischen BMI und Brustkrebsrisiko bedeutet dies: Autoren müssen vorab definieren, ob sie Subgruppen nach Menopausenstatus und molekularen Subtypen analysieren werden, oder ob diese Analysen explorativ sind.

Post-hoc-Subgruppenanalysen ohne vorherige Spezifikation erhöhen das Risiko falsch-positiver Befunde (p-hacking) drastisch und sollten als hypothesengenerierend, nicht als bestätigend interpretiert werden.

Das Reporting folgt den PRISMA-Standards (Preferred Reporting Items for Systematic Reviews and Meta-Analyses):

- Vollständiges Flussdiagramm der Studienauswahl.

- Tabellen mit Charakteristika eingeschlossener und ausgeschlossener Studien.

- Bewertung des Bias-Risikos für jede Studie unter Verwendung validierter Instrumente (Cochrane RoB 2, ROBINS-I).

Die Zukunft der KI-Ethik in der personalisierten Medizin: von gleichem Zugang zu fairen Algorithmen

Gerechtigkeit beim Zugang zu KI-Technologien und digitale Ungleichheit

Die Implementierung von KI-Systemen in der klinischen Praxis vertieft bestehende Ungleichheiten im Gesundheitswesen: Technologien konzentrieren sich in großen akademischen Zentren entwickelter Länder, während periphere und ressourcenarme Einrichtungen ohne Zugang bleiben. Für die KI-gestützte Identifikation von Nebenschilddrüsen bedeutet dies eine Kluft in der Versorgungsqualität — Chirurgen in gut ausgestatteten Kliniken erhalten ein Instrument, das das Komplikationsrisiko senkt, ihre Kollegen in regionalen Krankenhäusern arbeiten ohne diese Unterstützung.

Ökonomische Barrieren: hohe Lizenzkosten, Bedarf an spezialisierter Ausrüstung (hochauflösende Kameras, Rechenkapazitäten) und Personalschulung. Die ethische Antwort erfordert die Entwicklung von Open-Source-Lösungen, Subventionierung der Implementierung in ressourcenarmen Settings und die Einbeziehung von Kriterien für gerechten Zugang in die regulatorische Bewertung.

Gerechtigkeit in der KI-Medizin ist keine Wohltätigkeit, sondern Voraussetzung für die Validität der Technologie selbst. Ein System, das nur für wohlhabende Zentren funktioniert, löst keine klinische Aufgabe, sondern reproduziert soziale Ungleichheit.

Vermeidung algorithmischer Diskriminierung und Sicherstellung der Datenrepräsentativität

Algorithmische Verzerrung entsteht, wenn Trainingsdaten nicht repräsentativ für die Population sind, auf die das System angewendet wird. Wenn ein KI-Modell zur Identifikation von Nebenschilddrüsen überwiegend mit Bildern von Patienten europäischer Herkunft trainiert wurde, kann seine Genauigkeit bei Patienten anderer ethnischer Gruppen aufgrund von Unterschieden in Anatomie, Gewebepigmentierung oder Begleitpathologie geringer sein.

Systematische Reviews müssen die demografische Zusammensetzung der Teilnehmer eingeschlossener Studien bewerten und Einschränkungen der Generalisierbarkeit der Ergebnisse explizit diskutieren. Für Meta-Analysen zur Anti-VEGF-Therapie ist es kritisch zu berücksichtigen, dass Wirksamkeit und Sicherheit zwischen Populationen aufgrund genetischer Faktoren, Komorbiditätsmuster und Zugang zu Monitoring variieren.

| Prüfebene | Was zu bewerten ist | Warnsignal |

|---|---|---|

| Trainingsdaten | Demografische Zusammensetzung, geografische Herkunft der Proben | Mehr als 80% einer ethnischen Gruppe oder Region |

| Validierung | Genauigkeit nach Subgruppen (Alter, Geschlecht, Ethnizität, Komorbidität) | Genauigkeitsschwankung >5% zwischen Subgruppen |

| Regulierung | Explizite Angabe von Anwendbarkeitsgrenzen in der Anleitung | Fehlende Fairness-Analyse in der Dokumentation |

Regulatorische Anforderungen entwickeln sich in Richtung obligatorischer Fairness-Bewertung: Entwickler müssen nachweisen, dass das System mit vergleichbarer Genauigkeit für alle relevanten Subgruppen funktioniert, oder Anwendbarkeitsgrenzen explizit angeben.

Ein Algorithmus, der im Durchschnitt gut funktioniert, aber schlecht für eine Minderheit — das ist kein Fortschritt, sondern systematisierter Fehler. Fairness ist keine Ergänzung zur Validität, sondern Teil davon.

FIG_03: Prinzipien ethischer KI-Implementierung in der Medizin

┌──────────────────────────────────────────────────────────────┐

│ PRINZIP │ UMSETZUNG │ METRIK │

├──────────────────────────────────────────────────────────────┤

│ Transparenz │ Explainable AI │ SHAP values │

│ Fairness │ Diverse datasets │ Equity metrics│

│ Rechenschaftspflicht │ Audit trails │ Decision logs │

│ Sicherheit │ Validation studies │ AUC, NPV, PPV │

│ Vertraulichkeit │ Federated learning │ Privacy budget│

│ Menschliche Kontrolle│ Human-in-the-loop │ Override rate │

└──────────────────────────────────────────────────────────────┘

↓

KLINISCHER NUTZEN > TECHNOLOGISCHES RISIKO

Knowledge Access Protocol

FAQ

Häufig gestellte Fragen

KI-Ethik in der Medizin ist ein System von Prinzipien, die die Entwicklung und Anwendung künstlicher Intelligenz in der klinischen Praxis regeln. Sie umfasst Patientenautonomie, Transparenz von Algorithmen, gerechten Zugang und Schutz personenbezogener Daten. Diese Prinzipien gewährleisten eine sichere Implementierung von Technologien unter Wahrung der ärztlichen Verantwortung.

KI-Systeme mit Computer Vision analysieren intraoperative Bilder in Echtzeit und unterstützen Chirurgen bei der Erkennung von Nebenschilddrüsen. Dies reduziert das Risiko versehentlicher Schädigung oder Entfernung der Drüsen, was Hypokalzämie verhindert. Die Technologie bleibt ein unterstützendes Werkzeug, die endgültige Entscheidung trifft der Chirurg.

Ja, eine informierte Einwilligung ist obligatorisch beim Einsatz von KI-Systemen in Diagnostik und Behandlung. Der Patient muss verstehen, dass Algorithmen an Entscheidungen beteiligt sind, welche Daten verarbeitet werden und welche Risiken bestehen. Dies entspricht dem Prinzip der Autonomie und den Anforderungen der medizinischen Ethik.

Nein, das ist ein verbreiteter Mythos – KI ersetzt Ärzte nicht, sondern ergänzt ihre Arbeit. Algorithmen analysieren Daten und schlagen Optionen vor, aber klinisches Denken, Empathie und Verantwortung bleiben beim Facharzt. Systematische Reviews bestätigen, dass KI nur als Entscheidungsunterstützungsinstrument effektiv ist.

Der Schutz wird durch Verschlüsselungsprotokolle, Zugangskontrollen und Anonymisierung personenbezogener Patientendaten gewährleistet. Systeme müssen den Anforderungen der Informationssicherheit und der Datenschutzgesetzgebung entsprechen. Regelmäßige Audits und Zertifizierungen bestätigen die Zuverlässigkeit der Technologien.

Die Verantwortung wird zwischen Algorithmus-Entwicklern, medizinischer Einrichtung und behandelndem Arzt aufgeteilt. Der Arzt trägt die hauptsächliche klinische Verantwortung, da er die endgültige Entscheidung auf Basis der KI-Empfehlungen trifft. Rechtliche Aspekte erfordern eine klare Dokumentation des Entscheidungsprozesses.

Transparenz bedeutet, dass Ärzte und Patienten nachvollziehen können, wie ein KI-System zu einer bestimmten Schlussfolgerung oder Empfehlung gelangt ist. Erklärbare Algorithmen zeigen die Schlüsselfaktoren, die die Entscheidung beeinflussen, was das Vertrauen erhöht. Dies ist kritisch wichtig für die klinische Praxis und ethische Akzeptanz von Technologien.

Bewerten Sie die Transparenz der Methodik zur Studienauswahl, das Vorhandensein eines Protokolls und die Analyse von Publikationsbias. Eine qualitativ hochwertige Meta-Analyse gibt Einschlusskriterien, durchsuchte Datenbanken und statistische Methoden an. Systematische Reviews aus PubMed durchlaufen in der Regel eine strenge Peer-Review.

Ja, algorithmische Diskriminierung ist möglich, wenn Trainingsdaten Verzerrungen nach Geschlecht, Alter, ethnischer Zugehörigkeit oder sozialem Status enthalten. Dies führt zu ungleicher Qualität von Diagnostik und Behandlung für verschiedene Gruppen. Prävention erfordert diverse Datensätze und regelmäßige Audits zur Algorithmus-Fairness.

Nein, das ist ein Irrtum – die Genauigkeit von KI hängt von Datenqualität, Kontext und Aufgabentyp ab. In einigen engen Bereichen (z.B. Bildanalyse) zeigen Algorithmen hohe Genauigkeit, sind aber bei komplexer Bewertung unterlegen. Das optimale Ergebnis wird durch die Zusammenarbeit von Arzt und KI erreicht.

Gerechtigkeit erfordert die Verfügbarkeit von Technologien für alle medizinischen Einrichtungen unabhängig von Region und Finanzierung. Notwendig sind staatliche Förderprogramme, Standardisierung und Schulung von Fachkräften. Dies verhindert digitale Ungleichheit in der Qualität der medizinischen Versorgung zwischen Städten und Regionen.

Publikationsbias entsteht, wenn Studien mit positiven Ergebnissen häufiger veröffentlicht werden als solche mit negativen oder neutralen Resultaten. Dies verzerrt die Schlussfolgerungen von Meta-Analysen und überschätzt die Wirksamkeit von Interventionen. Minimierung erfordert die Suche nach unveröffentlichten Daten und statistische Tests auf Bias.

Nein, kritische Entscheidungen über Leben und Tod müssen bei Ärzten verbleiben unter Berücksichtigung ethischer Prinzipien und menschlichen Urteilsvermögens. KI kann prognostische Informationen liefern, besitzt aber keinen moralischen Status für solche Entscheidungen. Automatisierung in kritischen Situationen ist ethisch inakzeptabel.

KI transformiert die Rolle des Chirurgen vom Ausführenden zum Supervisor hochtechnologischer Systeme, wobei die finale Kontrolle bei ihm verbleibt. Algorithmen unterstützen bei der Identifikation von Strukturen und Planung, aber manuelle Fertigkeiten und klinisches Denken bleiben unverzichtbar. Dies erfordert neue Kompetenzen im Umgang mit digitalen Instrumenten.

Intransparente Algorithmen ("Black Boxes") erschweren die Fehlererkennung, reduzieren das Vertrauen von Ärzten und Patienten und schaffen juristische Risiken. Die Unmöglichkeit, Entscheidungen zu erklären, behindert klinisches Lernen und Verifikation von Empfehlungen. Dies kann zu falscher Behandlung und ethischen Verstößen führen.

Die Ethik wird sich auf Gerechtigkeit beim Zugang zu personalisierten Technologien, Schutz genomischer Daten und Verhinderung von Diskriminierung aufgrund genetischer Merkmale konzentrieren. Neue regulatorische Rahmen werden erforderlich sein, um Innovation und Patientenrechte auszubalancieren. Internationale Zusammenarbeit wird zum Schlüssel für die Entwicklung universeller Standards.