📊 Grundlagen des maschinellen Lernens

📊 Grundlagen des maschinellen LernensGrundlegende Prinzipien und Konzepte des maschinellen Lernens für Anfängerλ

Lernen Sie grundlegende Algorithmen, mathematische Grundlagen und praktische Methoden des maschinellen Lernens kennen, die das Fundament moderner künstlicher Intelligenz und Datenanalyse bilden

Overview

Machine Learning ist die Fähigkeit eines Systems, Muster in Daten zu erkennen und auf neue Aufgaben anzuwenden, ohne dass Regeln fest programmiert werden müssen. Mathematik ist hier 🧩 keine Dekoration: Lineare Algebra beschreibt Merkmalsräume, Wahrscheinlichkeitstheorie die Unsicherheit, Optimierung die Suche nach den besten Parametern. Wenn Sie diese drei Bausteine beherrschen, erhalten Sie das Werkzeug zum Verständnis jedes Algorithmus – von der linearen Regression bis zu Transformern.

🛡️

Laplace-Protokoll: Die Grundlagen des maschinellen Lernens sind nicht nur eine Sammlung von Algorithmen, sondern ein systematischer Ansatz zur Wissensextraktion aus Daten, der ein Verständnis von Statistik, linearer Algebra und Optimierung erfordert, um zuverlässige prädiktive Modelle zu erstellen.

Reference Protocol

Wissenschaftliche Grundlage

Evidenzbasierter Rahmen für kritische Analyse

Protocol: Evaluation

Teste Dich

Quiz zu diesem Thema kommt bald

Sector L1

Artikel

Forschungsmaterialien, Essays und tiefe Einblicke in die Mechanismen des kritischen Denkens.

📊 Grundlagen des maschinellen Lernens

📊 Grundlagen des maschinellen Lernens⚡

Vertiefung

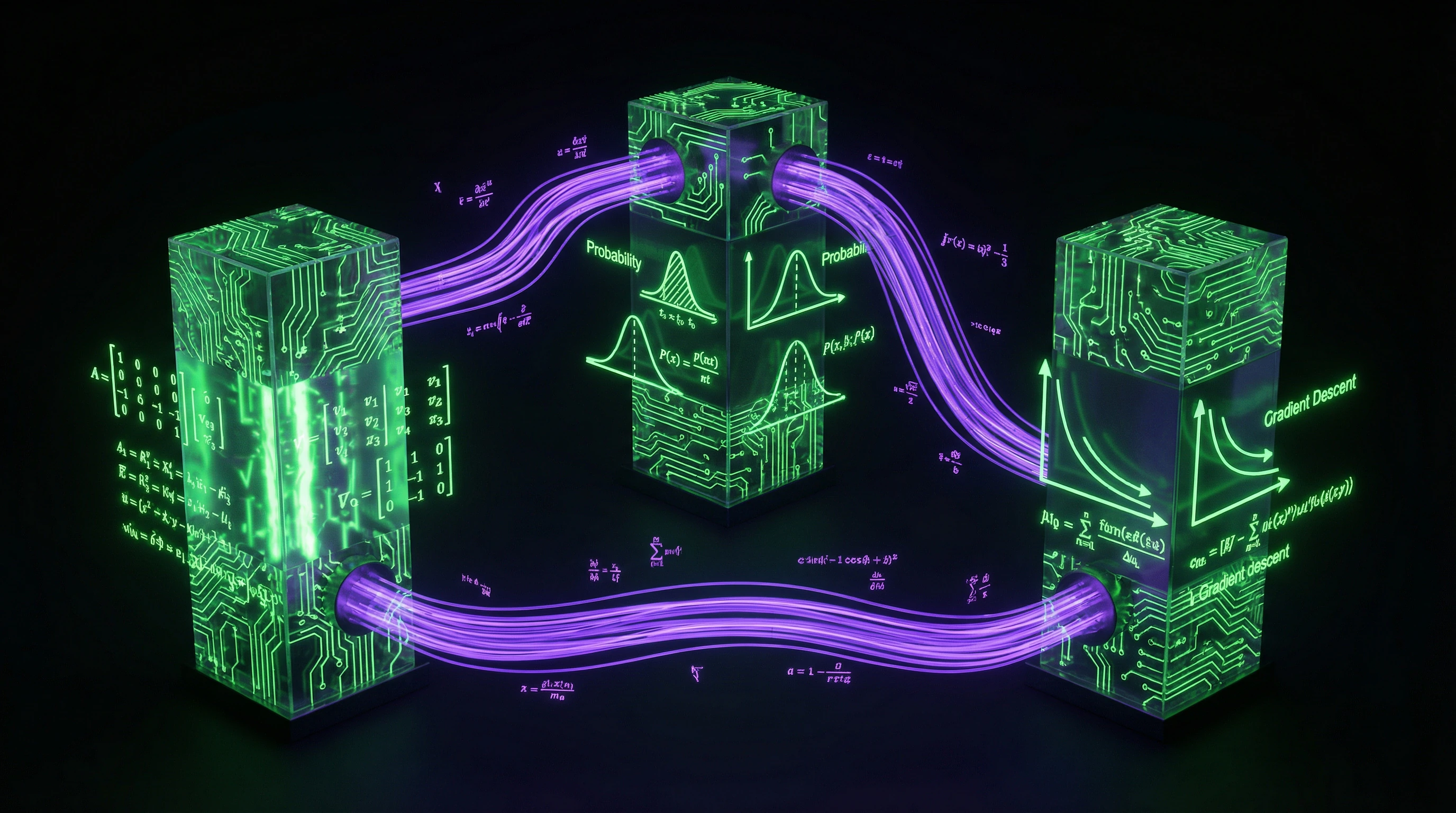

Mathematische Grundlagen des maschinellen Lernens: drei Säulen, ohne die Algorithmen nicht funktionieren

Maschinelles Lernen basiert auf drei mathematischen Disziplinen. Jede löst eine konkrete Aufgabe: Lineare Algebra repräsentiert Daten in mehrdimensionalen Strukturen, Wahrscheinlichkeitstheorie arbeitet mit Unsicherheit, Optimierungsmethoden suchen die besten Modellparameter.

Ohne Verständnis dieser Grundlagen ist es unmöglich, neue Algorithmen zu entwickeln oder bestehende kompetent anzuwenden.

Lineare Algebra und Vektorräume

Jedes Datenobjekt im maschinellen Lernen ist ein Vektor in einem mehrdimensionalen Raum, wobei jede Dimension einem Merkmal entspricht. Operationen mit Matrizen (Multiplikation, Transponierung, Eigenvektoren) bilden die Grundlage neuronaler Netze: Jede Schicht führt eine lineare Transformation der Eingabedaten mit anschließender Anwendung einer nichtlinearen Aktivierungsfunktion durch.

- Skalarprodukt

- Misst die Ähnlichkeit zwischen Vektoren — kritisch für Klassifikation und Clustering.

- Matrixzerlegung (SVD, PCA)

- Reduziert die Dimensionalität der Daten und extrahiert die bedeutendsten Merkmale.

Wahrscheinlichkeitstheorie und Statistik

Probabilistische Modelle bilden die Grundlage bayesscher Methoden, bei denen jede Vorhersage mit einer Bewertung der Modellsicherheit einhergeht. Bedingte Wahrscheinlichkeit, Bayes-Theorem und Wahrscheinlichkeitsverteilungen sind notwendig für den Aufbau generativer Modelle und die Arbeit mit unvollständigen Daten.

| Instrument | Anwendung |

|---|---|

| Statistische Tests (t-Test, Chi-Quadrat) | Bewertung der Merkmalssignifikanz und Modellqualität |

| Maximum-Likelihood | Training parametrischer Modelle (logistische Regression, Naive-Bayes-Klassifikator) |

Optimierungsmethoden und Gradientenabstieg

Das Training eines Modells läuft auf die Suche nach Parametern hinaus, die die Verlustfunktion auf den Trainingsdaten minimieren. Gradientenabstieg — ein iterativer Algorithmus, der sich in Richtung des steilsten Abstiegs der Funktion bewegt, indem er partielle Ableitungen für jeden Parameter berechnet.

- Stochastischer Gradientenabstieg (SGD) — aktualisiert Parameter bei jedem Beispiel, schneller, aber verrauschter.

- Adam — adaptive Lernrate mit Momentum, konvergiert oft schneller.

- RMSprop — passt die Lernrate für jeden Parameter separat an.

Das Verständnis der Konvexität von Funktionen und Konvergenzbedingungen ist kritisch für die Wahl der Optimierungsstrategie und Hyperparameter des Trainings.

Aufgabentypen und Lernalgorithmen: Die Wahl des richtigen Ansatzes

Maschinelles Lernen wird nach Datentyp und Aufgabencharakter unterteilt. Überwachtes Lernen verwendet gelabelte Daten — für jedes Beispiel ist die richtige Antwort bekannt. Unüberwachtes Lernen arbeitet mit ungelabelten Daten und sucht nach verborgenen Mustern.

Die Wahl des Ansatzes hängt nicht nur vom Vorhandensein von Labels ab, sondern auch von der Geschäftsaufgabe, dem Datenvolumen und den Anforderungen an die Interpretierbarkeit.

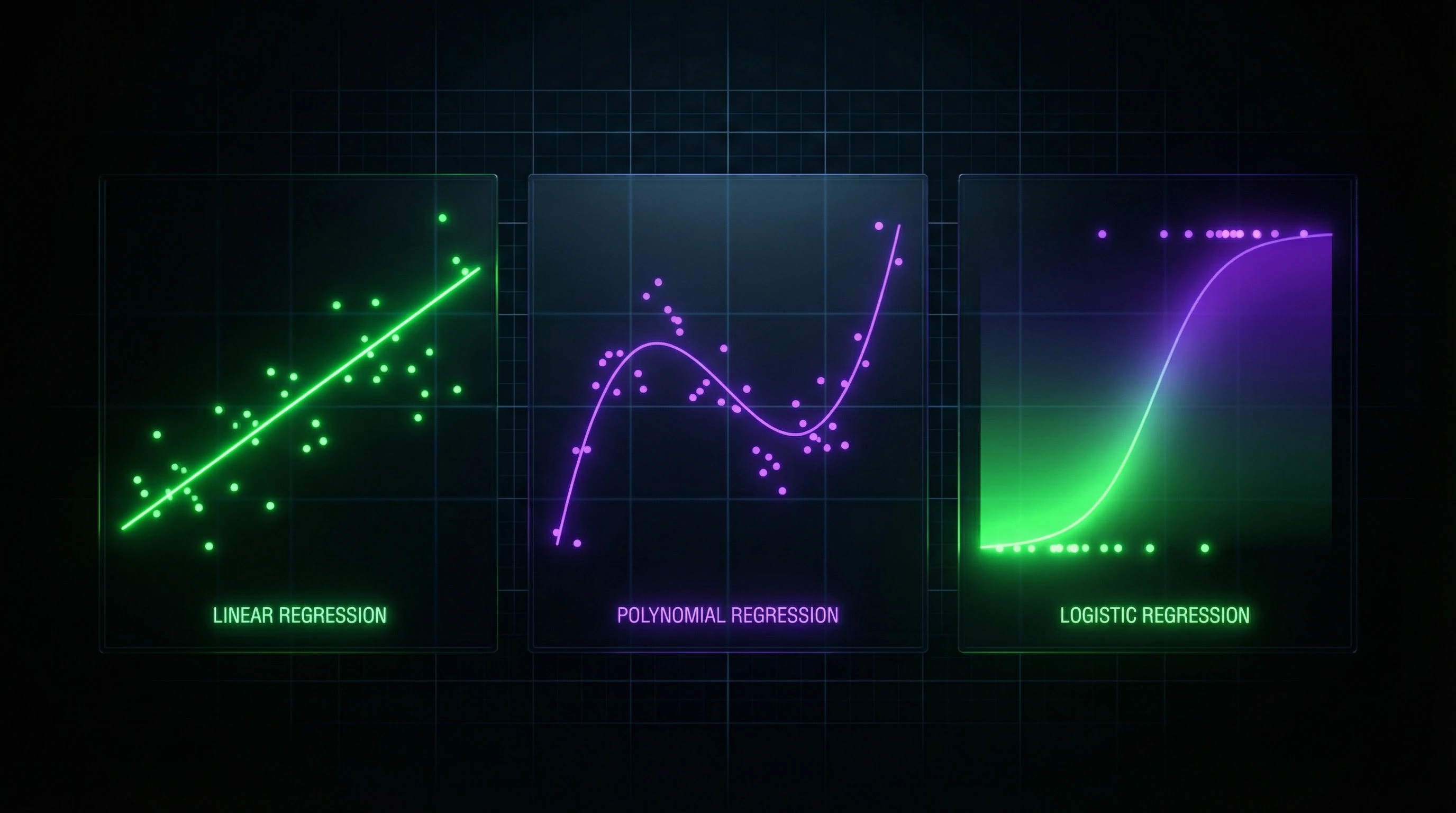

Überwachtes Lernen: Klassifikation und Regression

Klassifikation sagt diskrete Labels vorher — Spam oder kein Spam, Katze oder Hund. Regression sagt kontinuierliche Zahlen vorher — Preis, Temperatur, Verkaufsvolumen.

| Aufgabentyp | Beispiele für Algorithmen | Qualitätsmetriken |

|---|---|---|

| Klassifikation | Logistische Regression, Entscheidungsbäume, SVM, neuronale Netze | Accuracy, Precision, Recall, F1-Score |

| Regression | Lineare Regression, polynomiale Modelle, Gradient Boosting | MSE, RMSE, MAE |

Jeder Algorithmus hat seine Vorteile abhängig von der Datengröße und der Komplexität der Grenze zwischen Klassen oder dem Charakter der Werteverteilung.

Unüberwachtes Lernen: Clustering und Dimensionsreduktion

Clustering gruppiert Objekte nach Ähnlichkeit ohne vordefinierte Kategorien — segmentiert Kunden, erkennt Anomalien, organisiert große Datenmengen. K-means, hierarchisches Clustering und DBSCAN unterscheiden sich in der Art der Ähnlichkeitsbestimmung und der Form der Cluster.

Methoden zur Dimensionsreduktion — PCA, t-SNE, UMAP — projizieren Daten aus hochdimensionalen Räumen in niedrigdimensionale Räume, bewahren wichtige Informationen und ermöglichen die Visualisierung der Struktur.

Diese Techniken sind kritisch wichtig für die Arbeit mit Daten, die Hunderte oder Tausende von Merkmalen enthalten, wo eine direkte Analyse unmöglich ist.

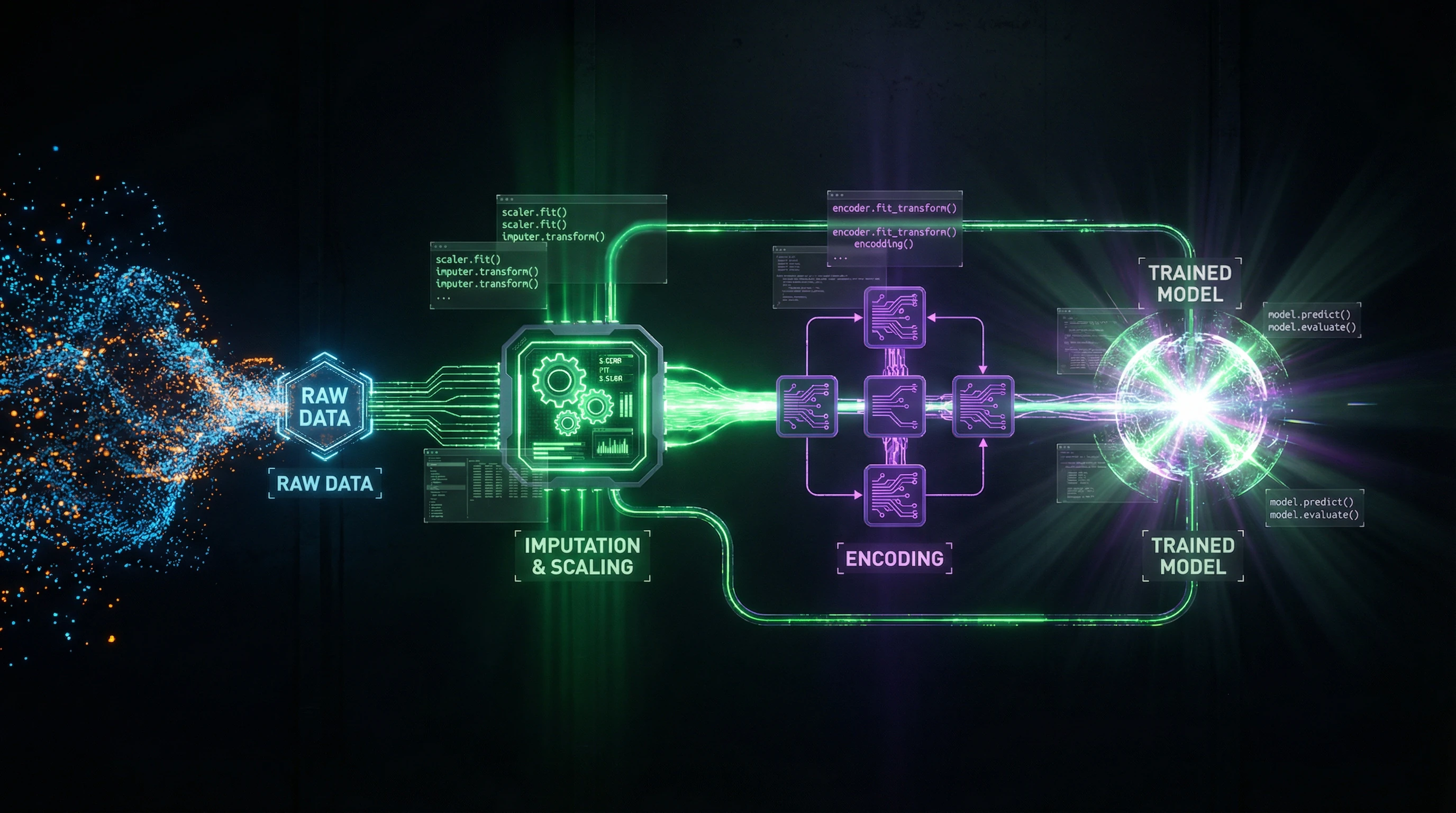

Datenvorbereitung und -verarbeitung: 80% der Arbeit, die den Modellerfolg bestimmt

Die Datenqualität bestimmt direkt die Qualität des trainierten Modells — selbst der ausgefeilteste Algorithmus kann keine nützlichen Muster aus verrauschten, unvollständigen oder falsch vorbereiteten Daten extrahieren. Diese Arbeit nimmt den Großteil der Zeit in realen Machine-Learning-Projekten ein, aber sie bestimmt, ob das Modell in der Produktion funktionieren wird.

Datenbereinigung und Normalisierung

Reale Daten enthalten fehlende Werte, Duplikate, Ausreißer und Eingabefehler, die vor Beginn des Trainings verarbeitet werden müssen. Strategien für den Umgang mit fehlenden Werten umfassen das Löschen von Zeilen, das Auffüllen mit Mittelwerten oder Medianwerten oder die Verwendung komplexerer Imputationsmethoden basierend auf anderen Merkmalen.

| Normalisierungsmethode | Formel/Bereich | Wann verwenden |

|---|---|---|

| Min-Max-Skalierung | [0, 1] | Wenn ein fester Bereich benötigt wird |

| Standardisierung (Z-Score) | Mittelwert 0, Varianz 1 | Für skalierungsempfindliche Algorithmen (Gradientenabstieg, KNN) |

| Logarithmierung | log(x) | Für Potenzverteilungen und große Wertebereiche |

Die Behandlung von Ausreißern erfordert eine Balance zwischen dem Entfernen anomaler Werte und dem Bewahren seltener, aber wichtiger Fälle.

Feature-Extraktion und Feature-Engineering

Feature-Engineering ist der Prozess der Erstellung neuer informativer Merkmale aus vorhandenen Daten basierend auf Domänenwissen und Datenanalyse. Qualitativ hochwertiges Feature-Engineering führt oft zu größeren Qualitätssteigerungen des Modells als der Wechsel zu einem komplexeren Algorithmus.

Für Zeitreihen kann dies die Extraktion von Trends, Saisonalität und Lags sein; für Texte — die Erstellung von N-Grammen, TF-IDF-Gewichten oder Embeddings; für Bilder — die Extraktion von Texturen, Kanten und Formen.

Feature-Transformationen umfassen polynomiale Features zur Erfassung nichtlinearer Abhängigkeiten und One-Hot-Encoding für kategoriale Variablen.

Datenaufteilung und Kreuzvalidierung

Die korrekte Aufteilung der Daten in Trainings-, Validierungs- und Testdatensätze verhindert Overfitting und liefert eine ehrliche Bewertung der Modellqualität auf neuen Daten.

- Standardverhältnis: 60–70% für Training, 15–20% für Validierung, 15–20% für finales Testing (wird einmal durchgeführt)

- Kreuzvalidierung teilt die Daten in k Teile und trainiert k Modelle, wobei jedes Mal unterschiedliche Teile für Training und Validierung verwendet werden

- Für Zeitreihen wird eine spezielle Strategie mit Beibehaltung der zeitlichen Reihenfolge verwendet

- Für unbalancierte Klassen wird stratifizierte Aufteilung angewendet, die die Klassenproportionen in allen Datensätzen bewahrt

Kreuzvalidierung liefert eine zuverlässigere Qualitätsbewertung bei begrenztem Datenvolumen.

Grundlegende Machine-Learning-Algorithmen: von Regression bis Ensembles

Lineare Regression modelliert die Abhängigkeit der Zielvariablen als gewichtete Summe der Merkmale plus Absolutglied und minimiert den mittleren quadratischen Fehler zwischen Vorhersagen und tatsächlichen Werten.

Die Methode der kleinsten Quadrate findet optimale Gewichte analytisch über die Pseudoinverse, was das Training schnell macht, aber eine lineare Beziehung zwischen Merkmalen und Ziel erfordert. Logistische Regression wendet eine Sigmoidfunktion auf die lineare Kombination der Merkmale an und transformiert das Ergebnis in eine Wahrscheinlichkeit der Klassenzugehörigkeit.

Trotz des Namens löst logistische Regression Klassifikationsaufgaben, nicht Regressionsaufgaben, und ist besonders effektiv für binäre Klassifikation mit linear trennbaren Klassen.

Lineare und logistische Regression

Regularisierung fügt der Verlustfunktion eine Strafe für große Gewichtswerte hinzu. L1-Regularisierung (Lasso) verwendet die Summe der Beträge der Gewichte und führt zu spärlichen Lösungen mit Nullkoeffizienten, wodurch faktisch Feature-Selektion durchgeführt wird.

L2-Regularisierung (Ridge) verwendet die Summe der Quadrate der Gewichte und verringert alle Koeffizienten gleichmäßig. Elastic Net kombiniert beide Ansätze und balanciert zwischen Feature-Selektion und Lösungsstabilität über zwei Hyperparameter.

- Polynomiale Regression

- Erweitert das lineare Modell durch Erzeugung neuer Merkmale als Potenzen und Produkte der ursprünglichen. Ermöglicht die Modellierung nichtlinearer Abhängigkeiten, erhöht aber drastisch das Risiko von Overfitting bei hohen Graden.

- Standardisierung der Merkmale

- Kritisch wichtig für regularisierte Modelle, da die Strafen für Gewichte in der Größenordnung vergleichbar sein müssen.

Entscheidungsbäume und Random Forests

Ein Entscheidungsbaum teilt den Merkmalsraum rekursiv in rechteckige Bereiche auf, indem er in jedem Schritt das Merkmal und den Schwellenwert wählt, die die Unsicherheit in den Kindknoten maximal reduzieren, gemessen durch Entropie für Klassifikation oder Varianz für Regression.

Der Algorithmus baut den Baum gierig von oben nach unten auf und stoppt beim Erreichen der maximalen Tiefe, der minimalen Anzahl von Objekten im Blatt oder wenn weitere Aufteilungen die Qualität nicht verbessern. Bäume sind interpretierbar, arbeiten mit kategorialen Merkmalen ohne Kodierung und führen automatisch Feature-Selektion durch.

Bäume neigen zu Overfitting und sind instabil — kleine Datenänderungen können die Baumstruktur radikal verändern.

Random Forest trainiert viele Bäume auf zufälligen Teilstichproben der Daten (Bagging) mit zusätzlicher Randomisierung durch Auswahl einer zufälligen Teilmenge von Merkmalen in jedem Knoten. Die finale Vorhersage ergibt sich durch Mittelung für Regression oder Abstimmung für Klassifikation.

Diese Strategie reduziert Overfitting und Vorhersagevarianz radikal, während die niedrige Verzerrung der Bäume erhalten bleibt, was Random Forests zu einem der zuverlässigsten Allzweck-Algorithmen macht. Gradient Boosting baut Bäume sequenziell auf, wobei jeder nachfolgende die Fehler der vorherigen korrigiert, indem er auf den Gradienten der Verlustfunktion trainiert.

- Bietet höchste Genauigkeit unter den baumbasierten Methoden

- Erfordert sorgfältige Abstimmung von Learning Rate und Anzahl der Bäume

- Benötigt Schutz vor Overfitting durch Early Stopping

Support Vector Machines

SVM sucht eine Hyperebene, die den Margin maximiert — den Abstand zu den nächstgelegenen Objekten verschiedener Klassen, die Support-Vektoren genannt werden. Dies gewährleistet bessere Generalisierungsfähigkeit im Vergleich zur einfachen Klassentrennung.

Für linear nicht trennbare Daten wird eine Slack-Variable eingeführt, die es einigen Objekten erlaubt, den Margin mit kontrollierter Strafe über den Parameter C zu verletzen, der zwischen Margin-Breite und Fehleranzahl balanciert.

Der Kernel-Trick bildet Daten implizit über Kernfunktionen in einen hochdimensionalen Raum ab, wo Klassen linear trennbar werden, ohne explizite Berechnung der Koordinaten im neuen Raum.

RBF-Kernel erzeugt einen unendlichdimensionalen Merkmalsraum und ist besonders effektiv für komplexe nichtlineare Grenzen, erfordert aber die Abstimmung des Parameters gamma, der den Einflussradius jedes Objekts kontrolliert.

Bewertung der Modellqualität: Metriken und Validierungsstrategien

Klassifikations- und Regressionsmetriken

Bei der Klassifikation misst Accuracy den Anteil korrekter Vorhersagen, ist aber bei unbalancierten Klassen nutzlos — ein Modell, das nur die Mehrheitsklasse vorhersagt, erhält hohe Accuracy ohne echten Nutzen.

Precision zeigt den Anteil echter Positive unter allen vorhergesagten Positiven (kritisch, wenn Fehlalarme teuer sind). Recall — der Anteil gefundener Positive unter allen tatsächlichen Positiven (kritisch, wenn Auslassungen gefährlich sind). F1-Score — ihr harmonisches Mittel, das beide Kennzahlen ausbalanciert.

| Metrik | Was sie misst | Wann zu verwenden |

|---|---|---|

| ROC-AUC | Fähigkeit, Objekte über alle Schwellenwerte zu ranken (0.5 = zufällig, 1.0 = ideal) | Wenn der Klassifikationsschwellenwert nicht im Voraus bekannt ist |

| MAE | Durchschnittliche Abweichung in Originaleinheiten, robust gegen Ausreißer | Regression mit Interpretierbarkeit |

| MSE / RMSE | Bestraft große Fehler; RMSE gibt Skala zurück | Regression, wenn Ausreißer kritisch sind |

| R² | Anteil erklärter Varianz (1 = ideal, 0 = Durchschnitt, <0 = schlechter als trivial) | Regression, Modellvergleich |

| MAPE | Fehler in Prozent der tatsächlichen Werte | Interpretierbarkeit, aber undefiniert bei Nullen |

Overfitting und Underfitting

Overfitting entsteht, wenn das Modell Rauschen und zufällige Muster der Trainingsdaten auswendig lernt statt echter Abhängigkeiten. Ergebnis: exzellente Qualität auf Train, schlechte auf Test — Zeichen hoher Varianz.

Underfitting zeigt sich in niedriger Qualität auf beiden Datensätzen aufgrund unzureichender Modellkomplexität. Das Modell kann echte Muster nicht erfassen — Problem hohen Bias.

Lernkurven (Metriken auf Train und Validation abhängig von der Stichprobengröße) zeigen die Diagnose: Bei Overfitting divergieren die Kurven mit großer Lücke; bei Underfitting bleiben beide auf niedrigem Niveau; bei optimaler Komplexität konvergieren sie auf hoher Qualität.

Regularisierung und Hyperparameter-Auswahl

Regularisierung kontrolliert die Modellkomplexität durch Strafterme in der Verlustfunktion (L1/L2), Beschränkungen der Baumtiefe, Dropout in neuronalen Netzen oder Early Stopping bei Validierungsmonitoring.

- Grid Search: durchläuft alle Kombinationen von Hyperparametern aus einem definierten Raster, garantiert Optimum im diskreten Raum, erfordert aber exponentiell viele Trainings bei wachsender Parameterzahl.

- Random Search: sampelt zufällig Kombinationen aus Verteilungen, findet oft schneller gute Lösungen als Grid Search, besonders wenn manche Parameter wichtiger sind als andere.

- Bayesian Optimization: baut ein probabilistisches Modell der Qualitätsabhängigkeit von Hyperparametern und wählt iterativ den nächsten Punkt, balanciert Exploration und Exploitation, minimiert die Anzahl kostspieliger Trainings.

Praktische Anwendung und Werkzeuge des maschinellen Lernens

Python-Bibliotheken für ML: scikit-learn, pandas, numpy

NumPy stellt mehrdimensionale Arrays und vektorisierte Operationen bereit, die dank C-Implementierung um Größenordnungen schneller als Python-Schleifen ausgeführt werden. Pandas baut auf NumPy auf und bietet DataFrame-Strukturen für tabellarische Daten mit benannten Spalten, Indizes sowie Werkzeugen zum Filtern, Gruppieren und Zusammenführen.

Scikit-learn implementiert Dutzende von Machine-Learning-Algorithmen mit einheitlicher API: Alle Modelle verfügen über fit()-Methoden zum Training und predict()-Methoden für Vorhersagen, was das Experimentieren mit verschiedenen Algorithmen durch Änderung einer einzigen Codezeile ermöglicht.

- Matplotlib und seaborn visualisieren Daten und Modellergebnisse

- Jupyter Notebook vereint Code, Visualisierungen und Text in einem einzigen Dokument

- Scikit-learn-Module: preprocessing für Skalierung, model_selection für Kreuzvalidierung, metrics für Qualitätsbewertung, pipeline zur Verkettung von Verarbeitungsschritten

Aufbau von Datenverarbeitungs-Pipelines

Pipeline wendet Datentransformationen und das finale Modell sequenziell an, garantiert identische Verarbeitung von Train- und Test-Daten und verhindert Informationslecks.

ColumnTransformer wendet unterschiedliche Transformationen auf verschiedene Merkmalsteilmengen an: Numerische werden mit StandardScaler skaliert, kategoriale mit OneHotEncoder kodiert, textuelle mit TfidfVectorizer vektorisiert — alles in einem Objekt.

Pipeline integriert sich mit GridSearchCV und ermöglicht die Optimierung von Hyperparametern sowohl der Transformationen als auch des Modells über eine einheitliche Schnittstelle mit automatischer Kreuzvalidierung für jede Parameterkombination.

FeatureUnion wendet mehrere Transformationen parallel auf dieselben Daten an und konkateniert die Ergebnisse, wodurch verschiedene Merkmalsrepräsentationen kombiniert werden können.

Custom Transformers werden durch Vererbung von BaseEstimator und TransformerMixin erstellt und implementieren die Methoden fit() und transform(). Serialisierung über joblib oder pickle speichert die trainierte Pipeline vollständig inklusive aller Transformationsparameter und Modellgewichte, was Reproduzierbarkeit und einfaches Deployment in Produktionsumgebungen gewährleistet.

Knowledge Access Protocol

FAQ

Häufig gestellte Fragen

Maschinelles Lernen ist ein Teilbereich der künstlichen Intelligenz, bei dem Computer lernen, Aufgaben anhand von Daten zu lösen, ohne dass jeder Schritt explizit programmiert wird. Algorithmen erkennen Muster in Beispielen und nutzen diese für Vorhersagen bei neuen Daten. Beispielsweise lernt ein Gesichtserkennungssystem anhand Tausender Fotos und identifiziert dann Personen auf neuen Aufnahmen.

Die Grundlage bilden lineare Algebra (Matrizen, Vektoren), Wahrscheinlichkeitstheorie und mathematische Statistik. Wichtig sind auch Optimierungsmethoden, insbesondere Gradientenabstieg für das Training von Modellen. Anfängern genügt das Verständnis grundlegender Konzepte, tiefgehende Kenntnisse sind für die Entwicklung neuer Algorithmen erforderlich.

Beim überwachten Lernen trainiert das Modell mit gelabelten Daten mit bekannten Antworten (z.B. Fotos mit den Beschriftungen ‹Katze› oder ‹Hund›). Unüberwachtes Lernen arbeitet mit ungelabelten Daten und findet verborgene Strukturen – Cluster ähnlicher Objekte oder Muster. Der erste Typ wird für Klassifikation und Regression verwendet, der zweite für Segmentierung und Dimensionsreduktion.

Das ist ein Mythos – der Datenbedarf hängt von Aufgabe und Algorithmus ab. Einfache Modelle (lineare Regression, Entscheidungsbäume) funktionieren effektiv mit Hunderten Beispielen. Tiefe neuronale Netze benötigen tatsächlich Millionen Datensätze, aber Techniken wie Transfer Learning und Data Augmentation ermöglichen das Training von Modellen auf kleineren Datensätzen mit guter Qualität.

Overfitting tritt auf, wenn ein Modell auf Trainingsdaten hervorragend funktioniert, aber schlecht auf neuen Daten, weil es Rauschen statt Muster "auswendig gelernt" hat. Vermeiden lässt sich das durch Regularisierung (L1/L2), Kreuzvalidierung, Vergrößerung des Datensatzes und Vereinfachung des Modells. Korrekte Aufteilung der Daten in Train/Validation/Test ist zur Kontrolle von Overfitting unerlässlich.

Beginne mit Python und den Bibliotheken numpy, pandas für Datenverarbeitung. Dann lerne scikit-learn – es enthält fertige Algorithmen und verständliche Dokumentation. Übe mit einfachen Datensätzen (Iris, Titanic) und lerne schrittweise die Theorie von linearer Regression, Entscheidungsbäumen und Qualitätsmetriken.

Die wichtigsten Metriken sind: Accuracy (Anteil korrekter Antworten), Precision (Genauigkeit), Recall (Vollständigkeit) und F1-Score (deren harmonisches Mittel). Bei unbalancierten Klassen ist Accuracy irreführend – besser sind Precision/Recall. ROC-AUC zeigt die Qualität der Klassentrennung bei verschiedenen Wahrscheinlichkeitsschwellen.

Feature Engineering ist die Erstellung neuer Merkmale aus Rohdaten zur Verbesserung der Modellqualität. Beispielsweise lassen sich aus einem Datum Wochentag, Monat oder Feiertag extrahieren. Richtiges Feature Engineering ist oft wichtiger als die Algorithmenwahl, besonders bei klassischen ML-Methoden, die komplexe Abhängigkeiten nicht automatisch erfassen.

Regression sagt kontinuierliche numerische Werte vorher (Wohnungspreis, Temperatur), Klassifikation dagegen Kategorien oder Klassen (Spam/kein Spam, Tierart). Für Regression verwendet man Metriken wie MSE, RMSE, MAE, für Klassifikation Accuracy und F1-Score. Manche Algorithmen (Entscheidungsbäume, neuronale Netze) lösen beide Aufgaben mit kleinen Anpassungen.

In den meisten Fällen ja, aber nicht immer. Random Forest mittelt die Vorhersagen vieler Bäume und reduziert damit Overfitting und Varianz. Allerdings ist er schwerer zu interpretieren, arbeitet langsamer und benötigt mehr Speicher. Für einfache Aufgaben mit wenigen Daten kann ein einzelner Baum ausreichend und verständlicher sein.

Kreuzvalidierung teilt die Daten in K Teile (Folds), trainiert das Modell auf K-1 Teilen und testet es auf dem verbleibenden Teil, wobei dieser Prozess K-mal wiederholt wird. Die endgültige Bewertung ist der Durchschnitt über alle Folds, was eine zuverlässige Qualitätseinschätzung liefert. Die Standardwahl sind 5 oder 10 Folds – ein ausgewogenes Verhältnis zwischen Bewertungsgenauigkeit und Rechenaufwand.

Normalisierung bringt Merkmale auf eine einheitliche Skala, was für skalierungssensitive Algorithmen (SVM, neuronale Netze, k-NN) entscheidend ist. Ohne sie würde ein Merkmal mit großen Werten (z.B. Einkommen in Euro) kleinere Merkmale (Alter) dominieren. Standardisierung (z-score) und Min-Max-Skalierung sind die gängigsten Normalisierungsmethoden.

Es gibt No-Code-Plattformen (Google AutoML, Azure ML Studio), die das Erstellen von Modellen über eine Benutzeroberfläche ermöglichen. Für ernsthafte Arbeit ist Programmierung jedoch notwendig – man muss Daten verarbeiten, Modelle anpassen und Lösungen integrieren. Python mit scikit-learn-Bibliotheken ist die Mindesteinstiegshürde, die Grundlagen lassen sich in wenigen Wochen erlernen.

Hyperparameter sind Algorithmuseinstellungen, die vor dem Training festgelegt werden (Baumtiefe, Learning Rate, Anzahl der Nachbarn bei k-NN). Sie werden durch Grid Search (systematisches Durchsuchen eines Werterasters) oder Random Search (zufällige Suche) optimiert. Wichtig ist die Verwendung von Kreuzvalidierung bei der Optimierung, um Overfitting auf dem Validierungsdatensatz zu vermeiden.

Ja, klassische Algorithmen (logistische Regression, SVM, Entscheidungsbäume) sind bei Datensätzen ab 100-1000 Beispielen effektiv. Der Schlüssel liegt in der richtigen Modellwahl und Regularisierung zur Vermeidung von Overfitting. Bei sehr kleinen Daten (Dutzende Beispiele) empfehlen sich einfache interpretierbare Modelle oder regelbasierte Expertenmethoden.

SVM sucht die optimale trennende Hyperebene mit maximalem Abstand zwischen den Klassen, logistische Regression maximiert die Wahrscheinlichkeit korrekter Klassifikation. SVM funktioniert besser in hochdimensionalen Räumen und löst mit dem Kernel-Trick nichtlineare Probleme. Logistische Regression ist einfacher zu interpretieren und liefert kalibrierte Wahrscheinlichkeiten für die Klassenzugehörigkeit.